結合改進主動學習的SVD-CNN彈幕文本分類算法

邱寧佳 叢琳 周思丞 王鵬 李巖芳

摘 要:為解決傳統卷積神經網絡(CNN)模型使用池化層進行文本特征降維會損失較多文本語義信息的問題,提出一種基于奇異值分解(SVD)算法的卷積神經網絡模型(SVD-CNN)。首先,采用改進的基于密度中心點采樣的主動學習算法(DBC-AL)選擇對分類模型貢獻率較高的樣本進行標注,以低標注代價獲得高質量模型訓練集;然后,結合SVD算法建立SVD-CNN彈幕文本分類模型,使用奇異值分解的方法代替傳統CNN模型池化層進行特征提取和降維,并在此基礎上完成彈幕文本分類任務;最后,使用改進的梯度下降算法(PSGD)對模型參數進行優化。為了驗證改進算法的有效性,使用多種彈幕數據樣本集,對提出的模型與常用的文本分類模型進行對比實驗。實驗結果表明,改進的算法能夠更好地保留文本語義特征,保證訓練過程的穩定性并提高了模型的收斂速度,在不同的彈幕文本上較傳統算法具有更好的分類性能。

關鍵詞:卷積神經網絡;奇異值分解;主動學習;梯度下降;文本分類

中圖分類號: TP391.1; TP18

文獻標志碼:A

文章編號:1001-9081(2019)03-0644-07

Abstract: For the loss of much semantic information in dimension reduction of text features when using pooling layer of the traditional Convolutional Network (CNN) model, a Convolutional Neural Network model based on Singular Value Decomposition algorithm (SVD-CNN) was proposed. Firstly, an improved Active Learning algorithm based on Density Center point sampling (DC-AL) was used to tag samples contributing a lot to the classification model, obtaining a high-quality model training set at a low tagging cost. Secondly, an SVD-CNN barrage text classification model was established by combining SVD algorithm, and SVD was used to replace the traditional CNN model pooling layer for feature extraction and dimension reduction, then the barrage text classification task was completed on these bases. Finally, the model parameters were optimized by using Partial Sampling Gradient Descent algorithm (PSGD). In order to verify the effectiveness of the improved algorithm, multiple barrage data sample sets were used in the comparison experiments between the proposed model and the common text classification model. The experimental results show that the improved algorithm can better preserve semantic features of the text, ensure the stability of training process and improve the convergence speed of the model. In summary, the proposed algorithm has better classification performance than traditional algorithms on multiple barrage texts.

Key words: Convolutional Nerual Network (CNN); Singular Value Decompostion (SVD); Active Learning (AL); gradient descent; text classification

0 引言

國內外研究者使用有監督的深度學習神經網絡進行文本分類,這種監督型檢測方法需要大量已標記數據,人工標注大量數據耗時耗力,因而難以實施。針對已有方法存在的問題,譚侃等[1]提出一種基于雙層采樣主動學習方法,用樣本不確定性、代表性和多樣性來評估未標記樣本的價值,使用排序和聚類相結合的雙層采樣算法對未標記的樣本進行篩選,使用少量有標簽樣本達到與有監督學習接近的檢測效果。徐海龍等[2]提出一種基于 委員會投票選擇算法(Query By Committee,QBC)的支持向量機(Support Vector Machine,SVM)主動學習算法,將改進的QBC與加權SVM有機結合并應用于SVM訓練學習中,有效地減少了樣本分布不均衡對主動學習性能的影響。姚拓中等[3]將Boosting思想應用到多視角主動學習框架中,通過將歷史上各次查詢得到的分類假設進行加權式投票來實現每次查詢后分類假設的強化,相比于傳統單視角主動學習算法能夠更快地完成收斂并達到較高的場景分類準確性。Li等[4]提出了結合半監督的主動學習方法,將主動學習過程產生的價值樣本用來加速分類器的訓練,和偽標簽一起輔助分類器進行高效的分類。Wan等[5]提出了基于主動學習的偽標簽校驗框架,極大地提高了半監督學習中偽標簽的置信度。Wang等[6]提出了主動學習與聚類相結合的偽標簽校驗的方法,進一步提高了偽標簽的置信度。Samiappan等[7]提出了Co-Training與主動學習算法進行組合的半監督算法,緩解了Self-Training中容易產生的數據傾斜問題而導致的分類器持續惡化的情況。上述主動學習采樣方法普遍面臨以下問題:1)基于概率型的采樣算法不適用句子型文本。2)只考慮分類結果最明確的樣本,這種樣本對當前分類器影響較小,并不能提高模型的泛化能力。本文提出基于密度中心點采樣的主動學習算法,根據樣本間的可連接性不斷擴展聚類簇,選擇每個類別中與密度中心相似度最高與最低的樣本進行標注,實現采樣的多樣性,從而適用于大規模未標注句子級彈幕樣本,使用極少量的標簽樣本訓練初始分類器,迭代選擇信息量最大的未標記彈幕樣本加入訓練集,以此提高分類器的分類性能,完成彈幕文本分類任務。

隨著深度學習的發展,越來越多的深度學習模型被應用于短文本分類任務中,魏超等[8]提出基于自編碼網絡的短文本流形表示方法實現文本特征的非線性降維,可以更好地以非稀疏形式更準確地描述短文本特征信息,提升提高分類效率。謝金寶等[9]提出一種基于語義理解的多元特征融合中文文本分類模型,通過嵌入層的各個通路提取不同層次的文本特征,比神經網絡模型(Conveolutional Neural Network,CNN)與長短期記憶網絡模型(Long Short-Term Memory,LSTM)的文本分類精度提升了8%。孫松濤等[10]使用CNN模型將句子中的詞向量合成為句子向量,并作為特征訓練多標簽分類器完成分類任務,取得了較好的分類效果。Kalchbrenner等[11]提出DCNN模型,在不依賴句法解析樹的條件下,利用動態k-max pooling提取全局特征,取得了良好的分類效果。Kim[12]采用多通道卷積神經網絡模型進行有監督學習,將詞矢量作為輸入特征,可以在不同大小的窗口內進行語義合成操作,完成文本分類任務。鄭嘯等[13]結合CNN和LSTM模型的特點,提出了卷積記憶神經網絡模型(Convolutional Memory Neural Network,CMNN),相比傳統方法,該模型避免了具體任務的特征工程設計。Hsu等[14]將CNN與循環神經網絡(Recurrent Neural Network, RNN)有機結合,從語義層面對sentense進行分類,取得良好的分類效果。Yin等[15]提出一種基于注意力機制的卷積神經網絡,并將該網絡用在句子對建模任務中,證明了注意力機制和CNN結合的有效性。上述方法使用傳統CNN模型對文本進行特征提取和分類,但池化操作在進行特征提取和降維時會損失較多的文本語義信息,從而導致分類精度下降。本文使用奇異值分解算法代替池化層的特征提取與降維工作,將奇異值較高的特征作為主要特征來代替原有目標矩陣的表達,更好地保存句子原有的語義結構,提升分類模型的精度。

1 相關研究

1.1 主動學習算法概述

主動學習算法是為了解決現實中標簽數據不足、標注數據耗時耗力的問題而提出的。該算法能夠從未標記樣例中挑選部分價值量高的樣例,標注后補充到已標記樣例集中來提高分類器和精度,降低領域專家的工作量。如何高效地選出具有高分類貢獻度的未標記樣本進行標注并補充到已有訓練集中,逐步提高分類器精度與魯棒性是主動學習亟待解決的問題。

主動學習根據選擇未標記樣本方式的不同,可以分為成員查詢綜合主動學習、基于流的主動學習和基于池的主動學習。其中,基于委員會的主動學習是當前應用最廣泛的采樣策略。根據選擇未標記樣例的標準不同,基于池的采樣策略又可分為:不確定性的采樣策略、基于版本空間縮減的采樣策略、基于模型改變期望的采樣策略以及基于誤差縮減的采樣策略。

1.2 卷積神經網絡文本分類

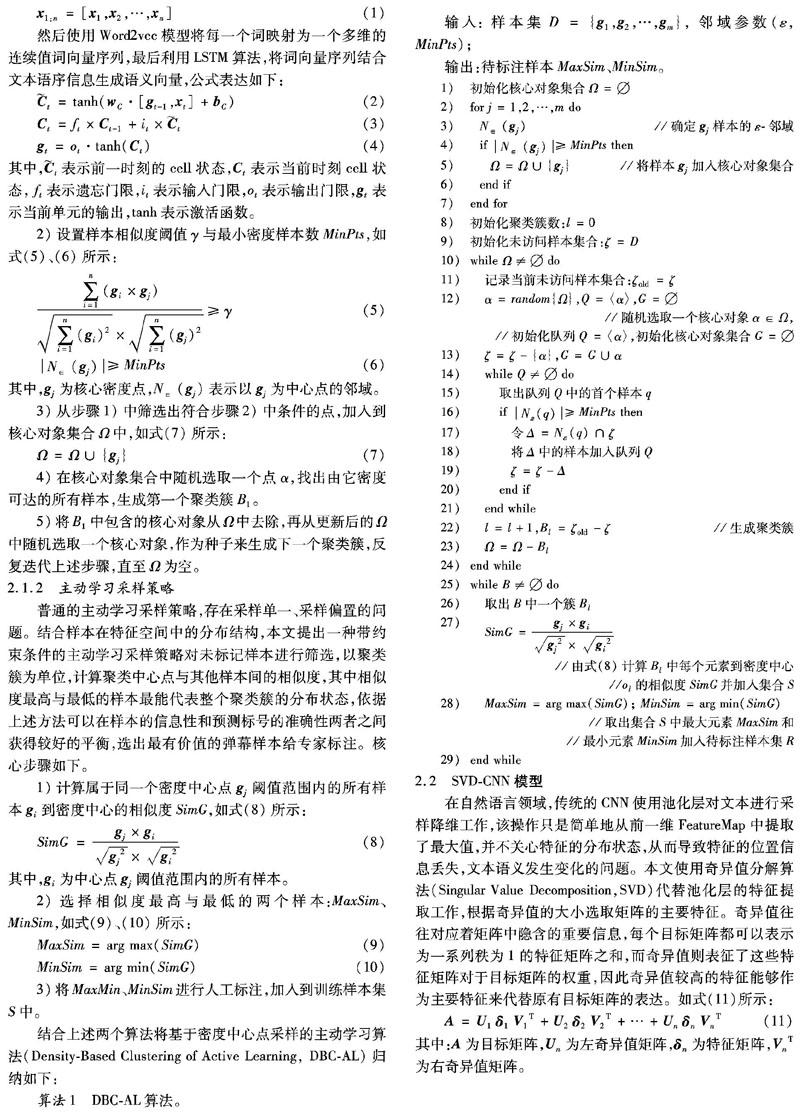

近年來,CNN模型在文本分類任務上取得了很好的實用效果。CNN模型首先根據輸入文本和詞向量構建輸入矩陣,然后通過卷積和池化操作,篩選和組合詞的分布式信息。其模型結構如圖1所示,在這樣一個網絡中,輸入層表示的是由每個詞的分布式向量組成的句子矩陣;卷積層使用若干個卷積核對于局部的詞向量矩陣進行卷積運算;池化層使用最大池化策略把卷積的結果轉換為一組特征向量;基于前兩層運算得到的特征向量,使用Softmax函數進行分類。

2 CNN分類模型改進算法

2.1 主動學習算法的改進

大多數傳統的主動學習算法使用基于概率的啟發式方法,這種方法建立在樣例的后驗概率分布基礎之上,用信息熵較大的樣本訓練分類模型。這種基于概率的信息熵計算方法并不適用于句子級彈幕文本,所以本文在原有主動學習算法的思想基礎上,提出一種基于密度中心點的主動學習采樣算法,通過比對句向量間相似度與設定最小密度閾值對樣本進行劃分,根據閾值的約束條件來選擇價值高的樣本標注,提高增強了樣本選擇算法的魯棒性。

2.1.1 基于相似度的密度聚類算法

傳統的密度聚類算法是基于樣本間距離的考察,本文針對句向量的空間分布提出向量間的相似度閾值來刻畫樣本類型的貼近程度,設計基于相似度的密度聚類算法,設置相似度與最小密度閾值,聚類核心步驟如下。

1)首先利用分詞工具進行彈幕句子樣本分詞,將句子以詞為單位形成一個詞向量序列,如式(1)所示:

然后使用Word2vec模型將每一個詞映射為一個多維的連續值詞向量序列,最后利用LSTM算法,將詞向量序列結合文本語序信息生成語義向量,公式表達如下:

3)從步驟1)中篩選出符合步驟2)中條件的點,加入到核心對象集合Ω中,如式(7)所示:

4)在核心對象集合中隨機選取一個點α,找出由它密度可達的所有樣本,生成第一個聚類簇B1。

5)將B1中包含的核心對象從Ω中去除,再從更新后的Ω中隨機選取一個核心對象,作為種子來生成下一個聚類簇,反復迭代上述步驟,直至Ω為空。

2.1.2 主動學習采樣策略

普通的主動學習采樣策略,存在采樣單一、采樣偏置的問題。結合樣本在特征空間中的分布結構,本文提出一種帶約束條件的主動學習采樣策略對未標記樣本進行篩選,以聚類簇為單位,計算聚類中心點與其他樣本間的相似度,其中相似度最高與最低的樣本最能代表整個聚類簇的分布狀態,依據上述方法可以在樣本的信息性和預測標號的準確性兩者之間獲得較好的平衡,選出最有價值的彈幕樣本給專家標注。核心步驟如下。

2.2 SVD-CNN模型

在自然語言領域,傳統的CNN使用池化層對文本進行采樣降維工作,該操作只是簡單地從前一維FeatureMap中提取了最大值,并不關心特征的分布狀態,從而導致特征的位置信息丟失,文本語義發生變化的問題。本文使用奇異值分解算法(Singular Value Decomposition,SVD)代替池化層的特征提取工作,根據奇異值的大小選取矩陣的主要特征。奇異值往往對應著矩陣中隱含的重要信息,每個目標矩陣都可以表示為一系列秩為1的特征矩陣之和,而奇異值則表征了這些特征矩陣對于目標矩陣的權重,因此奇異值較高的特征能夠作為主要特征來代替原有目標矩陣的表達。如式(11)所示:

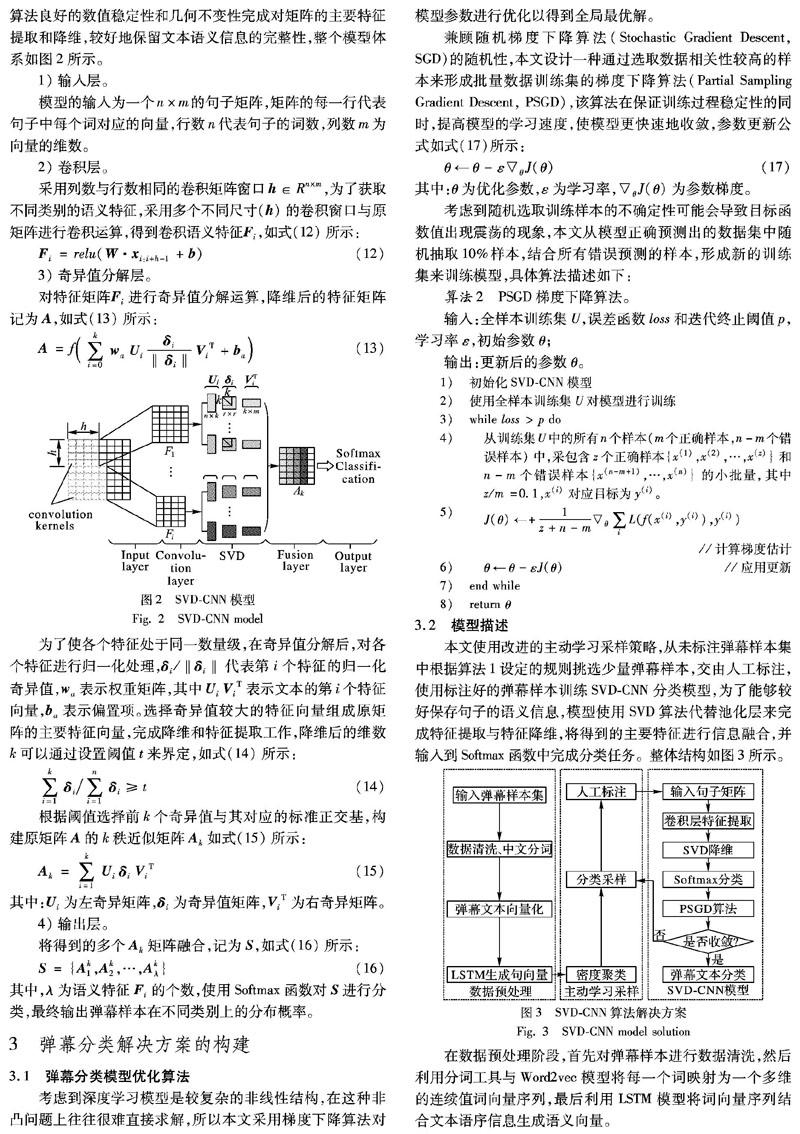

本文在傳統CNN分類模型基礎上設計了基于奇異值分解算法的卷積神經網絡模型(Convolutional Neural Network based on Singular Value Decomposition, SVD-CNN),利用SVD算法良好的數值穩定性和幾何不變性完成對矩陣的主要特征提取和降維,較好地保留文本語義信息的完整性,整個模型體系如圖2所示。

1)輸入層。

模型的輸入為一個n×m的句子矩陣,矩陣的每一行代表句子中每個詞對應的向量,行數n代表句子的詞數,列數m為向量的維數。

2)卷積層。

采用列數與行數相同的卷積矩陣窗口h∈Rn×m,為了獲取不同類別的語義特征,采用多個不同尺寸(h)的卷積窗口與原矩陣進行卷積運算,得到卷積語義特征Fi,如式(12)所示:

3)奇異值分解層。

對特征矩陣Fi進行奇異值分解運算,降維后的特征矩陣記為A,如式(13)所示:

3 彈幕分類解決方案的構建

3.1 彈幕分類模型優化算法

考慮到深度學習模型是較復雜的非線性結構,在這種非凸問題上往往很難直接求解,所以本文采用梯度下降算法對模型參數進行優化以得到全局最優解。

兼顧隨機梯度下降算法(Stochastic Gradient Descent, SGD)的隨機性,本文設計一種通過選取數據相關性較高的樣本來形成批量數據訓練集的梯度下降算法(Partial Sampling Gradient Descent, PSGD),該算法在保證訓練過程穩定性的同時,提高模型的學習速度,使模型更快速地收斂,參數更新公式如式(17)所示:

考慮到隨機選取訓練樣本的不確定性可能會導致目標函數值出現震蕩的現象,本文從模型正確預測出的數據集中隨機抽取10%樣本,結合所有錯誤預測的樣本,形成新的訓練集來訓練模型,具體算法描述如下:

算法2 PSGD梯度下降算法。

輸入:全樣本訓練集U,誤差函數loss和迭代終止閾值p,學習率ε,初始參數θ;

輸出:更新后的參數θ。

3.2 模型描述

本文使用改進的主動學習采樣策略,從未標注彈幕樣本集中根據算法1設定的規則挑選少量彈幕樣本,交由人工標注,使用標注好的彈幕樣本訓練SVD-CNN分類模型,為了能夠較好保存句子的語義信息,模型使用SVD算法代替池化層來完成特征提取與特征降維,將得到的主要特征進行信息融合,并輸入到Softmax函數中完成分類任務。整體結構如圖3所示。

在數據預處理階段,首先對彈幕樣本進行數據清洗,然后利用分詞工具與Word2vec模型將每一個詞映射為一個多維的連續值詞向量序列,最后利用LSTM模型將詞向量序列結合文本語序信息生成語義向量。

使用算法1中的方法,將句向量樣本根據相似度閾值和最小密度樣本數進行聚類,對每個密度中心點相似度臨界值進行采樣,得到最能代表每個聚類簇的整體樣本分布狀態,將樣本交由專家標注,以此提高訓練樣本集的代表性和廣泛性。

為了獲取不同的語義特征,采用不同尺寸的卷積窗口與原矩陣進行卷積運算,得到卷積語義特征Fi,對特征矩陣Fi進行奇異值分解運算,根據設定的閾值選擇前k個奇異值與其對應的標準正交基,構建原矩陣A的k秩近似矩陣,將多個Ak矩陣的融合S,通過Softmax函數計算得到樣本屬于各個類的概率分布,如式(17)所示:

4 實驗與結果分析

4.1 實驗數據與參數設置

本文針對三個方面對改進算法的有效性進行驗證。第一,通過模型不同的分類準確率,對比傳統采樣算法和DBC-AL算法的模型迭代次數,驗證后者具有更高的效率;第二,使用本文提出的SVD-CNN模型對彈幕文本分類,同時考慮詞向量維度和數據集泛化能力來驗證其分類性能;第三,使用改進后的梯度下降算法對模型進行優化,通過收斂速度和模型訓練速度來驗證優化算法的有效性。

本文通過爬蟲技術在不同視頻網站分別爬取彈幕文本,根據視頻類別形成不同的數據集進行對照實驗,對本文提出的算法進行性能評估。詳細的實驗數據統計如表1所示。

本文在實驗中選擇不同尺寸的卷積核對輸入的句子矩陣進行卷積操作,結合設定的閾值選取特征,使用奇異值分解算法完成矩陣的特征降維和特征提取,具體參數設置如表2所示。

4.2 算法性能驗證

實驗1 主動學習采樣算法性能驗證。

通過算法1中的方法對表1中的彈幕樣本進行采樣,為了驗證該算法對短文本語句向量在減少人工標注上所起到的作用,比較在模型達到同一分類準確率時,不同采樣算法所需的迭代次數。實驗選擇QBC算法、隨機采樣算法、基于最優標號和次優標號的(Best vs Second-Best,BvSB)[16]算法作為對照算法,使用CNN分類模型,實驗結果如圖4所示。

從圖4可以看出,在分類器識別精度為60%時,模型的分類正確率較低,除隨機采樣算法外,其余3種分類算法使用采樣所需的迭代次數沒有明顯差距。隨著分類精度從70%逐漸提升到90%時,隨機采樣和信息熵采樣算法所需迭代次數有著明顯的升高,而DBC-AL算法和BvSB算法相對較為穩定。由于BvSB算法只考慮樣本分類可能性最大的類別,因此相對前兩種算法來說采樣次數較少,但該算法忽略其他對樣本的分類結果影響較小的類別,導致該算法采集的樣本所含的信息量較少,相對于本文提出的DBC-AL算法需要更多的迭代次數,這說明了隨著模型精度的提高,前三種傳統的采樣算法收集到的樣本信息對于模型收斂提供的幫助越來越少,而DBC-AL算法根據樣本間的相似度進行聚類,對每個聚類簇采集到對分類模型來說最有價值的樣本,從而體現了DBC-AL算法在句向量中采樣的優越性。

實驗2 模型分類性能對比。

本文采用SVM算法、傳統CNN模型、不加池化層的CNN模型、多通道卷積神經網絡(Multi-Channel Convolution Neural Network, MCCNN)模型[17]和本文提出的SVD-CNN模型進行分類正確率對比實驗以驗證SVD-CNN模型的有效性。考慮到不同數據集可能引起分類模型精度變化的問題,使用表1中3個數據集分別進行模型分類性能對比實驗,實驗結果如圖5所示。

從圖5可以看出,SVM模型最高取得了78.9%的分類正確率,說明SVM模型在多分類問題上精度較低。CNN的分類正確率受數據集影響波動較大,在BiliBili彈幕數據集上的分類精度降低到76.6%,相比不加池化層的CNN模型分類正確率略有下降,這說明傳統CNN模型的池化層并不能對自然語言的文本特征進行有效提取。由于MCCNN模型采用多通道的特征提取方式,將不同的特征信息結合形成不同的通道作為卷積神經網絡的輸入,使得模型的分類效果優于前兩種模型,最高分類精度達到了87.6%,而本文提出的SVD-CNN模型相比前三個數據集上取得了最好的彈幕分類效果,其中在愛奇藝彈幕數據集上的分類精度最高達到了89.2%,相對于傳統使用池化層的CNN模型和MCCNN模型,分別提高了7.3%和1.6%,說明本文提出的對文本語義矩陣使用奇異值分解算法進行降維和特征提取的方法,更好地保留了文本語義特征,進而提高了模型分類精度,充分驗證了SVD-CNN模型在處理文本語義分類上對特征信息選擇的有效性。

實驗3 句向量維度實驗。

考慮到句向量維度會影響文本語義信息的表征,從而影響最終的分類結果,本文利用CNN模型、MCCNN模型和SVD-CNN模型在BiliBili彈幕數據集上使用不同維度的句向量進行對比實驗,分析句向量維度對分類結果的影響,實驗結果如表3所示。

從表3中可以看出,當句向量的維度增加到50,三種模型的分類精度都有著不同程度的提高,這說明隨著句向量維度的增加,文本語義的特征表達能力在逐漸提高。當維度繼續增加時,語句特征分布會變得更為稀疏,CNN模型與MCCNN模型使用池化層會忽略較多的文本語義特征,致使分類效果降低。本文使用SVD算法代替池化層進行特征提取,在語句特征分布較為稀疏的情況下仍然可以保留較多的文本語義特征,當詞向量維度增加到180以上時,模型的分類精度仍處于平穩狀態,充分驗證了SVD-CNN在彈幕文本語義特征提取上的高效性。

實驗4 彈幕分類模型優化算法。

為了驗證本文PSGD算法的訓練穩定性與訓練速度,選擇批量梯度下降算法(Batch Gradient Descent,BGD),SGD算法,小批量梯度下降算法(Mini-Batch Gradient Descent,MBGD)和本文提出的PSGD算法設計兩組對照實驗來檢驗算法性能,使用表1中BiliBili彈幕數據集共10000條,設置迭代閾值為2500次,設計實驗對比模型訓練時誤差變化率,驗證PSGD算法的穩定性,如圖6所示;設計實驗對比模型分類精度隨時間的變化率,驗證PSGD算法具有較低的時間復雜度,如圖7所示。

由實驗結果可以看出,隨著迭代次數的增加,使用BGD算法進行優化的模型誤差逐漸減小,訓練過程比較平穩,模型分類精度較高,但由于該算法采用全樣本訓練的方式,導致模型訓練時間長,模型訓練速度慢;SGD算法每次隨機選取樣本進行訓練,訓練時間較短,但相對于BGD算法存在的噪聲較多,導致每次迭代并沒有向著整體最優化方向進行,因此SGD的訓練過程穩定性較差,模型易陷入局部最優點,致使分類精度降低;MBGD算法每次迭代使用部分樣本更新模型參數,相對于SGD算法訓練過程比較穩定,訓練時間較短,模型分類精度介于BGD算法與SGD算法之間;由于本文提出的PSGD算法將模型分類錯誤的樣本引入到訓練集中,相對于MBGD算法的隨機性訓練集包含更多的信息,所以可以使模型訓練時間更短,訓練過程更穩定,模型分類精度更高,從而驗證了PSGD算法的有效性。

5 結語

本文提出一種基于密度中心點采樣的主動學習算法,利用樣本間的相似度將樣本進行聚類,并在每一個聚類簇中,按照設定的規則選擇最具有價值的樣本進行人工標注,減少人工標注的工作量;提出SVD-CNN模型,使用SVD算法代替傳統CNN模型的池化層,更好地保留了文本語義特征,從而提高模型的分類精度;使用改進的PSGD算法選取信息量較大的訓練樣本對模型進行優化,在保證訓練過程穩定性的同時提高了模型的訓練速度。通過對比不同主動學習采樣算法性能實驗表明,DBC-AL算法比傳統的主動學習采樣算法采集到的樣本信息量更高,對模型的分類貢獻更多;對比多種數據集和不同句向量維度下分類模型的分類精度可以看出,SVD-CNN模型能夠提取到更多的文本語義特征,具有較高的分類準確率;對比不同模型優化算法的訓練誤差與訓練時間,PSGD算法具有良好的穩定性,模型收斂速度更快,總體訓練效果優于其他算法。在主動學習采樣的規則條件中,采樣的閾值是通過經驗選取,可能并不是最優的,如何根據數據集及當前分類模型來對該閾值進行自適應的調整是下一步工作中需要考慮的重要問題。

參考文獻 (References)

[1] 譚侃,高旻,李文濤,等.基于雙層采樣主動學習的社交網絡虛假用戶檢測方法[J].自動化學報,2017,43(3):448-461.(TAN K, GAO M, LI W T, et al. Two-layer sampling active learning algorithm for social spammer detection [J]. Acta Automatica Sinica, 2017, 43(3): 448-461.)

[2] 徐海龍,別曉峰,馮卉,等.一種基于 QBC 的 SVM 主動學習算法[J].系統工程與電子技術,2015,37(12):2865-2871.(XU H L, BIE X F, FENG H, et al. Active learning algorithm for SVM based on QBC [J]. Systems Engineering and Electronics, 2015, 37(12): 2865-2871.)