親緣關(guān)系約束下的青少年人臉年齡合成研究

林 霞,李建微

福州大學(xué) 物理與信息工程學(xué)院,福州350116

年齡合成旨在預(yù)測各年齡段的人臉變化,生成相應(yīng)的人像,已廣泛應(yīng)用于社會保障、法醫(yī)、數(shù)字娛樂、尋找走失人口等領(lǐng)域[1]。數(shù)據(jù)顯示自2008 年至2017 年間經(jīng)法院判決的拐賣兒童案件有2 217 起,被立案調(diào)查以及未報案的兒童走失案件則更多[2]。已有研究表明,年齡合成生成逼真的人臉圖像可以提高人臉識別準(zhǔn)確率[3-4],有效地幫助尋找走失兒童。近年來對面部年齡合成的研究已取得了較大的進(jìn)展[5-11]。但是現(xiàn)有的年齡合成網(wǎng)絡(luò)模型大多是基于類間差異的普適模型,在成年人圖像上的年齡合成能夠得到優(yōu)越的測試結(jié)果。青少年的顱骨復(fù)合體與成年人有很大的不同[12],普適模型針對青少年的年齡合成并不能對青少年跨年齡人臉識別以及老化起到較好的作用[13]。因此在青少年群體的年齡合成研究領(lǐng)域仍然存在著急需解決的問題:類內(nèi)差異不明顯導(dǎo)致的個體個性特征丟失;較面部骨骼定型的成年人而言青少年隨時間推移面部變化更為劇烈;青少年逐年齡段人臉數(shù)據(jù)集稀缺;該領(lǐng)域現(xiàn)有研究較少且僅從個體面部圖像出發(fā),忽略了外部客觀因素可能對青少年面部變化帶來的影響。針對以上問題,本文的主要研究工作如下:

(1)針對青少年群體提出了使用親屬特征匹配模塊對因年齡推進(jìn)而導(dǎo)致的面部變化進(jìn)行約束的端到端人臉老化架構(gòu),在現(xiàn)有方法使用的年齡與身份約束外加入親緣約束,增加青少年群體的類內(nèi)差異,減少了人臉老化對大量同個體不同年齡段圖像數(shù)據(jù)的依賴,一定程度上減小了相關(guān)數(shù)據(jù)量稀缺的影響。同時也是將親緣匹配與年齡合成相結(jié)合的研究。

(2)在親屬對數(shù)據(jù)集TSK[14]上進(jìn)行了實驗,以驗證所提出方法在老化過程中保持身份特征與提高親屬匹配準(zhǔn)確性的能力,并與同樣利用親屬關(guān)系進(jìn)行特征融合的年齡合成方法[11]進(jìn)行了對比實驗,證明了所提出方法在青少年年齡段老化的優(yōu)越性。

(3)與現(xiàn)有先進(jìn)青少年人臉年齡合成算法IPCGAN和ChildGAN 在20+年齡組展開了對比實驗,從生成圖像質(zhì)量、驗證準(zhǔn)確率、人臉召回率三方面進(jìn)行對比,驗證了所提出方法具備一定的有效性和先進(jìn)性。

1 相關(guān)工作

1.1 生成對抗網(wǎng)絡(luò)在年齡合成上的應(yīng)用

模擬面部年齡進(jìn)展過程是一項艱巨的任務(wù),因為在嬰兒、幼兒、青年、中年、老年時期的面部生長中存在大的非線性偏差。基于生成對抗網(wǎng)絡(luò)(generative adversarial network,GAN)的模型在面部識別中顯示了更高的視覺保真度結(jié)果。

Antipov等人[15]提出了age-cGAN方法,以獲得保留個人身份的高質(zhì)量面部老化結(jié)果。Zhang 等人[16]提出了一種用于年齡進(jìn)展和回歸的條件對抗自動編碼器(conditional adversarial auto-encoder,CAAE)方法,該方法基于面部流形學(xué)習(xí)概念,并添加了年齡作為條件。Yang 等人[17]應(yīng)用了一個具有多個尺度的金字塔敵對鑒別器,并增加了一個保持身份的目標(biāo)。Li等人[18]提出了一種全局和局部一致年齡GAN,引入了殘差網(wǎng)絡(luò)來訓(xùn)練臉部全局和局部特征。同一作者小組提出了一種基于小波的GAN來解決非配對數(shù)據(jù)集中年輕和年老人臉圖像之間的匹配模糊性。Tang 等人[19]提出了一種保持身份的條件GAN,旨在根據(jù)年齡組合成人臉,將基于AlexNet 的感知損失和年齡分類項合并到目標(biāo)函數(shù)中。Zhao 等人[20-21]提出了一個年齡不變模型(age-invariant model,AIM)用于跨年齡人臉年輕化/老化和識別。Huang等人[22]在AIM 的基礎(chǔ)上加入了注意力機(jī)制以及權(quán)重共享策略,保持身份信息,實現(xiàn)平滑的人臉老化。Alaluf等人[11]使用年齡回歸網(wǎng)絡(luò)指導(dǎo)風(fēng)格生成對抗網(wǎng)絡(luò)(style generative adversarial network,StyleGAN)編碼器生成目標(biāo)年齡潛在向量。但是以上方法都是面向全年齡段的普適年齡合成模型,在成年人年齡段的表現(xiàn)較好,缺少針對青少年的年齡合成模型,這一年齡階段的個體往往面部變化較為劇烈。近年來學(xué)者們也看到了年齡合成在青少年群體中的局限性,展開了許多針對青少年人臉年齡合成的研究。Deb等人[23]針對兒童人臉提出深度特征老化GAN模型。Chandaliya等人[24]受自注意力生成對抗網(wǎng)絡(luò)(self-attention generative adversarial network,SAGAN)[25]的啟發(fā),引入自注意力機(jī)制模擬跨人臉圖像區(qū)域的長期、多層次的依賴關(guān)系。Liu 等人[26]將老化分為形狀老化與紋理老化兩部分,以模擬兒童老化面部變形的過程。但是以上方法同樣是在研究青少年群體老化的規(guī)律,對于身份特征尚不明晰的孩童而言,年齡合成必然有較大的誤差。Shu等人[27]利用遺傳基因?qū)W將家長特征與孩子老化特征進(jìn)行融合,在年齡合成中引入了個體以外的參考對象。但是特征融合卻易丟失孩子個體身份特征。

1.2 基于深度學(xué)習(xí)的親緣特征匹配

近年來許多親屬關(guān)系驗證算法被提出,主要分為特征提取與度量判斷兩個步驟。其中受深度學(xué)習(xí)顯著成功的影響,基于深度學(xué)習(xí)的特征提取方法成為了親屬關(guān)系驗證領(lǐng)域的主流方法。Zhang等人[28]利用卷積神經(jīng)網(wǎng)絡(luò)(convolutional neural network,CNN)進(jìn)行特征學(xué)習(xí),并取得了令人印象深刻的驗證性能。Dehghan等人[29]利用帶辨別神經(jīng)網(wǎng)絡(luò)層的門控自動編碼器來學(xué)習(xí)描繪親子關(guān)系的最佳特征。在深度學(xué)習(xí)中,利用多級特征也是提高性能的一種常用方法。這些策略已經(jīng)過廣泛測試,并在許多計算機(jī)視覺任務(wù)中證明了它們的有效性,例如物體檢測[30-31]。由于較淺層的特征圖編碼幾何細(xì)節(jié),而來自較深層的特征圖編碼空間信息,二者結(jié)合可以更好地描繪結(jié)構(gòu)輪廓。最近的一項親屬關(guān)系驗證研究使用了兩個共享參數(shù)的CNN 來提取不同尺度的深度特征,從而提供人臉圖像的全局上下文信息[32]。

在特征提取之后,后續(xù)步驟需要學(xué)習(xí)用于區(qū)分兩個給定的面部圖像是否具有親緣關(guān)系的判別度量。深度學(xué)習(xí)是一種可以用于學(xué)習(xí)復(fù)雜非線性關(guān)系的技術(shù)。例如,深度鑒別度量學(xué)習(xí)[33]旨在學(xué)習(xí)一組分層非線性變換,以將人臉對投影到同一潛在特征空間,在此空間下,每個正對的距離減小,每個負(fù)對的距離增大。Zhou等人[34]開發(fā)了一種耦合深度神經(jīng)網(wǎng)絡(luò),該網(wǎng)絡(luò)明確地模擬了父子對中固有的跨代差異,并學(xué)習(xí)了一種耦合深度相似性度量,使得具有親緣關(guān)系的圖像對被拉近,而沒有親緣關(guān)系的圖像對被推得盡可能遠(yuǎn)。Nandy等人[35]使用兩個并行預(yù)訓(xùn)練的SqueezeNet網(wǎng)絡(luò)建立了一個孿生CNN架構(gòu),并將其與不同的常見相似性度量結(jié)合起來進(jìn)行親緣關(guān)系驗證。深度度量學(xué)習(xí)方法的主要優(yōu)點是它們可以以端到端的方式進(jìn)行訓(xùn)練,其中特征學(xué)習(xí)和度量學(xué)習(xí)被聯(lián)合優(yōu)化。

2 提出方法

本文受Image to Image 網(wǎng)絡(luò)[36-37]的啟發(fā),針對青少年人臉設(shè)計了一個基于親緣關(guān)系約束的端到端年齡合成網(wǎng)絡(luò)。該網(wǎng)絡(luò)主要包含人臉老化模塊(FA)以及親緣特征匹配模塊,網(wǎng)絡(luò)結(jié)構(gòu)如圖1所示。

圖1 青少年人臉老化網(wǎng)絡(luò)結(jié)構(gòu)Fig.1 Structure of adolescents face aging

現(xiàn)有算法主要采用分年齡組訓(xùn)練網(wǎng)絡(luò)學(xué)習(xí)不同年齡組的特征,這需要大量對應(yīng)的數(shù)據(jù)集提供支持。針對上述問題本文提出加入目標(biāo)年齡的人臉老化模塊:新建與圖像維度一致的張量,數(shù)值為目標(biāo)年齡t,將其作為常數(shù)值通道與輸入圖像x的三維度張量聯(lián)結(jié)成為四通道張量,通過編碼器aged-Encoder對包含了目標(biāo)年齡信息的四通道張量提取人臉特征,并將輸出特征與圖像風(fēng)格特征聯(lián)結(jié),而后利用解碼器輸出對應(yīng)目標(biāo)年齡人臉預(yù)測圖像xaged。

針對青少年面部變化劇烈現(xiàn)有算法不能很好地生成青少年老化圖像的問題,基于基因遺傳學(xué),本文提出加入親緣特征匹配模塊對青少年年齡合成進(jìn)行約束:對上述人臉老化模塊輸出的xaged和對應(yīng)父母的圖像進(jìn)行特征提取,將提取到的特征進(jìn)行匹配得出相似度,該相似度得分作為損失函數(shù)的一部分對青少年年齡合成模型進(jìn)行約束。

2.1 人臉老化模塊

對于輸入圖像x,假設(shè)有對應(yīng)的圖像y,兩者分別代表同一個體在不同年齡的真實圖像,年齡合成就是使x向y轉(zhuǎn)變的過程,用F 來表示此過程:

針對現(xiàn)有親屬對數(shù)據(jù)集年齡標(biāo)簽缺失的問題,本文使用預(yù)訓(xùn)練VGG年齡分類器[38]來獲得x的年齡標(biāo)簽s,目標(biāo)年齡t在青少年面部變化較大的5~30 歲年齡段中隨機(jī)選取:

利用編碼網(wǎng)絡(luò)E提取出年齡合成后人像的特征:

為了得到圖像關(guān)于風(fēng)格編碼的向量w,以解決人臉特征外特征丟失的問題,保存如發(fā)型、衣著以及是否佩戴眼鏡等信息,本文將輸入x通過編碼網(wǎng)絡(luò)Estyle映射到StyleGAN生成網(wǎng)絡(luò)的W+空間:

本文的Estyle使用殘差網(wǎng)絡(luò)ResNet 標(biāo)準(zhǔn)特征金字塔提取特征圖,并參考文獻(xiàn)[37]map2style 分層訓(xùn)練StyleGAN網(wǎng)絡(luò)所需的18個目標(biāo)風(fēng)格向量,如圖2所示。

圖2 編碼器Estyle結(jié)構(gòu)Fig.2 Structure of encoder Estyle

結(jié)合式(3)與式(4),將特征ft與風(fēng)格編碼向量w輸入StyleGAN生成網(wǎng)絡(luò)Gstyle,得到輸出人臉老化預(yù)測圖像xaged:

2.2 親緣特征匹配

親屬關(guān)系驗證主要分為兩個步驟:(1)特征提取;(2)度量學(xué)習(xí)。

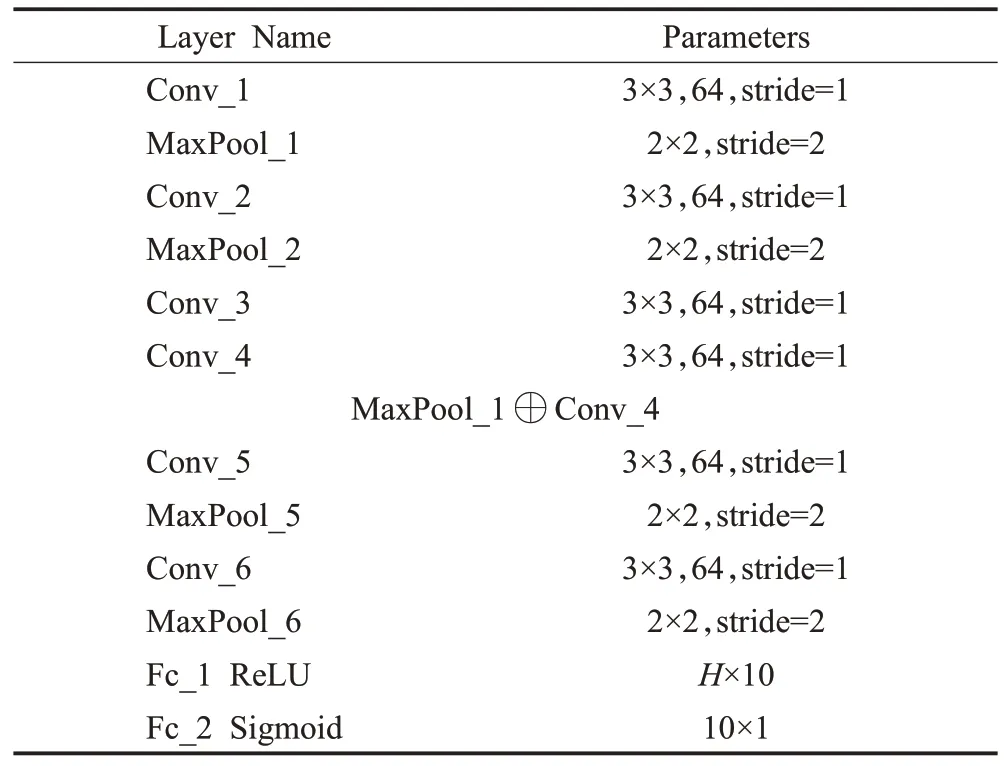

本文使用ResNet[39]作為親屬特征提取網(wǎng)絡(luò),并參考文獻(xiàn)[40]將不同卷積層的輸出聯(lián)結(jié),生成多級特征,以保留除輪廓、邊緣外的整體抽象特征,不同粒度特征間互補。使用歐幾里德距離作為圖像對的相似度度量,輸出親屬關(guān)系得分。親緣匹配網(wǎng)絡(luò)結(jié)構(gòu)如表1所示。

表1 親緣特征匹配網(wǎng)絡(luò)結(jié)構(gòu)Tabel 1 Structure of kinship feature verification

2.3 損失函數(shù)

本文所提出模型訓(xùn)練的損失由親緣損失、年齡損失、身份信息損失、像素級損失組成,四部分的損失進(jìn)行加權(quán)相加得到總損失:

人臉老化最重要的一部分就是在轉(zhuǎn)變年齡的過程中保持個體身份信息。對于青少年年齡段而言,面部變形較為巨大,相較于成年人單一使用特征間余弦相似性作為保持身份信息的約束,誤差較大。本文使用基于余弦相似性的預(yù)訓(xùn)練人臉驗證網(wǎng)絡(luò)[41]和親緣特征匹配模塊K[40]對青少年年齡合成過程的身份特征進(jìn)行約束,K輸出圖像對屬于親屬的概率,損失函數(shù)如式(7)、(8)所示:

為了提高模型年齡轉(zhuǎn)化的準(zhǔn)確性,使用預(yù)訓(xùn)練年齡分類器V對老化后人臉的年齡做出預(yù)測,并與目標(biāo)年齡t進(jìn)行均方差損失的計算,年齡估計損失函數(shù)如式(9)所示:

使用像素級損失減少身份特征外的圖像信息丟失,維持編碼器輸入輸出的相似性,像素?fù)p失函數(shù)如式(10)所示:

3 實驗與結(jié)果分析

3.1 數(shù)據(jù)集與實驗環(huán)境

本文使用TSK 數(shù)據(jù)集[14]對模型進(jìn)行實驗與驗證,TSK數(shù)據(jù)集由3 045張照片、1 015組家庭、2 030對家長-孩子圖像對組成。每組家庭均由父親(F)、母親(M)、孩子(S/D)三張圖像組成,其中包含502組女兒(D)家庭和513組兒子(S)家庭。數(shù)據(jù)集中的所有圖片都是從互聯(lián)網(wǎng)上獲取的,包含公眾人物家庭和照片分享社交網(wǎng)絡(luò)上的圖片。該數(shù)據(jù)集采集不受姿勢、光照、表情、背景、種族、圖像質(zhì)量等的限制。數(shù)據(jù)集中圖像大小為64×64,并且已經(jīng)進(jìn)行了基于眼睛坐標(biāo)對齊裁剪操作。數(shù)據(jù)集部分圖片如圖3所示。

圖3 TSK數(shù)據(jù)集部分圖像Fig.3 Part images of TSK dataset

本文從四類圖像對M-D、F-S、M-S、F-D中隨機(jī)選取80%作為訓(xùn)練樣本,余下20%作為測試樣本。用于訓(xùn)練的實驗設(shè)備操作系統(tǒng)為Ubuntu,GPU 為GeForce RTX 3080 12 GB,CPU 為Intel Core i7-12700F 64 GB。訓(xùn)練所用各損失函數(shù)的權(quán)值λkin、λid、λage、λpix設(shè)置為1、0.25、5、0.25。

3.2 實驗結(jié)果與分析

基于特征融合的年齡合成方法[27]與本文方法均利用了親緣關(guān)系來加強(qiáng)青少年年齡合成的準(zhǔn)確性。本文為了驗證所提出方法的可行性與優(yōu)越性,展開了兩組對比實驗:第一組以特征融合方法作為對照,展開了在人臉身份特征保持、年齡評估以及親緣特征匹配這三方面的對比實驗,分別計算人臉驗證準(zhǔn)確率(face verification accuracy,F(xiàn)VACC)、召回率(ID recall)、親緣檢測準(zhǔn)確率(kinship accuracy,KinACC)以及年齡預(yù)測平均誤差(mean age error,MAE);第二組以現(xiàn)有先進(jìn)算法ChildGAN[24]、IPCGAN[19]作為對照,對比各模型在20+年齡組的青少年年齡合成的圖像質(zhì)量,并分別計算人臉驗證準(zhǔn)確率以及召回率。所有實驗都是在同一實驗環(huán)境和同樣測試集下進(jìn)行的,最終用于測試的圖像均由各方法的年齡合成結(jié)果構(gòu)成。

3.2.1 與特征融合方法的對比

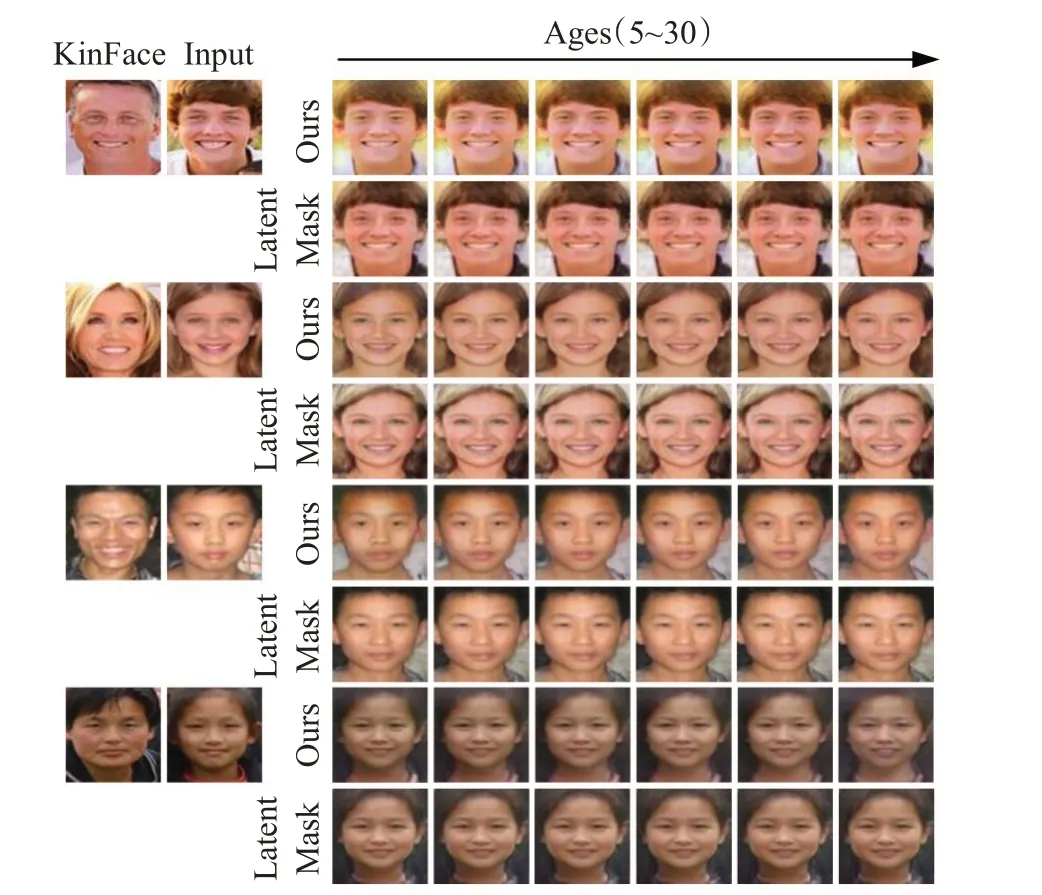

圖4 為青少年測試樣本在不同方法下的年齡合成結(jié)果示意圖。從圖中可以看出,本文方法在年齡合成過程中較好地保持了身份特征,并且本文引入的親緣特征約束模塊也一定程度上減輕了青少年隨著年齡的推進(jìn)顱面部變化所帶來的影響。

圖4 年齡合成示意圖對比Fig.4 Comparison of age synthesis images

在人臉驗證領(lǐng)域,評估指標(biāo)包括準(zhǔn)確率(accuracy,ACC)、召回率(true positive rate,TPR)、等錯誤率(equal error rate,EER)等[42]。本文目的是針對青少年進(jìn)行個性化年齡合成,故選取準(zhǔn)確率和召回率來評估方法對身份特征保持的性能,計算公式如式(11)、(12)所示。FaceNet[43]在公開人臉數(shù)據(jù)集上已經(jīng)可以達(dá)到99.6%的準(zhǔn)確度,有著很高的驗證精度,故本文使用FaceNet網(wǎng)絡(luò)來計算逐年齡段的人臉驗證準(zhǔn)確率以及召回率。

從圖5(a)和圖5(b)可以看出,本文方法的驗證準(zhǔn)確率與身份召回率在5~30歲年齡段內(nèi)整體高于特征融合方法,在18歲前后人臉驗證準(zhǔn)確率最高達(dá)到97%,較特征融合年齡合成方法提高了3個百分點,身份召回率最高同樣達(dá)到97%,較特征融合年齡合成方法提高了1個百分點,在5 歲與30 歲前后的準(zhǔn)確率與召回率較低,但是也達(dá)到了92%、96%。驗證了本文方法能夠在年齡合成過程中較好地保持青少年個體的身份特征。

圖5 各評估指標(biāo)曲線圖Fig.5 Curves of evaluation indexs

為了驗證本文提出方法對提升親緣特征匹配率的作用,先行計算出測試數(shù)據(jù)集TSK 初始親屬對(raw)的親緣匹配率作為衡量標(biāo)準(zhǔn),從圖5(c)可以看到,隨著年齡的推進(jìn)本文方法能夠有效地提高親緣匹配率,在25歲左右將匹配率從49%提高了8.5 個百分點,驗證了本文提出的親緣特征約束模塊的有效性。但是與特征融合年齡合成方法相比,本文方法在匹配率上還是有5個百分點的差距。

圖5(d)是隨年齡的推進(jìn)對測試樣本的年齡預(yù)測與目標(biāo)輸入年齡之間平均差距的趨勢示意圖。從圖中能夠看到,本文方法在年齡合成過程中對年齡的控制優(yōu)于特征融合方法。本文方法不論是表現(xiàn)較差的小年齡段,還是表現(xiàn)較好的成年段,與目標(biāo)年齡之間的差距始終比特征融合年齡合成方法少4.5歲左右。這也驗證了本文方法在針對青少年的年齡合成過程中,對年齡的控制是有效且更優(yōu)的。

3.2.2 與現(xiàn)有青少年年齡合成算法的對比

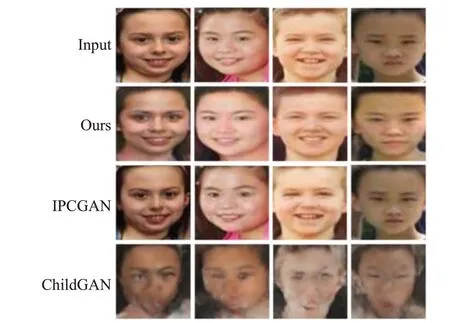

圖6 為本文方法與IPCGAN[19]、ChildGAN[24]算法在TSK 數(shù)據(jù)集孩子圖像上生成20 歲年齡組的效果示意圖。可以看到IPCGAN 算法生成的結(jié)果與輸入圖像特征基本一致,對青少年的年齡合成效果不佳;ChildGAN算法生成的結(jié)果質(zhì)量不高;在對比之下,本文算法能夠較好地在保留青少年個性特征的同時實現(xiàn)年齡合成。

圖6 各算法在20+年齡組的年齡合成效果Fig.6 Age synthesis result of algorithms in 20+age group

表2 是各算法在TSK 數(shù)據(jù)集下的準(zhǔn)確率以及召回率的對比。可以看到由于IPCGAN 算法的生成結(jié)果與輸入幾乎一致,其準(zhǔn)確率最高為99.5%,隨后就是本文所提方法,準(zhǔn)確率為95.3%;在召回率的表現(xiàn)上本文方法為92.7%,優(yōu)于其他算法。

表2 TSK數(shù)據(jù)集下準(zhǔn)確率與召回率對比Table 2 Comparison of accuracy and recall under TSK dataset 單位:%

3.2.3 結(jié)果分析

綜上所述,從實驗結(jié)果來看,本文方法不僅在視覺上可以得到逼真的年齡合成結(jié)果,并且在一定程度上能夠提高跨年齡的人臉驗證準(zhǔn)確率與親緣匹配率,對建立青少年跨年齡個體聯(lián)系與跨年齡親緣聯(lián)系都有著重要的意義。與現(xiàn)有其他采用親緣約束的年齡合成方法相比,本文方法在人臉驗證準(zhǔn)確率、身份召回率以及平均年齡差距的表現(xiàn)上都更優(yōu)。性能提升的原因如下:(1)引入了親緣特征匹配約束模塊,充分利用了基因遺傳學(xué)對青少年面部變化進(jìn)行合理的預(yù)測,提高了類內(nèi)差異,較現(xiàn)有方法而言并不是對特征直接進(jìn)行融合,因此年齡合成過程中在保持個體身份特征的同時也能很好地提高親緣匹配率;(2)本文使用StyleGAN風(fēng)格化生成網(wǎng)絡(luò)將人臉特征以外像素信息進(jìn)行了保留,使得背景、發(fā)型等信息能夠留存,得到更好的視覺結(jié)果。

4 結(jié)束語

本文提出了一個基于親緣特征匹配的端到端青少年年齡合成方法,在年齡合成過程中可以保持身份特征與親緣關(guān)系信息。實驗證明本文方法對比現(xiàn)有其他方法而言在人臉驗證準(zhǔn)確率、身份召回率、平均年齡差以及親緣特征匹配率上都有著更好的表現(xiàn)。但是本文方法還有不完善的地方:在幼童年齡段由于性別特征區(qū)分不明顯,會出現(xiàn)性別混淆的情況;網(wǎng)絡(luò)結(jié)構(gòu)較為復(fù)雜,訓(xùn)練速度較慢。在未來的研究工作中,將嘗試探索在現(xiàn)有基礎(chǔ)上加入性別約束對幼童年齡合成的影響,以及加入注意力機(jī)制對模型訓(xùn)練效果的影響。