基于自監(jiān)督聚類算法的小樣本醫(yī)學(xué)圖像分類

馬修玉 何良華

摘要:基于深度學(xué)習(xí)的醫(yī)學(xué)圖像分析是智慧醫(yī)療的一個(gè)重要方向。但是通常情況下,醫(yī)學(xué)圖像數(shù)據(jù)集數(shù)據(jù)量很小,而且由于醫(yī)學(xué)圖像的標(biāo)注困難,耗費(fèi)大量人力物力,所以帶標(biāo)簽的訓(xùn)練數(shù)據(jù)很難獲取。如何使用極少的帶標(biāo)簽數(shù)據(jù)和無(wú)標(biāo)簽的數(shù)據(jù)得到一個(gè)較好的網(wǎng)絡(luò)模型是本文的主要研究?jī)?nèi)容。該文提出基于深度聚類的自監(jiān)督網(wǎng)絡(luò)模型作為特征提取器,并且使用標(biāo)簽傳播算法對(duì)特征進(jìn)行分類,解決了只有極少量標(biāo)簽(例如1張,5張或者10張)即小樣本情況下的醫(yī)學(xué)圖像分類問(wèn)題,在BreakHis數(shù)據(jù)集上取得了比傳統(tǒng)機(jī)器學(xué)習(xí)算法更好的效果,并且接近于全監(jiān)督學(xué)習(xí)方法。

關(guān)鍵詞:深度學(xué)習(xí);深度聚類;自監(jiān)督學(xué)習(xí);小樣本學(xué)習(xí);標(biāo)簽傳播算法;醫(yī)學(xué)圖像分類

中圖分類號(hào):TP311? ? ?文獻(xiàn)標(biāo)識(shí)碼:A

文章編號(hào):1009-3044(2022)03-0078-03

開放科學(xué)(資源服務(wù))標(biāo)識(shí)碼(OSID):

1 概述

深度學(xué)習(xí)算法,尤其是卷積神經(jīng)網(wǎng)絡(luò)在醫(yī)學(xué)圖像分析領(lǐng)域的廣泛使用使得診斷的準(zhǔn)確性有了很大提升。雖然基于深度學(xué)習(xí)的方法能在這些任務(wù)上取得比傳統(tǒng)機(jī)器學(xué)習(xí)方法更好的效果,但是這些方法通常都需要大量已標(biāo)注的數(shù)據(jù)集作為訓(xùn)練數(shù)據(jù)。因此如何在已標(biāo)注樣本很少的情況下(即小樣本情況),利用僅有的已標(biāo)注數(shù)據(jù)以及無(wú)標(biāo)簽數(shù)據(jù)解決醫(yī)學(xué)圖像分類成為一個(gè)很重要的問(wèn)題。

最近,很多對(duì)標(biāo)注數(shù)據(jù)需求量小或者不需要標(biāo)注數(shù)據(jù)的方法受到人們關(guān)注,出現(xiàn)了很多無(wú)監(jiān)督學(xué)習(xí)的方法,自監(jiān)督學(xué)習(xí)就是其中最具代表性的一種。自監(jiān)督學(xué)習(xí)的思想非常簡(jiǎn)單,就是輸入的是無(wú)標(biāo)注的數(shù)據(jù),但是通過(guò)數(shù)據(jù)本身的結(jié)構(gòu)或者特性,人為構(gòu)造標(biāo)簽出來(lái)。有了標(biāo)簽之后,就可以類似監(jiān)督學(xué)習(xí)一樣進(jìn)行訓(xùn)練。傳統(tǒng)機(jī)器學(xué)習(xí)算法中,聚類算法是一種涉及數(shù)據(jù)點(diǎn)分組的機(jī)器學(xué)習(xí)技術(shù),不需要數(shù)據(jù)標(biāo)簽,屬于無(wú)監(jiān)督學(xué)習(xí)算法的一種。結(jié)合兩種思想本文主要做了以下工作:

1)提出基于深度聚類的自監(jiān)督網(wǎng)絡(luò)模型,利用無(wú)標(biāo)簽數(shù)據(jù)訓(xùn)練出較好的特征提取模型。

2)提出改進(jìn)的標(biāo)簽傳播算法,利用上述特征提取模型和有限的帶標(biāo)注樣本進(jìn)行分類,在BreakHis數(shù)據(jù)集上取得了很好的分類效果。

2 相關(guān)工作

2.1 自監(jiān)督學(xué)習(xí)

自監(jiān)督學(xué)習(xí)作為無(wú)監(jiān)督學(xué)習(xí)方法的一個(gè)子集,可以從大規(guī)模未標(biāo)記數(shù)據(jù)中學(xué)習(xí)一般圖像和視頻特征,而不使用任何人為標(biāo)注標(biāo)簽。自監(jiān)督學(xué)習(xí)的方法通常是設(shè)置一些前置任務(wù)(如圖像上色、圖像修補(bǔ)、圖像拼接等),訓(xùn)練網(wǎng)絡(luò)去解決前置任務(wù),在完成這些任務(wù)的過(guò)程中,網(wǎng)絡(luò)就學(xué)習(xí)到了相應(yīng)的特征。

何凱明在2019年提出了MoCo(Momentum Contrast)[1], 使用動(dòng)量的方式更新encoder參數(shù),解決新舊候選樣本編碼不一致的問(wèn)題;Chen Ting在2020年提出了SimCLR[2],在encoder之后增加了一個(gè)非線性映射

[ghi=W* ReLU (W* hi)]

效果直接比MoCo高出了7個(gè)點(diǎn),并直逼監(jiān)督模型的結(jié)果;何凱明在改進(jìn)自己的方法加入相同的非線性層后提出MoCov2,效果反超SimCLR;近些年來(lái)人們開始把自監(jiān)督學(xué)習(xí)用于醫(yī)學(xué)圖像分析,例如谷歌提出了大型自監(jiān)督模型改進(jìn)醫(yī)學(xué)圖像分類[3]。

2.2 深度聚類與標(biāo)簽傳播

聚類的目標(biāo)就是根據(jù)某一相似性度量準(zhǔn)則,將相似的數(shù)據(jù)分到同一類,盡管人們提出了很多的聚類算法,但是這些方法在高維數(shù)據(jù)上表現(xiàn)得很差。由于深度學(xué)習(xí)的發(fā)展,以及神經(jīng)網(wǎng)絡(luò)內(nèi)在的非線性變換的特點(diǎn),深度神經(jīng)網(wǎng)絡(luò)可以將數(shù)據(jù)轉(zhuǎn)化成更易于分類的特征表示,通常把使用深度學(xué)習(xí)的聚類方法稱之為深度聚類(deep clustering)[4]。

標(biāo)簽傳播算法[5]是一種基于圖的半監(jiān)督學(xué)習(xí)算法,它以一種迭代的方法通過(guò)帶標(biāo)注數(shù)據(jù)推測(cè)無(wú)標(biāo)注數(shù)據(jù)的標(biāo)簽,其基本思路是用已標(biāo)記節(jié)點(diǎn)的標(biāo)簽信息去預(yù)測(cè)未標(biāo)記節(jié)點(diǎn)的標(biāo)簽信息,經(jīng)常被用于社區(qū)發(fā)現(xiàn)。

2.3小樣本學(xué)習(xí)

機(jī)器學(xué)習(xí)在數(shù)據(jù)密集型的領(lǐng)域取得了巨大的成功,但是在數(shù)據(jù)集比較小的時(shí)候通常效果更不太理想,最近人們提出了小樣本學(xué)習(xí)來(lái)解決這個(gè)問(wèn)題。基于度量學(xué)習(xí)的小樣本學(xué)習(xí)方法比如MathingNet[6],ProtoNet[7]等都取得了不錯(cuò)的效果。

3 自監(jiān)督聚類模型

3.1 自監(jiān)督聚類模型

傳統(tǒng)的自監(jiān)督學(xué)習(xí)算法通常以大量的自然圖像比如ImageNet,作為訓(xùn)練數(shù)據(jù)集,構(gòu)造前置任務(wù),模型能夠在訓(xùn)練過(guò)程中學(xué)到底層的圖像特征。自監(jiān)督模型能夠使用無(wú)標(biāo)簽數(shù)據(jù)進(jìn)行訓(xùn)練,從而得到很好的特征提取器。傳統(tǒng)的網(wǎng)絡(luò)自監(jiān)督訓(xùn)練以每一張圖為一類,進(jìn)行實(shí)例區(qū)分來(lái)訓(xùn)練網(wǎng)絡(luò)。由于自然圖像分類通常類別數(shù)量很大,無(wú)法利用類別信息,而醫(yī)學(xué)圖像分類任務(wù)通常類別已知(比如乳腺癌可以分為良性和惡性),因此可以設(shè)計(jì)基于聚類的自監(jiān)督網(wǎng)絡(luò)模型。

本文提出基于深度聚類算法的自監(jiān)督網(wǎng)絡(luò)模型,如圖1所示。設(shè)計(jì)一個(gè)聚類隊(duì)列,在模型訓(xùn)練的同時(shí),以聚類算法更新隊(duì)列,使模型不僅能學(xué)習(xí)區(qū)分不同實(shí)例,而且能學(xué)習(xí)同類別的相似性。網(wǎng)絡(luò)采用兩個(gè)分支,其中一個(gè)分支以動(dòng)量方式更新參數(shù),并且將輸出用來(lái)更新聚類隊(duì)列,同時(shí)設(shè)計(jì)一個(gè)隊(duì)列存儲(chǔ)C個(gè)類別的均值向量,在迭代訓(xùn)練過(guò)程中采用k-means算法不斷地更新均值向量,具體步驟見算法1。自監(jiān)督訓(xùn)練分支采用InfoNCE損失函數(shù)。

[LossNCE=-logexp (q?k+ / T)i=0Kexp (q?ki / T)]

[Loss=LossNCE+λ?Losssim]

結(jié)合聚類損失函數(shù)得到最終損失函數(shù)([λ]為平衡因子):

算法1: 自監(jiān)督聚類

輸入:特征向量 [q,? k]

輸出:聚類隊(duì)列[ q] ,? 訓(xùn)練損失 [Losssim]

開始 :

[for q,? k in DataLoaer : ]

[j=argmax{ k ? avgi }Ni=1]

[enqueuej,? k ]

[avgj=? 1Kj i=1Kjkj, i]

[d=q?avgj]

[Losssim+=Id>thresold*d]

[return Losssim]

結(jié)束

3.2 標(biāo)簽傳播算法

標(biāo)簽傳播算法的基本理論是:每個(gè)節(jié)點(diǎn)根據(jù)相似度將自己的標(biāo)簽傳播給相鄰的節(jié)點(diǎn),對(duì)于傳播的一個(gè)節(jié)點(diǎn),它通過(guò)計(jì)算與周圍節(jié)點(diǎn)的相似度,根據(jù)相似度大的節(jié)點(diǎn)的標(biāo)簽來(lái)更新附近的標(biāo)簽,最終相似度大的節(jié)點(diǎn)的標(biāo)簽都會(huì)被分為同一標(biāo)簽。本文先將輸入的特征向量進(jìn)行正則化,映射到球面空間,再進(jìn)行標(biāo)簽傳播,詳細(xì)過(guò)程見算法2,其中[Xl= x1,? y1 …? xl,? yl] 為已標(biāo)注數(shù)據(jù)集,[Yl=y1, … , yl ∈{1 … C}] 為類別標(biāo)簽, 類別數(shù)量 [C] 已知,并且所有類別在已標(biāo)注數(shù)據(jù)集中都有展示。[Xu= xl+1,? yl+1 …? xl+u,? yl+u] 為未標(biāo)注數(shù)據(jù)集,[Yu=yl+1, … , yl+u ∈{1 … C}] 為待預(yù)測(cè)數(shù)據(jù),通常情況下,[l << u]。要解決的問(wèn)題就是根據(jù) [Xl] ,[Yl] ,[Xu] 預(yù)測(cè) [Yu] ,具體算法步驟見算法2。

算法2:? 標(biāo)簽傳播

輸入:特征向量矩陣 [X],? 實(shí)標(biāo)簽矩陣[ Yl∈l × C] , 軟標(biāo)簽矩陣 [Yu∈u × C]? ,傳播矩陣 [ T∈l+u × (l+u)]。

輸出 :? 標(biāo)簽矩陣 [Y ]。

步驟:

1. 正則化輸入特征向量 :?; ? ? ? [xi= xixi]

2. 計(jì)算相似度權(quán)重矩陣:? ? [wij=exp- dijσ2=exp (- d=1D(xdi - xdj) σ2)]

3. 計(jì)算標(biāo)簽[ j] 傳播到標(biāo)簽 [i] 的概率 : [Tij=? Pj →i= wijk=1l+uwkj]

4. 傳播:? ? ? [Y=cat(Yl, Yu)]? ? ? ? ? ? [Yt=? T × Yt-1]

5. 重置? [Y ]中已標(biāo)記樣本的標(biāo)簽: [Fl=? Yl]

6. 重復(fù)步驟 4 和 5 直至 [Y] 收斂。

筆者將第一階段訓(xùn)練好的模型作為特征提取器,將支撐集(support set, 有標(biāo)簽), 查詢集(query set,無(wú)標(biāo)簽)同時(shí)送入模型作為輸入,得到其在特征空間的映射,然后再將其歸一化到球形特征空間,通過(guò)標(biāo)簽傳播算法進(jìn)行預(yù)測(cè)分類,整個(gè)流程如圖2所示。

4 實(shí)驗(yàn)與結(jié)果分析

4.1 實(shí)驗(yàn)數(shù)據(jù)集

實(shí)驗(yàn)主要在BreakHis數(shù)據(jù)集上進(jìn)行,BreakHis (Breast Cancer Histopathological Image) 包括82個(gè)病人,一共7909張乳腺癌病理圖片。數(shù)據(jù)集包含了四種放大倍數(shù)(40x,100x,? 200x, 400x)的顯微圖片,分為良性腫瘤,惡性腫瘤兩個(gè)大類。

4.2 實(shí)驗(yàn)流程

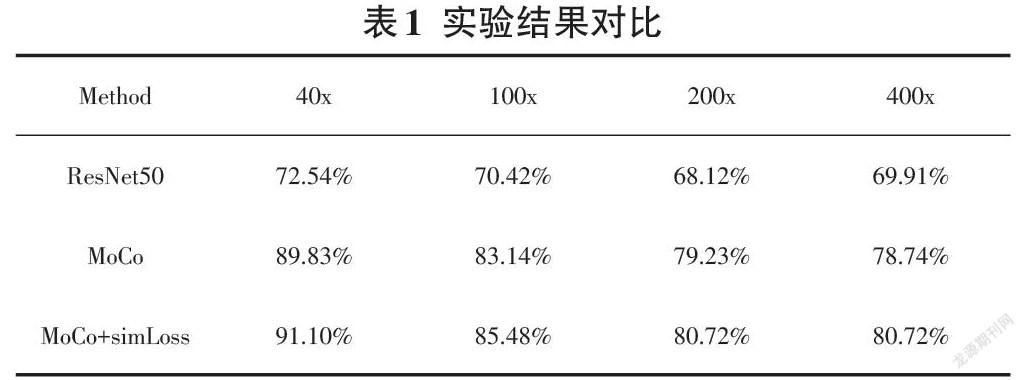

本文主要以ResNet50 和 MoCo作為基線模型和提出的自監(jiān)督聚類模型MoCo + simLoss 作為對(duì)比。本文實(shí)驗(yàn)基于Python3.7環(huán)境和PyTorch1.0框架,使用2塊NVIDIA GEFORCE 2080Ti GPU進(jìn)行訓(xùn)練和測(cè)試。所有實(shí)驗(yàn)的輸入圖像長(zhǎng)寬固定為224,batchsize 設(shè)置為64,訓(xùn)練50 epoch,采用分類準(zhǔn)確率來(lái)衡量算法的效果,數(shù)據(jù)增強(qiáng)方面則使用了隨機(jī)水平翻轉(zhuǎn),隨機(jī) HSV 變化,隨機(jī)縮放和隨機(jī)剪切。優(yōu)化算法采用動(dòng)量為 0.9 隨機(jī)梯度下降(SGD)。

4.3 實(shí)驗(yàn)結(jié)果

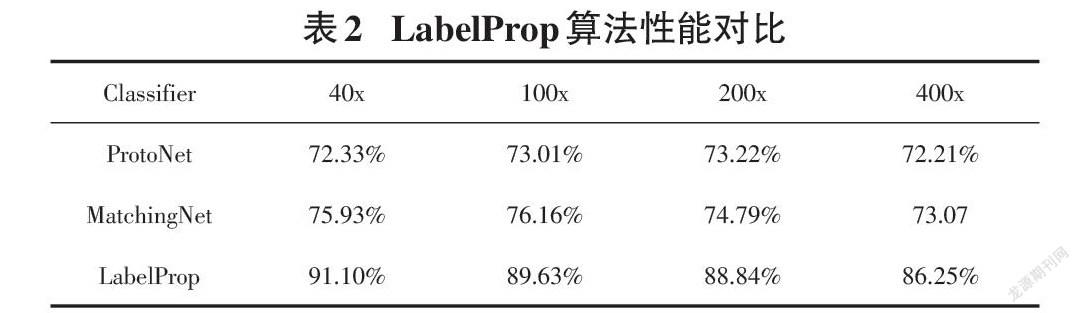

實(shí)驗(yàn)結(jié)果表1表明,基于MoCo的自監(jiān)督網(wǎng)絡(luò)模型比ResNet50預(yù)訓(xùn)練模型有很大的性能提升,說(shuō)明自監(jiān)督在醫(yī)學(xué)圖像特征提取任務(wù)上的有效性并且加入自監(jiān)督聚類simLoss模塊能有效提升模型的性能;表2 驗(yàn)證了標(biāo)簽傳播算法的有效性,實(shí)驗(yàn)結(jié)果表明標(biāo)簽傳播算法比基于歐式距離的ProtoNet 和基于余弦距離的MatchingNet效果要好很多。

最后與傳統(tǒng)分類算法相比,實(shí)驗(yàn)結(jié)果表3表明模型在 5-shot 以及 10-shot 的情況下已經(jīng)比傳統(tǒng)算法有更好的分類效果, 并且隨著每個(gè)類別的有標(biāo)簽樣本的增多,模型分類效果越來(lái)越好。

5 總結(jié)

本文提出了基于自監(jiān)督聚類算法的醫(yī)學(xué)圖像分類模型,通過(guò)對(duì)比和消融實(shí)驗(yàn)證明了本文提出的方法在小樣本情況下的醫(yī)學(xué)圖像分類問(wèn)題上比傳統(tǒng)的機(jī)器學(xué)習(xí)算法和全監(jiān)督算法具有更好的效果。

參考文獻(xiàn):

[1] He K, Fan H, Wu Y, et al. Momentum contrast for unsupervised visual representation learning[C]//Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. 2020: 9729-9738.

[2] Chen T, Kornblith S, Norouzi M, et al. A simple framework for contrastive learning of visual representations[C]//International conference on machine learning. PMLR, 2020:1597-1607.

[3] Azizi S, Mustafa B, Ryan F, et al. Big self-supervised models advance medical image classification[J]. arXiv preprint arXiv:2101.05224, 2021.

[4] Min E X,Guo X F,Liu Q,et al.A survey of clustering with deep learning:from the perspective of network architecture[J].IEEE Access,2018,6:39501-39514.

[5] Zhu X.Learning from Labeled and Unlabeled Data with Label Propagation[J]. Tech Report, 2002.

[6] Vinyals O, Blundell C, Lillicrap T, et al. Matching networks for one shot learning[J]. Advances in neural information processing systems, 2016,29: 3630-3638.

[7] Snell J, Swersky K, Zemel R S. Prototypical networks for few-shot learning[J]. arXiv preprint arXiv:1703.05175, 2017.

【通聯(lián)編輯:梁書】

- 電腦知識(shí)與技術(shù)的其它文章

- 智慧課堂教學(xué)模式下程序設(shè)計(jì)類課程的探索

- 應(yīng)用型本科計(jì)算機(jī)技術(shù)下“以學(xué)生學(xué)習(xí)成果”為導(dǎo)向的評(píng)價(jià)模式研究

- 校企合作下物聯(lián)網(wǎng)應(yīng)用技術(shù)專業(yè)人才培養(yǎng)方案探究

- 立德鑄魂,計(jì)算機(jī)師范教學(xué)與思政教育的和諧之探究

- 基于慕課和Python123的程序設(shè)計(jì)課程分層教學(xué)研究與實(shí)踐

- 基于工作過(guò)程系統(tǒng)化的應(yīng)用型課程建設(shè)路徑規(guī)劃——以模擬電子技術(shù)課程為例