基于卷積神經網絡的SAR圖像目標檢測綜述

劉 暢,朱衛綱

(航天工程大學 電子與光學工程系, 北京 101416)

合成孔徑雷達(Synthetic Aperture Radar,SAR)作為一種主動式微波成像傳感器,相比于光學遙感手段,不受氣候、天氣、光照等因素的制約,可以實現全天候、全天時的對地觀測。

SAR圖像目標檢測旨在從復雜的場景中快速有效地提取感興趣的目標位置,是SAR自動目標識別(SAR-automatic target recognition,SAR-ATR)的重要組成部分。

隨著SAR的迅速發展,現有的SAR圖像檢測技術難以滿足實際數據處理的需求。一方面,SAR系統的廣泛應用以及成像分辨率的提高,對SAR圖像目標的檢測效率提出了更高的要求;另一方面,SAR在不同工作模式下具有不同的極化方式、分辨率以及照射角度,導致目標圖像特征變化較大,這也給SAR圖像目標的檢測帶來了更大的挑戰。因此如何從海量數據中挖掘有用信息,準確、高效、智能地完成SAR圖像目標檢測任務,是當前亟待解決的問題。近年來,隨著人工智能技術的迅速發展,深度學習的方法開始應用于SAR圖像檢測任務。卷積神經網絡(convolutional neural network,CNN)可以實現對圖像高層特征的主動提取,避免了人工選取特征的復雜工作,具有良好的分類準確度和魯棒性,為SAR圖像目標的檢測提供了新的途徑。

本文在總結SAR圖像目標檢測算法基礎上,梳理了基于CNN的目標檢測框架及其在SAR圖像檢測中的應用,分析了SAR圖像目標檢測的難點問題與下一步研究趨勢。

1 傳統檢測算法的研究現狀

傳統的SAR圖像目標檢測算法主要有基于背景雜波統計分布的恒虛警率(constant false-alarm rate,CFAR)檢測算法和人工提取圖像紋理特征的檢測算法。

1.1 恒虛警率檢測算法

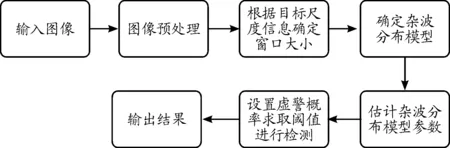

CFAR檢測算法利用目標周圍的背景單元,選擇恒定的虛警概率確定檢測閾值。利用CFAR算法檢測SAR圖像目標的一般流程如圖1所示[1]。

圖1 CFAR算法的檢測流程框圖

CFAR算法需要預先確定背景雜波分布的統計模型,由于傳統雙參數CFAR與基于K分布的CFAR檢測算法在處理寬幅圖像時,對所有滑窗內的雜波都使用同一種統計模型,這種處理方式容易導致統計模型在不適應區失配。針對這個問題,林旭等[2]提出了一種基于自適應背景雜波模型的CFAR寬幅SAR圖像艦船檢測算法。通過背景窗口的多尺度統計方差判斷目標所處的雜波環境,自適應選擇對應的背景雜波分布模型。

導致CFAR檢測效果差的另一原因是算法沒有充分利用圖像中的特征信息,僅僅利用了圖像灰度的統計分布特征。Huang Y[3]提出了一種結合目標語義特征的CFAR算法,在檢測高分辨率SAR圖像目標時具有更低的虛警率。艾加秋[4-5]利用SAR圖像目標內部相鄰像素的強相關性特征,提出了基于灰度相關性的聯合CFAR的檢測算法。曲岳晗[6]利用似物性判斷方法,使用二值化賦范梯度特征來提取CFAR檢測窗口。

CFAR算法容易實現,計算量相對較小,在簡單背景雜波下具有較好的檢測效果。但是算法只考慮灰度對比度,忽略了目標的結構信息,魯棒性與抗干擾能力差,在復雜背景雜波下檢測性能較差。

1.2 基于圖像紋理特征的檢測算法

紋理是一種反映圖像中同質現象的視覺特征,通常可分為四類:統計型紋理特征(如灰度共生矩陣、灰度—梯度共生矩陣),模型型紋理特征(如分形模型、隨機場模型),信號處理型紋理特征(如小波變換),結構型紋理特征(如局部二值模式)。

目前在SAR圖像目標檢測的研究中,分形特征的應用最為廣泛。L M Kaplan[7]利用擴展分形(Extended Fractal,EF)特征檢測SAR圖像中的車輛目標,該特征不僅對目標背景的對比度敏感,同時也對目標尺寸敏感,與CFAR算法相比,降低了檢測虛警率。D Charalampidis[8-9]提出了小波分形(Wavelet Fractal,WF)特征,可以有效地對圖像中的不同紋理進行分割與分類。劉冬等[10]利用指數小波分形特征檢測SAR圖像目標,該方法對目標對比度和尺寸敏感,且考慮了目標邊緣特征與區域內部平滑性特征。袁湛等[11]提出了改進擴展分形特征,在強雜波、多目標環境下具有更好的檢測性能。

相比于CFAR檢測算法,基于紋理特征的算法利用了更多的圖像信息,具有更高的檢測精度。但是紋理特征需要人工設計提取,設計過程復雜耗時,難以保證檢測的時效性。

2 基于卷積神經網絡的檢測算法

近年來,隨著深度學習方法的迅速發展,深度學習模型開始應用于圖像檢測任務。

深度學習方法的突出優勢在于:① 可以實現對高層特征的主動提取,避免了人工選取特征的復雜工作;② 利用深層的網絡結構逐層進行非線性變換,對復雜函數有良好的逼近效果,具有較高的分類準確度;③ 在訓練數據集較為完善的情況下,深度學習方法具有較強的魯棒性和泛化性,能夠適應復雜多變的應用環境。

卷積神經網絡(convolutional neural network,CNN)是一種針對二維圖像數據特征提取而設計的深度學習模型,通過多個卷積層擬合復雜函數,每個卷積層的特征都由前一層的局部特征通過共享的權重得到,有效地減少了網絡的參數個數,緩解了模型的過擬合問題,是目標檢測、識別等圖像處理領域廣泛采用的深度學習模型。

2.1 基于CNN的目標檢測框架

基于CNN的圖像目標檢測框架主要有兩類,分別是基于候選區域的目標檢測框架和基于回歸的目標檢測框架。

2.1.1基于候選區域的目標檢測算法

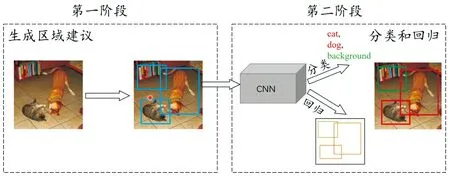

如圖2所示,基于候選區域的目標檢測框架先通過算法產生目標候選框,再對候選框內的區域做目標分類與邊框回歸,由于需要分為兩階段進行檢測,因此也稱為雙階段(two-stage)檢測算法。此類算法的特點是檢測精度高,但速度較慢,代表性算法有R-CNN[12]、SPP-net[13]、Fast R-CNN[14]、Faster R-CNN[15]、R-FCN[16]等。

圖2 雙階段算法的檢測框架示意圖

R-CNN算法通過selective search從輸入圖像中提取約2 000個候選區域,并將每個候選區域縮放為固定大小送入CNN網絡進行特征提取,然后將得到的特征向量用線性SVM分類器預測出候選區域中所含每個類別的概率值。最后為了提升定位的準確性,采用邊界框回歸(bounding box regression)對預測邊框進行調整。

SPP-net在產生候選區域之后將整張圖片送入CNN網絡,再將候選區域映射到特征圖得到對應的特征區域,從而避免了R-CNN中對每個候選區域單獨提取特征。在卷積層和全連接層之間加入空間金字塔池化(Spatial Pyramid Pooling,SPP)結構用于將不同大小的特征區域轉換為固定維度的特征向量,代替了R-CNN算法在輸入卷積神經網絡前對各個候選區域進行剪裁、縮放操作,使其圖像子塊尺寸一致的做法,避免了因此產生的目標變形。

Fast R-CNN借鑒了SPP-net的思想,對于每個候選區域,使用感興趣區域池化(ROI pooling)層來從CNN特征圖中提取固定長度的特征向量,通過全連接層之后,特征向量進入2個輸出層,分別進行分類和邊界框回歸。

Faster R-CNN采用RPN (Region Proposal Network)直接產生候選區域,取代了R-CNN以及Fast R-CNN中選擇性搜索(selective search)過程,提高了檢測速度。產生的候選區域送入Fast R-CNN網絡進行分類以及邊界框回歸。

R-FCN將Faster R-CNN最后的全連接層換成了位置敏感的卷積網絡,從而讓所有計算可以共享。

2.1.2基于回歸的目標檢測算法

基于回歸的目標檢測框架將檢測任務作為回歸問題,無需產生先驗框,直接利用神經網絡進行端到端的檢測,因此也稱為單階段(one-stage)檢測算法。此類算法的特點是速度很快,同時具有較高的檢測精度。其代表算法有YOLO[17-19]、SSD[20]、Retina-net[21]、RFB-net[22]等。

YOLO[17]算法將圖像縮放為固定大小并劃分為S×S的網格,每個網格預測B個邊界框以及邊界框置信度。YOLOv2[18]采用錨框(anchor boxes)進行邊界框預測,并通過K-means聚類對錨框進行初始化。YOLOv3[19]通過引入特征金字塔網絡(feature pyramid networks,FPN),將不同分辨率和不同語義強度的特征進行融合,解決了多尺度目標檢測的問題。

SSD算法結合Faster R-CNN的錨框機制和YOLO的回歸思想進行目標檢測,相比于早期版本的YOLO,提高了定位精度與分類精度。

Retina-net算法提出了聚焦損失(focal loss)函數,解決了訓練過程中正負樣本類別不平衡的問題,這也是制約單階段算法檢測效果的核心問題。

RFB-net算法在SSD網絡中引入感受野模塊(receptive field block,RFB),通過模擬人類視覺的感受野,加強網絡的特征提取能力。相比于SSD算法具有更高的檢測精度。

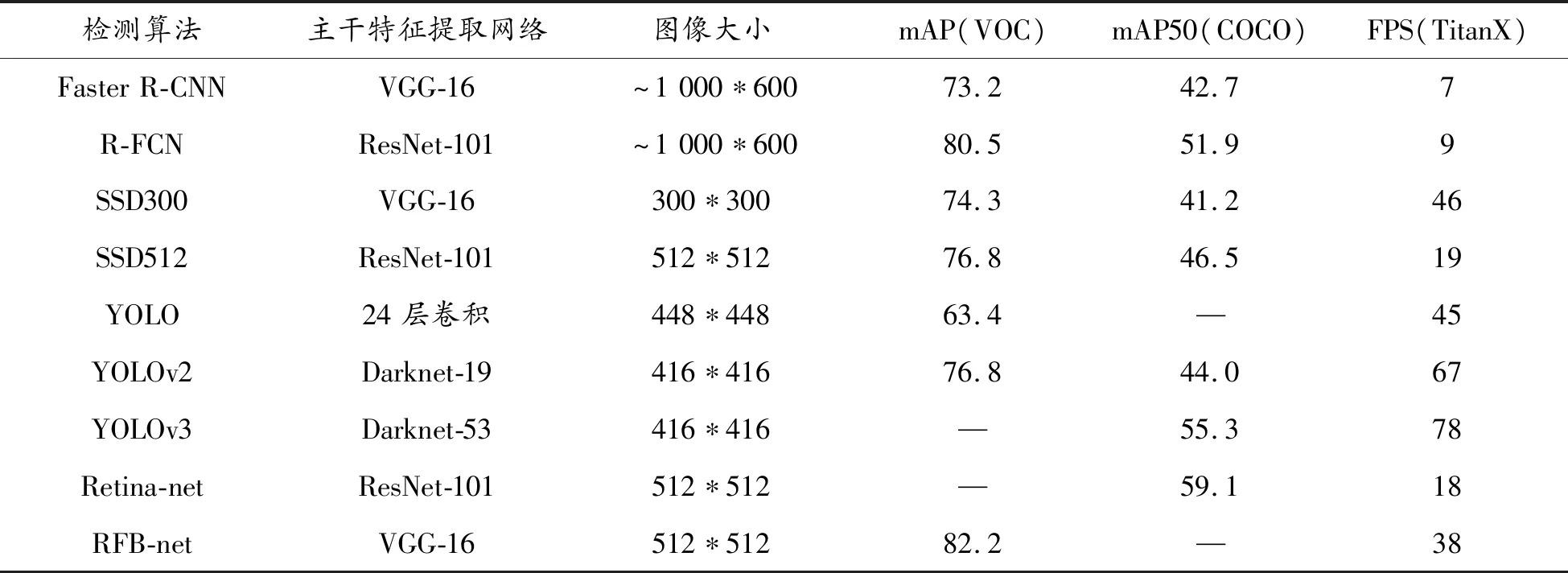

2.1.3主要檢測算法的性能對比

各主要算法的性能參數如表1所示。從表1可以看出,雙階段檢測算法的檢測精度普遍較高,但檢測速度很慢;單階段算法的檢測速度較快,且檢測精度接近雙階段算法,實時性強,效率高。

表1 主要目標檢測算法的檢測性能參數

2.2 CNN在SAR圖像目標檢測中的應用

SAR圖像與光學圖像相比,在包含信息、分辨率、成像機制方面都有較大區別:① 從包含信息方面來看,光學圖像通常含有多個顏色通道的灰度信息,而SAR圖像只記錄單一波段的回波信息,以二進制復數形式記錄下來,但基于每個像素的復數數據可變換提取相應的振幅和相位信息;② 從分辨率方面看,SAR圖像的分辨率相對較低,由于存在斑點噪聲,信噪比也較低;③ 從成像機制方面看,光學圖像采用中心投影或推帚式掃描的方式進行成像,而SAR的成像方式是主動發射與接收電磁波,成像幾何為斜距投影,會產生疊掩、透視收縮、多路徑假目標等幾何畸變,目標特征具有姿態敏感性。上述的差異性為SAR圖像目標檢測帶來了新的難題。

將CNN應用于SAR圖像目標檢測中,目前的研究主要集中在以下幾個方面:① 在復雜場景下檢測目標,降低虛警率;② 多尺度小目標檢測;③ 小樣本學習的方法;④ 結合傳統算法提高算法檢測性能。

下面介紹CNN應用于SAR圖像目標檢測的研究進展。

2.2.1復雜場景下的目標檢測

在復雜背景環境下,由于訓練數據不足或者網絡提取特征的性能不強,背景雜波中可能存在與目標相似的特征,導致網絡誤檢。

目標周圍的背景通常可以提供有用的上下文信息,例如檢測海面航行的艦船,若周圍背景為海雜波,則目標為艦船的可能性較大,若周圍背景為陸地,則可將待檢測目標排除。文獻[23]提出了結合上下文的檢測方法檢測SAR圖像艦船目標,利用目標周圍的背景信息提高檢測結果的可靠性,減少了虛警。

目標檢測網絡在給出最終的邊界框和分類分數之后,得分高于閾值的邊界框被直接視為目標。但對于復雜場景下的目標檢測,基于該準則的檢測結果往往存在較多的錯誤。文獻[24]使用最大穩定極值區域(maximum stability extremal region,MSER)準則進一步約束目標區域的判定。目標得分需要高于檢測閾值的條件下,只有目標區域為穩定的高灰度值,區域面積與長寬比符合條件時,才能最終判定為目標。

由于目前基于神經網絡的圖像檢測任務通常采用矩形框來標記目標位置,這種方式在框選目標時通常也會將一部分背景雜波引入,這樣提取的目標特征與背景特征的差異就會弱化,導致檢測性能下降。文獻[25]用DRBox-v2(一種旋轉邊界框)取代傳統矩形框標記目標,使得標記選框可以適應不同的目標朝向。這種標記方法在框選目標時幾乎不會引入背景雜波,提高了網絡在復雜環境下的檢測效果。文獻[26]將目標檢測任務轉化為像素分類問題,利用全卷積神經網絡(fully convolutional neural network,FCN)對圖像進行像素級的分類,有效避免了背景雜波的干擾,降低了虛警率。同時提出目標及陰影區域聯合檢測的方法,提高了檢測率。文獻[27]認為簡單樣本與困難樣本的不平衡是復雜背景下檢測效果較差的主要原因。因此,文獻[27]借鑒了focal loss[21]的思想,使用新的二分類損失函數,解決簡單樣本與困難樣本的不平衡問題,使訓練出的模型更好地區分目標與復雜背景。

2.2.2多尺度條件下小目標的檢測

在目標檢測中,由于分辨率較低或者自身真實尺寸較小,可能會出現目標在圖像中所占像素較少而導致漏檢的情況,這一類目標通常稱為“小目標”。

小目標在檢測中易漏檢的原因在于:① 目標圖像的像素過少,網絡難以提取特征;② 為了分類準確,檢測網絡利用高層特征生成區域與分類得分,而小目標在高層網絡中特征圖較小,喪失了較多信息。

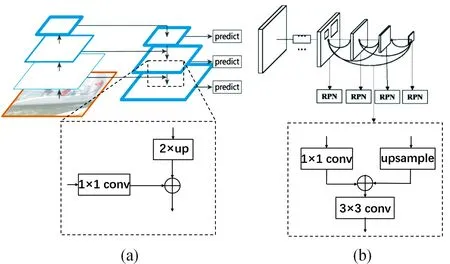

目前的研究中,大多采用多尺度特征融合的方法解決小目標在高層特征中信息丟失的問題。由于低層特征具有較多的位置信息,適合小目標的檢測,因此將底層特征與高層特征進行融合,既能充分利用高層特征的語義信息,也能利用低層特征的位置信息,從而使得檢測網絡具有多尺度檢測的能力。多尺度特征融合的兩種方法如圖3所示。

圖3 多尺度特征融合的兩種方法示意圖

特征金字塔網絡(feature pyramid networks,FPN) 是具有代表性的一種多尺度特征融合方法,如圖3(a)所示,FPN的方法自頂向下,將高層特征上采樣與低層特征進行融合,再在不同尺度上分別預測結果。文獻[28-30]都采用了FPN的特征融合方式,提高了對小目標的檢測能力。文獻[31]采用了另一種融合方法,如圖3(b)所示,在各層特征之間采用密集連接的方式進行融合,相比于FPN的非密集連接方式,漏警率明顯降低。文獻[32]采用一種改進的高分辨率特征金字塔網絡(HRFPN),充分利用高分辨率和低分辨率卷積的特征圖來進行SAR圖像艦船檢測,其不僅可并行連接高至低分辨率子網,還可以保持圖像高分辨率。

文獻[29]不僅對多尺度特征進行了融合,還在損失函數中引入了目標尺寸的平衡項,使小目標具有更低的損失函數值,從而更容易被檢測到。

在檢測網絡中,較多的下采樣次數會減小特征圖分辨率,這對小目標的檢測是不利的。因此文獻[33]在網絡設計中僅采用2次下采樣操作,保證了輸出特征圖的高分辨率。但是減少下采樣操作會引起特征的感受野變小的問題,因此在網絡中加入空洞卷積,擴大特征感受野。

文獻[34]基于inception模塊和空洞卷積擴大感受野的原理,在網絡中加入了淺層特征增強結構,增強了模型對小尺寸目標的適應能力。

2.2.3小樣本學習方法

深度學習方法需要大量訓練數據作為驅動,訓練數據集是否完備直接影響訓練出的模型的泛化能力,而收集數據、制作標簽的過程則需要消耗大量的人力物力。因此如何充分利用有限的樣本訓練出較好的模型是值得研究的問題。

文獻[35]采用遷移學習中微調(fine-tuning)的方法,不僅調整預訓練網絡模型以適應數據集,而且通過反向傳播調整網絡參數。文獻[36]利用了遷移學習的思想解決SAR目標分類問題中各類別數據不平衡的問題。采用批內平衡采樣和模型微調兩階段的遷移學習,提高了少數類目標的識別精度。

通過數據增強擴充數據集,可以一定程度上提高模型的泛化性。文獻[29,37-39]均通過平移、旋轉、加噪等方式進行數據增強。但由于SAR圖像具有姿態敏感性,簡單地對圖像進行旋轉變換并不能反映目標姿態角的變化特征。文獻[40]利用區域生長算法對切片數據進行圖像分割,并按照一定分布規律替換目標背景中的部分像素點,擴充的圖像背景具有多樣性,但沒有引入新的目標圖像。

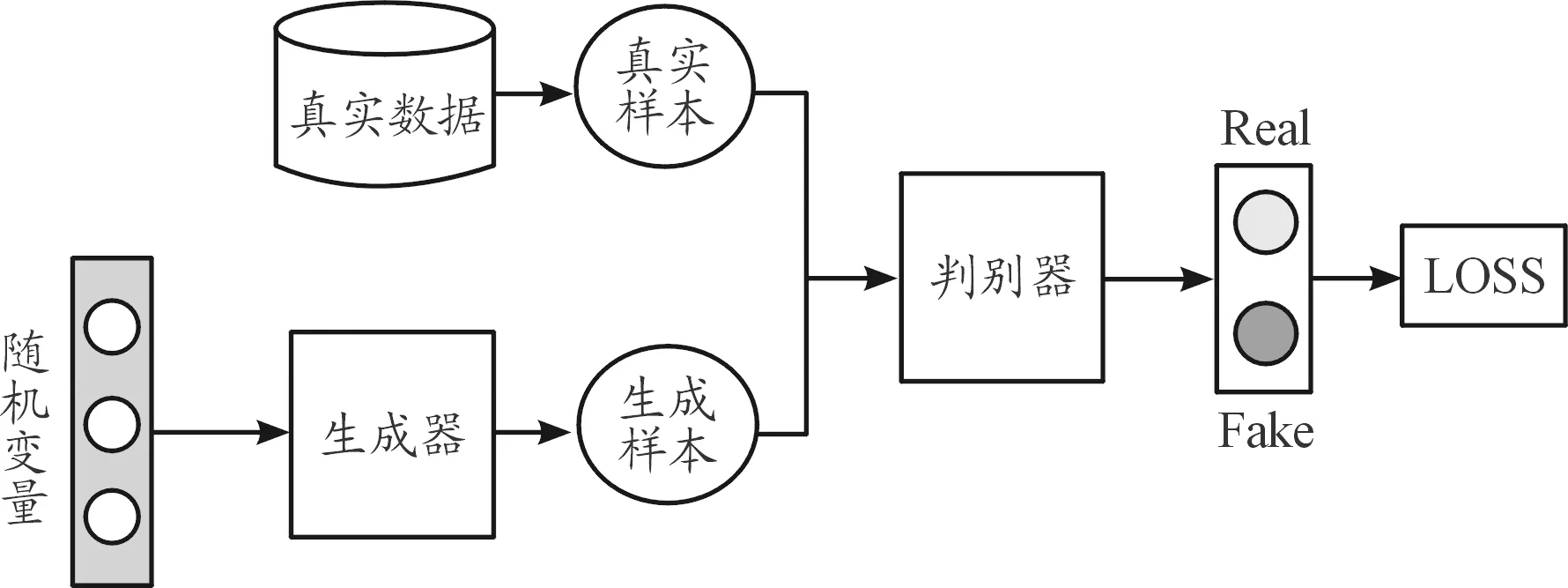

生成式對抗網絡(generative adversarial network,GAN)是另一種擴充數據集的有效手段,其網絡結構如圖4所示,在訓練過程中,生成網絡的目標是盡量生成真實的圖像去欺騙判別網絡,而判別網絡的目標就是盡量把生成的圖像與真實圖像區分開來,這樣就構成了一個動態的博弈過程。相比于傳統方法,利用GAN擴充數據能夠更好地模擬真實數據的分布特征。文獻[41]使用WGAN (wasserstain GAN)對MSTAR數據集進行擴充,并利用擴充后的數據集訓練識別網絡。實驗結果將識別的準確率從79%提升到91.6%,證明了這種數據擴充方法的有效性。文獻[42]基于GAN與空間變換網絡(STN)的思想引入了對抗空間變換網絡,同時在隨機梯度下降過程中引入線上難例挖掘(OHEM)。對抗空間變換網絡在特征圖上產生新的訓練樣本,并且能夠適應目標各種角度變化和尺度變換。在網絡后向傳播過程中引入OHEM技術,能夠自動選擇損失函數較大的難例樣本進行回傳梯度,使檢測器能夠更充分地利用難例樣本。

圖4 生成式對抗網絡的模型結構框圖

對SAR圖像進行切片標記需要耗費大量人力,文獻[43]利用少數切片級標記的樣本和多數圖像級標記的樣本,提出了一種半監督學習的訓練方法。圖像級標記的樣本僅需標記圖像中是否含有目標,能夠減少圖像標注所需的時間人力。實驗表明,該方法的性能與全監督方法的性能相差不大。

2.2.4CNN與傳統算法的結合

作為最早出現的SAR圖像檢測算法,CFAR檢測算法發展成熟,且計算量相比于深度學習方法較少,文獻[38]利用CFAR提取ROI對圖像區域進行預篩選,再利用CNN對篩選出的區域進行精細檢測,提高了檢測精度和效率。文獻[39]利用范數梯度圖(norm gradient map)提取圖像顯著區域,再利用CNN進一步對區域內目標定位。

人工提取的特征可以作為CNN特征圖的補充,將兩種特征進行融合,可以提高檢測模型的可靠性。文獻[44]通過支持向量機(SVM)融合了SAR圖像目標電磁特征和幾何特征,最后與卷積神經網絡的特征圖進行融合,實驗表明了該方法的有效性和可行性。文獻[45]提出了聯合使用強度和邊緣信息的目標識別框架,分別從強度圖像與梯度幅值圖像中提取兩類特征,并將兩種特征進行融合,同時保持對應的空間關系。此方法對于小數據集高分辨率SAR圖像的檢測效果較好,尤其在復雜場景下,也有較好的性能。

3 下一步的研究方向

結合研究現狀,對CNN在SAR圖像目標檢測算法研究的發展方向進行展望:

1) 復雜背景下的干擾以及不同分辨率、入射角等參數的影響,都對模型的泛化性提出了更高的要求,目前檢測算法的精度仍然難以達到實際應用的需求。針對檢測任務特點進一步改進網絡結構與訓練策略,將有助于提高算法的魯棒性與檢測精度。

2) 目前研究的CNN檢測框架是一種有監督學習的方式,需要制作訓練數據標簽,通常耗費較多時間和人力。隨著深度學習技術的不斷發展,可以將卷積神經網絡應用到強化學習、無監督學習、生成對抗模型等學習模型中,減少對標簽數據的依賴。

3) 由于深度學習方法需要大量的訓練數據作為驅動,目前用于目標檢測的公開數據集有SSDD[46]、OpenSAR[47]、Air-SARShip[48]等,但未來對檢測算法的深入研究仍需要大量數據作為研究支撐。生成式對抗網絡作為一種生成模型,具有很強的數據擴充能力,研究基于生成式對抗網絡的數據增強方法,能夠提高數據集的完備性,使模型具有更好的泛化性。

4) 傳統的檢測算法可以作為深度學習方法的補充,綜合利用人工提取的特征以及網絡自動提取的特征有助于更準確地檢測目標,多種算法的融合將為SAR圖像目標檢測提供更多的渠道。

4 結論

深度學習方法在SAR圖像目標檢測領域的應用具有巨大的價值和潛力。本文在對SAR圖像目標檢測方法綜述基礎上,結合了基于卷積神經網絡的目標檢測方法的應用,為下一步的研究指明了方向。卷積神經網絡方法為SAR圖像的特征提取提供了自動化、智能化途徑,隨著對深度學習方法的研究更加深入,SAR圖像目標檢測技術也將取得更大的突破。