非局部稀疏表示的圖像超分辨率重建方法

周 苑,周 巖,李慧敏

(1.河南工程學院 計算機學院,河南 鄭州451191;2.云南民族大學 數學與計算機科學學院,云南 昆明650031)

0 引 言

現有的超分辨技術大致可分為3 類:基于插值的方法[1,2]、基 于 正 則 項 的 方 法[3,4]和 基 于 學 習 的 方 法。基 于 插值的方法重建的圖像容易產生過渡平滑現象,并且伴隨有振鈴和鋸齒瑕疵;基于正則項的方法則不能夠對真實圖像的復雜性進行建模且在選擇合適的正則化參數上存在局限性;基于學習的方法與前兩類方法相比,能夠引入大量的先驗知識,很好地重建圖像的高頻細節,正是由于這個原因,基于學習的方法已成為近幾年研究的焦點。

基于學習的方法一般通過學習得到低分辨率圖像塊及其對應高分辨率圖像塊之間的關系,然后利用這種關系對低分辨率圖像中丟失的高頻信息進行預測。Yang等[5]利用基于學習的方法,提出了一種稀疏表示的方法用于重建高分辨率圖像,這種方法假設高低分辨率圖像塊在對應的過完備字典下有相同的稀疏表示;Jing等[6]提出了一種多空間的稀疏表示方法,該方法首先將圖像分解為結構成分和紋理細節,然后通過分別對結構成分和紋理細節進行編碼來得到高分辨率的圖像;Yang等[7]提出了一種基于多幾何字典的分簇的稀疏編碼策略,該方法首先訓練幾何簇的幾何字典,然后高分辨率圖像塊在不同的幾何字典下進行稀疏的編碼;文獻[8]對Yang的算法進行進一步研究,提出了局部正則化參數自適應的方法。近來的研究表明,重建圖像的質量很大程度上取決于圖像的幾何結構,在稀疏表示中利用潛在的幾何結構信息去加強其穩定性是很重要的[9]。通過將圖像結構的非局部自相似性 (non-local self-similarity)引入到稀疏系數空間[10,11],很好地保護了圖像的幾何結構。然而這種方法丟失圖像塊之間的差異性,使重建的圖像過渡平滑。為了解決這個問題,我們提出了一種非局部Laplacian稀疏表示方法,與之前的稀疏表示方法相比,提出的方法同時保護了圖像的幾何結構和不同圖像塊之間的差異性,從視覺效果和客觀評價指標上都取得了更好的效果。

1 圖像稀疏表示重建原理

1.1 稀疏表示重建

在文獻 [5]中,Yang等通過強迫對應的高低分辨率圖像塊具有相同的稀疏表示,對大量對應的高低分辨率圖像塊的學習建立高分辨率字典Dh和低分辨率字典Dl,計算待重建低分辨率圖像塊在Dl下的稀疏表示a,根據高低分辨率圖像塊具有相同的稀疏表示a,由稀疏表示a 選擇Dh中的原子塊進行線性組合從而重建出高分辨率圖像塊。

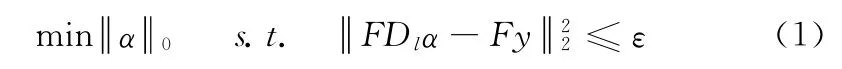

計算低分辨率圖像塊y 在低分辨率字典Dl下的稀疏表示a 是重要的一步,其可以由式 (1)定義

其中,F 為特征提取算子,主要作用是保證稀疏系數α盡可能接近y。但是式 (1)的求解是NP-HARD問題,是非凸化問題。已經有學者證明在在足夠稀疏的條件下,l1范問題是最接近零范數的凸優化問題,所以大量的研究集中于如何利用l1范優化來近似求解上述零范數問題,即轉化為解下式的問題

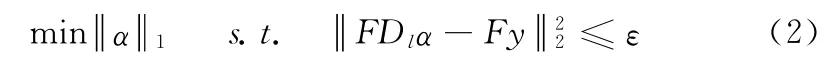

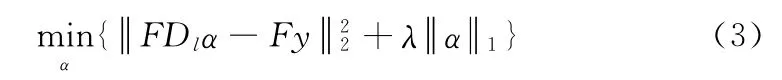

式 (2)可進一步改寫為式 (3)

其中,參數λ是稀疏正則項參數。但是對于單獨的每個局部圖像塊解式 (3)并不能保證相鄰圖像塊之間的兼容性。為了保證鄰近圖像塊之間的兼容性,修改式 (3)使低分辨率圖像塊的重建圖像塊Dhα 與之前計算的相鄰圖像塊更接近,如式 (4)所示

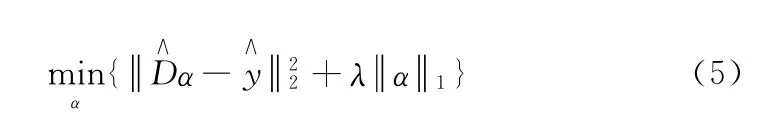

其中,矩陣P 表示提取當前目標圖像塊與之前重建圖像塊之間的重疊區域,ω 為之前重建圖像重疊部分的值,式 (5)可以寫為

1.2 雙字典訓練

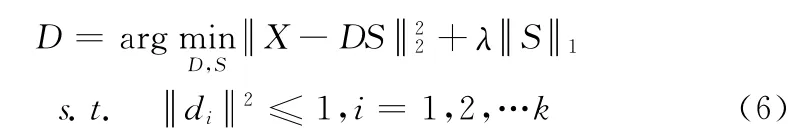

在上節中我們假設字典Dh、Dl是已經訓練得到的,那么這兩個字典是如何訓練得到。在Yang提出雙字典訓練之前,已有作者提出單個字典訓練的模型,如下

其中,X =[x1,…,xn]∈Rm×n,xi為圖像塊,D =[d1,…,dn]∈Rm×k,S=[s1,…,sn]∈Rk×n,si為xi在字典D 下的稀疏表示。

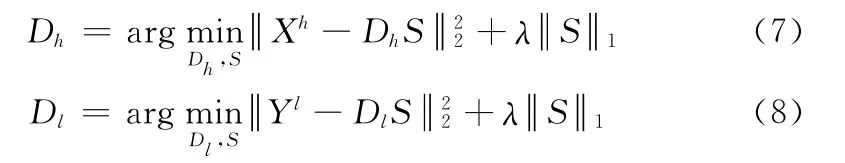

在超分辨率重建中,對于高低分辨率樣本圖像庫,我們從中提取大量高分辨率圖像塊集Xh={x1,x2,…,xn}和與其對應的低分辨率圖像塊集Yh={y1,y2,…,yn},仿照式 (6)訓練高分辨率字典Dh和低分辨率字典Dl

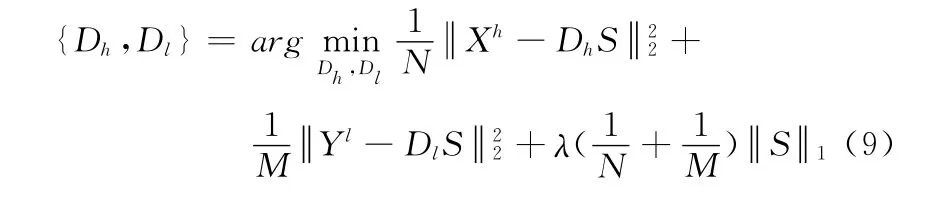

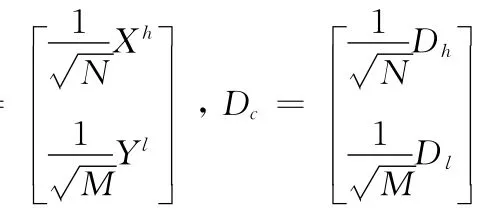

我們強迫高低分辨率圖像塊的稀疏表示相同,對式(7)、式 (8)進行組合

其中,Xc=。

這樣就可以按照單字典學習策略來同時訓練雙字典。

2 非局部Laplacian稀疏表示SR方法

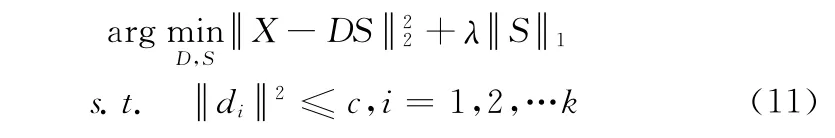

從上節中我們可以將傳統的稀疏表示模型總結為式(11)

其中,X =[x1,…,xn]∈Rm×n,xi為圖像塊,S =[s1,…,sn]∈Rk×n,si為xi在字典D 下的稀疏系數。

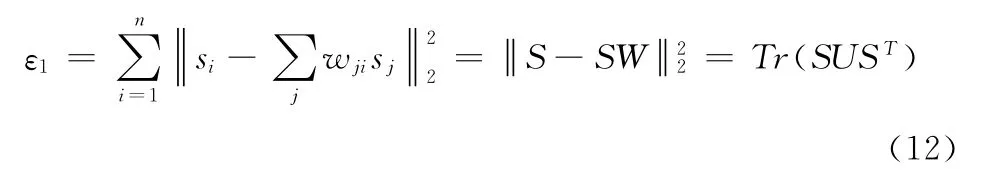

有關的研究結果表明,關于圖像幾何結構的一個重要先驗條件就是在自然圖像中往往包含相似的結構塊,但是由于稀疏表示方法具有潛在的不穩定性,具有相似幾何結構的圖像塊經常有不同的稀疏系數,從而導致了重建出不準確的幾何結構[12]。因此很有必要利用圖像的非局部自相似性去穩定稀疏表示。這種先驗約束正則項已被引入到圖像重建中去[10,11],可以用式 (12)表示

將式 (12)引入傳統的稀疏表示模型式 (11)中得到式 (13)

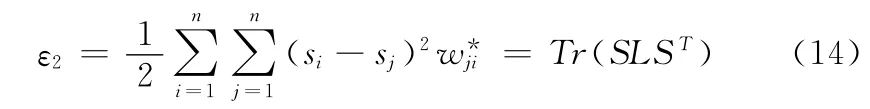

這種稀疏表示模型利用稀疏系數的自相似性減少了稀疏表示的誤差,保護圖像的幾何結構。值得注意的是,從式(12)可以看到這種非局部先驗知識其實是一個融合的過程,它將非局部區域內K個相似的圖像塊進行加權融合,這樣雖然保護了圖像幾何結構,但是丟失了圖像塊中的一些細節信息。因此重建后的非局部塊之間是非常相似的,導致重建后的結果變得過度平滑。換句話說,在融合之后,圖像塊之間的差異性丟失了。為了保護這種差異性,引入了文獻 [13]提出的Laplacian稀疏系數約束正則項,如式(14)所示

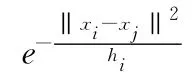

其中,L=F*-W*為Laplacian矩陣,W*為保護圖像塊之間差異性的權重矩陣,其元素為圖像塊xi和xj的相似權重。如果xi為xj的K′個最近鄰塊中一個或者xj為xi的K′個最近鄰塊中一個時,,其它情況下,=0。F*為對角矩陣,其第i個元素為與xi相關的所有權重之和,即。

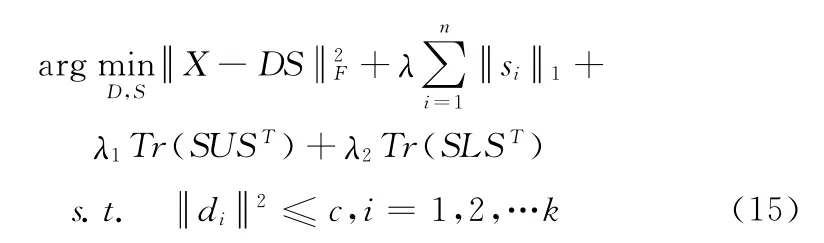

把式 (14)同時引入式 (13),提出了式 (15)所示的非局部Laplacian稀疏表示模型

式 (15)的l1范數最小化問題可以通過文獻 [14]中的feature-sign search搜索算法和文獻 [15]中的迭代最優化算法求解。

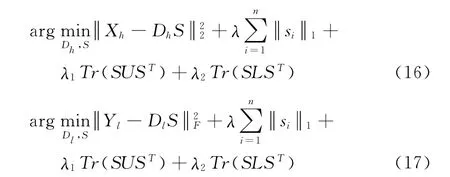

如上節中提到的,仿照式 (7)和式 (8),利用提出的稀疏表示模型式 (15)訓練高低分辨字典Dh、Dl

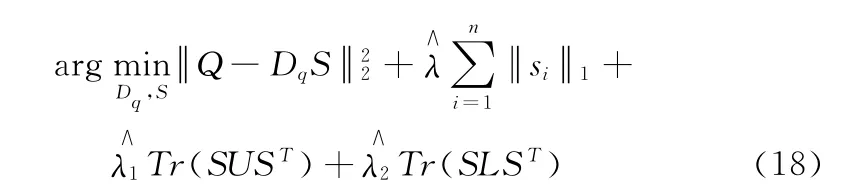

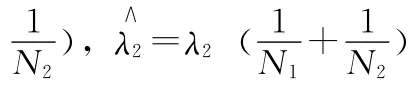

將式 (16)、式 (17)合并為式 (18)

通過式 (19)計算出si后,我們就可以通過=恢復高分辨率圖像塊,將多個高分辨率圖像塊進行組合后得到高分辨率圖像X*。

3 實驗結果與分析

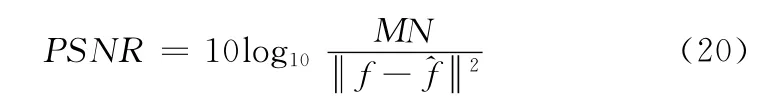

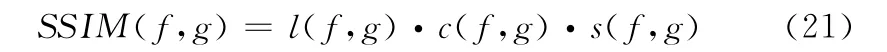

在實驗中,我們對測試圖像進行3 倍放大重建,并與Bicubic插值、文獻 [5]、文獻 [11]等方法從主觀視覺和客觀評價指標上進行對比。客觀評價指標為尖峰信噪比(peak signal to noise ratio,PSNR)和 結構相似度 (structural similarity,SSIM),其計算方法分別如下

式中:M、N——重建圖像的尺度,f——原始的高分辨率圖像,——重建后的超分辨率圖像。

式中,l(f,g)——亮度變化,c(f,g)——差異變化,s(f,g)——結構變化。其定義如式 (22)~式 (24)所示

其中,f 和g 表示兩幅圖像,μf 和μg 表示圖像的均值,σf和σg表示它們的方差,σfg表示它們的協方差。C1,C2,C3為比較小的常數,用來確保分母不等于零。

實驗測試庫圖像來源于文獻 [5]和文獻 [11],訓練庫圖像 來 源 于Berkeley Segmentation Data Set and Benchmarks 500 (BSD500),并從中選取80幅自然圖像,包括植物、動物、建筑、人類等,并隨機采取50 000對5×5圖像塊來訓練大小為512原子的字典。最近鄰個數K =5,K’=5,正則項參數λ,λ1,λ2分別為0.1,0.2,0.02。

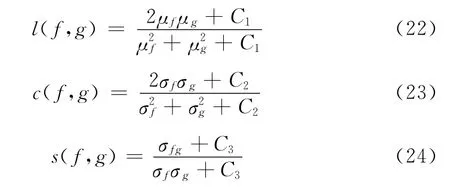

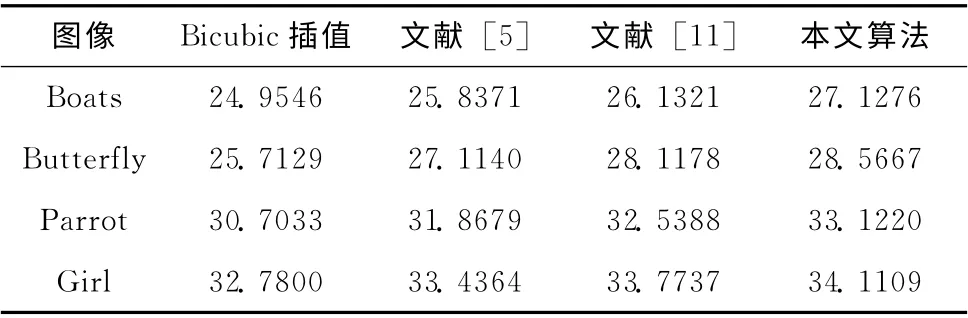

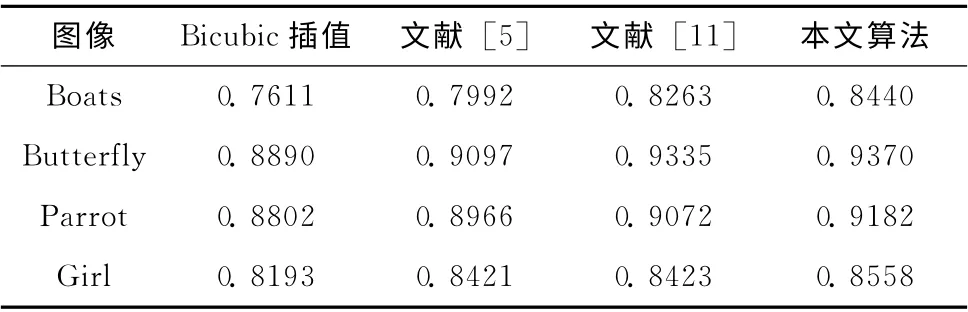

表1和表2分別列出了4幅不同圖像采用不同重建方法的PSNR 和SSIM。從表1、表2中可以看出本文提出的算法在幾種對比方法中PSNR 和SSIM 取得了最高值。

表1 不同方法重建圖像的PSNR

表2 不同方法重建圖像的SSIM

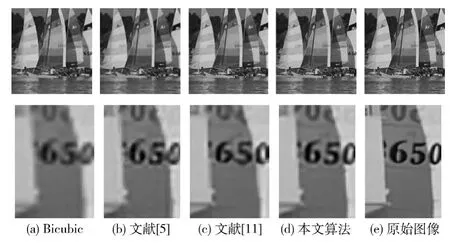

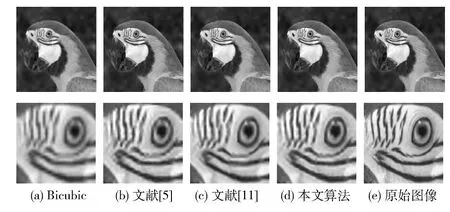

為了展示不同算法重建圖像的視覺效果,我們選取其中Boats重建結果進行對比,如圖1和圖2的局部放大圖中可以看出,本文算法相對于其它算法取得更好的視覺效果。如圖1中 “650”以及圖2中鸚鵡眼睛周圍,Bicubic插值的邊緣模糊且存在鋸齒瑕疵,文獻 [5]算法重建結構不準確,文獻 [11]算法結構較為準確但存在過渡模糊的現象,而本文算法結構準確,邊緣清晰銳化,更加接近原始圖像。

圖1 Boats重建結果及其局部放大圖

4 結束語

圖2 Parrot重建結果及其局部放大圖

本文針對傳統的稀疏表示模型進行了改進,提出了一種同時結合圖像的非局部自相似性和圖像塊之間一對一關系的稀疏表示重建方法。從主觀視覺和客觀評價兩個方面驗證了本文算法的有效性。與其它的算法相比,本文算法能夠取得更高的PSNR 和SSIM,并且與傳統的稀疏表示相比,改善了圖像的視覺效果,是重建圖像的幾何結構更加準確,紋理更加清晰銳化。

[1]Li M,Nguyen TQ.Markov random field model-based edge-directed image interpolation [J].IEEE Transactions on Image Processing,2008,17 (7):1121-1128.

[2]Zhang X J,Wu X L.Image interpolation by adaptive 2Dautoregressive modeling and soft-decision estimation [J].IEEE Transactions on Image Processing,2008,17 (6):887-896.

[3]Zhang K B,Gao X B,Tao D C,et al.Single image super-resolution with non-local means and steering kernel regression[J].IEEE Transactions on Image Processing,2012,21 (11):4544-4556.

[4]Villena S,Vega M,Babacan S D,et al.Bayesian combination of sparse and non-sparse priors in image super resolution [J].Journal of Digital Signal Processing,2013,23 (2):530-541.

[5]Yang J C,Wright J,Huang T S,et al.Image super-resolution via sparse representation [J].IEEE Transactions on Image Processing,2010,19 (11):2861-2873.

[6]Jing G D,Shi Y H,Kong D H,et al.Image super-resolution based on multi-space sparse representation [C]//The Second International Conference on Internet Multimedia Computing and Service,2010:11-14.

[7]Yang S Y,Wang M,Chen Y G,et al.Single-image superresolution reconstruction via learned geometric dictionaries and clustered sparse coding [J].IEEE Transactions on Image Processing,2012,21 (9):4016-4028.

[8]ZHANG Yao,XU Bin,ZHOU Shangbo,et al.Image superresolution with adaptive regularization sparse representation[J].Application Research of Computers,2013,30 (3):938-941 (in Chinese).[張垚,徐斌,周尚波,等.基于稀疏表示的自適應圖像超分辨率重建算法 [J].計算機應用研究,2013,30 (3):938-941.]

[9]Lu XQ,Yuan HL,Yan PK,et al.Geometry constrained sparse codingfor single image super resolution [C]//Proc of IEEE Conference on Computer Vision and Pattern Recognition,2012:1648-1655.

[10]Dong WS,Zhang L,Shi GM.Centralized sparse representation for image restoration [C]//Proc of IEEE International Conference on Computer Vision,2011:1259-1266.

[11]Dong W S,Zhang L,Lukac R,et al.Sparse representation based image interpolation with nonlocal autoregressive modeling[J].IEEE Trans Image Process,2013,22 (4):1382-1394.

[12]Zheng M,Bu J,Chen C,et al.Graph regularized sparse coding for image representation [J].IEEE Transactions on Image Processing,2011,20 (5):1327-1336.

[13]Gao SH,Tsang WH,Chia LT.Laplacian sparse coding,hypergraph Laplacian sparse coding,and applications[J].IEEE Trans Pattern Anal Mach Intell,2013,35 (1):92-104.

[14]Zheng M,Bu JJ,Chen C,et al.Graph regularized sparse coding for image representation [J].IEEE Trans Image Process,2011,20 (5):1327-1336.

[15]Setzer S,Steidl G,Teuber T.Deblurring poissonian images by split bregman techniques[J].Journal of Visual Communication and Image Representation,2010,21 (3):193-199.