基于YOLO的非合作衛星圖像分割

2024-12-06 00:00:00賈文沆

中國新技術新產品

2024年8期

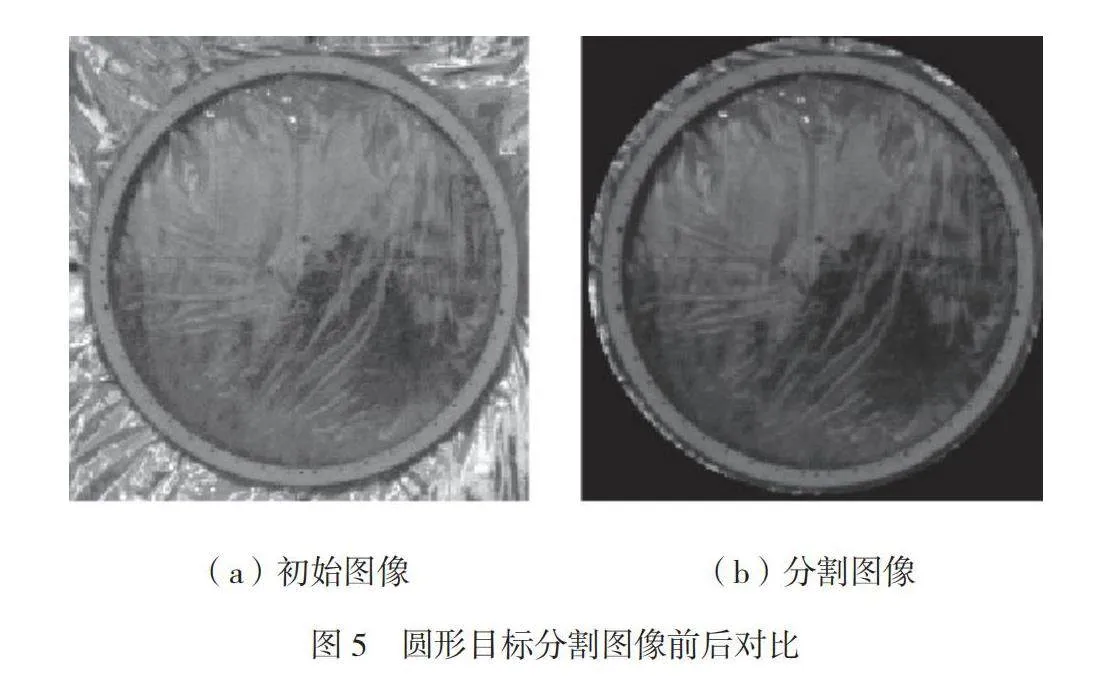

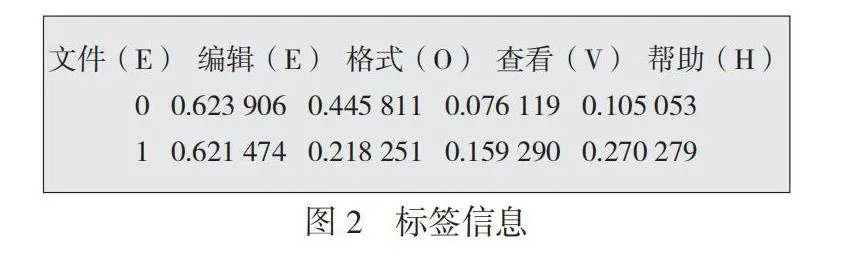

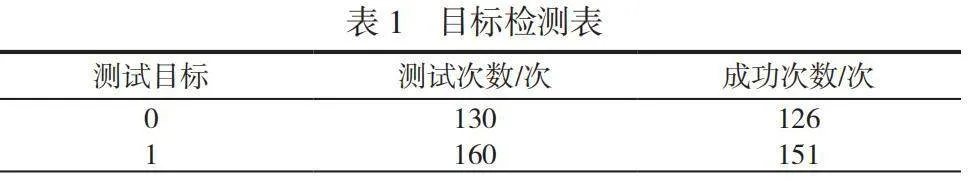

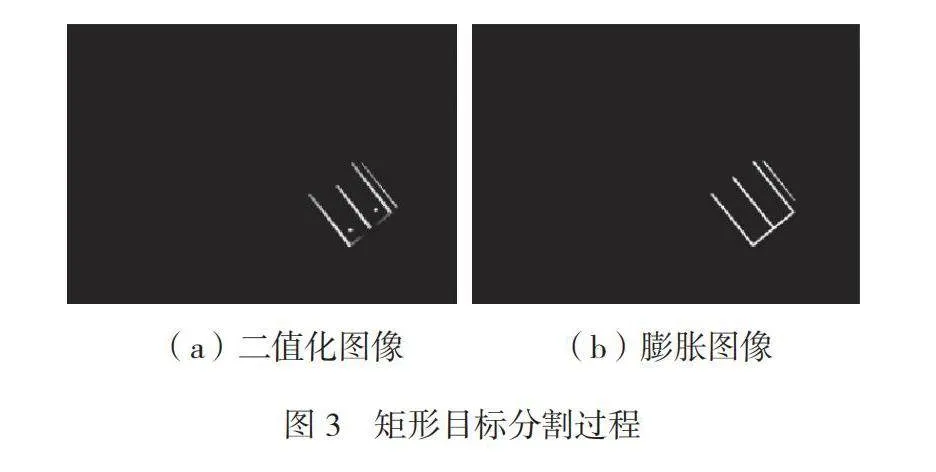

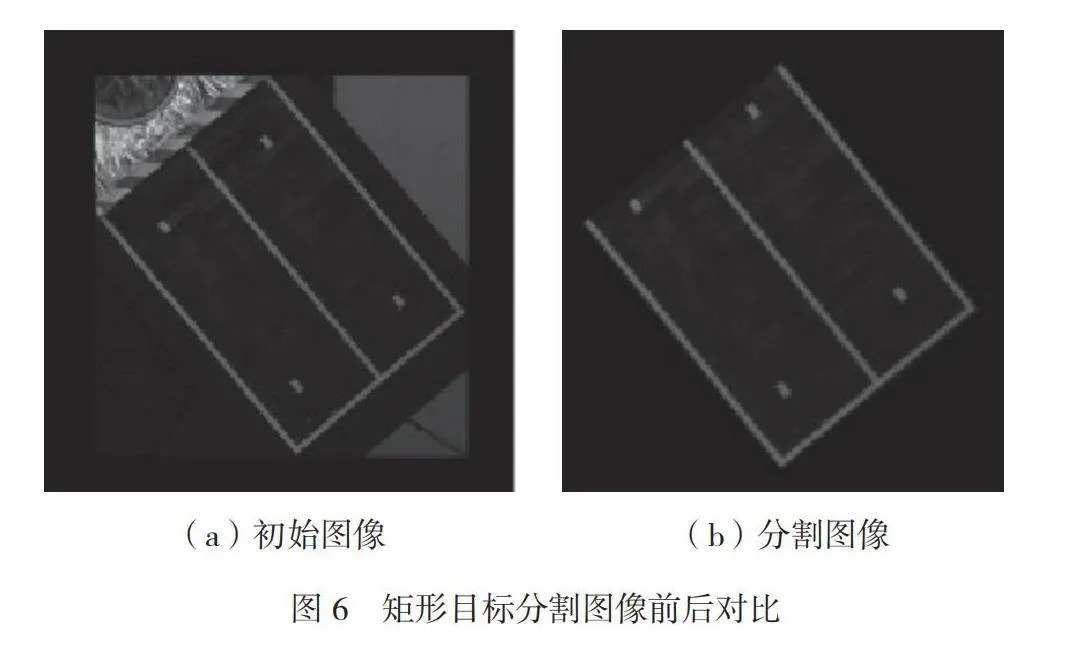

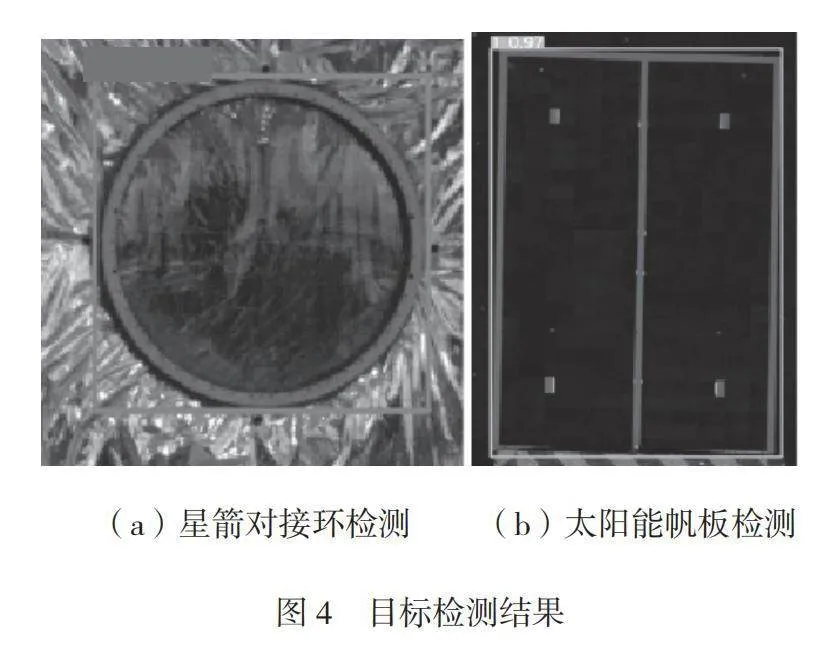

摘 要:由于空間中失效衛星數量不斷增加,因此需要通過空間對接完成燃料加注以延長壽命。因為視覺測量具有實時性和經濟性,所以廣泛應用于對接環節,但是背景干擾導致視覺測量精度下降。針對以上問題,本文以非合作衛星的星箭對接環和太陽能帆板為顯著目標,基于YOLO卷積神經網絡對其進行目標檢測,再采用圖像差分、二值化以及形態學操作等方法對2種目標進行準確分割,最后進行試驗,試驗結果表明目標檢測準確,圖像分割效果明顯,目標圖像中沒有背景干擾,本文方法具有可行性。

關鍵詞:卷積神經網絡;形態學操作;圖像分割

中圖分類號:TP 181;TP 391" " " 文獻標志碼:A

隨著人類探索太空的力度不斷增強,太空中的人造衛星數量相應增加,因為燃料耗盡,所以失效衛星也相應增多。失效衛星不僅會占用軌道資源,還會威脅其他衛星的安全。在失效衛星中有些是合作衛星,其可以提供合作信息,與之相反的是非合作衛星,難點是針對非合作衛星的視覺測量[1]。視覺測量利用光學成像得到目標的大量信息,例如大小、姿態等[2],但是計算機不能像人類一樣有強大的識別能力[3]。張澤[4]采用中值濾波、Canny邊緣檢測等方法檢測輪廓,最終的尺寸測量絕對誤差在0.26 mm以內;He[5]提出將開運算和閉運算的結果相減來提取特征的邊緣信息。與傳統方法相比,這些方法效果更加明顯[6]。隨著人工智能的發展,一些學者將機器學習引入視覺測量中,以提高自動提取目標特征的精度,加快速度[7]。……

登錄APP查看全文