基于三維空間的多行人重識別方法

摘要:為了解決監控中的遮擋問題和提高人群監控的準確性,該文提出了基于三維空間的多行人重識別方法,結果表明,該方面可以大幅提高監控系統的覆蓋范圍和人群監控系統在復雜環境下的識別與跟蹤準確性,有效支持密集人群環境下的安全監控需求。

關鍵詞:三維空間;行人重識別;人群監控

doi:10.3969/J.ISSN.1672-7274.2024.07.021

中圖分類號:TP 3 文獻標志碼:A 文章編碼:1672-7274(2024)07-00-03

Multi-pedestrian Rerecognition Method Based on Three-dimensional Space

SUN Yiyang

(Hubei University. Wuhan 430062, China)

Abstract: In order to solve the occlusion problem and improve the accuracy of crowd monitoring, a multi-pedestrian rerecognition method based on three-dimensional space is proposed. The research results show that the coverage of the monitoring system and the identification and tracking accuracy of the crowd monitoring system in complex environments can be greatly improved, and the security monitoring requirements in dense crowd environments can be effectively supported.

Keywords: three-dimensional space; pedestrian rerecognition; crowd monitoring

1 研究背景

當前,目標識別、目標跟蹤等技術已廣泛應用于視頻監控領域。然而,現有視頻監控系統中,監控端攝像頭等設備存在容易被遮擋、遠距離成像效果較差等問題[1-3]。由于攝像頭取景范圍有限,造成難以完整地檢測到行人的面部特征、手足運動軌跡,從而無法達到實時監控的效果。另外,單一維度的攝像頭無法獲取行人在多個方向的運動軌跡。在行人面向鏡頭行走時,無法獲取行人坐標位置。因此,本文提出一種基于三維空間的多行人重識別方法,以解決以上問題。

2 研究方法

行人重識別是指在視頻監控系統中,通過分析行人的外觀特征或行為特征,實現在不同場景、不同攝像頭下對同一行人的再次識別。多行人重識別方法包括如下步驟:

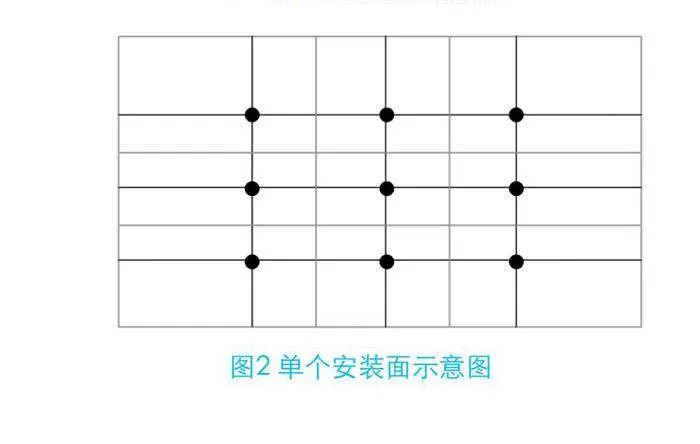

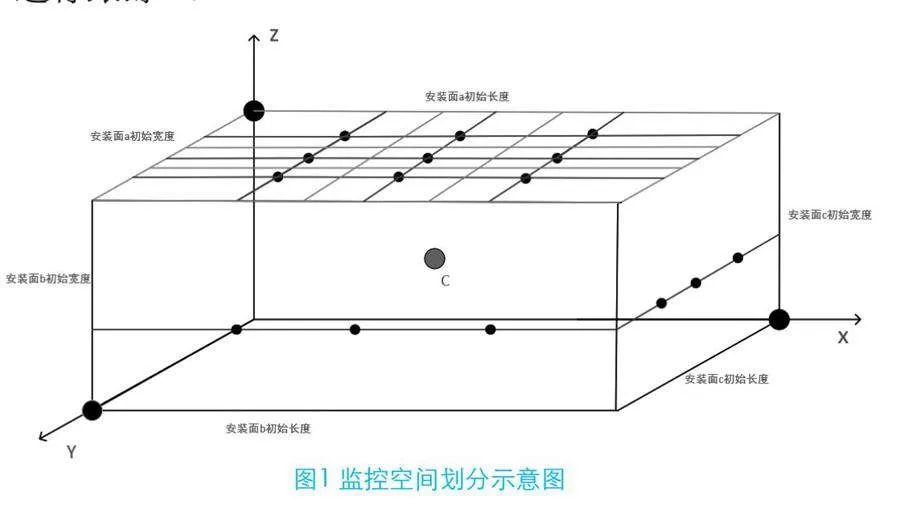

步驟1,將監控區域劃分為存在多個可安裝平面的立體監控空間(見圖1);基于立體監控空間的各個可安裝平面布設分布式監控裝置(見圖2)。

步驟2,利用布設的分布式監控裝置獲取當前監控目標區域的實時監控圖像,利用神經網絡模型判斷采集的實時監控圖像中是否存在行人[4]。

步驟3,當監控圖像中存在行人時,則采用基于鄰域判定的跟蹤拍攝方法控制分布式監控裝置對行人進行跟蹤[5]。

識別行人軌跡方法如下:

①布置攝像頭時將其按相同間距排列,對于安裝面a,定義其長度為Lc,寬度為Lk;安裝面a存在x×y個分攝像頭,分攝像頭兩個方向上的間距分別為Lc/x、Lk/y;對于安裝面b、c,以安裝面b為例,定義其長度為L,在安裝面b上安置n個分攝像頭,則每個分攝像頭之間間距L/n;共設置n個安裝面a,攝像頭平行于地面安裝,每個安裝面上均安裝攝像頭。

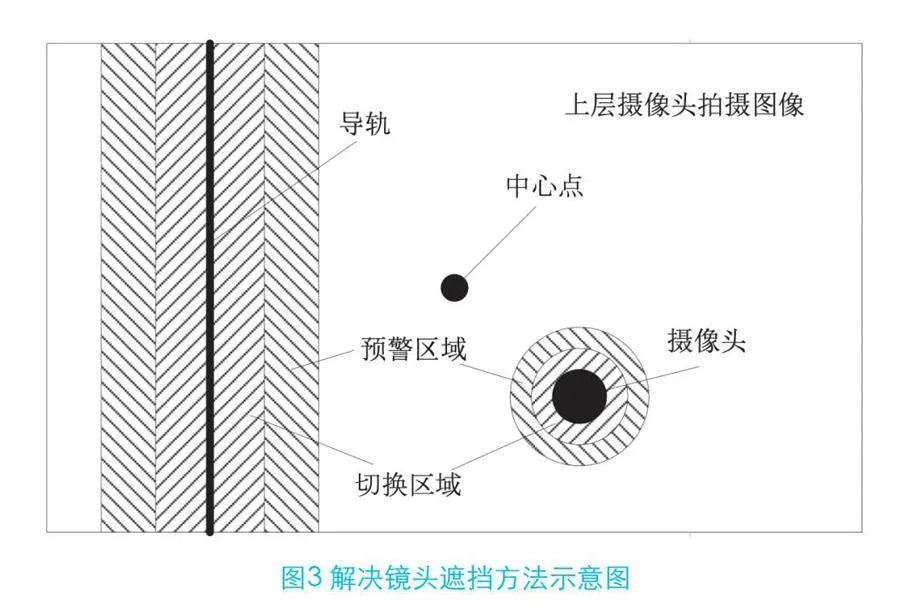

②設置預警區域,取導軌兩側距離為dy1的矩形區域,與中心點距離近的一側為近側,與中心點距離遠的一側為遠側;以攝像頭背面中心,取半徑為dy2的圓形區域。設置切換區域,取導軌兩側距離為dq1的矩形區域,與中心點距離近的一側為近側,與中心點距離遠的一側為遠側;以攝像頭背面中心,取半徑為dq2的圓形區域。

③當中心點進入預警區域,系統對中心點相對于導軌或者攝像頭的運動軌跡(從進入預警區域到進入切換區域的運動過程中,圖像采集到的一系列位置坐標形成運動軌跡[6-7],每隔t秒進行軌跡點采樣,t可取0.1)進行擬合,每隔t秒可以得到一段運動軌跡,可采用最小二乘法對圖像的x、y坐標進行線性擬合,形成預判運動趨勢方向的方向線段y=ax+b,x、y分別為圖像的橫縱坐標。根據視頻每幀時間(1/24 s)以及幀數(圖像數)p,可以推算出運動速度v=L/(1/24×(p-1)),其中,L為每隔t秒運動軌跡的起始位置的直線距離。將平面沿半徑方向平均劃分為m個扇形區域,對應了m個方向。設置計數器,計數器包括m個值,對應m個扇形區域的計數值。每隔t秒進行一次計數器更新,當方向線段所指的方向位于第i(i=1,…,m)個扇形區域間時,第i個計數器值為v×k+c,其中,k為速度比例系數,c、k均為經驗值。

當下層安裝面a的導軌或者攝像頭(背面)遮擋住上層安裝面a的攝像頭視野時,避免遮擋的方法:首先采用深度學習神經網絡方式對攝像頭獲得的圖像進行識別[8],并對已有的導軌或者攝像頭背面的數據集進行訓練,然后對實時圖像中的導軌或者攝像頭進行識別,獲取下層導軌或者下層攝像頭在圖像中的位置,從而獲取當前攝像頭與下層導軌或攝像頭的對應位置關系。如圖3所示。

對于導軌,中心點進入切換區域時,最后一段方向線段的重合直線與切換區域相交于兩點,分別位于近側、遠側。上層安裝面的攝像頭當前位于近側交點,移動攝像頭至遠側的位置。對于攝像頭,中心點進入切換區域相交時,最后一段方向線段的重合直線與切換區域相交于兩點,分別位于近側、遠側,上層安裝面的攝像頭當前位于近側交點,移動攝像頭至遠側的位置;最后一段方向線段的重合直線與切換區域相切時,不進行切換。

當中心點與切換區域邊界相交時,攝像頭移動至遠側位置的方法。

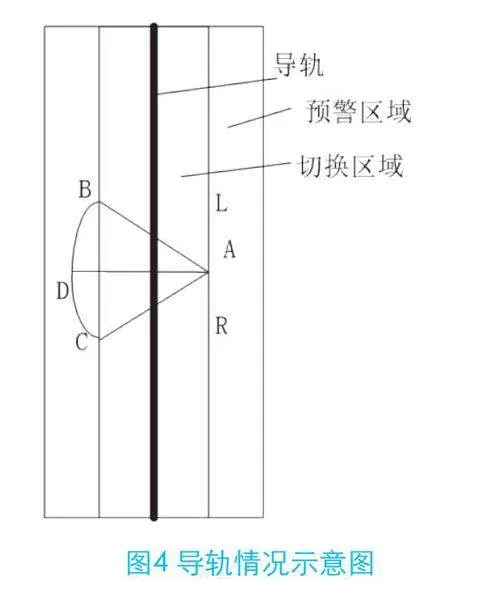

(1)對于導軌情況,設相交點為A。設置扇形區域,扇形區域圓心為A,將A與導軌的垂線設為扇形的對稱中心,扇形角度可取經驗值α。扇形與遠側交點為B、C,A與導軌的垂線與弧線BC交點為D。近側邊界以A為界,兩側分別取L、R兩個點,形成角BAL和角CAR,如圖4所示。

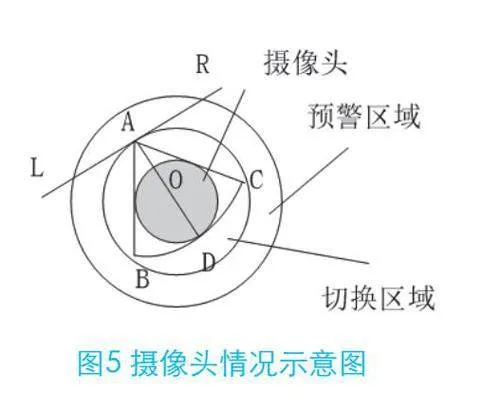

(2)對于攝像頭情況,設相交點為A。設置扇形區域,扇形區域圓心為A,將A與攝像頭中心點O的線段設為扇形的對稱中心,扇形角度可取經驗值β。將線段AO沿AO方向延長攝像頭圓形的半徑r至攝像頭與扇形的切點D,扇形弧線的兩個終點為B、C。以A為交點取AD的垂線LR,形成角BAL和角CAR,如圖5所示。

(3)當角BAC屬于m個扇形區域方向中第p,p+1,...,q個區域時(p≤q≤m),則取計數器中第p,p+1,...,q個計數值的和為sum1。當角BAL屬于m個扇形區域方向中第p,p+1,...,q個區域時(p≤q≤m),則取計數器中第p,p+1,...,q個計數值的和為sum2。當角CAR屬于m個扇形區域方向中第p,p+1,...,q個區域時(p≤q≤m),則取計數器中第p,p+1,...,q個計數值的和為sum3。不含角BAC、角BAL、角CAR,當角LAR屬于m個扇形區域方向中第p,p+1,...,q個區域時(p≤q≤m),則取計數器中第p,p+1,...,q個計數值的和為sum4。

取sum1、sum2、sum3、sum4中最大值summax:summax等于sum1時,移動攝像頭,直到中心點位于D為止;summax等于sum2時,移動攝像頭,直到中心點位于B為止;summax等于sum3時,移動攝像頭,直到中心點位于C為止;summax等于sum4時,攝像頭保持不動。

在具有多個安裝面ai(i=1,…,n)情況下,當中心點與切換區域邊界相交時,完成前述預防遮擋的算法,如果summax等于sum1、sum2、sum3,則進行區域重疊測試[9]。如果距離最近的攝像頭無區域重疊,則改用該攝像頭進行重識別;如果所有攝像頭都處于區域重疊狀態,則系統發出警告提示。

3 研究結果

(1)本研究提出了一種基于三維空間的行人重識別方法,對于被監控區域,將其抽象為存在多個可安裝平面的立體空間;通過多組攝像設備,分別將其布置在被監控區域內的多個安裝平面,通過配套的固定支架和活動導軌,實現攝像設備可活動的目的;可根據目標監控區域人群活動情況進行動態調整攝像頭分布情況,達到分布式攝像監控和預警的目的。

(2)本研究通過在垂直于地面方向安裝多個可安裝平面,每個安裝平面可獨立識別一個行人的運動軌跡,從而能夠重識別多個行人。同時,對于判定為重識別目標的行人(如重點監控對象),引入基于鄰域判定的跟蹤拍攝方法,對目標行人進行跟蹤拍攝,通過提前關注潛在危險人員達到危險預防的目的。

(3)本研究能夠彌補現有技術存在監控端攝像頭等設備攝像過程中容易被遮擋、遠距離成像效果較差等問題,能夠對重點關注人員進行不間斷的、高質量的視頻監控,為社會治安管理提供了有效支持。

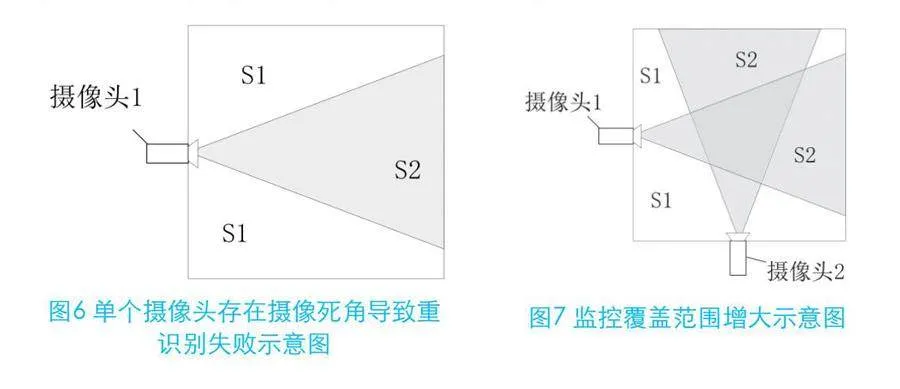

如圖6所示,單個攝像頭攝像范圍為S2,未覆蓋范圍S1,造成攝像死角,導致重識別失敗。在增加了攝像頭2后,監控覆蓋范圍S2增大。如圖7所示。

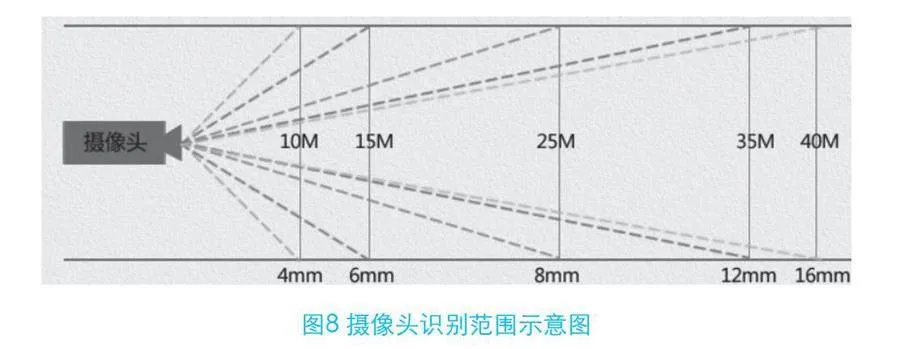

8 mm焦距攝像頭為典型焦距值,為拍攝更清晰畫面,往往采用更小焦距,同時監控距離變小影響監控效果,8 mm焦距攝像頭角度在30°~40°。以10 m×10 m場地為例,設置8 mm焦距攝像頭,常見的攝像頭角度為40°,在場地兩側安裝攝像頭如圖8所示,大幅提升了監控范圍。

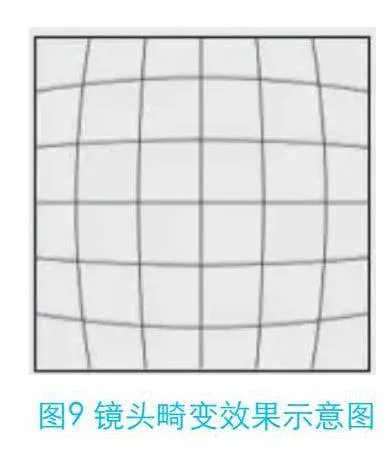

為提高攝像質量,需要擴大攝像角度,盡可能減小焦距。而已有的攝像頭在較近距離攝像時會產生桶形畸變,尤其是廣角攝像頭,如圖9所示。

在此情況下,距離攝像中心點越遠,畸變越明顯。因此,需要盡可能將攝像頭攝像中心靠近被攝像物體,這樣可以減小畸變,更精確確定行人位置坐標。行人運動速度約為1.2 m/s,使用導軌能將攝像頭以最高至3 m/s以上速度移動到行人上方位置,并跟隨行人移動。如果在人高速奔跑的情況下,還可以通過更多的安裝面a上的攝像頭輔助捕捉人員信息,避免單一攝像頭攝像范圍有限且固定,而無法捕捉到人員圖像。

參考文獻

[1] 宋婉茹,趙晴晴,陳昌紅,等.行人重識別研究綜述.智能系統學報,2017,12(6):770-780.

[2] 李擎,胡偉陽,李江昀,劉艷,李夢璇.基于深度學習的行人重識別方法綜述[J].工程科學學報,2022,44(5):920-932.

[3] 劉莎,黨建武,王松,等.結合一階和二階空間信息的行人重識別[J].激光與光電學進展,2021,58(2):299-307.

[4] 羅浩,姜偉,范星,等.基于深度學習的行人重識別研究進展[J].自動化學報,2019,45(11):2032-2049.

[5] 趙元龍,單玉剛,袁杰.改進YOLOv7與DeepSORT的佩戴口罩行人跟蹤[J].計算機工程與應用,2023,59(6):221-230.

[6] 孔瑋,劉云,李輝,等.基于深度學習的行人軌跡預測方法綜述[J].控制與決策,2021,36(12):2841-2850.

[7] 李琳輝,周彬,任威威,等.行人軌跡預測方法綜述[J].智能科學與技術學報,2021,3(4):399-411.

[8] Girshick R. Fast r-cnn[C]//Proceedings of the IEEE international conference on computer vision. 2015: 1440-1448.

[9] 盧小平,盧遙,焦金龍,等.基于重疊區域相關系數的視頻影像關鍵幀提取算法[J].武漢大學學報(信息科學版),2019,44(2):260-267.