基于SAR 目標(biāo)識別的深度學(xué)習(xí)方法*

郝 巖,白艷萍,張校非

(1.中北大學(xué)信息與通信工程學(xué)院,太原 030051;2.中北大學(xué)理學(xué)院,太原 030051)

0 引言

合成孔徑雷達(dá)(SAR)以其自身的獨(dú)特優(yōu)勢而被廣泛應(yīng)用于軍事和民用領(lǐng)域。目前,SAR 目標(biāo)識別技術(shù)主要包括基于支持向量機(jī)的目標(biāo)識別技術(shù)[1];基于模板的目標(biāo)識別技術(shù)[2]以及基于神經(jīng)網(wǎng)絡(luò)的目標(biāo)識別技術(shù)[3-6]。其中基于神經(jīng)網(wǎng)絡(luò)的目標(biāo)識別技術(shù)應(yīng)用最為廣泛,尤其是BP 神經(jīng)網(wǎng)絡(luò)。但BP 反向傳播過程中,局部梯度下降對權(quán)值進(jìn)行調(diào)整容易出現(xiàn)梯度彌散,導(dǎo)致局部最優(yōu)問題。而且,隨著網(wǎng)絡(luò)層數(shù)的增多,這種情況會越來越嚴(yán)重。這一問題的產(chǎn)生嚴(yán)重制約了神經(jīng)網(wǎng)絡(luò)的發(fā)展。

2006 年,Hinton 提出對深度學(xué)習(xí)方法以及模型訓(xùn)練方法的改進(jìn)打破了BP 神經(jīng)網(wǎng)絡(luò)發(fā)展的瓶頸,由此引發(fā)了新一輪的深度學(xué)習(xí)浪潮。深度學(xué)習(xí)方法主要包括3 類[7]:1)生成模型:常見的生成模型包括,RBM(受限玻爾茲曼機(jī))、AE(自編碼)及其各種變型。2)判別模型:CNN(卷積神經(jīng)網(wǎng)絡(luò))是一種良好的判別模型,成功應(yīng)用于多類圖像的分類研究中,也是一種非常成熟的深度學(xué)習(xí)方法。3)混合模型:即包含了生成和判別兩部分結(jié)構(gòu)的模型,例如DBN(深度信念網(wǎng)絡(luò))或SAE(棧式自編碼)預(yù)訓(xùn)練后的DNN(深度神經(jīng)網(wǎng)絡(luò))。本文主要研究DBN 以及SDAE(棧式降噪自編碼)無監(jiān)督預(yù)訓(xùn)練,BP 神經(jīng)網(wǎng)絡(luò)“微調(diào)”的兩種混合模型。

目前,大多數(shù)人選用的DBN 或SDAE 都具有兩個或兩個以上隱含層,但隨著隱含層和神經(jīng)元數(shù)量的增多,計算復(fù)雜度自然會增大,訓(xùn)練耗時較長。另外,雖然兩種深度學(xué)習(xí)方法都可以自動提取圖像的高級特征,但SDAE 是非線性變換找到主特征方向,而DBN 是基于樣本的概率分布來提取高層表示,所提取的特征具有很大差異,依然存在特征利用不充分從而造成識別效果較差的問題。本文針對這兩個問題,提出了一種雙通道單隱含層的DBN-SDAE 模型,通過DBN 和SDAE 分別學(xué)習(xí)數(shù)據(jù)的深層特征,然后采用加權(quán)融合法融合二者所學(xué)習(xí)的權(quán)重,用以初始化NN 的權(quán)值。該模型不僅可以降低計算的時間復(fù)雜度,還可以得到相當(dāng)可觀的識別準(zhǔn)確率。

1 算法原理

1.1 深度信念網(wǎng)絡(luò)(DBN)

深度信念網(wǎng)絡(luò)是一種混合模型,包括無監(jiān)督的預(yù)訓(xùn)練和“微調(diào)”兩部分。一個DBN 被視為由若干個RBM 堆疊在一起,訓(xùn)練時可通過由低到高逐層訓(xùn)練這些RBM 來實(shí)現(xiàn)。

RBM(受限玻爾茲曼機(jī))由可見層和隱含層構(gòu)成,層內(nèi)無連接,層間全連接。其目標(biāo)是盡可能使可見層分布逼近樣本空間的分布,換句話說就是使得訓(xùn)練樣本在該模型中的觀測概率最大,這個目標(biāo)可以通過最小化KL 距離[8]實(shí)現(xiàn),詳細(xì)過程見文獻(xiàn)[9-10]。

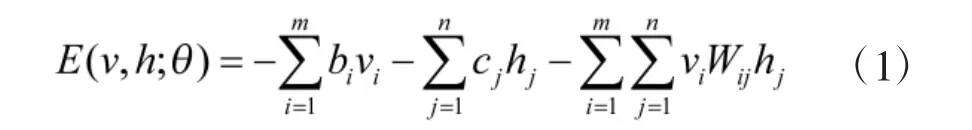

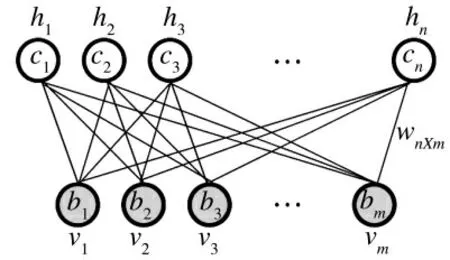

對于一個RBM 模型,如圖1 所示,由于RBM是一個隨機(jī)網(wǎng)絡(luò),無法確定該模型的分布函數(shù),因此,通過能量模型來得到模型的分布,其能量模型定義為

圖1 RBM 結(jié)構(gòu)圖

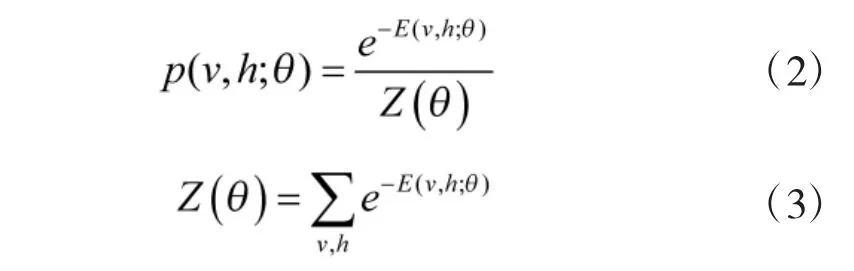

其中,v 和h 分別表示可見層和隱含層,vi表示第i個可見單元,hj表示第j 個隱藏單元,bi和cj分別表示vi和hj的偏移量,Wij為vi和hj之間的權(quán)重。θ={Wij,bi,cj}為RBM 模型的參數(shù)。則基于上述能量模型可得到相應(yīng)的聯(lián)合概率分布:

Z(θ)為歸一化因子,也稱為配分函數(shù)。

在實(shí)際應(yīng)用中,如何確定由RBM 模型所定義的觀測數(shù)據(jù)的分布是關(guān)鍵問題,因此,需要計算v 的邊際概率:

由此,可以通過最大化p(v;θ)在訓(xùn)練集上的對數(shù)似然來獲得θ。通過CD[11](對比散度)快速學(xué)習(xí)方法得到最終的W,b,c。

其過程如下:

可見層:v:v1=x,x 為訓(xùn)練樣本;

1.2 棧式降噪自編碼

棧式降噪自編碼是指由降噪自編碼(DAE)[12]堆疊而成的深層神經(jīng)網(wǎng)絡(luò),DAE 與自編碼器(AE)的不同之處是在原始數(shù)據(jù)上加入噪聲,然后將含噪聲的數(shù)據(jù)作為網(wǎng)絡(luò)的輸入數(shù)據(jù),來重構(gòu)輸出原始還未加入噪聲的數(shù)據(jù)。下面簡單介紹一下AE。

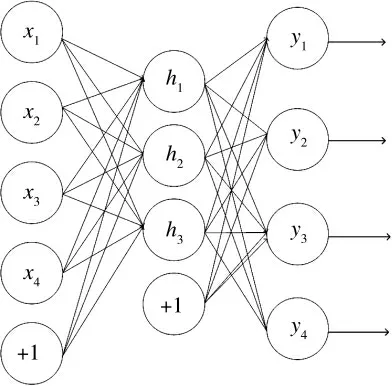

圖2 是自編碼器的結(jié)構(gòu)示意圖,圖中,x1,x2,x3,x4表示網(wǎng)絡(luò)的輸入單元,h1,h2,h3表示網(wǎng)絡(luò)的隱藏單元,y1,y2,y3,y4表示x1,x2,x3,x4的重構(gòu),+1 表示偏置項(xiàng)。

圖2 自編碼器的結(jié)構(gòu)示意圖

自編碼神經(jīng)網(wǎng)絡(luò)主要可以分為兩個過程,編碼和解碼。其基本思想是將輸入樣本壓縮到隱藏層,再在輸出端重建樣本。

具體過程如下:

W1是輸入層與隱含層之間的權(quán)重,W2是隱含層與重構(gòu)單元之間的權(quán)重,b1,b2分別是輸入層和隱含層的偏置。另外,SDAE 的訓(xùn)練過程與DBN 的訓(xùn)練過程相似,均采用貪婪學(xué)習(xí)法,這里不再敘述。

2 DBN-SDAE 簡介

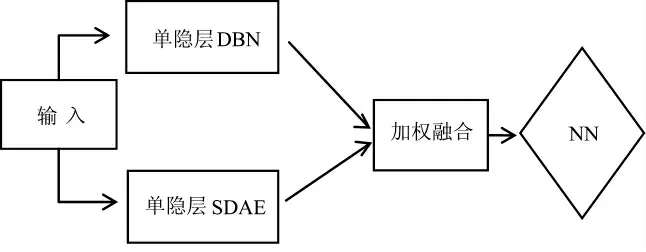

對于傳統(tǒng)的深度學(xué)習(xí)方法,隱含層和神經(jīng)元越多,自動學(xué)習(xí)到的高階特征越多,通常情況下,第1個隱含層學(xué)習(xí)輸入數(shù)據(jù)的一階特征,而第2 個隱含層會學(xué)習(xí)到二階特征,如輪廓或角點(diǎn),其他的隱含層則會學(xué)習(xí)更加復(fù)雜的高階特征。但隨著隱含層和神經(jīng)元數(shù)量的增多,網(wǎng)絡(luò)的計算復(fù)雜度會呈指數(shù)增長,耗時更長。同時由于DBN 和SDAE 算法的差異,各自學(xué)習(xí)的特征也有所差異,往往會出現(xiàn)特征利用不充分的情況。為了避免上述問題,本文提出一種雙通道單隱含層的深度學(xué)習(xí)方法,并采用加權(quán)融合的方法進(jìn)行特征融合。為了得到更好的識別效果,本文采用BP 神經(jīng)網(wǎng)絡(luò)進(jìn)行微調(diào)。其結(jié)構(gòu)如圖3 所示。

算法步驟如下:

1)對數(shù)據(jù)進(jìn)行預(yù)處理,并將處理好的數(shù)據(jù)分為訓(xùn)練樣本和測試樣本;

2)將訓(xùn)練樣本分別輸入單隱層的DBN 和SDAE,通過自動學(xué)習(xí)得到各自學(xué)習(xí)后的權(quán)重;

圖3 DBN-SDAE 模型示意圖

3)對權(quán)重進(jìn)行加權(quán)融合,并用融合后的權(quán)重初始化NN 的權(quán)重;

4)將訓(xùn)練樣本和測試樣本輸入NN,通過BP進(jìn)行“微調(diào)”,最終分類。

對DBN 和SDAE 學(xué)習(xí)的權(quán)重加權(quán)公式定義如下:

其中,Wd為DBN 學(xué)習(xí)得到的權(quán)重,Ws為SDAE 學(xué)習(xí)得到的權(quán)重,Wds為二者加權(quán)后得到的權(quán)重。a,b分別為二者的加權(quán)系數(shù),且a,b∈[0,1],a+b=1。選擇加權(quán)系數(shù)時,首先確定最優(yōu)系數(shù)的范圍,然后對系數(shù)進(jìn)行細(xì)化,具體見實(shí)驗(yàn)部分。

3 實(shí)驗(yàn)及結(jié)果分析

3.1 數(shù)據(jù)預(yù)處理

本文的實(shí)驗(yàn)數(shù)據(jù)選自MSTAR 的公開數(shù)據(jù)集,選取BMP2(裝甲車),BTR70(裝甲車)以及T72(主戰(zhàn)坦克)作為目標(biāo)。實(shí)驗(yàn)分別選取SN_C21,SN_C71和SN_132 俯仰角下的圖像作為訓(xùn)練樣本,共698個,15°俯仰角下的圖像作為測試樣本,共588 個。數(shù)據(jù)庫中的SAR 圖像分辨率為0.3 m×0.3 m,目標(biāo)圖像大小為128×128 像素。由于這些圖像的目標(biāo)均集中于圖像的中間部分,因此,本文首先將圖像中心部分剪裁為64×64 的圖像。同時為了減小噪聲對目標(biāo)識別的影響,本文采用Gaussian 去噪法對圖像進(jìn)行去噪處理。處理過程見圖4。將處理過的圖像張成列向量,則訓(xùn)練樣本為4 096×698,測試樣本為4 096×588。

圖4 圖像預(yù)處理過程

3.2 網(wǎng)絡(luò)參數(shù)設(shè)置

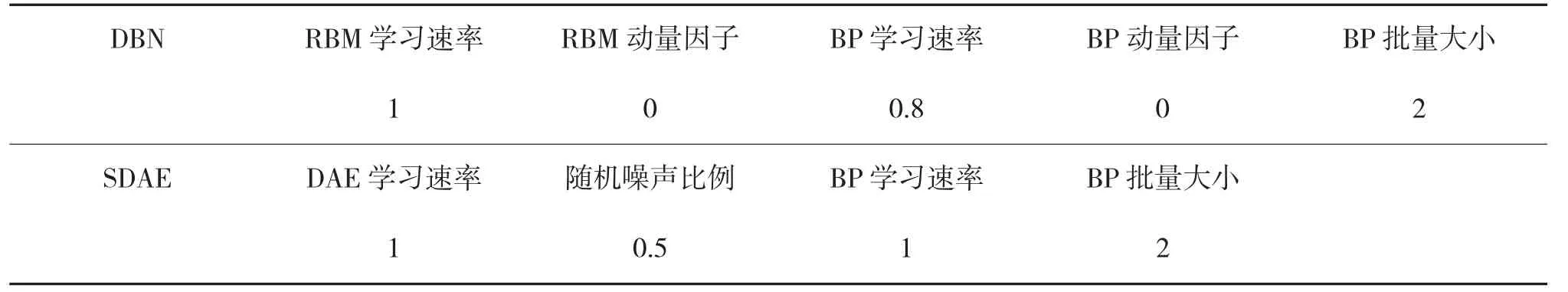

為了保證與下文實(shí)驗(yàn)的一致性,DBN 和SDAE均采用批量訓(xùn)練的方法,且只有一個隱含層。

在DBN 網(wǎng)絡(luò)中,可見單元的數(shù)量為4 096,隱藏單元的數(shù)量為100,訓(xùn)練次數(shù)設(shè)置為50,批量大小為2,相應(yīng)的BP 神經(jīng)網(wǎng)絡(luò)的結(jié)構(gòu)為4 096-100-3,訓(xùn)練次數(shù)為1 500。

在SDAE 網(wǎng)絡(luò)中,輸入層和隱含層單元數(shù)量分別為4 096,100,訓(xùn)練次數(shù)為100,批量大小為2,相應(yīng)的BP 神經(jīng)網(wǎng)絡(luò)的結(jié)構(gòu)為4 096-100-3,訓(xùn)練次數(shù)為100。兩個網(wǎng)絡(luò)的其他相關(guān)參數(shù)見表1。

表1 DBN 與SDAE 其他參數(shù)設(shè)置

3.3 實(shí)驗(yàn)

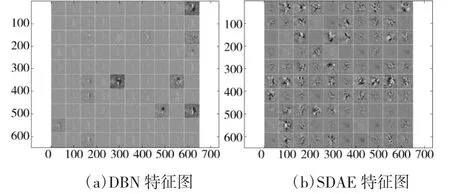

圖5 網(wǎng)絡(luò)對應(yīng)的特征圖

從圖5 中可以明顯看出,DBN 所學(xué)習(xí)到的特征細(xì)節(jié)信息較多,結(jié)構(gòu)信息不明顯,而SDAE 學(xué)習(xí)到的特征既包含了細(xì)節(jié)信息又包含了結(jié)構(gòu)信息,且結(jié)構(gòu)信息較多。因此,SDAE 比DBN 獲得了更好的識別效果。

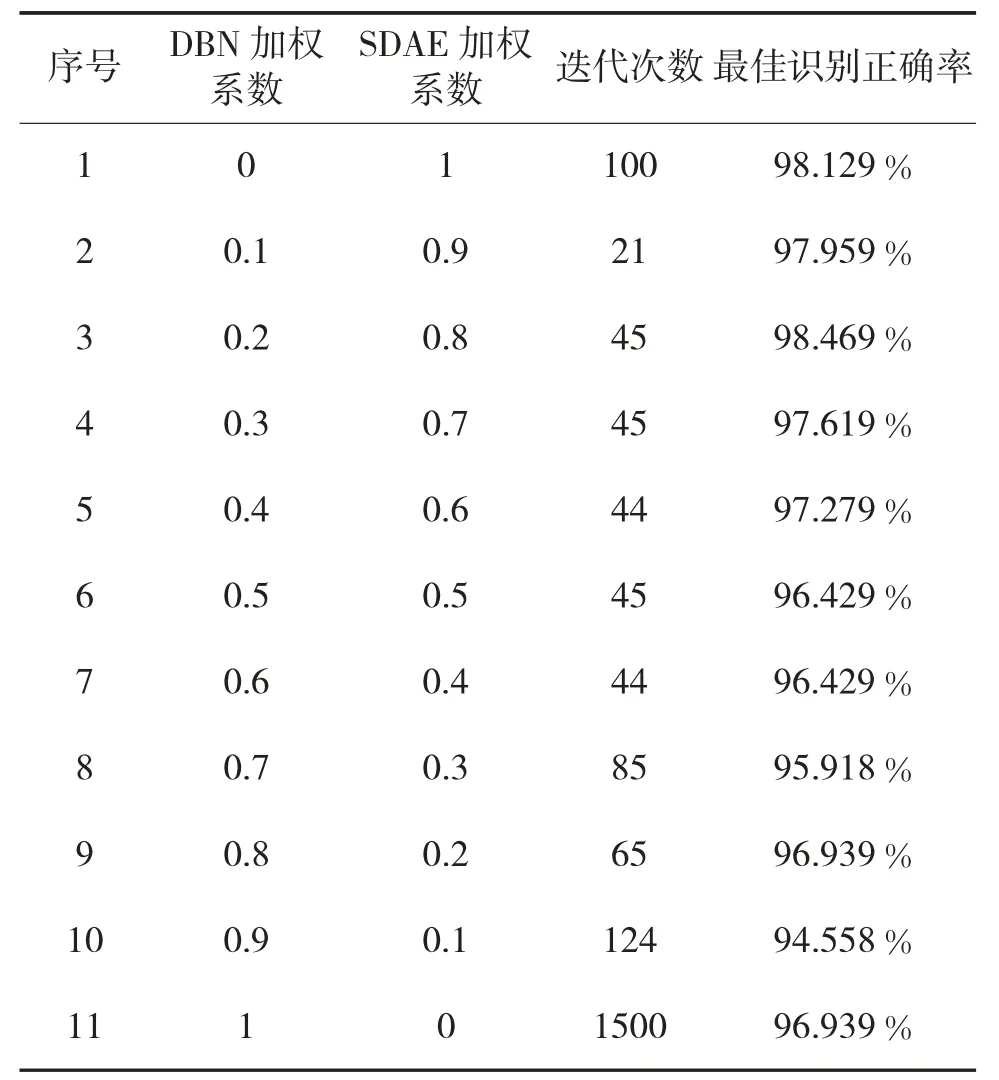

通過上述實(shí)驗(yàn)可以發(fā)現(xiàn),DBN 可以提取更多的細(xì)節(jié)信息,而SDAE 則能提取到結(jié)構(gòu)信息。因此,本文選擇將兩種方法學(xué)習(xí)的特征進(jìn)行加權(quán)融合。同時為了降低時間復(fù)雜度,DBN 和SDAE 均采用單隱含層,通過對DBN 和SAE 學(xué)習(xí)的權(quán)重進(jìn)行加權(quán)融合,進(jìn)而初始化NN 神經(jīng)網(wǎng)絡(luò)的權(quán)值。表2 是加權(quán)平均的系數(shù)及最佳識別效果。

從表2 可以看出,隨著DBN 權(quán)重所占比重的增大,除了序號為3 和9 的兩組實(shí)驗(yàn),識別準(zhǔn)確率基本上呈逐漸降低的趨勢。且DBN 權(quán)重比例超過0.5后,其識別準(zhǔn)確率低于DBN 的識別準(zhǔn)確率。另外,達(dá)到最佳識別準(zhǔn)確率的迭代次數(shù)均維持在0~130 之間(不包括序號為1 和11 的兩組實(shí)驗(yàn)),但隨著DBN 權(quán)重所占比例的增大,達(dá)到最佳識別準(zhǔn)確率的迭代次數(shù)也有所增加,但相比于單一的單隱含層DBN,迭代次數(shù)大大減少。從表2 還可以看出,當(dāng)SDAE 的系數(shù)為0.8 時,最佳識別準(zhǔn)確率最高,可達(dá)到98.469%,高于單隱含層的DBN 和SDAE。

表2 加權(quán)系數(shù)及最佳識別準(zhǔn)確率

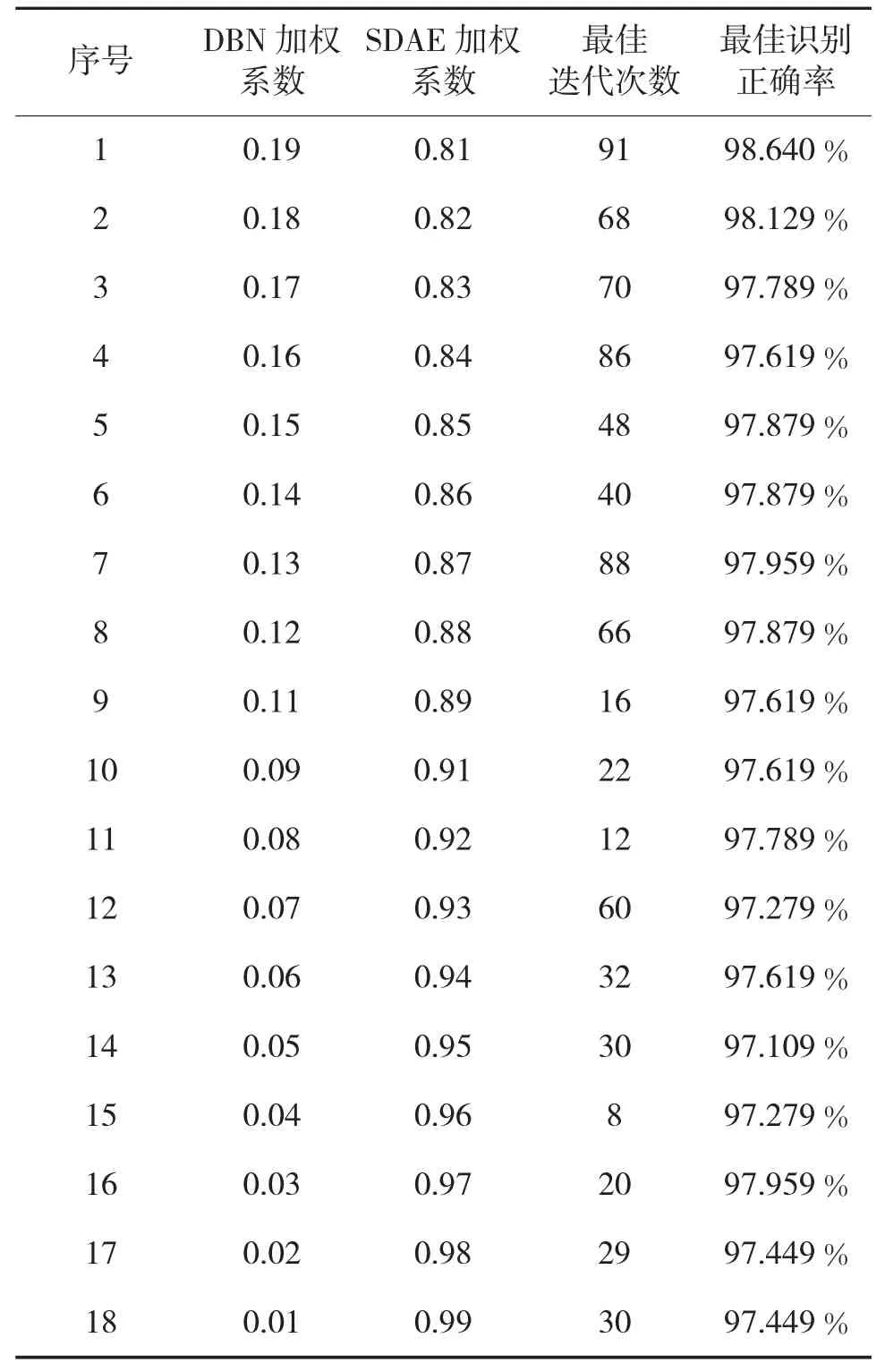

為了進(jìn)一步體現(xiàn)最優(yōu)的加權(quán)系數(shù),根據(jù)表2 的結(jié)果,SDAE 的最優(yōu)系數(shù)應(yīng)處于0.8~1 之間。下頁表3 是細(xì)化后的加權(quán)系數(shù)及最佳識別準(zhǔn)確率。

對于細(xì)化后的結(jié)果進(jìn)行分析發(fā)現(xiàn),SDAE 加權(quán)系數(shù)在0.8~1 之間的識別準(zhǔn)確率均在97 %以上,且當(dāng)SDAE 系數(shù)為0.81,DBN 系數(shù)為0.19 時識別準(zhǔn)確率最高,可達(dá)到98.640%,較單隱含層的SDAE 和DBN 分別高出0.511%及1.701%,充分證明了本文所提方法的有效性。

4 結(jié)論

本文針對SAR 目標(biāo)識別問題,研究了DBN 及SDAE 兩種深度學(xué)習(xí)模型。并針對傳統(tǒng)的深度學(xué)習(xí)存在的問題:1)隨著隱含層數(shù)和神經(jīng)元數(shù)量的增加,計算復(fù)雜度呈指數(shù)增長;2)深度學(xué)習(xí)方法雖然可以提取圖像的高階特征,但依然存在特征利用不充分的問題;提出了一種雙通道單隱含層的模型DBN-SDAE。該模型不僅解決了上述兩個問題,還實(shí)現(xiàn)了較可觀的識別準(zhǔn)確率,最高可達(dá)到98.640%,且加權(quán)融合后的識別準(zhǔn)確率均高于單一的單隱含層DBN 或SDAE 模型,充分證明了所提方法的有效性。

表3 細(xì)化后加權(quán)系數(shù)及最佳識別準(zhǔn)確率