復合深度神經網絡在直升機聲目標識別中的研究

郭 洋 周 翊 管魯陽鮑 明

(1中國科學院噪聲與振動重點實驗室(聲學研究所) 北京 100190)

(2重慶郵電大學 重慶 400065)

0 引言

聲學探測根據目標自身噪聲進行目標探測識別,具有全向探測無盲區、被動探測隱蔽性好等優勢,是目標識別的重要手段之一,可成為雷達、光學等傳統目標探測方式的補充,提供更豐富的信息和更好的環境適應能力[1?2]。為了盡早發現目標,并考慮到目標聲信號的短時平穩性,現有的聲目標識別通常采用聲信號分幀處理的方法。借鑒聲信號處理技術,人工設計特征提取方法獲得每幀信號的特征并進行識別,從而快速更新識別結果。特征提取主要有以下兩種思路:第一種是直接檢測目標的物理參數作為判別依據,如文獻[3]檢測直升機聲信號的基頻及諧頻的頻率。該方法物理意義明確,但在低信噪比條件下難以準確估計上述參數,不能適應復雜的實際應用環境。第二種,也是主流的方法,通常是以各種信號處理或數據處理技術從直升機聲信號中抽象出特征再由分類器進行識別[4]。其與第一種方法的主要區別在于信號特征與直升機型號參數之間的物理關系不明確,需要通過分類器的訓練建立信號特征與直升機型號之間的映射。傳統的聲信號特征提取在聲信號分析處理基礎上進行優化,尋找能有效識別目標且維數盡量低的特征表征方法。典型的聲信號特征包括短時傅里葉頻譜特征、小波特征、線性預測倒譜系數等信號處理參數特征,以及Mel頻率倒譜系數(Mel-frequency ceptral coefficients,MFCC)等反映人類聽覺特性的聲學特征等。

近年來隨著深度學習技術的快速發展,越來越多的研究人員開始采用深度學習進行聲目標識別研究,并借助深度神經網絡實現特征優化和目標識別[5?6]。如文獻[6]利用稀疏自編碼器從聲信號短時傅里葉譜中提取淺層目標特征,再結合堆疊自編碼器從淺層目標特征中進一步提取更抽象的目標特征用于水下目標識別,由此得到的識別正確率相較于傳統方法有顯著提升。但這種利用深度學習的方法與傳統方法類似,僅利用了當前數據幀的特征進行識別得到當前識別結果,實際使用中通常需要后處理環節以利用時間歷程信息減少虛警和漏警。

本文在對直升機飛行噪聲分析的基礎上,利用深度學習技術從直升機聲信號短時譜圖中自動進行特征提取和分類識別,優化信號的局部時頻信息和時序相關信息的表征,以提高直升機飛行過程中聲信號連續識別的魯棒性和正確率。

1 直升機聲信號分析

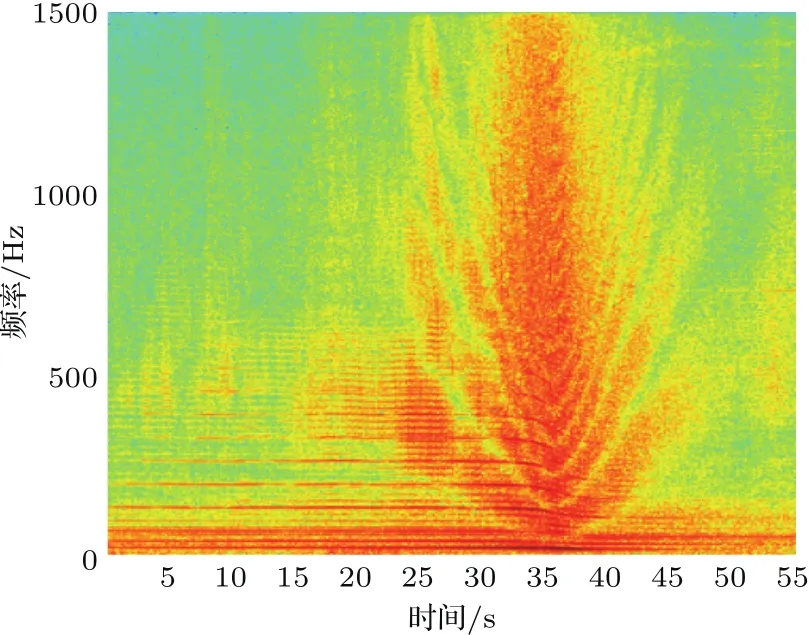

直升機飛行噪聲主要來自旋翼、發動機等部件的周期性運動及帶動氣流產生的氣動噪聲,其中旋翼是主要的噪聲來源[7]。直升機從遠處直線飛行經過測點再飛離這一完整飛行事件的聲信號短時譜圖如圖1所示,線譜噪聲主要分布在1.5 kHz以下,是主旋翼周期性運動產生的一系列諧頻信號。

基于聲信號的直升機遠距離連續探測識別中存在不利因素:直升機在測點附近時,寬帶氣動噪聲增強,導致直升機諧頻信號的信噪比明顯下降;直升機高速運動導致的多普勒效應使聲信號發生頻移,如圖1所示短時譜圖上第35 s直升機經過測點上空時諧頻信號的頻率出現整體下降;同時,在近場情況下多徑傳播導致直達聲與反射聲之間的相位差變化明顯,信號在某些頻率上相互抵消或增強,短時譜圖中產生多個波谷、波峰[8]。這些波谷、波峰改變了部分線譜信號的信噪比,使聲信號特征頻率表征的連續性、穩定性受到干擾。

這些干擾,加上實際應用中風噪聲等環境噪聲的影響,使得直升機飛過測點的過程中目標連續識別魯棒性受到影響,往往不能連續正確識別。

圖1 直升機飛行經過測點過程的噪聲短時譜圖Fig.1 Noise spectrogram of helicopter passing by the detector

2 復合深度神經網絡模型

深度學習技術具有強大的學習能力,能夠描述輸入數據與輸出目標之間的高度非線性關系,已在多類應用中取得了突破性的進展[9]。深度學習模擬人腦的分層工作機制,構建層次化的深度神經網絡,對輸入數據逐層進行特征提取,得到分層的特征表示。深度神經網絡通過監督或無監督學習優化數據的特征表征,有效地簡化了特征提取的設計。本文所用于優化直升機聲信號特征提取的卷積神經網絡(Convolutional neural network,CNN)和長短時記憶神經網絡(Long short-term memory,LSTM)是深度學習中的經典模型,已被廣泛應用語音識別[10]、聲學場景分析[11]等眾多研究和應用領域。

2.1 總體框架

本文采用一種并行結合CNN和LSTM的復合深度神經網絡模型,如圖2所示,利用CNN和LSTM并行地從聲信號短時譜圖中進一步提取局部時頻信息和時序相關信息構造新的信號特征進行分類。

圖2 復合深度神經網絡模型Fig.2 Structure of combined deep neural network

2.2 卷積神經網絡

卷積神經網絡是由多層卷積層和池化層交替連接組成的深度神經網絡,具有局部連接、權值共享和池化操作三大特點[12]。卷積層從底層到高層逐步抽取輸入數據的抽象特征。池化層將相似特征融合,大大減少了模型參數,同時具有二次提取特征表示的功能,使特征對噪聲和變形具有魯棒性,保證特征的平移不變性。

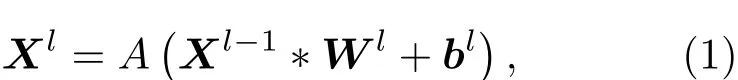

每個卷積層都包含多個特征圖,特征圖是由多個神經元構成的二維矩陣,每一個神經元通過可訓練的卷積核與上一層特征圖的局部區域連接,卷積核是一個二維權值矩陣。特征圖和卷積核維度可視為頻率F和時間T。對于卷積層l,輸出特征圖Xl表示為[13]

其中,運算符號“?”表示卷積操作;A為激活函數;Wl為卷積核;bl為加性偏置向量。

池化層通常跟隨在卷積層之后,依據一定的下采樣規則對特征圖進行下采樣。對于池化層l,輸出特征圖Xl表示為[13]

其中,S為下采樣規則,本文采用最大池化的下采樣規則。

線譜在短時譜圖的相鄰時頻單元中通常表現為局部最大值。最大池化操作選取特征的局部最大值,可得到在該局部的線譜特征。為了更好地追蹤線譜的變化,結合目標聲信號頻譜特點,對卷積神經網絡的卷積、池化進行改進,使其只沿輸入特征的頻率軸方向進行,各卷積核、池化核在時間軸上的維度等于對應輸入特征在時間軸上的維度,記為CNN-1D,而通常對輸入特征所使用的二維操作記為CNN-2D。局部連接機制使卷積神經網絡可以按照參數所設定的尺度分析、挖掘聲信號短時譜的局部時頻信息,進而表達聲信號時頻兩個維度的內在聯系。

卷積神經網絡模型參數依據聲信號特點設置。卷積核尺度大于線譜頻率之間的間隔,以分析相鄰線譜之間頻帶范圍內的線譜特征。池化核尺度小于線譜頻率之間的間隔,以避免池化核在頻率軸上滑動時可能混淆相鄰線譜特征。

2.3 長短時記憶神經網絡

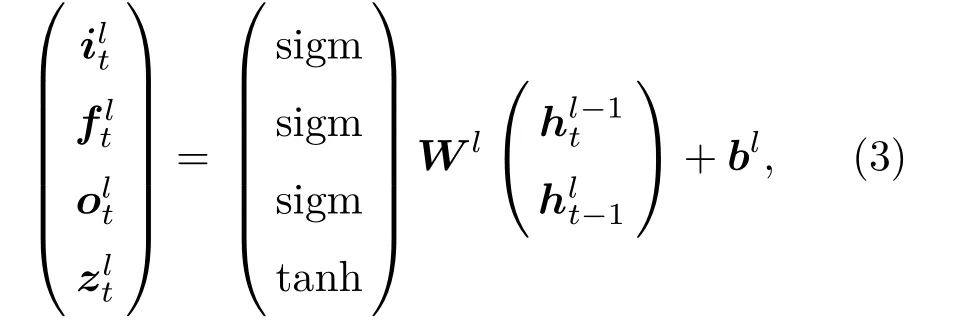

長短時記憶神經網絡是一種擅長處理序列數據的深度神經網絡[14],能夠從序列中學習到數據特征和建模數據之間的長短時依賴性。其循環連接的結構使得長短時記憶神經網絡可對歷史信息進行記憶并應用于當前輸出的計算中。區別于其他神經網絡,其同一隱藏層之間的節點是有連接的且節點間參數共享,并且隱藏層的輸入不僅包括當前時間步上一隱藏層的輸出還包括上一時間步同一隱藏層的輸出。同時,在隱藏層中引入由記憶單元、輸入門、輸出門和遺忘門組成的存儲塊,存儲塊中的三個門能對記憶單元進行讀、寫和復位操作,通過三個門控制信息在不同記憶單元之間的流動。本文采用文獻[15]所提出的LSTM存儲塊結構,如圖3所示,計算關系如下。

圖3 LSTM存儲塊結構Fig.3 Structure of LSTM cell

直升機飛行是一個連續過程,因此其聲信號特征具有時間上的連續性,這一特性有助于提升聲目標識別效果。特別是在直升機聲信號特征變化時,歷史信息有助于目標探測系統快速適應改變,及時捕捉目標聲信號特征。因此可考慮利用長短時記憶神經網絡學習聲信號特征的長短時依賴性,改善連續識別過程中識別的正確率和魯棒性。

3 直升機識別實驗

3.1 實驗數據

本文使用的數據是來自不同地點的多次外場實驗中采集的四種型號(分別以A、B、C、D表示)的直升機聲信號。根據直升機聲信號特點,信號采樣率為3 kHz,兼顧特征提取與計算量控制。實驗數據包含多種典型飛行狀態,如不同高度的直線飛行和沿不同半徑的盤旋飛行以及少量的不同距離和高度上的懸停等,通常實驗中直線飛行與盤旋飛行次數比例約為2:1。

將實驗數據根據實驗環境分為訓練集和測試集,訓練集數據大多采集自訓練場、靶場等場所,測試集數據來自更接近實際使用條件的野外環境。以直升機從聲學探測距離之外飛向測點,經過測點后繼續飛出探測距離為止作為一個完整的飛行事件,表1列出了訓練集和測試集中各類飛行事件的分布情況。訓練集中各類目標的聲信號時長約1 h,大體均衡;測試集中各類目標的聲信號時長則各不相同。

通過交叉校驗方法使用訓練集數據訓練神經網絡,測試集用于檢驗其識別性能和泛化能力。訓練集和測試集中的各類數據都是在多個時間、多個地點,利用同一型號不同架次直升機分批次采集得到的。

表1 飛行事件數Tabel 1 Number of f l ight events

本工作比較了3組不同類型的特征(表2):短時譜圖、幅度譜和改進Mel頻率倒譜系數(Modif i ed MFCC,MMFCC)特征[16]。其中MMFCC特征是在MFCC基礎上針對車輛、飛行器等低頻聲目標遠距離識別而改進的特征提取方法。

短時譜圖:計算聲信號每一秒的短時譜圖作為一個特征樣本,幀間重疊50%。在計算短時譜時,做512點快速傅里葉變換(重疊為50%)并取幅度值。為了避免風噪聲等干擾,去掉50 Hz以下的低頻部分,得到247×12的二維特征矩陣。

幅度譜:以256 ms為一幀,每幀數據使用Welch方法采用256點快速傅里葉變換計算歸一化的平均幅度譜,去掉50 Hz以下的低頻部分,得到124維的特征樣本。計算頻譜的能量、標準差、斜度和峭度等統計量,將124維幅度譜和4個統計量組合為128維特征向量。

MMFCC:聲信號降采樣到1 kHz,按照文獻[16]所述,以256 ms為一幀,提取25維特征向量。與傳統MFCC相比,該特征主要依據目標聲信號特點改進了濾波器組的設計。

表2 特征樣本數Table 2 Number of feature samples

3.2 參數配置

復合深度神經網絡的CNN模塊由兩層卷積層和兩層最大池化層組成。第一層卷積層卷積核個數為64,第二層卷積層卷積核個數為128,使用ReLU非線性激活函數。為進一步提升識別效果,卷積層和池化層之間連接使用批歸一化(Batch normalization,BN)[17]。

依據直升機聲信號基頻及諧頻頻率分布特點和快速傅里葉變換定義的頻率分辨率設置卷積核和池化核尺寸。在CNN-2D中,卷積核維度均為3×3,步長均為1×1,池化核維度均為2×2,步長均為2×2。在CNN-1D中,卷積核在頻率軸上維度均為3,步長均為1,池化核在頻率軸上維度均為2,步長均為2。

復合深度神經網絡的LSTM模塊由兩層隱藏層組成,隱藏層有12個存儲塊,存儲塊維度是512,在隱藏層之間使用層歸一化(Layer normalization,LN)[18]。全連接層神經元個數為1024,由CNN-1D組成的復合深度神經網絡記為CNN-1D+LSTM,輸出層為4個神經元的Softmax層。

復合深度神經網絡選用Nesterov Momentum優化算法[19],動量因子為0.9。前10次迭代初始學習率為0.01,之后每次迭代學習率遞減10%,連續3次迭代交叉校驗的結果無進一步改善則停止迭代訓練。

3.3 識別結果分析

為了驗證復合深度神經網絡的有效性,本文將其與CNN、LSTM兩種深度神經網絡和以支持向量機(Support vector machine,SVM)為代表的淺層神經網絡,使用三種典型特征通過分類實驗進行識別性能比較。深度神經網絡使用短時譜圖特征;SVM分類器使用幅度譜特征及針對目標遠距離探測設計的MMFCC特征。其中,使用幅度譜特征的SVM記為SVM1,使用幅度譜和MMFCC組合特征的SVM記為SVM2。

表3是CNN、LSTM兩種深度神經網絡與以SVM為代表的淺層神經網絡的識別結果。深度神經網絡的總體識別結果均好于SVM的總體識別結果,主要原因是目標聲信號頻域信息及其隨時間的變化規律是目標聲信號特性的重要體現,深度神經網絡采用的二維短時譜圖包含了連續數幀數據的連續時頻變化信息,利用其多層網絡結構的信息抽象表征能力,能夠在學習中逐步優化目標聲信號特征表征提高目標識別性能。而SVM由于受限于淺層神經網絡的信息處理能力,只能采用幅度譜、MMFCC等低維特征,這些特征局限于信號的短時頻域信息,不能擴展到連續數幀數據來獲取聲信號的時頻相關信息。此外,SVM識別結果中各類目標識別正確率之間的不均衡程度明顯大于深度神經網絡的識別結果,在實際應用中這種不均衡將導致識別系統對某類目標存在嚴重的性能短板。

表3 SVM和深度神經網絡的識別結果Table 3 Recognition results of SVM,LSTM and CNN

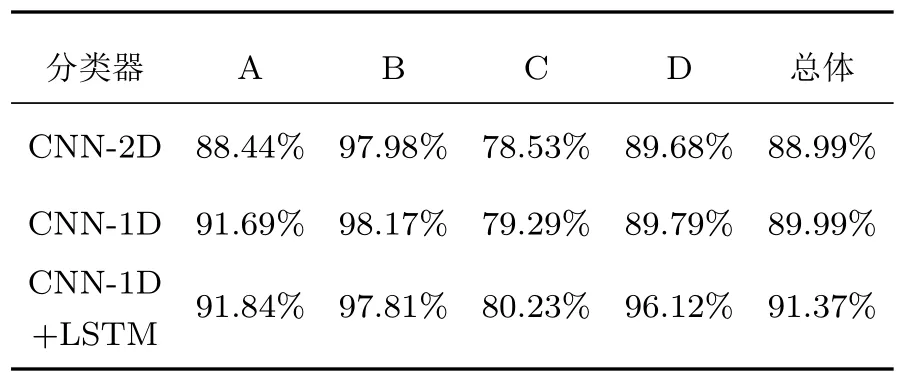

表4比較了CNN-1D、CNN-2D和復合深度神經網絡的識別結果。CNN-1D較CNN-2D提高了聲目標識別的總體正確率,各類均有不同程度的提高。這是因為當線譜發生頻移時,沿時間軸的一維操作篩選掉短時譜圖中每個頻帶上的局部較小值,能更好地選取每個頻帶上局部最大值,有效地追蹤到線譜的頻率變化。CNN-1D+LSTM復合深度神經網絡的整體識別正確率最高。可見LSTM網絡所側重的直升機信號隨時間變化的特征信息,可輔助CNN優化目標聲信號頻域信息的表征,從而進一步提高識別性能。圖4是以一個典型直升機聲信號對比復合深度神經網絡和CNN-1D的連續識別結果,可見復合深度神經網絡能有效減少信號頻譜的短時變化引起的錯誤判決。

表4 三種深度神經網絡的識別結果Table 4 Recognition results of the three deep neural networks

圖4 CNN-1D+LSTM和CNN-1D的連續識別結果對比Fig.4 Compare of continuous recognition results of CNN-1D+LSTM and CNN-1D

以直升機從遠處直線飛入探測范圍,經過測點然后直線飛離探測范圍為一個飛行事件,計算多個飛行事件中各時刻的平均識別正確率,得到平均識別正確率隨時間的變化曲線。無論目標運動速度如何,在直線飛行事件中目標與測點之間的距離與時間成正比。因此該曲線能夠在統計意義上展示直升機飛行過程中聲信號的連續識別性能。

以47個完整的直升機直線飛行事件為樣本,統計CNN-1D+LSTM和SVM2的平均識別正確率隨時間變化曲線。將直升機經過測點,信號短時能量最大的時刻作為時間軸原點,繪制曲線如圖5所示。總體上,直升機在測點附近時,由于信噪比較好,平均識別正確率總體相對較高。隨著目標與測點之間距離增大,信噪比變差,平均識別正確率隨之下降,直到無法有效探測。

圖5 飛行事件的平均識別正確率隨時間變化曲線Fig.5 Average accuracy rate in a target event changing over time

直升機經過測點上方時,目標特征線譜不但由于多普勒效應產生頻移,并且往往被寬帶氣動噪聲所淹沒,導致目標最接近測點時反而容易產生誤判。如SVM2在測點上方附近平均識別正確率有較大波動。這就是前文所述傳統分類方法對目標信號連續識別的魯棒性較差的問題。如圖5所示,本文所提方法有效改善了完整飛行事件中目標識別正確率和正確識別的連續性,其性能明顯優于SVM方法。

4 結論

本文提出了一種基于復合深度神經網絡的直升機聲目標特征提取和分類識別框架,該框架使用CNN和LSTM兩個并行的深度神經網絡模塊提取一段時間內聲信號頻譜特征和頻譜隨時間變化特征,彌補了傳統聲目標識別方法對信號時間歷程信息利用不足的缺陷。同時結合聲信號處理方法,改進了卷積神經網絡卷積層與池化層的計算方式,以更好地適應聲信號特征頻率的變化。真實外場實驗數據測試結果表明,與傳統方法相比,該方法明顯提升了對直升機完整飛行事件連續識別的魯棒性,同時提高了整體識別正確率。