基于單目視覺的機器人避障方法研究

王瀟峰,張禮廉,胡小平,張 盼

(1.國防科學技術大學,長沙410073;2.浙江理工大學,杭州310018)

0 引言

機器人避障就是在機器人運動過程中,通過相應的障礙物檢測算法,運用控制策略指導機器人對檢測到的障礙物進行躲避,保障機器人的安全行駛。機器人避障是實現機器人全自主運動的關鍵環節,總體方法可分為主動避障和被動避障。主動避障這類算法是針對已知環境情況的,此時機器人運動空間中的障礙物信息是完全已知的,如同時定位與地圖構建(Simultaneous Localization and Mapping,SLAM),經典的基于視覺的 SLAM方法有 LSD-SLAM(Large Scale Direct Monocular SLAM)[1]。主動避障方法在得到環境地圖后,進行路徑規劃,可實現機器人主動避開障礙物。本文提出的方法屬于被動避障,這類避障方法針對的環境情況是未知的,或者即使環境已知但還需要面對突然出現的障礙物,因而需要實時檢測障礙物,在檢測到障礙物后進行躲避。隨著計算機視覺技術的不斷發展,基于視覺的障礙物檢測方法被不斷地研究和應用,現已成為機器人障礙物檢測的主要手段。

相關的基于視覺的方法有:在文獻[2]中,結合SIFT特征及MOPS恢復了障礙物的三維信息。其中,MOPS用于提取障礙物的邊緣及角點信息,SIFT用于檢測障礙物內部輪廓信息。文獻[3]提出了一種測量到障礙物相對距離的方法。其中,基于慣性傳感器(IMU)并應用拓展Kalman濾波(EKF)方法估計攝像機位置,然后重投影特征點到圖像中來計算障礙物的空間坐標。Kovács[4]利用顯著性物體檢測方法檢測圖像內的顯著性物體,并把該物體當作障礙物,然后進行規避。文獻[5]提出一種仿生方法,模擬昆蟲的避障機理,提出基于光流的平衡策略,并計算接觸時間(Time to Contact,TTC)構建深度圖。 透視信息[6-7](例如消失的線特征)在人造的結構化的環境中很有作用,然而在自然環境中表現很差。基于立體視覺的方法也有很多,如文獻[8],模擬人類的雙眼結構,能獲得較好的深度信息,但是對應的成本更高、結構更復雜,主流處理方法的復雜性較高。

本文提出的方法僅僅依賴單目相機,針對單目攝像頭系統的局限性,因而需要一種可靠的避障方法。當機器人正前方的障礙物尺寸擴大時,意味著障礙物正在靠近機器人。因而提出基于SURF特征[9]尺度膨脹的方法,并計算由特征點連接成的凸包的面積,用于檢測機器人正前方的障礙物。對于機器人視野兩側的障礙物,采用基于光流平衡的方法,通過平衡運動視差避免碰撞到兩側的障礙物;然而基于特征和光流的方法對于紋理高度相似的區域(如白墻)失效,因為沒有足夠的信息來提取特征和計算光流,所以,提出基于圖像熵的方法指導機器人在這些情況下的避障。本文提出的方法在地面移動機器人Turtlebot上進行了大量實驗,表現出了良好的避障效果。

1 系統總述

本文的方法首先將一幅圖像分為3個區域,分別為IL、IM、IR,如圖1所示。

之所以將圖像分成3個區域,是為了充分利用上文提到的各方法的優勢,形成互補。圖像中間區域IM運用特征尺度檢測器算法檢測正前方的障礙物,視野兩側的區域IL、IR則被應用于光流平衡策略躲避兩側障礙物。對于高度相似紋理的障礙物(如白墻),計算的光流是不可靠的,而且也沒特征點可以提取,這種時候需要分別在3個區域計算圖像熵,利用熵值判斷障礙物。系統總體結構框圖如圖2所示。

圖2中的圖像序列指的是前后兩幀圖像,這是因為在SURF特征點匹配以及計算光流場時都需要兩幀圖像。當左右視野IL、IR某一區域圖像熵小于閾值時,例如區域IL,說明機器人左側已經靠近障礙物,這時候需要轉向右側,反之亦然;當IL、IR熵值都沒有達到閾值,這時候可以分別計算左右視場的光流場,通過平衡光流達到同時不碰撞兩側障礙物的目的;對于區域IM,在提取特征點前先同樣計算圖像熵,當中間區域檢測到障礙物時,需要向左側還是右側規避?本文采取的策略是,轉向左右視場中光流較小的一側。轉角大小與左右區域光流差值成正比例關系,即簡單的比例控制。

2 單目視覺避障方法

2.1 特征尺度檢測器

本文中機器人視野正前方障礙物的檢測方法主要依賴于尺度膨脹信息,這種檢測方法不依賴于先驗信息,也不對環境作前提假設。尺度膨脹信息在避免機器人碰撞到正前方障礙物時很有用,當障礙物與機器人的距離縮小時,圖像中的物體尺寸也在相應擴大。因而采用基于SURF特征的尺度檢測器方法,用于檢測機器人正對著的正在靠近的障礙物。

本文的方法首先在某兩幀圖像(區域IM)中提取SURF特征關鍵點和描述子,這些特征點可能是障礙物上的點,也可能不是障礙物上的點。由于SUFR特征點具有旋轉不變性和尺度不變性,因而即使關鍵點尺寸大小發生變化,也能匹配。所以,在連續的圖像序列中,將相鄰兩幅圖像中的關鍵點進行匹配,并且比較匹配上的兩個點的尺寸大小,來判斷相機是否正在靠近障礙物。在所有關鍵點匹配好以后,由于是檢測正在靠近的障礙物,所以先剔除關鍵點尺寸變小或者不變的匹配對。然后用基于尺寸比例的方法進一步確定有可能是障礙物上的點,最后將這些特征點連接起來構成一個凸包,比較上下兩幀凸包的面積,只有當面積之比大于一個閾值時,就認為已經檢測到障礙物,具體算法步驟如下。

算法:特征尺度檢測器

⑥判斷障礙物,ratio>Th?yes:no。

首先在相鄰兩幀圖像中提取關鍵點和特征描述子,并進行FLANN匹配(步驟①和步驟②),匹配結果如圖3所示,這里面有許多誤匹配的點。

為了提高匹配的準確率,必須對匹配點進行過濾,只有當兩個匹配點描述子的距離度量小于一定閾值時,才認為這些關鍵點足夠相似,然后保留這些匹配對。此外,僅僅需要在下一幀圖像中尺寸變大的關鍵點,因而去除尺寸變小或者不變的匹配對(步驟③),得到結果如圖4所示。此時可以看到,誤匹配情況很少。

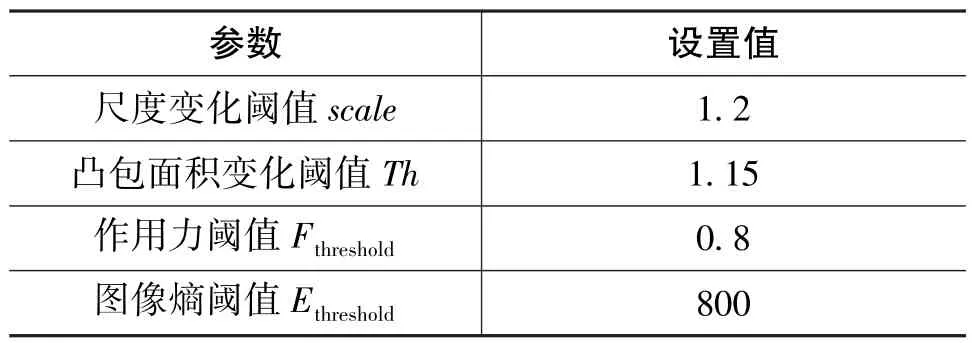

但僅僅利用尺寸變大這一點是無法判斷這些特征點是否屬于障礙物,因為機器人在前進的過程中,看到的大部分物體尺寸都是在變大的。雖然物體尺寸都在變大,但是變大的比例是不一樣的。如圖4所示,機器人向前移動一定距離,分別得到上一時刻和當前時刻的圖像。可以看到,距離最近的物體(書本)的尺寸明顯變大,而距離較遠的物體(窗戶邊的椅子)尺寸則變化不明顯,也就是說特征尺寸變化的比例是不一樣的。利用這一觀察,對特征點作進一步過濾,如步驟④,這里的scale參數(本文設置為1.2,必須大于1)設置依據機器人運動速度而異,得到圖5的結果。可以看到,此時剩余這些特征點基本都屬于障礙物(書本)。

最后,將剩余這些特征點連接形成凸包,并比較上一幀和當前幀凸包面積之比,步驟⑤的結果如圖6所示。目的是進一步確認剩余的這些特征點是否構成障礙物,當剩余特征點很少且稀疏時,認為這不是障礙物。通過設置Th參數(本文設置為1.15,必須大于1),可以防止在距離障礙物很遠時就檢測出障礙物,距離障礙物太遠就進行規避是沒有必要的。由圖6可以看到,畫出的凸包的位置基本上描述了障礙物的大致位置。

可以看到,利用特征尺度檢測器的方法,檢測正前方的障礙物是確實有效的。但稍微也有不足之處,正前方可能沒有障礙物,而機器人的兩側有障礙物,這時候需要用另一種方法進行互補,即基于光流平衡的避障方法。

2.2 光流平衡策略

光流(Optical Flow)是圖像灰度模式的運動。運動場是空間物體三維運動在圖像平面的投影,光流場是一個二維矢量場,它包含的信息是各像素點的瞬時運動速度矢量信息。在含有平移運動的情況下,運動場可等價于光流場。

平衡策略(Balancing Strategy)受到了昆蟲飛行的啟發,人們在日常生活中觀察發現,蜜蜂在穿過窗戶上的小洞時,能沿著洞的中心飛過去;在走廊環境中時,能沿走廊的中心線飛行。在探究了蜜蜂的導航機理以后,證實了蜜蜂是通過平衡兩眼中圖像的運動速度即光流來控制飛行軌跡的。

仿照蜜蜂的視覺導航機理,設計了光流平衡策略用于機器人避障。使用光流密度來構建平衡策略方法的主要思想是利用運動視差:當機器人運動時,近處的物體比遠處的物體在圖像上產生更大的運動;近處的物體會占據更大的視野,所以近處的障礙物將產生更大的光流。控制機器人遠離光流更大的一側,就可實現避障[10]。

本文的做法是,在圖像區域IL、IR分別計算稠密光流場。稠密光流是一種針對圖像進行逐點匹配的圖像配準方法,稀疏光流只針對圖像上若干個特征點,稠密光流計算圖像上所有點的偏移量,從而形成一個稠密的光流場。通過這個稠密的光流場,可以進行像素級別的圖像配準,相比稀疏光流計算,稠密光流更加精確,而且更重要的是對于特征點少的物體也能可靠計算。由于要計算每個點的偏移量,所以計算量特別大。但是本文并不需要在整幅圖像上計算,只需要分別在機器人視野IL、IR中計算每個像素的光流即可。更進一步節省計算資源的方法,也是本文用到的方法,將IL、IR分別進行降采樣,IL、IR同時縮小為原來的1/2,再對得到的像素計算光流。這樣做不僅不影響光流計算的精度,而且能極大減少計算量。

稠密光流計算方法采用Farneback法,Farneback在文獻[11]中通過計算參數化的運動模型約束,從圖像序列中計算3D方向張量。方向張量構造如下:

本文不是直接從張量點估計速度,而是假設在某個區域的速度場能夠根據運動模型被參數化,然后用所有的張量去計算參數。用仿射模型表示該方法:

x、y表示像素坐標,寫成矩陣形式如下:

為了估計運動模型的向量p,引入代價函數:

根據式(3)、 式(4)得到:

將區域內所有點相加得到:

通過最小化這個總代價函數,可以估計出參數向量p,即計算出每個像素點的運動向量,得到稠密光流場。

截取機器人運動過程中的某連續兩幀圖像進行計算, 如圖7所示。 圖7(b)由圖7(a)向前運動得到,可以看到在圖像視野右側,機器人已經靠近障礙物,這時候需要進行躲避。

通過分別計算IL、IR區域的稠密光流場,并每隔10個像素取一個像素,畫出該像素點的光流向量,如圖8所示。

從圖8中得到的光流場可以看到,IR區域由于距離障礙物較近,所以大部分像素點的光流向量幅值(直線長度)明顯大于IL區域。假設像素點(x,y)處光流向量為f(x,y)=(u,v), 則該像素點光流幅值為:

分別在IL、IR區域內計算所有像素點的光流向量幅值之和得到:

根據運動視差原理,設計光流平衡策略如下[5]:

比較左右兩側的光流強度總和,再進行歸一化,得到作用力F。如果F大于0,說明機器人左側的光流較大,極有可能左側距離障礙物較近;F小于0,則右側已靠近障礙物。但是由于圖像噪聲的原因,光流計算不可能絕對準確。如果僅僅F大于0,就控制機器人向右轉,F小于0,機器人向左轉,那么整個運動過程機器人就一直在左右搖擺。因而需要對F設定一個閾值Fthreshold,實際上歸一化的目的就是為了方便設定閾值。通過合理設定這個閾值,就可以控制機器人在實際靠近障礙物時再進行轉向,而不是一直左右轉向。至于轉角大小,本文的方法是與F成比例關系。F絕對值越大,說明某一側靠近障礙物的速度越快,因而需要一個大的轉角,確保立即避開。

結合特征尺度檢測器和光流平衡策略,對于大部分自然障礙物已經可以達到很好的避障效果。但這些障礙物通常具有少量的紋理信息,這樣才可以提取特征點,或者可以計算稠密光流場。但是對于很大區域都是相同紋理的物體,例如白墻,既無法提取特征點,光流計算也不準,這種情況就需要利用計算圖像熵的方法,此法對這種障礙物也能檢測。

2.3 計算圖像熵

熵的概念最早起源于物理學,用于度量一個熱力學系統的無序程度。熱力學第二定律,又稱“熵增定律”,表明了在自然過程中,一個孤立系統的總混亂度不會減小。在信息論中,熵被用來衡量一個隨機變量出現的期望值。它代表了在被接收之前,信號傳輸過程中損失的信息量,又被稱為信息熵。信息熵也稱信源熵、平均自信息量。

實際上熵就是衡量信息量的大小,對于圖像來說,如果一個灰度圖像的值是常數,那么它的熵為0,也就是這個圖像沒帶給我們任何信息,我們知道了一個像素值,其他也就全知道了。相反,熵越大說明圖像包含的信息越多、越復雜,其灰度值越混亂。因而可以通過檢測圖像熵的方法,去判斷物體包含紋理的多少。對于白墻,幾乎沒有紋理信息,因而圖像熵很小;而高紋理的物體,包含大量紋理信息,圖像比較混亂,因而擁有較大的圖像熵。

這里只引入圖像的一維熵,它反映了圖像中平均信息量的多少,表示圖像灰度分布的聚集特征所包含的信息量,計算方法如下:

mi表示圖像中灰度值為i的像素點的總個數,N表示該圖像內像素總數,所以pi代表了某個灰度在該圖像中出現的概率。圖像的熵則表示為:

實驗中,讓機器人分別靠近一張黑色椅子和一面白墻,并計算相應區域的圖像熵。首先,機器人視野右側有一張純黑色椅子,讓機器人逐漸靠近,計算IR區域的圖像熵,熵值用數字標明,得到如圖9所示的3幅圖像。

然后,再讓機器人靠近一堵白墻,并計算IM區域的圖像熵,結果如圖10所示。

從實驗結果可以看到,當圖像某區域只有一種相似紋理的時候,例如純黑色椅子和白墻,該區域圖像熵值很小;當混有其他紋理時,則熵值很大。從高紋理到低紋理,圖像熵值有一個大幅度的跳躍過程,例如圖9中,從第2幀到第3幀,第2幀中IR區域還包括地面,該區域熵值為2223;但當到第3幀時,IR區域就只包含黑色椅子,圖像熵值為173,可以看到有一個急劇跳躍的過程,圖10也是相同的過程。從而可以設定一個臨界值Ethreshold,本文設定為800,當圖像某一區域熵值小于該臨界值時,表明該區域已經臨近障礙物,需要做出動作規避。從上面實驗也可以看到,當面對的是一堵白墻時,根本無法提取有效特征點,所以計算圖像熵值是在提取特征點和計算光流場之前。

3 實驗及結果分析

為了驗證本文方法的可行性,把上述方法綜合起來構成一個實際系統。本文實驗基于Turtlebot地面移動機器人,上面搭載ROS開源機器人操作系統,配備Kinect深度/彩色相機(本文僅需彩色相機),RGB相機分辨率為640×480,采樣頻率為25Hz。在室內環境下進行實驗,設置機器人直線速度為0.2m/s,室內環境布置如圖11所示。

相關實驗參數設置如表1所示。

表1 實驗參數設置Table 1 Parameter setting of experiment

每次實驗場景障礙物擺放略有不同,且機器人每次從不同起點出發,目的是為了充分驗證本文方法的可行性。本文在上述環境中共做了12次漫游實驗,只有當無碰撞漫游時間達到2min或者中途碰撞到障礙物時,一次實驗才算完成。提取其中3次成功的實驗,并將軌跡圖畫出來,得到如圖12所示結果。

圖12中,灰色線條及矩形為障礙物,黑色邊框表示墻壁,黑色菱形為機器人初始位置,虛線為機器人運動軌跡,黑色三角形是機器人漫游終點位置。從圖12可以看到,機器人在漫游過程中可以避開障礙物,本文提出的方法對指導機器人避障確實有效。

本實驗目前只在室內進行,由于室內環境比較封閉,從而容易使機器人陷入障礙物構成的狹小角落內,如圖12(b)終點黑色三角形所示。機器人進入這樣的角落,就極有可能一直在原地左右搖擺尋找可通行路徑。圖12(b)是在時間到了2min以后陷入角落,所以仍視為一次成功的實驗。實際上在陷入角落之前,很多次實驗都沒有碰撞到障礙物,但是實驗時間沒有達到2min,對于這樣的一次實驗既沒有算做成功也沒有并入失敗,相當于一次無效實驗。因而要在室內漫游時間達到2min而不陷入角落需要一定運氣,如果是在室外,2min漫游則容易達到。12次實驗中共有兩次實驗失敗,避障失敗的情形如圖13所示。

圖13(a)失敗并不是因為沒有檢測到障礙物(黑色椅子),而是因為沒有相應措施檢測到地面障礙物(椅子底座),這也是本文方法的局限之一,因為本文的方法都是假設障礙物至少具有一定高度;圖13(b)失敗是因為該障礙物出現在圖像IM區域,但是供提取的特征點不夠,所以沒有檢測出該障礙物,這也是本文方法的局限之二,正前方障礙物需要一定量的紋理可供提取特征點。但實驗中發現,當圖13(b)中的障礙物出現在機器人視野兩側時,則可以躲避成功,這是因為光流計算對于紋理要求相對較低。

4 總結及未來工作

本文基于單目視覺,通過結合特征尺度檢測器、光流平衡策略以及圖像熵的方法,設計了一個可靠的避障系統,具有較強的實用性。本文的方法把圖像分為左中右3個區域,在不同區域內應用不同的方法檢測障礙物,這樣可以將各個方法形成互補,保證系統的可靠性。

對于圖像中間區域,基于SURF特征提取膨脹特征點,并將這些特征點連接以形成凸包,通過凸包面積變化速率,可以確認是否有障礙物靠近。實驗表明,在障礙物有足夠紋理提取特征時,這種方法對于檢測正前方障礙物很有效。對于圖像視野兩側,可以通過平衡這兩個區域的光流密度來避障。本文計算方法是Farneback稠密光流方法,為了保證實時性,可以將左右區域再降采樣。通過上述兩種方法的互補,既可以檢測機器人正前方的障礙物,也可以同時躲避左右兩側的障礙物。但保證上述兩種方法有效的前提是,障礙物具有一定紋理信息。當障礙物紋理信息很低時,可以再加入圖像熵的方法避障。

接下來的工作將考慮把主動避障和被動避障結合起來,先對環境建圖,然后作路徑規劃指導機器人避障,對于動態障礙物或者地圖構建不準確時則用被動避障方法。此外,還可以在本文方法的基礎上,加入透視及其他信息進行融合,因為透視信息已經被成功應用于結構化環境中的導航,因而同樣可以應用于避障。而且,本文對環境信息沒有作假設,這種方法可以應用于室內環境,也可以用在自然環境中;既可以是地面移動機器人,也可以是飛行器,所以將考慮把本文方法應用于四旋翼無人機的自動避障。

[1]Engel J,Sch?ps T,Cremers D.LSD-SLAM:large-scale direct monocular SLAM [C].European Conference on Computer Vision,2014:834-849.

[2]Lee J O,Lee K H,Park S H,et al.Obstacle avoidance for small UAVs using monocular vision [J].Aircraft Engineering and Aerospace Technology,2011,83 (6):397-406.

[3]Saha S,Natraj A,Waharte S.A real-time monocular vision-based frontal obstacle detection and avoidance for low cost UAVs in GPS denied environment[C].IEEE International Conference on Aerospace Electronics and Remote Sensing Technology (ICARES),2014:189-195.

[4]Kovács L.Visual monocular obstacle avoidance for small unmanned vehicles [C].Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition Workshops,2016:59-66.

[5]Souhila K,Karim A.Optical flow based robot obstacle avoidance [J].International Journal of Advanced Robotic Systems,2007,4 (1):13-16.

[6]Bills C,Chen J,Saxena A.Autonomous MAV flight in indoor environments using single image perspective cues[C].IEEE International Conference on Robotics and Automation (ICRA),2011:5776-5783.

[7]Chavez A,Gustafson D.Vision-based obstacle avoidance using SIFT features [C].International Symposium on Visual Computing,2009:550-557.

[8]Hrabar S,Sukhatme G S,Corke P,et al.Combined opticflow and stereo-based navigation of urban canyons for a UAV [C].2005 IEEE/RSJ International Conference on Intelligent Robots and Systems,2005:3309-3316.

[9]Mori T,Scherer S.First results in detecting and avoiding frontal obstacles from a monocular camera for micro unmanned aerial vehicles [C].IEEE International Conference on Robotics and Automation (ICRA),2013:1750-1757.

[10]徐麗.基于光流的移動機器人仿生避障方法研究[D].北京工業大學,2014.XU Li.Research on bionic obstacle avoidance method of mobile robot based on optical flow [D].Beijing University of Technology,2014.

[11]Farneback G.Fast and accurate motion estimation using orientation tensors and parametric motion models [C].15thInternational Conference on Pattern Recognition,2000,1 (1):135-139.