基于跨尺度特征融合的泵站安全帽檢測(cè)方法

李記恒, 褚霄楊, 王濤, 劉鵬宇*

(1.北京市南水北調(diào)團(tuán)城湖管理處,北京 100195; 2.北京工業(yè)大學(xué) 信息學(xué)部,北京 100124;3.先進(jìn)信息網(wǎng)絡(luò)北京實(shí)驗(yàn)室,北京 100124; 4.北京工業(yè)大學(xué) 計(jì)算智能與智能系統(tǒng)北京市重點(diǎn)實(shí)驗(yàn)室,北京 100124 )

依托人工智能等先進(jìn)技術(shù)優(yōu)勢(shì)建設(shè)智能泵站是在產(chǎn)業(yè)智能升級(jí)背景下的發(fā)展趨勢(shì)。泵站重要區(qū)域遍布多種設(shè)備裝置,要求進(jìn)入泵站重點(diǎn)區(qū)域如高壓室、主廠房的人員佩戴安全帽[1]。由于人員安全防范意識(shí)參差不齊,未佩戴安全帽的情況時(shí)有發(fā)生,這是導(dǎo)致安全事故的重大隱患。人工監(jiān)管方式存在成本高、效率低等問題,因此迫切需要研究適配于泵站場(chǎng)景的安全帽檢測(cè)技術(shù),實(shí)現(xiàn)智能高效的安防監(jiān)管[2]。

目前,安全帽佩戴檢測(cè)方法主要包括傳統(tǒng)檢測(cè)方法和基于深度學(xué)習(xí)的方法。傳統(tǒng)方法通常在形態(tài)學(xué)操作基礎(chǔ)上利用顏色、形狀特征檢測(cè)安全帽[3]。劉曉慧等[4]利用人體膚色和安全帽顏色的顯著性差異進(jìn)行安全帽檢測(cè),方法簡(jiǎn)單,但易受光線強(qiáng)度的干擾。Shrestha等[5]利用邊緣檢測(cè)算法判斷人臉上方是否存在安全帽的半圓輪廓進(jìn)行安全帽檢測(cè),此類方法使用形狀特征,克服了光照不均的影響。Rubaiyat等[6]通過特征描述子結(jié)合分類器的方法判定安全帽位置,從而提升安全帽檢測(cè)精度。傳統(tǒng)安全帽檢測(cè)方法適用的場(chǎng)景比較理想且多為戶外施工現(xiàn)場(chǎng),在復(fù)雜環(huán)境下的檢測(cè)精度較低,因此難以適用于泵站場(chǎng)景。深度學(xué)習(xí)技術(shù)的發(fā)展為安全帽檢測(cè)提供了新方向。黃渝文等[7]改進(jìn)了LeNet_5,提出了一種并行雙路卷積神經(jīng)網(wǎng)絡(luò)方法來識(shí)別人體,再通過顏色特征識(shí)別安全帽,但是對(duì)遠(yuǎn)距離小目標(biāo)檢測(cè)效果不佳。何慧敏等[8]通過構(gòu)建多層卷積神經(jīng)網(wǎng)絡(luò)對(duì)人進(jìn)行檢測(cè),再結(jié)合顏色和方向梯度直方圖(Histogram of Oriented Gradient,HOG)特征識(shí)別安全帽,檢測(cè)效果有所提升,但是對(duì)于人員之間相互遮擋和物體對(duì)人遮擋的情況效果不佳。上述方法雖然較傳統(tǒng)方法精度有明顯提升,但是難以適用于泵站場(chǎng)景下的遮擋和小目標(biāo)等情況。

為有效應(yīng)對(duì)泵站場(chǎng)景的安全帽檢測(cè)任務(wù),針對(duì)存在的遮擋和遠(yuǎn)距離目標(biāo)檢測(cè)等問題,本文以YOLOv5目標(biāo)檢測(cè)模型為基礎(chǔ),提出一種面向泵站場(chǎng)景的安全帽檢測(cè)方法。首先建立了泵站場(chǎng)景下安全帽的數(shù)據(jù)集;在特征提取網(wǎng)絡(luò)算法中融入注意力機(jī)制[9],同時(shí)增加一個(gè)檢測(cè)層提升多尺度學(xué)習(xí)能力,并在后處理時(shí)使用柔和非極大值抑制(Soft Non-Manimum Suppression,Soft-NMS)和完全交并比(Complete Intersection over Union,CIoU)算法進(jìn)行改進(jìn),以減少遮擋目標(biāo)漏檢的情況[9]。通過對(duì)比得出,本文所提算法的效果優(yōu)于常見的目標(biāo)檢測(cè)算法,可有效解決泵站場(chǎng)景的安全帽檢測(cè)問題。

1 面向泵站場(chǎng)景的安全帽檢測(cè)方法

1.1 方法概述

本文所提出的泵站場(chǎng)景的安全帽檢測(cè)算法主要包括如下3個(gè)步驟:首先獲取泵站廠區(qū)監(jiān)控?cái)?shù)據(jù),構(gòu)建泵站場(chǎng)景的安全帽檢測(cè)數(shù)據(jù)集;其次構(gòu)建安全帽檢測(cè)網(wǎng)絡(luò)用于模型的訓(xùn)練和推理預(yù)測(cè);最終獲得安全帽檢測(cè)的識(shí)別結(jié)果。

1.2 改進(jìn)型的目標(biāo)檢測(cè)網(wǎng)絡(luò)

本文所提出的目標(biāo)檢測(cè)網(wǎng)絡(luò)結(jié)構(gòu)如圖1所示,主要分為特征提取網(wǎng)絡(luò)、Neck網(wǎng)絡(luò)和預(yù)測(cè)網(wǎng)絡(luò)3部分。

圖1 改進(jìn)型檢測(cè)網(wǎng)絡(luò)結(jié)構(gòu)圖

特征提取網(wǎng)絡(luò)融入SE-Net(Squeeze-and-Excitation Networks)注意力機(jī)制模塊,提升對(duì)小目標(biāo)的特征提取能力[10]。在Neck網(wǎng)絡(luò)結(jié)構(gòu)中增加一個(gè)檢測(cè)層使得特征融合時(shí)能夠結(jié)合多級(jí)特征,并在預(yù)測(cè)時(shí)使用Soft-NMS改進(jìn)去冗余框算法以減少遮擋目標(biāo)的漏檢情況。

1.2.1 改進(jìn)的特征提取網(wǎng)絡(luò)

輸入的原始圖像首先經(jīng)過Focus結(jié)構(gòu),其主要作用是從高分辨率圖像中抽取像素點(diǎn)重構(gòu)為低分辨率圖像,并獲得獨(dú)立的特征層[11],經(jīng)過通道堆疊后可將寬高信息集中到通道信息,從而達(dá)到增強(qiáng)輸入圖像感受視野、降低模型計(jì)算量的作用[11],Focus具體結(jié)構(gòu)如圖2所示。

圖2 Focus結(jié)構(gòu)示意圖

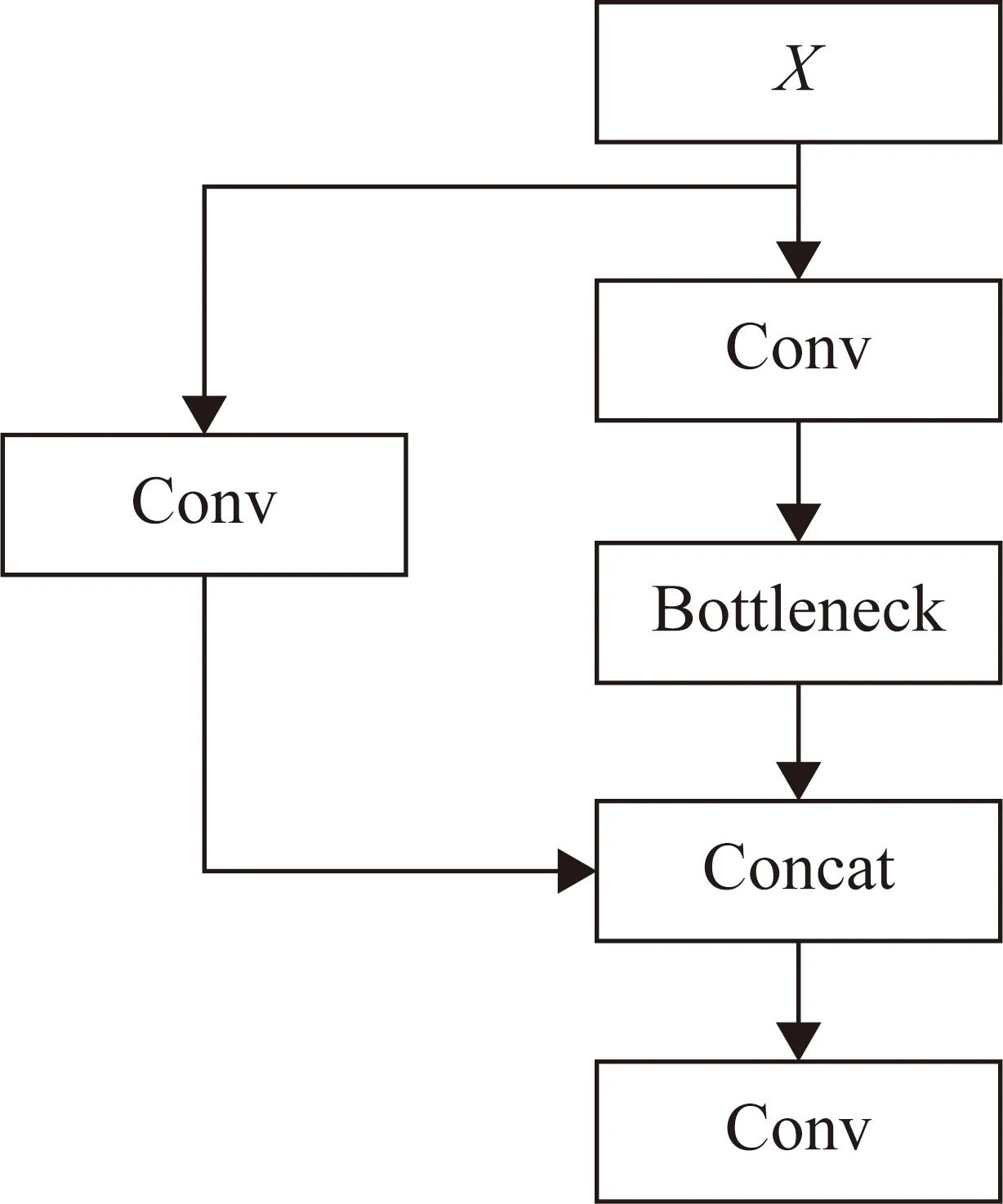

Focus結(jié)構(gòu)處理后的特征圖經(jīng)過卷積進(jìn)行特征提取,進(jìn)一步降低圖像的尺寸,并采用CSP結(jié)構(gòu)進(jìn)行安全帽特征的細(xì)致化提取[12]。其中CSP結(jié)構(gòu)包含2個(gè)分支:第1個(gè)分支使用多個(gè)卷積層進(jìn)行特征提取并用殘差結(jié)構(gòu)將分支的輸入輸出相連,減少因網(wǎng)絡(luò)層過深引起的梯度消失現(xiàn)象:另一個(gè)分支由一個(gè)卷積層處理保留部分特征信息,最終將2個(gè)分支的結(jié)果進(jìn)行通道堆疊獲得融合之后的特征圖[13],CSP結(jié)構(gòu)如圖3所示。

圖3 CSP結(jié)構(gòu)示意圖

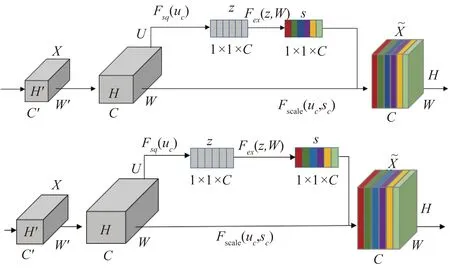

利用深層網(wǎng)絡(luò)提取特征圖,不同通道包含著不同類別的特征信息,學(xué)習(xí)不同通道間的特征信息對(duì)提高安全帽檢測(cè)準(zhǔn)確度具有重要的意義[14],因此本文在CSP結(jié)構(gòu)進(jìn)行細(xì)致化特征提取后增加了一個(gè)SE-Net層用于獲取具有更強(qiáng)語義的安全帽特征信息[14]。SE-Net具體結(jié)構(gòu)如圖4所示。

圖4 SE-Net結(jié)構(gòu)示意圖

輸入一個(gè)大小為C′×W′×H′的特征圖X,經(jīng)過卷積映射后變?yōu)榇笮镃×W×H的特征圖U,在空間維度上提高模型的感受野[15]。然后將特征圖U分成2個(gè)分支,其中一個(gè)分支進(jìn)行擠壓和激勵(lì)操作,另一個(gè)分支對(duì)特征圖進(jìn)行重標(biāo)定。擠壓模塊主要利用全局池化層對(duì)通道進(jìn)行壓縮來獲取全局空間信息,提高對(duì)全局目標(biāo)特征的提取能力;激勵(lì)模塊主要通過全連接層和非線性層獲取通道間的關(guān)系,將不同通道的安全帽特征信息結(jié)合起來。重標(biāo)定模塊將輸入特征圖中每個(gè)通道與注意力向量的元素相乘來提高模型對(duì)通道特征的敏感性[16]。相較于傳統(tǒng)卷積,池化操作默認(rèn)不同通道的重要性是相同的,引入注意力機(jī)制后能夠使模型聚焦于強(qiáng)語義安全帽特征通道的信息,提高整體特征的提取能力。

1.2.2 多檢測(cè)層的Neck網(wǎng)絡(luò)

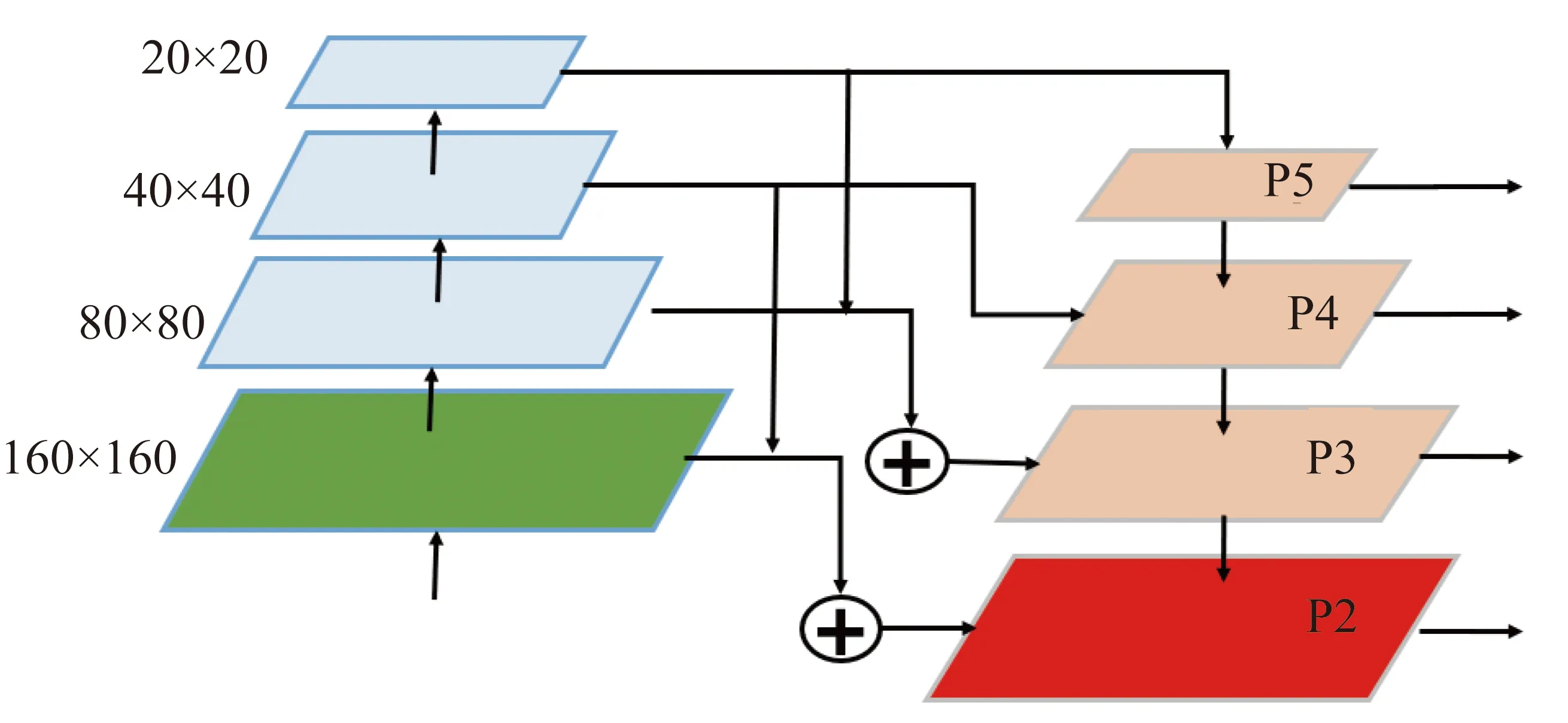

原始YOLO系列目標(biāo)檢測(cè)模型Neck部分使用骨干網(wǎng)絡(luò)提取3個(gè)尺度不同的特征層進(jìn)行特征融合。其中淺層特征圖具有弱語義、分辨率高和幾何細(xì)節(jié)表征能力強(qiáng)等特點(diǎn);而深層特征圖具有強(qiáng)語義、分辨率低和集合細(xì)節(jié)表征能力弱的特點(diǎn)[16],采用特征融合方法能夠使模型學(xué)習(xí)到不同尺度的語義信息[16]。鑒于泵站場(chǎng)景下,人員會(huì)隨著活動(dòng)范圍不同,在監(jiān)控畫面中出現(xiàn)的尺寸大小也會(huì)不一,為使模型能夠從不同大小的目標(biāo)特征中獲取更多語義信息,本文在Neck網(wǎng)絡(luò)增加一次上采樣獲得大小為160×160的特征層[17],再將所有的特征層與特征提取網(wǎng)絡(luò)提取的特征相融合使得模型能夠結(jié)合多級(jí)特征[18]。因此本文最終獲得4個(gè)大小分別為20×20、40×40、80×80和160×160的特征層作為檢測(cè)頭的輸入,用于不同尺度大小的預(yù)測(cè),改進(jìn)型Neck網(wǎng)絡(luò)具體結(jié)構(gòu)如圖5所示。

圖5 改進(jìn)型Neck網(wǎng)絡(luò)結(jié)構(gòu)示意圖

1.3 預(yù)測(cè)網(wǎng)絡(luò)優(yōu)化

模型預(yù)測(cè)主要是對(duì)上述P2~P5四種不同尺度大小的特征圖進(jìn)行后處理,通過1×1卷積操作輸出4個(gè)不同尺寸分辨率大小的特征圖。對(duì)輸出的特征圖進(jìn)行損失計(jì)算,生成一個(gè)包括類別概率、邊界框得分和置信度得分的特征向量。訓(xùn)練損失包含3個(gè)部分:分類、定位和置信度,總損失為3類之和,總和的值越小代表模型檢測(cè)能力越好。其中置信度和分類損失都是基于二元交叉熵?fù)p失函數(shù)進(jìn)行計(jì)算的,分別用于計(jì)算模型預(yù)測(cè)矩形框中存在真實(shí)標(biāo)注目標(biāo)類別的概率和預(yù)測(cè)矩形框中目標(biāo)類別屬于真實(shí)標(biāo)注類別的概率,而定位損失計(jì)算模型預(yù)測(cè)目標(biāo)框和真實(shí)標(biāo)注目標(biāo)框之間的誤差目前常采用IoU作為指標(biāo),存在回歸精度低的問題,因此下面從這方面進(jìn)行優(yōu)化。

1.3.1 IoU優(yōu)化

原始的YOLO系列目標(biāo)檢測(cè)模型采用IoU作為判斷真實(shí)框A和預(yù)測(cè)框B的重合程度指標(biāo),其計(jì)算公式為

(1)

對(duì)于安全帽檢測(cè)中的小目標(biāo)以及遮擋現(xiàn)象等問題,IoU的邊框回歸精度較低,因此本研究采用CIoU作為預(yù)測(cè)框的回歸損失函數(shù),并引入懲罰項(xiàng)RCIoU,其計(jì)算公式為

(2)

(3)

式中:ρ為歐式距離;b、bgt分別為預(yù)測(cè)框和真實(shí)框的中心點(diǎn);c為包含預(yù)測(cè)框和真實(shí)框的對(duì)角線距離;α為權(quán)重系統(tǒng);v為測(cè)量長寬比的一致性。

(4)

(5)

式中:wgt、hgt、w、h分別為兩框的長和寬。

1.3.2 NMS優(yōu)化

傳統(tǒng)NMS在當(dāng)前檢測(cè)框和最高分檢測(cè)框的CIoU大于閾值時(shí),直接將該檢測(cè)框的得分置0,這將導(dǎo)致重疊區(qū)域的目標(biāo)被漏檢[18]。本文采用Soft-NMS替換原有的NMS算法,使得計(jì)算得分時(shí)會(huì)根據(jù)重合面積的大小給出檢測(cè)框的得分,而不會(huì)直接置為0,其計(jì)算公式為

(6)

式中:Si為當(dāng)前檢測(cè)框的得分;M為得分最高的檢測(cè)框;bi為當(dāng)前檢測(cè)框;Nt為交并比的閾值[19]。

2 泵站場(chǎng)景安全帽數(shù)據(jù)集

本研究使用的數(shù)據(jù)集為泵站監(jiān)控實(shí)地拍攝的圖片,共1 800幅圖片,包含佩戴安全帽和未佩戴安全帽2種目標(biāo)。為防止網(wǎng)絡(luò)訓(xùn)練時(shí)出現(xiàn)過擬合的情況,通過左右翻轉(zhuǎn)、平移、拉伸、旋轉(zhuǎn)和裁剪等方式對(duì)數(shù)據(jù)樣本進(jìn)行擴(kuò)充,最終將數(shù)據(jù)集擴(kuò)充到7 213張。通過圖像標(biāo)注軟件LabelImg進(jìn)行圖像標(biāo)注,并按照8∶1∶1劃分為訓(xùn)練集、驗(yàn)證集和測(cè)試集,輸入的圖像尺寸大小統(tǒng)一為640像素×640像素劃分訓(xùn)練。

3 試驗(yàn)結(jié)果與分析

本研究使用的操作系統(tǒng)為Ubuntu18.02,CPU為Intel-i7-10875,GPU為NVIDIA GeForce RTX 3090,并基于遷移學(xué)習(xí)策略使用預(yù)訓(xùn)練權(quán)重進(jìn)行訓(xùn)練,加速模型的收斂。訓(xùn)練的學(xué)習(xí)率為0.000 7,Batchsize為16,epoch為100,使用Adam作為優(yōu)化器。

3.1 評(píng)價(jià)指標(biāo)

本研究采用精確率(Precision)、召回率(Recall)、平均準(zhǔn)確率(AP)和均值平均精度(mAP)作為評(píng)價(jià)指標(biāo)來衡量模型的性能,其具體計(jì)算公式為

(7)

(8)

(9)

(10)

式中:TP為模型預(yù)測(cè)為正例且真實(shí)標(biāo)注為正例;FP為模型預(yù)測(cè)為正例而真實(shí)標(biāo)注為負(fù)例;FN為模型預(yù)測(cè)為負(fù)例而真實(shí)標(biāo)注為正例;n為類別數(shù);i為當(dāng)前類別序號(hào)。AP值是Precision在(0,1)區(qū)間內(nèi)對(duì)Recall進(jìn)行積分獲得的值,用來評(píng)估某一類目標(biāo)的預(yù)測(cè)效果,mAP為多類目標(biāo)的AP均值。

3.2 消融試驗(yàn)

為證明本文所提方法的有效性,選取原始YOLOv5s作為基準(zhǔn),并在此基礎(chǔ)上添加本文所提的不同模塊進(jìn)行驗(yàn)證,具體結(jié)果如表1所示。根據(jù)結(jié)果可以發(fā)現(xiàn)原始YOLOv5s在本數(shù)據(jù)集上的精確率和召回率分別達(dá)到了89.21%和84.17%,均值平均精度達(dá)到了86.91%。在添加本文提出的模塊后mAP均有所提升,所提算法最終mAP達(dá)到了93.5%,證明了本文所提方法在泵站場(chǎng)景安全帽檢測(cè)任務(wù)中的可行性。

表1 消融實(shí)驗(yàn)對(duì)比表

3.3 對(duì)比試驗(yàn)

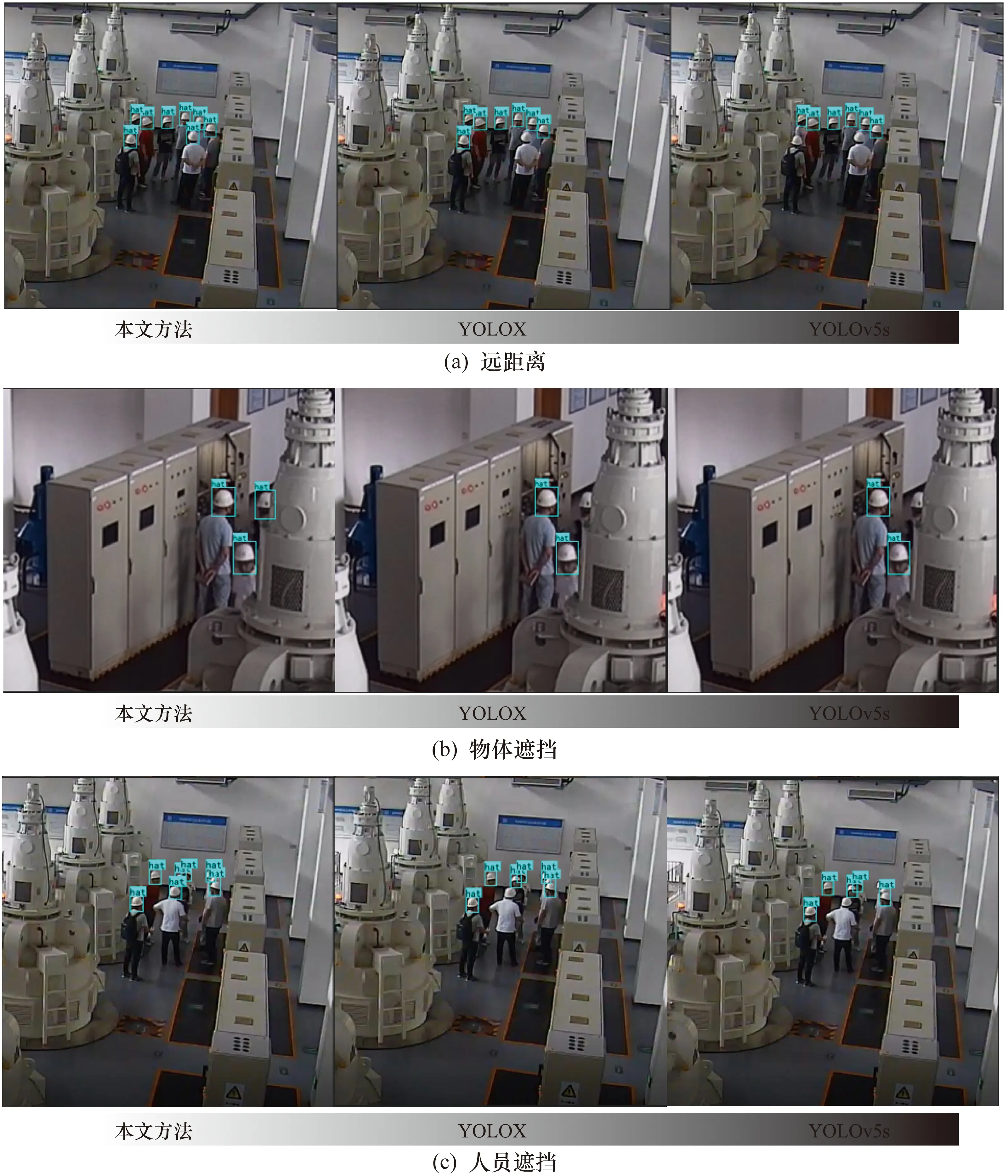

3.3.1 定性分析

為驗(yàn)證本文所提算法的性能,選擇與目前常見效果較好的YOLOv5s、YOLOX算法進(jìn)行對(duì)比試驗(yàn),針對(duì)小目標(biāo)檢測(cè)、人員遮擋以及被物體遮擋3種情況進(jìn)行試驗(yàn)。試驗(yàn)采用的數(shù)據(jù)集為本文所建數(shù)據(jù)集,訓(xùn)練的epoch均為100,具體效果如圖6所示,在遠(yuǎn)距離、人員遮擋和物體遮擋的情況下,其他算法均有漏檢目標(biāo)的情況出現(xiàn),因此足以證明本文所提的方法在復(fù)雜的泵站場(chǎng)景下安全帽檢測(cè)效果要優(yōu)于其他常見的目標(biāo)檢測(cè)算法。

圖6 不同算法效果對(duì)比圖

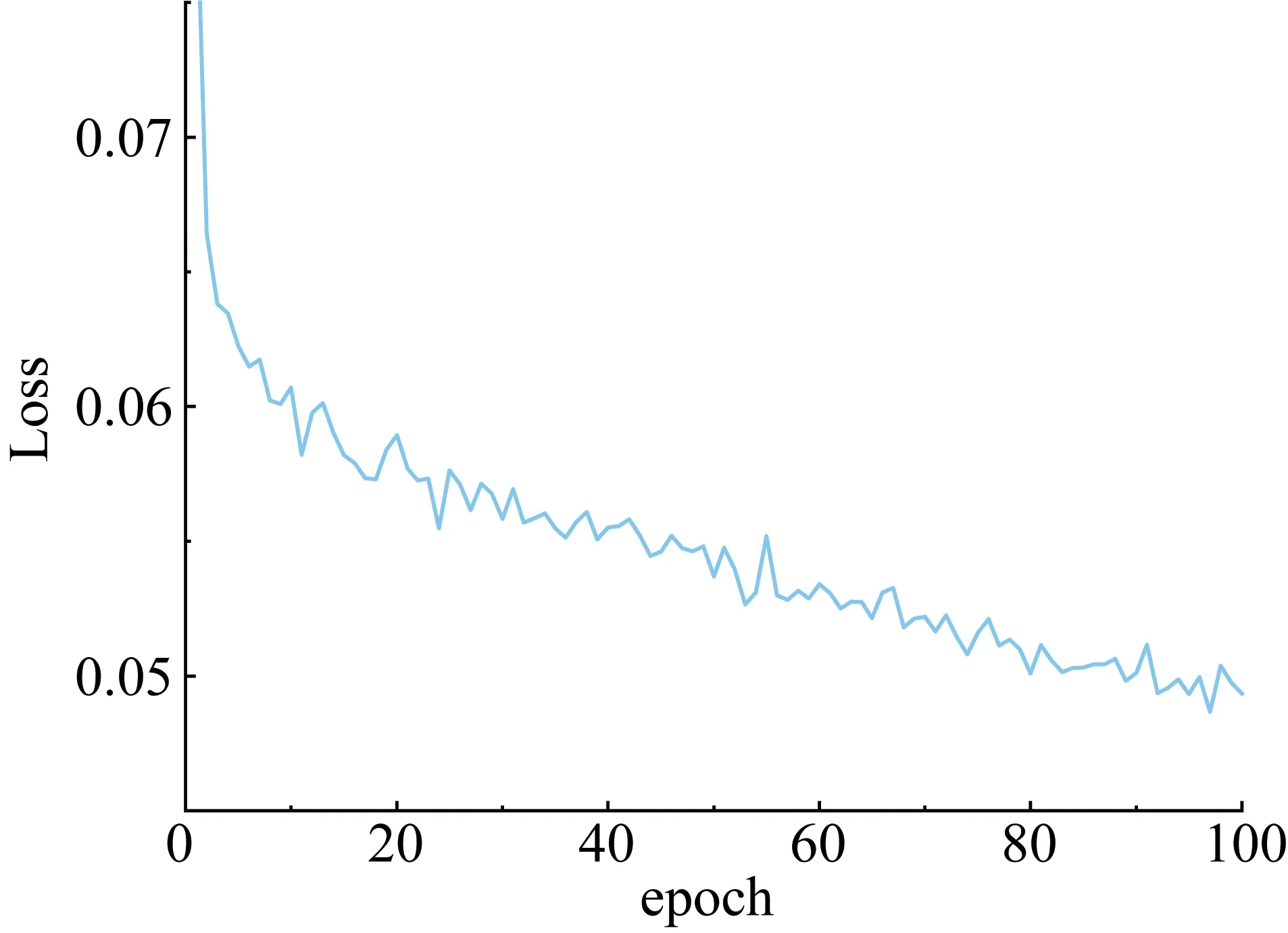

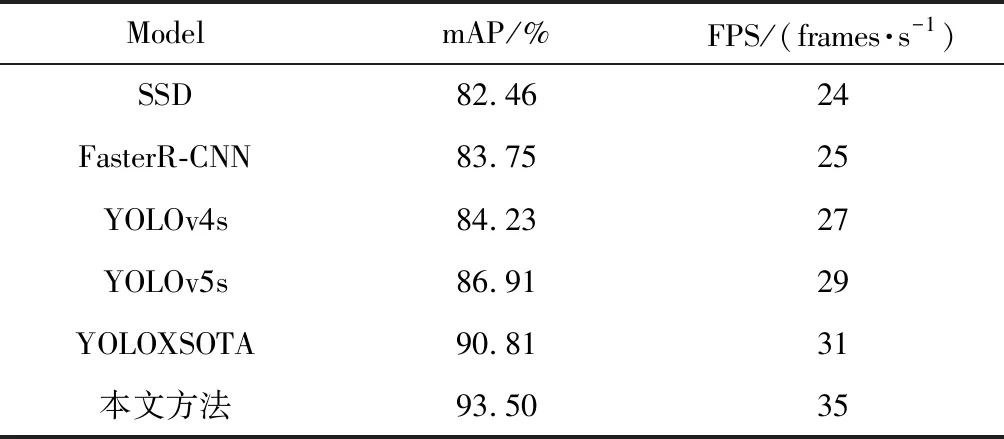

3.3.2 定量分析

為更好地對(duì)比本文方法與常見的目標(biāo)檢測(cè)算法的性能,選用mAP作為評(píng)價(jià)指標(biāo)來衡量安全帽檢測(cè)的準(zhǔn)確率,最終本文所提方法的mAP隨epoch的變化情況如圖7所示,最終達(dá)到了93.5%,損失Loss隨epoch的變化情況如圖8所示。

圖7 訓(xùn)練精度折線圖

圖8 訓(xùn)練損失折線圖

同時(shí),與常見的目標(biāo)檢測(cè)算法SSD、Faster R-CNN、YOLOv4s、YOLOv5s和YOLOXSOTA相比,本文方法的mAP均有不同程度的提高,性能對(duì)比結(jié)果如表2所示,足以證明本文所提方法具有優(yōu)越性,能夠適用于泵站復(fù)雜場(chǎng)景的安全帽檢測(cè)問題。

表2 本文模型與主流目標(biāo)檢測(cè)模型性能對(duì)比表

4 結(jié)束語

為解決泵站復(fù)雜場(chǎng)景下安全帽佩戴檢測(cè)技術(shù)因遠(yuǎn)距離和遮擋等因素帶來的準(zhǔn)確度不佳問題,本文在特征提取網(wǎng)絡(luò)中融入了SE-Net注意力機(jī)制,使得模型關(guān)注于目標(biāo)區(qū)域的通道信息,同時(shí)增加了一個(gè)目標(biāo)檢測(cè)層使得特征融合能夠結(jié)合不同尺度的特征信息。最后使用CIoU和Soft-NMS改進(jìn)原有的YOLOv5s算法,降低遮擋情況下的目標(biāo)漏檢問題。試驗(yàn)結(jié)果表明,本文所提的方法能夠有效解決泵站復(fù)雜場(chǎng)景下遠(yuǎn)距離和遮擋情況的安全帽檢測(cè)問題,最終mAP達(dá)到了93.5%,后續(xù)將考慮設(shè)計(jì)更加輕量化的模型來提升安全帽的檢測(cè)速度。