基于人體屬性分析的考場行為識別

姚捃, 郭志林, 趙杰

(1.成都理工大學工程技術學院, 樂山 614000; 2.核工業西南物理研究院, 成都 610000)

人體行為識別是人工智能視覺任務的重要技術,在人機交互、智能安防、考場監考、嬰幼兒看護中都有著重要應用。

早期的行為識別基于手工提取特征的方法,利用特征描述符包括軌跡特征、梯度直方圖特征(histogram of oriented gradient, HOG)、光流直方圖特征(histogram of oriented optical flow, HOF)、混合動態紋理特征、光流場特征、人體關節點特征等構建特征空間,進而使用機器學習的方法進行行為的識別。

唐超等[1]提出深度圖像特征(RGB depth map,RDG-D)的人體動作識別方法,首先獲取基于RGB模態信息的梯度直方圖特征、基于深度圖像模態信息的時空興趣點特征和基于關節模態信息的人體關節點位置特征,利用集成決策對三種提取到的特征進行分類,在公開數據集上取得了不錯的效果。

劉帆等[2]改進了一種基于全局特征和局部特征的方法來實現人體行為識別,首先使用背景減法獲得人體運動區域,然后引入方向可控濾波器改進HOG特征以增強局部邊緣信息,同時對加速穩健特征進行聚類獲得詞袋模型;最后將融合后的行為特征輸入支持向量機對行為特征進行分類識別,在UCF Sports等數據集上獲得了先進的性能表現。

張恒鑫等[3]借助OpenPose算法得到人體區域中關節點的二維坐標構建骨架模型,提取基于關節向量的多種動作時空特征,采用KNN(K nearest neighbor)模型進行行為識別,在Weizmann數據集上取得了不錯的效果。

但是,由于視頻場景的復雜性、光線變化、人體遮擋等問題,以上所列舉的手工提取特征的方法嚴重依賴于手工特征提取算子的設置和具體任務的數據集分布,具有一定的局限性,漸漸被深度學習方法所替代,如卷積神經網絡、快慢信息網絡、TSN雙流網絡、3D卷積神經網絡、TSN雙流與長短期記憶網絡(long short term memory,LSTM)結合的混合網絡等。這些網絡利用深度學習強大的特征提取能力,從各個角度提取出行為識別所需要的人體外觀和人體運動的高級時空特征(如光流特征、3D時空特征),能更準確地分辨行為類別。

戎輝等[4]利用卷積神經網絡AlexNet對駕駛員行為狀態進行識別,首先對駕駛員7種駕駛狀態進行了定義,構建了駕駛員狀態信息采集系統,然后利用卷積神經網絡和遷移學習方法進行行為識別,同時達到了理想的準確率與推理速度。齊琦等[5]提出了一種基于改進多通道3D卷積神經網絡結構的人體行為識別方法,同時將圖片的空間信息和時間信息作為卷積神經網絡的輸入進行行為識別,在公開數據集UCF-101上取得了不錯的效果。周鵬等[6]提出一種改進的深度卷積神經網絡模型(dynamic convolution neural network,DCNN),模型中增加了信號融合單元,并提出一種將時間序列轉換成單通道行為圖片進行行為識別的方法,在公開數據集UCI上取得了優于傳統模型的性能。何嘉宇等[7]構建了特征金字塔層次結構以增強網絡檢測不同持續時長的行為片段的能力,在公開數據集上獲得了先進的識別性能。文獻[8-12]利用LSTM長短記憶網絡對于時序數據特有的敏感性,對數據之間的聯系進行有選擇的記憶與遺忘,僅保留對識別結果有益的數據,達到了良好的識別率。Ayed等[13]利用深度卷積神經網絡在提取出面部姿勢、面部特征和感覺特征基礎上進行了行為識別,在CK+(the extended Cohn-Kanade dataset)數據集上取得了不錯效果。Fuentes等[14]提出了一種基于深度學習的時空信息分層牛行為識別方法,在有效提取外觀特征、時空信息和上下文時間特征基礎上進行了牛行為識別,成功檢測出15種不同類型的分級活動。Ma等[15]在RexNet基礎上加入時序信息,進行了擴展網絡的3D算法改進,最終在公開數據集上獲得了91.02%的準確率和101.02 f/s的每秒識別幀數。

以上一些基于深度學習提取時空特征的行為識別算法存在著硬件需求過高、時效性不足、復雜場景準確率偏低等問題。在很多應用場景下不能實現實時識別,是這些行為識別算法并未得到有效應用的主要原因。因此有研究者提出利用深度學習模型中多種類輸出頭的特性,在實際應用中以構建精準的行為類別數據集為基礎進行行為識別,以期達到或超越傳統機器學習和基于時空特征的深度學習算法的效果。

董琪琪等[16]利用SSD(single shot multiBox detector)算法,在建立聽講、睡覺、舉手、回答及寫字5種學生行為狀態數據集基礎上進行了行為識別, 達到了95.4%的平均精度。王昊飛等[17]提出了一種基于注意力機制的ResNeXt模型進行行為識別,將注意力機制嵌入ResNeXt網絡中,在UCF101和HMDB51數據集上分別進行實驗,得到了95.2%和65.6%的準確率。葉黎偉等[18]利用YOLOv5網絡結合GCT(gated channel transformation)模式利用采集的課堂視頻數據進行了10類課堂行為的識別。竇剛等[19]利用經典的端到端網絡YOLOv3,在沒有提取時序信息基礎上,通過改進的網絡進行了考場異常行為識別,解決了推理速度過慢的問題。陳亞晨等[20]基于改進的YOLOv3網絡通過去除部分輸出檢測模塊、增加淺層網絡的層數以及采用K-means聚類算法選取初始先驗框等策略進行了眼行為的識別,達到了91.3%的識別準確率。

以上研究雖然解決了特定場景中行為識別推理速度的問題,然而存在以下問題:①不能同時識別多種行為;②沒有利用大型數據集進行遷移學習,在其他問題上擴展性不足。基于此,現提出基于人體屬性分析的考場行為識別算法,利用考場特殊場景的優勢,在沒有光照變化、場景單一、人體上半部沒有明顯遮擋情況下,采集高清視頻圖像,進而利用視頻處理設備解幀輸入深度神經網絡,進行快速的人體檢測與人體屬性分析,再根據屬性分析結果進行行為判別。算法采用多標簽學習機制可以同時識別出多種行為類別;檢測網絡優化為單一anchor box,進一步提升了推理速度;使用了大型公開數據集進行預訓練,只需稍做更改就可以擴展到其他行為識別任務。提出的算法經過實驗驗證,具有良好的擴展性、高效性和準確率。

1 方法

人體檢測和人體屬性分析從本質上講都涉及分類與定位算法,因此采用了效率與性能并重的YOLOv3來實現。YOLOv4和YOLOv5雖然是在YOLOv3基礎上進一步改進,但都是在細枝末節上進行的優化,反而丟失了YOLOv3在工業界的普遍適用性。所以總體思路是將人體檢測與屬性分析作為YOLOv3網絡的并行化任務,并對輸出向量加以修正。

1.1 數據準備

在數據準備階段,需要采集本地視頻數據集,篩選出視頻數據中典型的正常行為與違規行為,然后對視頻幀進行標注。其中紙條、手機、書本等應歸為人體攜帶屬性;而扭頭、斜視、說話、埋頭等作為人體行為屬性。由于人體檢測與屬性分析由統一的網絡完成,所以需要對數據進行整體標注,考場主要行為數據判定如表1所示。

標注應符合多標簽學習模式,采用與行人屬性分析的WIDER數據集相同的json格式,需要標注出人體目標的bbox及所攜帶屬性。bbox由4個坐標給定,屬性由屬性向量給定。

結合表1給出屬性對照及單個目標標注(紙條)示例如下:

{′attribute_id_map′:

{′0′: ′note′,

′1′: ′phone′,

′2′: ′book′,

′3′: ′turn′,

′4′: ′strabismus′,

′5′: ′speak′,

′6′: ′bury′,

′7′: ′probe′}

{′attribute′: [1, -1, -1, -1, -1, -1, -1, -1],

′bbox′: [565.398773006135,

370.6503067484663,

76.95705521472392,

238.7239263803681]}

}

最后經過數據預處理,進行了數據集的標簽可視化,如圖1所示。

1.2 模型訓練

訓練階段,神經網絡模型主要采用了以特征金字塔和Darknet53相結合作為backbone的YOLOv3算法,并基于考場監考的任務特點在YOLOv3網絡結構基礎上進行了如下改善。

(1)設定1個anchor box,只有檢測到人體目標時人體附屬的屬性信息才有判定的價值,同時考慮到坐姿下人體目標大小基本一致,因此YOLOv3只需要1個anchor box來檢測人體目標類別,極大地提升了檢測效率。

(2)修改任務輸出,將YOLOv3輸出的80個類別的分類置信度向量改為本任務所需的人體屬性分析向量,每個人體目標框后攜帶8個屬性的置信度(紙條,手機,書本,扭頭,斜視,說話,埋頭,探頭),改善后的輸出與YOLOv3輸出對比如圖2所示。

(3)加入注意力機制,基于考場人員坐姿特點,加入注意力機制模塊(convolutional block attention module,CBAM),對于給定的中間特征圖,CBAM按順序推導出沿通道和空間兩個獨立維度的注意力圖,然后將注意圖相乘到輸入特征圖進行自適應特征細化。通道注意力聚焦在“什么”是有意義的輸入圖像,為了有效計算通道注意力,需要對輸入特征圖的空間維度進行壓縮,對于空間信息的聚合,常用的方法是平均池化。空間注意力聚焦在“哪里”是最具信息量的部分,這是對通道注意力的補充。為了計算空間注意力,沿著通道軸應用平均池化和最大池化操作,然后將它們連接起來生成一個有效的特征描述符,如圖3所示。

CBAM可以無縫集成到任何CNN架構中,開銷可以忽略不計,并且可以與基礎CNN一起進行端到端訓練。對于考場特殊環境下的考試人員,與違規行為有關的屬性(如書本、扭頭)往往集中在上半身區域,因此加入CBAM模塊,尤其是CBAM中的空間注意力圖將有效地提升目標檢測與屬性分析的準確率,在殘差網絡中加入CBAM模塊后如圖4所示。

L=Lt+Lc+La

(1)

(2)

(3)

(1-yijk)ln(1-pijk)

(4)

(5)進行預訓練,本地采集視頻數據非常耗時,為了提高人體屬性分析最后的準確率,需要利用主流數據集的預訓練模型來初始化網絡參數。結合考場任務的需求,最終選擇了WIDER數據集,WIDER數據集一共包含13 789張圖像,共57 524個行人邊界框,并且為每個行人標注了14種屬性,每種屬性包含存在、不存在兩種情況。WIDER數據集與其他數據集對比如表2所示。

表2 行人屬性識別數據集Table 2 Pedestrian attributes recognition data set

模型預訓練使用標準的YOLOv3網絡,將輸出網絡屬性向量修改為WIDER數據集所需的14個2值屬性向量,并在每一個殘差塊后添加一個CBAM模塊,以準確高效的提取人體上半身屬性信息。

預訓練完成后初始化YOLOv3網絡,輸出修改為任務所需的1個anchor box并攜帶8個2值屬性向量,在本地數據集上進行再次訓練,獲得最終模型。

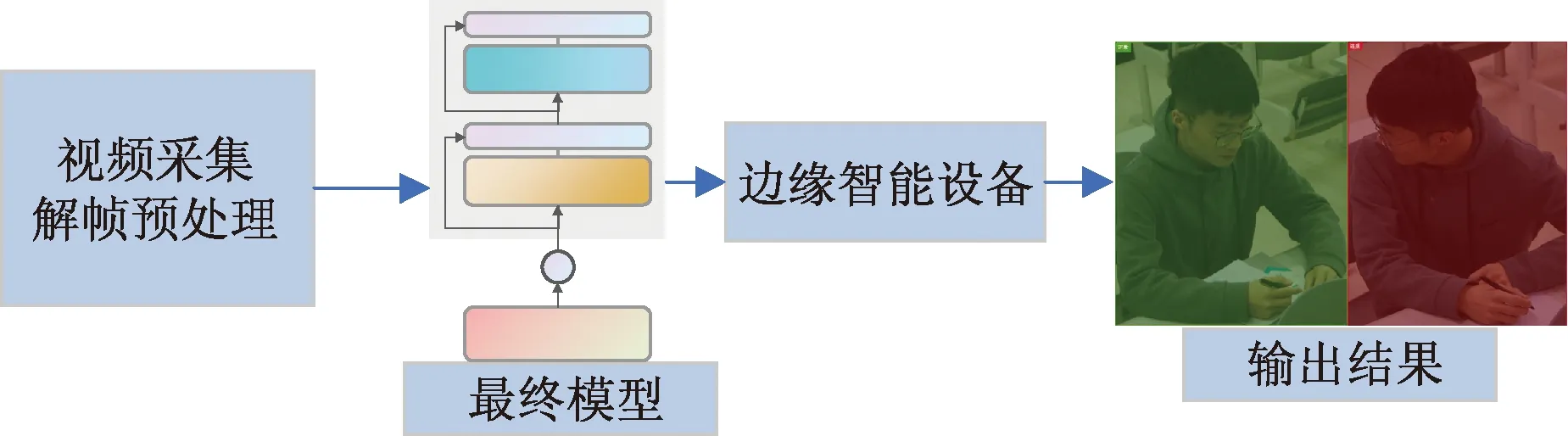

1.3 模型部署

模型運行階段,利用部署在考場的高清攝像頭采集視頻數據流,并接入到視頻處理設備。視頻處理設備主要進行視頻解幀與幀圖像預處理,以符合神經網絡數據輸入。

將模型導入考場邊緣設備中,視頻處理設備的輸出視頻幀作為輸入數據,邊緣設備同時輸出所有考場人員目標檢測框和屬性分析值,并根據屬性分析值的結果作出實時的考場行為判斷,整體部署如圖5所示。

圖5 整體部署Fig.5 Overall deployment

2 實驗

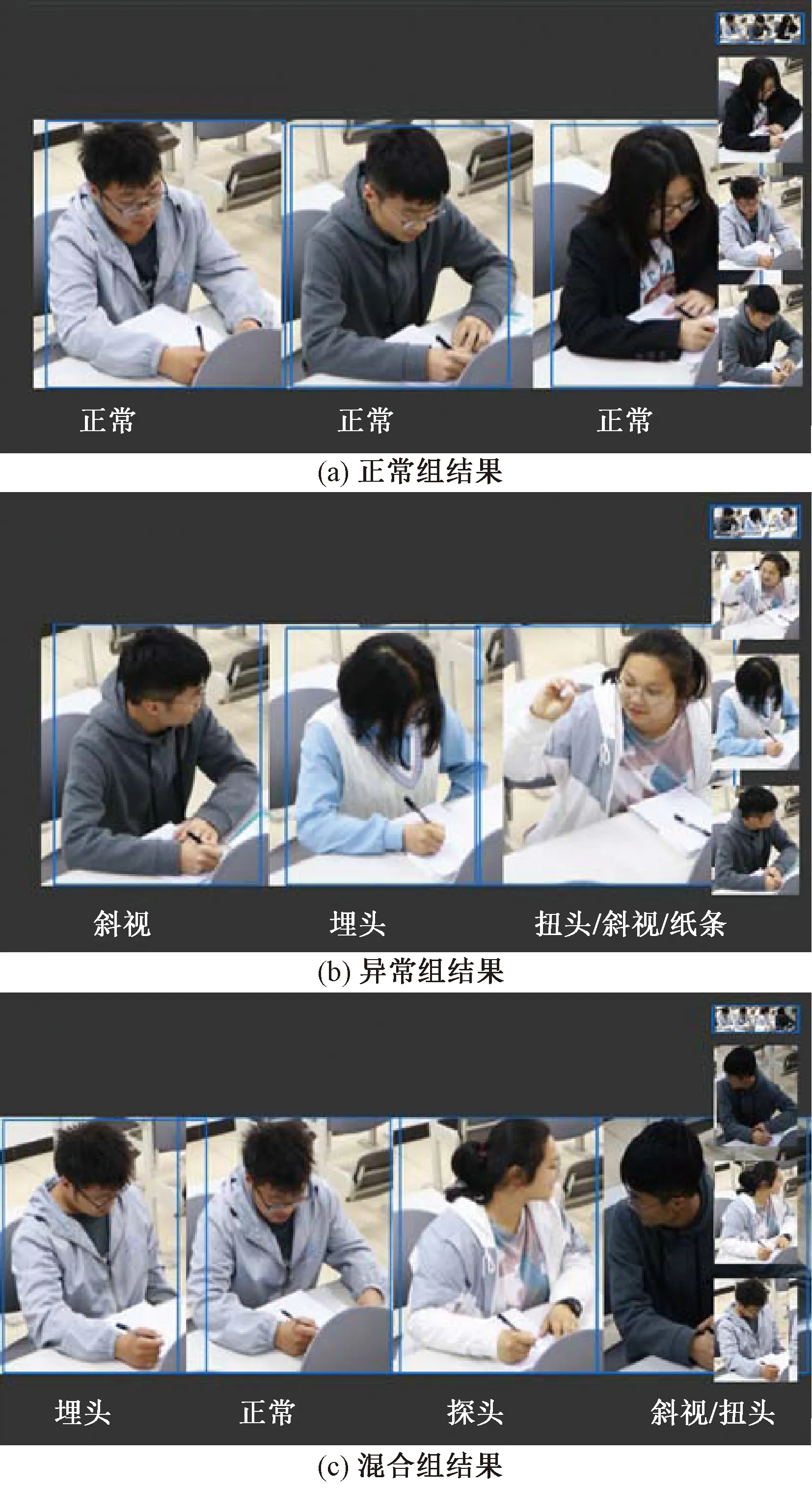

利用攝像頭和視頻處理設備將視頻采集解幀后輸入邊緣智能設備,分三組分別檢驗正常考場行為、各種違規行為、正常與違規行為。實驗運行部分結果如圖6所示,可以發現,只有當所有人體屬性值均未檢出才會判定為正常行為;如果檢測出1條或多條屬性,將判定為違規行為。

圖6 模型實驗結果Fig.6 Experimental results of ours

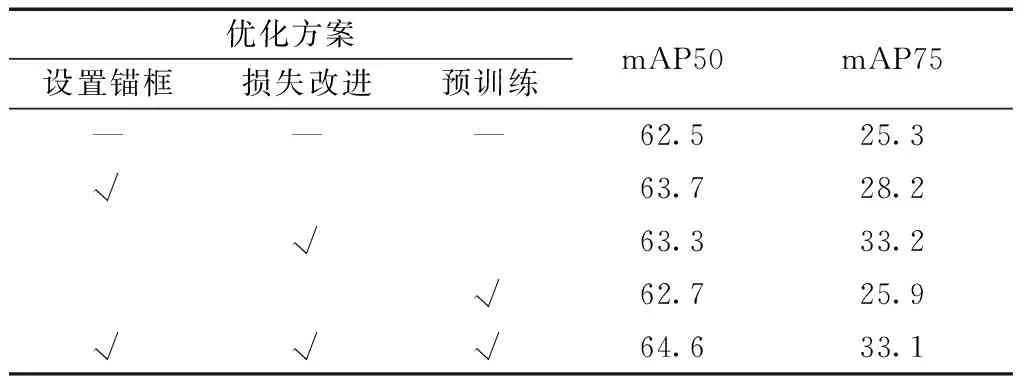

為了驗證模型改善方案對最后本實驗改進的YOLOv3模型結果的影響大小,并確定最終采取的措施,在WIDER數據集上進行了anchor、損失函數、預訓練三種改進方案的消融實驗,評價指標采用mAP(mean average precision),分別以mAP50和mAP75以度量在WIDER數據集14個屬性上平均性能,實驗結果分析如表3所示。

實驗結果發現,三種措施對于mAP50和mAP75指標都有一定提升,且設置anchor提升效果最為明顯。

原因為:①唯一確定的anchor能夠使得網絡對數據集上的預測框擁有一個正確的先驗認識,使得邊界框的預測更加容易,參數學習更加輕松,從而提升檢測效果與效率;②損失函數的改進能夠讓模型學習到更好的坐標回歸參數,使得模型預測的坐標位置更加準確,進而最終提升屬性檢測準確率。

表3 消融實驗mAPTable 3 Ablation study mAP

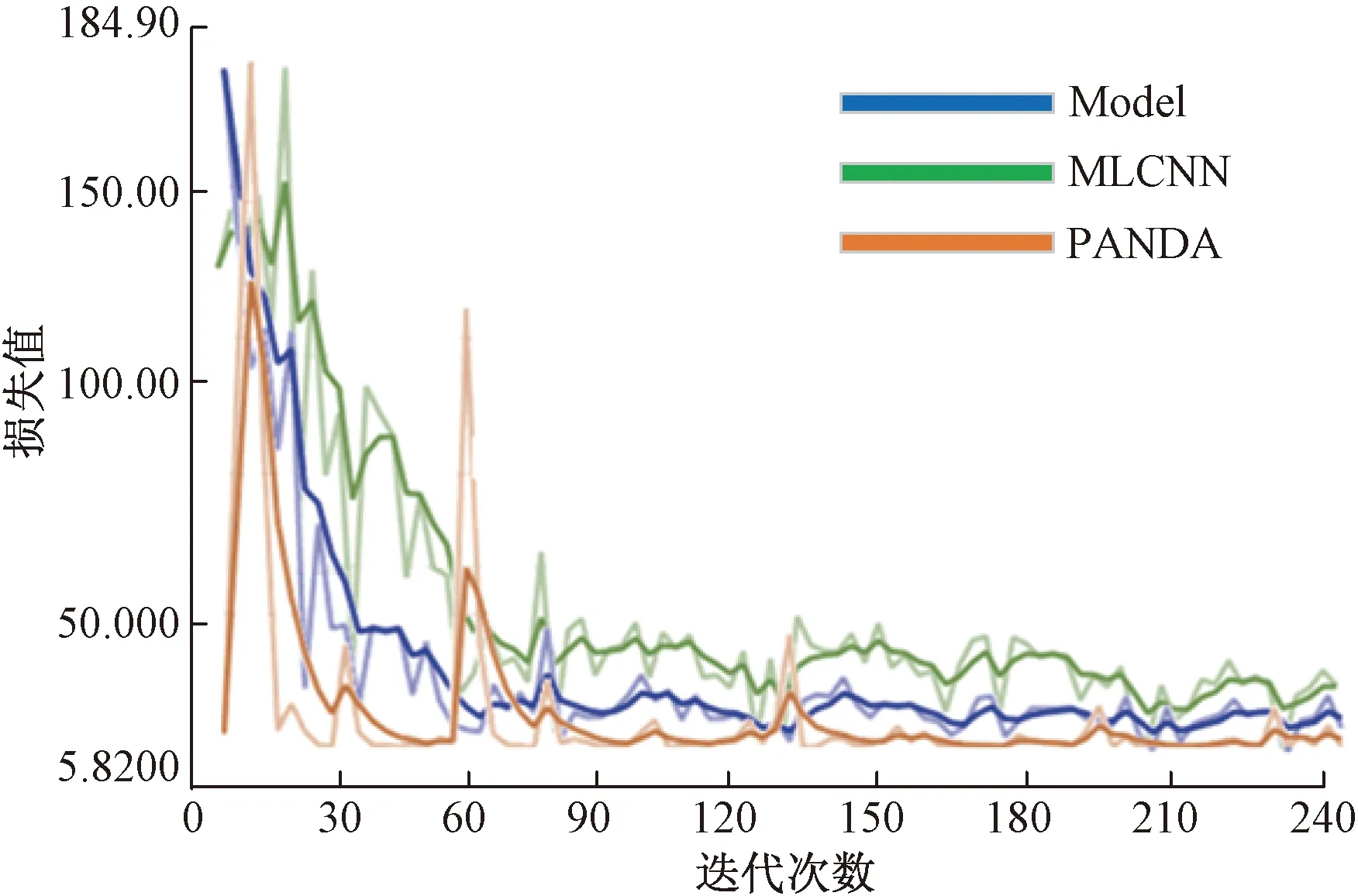

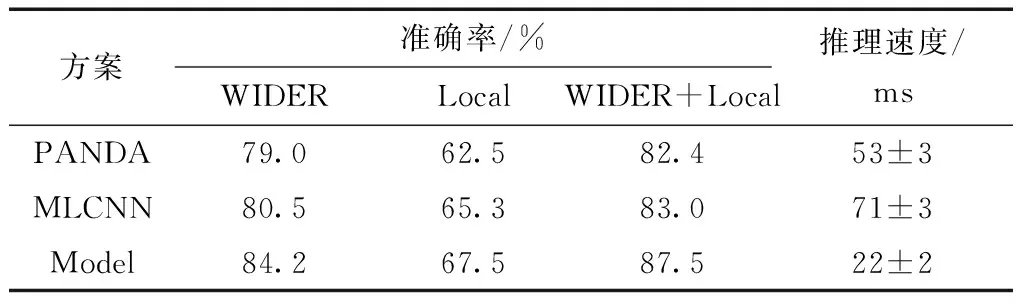

為了分析模型在實際監控中對比傳統方案的效率與準確性提升程度,利用WIDER數據集、本地采集數據集、WINDER+本地數據集三種數據組合分別測試傳統行人屬性識別算法PANDA、MLCNN和本實驗改進的YOLOv3模型(簡稱Model)表現。

三種方案都需要進行預訓練和遷移學習,才能在實際的考場視頻上進行屬性分析和行為判別,模型訓練過程對比如圖7所示。

可以發現Model相比MLCNN和PANDA,模型具有優良的訓練曲線,曲線在中前段就很快收斂到低值,中后段也更加平穩,反映出模型泛化推理階段具有更好的魯棒性。

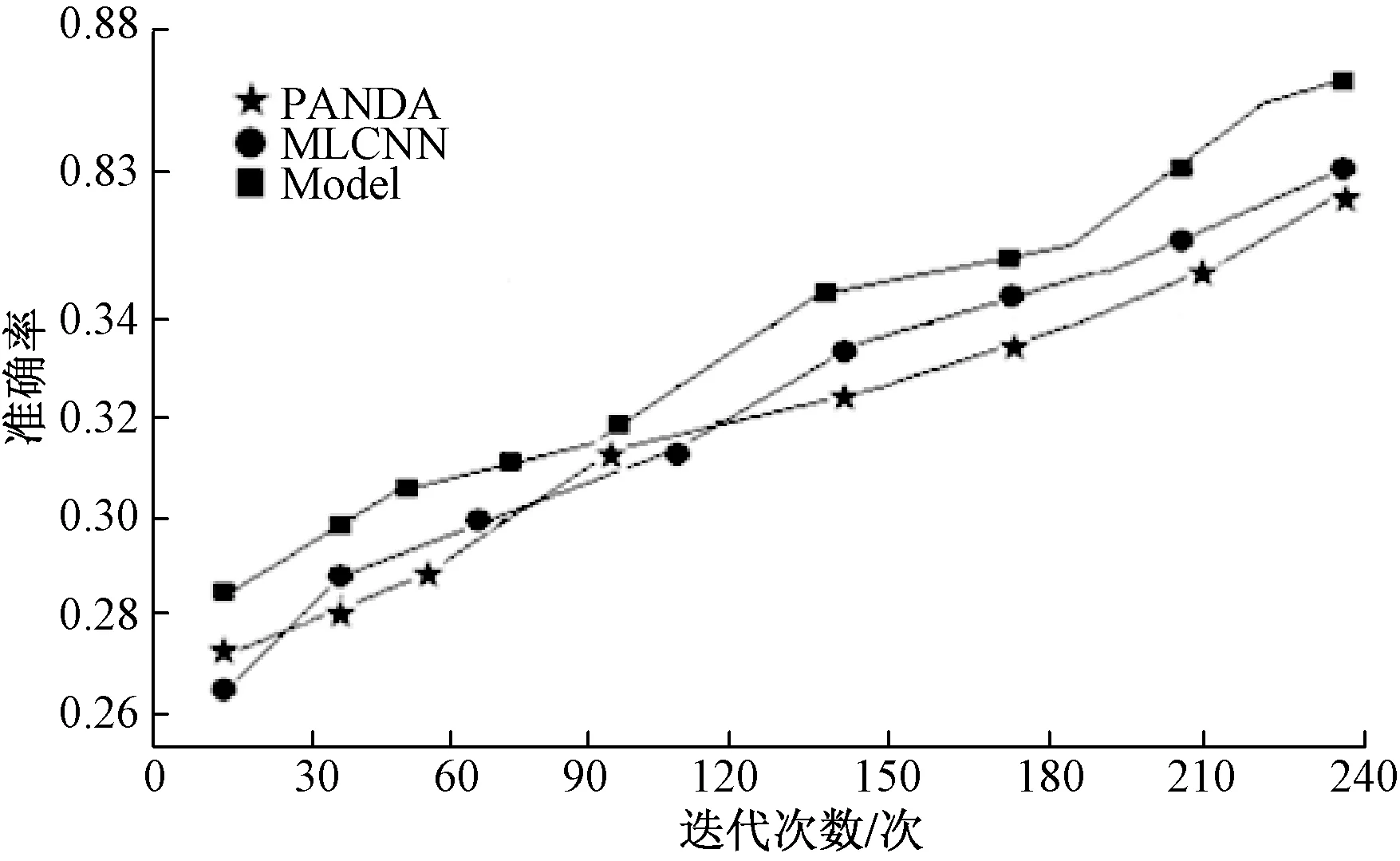

三種方案學習過程的準確率對比如圖8所示。

從準確率上對比可以發現Model相比PANDA和MLCNN,學習曲線在后半段趨于平滑穩定,也具有更高的性能指標,更符合實際考場應用需求。

將三種方案部署于考場,并對考場行為視頻長時運行進行匯總和分析,評價指標采用行人屬性識別常用的mA(mean accuracy),mA計算公式為

(5)

分析結果如表4所示。由表4可知,模型準確率與推理速度相對于傳統屬性分析算法具備一定優勢,原因為:①YOLOv3集成了SSD多尺度預測、全卷積(fully convolutional networks,FCN)、特征金字塔(feature pyramid networks,FPN)、DenseNet特征復用等多種特性,具有工業部署的優勢;②改進的網絡中加入了CBAM注意力模塊,在預訓練階段能很好地提取到人體上半身局部屬性信息;③由于本地數據集采集自室內環境,場景單一,沒有明顯遮擋,簡化了anchor box與屬性向量等因素,使得WIDER+Local的遷移學習方案獲得了三種算法上的最佳效果。

圖7 模型訓練過程對比Fig.7 Comparison of training process

圖8 三種模型學習過程對比Fig.8 Comparison of learning process of three models

表4 準確率mA和推理速度分析Table 4 Analysis of accuracy mA and reasoning speed

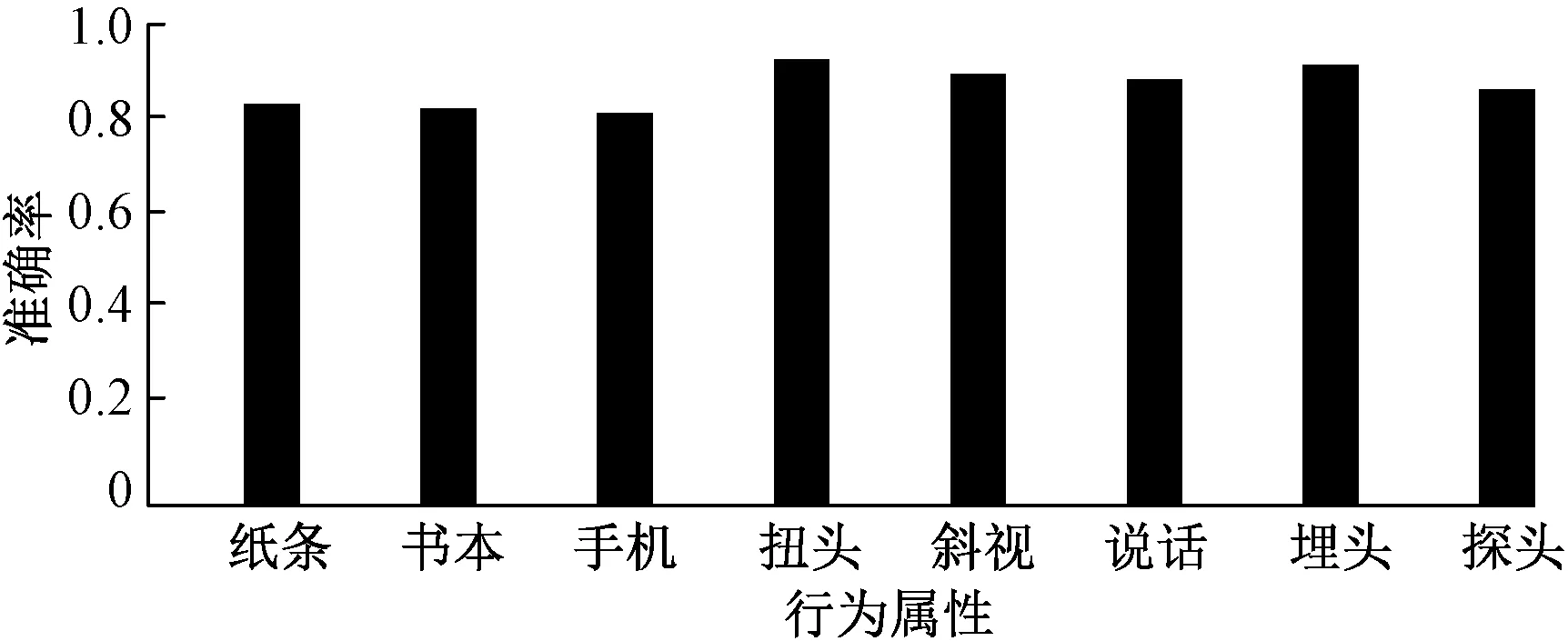

對各屬性預測準確率的進一步分析可以發現,由于加入了通道注意力和空間注意力機制,在WIDER數據集上可以提取到非常良好的人體上半身局部屬性特征。而書本、紙條、手機等屬性因為預訓練數據集沒有相關樣本而本地采集樣本又較少,因此最終扭頭、斜視、說話、埋頭、探頭等與人體局部特征相關屬性上表現明顯好于其他非人體局部特征相關屬性;同時紙條屬性又屬于小目標,相較于書本和手機的檢測精度更低,所有屬性最終檢測準確率如圖9所示。

圖9 各屬性檢測準確率對比Fig.9 Comparison of accuracy of attributes

3 結論

雖然行人屬性識別領域由于問題場景的復雜性、拍攝角度不同、相同屬性類內差異巨大、光線變化、類內和類間遮擋等問題而仍然存在很大的挑戰。但是在實際的考場監控場景中,由于攝像頭角度固定、室內無明顯光學變化、檢測的目標單一、類內無遮擋等天然的優勢,使得利用YOLOv3改進后的模型能較好地同時執行人體檢測和人體屬性分析任務。

基于人體屬性分析的考場行為識別也具有不可避免的缺陷:①由于問題的特殊性,需要對本地采集數據進行精心的標注;②由于本地數據集采集數量有限,無法勝任實際應用,需要借助大型人體屬性數據集的預訓練參數;③人體屬性分析屬于靜態幀的行為識別方法,沒有加入時序信息,在一些情況下會造成錯誤的判定,如彎腰撿東西、舉手提問等。

鑒于此,應根據需要加入人工復核機制,或增加檢測屬性,或增加視頻采集時長,而這些措施無疑都增加了算法的復雜性與操作的難度。