一種基于AlexNet遷移學習模型的空間目標ISAR像識別方法

許益喬,楊 虹,張占月,張 剛

(1.航天工程大學,北京 101416; 2.北京遙感信息研究所,北京 100192;3.北京跟蹤與通信技術研究所, 北京 100094)

1 引言

逆合成孔徑雷達(ISAR)是一種全天時、全天候、遠距離、高分辨的二維成像設備,在民用以及軍事領域中占有重要的地位。ISAR通過發射大寬帶信號對目標進行高分辨成像,可以精確地描述目標的結構特性以及散射中心分布,與傳統的雷達散射截面積(RCS)、高分辨距離像(HRRP)、微多普勒譜圖(MD)等相比,能夠提供更加豐富的目標結構信息。因此,利用二維ISAR像進行空間目標識別一直是空間態勢感知領域的研究熱點。

現階段,利用空間目標二維ISAR像進行空間目標識別主要依靠人工提取特征,然后使用分類器實現分類。其中,文獻[15]探索了二維傅里葉變換與極坐標映射技術(FT-PM)在空中目標ISAR像分類中的應用;文獻[16]提出利用Trace變換提取空中目標ISAR像的小維度高判別性特征進行分類;文獻[13]將尺度不變特征變換(SIFT)和顯著特征組合在一起,對雷達圖像進行分類;文獻[17]利用多流行正則化低秩近似(MLA)方法獲取SAR圖像的低維表示,以實現對SAR目標的分類識別。盡管傳統方法能夠實現空間目標識別,但是過程復雜,耗費大量的時間與精力,且時效性差。為了實現空間目標識別的自動化,最近,深度學習(DL)在計算機視覺領域引起了人們的廣泛關注。與手動提取特征方法相比,深度學習算法憑借多層的網絡結構,具有自動學習深層模態特征、獲取較高分類準確率等優勢。例如,文獻[23]設計了一個包含2層卷積層、2層全連接層的CNN網絡架構。該模型能在不同場景下從非貨船目標和海雜波中提取貨船目標,取得了很好的分類結果。此外,文獻[24]提出一種全卷積神經網絡(FCNN),當利用該網絡對MSTAR數據中的10類目標進行分類時,識別率達到99.13%。但受空間目標過境時間短、成像過程復雜、以及標注需要專業人員等限制,空間ISAR像數據缺乏,導致現有的深度學習工具直接應用于空間目標ISAR圖像領域會出現訓練困難、難以實施等現象。

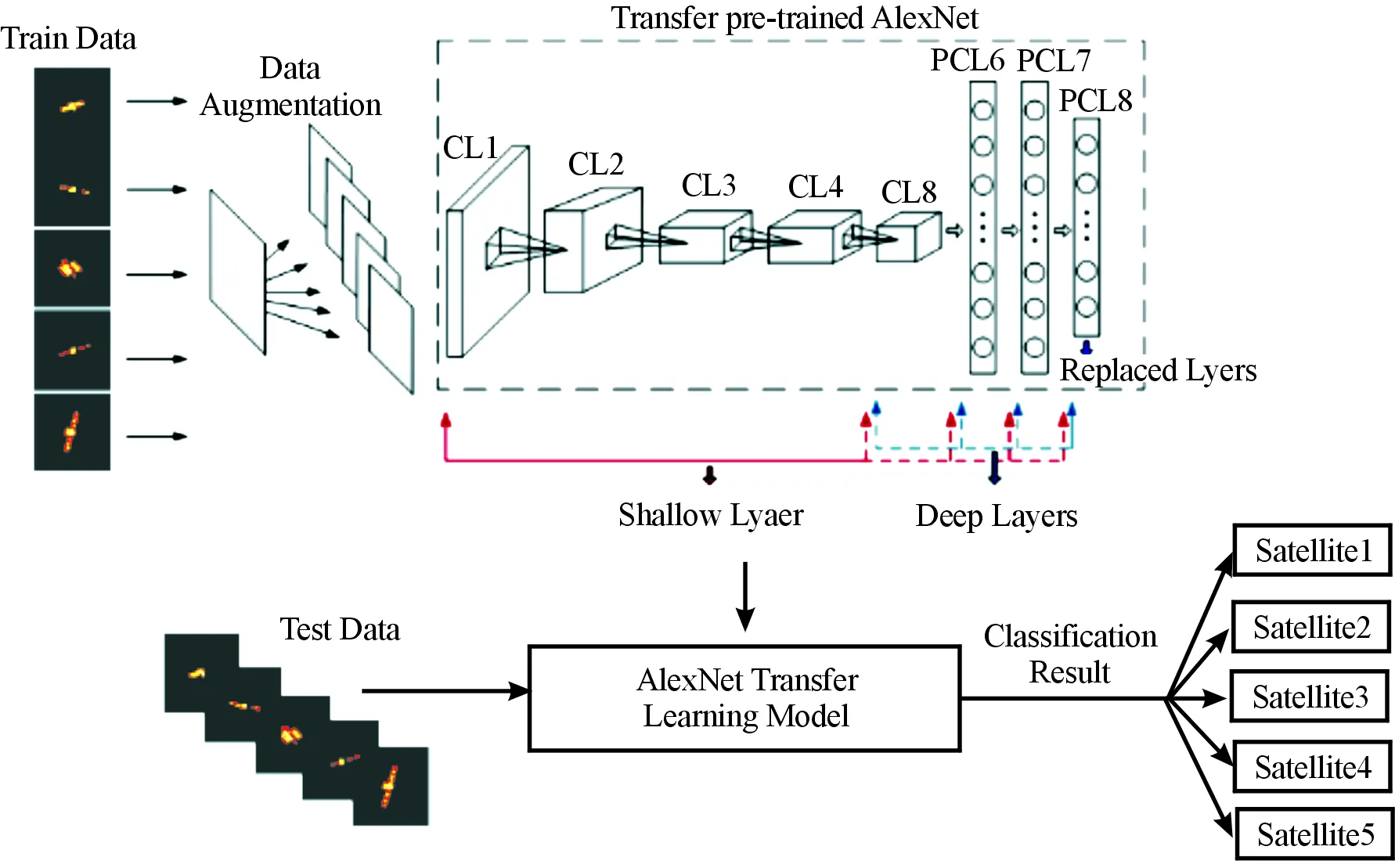

面對上述問題,遷移學習(TL)提供了一種新的解決思路。它將已學到的知識遷移到僅有少量目標數據的分類任務中,以解決不同相關領域的問題。鑒于此,本文首次提出了小樣本集條件下基于遷移學習模型的空間目標ISAR像識別方法,首先通過角度旋轉、方位向距離向尺度變換、斑點噪聲注入等方式對空間目標ISAR像訓練數據進行增強,使訓練集涵蓋更多空間分布情況,提升模型泛化性;然后利用遷移學習,將預先預訓練好的AlexNet模型在該數據集上進行重新訓練,完成網絡權值的微調,解決深度神經網絡模型在小樣本情況下的訓練過擬合問題;最后研究4種遷移配置下AlexNet遷移學習模型的分類性能,并與傳統分類方法進行對比,進一步驗證本文所提方法的有效性。

2 基于遷移學習的ISAR像空間目標識別方法

2.1 基于遷移學習的AlexNet網絡模型

通常在遷移AlexNet預訓練模型時有以下2種策略:一是直接將AlexNet模型作為一個固定的特征提取器,即刪除AlexNet模型的最后一個全連接層,將AlexNet模型中的其余部分作為空間目標ISAR像數據集的固定特征提取器,利用所提特征訓練一個分類器從而實現模型遷移;二是對AlexNet預訓練模型進行權值微調,在替換掉AlexNet模型中的最后一個全連接層(FCL)后,將空間目標ISAR像數據集作為新的輸入,通過反向傳播方式對AlexNet模型的權值進行微調,從而實現模型遷移。

對于第1種遷移策略,只有當新數據集與訓練AlexNet的原始數據集具有十分相似的特征時,該遷移策略才較為合適。但是AlexNet的預訓練是在ImageNet上進行的,主要為光學圖像,與雷達圖像具有較大區別,且大部分訓練目標與空間目標具有十分不同的特征。因此在空間目標ISAR像的分類問題上,并不適合使用該策略來遷移AlexNet預訓練模型。

因此本文選取第2種權值微調策略對AlexNet預訓練模型進行遷移。本文所提出的基于遷移學習的AlexNet網絡模型的算法流程如圖1所示,其中CL1~CL5為卷積層,FCL6~FCL8是全連接層。模型的圖像輸入大小為227×227,輸出為空間目標類別。

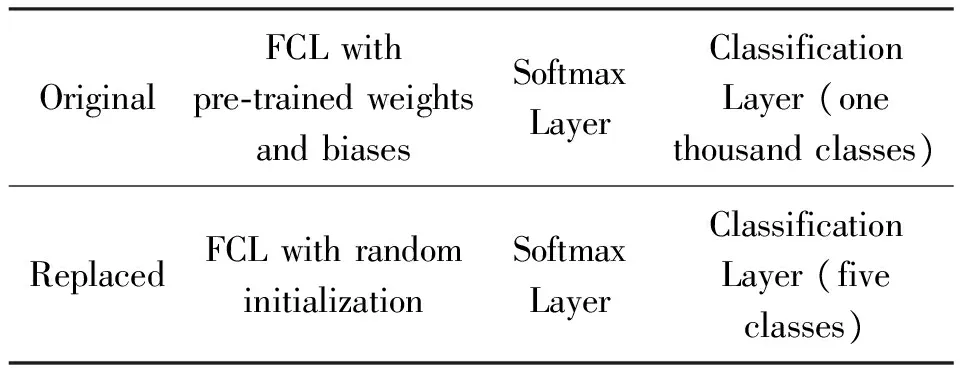

在對AlexNet模型進行遷移學習時使用微調AlexNet預訓練模型的策略,即修改AlexNet的FCL8的輸出,由輸出1000維修改為5維。修改的FCL8的參數如表1所示。

圖1 本文整體算法流程圖

表1 替換AlexNet的最后一個FCL

表1中,Softmax層使用的激活函數為softmax。softmax函數是二分類Logistic回歸模型在多分類問題上的擴展,有多少個分類softmax函數的輸出層,則擁有多少個單元。在softmax函數作用下每個神經單元都會計算出當前樣本屬于本類的概率。其表達式為:

(1)

式(1)中:,,,…,表示權重;,,,…,表示偏置;表示神經元的輸出;表示類別數,本文中=5。

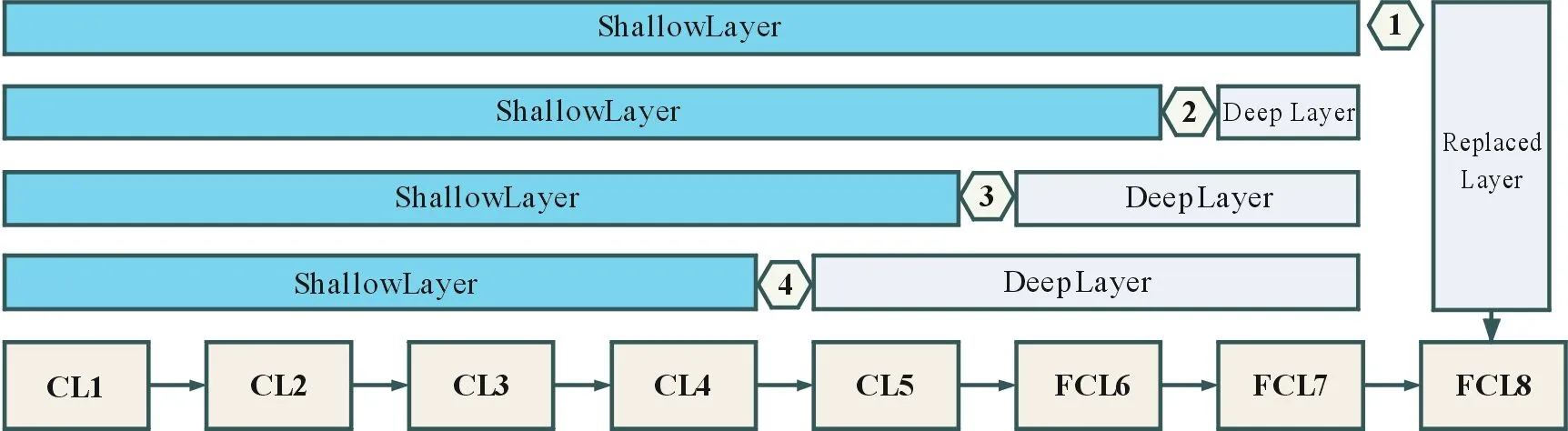

為更好改善網絡識別性能,對AlexNet預訓練模型的深、淺層權值設置不同的學習遷移模型訓練,即將AlexNet的淺、深層結構的學習率分別設置為10和10。劃分AlexNet預訓練模型深淺層有以下4種方式:遷移配置1,[(CL1,CL2,CL3,CL4,CL5,FCL6,FCL7),()];遷移配置2,[(CL1,CL2,CL3,CL4,CL5,FCL6),(FCL7)];遷移配置3,[(CL1,CL2,CL3,CL4,CL5),(FCL6,FCL7)];遷移配置4,[(CL1,CL2,CL3,CL4),(CL5,FCL6,FCL7)]。以遷移配置4為例進行說明,其中(CL1,CL2,CL3,CL4)表示將AlexNet預訓練模型的CL1,CL2,CL3,CL4作為淺層,初始權值與AlexNet預訓練模型的權值保持一致,選取學習率為10;(CL5,FCL6,FCL7)表示將AlexNet預訓練模型的CL5,FCL6,FCL7作為深層,初始權值與AlexNet預訓練模型的權值保持一致,選取學習率為10。其他遷移設置依此類推,4種遷移配置方式如圖2所示。

圖2 4種遷移配置方式示意圖

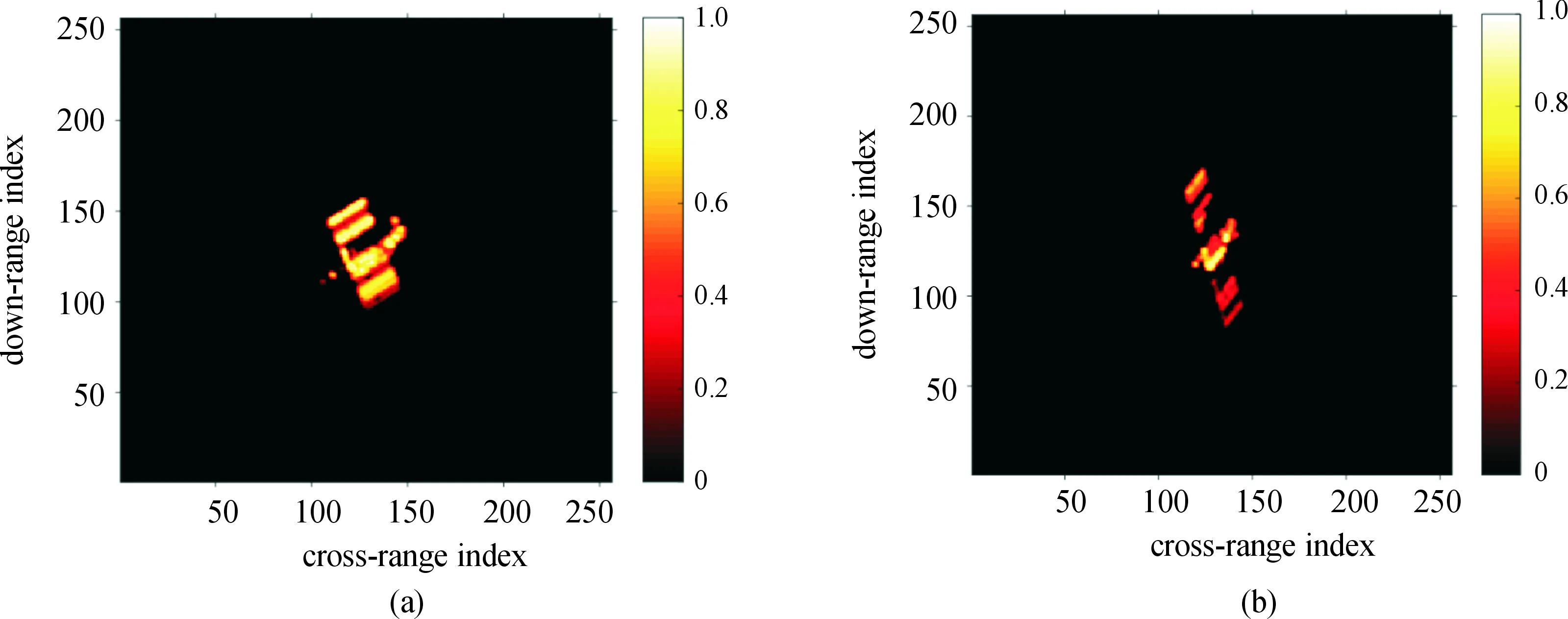

2.2 ISAR成像模型

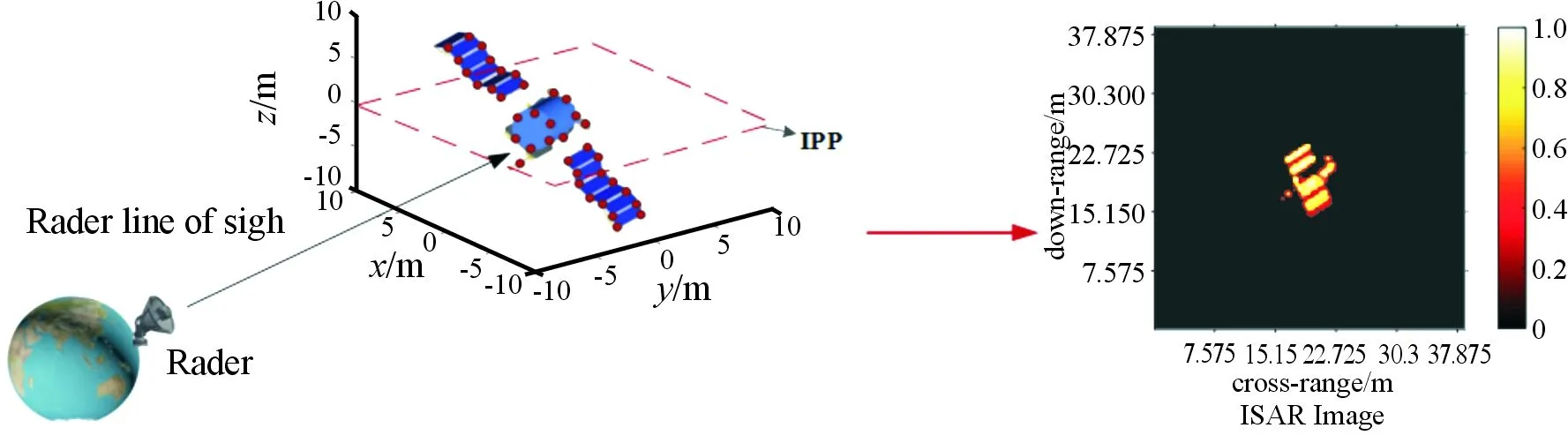

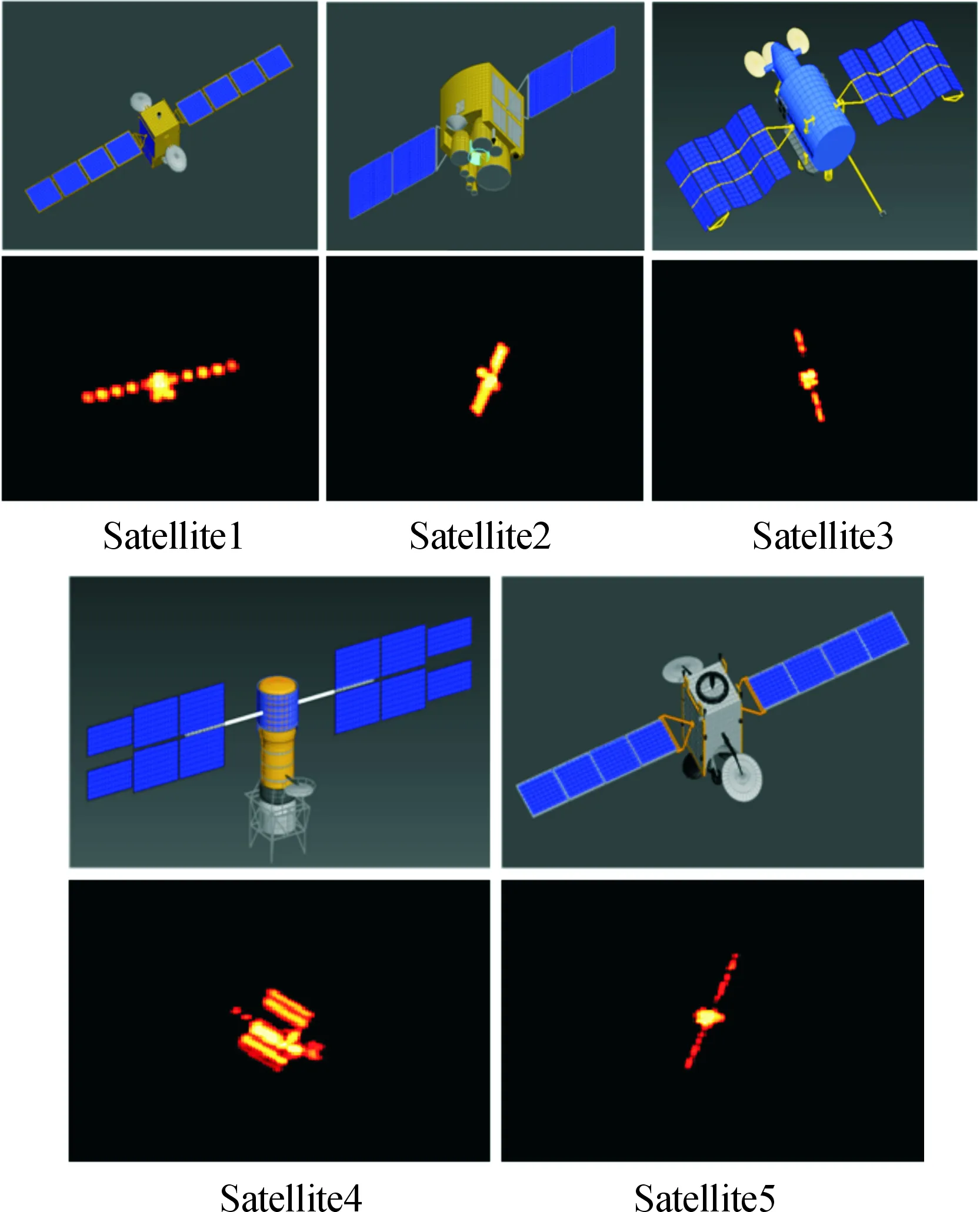

空間目標ISAR像是空間目標的高能散射中心在二維平面上的分布。ISAR成像系統根據空間目標的電磁散射特性,將空間目標中的組成部分(如太陽能帆板、天線、本體等部位)映射到一個二維的圖像投影平面(IPP)上,從而獲得空間目標的ISAR像,ISAR的成像示意圖如圖3。通過圖3的成像模型,利用空間目標的三維模型,生成5類空間目標,部分樣例如圖4所示。

圖3 空間目標ISAR像獲取示意圖

圖4 5類空間目標的三維模型及其ISAR像

2.3 數據增強

為了確定選用何種數據增強方式,接下來首先分析影響空間目標ISAR像的各種因素。

2.3.1 圖像投影平面(IPP)的影響

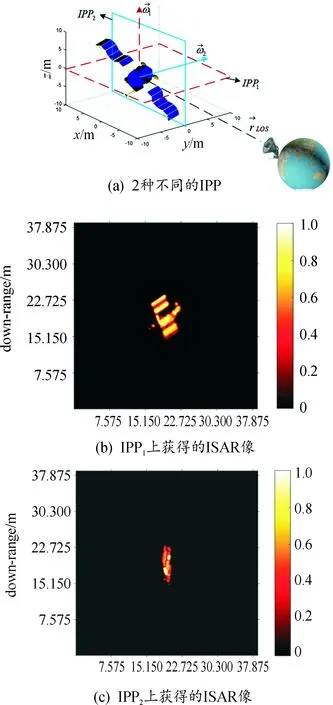

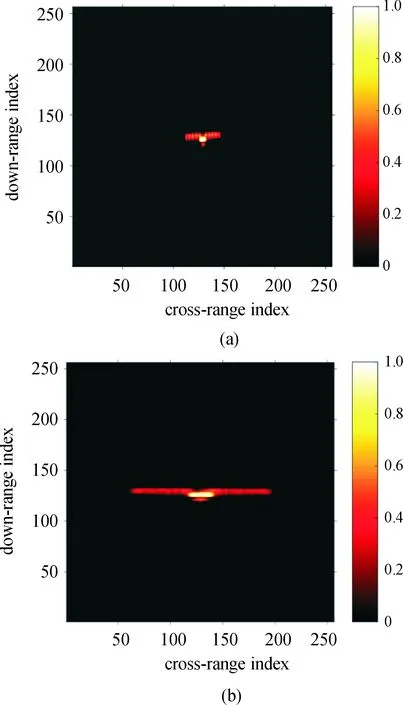

IPP決定了空間目標在ISAR圖像中的呈現形式。IPP的確定取決于相干處理間隔(CPI)內雷達視線(RLOS)方向和空間目標相對于雷達的轉動矢量方向。因此受目標運動狀態影響,實際成像過程中存在多種IPP,導致空間目標ISAR像的空間分布以及空間指向出現可變性。圖5展示了2種不同IPP及其對應的ISAR像。

圖5 2種不同IPP及其對應的ISAR像

2.3.2 方位向分辨率的影響

Δ=2

Δ=2

(2)

圖6 具有不同方位分辨率Δy的2張ISAR像

2.3.3 采樣率的影響

線性調頻信號是雷達系統中經常使用的信號。當雷達系統對接收到來自目標的線性調頻信號進行ISAR成像處理時,首先需要利用A/D轉換器對信號進行采樣,然后再對信號進行匹配濾波,平動補償以及方位向上的快速傅里葉變換。其中,A/D采樣率是影響ISAR像的重要因素,因為決定了距離像在匹配濾波后的網格間距2,從而導致ISAR像在距離向上的空間分布具有可變性。圖7展示了2種不同采樣率對應的ISAR像。

2.3.4 其他因素的影響

由于目標的RCS對方位角的依賴性較強,使得自遮擋、非線性散射機制以及調制引起的載頻變化等因素將進一步增強ISAR像的可變性。此外,不完全地平移運動補償(TMC)引起的ISAR像散焦與模糊也會影響ISAR像的空間分布。

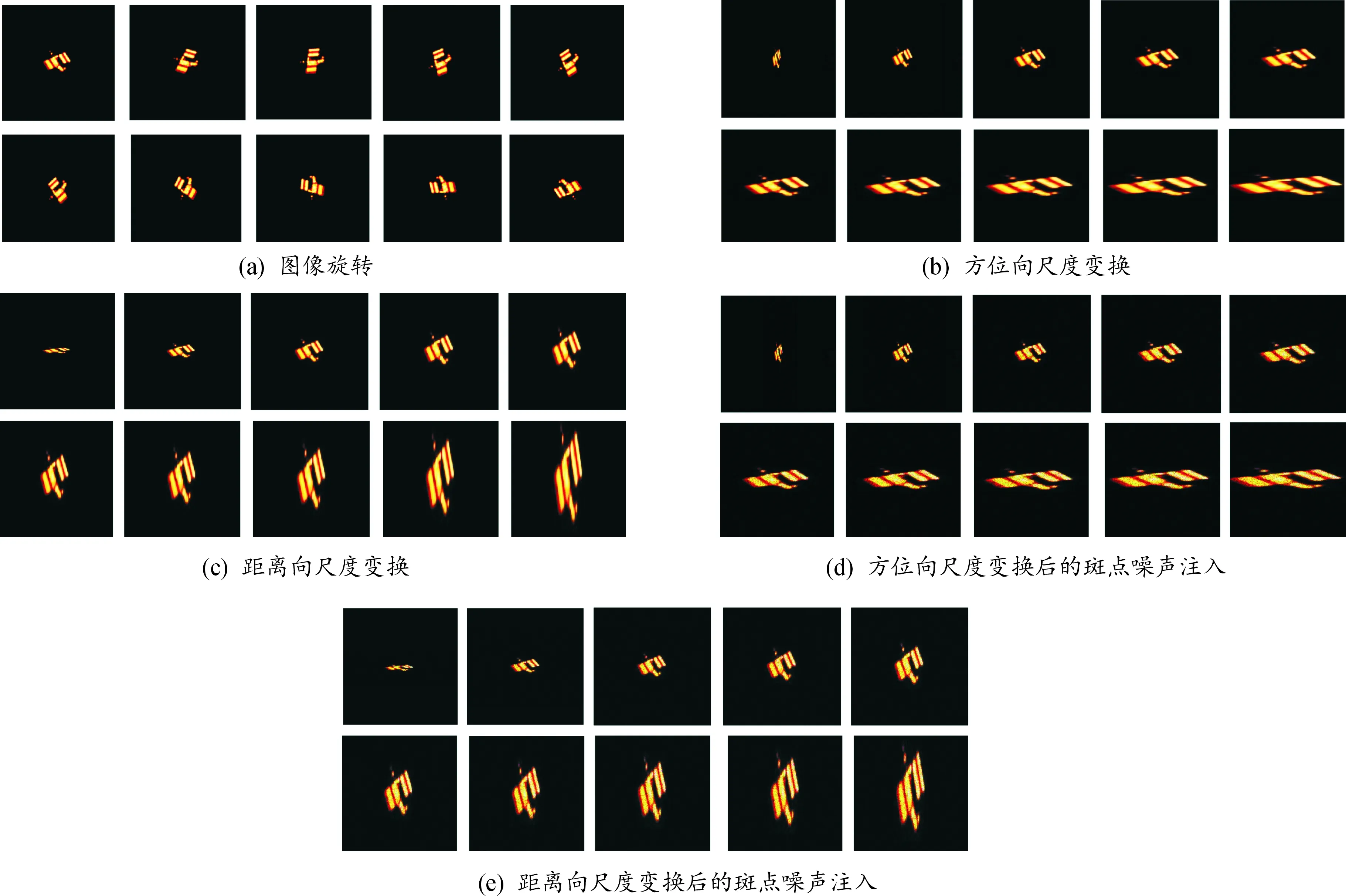

通過上述分析,最終對ISAR像采用的數據增強方式主要包括:角度旋轉、方位向與距離向上的尺度變換以及斑點噪聲注入。具體為:① 旋轉,從-90°開始,每次旋轉20°,旋轉區間為[-90°,90°];② 方位向尺度變換,按一定的比例因子對空間目標沿方位向進行縮放,比例因子的取值依次為0.3,0.7,1.1,…,3.9;③ 距離向尺度變換,按一定的比例因子對空間目標沿距離向進行縮放,比例因子的取值依次為0.3,0.7,1.1,…,3.9;④ 噪聲注入,分別給方位向尺度變換與距離向尺度變化后的圖像注入斑點噪聲,噪聲服從均值為0方差為0.1的高斯分布。數據增強的結果如圖8所示。

圖7 2種不同采樣率對應的ISAR像

圖8 ISAR像數據增強結果

在進行數據增強操作后,每個原始訓練圖像會產生總共1+5×10 = 51張新圖像。在本文任務中,測試集占總數據量的30%,剩余數據中訓練集占70%,驗證集占30%。由于每類空間目標有265張ISAR像,因此隨機選擇130張用于訓練,56張用于驗證、79張用于測試。那么在數據增強之后,每種空間目標的訓練數據集中總共有6 630張ISAR圖像。因此,由5類空間目標所組成的新訓練集中,共有5×130×51 = 33 150張ISAR像。

3 實驗及結果分析

3.1 AlexNet遷移學習模型的訓練效果評估

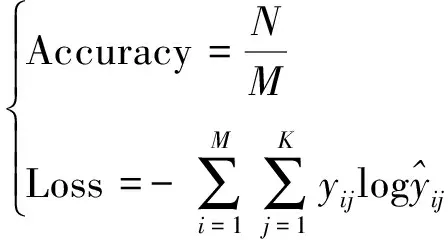

空間目標ISAR像的識別屬于多分類問題,故采用訓練準確率(training accuracy)以及交叉熵損失(training loss)來評估AlexNet遷移學習模型的訓練效果。下面分別給出其定義:

(3)

為了減少訓練過程中的交叉熵損失,提高訓練準確度,有必要為AlexNet遷移學習模型選擇合適的優化器(optimizer)。鑒于Adam優化器集成了AdaGard與RMSProp的主要優點,不僅如RMSProp算法那樣基于一階矩均值計算權值的適應性學習率,還充分利用了梯度的二階矩均值,使模型訓練具有更快的收斂速度。因此,論文采用Adam優化器進行AlexNet遷移學習模型的加速訓練。

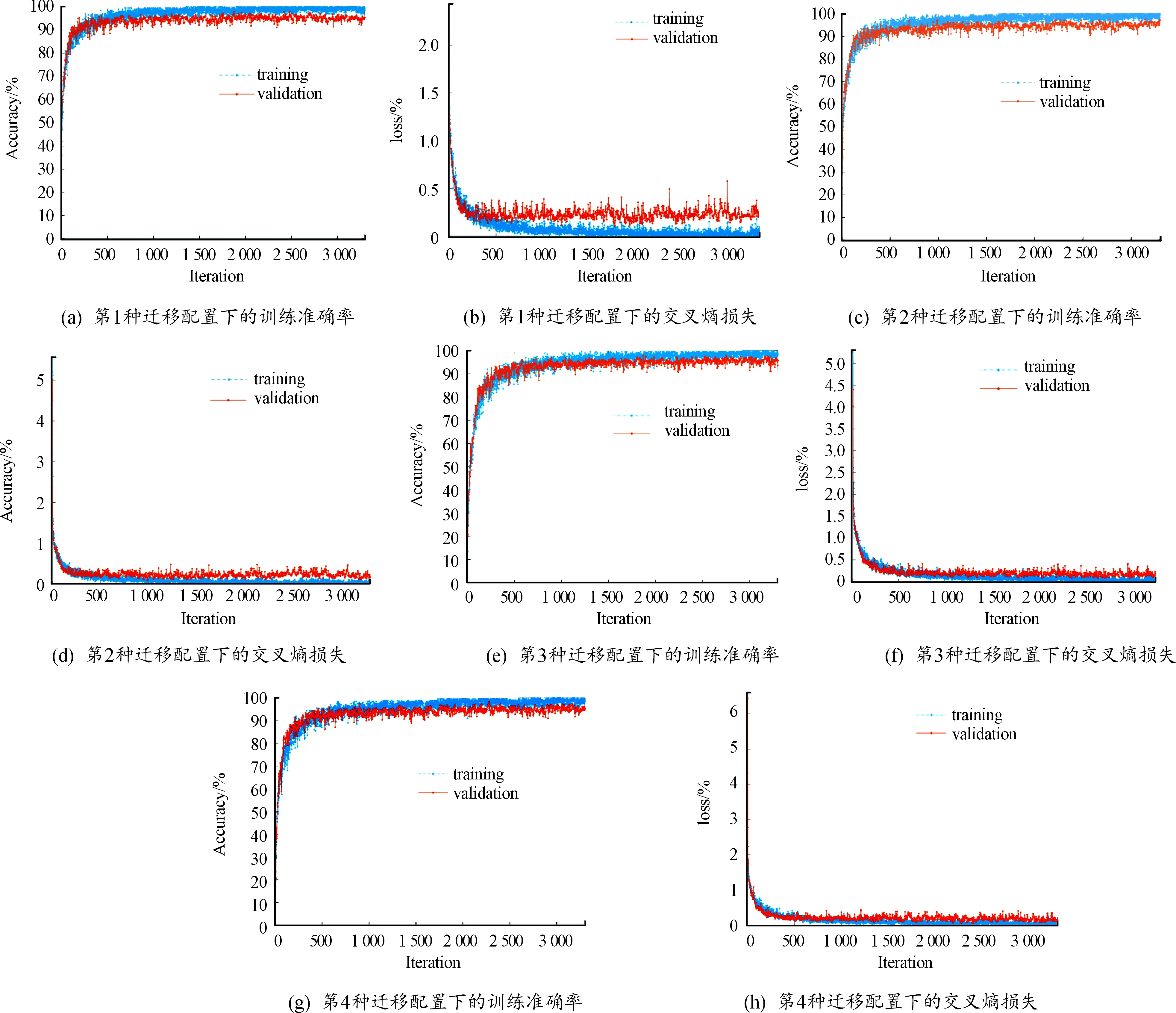

圖9給出了4種遷移配置下的訓練結果。

圖9 4種遷移配置下AlexNet遷移學習模型的訓練結果圖

如圖9所示,4種遷移配置下AlexNet遷移學習模型均達到了較好的訓練效果,訓練準確率和驗證準確率隨著訓練時間的增加而不斷提高,并最終收斂到一個較高水平。其中,第1種遷移配置下的最終訓練準確率與驗證準確率分別為98.50%、95.36%;第2種遷移配置下的最終訓練準確率與驗證準確率分別為99.50%、97.14%;第3種遷移配置下的最終訓練準確率與驗證準確率分別為98.50%、95.71%;第4種遷移配置下的最終訓練準確率與驗證準確率分別為99.50%、95.36%。相應地,訓練數據和驗證數據的交叉熵損失隨著訓練時間的增加而不斷減小,最終趨近一個較小值。其中,第1種遷移配置下的最終交叉熵損失與驗證交叉熵損失為0.256 7%、0.021 7%;第2種遷移配置下的最終交叉熵損失與驗證交叉熵損失為0.012 0%、0.164 4%;第3種遷移配置下的最終交叉熵損失與驗證交叉熵損失為0.024 5%、0.179 7%;第4種遷移配置下的最終交叉熵損失與驗證交叉熵損失為0.021 8%、0.139 8%。

3.2 分類結果與對比分析

本節基于訓練好的AlexNet遷移學習模型,對4種配置下的模型分類性能進行了對比分析。同時研究了數據增強對AlexNet遷移學習模型分類性能的影響。最后將模型的分類性能與其他遷移方式及傳統方法進行了對比。

3.2.1 遷移配置對分類性能的影響

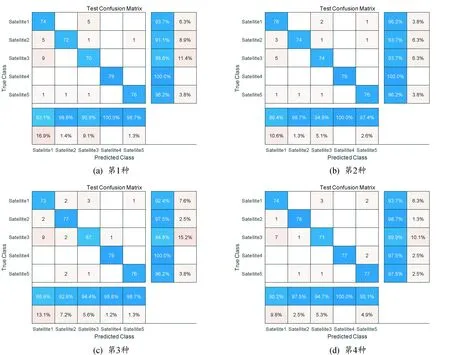

為了確定不同遷移配置下模型分類性能的差異,本節利用3.1節中訓練得到的4種AlexNet遷移學習模型,對測試數據進行分類。圖10給出了4種模型在對測試數據進行分類時得到的混淆矩陣,相應的分類準確率如表2所示。

圖10 4種遷移配置下AlexNet遷移學習模型的測試結果

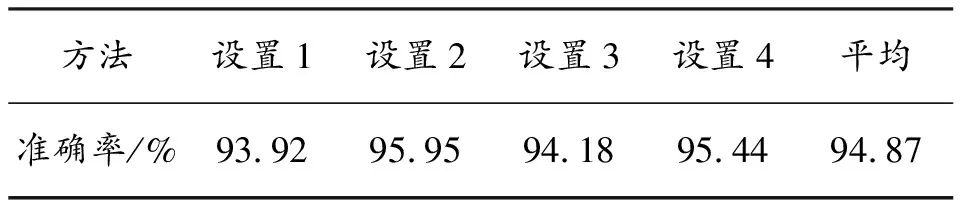

表2 4種遷移配置下AlexNet遷移學習模型的 測試準確率Table 2 Test accuracy of ATLM under four TL settings

圖10(a)~圖10(d)中,橫坐標表示預測值,縱坐標表示真實值,斜對角線上的值表示正確分類結果。如圖10與表2所示,4種配置下的AlexNet遷移學習模型均具有較高的分類性能,平均分類準確率達到了94.87%。為避免實驗過程中訓練數據與測試數據的隨機選取給空間目標分類效果造成影響,接下來按原始比例重新隨機劃分數據集,并對4種遷移配置下的模型進行重新訓練、測試。5次檢驗結果在表3中給出。

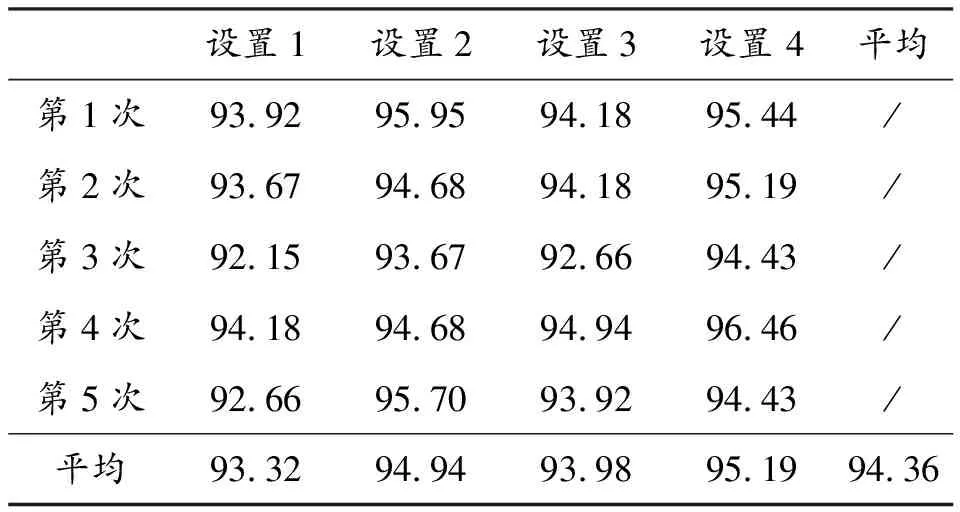

表3 4種配置下的AlexNet遷移學習模型在5次試驗中的測試準確率(%)

表3中給出了4種遷移配置下AlexNet遷移學習模型在5次試驗中的測試準確率,4種遷移配置下AlexNet遷移學習模型在5次試驗中均表現出了較好的分類性能。遷移配置1到遷移配置4的平均測試準確率分別為93.32%、94.94%、93.98%、95.19%。4種遷移配置在5次試驗中的平均測試準確率達到了94.36%,驗證了本文方法的有效性。其中第4種配置下AlexNet遷移學習模型的平均分類準確率相對最高為95.19%,第1種遷移配置下AlexNet遷移學習模型的平均分類準確率相對最低為93.32%。最高平均分類準確率與最低平均分類準確率相差1.87%。說明在數據增強條件下,4種不同配置對AlexNet遷移學習模型的分類性能影響較小。

3.2.2 數據增強對分類性能的影響

為了確定數據增強對AlexNet遷移學習模型分類性能的影響,本文利用未增強數據對4種不同配置下的AlexNet遷移學習模型進行重新訓練,5次測試結果如表4所示。其中,訓練數據650張、驗證數據280張、測試數據395張。結果如圖11所示。

表4 數據未增強時4種配置下的AlexNet遷移學習模型在5次檢驗中的測試準確率(%)

圖11 數據增強與數據未增強條件下AlexNet遷移學習模型的分類效果

表4中給出了數據未增強時4種配置下AlexNet遷移學習模型在5次試驗中的測試準確率,未采用數據增強時,4種配置下模型的平均分類準確率相較表3有所降低。配置1到配置4的平均測試準確率分別為92.20%、91.44%、90.78%、89.82%。4種配置在5次試驗中的平均測試準確率為91.06%。其中第1種配置下AlexNet遷移學習模型的平均分類準確率相對最高為92.20%;第2、3、4種配置下模型的平均分類準確率依次降低,分別為91.44%、90.78%及89.82%。說明數據未增強時,遷移模型權值調整越小、模型的分類性能越好。

由圖11所示,數據增強有效提高了AlexNet遷移學習模型的分類性能。其中4種配置條件下對應的平均分類準確率分別提升了1.12%、3.50%、3.20%、5.37%。平均分類準確率的提升均值為3.30%。說明本文針對空間目標ISAR像的數據增強方式,可以提升AlexNet遷移學習模型的泛化性,在一定程度上避免模型出現過擬合現象。

3.2.3 與其他遷移方式及分類方法進行對比

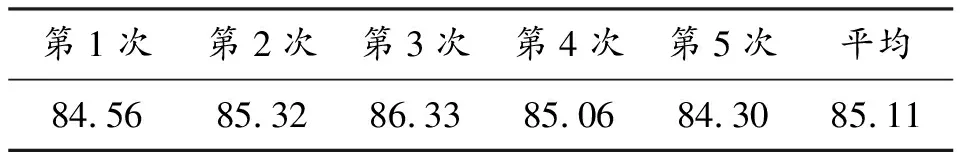

如2.1節中所述,遷移方式還包括將AlexNet預訓練模型作為特征提取器(后文統一稱特征提取器AlexNet),直接提取空間目標的深層特征,然后利用所提特征訓練一個分類器從而實現模型遷移。為對比2種遷移方式的分類性能,本節利用特征提取器AlexNet提取空間目標ISAR像的特征,并采用支持向量機(SVM)對所提特征進行分類。表5給出了此種遷移方式下的5次交叉檢驗分類準確率。

表5 特征提取方式下的5次交叉檢驗分類準確率(%)

如表5所示,特征提取方式下的平均分類準確率為85.11%。低于本文所采用權值微調遷移方式下的分類準確率(數據增強條件下4種遷移配置的平均分類準確率分別為93.32%、94.94%、93.98%、95.19%;數據不增強條件下4種遷移配置的平均分類準確率分別為92.20%、91.44%、90.78%、89.82%)。該結果說明權值微調的遷移方式更適合于空間目標ISAR像的分類。

為了進一步證明權值微調的遷移方式所得到的遷移模型具有更好的分類性能,將3.2.1節中訓練得到的AlexNet遷移學習模型也作為特征提取器,提取空間目標ISAR像的特征,并利用SVM分類器對所提特征進行分類。表6給出了此方式下的5次交叉檢驗分類結果。

表6 AlexNet遷移學習模型作為特征提取器方式下的5次交叉檢驗分類準確率(%)

由表6可知,相比于特征提取器AlexNet所提特征,4種配置下AlexNet遷移學習模型所提特征具有更好的目標表現力。此方式下,遷移配置1到遷移配置4的平均分類準確率分別為94.18%、95.39%、94.33%、95.80%。相比于表5中的85.11%,平均分類準確率分別高出9.07%、10.28%、9.22%、10.69%。從而驗證了權值微調的遷移方式所得到的遷移模型具有更好的分類性能。

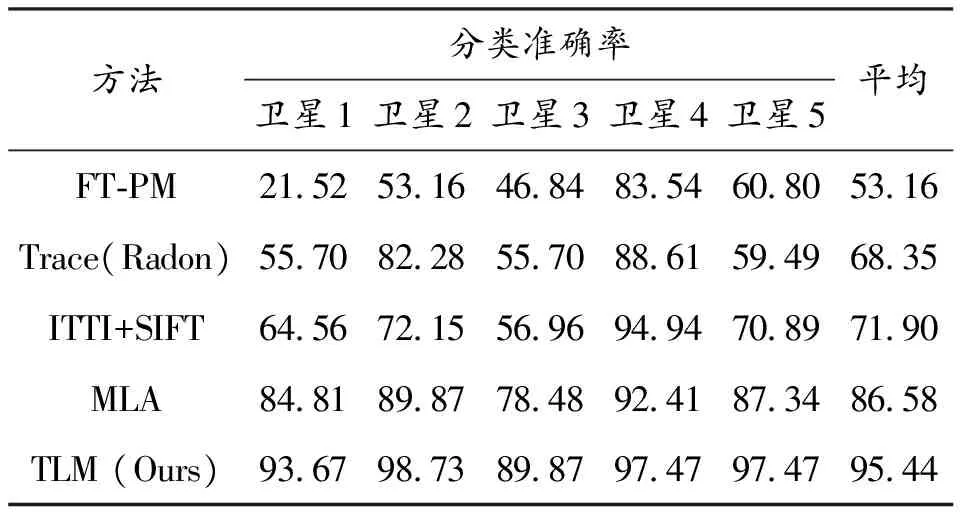

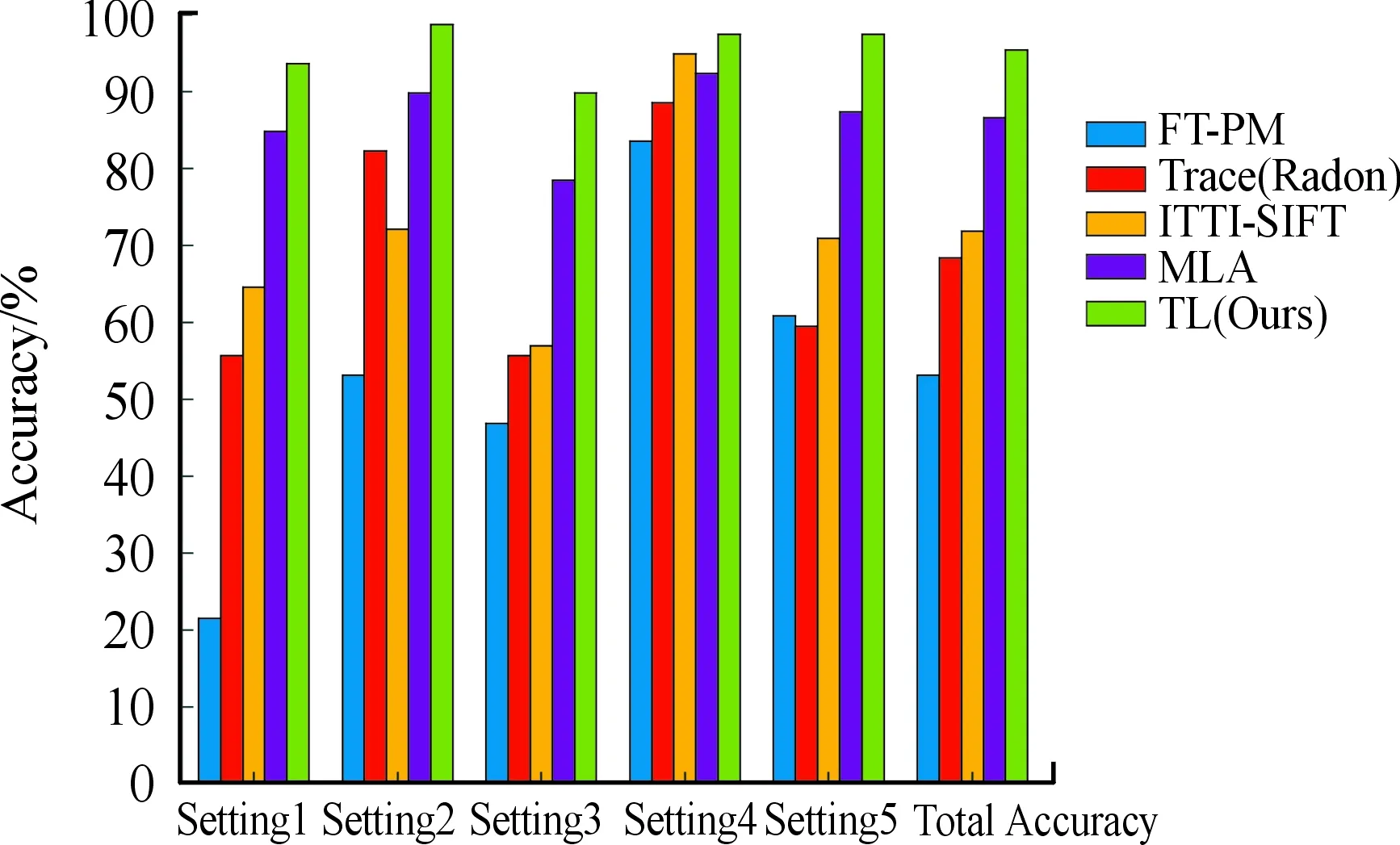

與傳統手動提取特征的目標分類方法相比,本文基于遷移學習的分類方法無需手動提取特征,節約了大量人力物力,且時效性強。為了進一步檢驗本文分類方法相比于傳統分類方法的分類性能,本文將傳統方法的分類結果與本文方法的分類結果進行了對比。傳統方法主要包括FT-PM、Trace(Radon)、ITTI+SIFT和MLA等,選用配置4下的AlexNet遷移學習模型(TLM)。表7給出了傳統方法與本文方法在進行5類空間目標ISAR像分類后的結果。圖12給出了直方圖。

由表7與圖12可知,相比于傳統方法,AlexNet遷移學習模型具有更好的分類性能,總的分類準確率比次優方法高出8.86%。同時,本文方法無需手動提取特征,可以對空間目標ISAR像進行自動識別,因而更適用于實際中的空間目標分類任務。

表7 本文方法與傳統方法的分類結果(%)

圖12 本文方法與傳統方法分類結果直方圖

4 結論

本文提出了一種基于數據增強與遷移學習的空間目標ISAR像識別新方法。該方法通過數據增強操作使空間目標ISAR像的訓練集涵蓋更多的空間分布情況。并以預訓練好的AlexNet深度網絡模型為基礎,采用權值微調策略實現模型遷移,從而解決了小樣本集下利用ISAR像進行空間目標快速自主識別難的問題。仿真算例表明:

1) 該方法可以實現小樣本數據條件下空間目標ISAR像的快速自主識別,具有較高的分類準確率。

2) 數據增強操作可以有效提高AlexNet遷移學習模型的分類性能,一定程度上避免擬合現象。

3) 采用權值微調遷移策略訓練得到的模型對空間目標ISAR像的分類性能,要高于直接將預訓練好的AlexNet深度網絡模型作為特征提取器的分類方式。

4) 與傳統手動特征提取方法相比,AlexNet遷移學習模型無需手動提取特征,且具有更好的分類性能。