基于強化學習的立體全景視頻自適應流

蘭誠棟 饒迎節 宋彩霞 陳 建

①(福州大學物理與信息工程學院 福州 350108)

②(福建省媒體信息智能處理與無線傳輸重點實驗室 福州 350108)

1 引言

虛擬現實技術(Virtual Reality, VR)是一種可以創建和體驗虛擬世界的計算機仿真系統。它利用計算機生成一種模擬環境,向使用者提供視覺、聽覺、觸覺等多種感官刺激,帶來一種身臨其境的沉浸感受[1]。思科預計到2022年,沉浸式應用所產生的互聯網流量將增加20倍[2]。雖然單一的360視頻可能是當前VR視頻內容中最流行的類型,但它們缺乏3D信息,因此無法以完整的6個自由度(six Degree Of Freedom, 6-DOF)觀看[3]。立體全景視頻實現在3 DOF 360視頻條件下進一步增強沉浸式效果,已經受到人們的關注。

在傳統全景視頻傳輸中,由于強化學習方法能夠獲得長期內的最優決策。利用強化學習進行全景視頻的碼率選擇已經受到大量學者的研究。文獻[4]運用強化學習中的異步優勢動作評價(Asynchronous Advantage Actor-Critic, A3C)算法通過輸入之前時刻帶寬、之前時刻預測精度、當前帶寬等數據進行視點區域、臨近區域、外部區域的碼率選擇,該算法已成為基于強化學習的全景視頻區域碼率選擇的經典算法。文獻[5]同樣利用A3C算法進行3個區域的比特流分配。其考慮到為提高視點預測精度,緩存區應該不宜過大。其將緩存區大小也作為獎勵函數,鼓勵算法偏向適宜的緩存大小來兼顧預測精度和播放卡頓,該算法說明獎勵函數的設置對系統工作有重要的影響。

在立體全景視頻傳輸中,文獻[6–8]研究了各種量化參數(Quantization Parameter, QP)、不同空間縮放比等情況下的差分平均意見得分(Different Mean Opinion Scores, DMOS)值。其結論不僅說明雙目抑制也適用立體全景視頻中,也說明當某一視點的空間分辨率在可接受的情況下進行縮放時,其帶寬能節省25%~50%。文獻[9]將一個視點水平、垂直下采樣,并在解碼端上采樣。而另一視點保持不變,進行非對稱傳輸。上述方法都是固定碼率或者下采樣進行非對稱編碼的方法,沒有充分考慮網絡帶寬的實時變化等對用戶體驗質量(Quality of Experience, QoE)的影響。本文提出一種基于強化學習的立體全景視頻自適應流傳輸方案。通過為一路視點提供基本視頻內容信息,另一路視點動態提供輔助立體信息,可以在帶寬有限的情況下提供最佳的觀看質量[10]。考慮到立體全景視頻視點中各瓦片(tiles)的顯著性不同,因此左右視點對應瓦片對主觀質量的貢獻度是不一樣的。合理降低每路視點中顯著性較低瓦片的碼率,提高每路視點中顯著性較高瓦片的碼率,并利用強化學習合理分配網絡帶寬數據,依據雙目抑制原理,設置合適的獎勵函數,從而提高視頻整體質量。其具體方法是利用多智能體強化學習對左右視點各瓦片分別進行碼率選擇,以避免傳統強化學習對多個瓦片進行碼率選擇造成的行動空間爆炸問題。最后,為保證系統的有效性,采用一種分步更新策略來平衡整體獎勵和左右視點的局部獎勵。

2 基于DASH的立體全景視頻自適應流系統

圖1展示了基于動態自適應流超文本傳輸協議(Dynamic Adaptive Streaming over Hypertext transfer protocol, DASH)的立體全景視頻自適應流系統框架。DASH技術具有快速的啟動時間、較好的用戶體驗以及較少的緩沖等顯著的特點。其較大地緩解了全景視頻對網絡的高負載,確保了用戶的體驗質量[11]。由于同一時刻人眼觀看的視點區域為視頻內容的一部分,因此全景視頻通過特定工具,在時間上切割為片段(segments),在空間上切割為瓦片。編碼后的瓦片數據集存儲在服務器端,服務器端根據客戶端反饋的信息進行數據選擇和發送。利用HTTP2.0協議,客戶端發送一條指令信息能夠獲取所有要求的瓦片數據。下載后的數據經過解碼和縫合,存儲在客戶端播放緩存中。最后通過頭戴設備等播放軟件進行渲染和播放。利用從播放設備獲取的頭部運動數據,通過視點預測,并結合當前帶寬數據對視點內和視點外區域瓦片選擇不同的碼率,可適當降低全景視頻傳輸所要求的帶寬需求。合理地為每個瓦片進行碼率控制決定著該流傳輸系統性能的優劣。

圖1 基于DASH的立體全景視頻流系統結構圖

3 立體全景視頻聯合碼率控制

3.1 基于瓦片的左右觀看概率預測方法

在立體視頻中,左右兩路視頻存在一定的視差,對應的瓦片的顯著性并不相同,左右視點對于用戶的關注度都存在影響。同時,用戶的頭部運動起著絕對作用。因此,本文提出一種基于瓦片的立體全景視頻左右觀看概率預測方法。通過分別獲取兩路視點瓦片的觀看概率,并依據雙目抑制原理設計合理的獎勵函數,從而為左右兩路視點各瓦片選擇不同的碼率。

如圖2所示,利用一種節能高效的3維卷積神經網絡(Three-Dimension Convolutional Neural Network, 3D-CNN)[12]分別對獲取的主視點序列瓦片的靜態顯著信息、動態顯著信息和雙目視點的視差信息進行特征提取。同時,利用長短期記憶網絡(Long Short-Term Memory, LSTM)在時間序列預測上的較強性能,進行頭部運動數據預測。與獲取到的顯著性數據和視差數據進行拼接融合。最后通過多層全連接層,利用監督學習的方法,分別獲取側重不同信息的左右視點各瓦片的觀看概率。某個瓦片的觀看概率pi可以簡短地表示為

圖2 基于tile的視點預測概率模型

3.2 基于多智能體強化學習的聯合碼率控制模型

假設立體全景視頻左右視點分別在時間上分為N個片段,每個片段長度為T,每個片段包含K個瓦片,并且每個片段有Mbit水平。每個片段中每個瓦片所選擇的碼率為ai,其i ∈{0,M ?1}。q(ai)表示碼率到感知質量的映射。左右視點每個瓦片的觀看概率分別為pLi,pRi。

在單視點情況中,利用強化學習為每個瓦片選擇碼率,在每一時刻,一共有MK種可能。如此巨大的行動空間在實踐中是不可行的。本文利用基于策略-評價(Actor-Critic)[13]的多智能體強化學習,將每個瓦片當成一個智能體,其共享一個狀態,進行聯合行動。行動空間最終減小為M。其結構如圖3(b)所示。

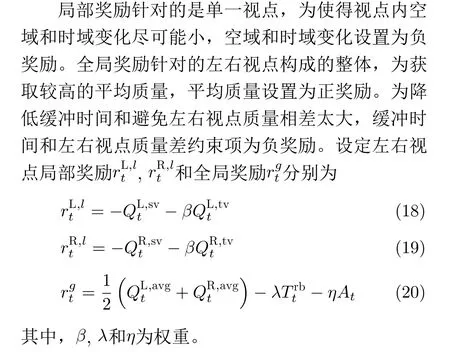

當左右視點都采用多智能體強化學習進行瓦片碼率選擇時。每個智能體的獎勵混雜著單視點中智能體聯合行動從環境中獲取的局部獎勵(如時域光滑度、空域光滑度等),以及左右視點的智能體聯合作用時的全局獎勵(如緩沖時間等)。混雜局部和全局獎勵的獎勵函數無法體現獎勵函數中各代價函數的貢獻,極易造成模型的不穩定,導致每個智能體無法選擇最優行動。

針對上述問題,本文采用圖3(a)所示的結構,通過引入全局策略進行監督,將全局獎勵和局部獎勵分開,分別進行優化,從而保證模型的穩定性。

圖3 算法結構圖

修改后每個智能體的策略梯度為

3.3 獎勵函數的設計

獎勵函數決定強化學習的學習方向,因此,設計合適的獎勵函數,決定系統的工作性能好壞。假設左右視點中每個智能體每個時刻分別共用一個狀態,輸入狀態分別為

變異系數(Coefficient of Variation, CV)可以反映視口空域質量變化大小[4]。左右視點視口中瓦片的視口空域質量變化為

4 實驗設計和結果分析

4.1 實驗設計

目前尚沒有公開的立體全景視頻數據集,本文從Youtube網站上分別下載4個分辨率為4K和8K的立體全景視頻[16]。利用多媒體視頻處理工具FFmpeg對數據集進行空域和時域切片,并依據高效視頻編碼(High Efficiency Video Coding, HEVC)標準編碼。反映用戶真實頭部運動的數據采用文獻[17]中的公開數據集。視點區域大小為水平方向110°,垂直方向90°。投影方式采用常用的等距柱狀投影(EquiRectangular Projection, ERP),6×4布局;播放緩沖區大小為3 s。運行環境為Intel Xeon E5-2680 v4 2.40 GHz CPU和2個2080Ti GPU。

當今,5G技術已經已經逐漸在普及完善,利用5G技術傳輸高清視頻是眼下可見的必然選擇。因此本文分別驗證在4G和5G帶寬下利用不同算法傳輸4K和8K立體全景視頻的效果。帶寬數據集分別采用文獻[18]中的4G帶寬數據集,以及文獻[19]中的5G帶寬數據集。其帶寬軌跡如圖4所示。

圖4 4G和5G帶寬軌跡

4.2 實驗結果和分析

為提高處理速度,每個片段間隔抽取5幀,并縮小為192×108的大小。如表1所示,本文選擇了一個視頻序列和一個頭部運動軌跡進行時間復雜度測試,獲取每個片段平均處理時間和預測精度。由于本文算法增加了顯著度和視差提取等模塊,后續的碼率分配環節能夠通過不同的觀看概率選擇碼率。從表1可看出,本文算法預測精度有所提高,但是運行時間有所增加。如圖1所示,視點預測和碼率選擇機制部署在客戶端,從而減輕了服務器負荷及傳輸成本,提高了反應速度。當前,5G技術的發展促進了邊緣計算與終端間的更好的融合,終端設備的計算能力也在不斷增強,利用終端設備進行預測具有很高的操作性。

表1 時間測試與視點預測精度

通過在相同的客觀實驗環境下,獲取3種算法的緩沖時間、時域和空域光滑度,以及式(23)構建的視點區域PSNR值,其反映了整體的感知質量。

圖5反映了3種算法在4G和5G網絡帶寬情況下的各數據的比較,其中圖5(a)、圖5(b)和圖5(c)、圖5(d)分別展示了4G和5G帶寬下傳輸4K和8K立體全景視頻下的有關數據。實驗結果表明,在感知質量V ?PSNR3D指標方面,5G帶寬下3種算法的整體性能優于4G帶寬下的性能,這符合人們的一貫認知和客觀事實。但是在5G帶寬情況下,3種算法的緩沖時間都在增加,這是因為如圖5所示的4G和5G帶寬軌跡情況,5G帶寬波動相對于4G更加劇烈。劇烈波動的帶寬將會給算法的碼率選擇策略上帶來更大的挑戰。

基于強化學習的碼率選擇方法通過不斷地學習強化過去對將來的影響,其在復雜情況下更能表現出優良的性能,做出正確的決策。從圖5可以看出,在5G網絡帶寬情況下,本文算法相對于其他兩種算法感知質量V ?PSNR3D最高,同時能夠保持最少的緩沖時間。這是因為根據式(22),在超過一定的閾值下,非對稱編碼優于對稱編碼,并且相對于傳輸左右兩個相等碼率的瓦片,非對稱傳輸能減小帶寬數據,從而減小緩沖時間。從圖5(a)和圖5(b)可以看出,4G網絡帶寬下傳輸8K視頻相比于傳輸4K視頻,本文法的V ?PSNR3D相對基準算法Plato增益更大。因而,在網絡環境更加惡劣情況下,本文算法的感知質量效果更加明顯。

圖5 各算法性能比較

對空域切割的瓦片分別進行碼率分配,降低了視頻質量空時域的連續性,導致在時域和空域上一定程度上的不平滑。從圖5可以看出,本文算法在時域和空域光滑度上性能較差。本文算法持續更新全局價值網絡,間隔更新局部價值網絡實現智能體策略網絡朝著全局獎勵和局部獎勵最優方向進行優化。這種非同步更新方法,可能會使全局價值網絡或局部價值網絡處于欠擬合或者過擬合狀態,導致二者不能同時保持較高的性能。下一步將探索全局價值網絡和局部價值網絡間的同時更新策略,以同步提高二者的性能。在本文算法中,全局價值網絡發揮更好的作用,因此體現全局獎勵的感知質量V ?PSNR3D有所提升,緩沖時間有所下降。然而,體現局部獎勵的時域和空域光滑度性能有所不足。

圖6展示了不同算法在4G和5G帶寬下傳輸4K和8K立體全景視頻的QoE-CDF圖,從圖6可知,本文算法能達到一個好的均衡,其平均QoE相對其他兩種算法在4G帶寬下平均能有20%的提高,在5G帶寬下平均能有12%的提高。說明5G網絡能在一定程度上緩解立體全景視頻傳輸在4G網絡下造成的質量下降,也說明非對稱傳輸方法能進一步提高視頻整體質量。

圖6 各算法CDF比較

5 結論

本文提出一種基于強化學習的立體全景視頻自適應流傳輸方法,首先提出一種視點預測概率模型,分別獲取左右視點每個瓦片的觀看概率。其次,提出一種基于多智能體協作的立體全景視頻碼率選擇框架,分別將左右視點的每個瓦片當作一個智能體,每個視點內部的瓦片所構成的多個智能體相互協作,以解決針對瓦片碼率選擇上的行為爆炸問題。最后,根據雙目抑制原理,設置合適的獎勵函數。并通過設計整體和局部的學習機制,將視點內部的目標與整體的目標分開學習優化。以達到最終的目的。通過與其他方法進行比較,本文方法在視頻感知質量提高和視頻緩沖時間的降低具有更加優良的性能。