模擬“what”通路前端視覺機制的邊緣檢測網絡

潘盛輝 王蕤興 林川

摘? 要: 邊緣檢測是圖像處理工作的關鍵步驟之一,目前邊緣檢測模型基于卷積神經網絡(CNNs)搭建編碼-解碼網絡。由于現有編碼網絡提取特征能力有限,且忽視了神經元之間復雜的信息流向,本文模擬視網膜、外側膝狀體(LGN)和腹側通路(“what”通路)前端V1區、V2區、V4區的生物視覺機制,搭建全新的編碼網絡和解碼網絡。編碼網絡模擬視網膜-LGN-V1-V2的信息傳遞機制,充分提取圖像中的特征信息;解碼網絡模擬V4區的信息整合功能,設計鄰近融合網絡以整合編碼網絡的特征預測,實現特征的充分融合。該神經網絡模型在BSDS500數據集和NYUD-V2數據集上進行了實驗。結果表明,本文搭建的編碼-解碼方法的F值(ODS)為0.820,相比于LRCNet提高了0.49%。

關鍵詞:邊緣檢測;生物視覺;編碼-解碼網絡;特征提取;卷積神經網絡(CNNs)

中圖分類號:TP317.4;TP391.41? ? ? ? ? ? ?DOI:10.16375/j.cnki.cn45-1395/t.2022.02.009

0? ? 引言

邊緣檢測作為輪廓檢測的基礎工作,旨在標記數字圖像中目標與背景的交界[1-2],其作為圖像處理與計算機視覺的關鍵步驟之一,用于圖像分類[3]、目標檢測[4-5]、語義分割[6-7]等諸多領域。

近年來,卷積神經網絡(CNNs)在邊緣檢測任務中取得了很好的效果。以經過裁剪后的VGGNet、ResNet等學習架構作為網絡的編碼結構,通過構造不同的解碼結構對編碼結構中不同卷積層的輸出特征進行整合,獲得最終的邊緣輸出[8]。以VGG16為編碼網絡構造的邊緣檢測模型都取得了很好的成績。如Xie等[9]提出了一種端到端的整體嵌套的輪廓檢測算法(HED),通過上采樣的方法融合VGGNet[10]五大層的側邊輸出,證明了深度學習模型在邊緣檢測的高效性。為了增加信息的利用率,Liu等[11]在HED 的基礎上提出了RCF網絡,該算法將VGG16的13 層的側面輸出融合,在不增加計算成本的基礎上,減少了信息丟失,得到了優于HED的效果。但是,側面輸出圖直接上采樣會導致圖片紋理大量增加,且輪廓粗糙,缺少細節信息。因此,Xu等[12]引入了一個分層深度模型(AMH-Net),它產生了更豐富和互補的紋理。此外,為了更好地融合從不同尺度上得到的特征圖像,提出了一種新的注意門控條件隨機場(AG-CRFs)。Wang等[13]提出了一種CED網絡,該網絡使用逐層組合的方式融合VGG16的每一階段輸出,使用亞像素卷積的方法進行上采樣。可見,信息逐層連接可大大提高輪廓的精度,得到清晰的邊緣。Lin等[14]提出了一種新型的水平細化網絡(LRCNet),通過融合不同級別的細化模塊來獲得越來越有效的輪廓信息,提高了圖像間的預測性能。Cao等[15]提出一種深度精化網絡(DRNet),通過堆疊多個精化模塊,設計一種鄰近結合方式。從視覺神經機制來看,視覺系統的分析過程表現為分層化、復雜化,而特征信息的提取則逐漸細節化。視覺任務中的CNNs 通過分層次特征學習實現特征提取和整合,完整地模擬了整體視覺的功能。因此,將生物視覺神經機制與深度學習相結合,模擬視覺皮層對信息的提取,并將所得信息有效結合,可取得更加優化的效果。

本文從生物視覺出發,模擬來自視網膜的視覺信號,經丘腦外側膝狀體處理后,參與與物體識別相關的“what”視覺通路,這一過程在目標識別中起著關鍵作用[16]。本文模擬了 “what”通路中視網膜-LGN-V1-V2-V4的處理過程,搭建編碼-解碼網絡,構建基于仿生的深度學習模型;在BSDS500數據集和NYUD-V2數據集上對本文模型進行定性和定量測評,并與其他CNNs模型進行對比。結果表明,本文模型優于其他模型,有較好的檢測效果。

1? ? 模型搭建

生物視覺系統按照特定的規則處理圖像信息。功能性磁共振成像(fMRI)[17]研究表明,外膝體(LGN)在處理視網膜傳遞的圖像信息之后分為腹側(“what” 通路) 和背側 (“where”通路)2條視覺通路進行分流處理。“what”通路參與物體識別,起始于初級視皮層V1區,依次通過V2區和V4區,進入高級視皮層(IT區)[18]。本文模擬“what”通路前端視覺處理機制搭建編碼-解碼網絡,即:視網膜-LGN-V1-V2-V4。

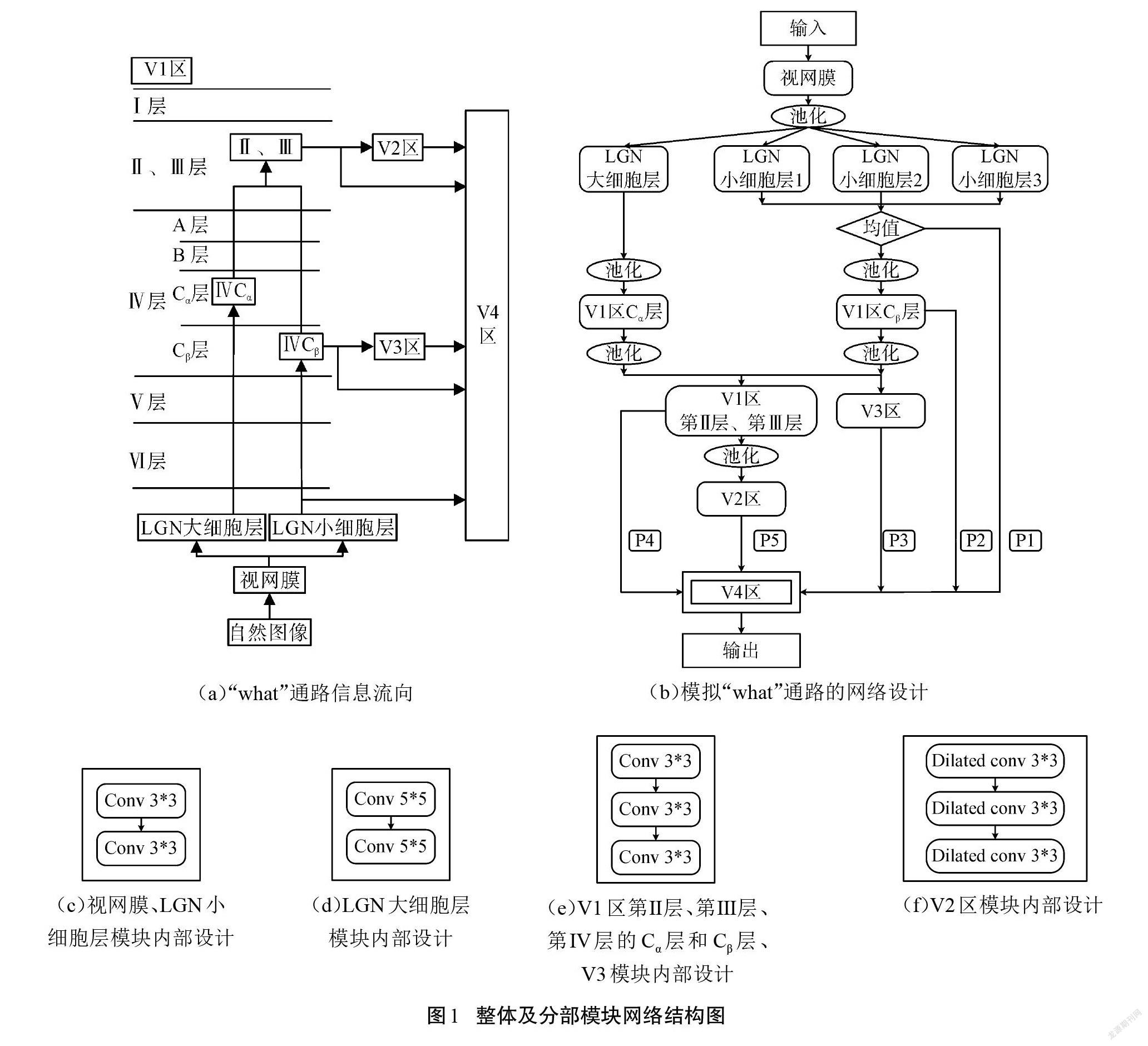

圖1(a)為“what”通路信息流向,在“what”通路中,視網膜接收圖像進行簡單的信息提取后向LGN傳遞,LGN根據細胞感受野大小分為大細胞層和小細胞層。大細胞層對運動、方向、速度等信息敏感,而小細胞層對物體的形狀、顏色等信息敏感。大、小細胞層接收視網膜提取的信息后分別向視覺機制中初級視皮層(V1區)的不同層分流傳遞。其中,V1區共分為6層,分別標記為Ⅰ、Ⅱ、Ⅲ、Ⅳ、Ⅴ、Ⅵ,信息流通方向為Ⅵ→Ⅴ→Ⅳ→Ⅲ→Ⅱ→Ⅰ。Ⅳ層內部又細分為A、B、Cα、Cβ等4個小層,信息流通方向為Cβ→Cα→B→A,每層處理任務各不相同。LGN大細胞層神經元將信息傳遞至V1區Ⅳ層的Cα層,再傳遞到V1區的第Ⅱ層、第Ⅲ層;小細胞層神經元將信息傳遞到V1區的Ⅳ層的Cβ層,再傳遞到V1區的第Ⅱ層、第Ⅲ層和V2區。在第Ⅱ層、第Ⅲ層時對圖像的顏色及形狀等信息進行重點提取。之后,經過第Ⅱ層、第Ⅲ層處理的視覺信號離開V1區,到達V2區。V3區接收V1區第Ⅳ層中Cβ層的信息,由于V3區主要對視野中的運動特征進行提取,故在腹側流中僅起到增強輪廓的作用。視覺聯絡區(V2區、V3區、V4區)不局限于某種功能,而是對各信息進行加工整合。V2區注重對形狀、顏色、立體視覺等信息的處理,起到調制復雜信息的作用。V4區和V1區相似,提取形狀、顏色等信息,用來接收來自V1區、V2區、V3區及部分LGN的前饋信息,擁有強大的注意力調節功能,可分離出更加復雜精確的輪廓。本文根據上述視覺機制搭建網絡,整體結構如圖1(b)所示。

編碼網絡分別模擬了視網膜、LGN、V1區、V2區的視覺傳遞機制。為了模擬視網膜提取初級特征的能力,設計了由2個連續的3*3卷積核組成的模塊,對輸入圖像的輪廓特征進行提取,如圖1(c)所示。將所提取的特征經過最大值池化后傳遞至模擬LGN的模塊中。視神經學中根據LGN細胞感受野大小分為大細胞層和小細胞層,基于這一特性本文設計了大細胞層和小細胞層2個通道。對于大細胞層而言,其細胞感受野相對較大且數量較少,因此,使用一組卷積操作來模擬大細胞層的特征獲取能力。它由連續2個5*5卷積核組成,所得特征作為LGN大細胞層的側面輸出,如圖1(d)所示。對于小細胞層而言,其細胞感受野較小且數量較多,因此,設計了3組平行卷積操作,每一組都由2個3*3卷積核組成,如圖1(c)所示,將3組處理后的特征信息求取算數平均值并作為LGN小細胞層的側面輸出。 LGN接收視網膜的信息后向V1區傳遞,而V1區內部Ⅳ層中Cα 、Cβ 2個小層分別接收來自LGN的信息。其中,V1區Ⅳ層中的Cα層接收LGN大細胞層神經元投射的信息,V1區Ⅳ層中的Cβ層接收LGN小細胞層神經元投射的信息。從V1區Cα 、Cβ層輸出的信息經過池化相加后,向模擬V1區中第Ⅱ層和第Ⅲ層的模塊傳遞,經其處理后的輪廓信息分別向V2區和V4區傳遞。此外, 經fMRI研究發現,V1區Cβ層經V3區的處理后再向V4區傳遞,V4區對所有接收到的特征信息進行統一處理。其中,V1區第Ⅳ層的Cα層和Cβ層、V1區第Ⅱ層和第Ⅲ層和V3模塊的模型結構均采用3個連續的3*3卷積操作來模擬,如圖1(e)所示。對于V2區的功能,選擇3個連續的空洞卷積來模擬,空洞率設置為1,有效地加強了網絡的泛化能力,提取到了更加清晰的特征信息,如圖1(f)所示。

解碼網絡模擬“what”通路中V4區的功能及作用。在V4區之前,通路中各部分已基本完成了視覺機制中簡單的輪廓提取任務,且V4區位于整個腹側流的中高層,是視覺處理機制的中繼站,也是多種信息的匯聚點[16]。本文解碼網絡模擬V4區的功能作用,接收并融合來自LGN、V1、V2等機制處理所得的豐富信息,合成最終輪廓。模擬V4區網絡結構如圖2(a)所示。選取編碼網絡中的5幅側面輸出圖進行解碼,即:LGN小細胞層、V1區的Cβ層、V3區、V1區的第Ⅱ層和第Ⅲ層、V2區的側面輸出信息,標注為如圖2(a)所示的P1、P2、P3、P4、P5。

將P1、P2、P3、P4、P5這5幅側面輸出圖視為“what”通路前期提取的特征信息。使用一種鄰近結合的方式將高分辨率與相鄰的低分辨率通過精煉模塊R兩兩結合,如圖2(a)所示。其中,精煉模塊R包含2個輸入和1個輸出,每個輸入通過1個大小為3*3的卷積核來改變圖片通道,使輸出特征圖與2個輸入特征圖中通道數少的一方相同。設置Relu激活函數與BN層加快訓練速度,隨后與經過sigmoid函數歸一化的權重系數相乘,解決輸出邊緣在不同分辨率下的特征比率不平衡的問題。將低分辨率特征信息經雙線性上采樣操作至與高分辨率特征相同并相加,如圖2(b)所示。由于P3與P4的圖片分辨率相同,在此處省略精煉模塊R中上采樣的處理過程,將兩者權重卷積過后的結果直接相加,輸出至下一階段。解碼網絡的最后1個精煉模塊通過1個1*1的卷積核處理后得到的預測結果為最終邊緣檢測結果。

2? ? 實驗結果與分析

2.1? ?網絡設置

本文將非極大值抑制處理方法應用于所有的輸出結果。使用BSDS500數據集[19] 及NYUD-V2數據集[20]對所提出的檢測方法進行定性和定量的實驗驗證,并與其他深度學習的神經網絡進行對比。

為了改善邊緣質量,創建了圖像金字塔[21]以檢測多尺度輪廓。單尺度檢測器是以圖像原始大小進行采樣。多尺度模型首先將放大或縮小的圖像輸入單尺度檢測器中,再用雙線性鄰近插值將所得邊緣圖調整為原始圖像尺寸,最后通過求取每個像素點的平均值作為最終的預測圖。本文使用0.5倍圖像、1倍圖像、2倍圖像進行融合。

使用精確-回歸(precision-recall,P-R)曲線和調和平均數[F]值來評判輪廓檢測模型的性能。[F]值的定義如下:

[F=2PR/(P+R)],? ? ? ? ? ? ? ? ? ? ?(1)

其中:[P]和[R]分別代表精確度和回歸度,[P=NTP/(NTP+NFP)],[R=NTP/(NTP+NFN)];[NTP]、[NFP]和[NFN]分別代表輪廓像素的正確個數、錯誤檢測個數和漏檢測個數。

輪廓檢測模型一般使用以下3個指標來評價性能:1)固定閾值下整個數據集得到一個最優[F]值,被稱作最優的數據集尺度(ODS);2)每一幅圖像在一個固定閾值得到一個最優[F]值,被稱作最優的圖像尺度(OIS);3)數據集的平均精度(AP)。

2.2? ?整體結構對比分析

2.2.1? ? BSDS500

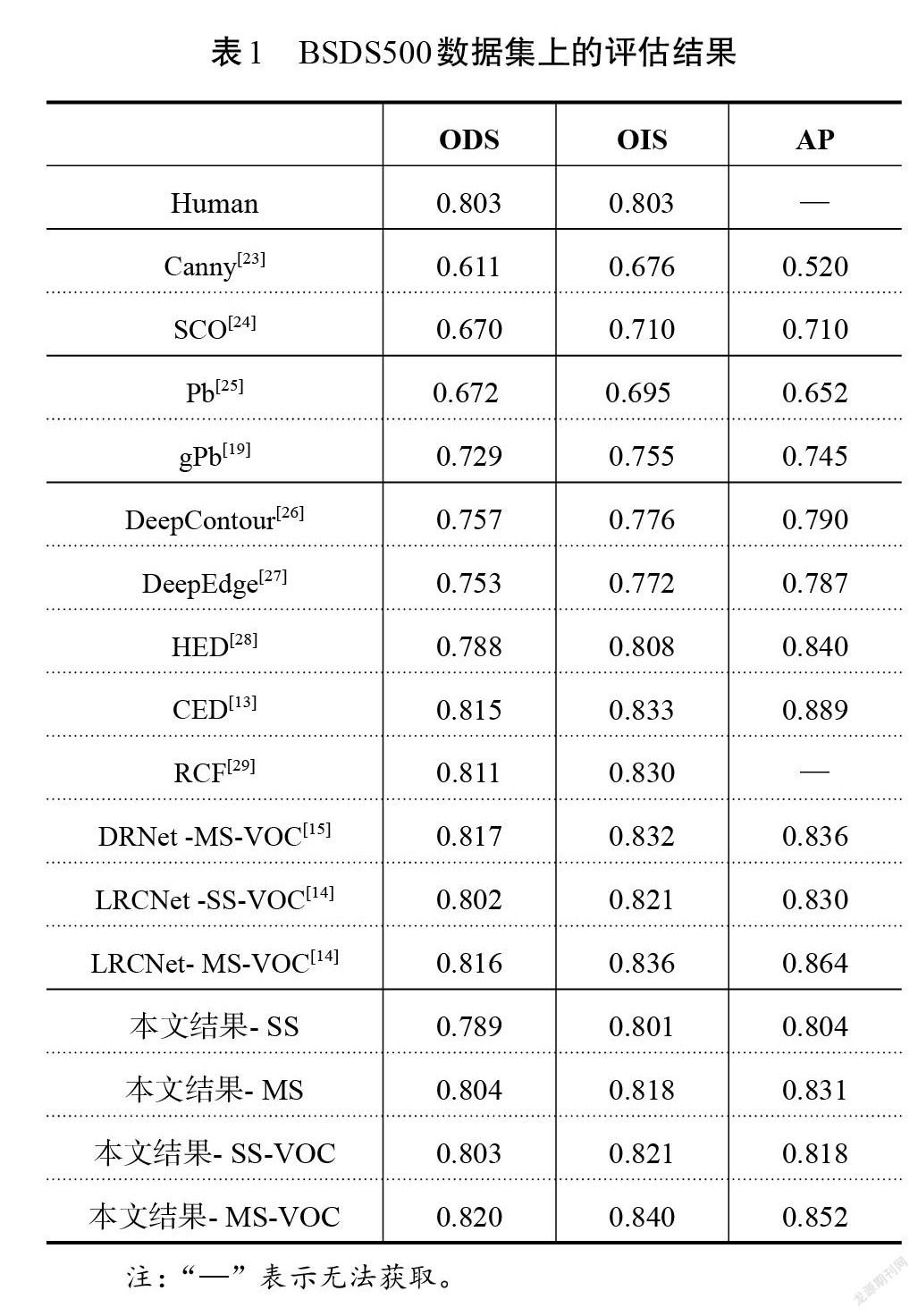

BSDS500數據集為BSDS300的擴展版,包含200幅測試圖像和300幅訓練圖像,其中每幅圖像都對應著5~10個由人工標注的真實輪廓。由于訓練數據有限,將這300幅訓練圖像旋轉、縮放和裁剪為24 880幅圖像,從而擴展了BSDS500訓練集。將BSDS500增強訓練集與Pascal VOC訓練集(即表1中的VOC)[22]混合作為訓練數據。在評估過程中,采用標準非最大抑制(NMS)對檢測到的邊緣進行細化。將該算法與傳統的邊緣檢測算法、機器學習、仿生學習及近幾年的深度學習算法作比較,包括:Canny[23]、SCO[24]、Pb[25]、gPb[19]、DeepContour[26]、DeepEdge[27]、HED[28]、CED[13]、RCF[29]、DRNet[15]、LRCNet[14]。在本文中,SS 表示單尺度,MS 表示多尺度。

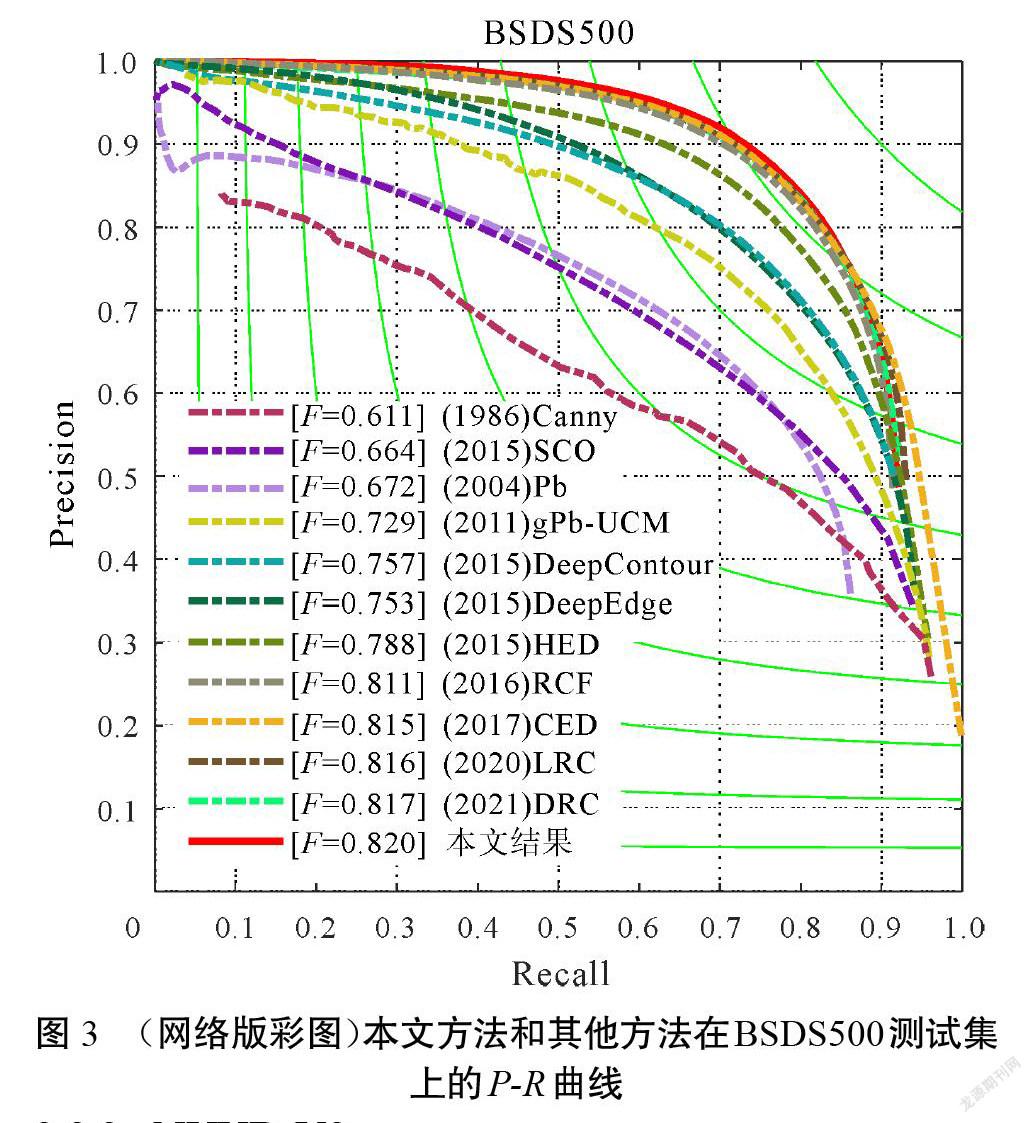

表1為BSDS500數據集上ODS、OIS和AP的定量評價結果,由表1可知,無論是單尺度還是多尺度,本文方法均優于所列文獻中的方法。本文模型的ODS為0.820,OIS為0.840,AP為0.852,其網絡結果在BSDS500數據集上超過了人類基準(ODS=0.803),相較于其他仿生學及深度學習網絡都有較好的檢測結果;單尺度和多尺度ODS值相比于LRCNet[14]在BSDS500和VOC混合數據集中分別提高了0.12%和0.49%。本文為了加快計算速度,縮減了網絡內存,只對最終輸出結果求損失函數與真實輪廓圖進行對比,因而AP值并沒有優于其他所有網絡。圖3為算法的P-R曲線,圖4展示了一些模型在BSDS500測試集上的定性結果。由圖4可以看出,本文模型在預測出更多邊緣細節的同時,含有更少的背景紋理。

2.2.2? ?NYUD-V2

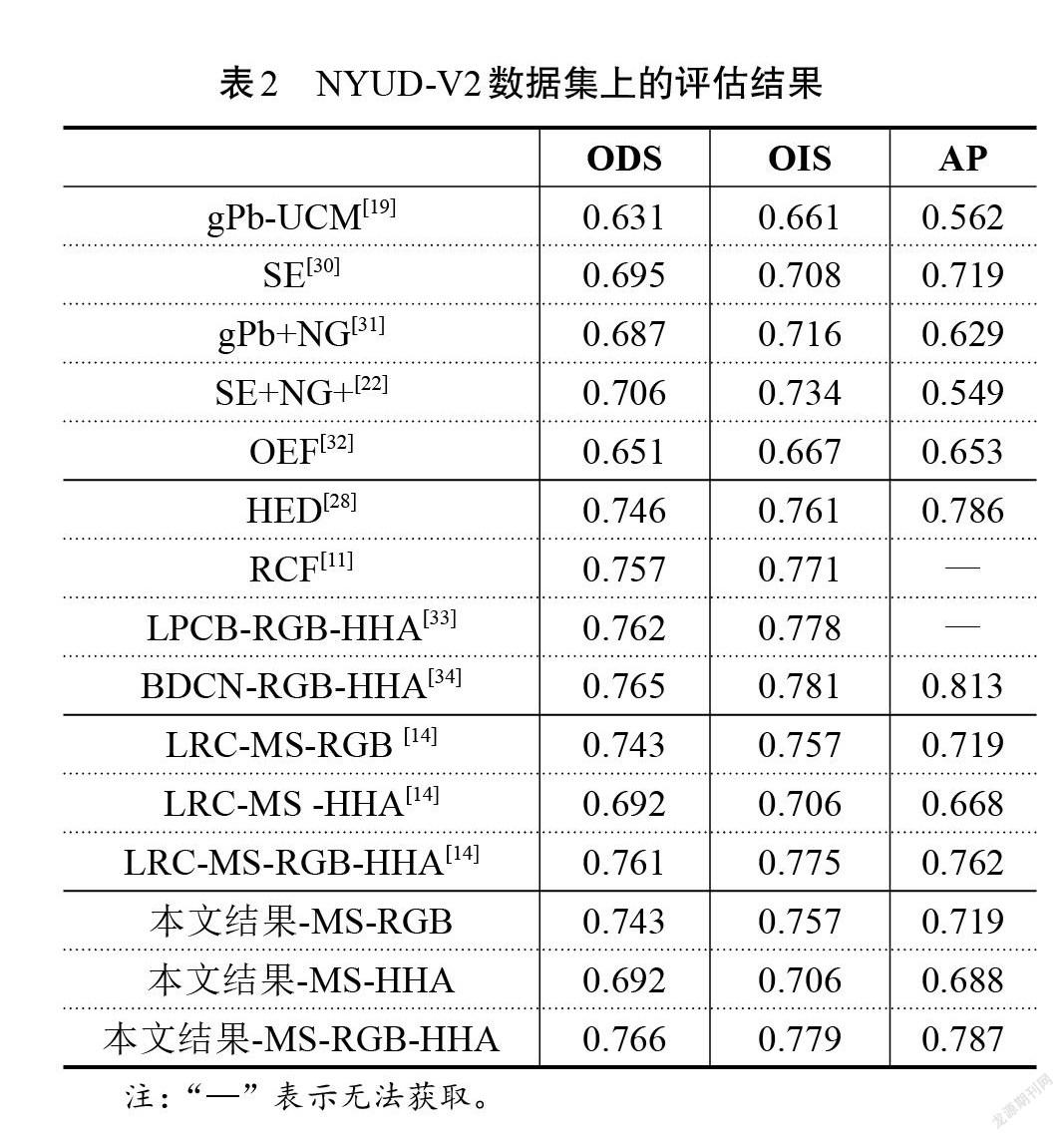

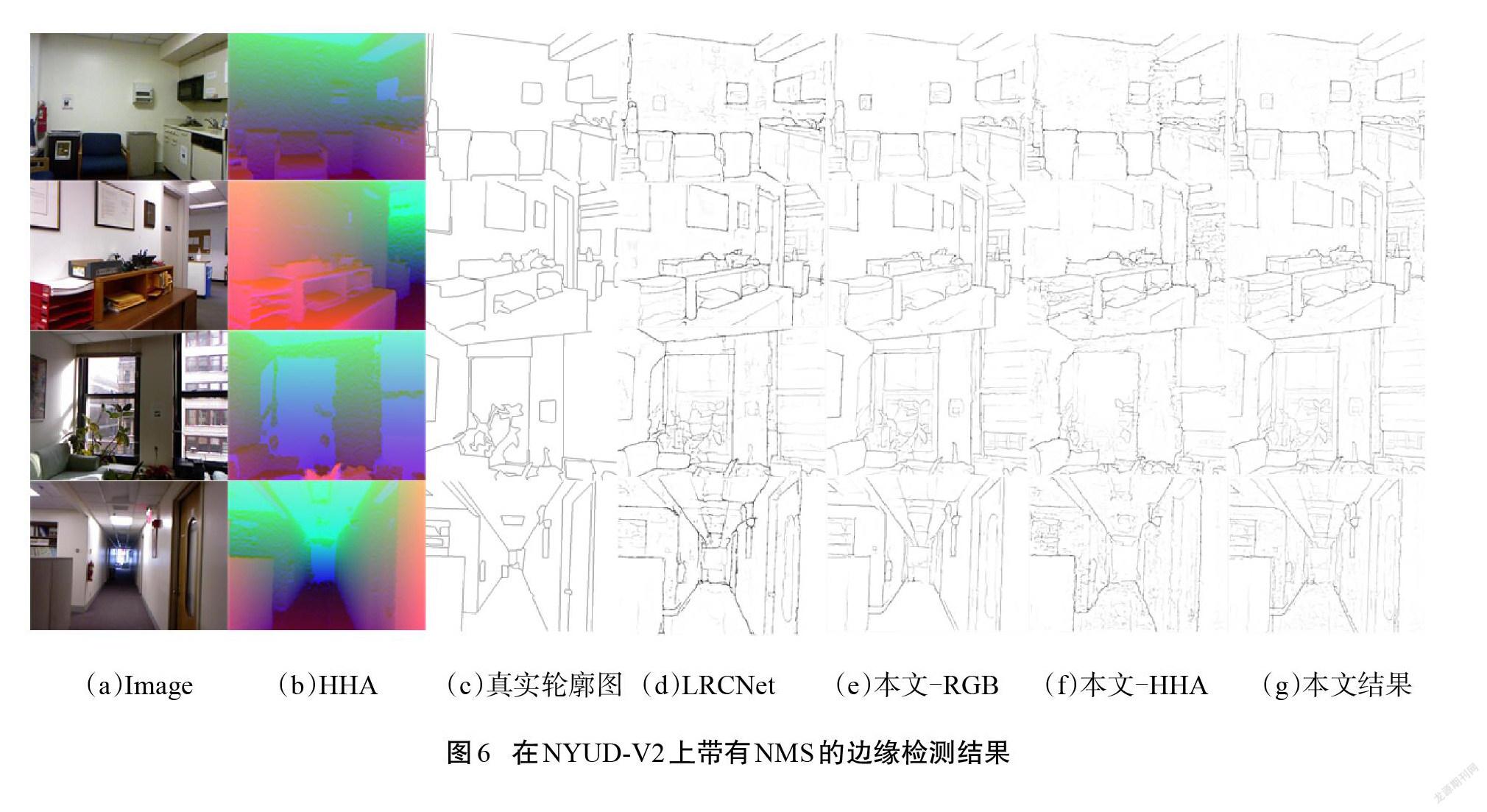

該數據集一共由1 449幅自然圖像組成(381幅訓練圖像,414幅驗證圖像和654幅測試圖像),每幅圖像都對應著由人工標注的真實輪廓,由654幅測試圖像得到NYUD-V2的定量實驗。該數據集共分為2種類型圖片:HHA與RGB圖像。本文在檢測這2種圖片的基礎上將兩者結合,對HHA-RGB進行測試,并將提出的模型與機器學習及其他深度學習的網絡進行了比較,包括gPb-UCM[19]、SE[30]、gPb+NG[31]、OEF[32]、HED[28]、RCF[11]、LPCB[33]、LRC[14]、BDCN[34]。表2為NYUD-V2數據集上ODS、OIS和AP的定量評價結果,圖5為算法在NYUD-V2測試集上的P-R曲線,圖6展示了一些模型在測試集上的定性結果。

由表2、圖5可知,本文網絡用于HHA圖像的ODS達到了0.689,用于RGB圖像的ODS達到了0.743,RGB和HHA平均融合結果的ODS為0.766,OIS為0.779,AP為0.787。以LRCNet為例,本文網絡在RGB上的ODS值可與其持平,在HHA上的結果卻相差甚遠,但RGB和HHA平均融合結果優于LRCNet的結果。說明本文網絡雖可過濾大量的紋理背景,且突出了輪廓特征,但提升效果并不明顯。其主要原因分析圖6可知,RGB和HHA的融合結果中包含了來自HHA預測圖的絕大部分邊緣和背景紋理,影響了最終的檢測結果。

由圖6可以看出,本文模型的預測結果過濾了大量的背景紋理,邊緣更加清晰。

3? ? 結論

提取清晰的底層特征是邊緣檢測的難點之一。近幾年的邊緣檢測模型通常以VGG16為編碼網絡并在此基礎上搭建解碼網絡,忽略了神經元之間復雜的信息流向,且編碼網絡的側面輸出圖邊緣粗糙、攜帶大量的紋理與噪聲。本文從生物視覺出發,摒棄了經典VGG16結構,模擬視覺神經機制中“what”通路的信息傳遞方向,搭建全新的編碼網絡結構,并模擬V4區的特征整合功能設計解碼網絡。經過對比分析,所提出的編碼網絡適用于大部分解碼網絡,并可以表現出良好的成績。整體模型結構在BSDS500數據集和NYUD-V2數據集上進行定性和定量實驗,結果表明,與多個網絡的檢測效果相比,均表現出明顯的優勢。其中,本網絡在BSDS500數據集上,獲得了ODS為0.820的效果,相較于LRCNet提升了0.49%。本文提出的方法為后續輪廓檢測研究提出了一個新的思路,為將生物視覺機制融入視覺任務中拓展了新的方向。

參考文獻

[1]? ? ?林川,曹以雋.基于深度學習的輪廓檢測算法:綜述[J].廣西科技大學學報,2019,30(2): 1-12.

[2]? ? ?CHAPELLE O,HAFFNER P,VAPNIK V N.Support vector machines for histogram-based image classification[J].IEEE Transactions on Neural Networks,1999,10(5):1055-1064.

[3]? ? ?BOSCH A,ZISSERMAN A,MU?OZ X.Image classification using random forests and ferns[C]//2007 IEEE 11th International Conference on Computer Vision,2007.

[4]? ? VIOLA P,JONES M.Rapid object detection using a boosted cascade of simple features[C]//2001 IEEE Computer Society Conference on Computer Vision and Pattern Recognition,2001.

[5] FELZENSZWALB P F,GIRSHICK R B,MCALLESTER D,et al.Object detection with discriminatively trained part-based models[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2010,32(9):1627-1645.

[6]? ? ?PINHEIRO P O,LIN T Y,COLLOBERT R,et al.Learning to refine object segments[C]//14th European Conference on Computer Vision,ECCV,2016:75-91.

[7]? ? ?NOH H,HONG S,HAN B.Learning deconvolution network for semantic segmentation[C]//IEEE Conference on Computer Vision and Pattern Recognition,2015:1520-1528.

[8]? ? ?張曉,林川,王蕤興.輪廓檢測深度學習模型的多尺度特征解碼網絡[J].廣西科技大學學報,2021,32(3):60-66.

[9]? ? ?XIE S,TU Z.Holistically-nested edge detection[C]//Proceedings of the IEEE International Conference on Computer Vision (ICCV),2015 :1395-1403

[10]? ?SIMONYAN K,ZISSERMAN A.Very deep convolutional networks for large-scale image recognition[J].Computer Vision and Pattern Recognition,2014.arXiv:1409.1556.

[11]? ?LIU Y,CHENG M M,HU X W,et al.Richer convolutional features for edge detection[C]//IEEE Conference on Computer Vision and Pattern Recognition,2017:5872-5881.

[12]? ?XU D,OUYANG W L,ALAMEDA-PINEDA X,et al.Learning deep structured multi-scale features using attention-gated CRFs for contour prediction[C]//31st Annual Conference on Neural Information Processing Systems,2017.

[13]? ?WANG Y P,ZHAO X H,HUANG K Q.Deep crisp boundaries[C]//IEEE Conference on Computer Vision and Pattern Recognition,2017:3892-3900.

[14]? ?LIN C,CUI L H,LI F Z,et al.Lateral refinement network for contour detection[J].Neurocomputing,2020,409:361-371.

[15]? ?CAO Y J,LIN C,LI Y J.Learning crisp boundaries using deep refinement network and adaptive weighting loss[J]. IEEE Transactions on Multimedia,2021,23:761-771.

[16]? ?DESIMONE R,SCHEIN S J,MORAN J,et al.Contour,color and shape analysis beyond the striate cortex[J].Vision Research,1985,25(3):441-452.

[17]? ?ENGEL S A,RUMELHART D E,WANDELL B A,et al.fMRI of human visual cortex[J].Nature,1994,369:525-525.

[18]? ?KANDEL E R,SCHWARTZ J H,JESSELL T M,et al.Principles of neural science[M].5th ed.New York:McGraw-Hill? Medical,2012.

[19]? ?ARBELAEZ P,MAIRE M,FOWLKES C,et al.Contour detection and hierarchical image segmentation[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2011,33(5):898-916.

[20]? ?SILBERMAN N,HOIEM D,KOHLI P,et al.Indoor segmentation and support inference from RGBD images[C]//12th European Conference on Computer Vision,2012 :746-760.

[21]? ?LIN T Y,DOLLáR P,GIRSHICK R,et al.Feature pyramid networks for object detection[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition,2016:2117-2125.

[22]? ?GUPTA S,GIRSHICK R,ARBELáEZ P,et al.Learning rich features from RGB-D images for object detection and segmentation[C]//Proceedings of 13th European Conference on Computer Vision,2014.

[23]? ?CANNY J.A computational approach to edge detection[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,1986,8(6):679-698.

[24]? ?YANG K F,GAO S B,GUO C F,et al.Boundary detection using double-opponency and spatial sparseness constraint[J].IEEE Transactions on Image Processing,2015,24(8):2565-2578.

[25]? ?MARTIN D R,FOWLKES C C,MALIK J.Learning to detect natural image boundaries using local brightness,color,and texture cues[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2004,26(5):530-549.

[26]? ?SHEN W,WANG X G,WANG Y,et al.DeepContour:a deep convolutional feature learned by positive-sharing loss for contour detection[C]//IEEE Conference on Computer Vision and Pattern Recognition,2015:3982-3991.

[27]? ?BERTASIUS G,SHI J B,TORRESANI L. DeepEdge:a multi-scale bifurcated deep network for top-down contour detection[C]//IEEE Conference on Computer Vision and Pattern Recognition,2015:4380-4389.

[28]? ?XIE S N,TU Z W.Holistically-nested edge detection[J].International Journal of Computer Vision,2017,125:3-18.

[29]? ?LIU Y,CHENG M M,HU X W,et al.Richer convolutional features for edge detection[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2019,41(8):1939-1946.

[30]? ?DOLLáR P,ZITNICK C L.Fast edge detection using structured forests[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2015,37(8):1558-1570.

[31]? ?KOKKINOS I.Pushing the boundaries of boundary detection using deep learning[C]//International Conference on Learning Representations,2016.

[32]? ?HALLMAN S,FOWLKES C C.Oriented edge forests for boundary detection[C]//IEEE Conference on Computer Vision and Pattern Recognition,2015:1732-1740.

[33]? ?DENG R X,SHEN C H,LIU S J,et al.Learning to predict crisp boundaries[C]//Proceedings of the European Conference on Computer Vision,2018:562-578.

[34]? ?HE J Z,ZHANG S L,YANG M,et al.Bi-directional cascade network for perceptual edge detection[C]//32nd IEEE/CVF Conference on Computer Vision and Pattern Recognition,2019.

An edge detection network simulating the front-end vision mechanism of? "what" pathway

PAN Shenghui, WANG Ruixing, LIN Chuan*

(School of Electrical, Electronic and Computer Science, Guangxi University of Science and Technology,

Liuzhou 545006, China)

Abstract: Edge detection is a key step in image processing. In recent years, edge detection has built an encoding-decoding network based on Convolutional Neural Networks(CNNs), and has achieved good results. Among them, the coding network is usually built based on classic networks such as VGG16, and researchers more focus on the design of the decoding network. Considering that the? ? ? ? existing coding network has limited ability to extract features and ignores the complex information flow between neurons, this study simulates the biological vision mechanism of the retina, the lateral geniculate body(LGN), and the front end of the ventral pathway("what" pathway), including V1, V2, and V4, to build a new encoding network and decoding network. In this paper, the encoding network simulates the information transfer mechanism of the retina-LGN-V1-V2 to fully extract the feature? ? ?information in the image; the decoding network simulates the information integration function of the V4 area, and the adjacent fusion module is designed to integrate the feature prediction of the encoding network to realize the full integration of feature information. This neural network model has performed a large number of experiments on the BSDS500 dataset and NYUD-V2 dataset, and the results have been significantly improved compared with competitors in recent years. Through comparative? ? ? ? ? ? ?experiments, the F value(ODS)of the encoding-decoding method built in this paper is 0.820, which is about 0.49% higher than that of? LRCNet.

Key words: edge detection; biological vision; encoding-decoding network; feature extraction; conventional neural networks(CNNs)

(責任編輯:黎? 婭)