基于多子區策略的絲綢圖像匹配算法

呂文濤 劉志偉 王成群 周迪 馬廷芳 徐偉強

摘要: ?印花是絲綢生產工藝中重要一環,基于圖像的匹配技術可用于檢驗絲綢的印花質量。本文提出了一種基于多子區策略的絲綢彩色圖像和矢量模板圖匹配算法,并采用邊緣信息作為絲綢彩色圖像和矢量圖的共性特征,解決了兩種圖像灰度不一致的問題。對預處理后的絲綢彩色圖像提取圖像邊緣,選取邊緣信息完整的區域作為待匹配子區,采用改進的Hausdorff距離矩陣作為最終的相似度準則。該算法可以獲取較高的匹配正確率,基于真實絲綢場景數據的實驗結果,證明了所提方法的有效性。

關鍵詞: ?絲綢圖像;矢量圖像;多子區匹配;Hausdorff距離;相似性度量

中圖分類號: TS101.1

文獻標志碼: A

文章編號: 1001 7003(2022)03 0001 06

引用頁碼: 031101

DOI: 10.3969/j.issn.1001-7003.2022.03.001 (篇序)

基于計算機視覺的匹配技術在絲綢圖案印刷領域是重要的手段。在實際的生產環境中,獲取絲綢圖像的質量受環境因素的影響較大,光源的位置和角度、絲綢放置時的平整程度、相機的拍攝角度等都會對最終的結果造成很大的影響,使得很多現有的匹配算法不完全適用于絲綢圖像的匹配 ?[1-2] 。

曹霞等 ?[3] 通過多種方法提取圖像的紋理特征,基于層次匹配對紋理特征進行多特征融合處理,彌補了單一匹配方法準確率較低的不足,但在實時性上還存在一定的改進空間。為了實現織物圖像的快速匹配,Zhang等 ?[4] 通過提取織物圖像的SIFT特征,使用K-Means聚類方法形成特征字典,最后通過E2LSH算法織物圖案進行匹配,能夠較大地提升匹配速度。夏明等 ?[5] 通過對輪廓描述值的相似性度量研究,表明匹配圖像的角度余弦值、寬度、高度等因素對輪廓特征描述子有著較大的影響,從理論的角度說明了各因素對匹配結果的影響。基于傳統懸垂指標和織物面密度提出了織物圖像三維懸垂模型 ?[6] 用于織物匹配,在速度和準確率上有良好的平衡,具有較好的工業前景。張聰等 ?[7] 利用Live Wire算法提取服飾圖案的輪廓,將幾何特征、灰度共生矩陣和傅里葉描述符作為特征向量,以此進行匹配并按照相似性度量大小進行排序,相較于其他方法,對于單一的圖案匹配有著更高的匹配準確率。

以上方法大都是基于像素來對織物圖案進行匹配,面對較復雜背景時,這些算法的實時性和準確率都不盡如人意,不能直接應用到絲綢圖像的匹配中。一是由于絲綢的圖案紛雜繁復,背景較為復雜;二是基于像素匹配技術難以直接應用到模板矢量圖的匹配中;三是真實場景下的絲綢圖案匹配對實時性和準確率有著更高的要求。

基于此,本文提出了一種基于多子區策略的絲綢彩色圖像和矢量模板圖匹配算法,采用邊緣信息作為絲綢彩色圖像和矢量圖的共性特征,從而解決了兩種圖像灰度不一致的問題。對預處理后的絲綢彩色圖像提取圖像邊緣,選取邊緣信息完整的區域作為待匹配子區,采用改進的Hausdorff距離矩陣作為最終的相似度準則。該算法可以獲取較高的匹配正確率。

1 圖像預處理

1.1 仿射變換

由于獲取絲綢圖像數據集時工業相機的拍攝角度不同和印刷過程中傳送帶上絲綢可能發生的移動扭曲現象,得到的圖像數據與匹配時用的矢量模板圖存在一定的角度偏差,對后期的匹配成功率和時效性存在很大的影響,因此本文使用仿射變換進行旋轉平移變換以消除影響效率的角度偏差。

在二維平面內,對圖像進行旋轉操作等價于對坐標軸進行旋轉。二維平面內的旋轉平移仿射變換可以用下式來表示:

x′ y′? =? ?cos θ ?sin θ - sin θ ?cos θ ???x y? ???(1)

式中: θ 為旋轉的角度, x、y 為初始坐標, x′、y′ 為變換之后的坐標。

本文通過計算圖像最大外接橢圓的長軸與豎直線的夾角 θ ,得到將變換圖像所需的仿射變換矩陣,利用式(1)即可將圖像變換為指定角度。

1.2 邊緣提取

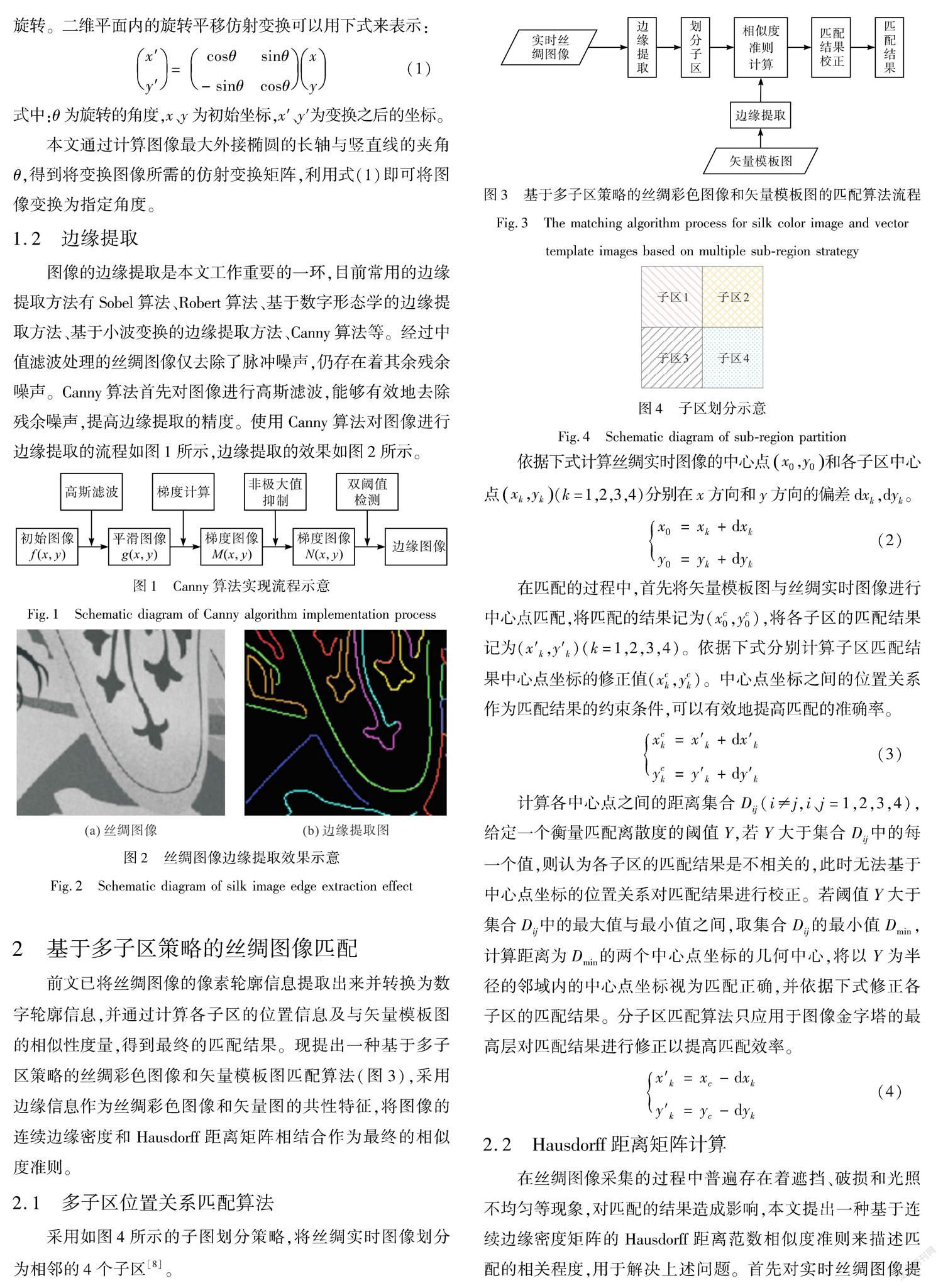

圖像的邊緣提取是本文工作重要的一環,目前常用的邊緣提取方法有Sobel算法、Robert算法、基于數字形態學的邊緣提取方法、基于小波變換的邊緣提取方法、Canny算法等。經過中值濾波處理的絲綢圖像僅去除了脈沖噪聲,仍存在著其余殘余噪聲。Canny算法首先對圖像進行高斯濾波,能夠有效地去除殘余噪聲,提高邊緣提取的精度。使用Canny算法對圖像進行邊緣提取的流程如圖1所示,邊緣提取的效果如圖2所示。

2 基于多子區策略的絲綢圖像匹配

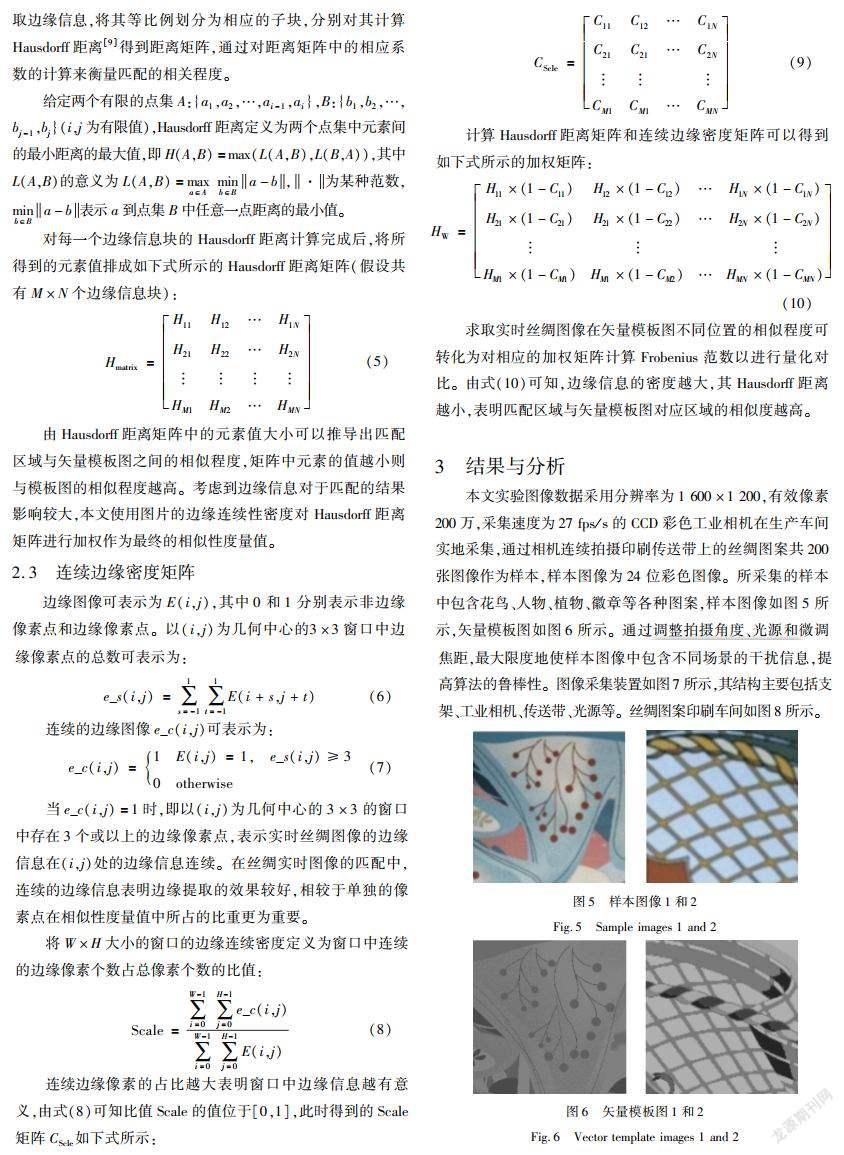

前文已將絲綢圖像的像素輪廓信息提取出來并轉換為數字輪廓信息,并通過計算各子區的位置信息及與矢量模板圖的相似性度量,得到最終的匹配結果。現提出一種基于多子區策略的絲綢彩色圖像和矢量模板圖匹配算法(圖3),采用邊緣信息作為絲綢彩色圖像和矢量圖的共性特征,將圖像的連續邊緣密度和Hausdorff距離矩陣相結合作為最終的相似度準則。

2.1 多子區位置關系匹配算法

采用如圖4所示的子圖劃分策略,將絲綢實時圖像劃分為相鄰的4個子區 ?[8] 。

依據下式計算絲綢實時圖像的中心點 ??x 0,y 0? ?和各子區中心點 ??x k,y k? (k=1,2,3,4) 分別在 x 方向和 y 方向的偏差d x k ,d y k 。

x 0=x k+ d x k y 0=y k+ d y k ???(2)

在匹配的過程中,首先將矢量模板圖與絲綢實時圖像進行中心點匹配,將匹配的結果記為 (x c 0,y c 0) ,將各子區的匹配結果記為 (x′ k,y′ k)(k=1,2,3,4) 。依據下式分別計算子區匹配結果中心點坐標的修正值 (x c k,y c k) 。中心點坐標之間的位置關系作為匹配結果的約束條件,可以有效地提高匹配的準確率。

x c k=x′ k+ d x′ k y c k=y′ k+ d y′ k ???(3)

計算各中心點之間的距離集合 D ?ij (i≠j,i、j=1,2,3,4) ,給定一個衡量匹配離散度的閾值 Y ,若 Y 大于集合 D ?ij ?中的每一個值,則認為各子區的匹配結果是不相關的,此時無法基于中心點坐標的位置關系對匹配結果進行校正。若閾值 Y 大于集合 D ?ij ?中的最大值與最小值之間,取集合 D ?ij ?的最小值 D ??min ,計算距離為 D ??min 的兩個中心點坐標的幾何中心,將以 Y 為半徑的鄰域內的中心點坐標視為匹配正確,并依據下式修正各子區的匹配結果。分子區匹配算法只應用于圖像金字塔的最高層對匹配結果進行修正以提高匹配效率。

x′ k=x c- d x k y′ k=y c- d y k ???(4)

2.2 Hausdorff距離矩陣計算

在絲綢圖像采集的過程中普遍存在著遮擋、破損和光照不均勻等現象,對匹配的結果造成影響,本文提出一種基于連續邊緣密度矩陣的Hausdorff距離范數相似度準則來描述匹配的相關程度,用于解決上述問題。首先對實時絲綢圖像提取邊緣信息,將其等比例劃分為相應的子塊,分別對其計算Hausdorff距離 ?[9] 得到距離矩陣,通過對距離矩陣中的相應系數的計算來衡量匹配的相關程度。

給定兩個有限的點集 A:{a 1,a 2,…,a ?i-1 ,a i},B:{b 1,b 2,…,b ?j-1 ,b j}(i,j為有限值) ,Hausdorff距離定義為兩個點集中元素間的最小距離的最大值,即 H(A,B) =max (L(A,B), L(B,A)) ?,其中 L(A,B) 的意義為 L(A,B) = max ??a∈A ????min ??b∈B ???a-b ?, · 為某種范數, min ??b∈B? a-b ?表示 a 到點集 B 中任意一點距離的最小值。

對每一個邊緣信息塊的Hausdorff距離計算完成后,將所得到的元素值排成如下式所示的Hausdorff距離矩陣(假設共有 M×N 個邊緣信息塊):

H ??matrix ?=? H ?11 ?H ?12 ?… H ?1N ?H ?21 ?H ?22 ?… H ?2N? ? H ?M1 ?H ?M2 ?… H ?MN ?????(5)

由Hausdorff距離矩陣中的元素值大小可以推導出匹配區域與矢量模板圖之間的相似程度,矩陣中元素的值越小則與模板圖的相似程度越高。考慮到邊緣信息對于匹配的結果影響較大,本文使用圖片的邊緣連續性密度對Hausdorff距離矩陣進行加權作為最終的相似性度量值。

2.3 連續邊緣密度矩陣

邊緣圖像可表示為 E(i,j) ,其中0和1分別表示非邊緣像素點和邊緣像素點。以 (i,j) 為幾何中心的 3×3窗 口中邊緣像素點的總數可表示為:

e_s(i,j)= ∑ ?1 s=-1 ?∑ ?1 t=-1 E(i+s,j+t) ??(6)

連續的邊緣圖像 e_c(i,j) 可表示為:

e_c(i,j)= 1 E(i,j)=1, e_s(i,j)≥3 0 ?otherwise ????(7)

當 e_c(i,j)=1 時,即以 (i,j) 為幾何中心的3×3的窗口中存在3個或以上的邊緣像素點,表示實時絲綢圖像的邊緣信息在 (i,j) 處的邊緣信息連續。在絲綢實時圖像的匹配中,連續的邊緣信息表明邊緣提取的效果較好,相較于單獨的像素點在相似性度量值中所占的比重更為重要。

將 W×H 大小的窗口的邊緣連續密度定義為窗口中連續的邊緣像素個數占總像素個數的比值:

Scale = ?∑ ?W-1 i=0 ?∑ ?H-1 j=0 e_c(i,j) ?∑ ?W-1 i=0 ?∑ ?H-1 j=0 E(i,j) ???(8)

連續邊緣像素的占比越大表明窗口中邊緣信息越有意義,由式(8)可知比值Scale的值位于[0,1],此時得到的Scale矩陣 C ??Scle 如下式所示:

C ??Scle ?=? C ?11 ?C ?12 ?… C ?1N ?C ?21 ?C ?21 ?… C ?2N ? ?C ?M1 ?C ?M1 ?… C ?MN ?????(9)

計算Hausdorff距離矩陣和連續邊緣密度矩陣可以得到如下式所示的加權矩陣:

H ?W =?? H ?11 ×(1-C ?11 ) H ?12 ×(1-C ?12 ) … H ?1N ×(1-C ?1N ) H ?21 ×(1-C ?21 ) H ?21 ×(1-C ?22 ) … H ?2N ×(1-C ?2N )?H ?M1 ×(1-C ?M1 ) H ?M1 ×(1-C ?M2 ) … H ?MN ×(1-C ?MN )?? ???(10)

求取實時絲綢圖像在矢量模板圖不同位置的相似程度可轉化為對相應的加權矩陣計算Frobenius范數以進行量化對比。由式(10)可知,邊緣信息的密度越大,其Hausdorff距離越小,表明匹配區域與矢量模板圖對應區域的相似度越高。

3 結果與分析

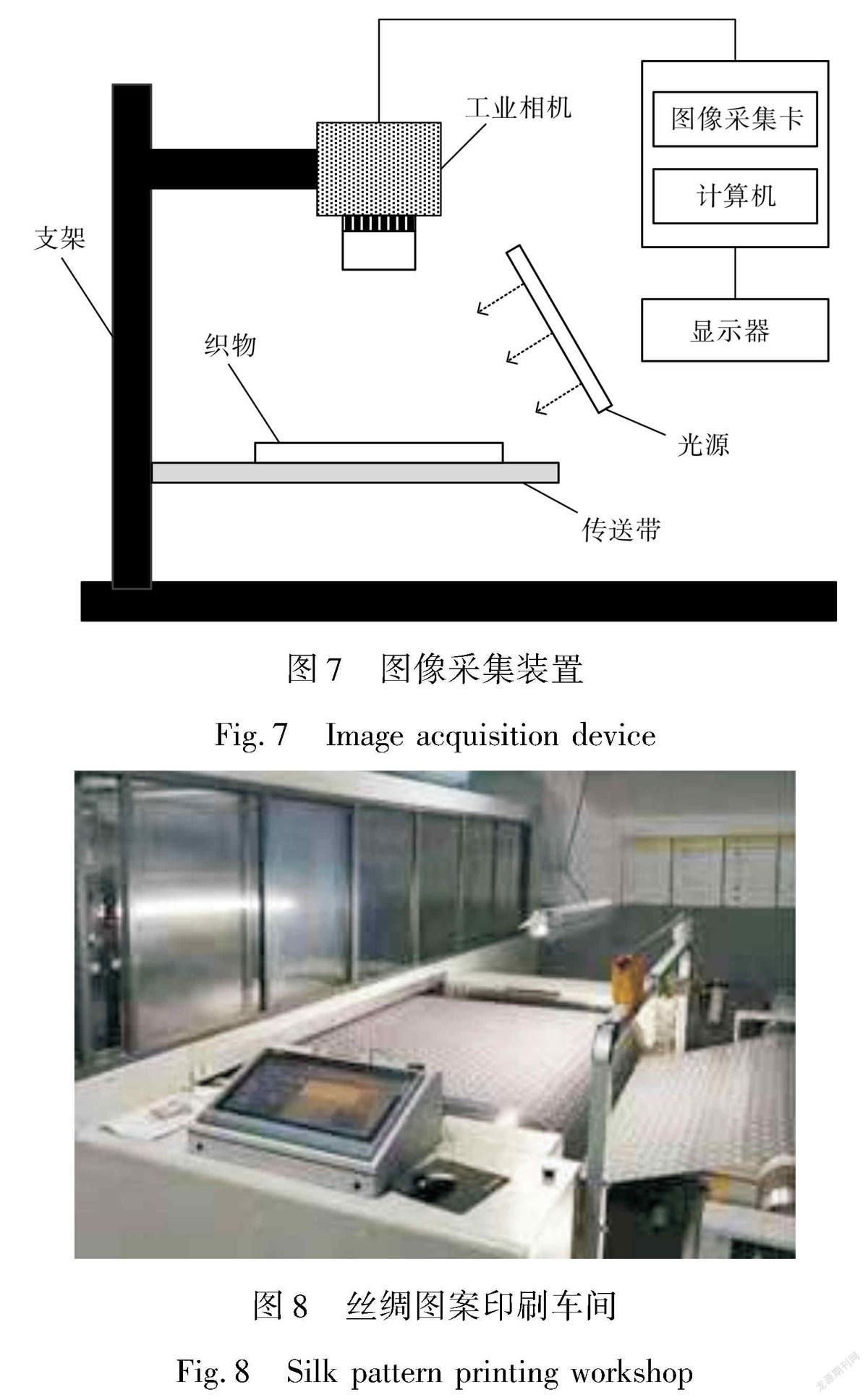

本文實驗圖像數據采用分辨率為1 600×1 200,有效像素200萬,采集速度為27 fps/s的CCD彩色工業相機在生產車間實地采集,通過相機連續拍攝印刷傳送帶上的絲綢圖案共200張圖像作為樣本,樣本圖像為24位彩色圖像。所采集的樣本中包含花鳥、人物、植物、徽章等各種圖案,樣本圖像如圖5所示,矢量模板圖如圖6所示。通過調整拍攝角度、光源和微調焦距,最大限度地使樣本圖像中包含不同場景的干擾信息,提高算法的魯棒性。 圖像采集裝置如圖7所示,其結構主要包括支架、工業相機、傳送帶、光源等。絲綢圖案印刷車間如圖8所示。

實驗設備計算機硬件CPU為Intel i5-10400,主頻為 2.9 GHz ,內存為16 GB,硬盤規格為500 GB,實驗編程工具為MathWorks公司出品的Matlab2020a。

3.1 算法魯棒性測試

為了驗證本文所提出算法在生產中常見的干擾因素諸如噪聲干擾、光照不一致等環境下的魯棒性,對數據集圖片進行如圖9、圖10所示的數據增強處理。使用本文方法分別對實時絲綢圖像和矢量模板圖的相關區域進行匹配,記錄最終平均匹配系數、匹配時間和匹配成功率,結果如表1、表2所示。

通過將本文提出的方法在不同程度的高斯噪聲、不同強 度的光照條件下的圖片與原圖實驗數據進行對比,可以發現在噪聲干擾和光照變化的情況下,本文方法均具有強魯棒性,可以在保持較高的準確率情況下同時保證實時性,以滿足工業生產中的實際應用。

3.2 驗證算法的有效性

為驗證本文所提出算法的有效性,首先提取預處理過的實時絲綢樣本圖像的邊緣信息,并選取邊緣信息較為完整的區域劃分為4個相鄰的子區。使用本文方法、改進的尺度不變特征變換 ?[10] (F-SIFT)、改進的快速魯棒性尺度不變特征 ?[11] ?(K-SURF)共 3種方法對實時絲綢圖像和矢量模板圖的相關區域進行匹配, 分別記錄200張圖片的匹配系數、匹配時間和匹配成功率,其結果如表3所示。圖11為F-SIFT算法的匹配結果,圖12為K-SURF算法的匹配結果,圖13為本文方法的匹配結果。

通過將本文提出的方法與F-SIFT算法、K-SURF算法在絲綢實時圖像上進行對比,可以發現本文方法可以更加準確地提取出圖像中用于匹配的特征點,從而更加精確地對絲綢圖案進行匹配。由表3可以看出,本文算法在圖片的平均匹配系數、匹配時間和匹配成功率三個方面均有著較大的提升,實驗證明了算法的有效性。

4 結 論

本文針對絲綢圖案紛雜繁復、背景較為復雜的特點,提出了一種基于多子區策略的絲綢彩色圖像和矢量模板圖的匹配算法,采用邊緣信息作為絲綢彩色圖像和矢量圖的共性特征,解決了兩種圖像灰度不一致的問題。對經過預處理的絲綢彩色圖像提取圖像邊緣,選取邊緣信息完整的區域作為待匹配子區,結合圖像的連續邊緣密度信息與Hausdorff距離作為最終的相似度準則,使得匹配正確率有了較大的提高。

由于絲綢圖案的復雜多樣性,本文算法仍然存在一些不足之處,主要表現為邊緣信息提取的質量不高,在背景圖案的交匯處易發生丟失信息的現象,影響最后的匹配結果。因此,如何進一步高質量地提取絲綢圖案的邊緣信息將是下一步研究的主要工作。

參考文獻:

[1] REN J X, CHEN G, LI X Y. A fine grained digital textile printing system based on image registration[J]. Computers in Industry, 2017, 92/93: 152-160.

[2] 賈迪, 朱寧丹, 楊寧華, 等. 圖像匹配方法研究綜述[J]. 中國圖象圖形學報, 2019, 24(5): 677-699.

JIA Di, ZHU Ningdan, YANG Ninghua, et al. Image matching methods[J]. Journal of Image and Graphics, 2019, 24(5): 677-699.

[3] 曹霞, 李岳陽, 羅海馳, 等. 蕾絲花邊的改進型紋理特征檢索方法[J]. 紡織學報, 2016, 37(6): 142-147.

CAO Xia, LI Yueyang, LUO Haichi, et al. Lace retrieval method based on improved texture feature[J]. Journal of Textile Research, 2016, 37(6): 142-147.

[4]ZHANG X Q, LIU Y Y, WEI Y F. A fast fabric image matching and retrieval algorithm based on locality-sensitive hashing and visual word [C]//IFTC 2017: Digital TV and Wireless Multimedia Communication. ?Singapore: Springer Singapore, 2018, 815: 25-35.

[5] 夏明, 宋婧, 姜朝陽, 等. 基于連衣裙結構特征匹配的款式識別技術[J]. 紡織學報, 2020, 41(7): 141-146.

XIA Ming, SONG Jing, JIANG Zhaoyang, et al. Style recognition technique based on feature matching in dress construction[J]. Journal of Textile Research, 2020, 41(7): 141-146.

[6] 余志才, 鐘躍崎, GONG R H, 等. 基于三維懸垂模型和織物面密度的織物匹配[J]. 紡織學報, 2020, 41(10): 46-51.

YU Zhicai, ZHONG Yueqi, GONG R H, et al. Fabric matching based on three-dimensional drape model and fabric weight[J]. Journal of Textile Research, 2020, 41(10): 46-51.

[7] 張聰, 李岳陽, 羅海馳, 等. 基于交互式分割的蕾絲花型檢索算法[J]. 絲綢, 2018, 55(4): 38-43.

ZHANG Cong, LI Yueyang, LUO Haichi, et al. Lace retrieval algorithm based on interactive segmentation[J]. Journal of Silk, 2018, 55(4): 38-43.

[8] 李天池, 張紹明, 何向晨, 等. 基于位置關系約束的SAR圖像與光學圖像匹配[J]. 系統工程與電子技術, 2007(6): 878-882.

LI Tianchi, ZHANG Shaoming, HE Xiangchen, et al. Matching SAR image to optical image with spatial relation constrain[J]. Systems Engineering and Electronics, 2007(6): 878-882.

[9] 徐一鳴, 劉曉利, 劉怡昕. 基于分割模板加權Hausdorff距離矩陣的特征匹配算法[J]. 兵工學報, 2011, 32(11): 1353-1358.

XU Yiming, LIU Xiaoli, LIU Yixin. A feature matching algorithm based on template partition weighted Hausdorff distance matrix[J]. Acta Armamentarii, 2011, 32(11): 1353-1358.

[10]? 丁國紳, 喬延利, 易維寧, 等. 基于光譜圖像空間的F-SIFT特征提取與匹配[J]. 光學精密工程, 2021, 29(5): 1180-1189.

DING Guoshen, QIAO Yanli, YI Weining, et al. Feature extraction and matching of F-SIFT based on spectral image space[J]. Optics and Precision Engineering, 2021, 29(5): 1180-1189.

[11]? 唐穎復, 王忠靜, 張子雄. 基于改進SIFT和SURF算法的沙丘圖像配準[J]. 清華大學學報(自然科學版), 2021, 61(2): 161-169.

TANG Yingfu, WANG Zhongjing, ZHANG Zixiong. Registration of sand dune images using an improved SIFT and SURF algorithm[J]. Journal of Tsinghua University (Science and Technology), 2021, 61(2): 161-169.

Silk image matching algorithm based on multiple sub-region strategy

Lu Wentao ?1a , LIU Zhiwei ?1a , WANG Chengqun ?1a , ZHOU Di 2, MA Tingfang 3, XU Weiqiang ?1b

(1a.School of Information Science and Technology; 1b.College of Textile Science and Engineering, Zhejiang Sci-Tech University, Hangzhou 310018, China; 2.Zhejiang Uniview Technologies Co. , Ltd. , Hangzhou 310018, China; 3.WENSLI Group Co. , Ltd. , Hangzhou 310018, China)

Abstract:

Silk textile industry is an important part of Chinas light industry system, occupying a pivotal position in the national economy. The production and export scale of silk products is among the top in the global market. With the comprehensive promotion of "Made in China 2025", the combination of silk product manufacturing and industrialized intelligent detection has become the important means and development trend to improve product quality and reduce production costs.

The matching method based on computer vision technology is an important means in the field of silk pattern printing. In the actual production environment, due to such factors as the position and angle of the light source, the flatness of the silk when placed and the shooting angle of the camera, the quality of the acquired silk images varies, thereby greatly influencing the final matching results. When handling silk patterns with complex backgrounds, the existing matching algorithm is not satisfactory in terms of the real-time and accuracy rate, making it unapplicable to the matching of silk images. There are three reasons. Firstly, the silk patterns are complicated and the backgrounds are complex. Secondly, it is difficult to directly apply pixel-based matching technique to the matching of template vector images, and thirdly, real-scenario silk pattern matching sets higher requirements for real-time and accuracy.

In this paper, a matching algorithm for silk color images and vector template images based on multiple sub-region strategy was proposed, solving the grayscale inconsistency problem of the two images with edge information as the common feature of silk color images and vector images. Firstly, the angle of the image to be matched was adjusted by affine transformation to eliminate the angle difference with the vector template images to improve the matching efficiency. The edges of the pre-processed silk color images were extracted using Canny algorithm, the continuous edge density matrix of the edge pattern was calculated, the region with complete edge information was selected as the sub-region to be matched, and the geometric constraint relationship of the sub-region was calculated to improve the matching efficiency. The edge continuity of the image was commonly obscured, broken and unevenly illuminated in the process of silk image acquisition, affecting the matching results. Thus, we proposed a Hausdorff distance norm similarity criterion based on the continuous edge density matrix to describe the correlation degree of matching. Considering the great influence of edge information on the matching results, the edge continuity density of the image was used for the weighting of Hausdorff distance matrix, with the result being the final similarity measurement value. The obtained similarity degree of real-time silk images at different positions of the vector template images could be converted into the calculation of the Frobenius norm for the corresponding weighting matrix in order to conduct quantative comparison and finally the matching results are obtained. The algorithm can obtain a high matching accuracy. By testing the robustness and accuracy of the real-scenario silk patterns, the effectiveness of the proposed method is proved.

Key words:

silk images; vector images; multiple sub-region matching; Hausdorff distance; similarity measurement