動態視覺傳感器的目標檢測算法對比分析

邱忠宇,趙文龍,高 文,潘洪濤,史冉東

(上海機電工程研究所,上海 201109)

0 前 言

近年來,機器視覺在安防、軍事、醫療、工業農業生產等諸多領域大放異彩,但面對復雜環境,圖像傳感器仍無法平衡高精度與低計算消耗的關系。1991年,《Scientific American》雜志上刊登了一張由模仿眼睛神經結構的新型硅視網膜獲得的貓的圖像[1],這是首次從生物學和工程學角度研究立體視覺問題并產生成果,也標志著視覺仿生神經形態領域的揭幕。事件相機作為一種異步傳感器,改變了傳統獲取視覺信息的方式,從原來的根據時鐘周期采樣獲取視覺信息,變為依靠動態場景中光線變化獲取視覺信息,這與視網膜系統的信號傳輸有著極大相似之處。

動態視覺傳感器最早源于瑞士的J?rg Kramer 教授設計的第一款異步動態視覺傳感器(dynamic vision sensor,DVS),其成像規格為48×48,每個像素點會根據光照強度變化,輸出ON/OFF 事件[2-3]。2004年,瑞士的Lichtsteiner 等[4]在動態視覺傳感器中加入反饋機制,加快了模型反應速度,提高了傳感器的動態范圍。2006年到2008年,Lichtsteiner 等[5]將前端光感受器與開關電容差分電路相結合,使得響應延遲值進一步降低,動態范圍也有所提升。2009年,奧地利的Posch團隊[6]設計了一款基于事件的紅外視覺傳感器。2014年,瑞士Berner 等[7]設計了動態有源像素視覺傳感器(dynamic and active pixel vision sensor,DAVIS),實現異步事件和同步幀級圖像的同時輸出。

事件相機以其微秒級的時間分辨率、低延遲、高動態范圍和低功耗的特性,在高速、高動態范圍等挑戰性場景中有著極高的應用潛力。本文通過對基于事件的特征檢測算法和基于事件的卷積神經網絡算法這兩種目標檢測算法進行對比分析,驗證基于事件的卷積神經網絡算法在多目標、高速場景檢測的優越性。

為驗證檢測算法,根據MNIST-DVS 數據集和POKER-DVS 數據集進行目標檢測,具體流程如圖1所示。基于事件的特征檢測算法采用第一章的積分模型和LS(leaky surface)模型進行事件相機數據的預處理,并通過改進方向梯度直方圖(histogram of oriented gradient,HOG)算法進行特征提取,改進支持向量機(support vector machine,SVM)分類器進行特征分類,進而實現目標的檢測與分類。基于事件的卷積神經網絡算法采用第一章的LS 模型,將其放在神經網絡模型的第一層進行事件處理,然后進行神經網絡的模型訓練,最終實現基于事件的卷積神經網絡的目標檢測。

1 動態視覺傳感器事件處理

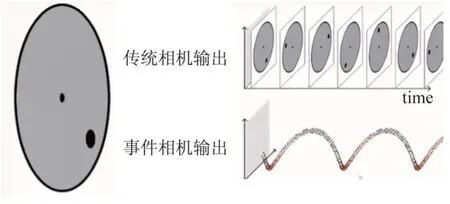

動態視覺傳感器作為一種異步傳感器,改變了傳統獲取視覺信息的方式。動態視覺傳感器與傳統圖像傳感器的區別在于,動態視覺傳感器沒有“幀”的概念,主要利用動態場景的光照強度變化進行采樣,輸出由微秒級的事件組成,類似于點云,不受傳輸速度的限制,圖2 為傳統圖像傳感器與動態視覺傳感器的對比。

圖2 傳統圖像傳感器與動態視覺傳感器的輸出對比Fig.2 Output comparison between traditional imaging sensor and dynamic vision sensor

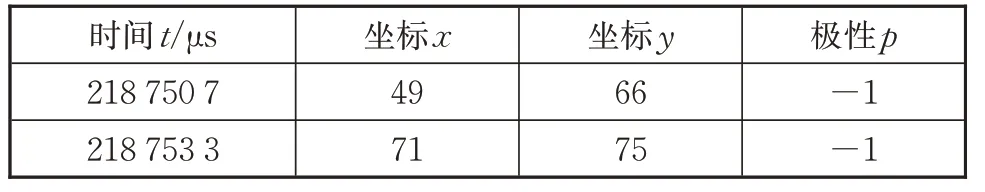

動態視覺傳感器的輸出樣例如表1 所示,共有4個變量,分別為時間t、像素點橫坐標x、縱坐標y、極性p。時間t單位為微秒級分辨率,較為精確地表示出像素點的光照強度變化時間;坐標(x,y)構成一個二維空間,表示像素點的位置;極性p∈{-1,1}表示某一個像素點的光照強度是否發生變化。如果p無變化則動態視覺傳感器沒有事件輸出;如果像素點的光照強度變亮超過某個閾值,則極性為1;如果像素點的光照強度變暗超過某個閾值,則極性為-1。有效提取事件信息是一個重要的研究內容,本文參照已有方法選取兩種模型進行對比。

表1 動態視覺傳感器輸出樣例Tab.1 Output sample of dynamic vision sensor

1.1 LS模型

CanniciM 等[8]設計一種LS 模型,將動態視覺傳感器產生的稀疏事件整合到一個表面,用于卷積神經網絡的事件預處理,便于后續卷積層、池化層的內部數據處理和修改信息的向下傳遞。

參照尖峰神經網絡具有保持過去事件記憶的功能,其主要通過一個能夠累積事件的體系結構將動態視覺傳感器產生的稀疏事件整合到LS模型上。時刻t產生的事件對應像素坐標(xe,ye)和時間戳tts,每個像素位置(x,y)產生一定的增量Δincr。此外,表面所有像素的衰減量取決于上一次接收到的事件和先前接收到的事件之間的時間間隔,因此,t時刻的表面像素(x,y)對應值具體可以表示為

式中:表示LS 模型上的像素坐標(x,y)的值;Δleak=λ·(tts-tt-1s)。λ和Δincr對整個模型有很大影響:Δincr決定每個事件中包含多少信息,而λ定義了其中的衰減率,可通過調整λ和Δincr決定每個像素點值的累積,最大值化操作可防止像素值變為負值。

1.2 積分模型

解決稀疏事件還有另外一種方式——積分模型[9],主要是將每個像素點的事件轉化為一系列的連續函數,然后通過積分實現圖像重構。

根據輸出事件e={tts,x,y,p},基于事件相機的積分模型可表示為

式中:ex,y(t)表示隨時間變化的連續函數;δts(t)是一個脈沖函數,事件序列被轉換成連續時間信號,由一系列脈沖組成;表示時間戳為tts的位置(x,y)的事件輸出極性。這樣,圖像中每一個像素點都有對應的一個ex,y(t)來表示。

接著定義增量E為時間段[f,t]之間的事件的積分累加,可表達為

通過得到的增量E,將其與原始值進行整合,像素點(x,y)對應值可表達為

2 基于事件的特征檢測算法

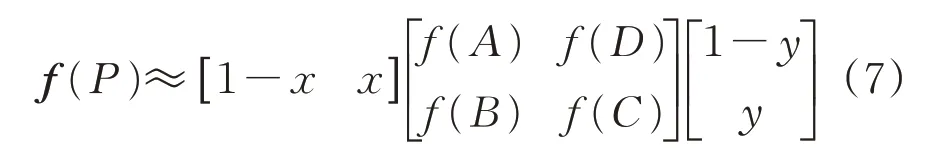

基于事件的特征檢測算法采用改進HOG 算法[10]和改進多分類SVM 算法[11-12]。首先采用LS 模型或積分模型將事件形成到某一平面,再通過改進HOG算法和改進多分類SVM 算法進行特征提取和目標檢測。HOG特征提取算法,在進行梯度計算之前通過高斯濾波實現圖像的平滑操作,對梯度方向位于相鄰區間的中心之間的方向和位置進行雙線性插值,可降低圖像的局部細節特征,提高圖像的整體細節性,原理如圖3所示。點M、N、P像素值的計算公式為

圖3 雙線性插值原理Fig.3 Schematic diagram of bilinear interpolation

并將A、B、C、D的坐標(0,0)、(0,1)、(1,0)和(1,1)代入,化簡可得矩陣表達形式為

式中:f(A)、f(B)、f(C)、f(D)、f(M)、f(N)、f(P)分別為像素點A、B、C、D、M、N、P的像素值。

SVM分類器只是一個二分類模型,要將多分類復雜問題轉換為二分類的簡單問題,可通過采用多個SVM 分類器來實現多分類目的。由于目標檢測中提取出來的特征向量中背景類別通常占絕大部分,因此本文對二叉樹的分類方法進行了改進。首先將背景與其他類別通過SVM 分類器進行分類,以有效地分離背景特征類別與目標特征類別,最大限度地提高目標檢測的精度。改進多分類SVM 算法如圖4所示,步驟為:

圖4 改進多分類SVM算法Fig.4 Improved multi-classification SVM algorithm

1)將訓練樣本數據集輸入SVM 模型中,得到一個初步分類背景特征與目標特征的SVM模型S。

2)通過模型S將目標特征和背景特征分為兩大類。

3)根據目標特征類別數量N判定是否需要進行二分類。如果N≤6,可直接進行逐個分類;否則,則需要先進行二分類,再次將目標特征分成兩大類,以減少錯誤累積。

4)輸出各個特征類別,實現目標檢測。

3 基于事件的卷積神經網絡算法

本文采用已有的基于事件的深度學習目標檢測算法——Event-YOLO[8]進行驗證,基于事件的卷積神經網絡,對卷積層和池化層進行重新表達,通過重新計算更新事件的像素區域的特征,并以此實現最終的目標預測。在此設計中,特征圖只會在新事件傳入時才進行更新,此外,Event-YOLO 引入了衰減機制,隨著時間推移,某些像素點的增量在各個隱藏層也會不斷衰減,這也導致了計算出來的特征信息會隨著視覺信息在輸入端的消失而逐漸衰減消失。

Event-YOLO算法的網絡架構主要參照了YOLO檢測網絡[13],加入了LS 模型,并改進了卷積層、池化層、全連接層。基于事件的卷積層(e-conv)的主要功能是:通過事件更新來確定此刻的特征圖相比于上一時刻特征圖在哪個區域發生變化,便于重新計算已經發生變化的特征圖和重用未變化的特征圖。基于事件的最大池化層的設計核心在于:在最大池化層的每個接收域中,最大值的位置可能會隨著時間保持不變,利用此性質可避免每次重新計算最大值的位置。全連接層可用1×1的基于事件的卷積層來代替,將之前層提取的特征映射成一組向量。損失函數與YOLO網絡損失函數相同。

Event-YOLO 網絡結構如圖5 所示,網絡采用事件流作為輸入,通過LS 模型將事件集成到一個表面上,并采用基于事件的卷積層、基于事件的最大池化層對事件進行特征提取,最后形成可用于目標檢測和分類的網絡結構。所采用的事件數據集像素大小均為128×128或256×256,因此本文將輸入表層劃分成4×4 個區域,這樣無論數據集尺寸為何種形式,都無需對網絡進行大的修改。此外,本網絡結構設置每個區域需要預測兩個回歸框,即B=2,由于類別根據數據集的不同有所差異,在MNIST-DVS 數據集中,共有10個數字,類別數目C=10。

圖5 Event-YOLO網絡結構Fig.5 Event-YOLO network structure

4 仿真結果及分析

4.1 檢測數據集

目前傳統圖像的目標檢測數據集數不勝數,但DVS尚處于起步階段,公開的基于事件的數據集資源稀缺。目前最流行的數據集有:MINST-DVS、POKER-DVS[14]、CIFAR10-DVS[15],這些數據集大多來源于傳統的數據集。受限于數據集,本文采用MINST-DVS、POKER-DVS兩種數據集進行檢測。

MNIST-DVS數據集是由塞維利亞微電子研究所制作,來源于傳統圖像MNIST數據集。MNIST-DVS數據集通過平滑插值算法,將原始尺寸的手寫數字圖像放大4、8、16倍,最終通過動態視覺傳感器錄制300 00組事件數據集,其中0~9每個數字各有3 000組。

POKER-DVS 數據集是一個小的神經擬態記錄的數據集,通過在DVS前快速瀏覽定制撲克牌而制作形成,此數據集包含了黑桃、紅桃、方塊、梅花4 類目標,每組數據像素大小為31×31。POKER-DVS 數據集數據樣本過少,為便于應用到目標檢測算法中,本文進行處理,每個時長控制在1.5 ms 左右,并結合撲克牌中的邊界框,最終形成了292個數據樣本。

為驗證已有算法的準確性,本文設計了單目標、多目標、快速運動場景進行試驗驗證。在單目標檢測中,采用MNIST-DVS 數據集進行驗證;多目標和快速運動場景采用POKER-DVS數據集。

4.2 MNIST-DVS數據集檢測結果分析

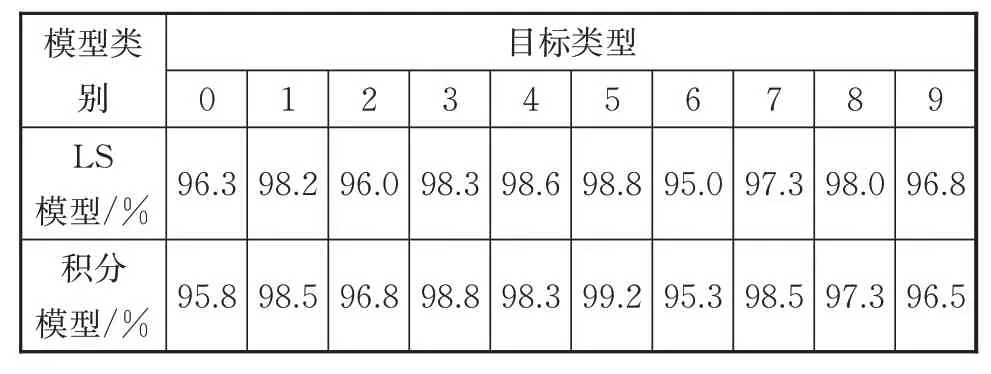

單目標檢測采用MNIST-DVS 數據集進行驗證,在基于事件的特征檢測算法中,采用不同的事件處理模型對MNIST-DVS 數據集進行檢測,檢測結果如表2 所示。由表2 可知,數字6 和數字9 在不同的角度有著極大的相似性,且兩者的檢測精度較低,其主要原因在于錯誤的分類。此外根據數據還可以發現,積分模型和LS 模型這兩種模型對事件的處理結果精度大致相當。

表2 基于事件的特征檢測結果Tab.2 Result of event-based feature detection

MINST-DVS 數據集下,基于事件的特征檢測算法準確率為97.3%,基于事件的卷積神經網絡算法準確率為98.2%(事件處理后3 種不同尺寸數字圖片的檢測結果如圖6 所示)。兩種算法檢測準確率都比較高,均在97%以上,其原因在于該數據集背景較為簡單,事件處理模型可以快速地將事件背景剔除,形成只有數據的表層,這種檢測較為簡單且準確率會很高。

圖6 MINST-DVS數據Fig.6 MINST-DVS dataset

4.3 POKER-DVS數據集檢測結果分析

在快速場景目標檢測中,基于事件的特征檢測算法結果較差,準確率為52.6%,檢測效果較差的原因不在此文中進行分析。面對多目標檢測,簡單的基于事件的檢測網絡結構不足以實現復雜的目標檢測,因此本實驗加深網絡層次,加深了Event-YOLO網絡,增加基于事件的卷積層的層數,并將其網絡結構命名為Event-YOLO-D。POKER-DVS 數據集檢測結果如圖7所示。

圖7 POKER-DVS數據Fig.7 POKER-DVS dataset

根據數據集檢測結果,如表3所示,對于單目標檢測,不同的檢測網絡目標檢測準確率均高達98%以上,精度較高,符合驗證性能;對于多目標和快速運動場景,受限于數據集較小,且目標在DVS 中閃動極為快速,檢測準確率相對不高,但增加網絡層數對檢測的準確度有明顯提升,基于DVS的目標檢測效果已經遠遠高于同類別的傳統圖像檢測效果。

表3 不同數據集的檢測結果Tab.3 Detection results of different dataset

5 結束語

本文針對動態視覺傳感器輸出事件特性的分析,提出兩種處理事件模型并通過算法檢測仿真進行比較,仿真結果表明,相同條件下兩種處理事件模型的檢測準確度無較大差異。此外,本文根據基于事件的特征檢測算法和卷積神經網絡算法,分別對MNISTDVS和POKER-DVS數據集進行單目標、多目標和快速場景檢測,基于事件的卷積神經網絡算法檢測效果更佳,網絡層數越多,檢測精度越高,驗證了基于事件的卷積神經網絡算法在多目標、高速場景檢測的優越性。