融合特征的深度學(xué)習(xí)遙感圖像目標(biāo)檢測(cè)模型

張永福,宋海林,班 越,汪西莉

(陜西師范大學(xué) 計(jì)算機(jī)科學(xué)學(xué)院,陜西 西安 710119)

0 引 言

目標(biāo)檢測(cè)是計(jì)算機(jī)視覺(jué)的研究熱點(diǎn)之一,隨著遙感衛(wèi)星以及無(wú)人機(jī)的增多,遙感圖像數(shù)據(jù)的大數(shù)據(jù)特點(diǎn)日益凸顯。遙感圖像目標(biāo)檢測(cè),即在遙感圖像中獲取特定目標(biāo)的位置和類(lèi)別,在公共安全、車(chē)輛監(jiān)控、智慧城市等諸多方面具有重要的應(yīng)用價(jià)值。遙感圖像目標(biāo)檢測(cè)和普通光學(xué)圖像目標(biāo)檢測(cè)相比有很多不同,如遙感圖像尺寸較大,而目標(biāo)相對(duì)所占比例小,目標(biāo)可能非常密集,且目標(biāo)的大小、姿態(tài)等可能會(huì)有很大的不同,遙感圖像中的復(fù)雜背景以及遮擋、陰影等也會(huì)使目標(biāo)檢測(cè)難度增加。針對(duì)這些挑戰(zhàn)及標(biāo)記樣本較少的實(shí)際情況,提出了一種融合特征的深度學(xué)習(xí)遙感圖像目標(biāo)檢測(cè)模型,貢獻(xiàn)主要有:小規(guī)模的網(wǎng)絡(luò)結(jié)構(gòu)應(yīng)對(duì)標(biāo)記樣本少的問(wèn)題,多級(jí)特征融合策略應(yīng)對(duì)不同尺度目標(biāo)檢測(cè)難題,新的后處理算法進(jìn)一步提升檢測(cè)精度。所提模型和Faster R-CNN相比在提高檢測(cè)精度的同時(shí)降低了漏檢率和誤檢率。

1 相關(guān)工作

隨著深度學(xué)習(xí)的興起,卷積神經(jīng)網(wǎng)絡(luò)(convolutional neural networks,CNN)被用于圖像目標(biāo)檢測(cè),CNN通過(guò)大量的訓(xùn)練數(shù)據(jù)自主學(xué)習(xí)到圖像的多層次特征,相對(duì)于傳統(tǒng)的手工設(shè)計(jì)特征,展現(xiàn)了其自動(dòng)和有效性[1]。但是卷積網(wǎng)絡(luò)由于卷積和池化操作在信息傳遞時(shí)會(huì)導(dǎo)致信息丟失,進(jìn)而對(duì)多尺度目標(biāo)檢測(cè)效果不理想。通常采用兩種方式解決此問(wèn)題,一種是改進(jìn)卷積網(wǎng)絡(luò)結(jié)構(gòu),如He等[2]提出了殘差網(wǎng)絡(luò)模型(residual neural network,ResNet),該模型建立前后層之間的“短路連接”,直接將輸入信息與輸出特征結(jié)合使特征更加完整,并有助于訓(xùn)練過(guò)程中梯度的反向傳播,從而訓(xùn)練出更深的CNN網(wǎng)絡(luò),提高目標(biāo)檢測(cè)精度。Kuang等[3]提出了DenseNet網(wǎng)絡(luò),其每一層的輸入都是前面所有層輸出的并集,而該層所學(xué)習(xí)的特征圖也會(huì)被直接傳給其后面所有層作為輸入,通過(guò)這些操作達(dá)到保留特征的目的。

另一種解決思路是融合多級(jí)特征圖。Sean等[4]提出了inside-outside net (ION),ION在最后一層卷積輸出的特征圖上分別在上、下、左、右四個(gè)方向獨(dú)立地使用RNN,并將它們的輸出連接成一個(gè)特征輸出,將兩次相同操作得到的特征作為上下文信息,再與前面不同的卷積層得到的特征連接起來(lái)作為一個(gè)特征輸出。這樣得到的特征既包括上下文信息,又包含多尺度信息,有利于對(duì)不同尺度的目標(biāo)進(jìn)行檢測(cè),使檢測(cè)結(jié)果更加精確。Lin等[5]提出了特征金字塔網(wǎng)絡(luò)feature pyramid network (FPN),利用特征圖金字塔,通過(guò)bottom-up和top-down的方法創(chuàng)建了一個(gè)具有橫向連接的自頂向下架構(gòu)用在多尺度上構(gòu)建高級(jí)語(yǔ)義特征圖。Kong等[6]提出一種端到端的全卷積檢測(cè)方法(RON),通過(guò)反向連接塊將相鄰的特征圖融合起來(lái),這樣淺層的特征圖融合了高層的特征圖信息,然后分別對(duì)融合后的多個(gè)特征圖做預(yù)測(cè),預(yù)測(cè)得到的檢測(cè)框整合在一起輸出就得到整個(gè)網(wǎng)絡(luò)的輸出結(jié)果。Cai等[7]通過(guò)級(jí)聯(lián)幾個(gè)不同閾值訓(xùn)練得到的網(wǎng)絡(luò),前一個(gè)檢測(cè)模型的輸出作為后一個(gè)檢測(cè)模型的輸入,達(dá)到不斷優(yōu)化預(yù)測(cè)結(jié)果的目的。Singh等[8]提出了圖像金字塔尺度歸一化(SNIP),用圖像金字塔來(lái)處理數(shù)據(jù)集中不同大小的數(shù)據(jù)。Zhang等[9]通過(guò)scale-depend pooling (SDP)來(lái)處理目標(biāo)尺度多樣的問(wèn)題,根據(jù)目標(biāo)大小選擇合適的卷積層的特征作為分類(lèi)器和邊框回歸器的輸入特征。

上述文獻(xiàn)研究基于深度學(xué)習(xí)的圖像目標(biāo)檢測(cè)仍然存在一些不足。首先,GoogLeNet、ResNet等大型網(wǎng)絡(luò)在訓(xùn)練時(shí)需要大量的標(biāo)記樣本[10],但遙感圖像有標(biāo)記樣本往往有限,對(duì)于大規(guī)模的深度網(wǎng)絡(luò),少量訓(xùn)練樣本會(huì)造成訓(xùn)練不充分。其次,級(jí)聯(lián)不同網(wǎng)絡(luò)會(huì)造成參數(shù)的增加,使時(shí)間成本增加。最后,現(xiàn)有特征融合方式未高效和有效地將淺層網(wǎng)絡(luò)與深層網(wǎng)絡(luò)信息融合用于預(yù)測(cè),對(duì)遙感圖像中小目標(biāo)的檢測(cè)幫助不大[11]。

本研究以Faster R-CNN目標(biāo)檢測(cè)框架為基礎(chǔ),提出了一種融合特征的深度學(xué)習(xí)遙感圖像目標(biāo)檢測(cè)模型(fusion features based deep learning remote sensing image target detection model,F(xiàn)F-DLM),主要工作和創(chuàng)新包括:一,模型用小型卷積深度網(wǎng)絡(luò)作為特征提取的主干網(wǎng)絡(luò),適用于訓(xùn)練樣本較少的情況;二,在特征提取主干網(wǎng)絡(luò)中通過(guò)融合特征圖提高對(duì)不同尺度目標(biāo)的檢測(cè)率,在融合后的特征圖上進(jìn)行預(yù)測(cè),降低漏檢率,并采用RPN網(wǎng)絡(luò)提取候選框,加快處理速度;三,提出一種新的檢測(cè)框后處理算法——分組融合剔除檢測(cè)框算法(packet fusion reject detection bounding boxes,PFR-DBB),在減少冗余檢測(cè)框的同時(shí)微調(diào)檢測(cè)框位置,使檢測(cè)框?qū)δ繕?biāo)定位更精確。模型在有限的訓(xùn)練樣本和相對(duì)較短的時(shí)間內(nèi),對(duì)遙感圖像中較小且密集的目標(biāo)取得了較高的檢測(cè)正確率,較低的漏檢率、誤檢率,且對(duì)目標(biāo)定位更為準(zhǔn)確。

2 方法原理

兩階段目標(biāo)檢測(cè)深度學(xué)習(xí)模型包括定位和識(shí)別兩個(gè)階段,其中region with convolutional neural network (R-CNN)[12]目標(biāo)檢測(cè)方法重復(fù)提取所有的候選區(qū)域特征而造成時(shí)間花費(fèi)巨大,效率低下。為此,F(xiàn)ast R-CNN[13]使用ROI-Pooling將提取的候選區(qū)映射到最后一個(gè)卷積層的特征圖上,只需要提取一次特征,大幅度提高了檢測(cè)速度,但它使用Selective Search進(jìn)行候選區(qū)域的提取耗時(shí)過(guò)多[14],為此Faster R-CNN[15]提出了區(qū)域建議網(wǎng)絡(luò)(region proposal network,RPN),自動(dòng)提取候選區(qū)域,這樣可以使目標(biāo)檢測(cè)在一個(gè)網(wǎng)絡(luò)中進(jìn)行,真正形成端到端的訓(xùn)練。因此Faster R-CNN在時(shí)間、效率上比之前的模型有巨大的優(yōu)勢(shì)。遙感圖像目標(biāo)檢測(cè)比普通光學(xué)圖像目標(biāo)的檢測(cè)難度更高,文中以Faster R-CNN框架為基礎(chǔ),提出FF-DLM模型應(yīng)對(duì)遙感圖像訓(xùn)練樣本較少、目標(biāo)較小且密集等對(duì)目標(biāo)檢測(cè)帶來(lái)的困難。

2.1 融合特征的目標(biāo)檢測(cè)模型

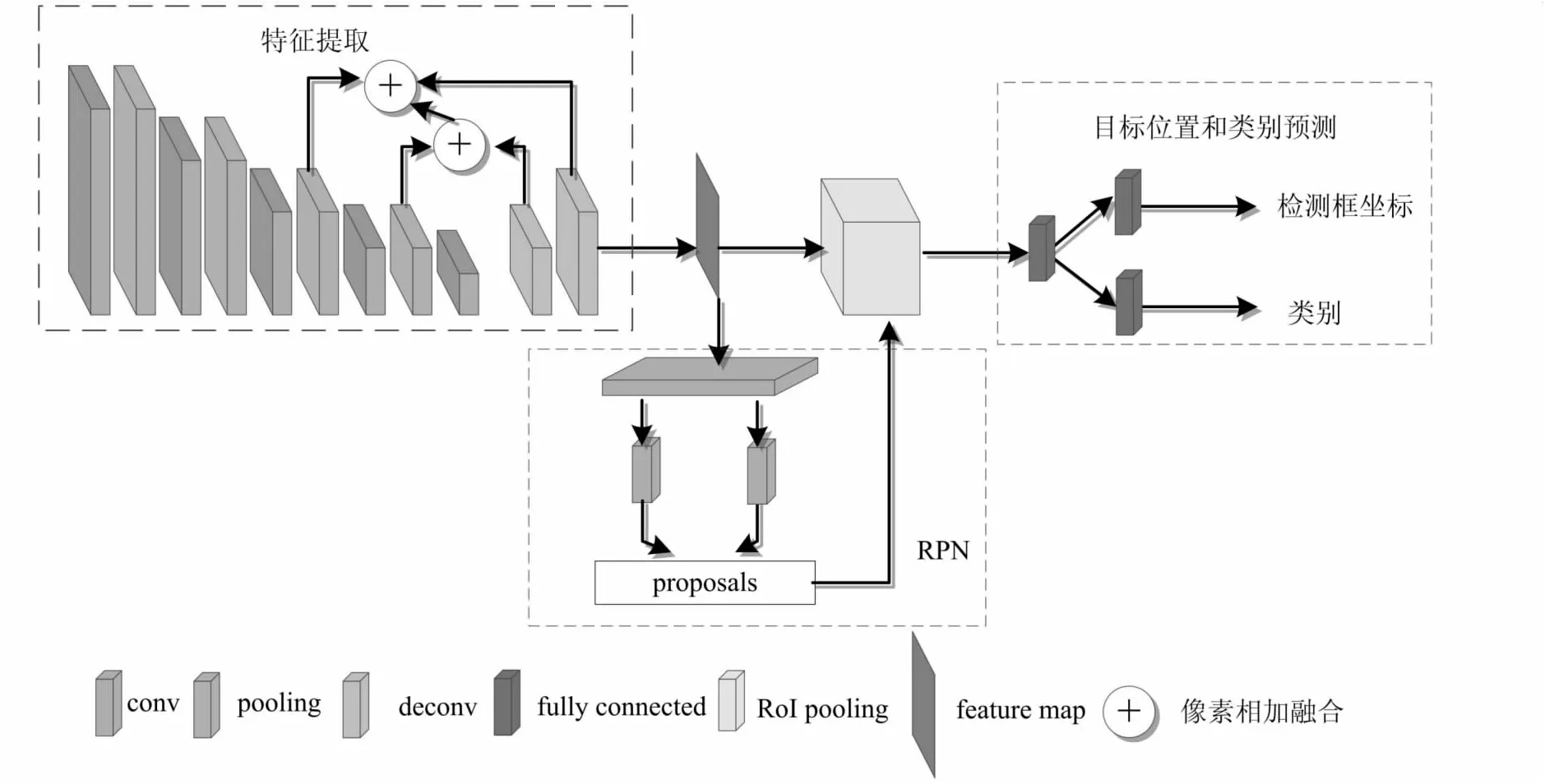

FF-DLM和Faster R-CNN目標(biāo)檢測(cè)模型具有相同的框架,模型包括3個(gè)部分:特征提取、區(qū)域提議和檢測(cè)部分。首先利用一個(gè)小型的卷積網(wǎng)絡(luò)提取特征;其次,融合多層特征圖,將融合的特征圖送到區(qū)域提取網(wǎng)絡(luò)產(chǎn)生候選區(qū)域,再將候選區(qū)域送到目標(biāo)檢測(cè)網(wǎng)絡(luò)中得到目標(biāo)檢測(cè)框和目標(biāo)的類(lèi)別;最后,使用分組融合剔除檢測(cè)框(PFR-DBB)算法去除冗余的檢測(cè)框,并調(diào)整檢測(cè)框位置使其對(duì)目標(biāo)定位更精確。

FF-DLM模型結(jié)構(gòu)如圖1所示。其中特征提取卷積神經(jīng)網(wǎng)絡(luò)有7層,前5層是卷積層,后2層是反卷積層。網(wǎng)絡(luò)中的卷積核均采用較小的尺寸。為了減少參數(shù)個(gè)數(shù),降低計(jì)算量,設(shè)置第一個(gè)卷積層卷積核的尺寸為7×7,第二層卷積核的尺寸為5×5,剩下的卷積層的卷積核尺寸為3×3。5個(gè)卷積層的卷積核個(gè)數(shù)分別為96、256、384、384、256。卷積核作用于前一層卷積操作后輸出的所有特征圖上,同一卷積核對(duì)于前一層不同特征圖的權(quán)重不同以提取不同的特征。前四個(gè)卷積層包括卷積運(yùn)算、Relu非線性激活處理、數(shù)據(jù)歸一化和池化操作。采用最大池化方式,池化時(shí)對(duì)特征圖進(jìn)行Padding=1的擴(kuò)充。最后一個(gè)卷積層不進(jìn)行池化操作。反卷積階段使用3×3的卷積核進(jìn)行反卷積操作恢復(fù)conv4、conv5的特征圖。這里通過(guò)卷積操作提取輸入的遙感圖像特征,池化操作保留卷積后的主要特征,減少干擾信息。

圖1 FF-DLM模型結(jié)構(gòu)

鑒于越深層次的特征語(yǔ)義信息越豐富,特征越來(lái)越抽象,分辨率越來(lái)越低;層次較淺的特征具有較高的分辨率,適于小目標(biāo)的檢測(cè),故提出將多級(jí)特征融合以保留不同尺度目標(biāo)的特征來(lái)適應(yīng)不同尺度目標(biāo)的檢測(cè)任務(wù)[16]。為了進(jìn)行融合操作,對(duì)conv4、conv5通過(guò)反卷積操作得到增大的特征圖,在高分辨率特征圖上保留語(yǔ)義信息。然后將conv3、conv4、conv5的特征圖進(jìn)行逐像素相加的融合,融合結(jié)果既包含淺層次的細(xì)節(jié)特征,又包含深層次的語(yǔ)義特征。接著,用3×3的卷積核在卷積神經(jīng)網(wǎng)絡(luò)融合后的特征圖上滑動(dòng),每個(gè)滑動(dòng)窗口產(chǎn)生9個(gè)不同比例{1∶1,1∶2,2∶1}、不同尺寸{322,642,1 282}的錨框(anchor box),之后用兩個(gè)1×1的卷積核判斷其是否為目標(biāo)并進(jìn)行位置回歸,將所有錨框按目標(biāo)置信度排序,取前300個(gè)作為候選框。最后將候選框送到檢測(cè)網(wǎng)絡(luò)再次對(duì)候選區(qū)域進(jìn)行分類(lèi),并回歸得到目標(biāo)邊界框的坐標(biāo)。由于多級(jí)尺度特征的融合使提取的目標(biāo)特征更為有效,模型不僅能檢測(cè)出特征明顯的目標(biāo),對(duì)于尺寸較小的目標(biāo)、干擾較多的大的目標(biāo)也提升了檢測(cè)率,降低了背景對(duì)目標(biāo)的干擾造成的誤檢。

2.2 分組融合剔除檢測(cè)框算法(PFR-DBB)

目標(biāo)檢測(cè)網(wǎng)絡(luò)最終輸出的檢測(cè)結(jié)果中一個(gè)目標(biāo)可能會(huì)被多個(gè)檢測(cè)框檢出,且對(duì)目標(biāo)定位可能不夠準(zhǔn)確。經(jīng)典的非極大值抑制算法(non-maximum suppression,NMS)[17]將所有的檢測(cè)框按照置信度從小到大排序,保留得分最高的檢測(cè)框,計(jì)算該檢測(cè)框與其他檢測(cè)框的IOU,當(dāng)IOU大于設(shè)定的閾值,則刪除該檢測(cè)框。NMS算法僅去除多余的檢測(cè)框,沒(méi)有對(duì)檢測(cè)框位置進(jìn)行調(diào)整,最終剩下的檢測(cè)框?qū)δ繕?biāo)的定位不夠準(zhǔn)確,且仍然存在多個(gè)目標(biāo)被框在一個(gè)檢測(cè)框中或一個(gè)目標(biāo)被多個(gè)檢測(cè)框包圍的情況。

為了同時(shí)減少漏檢、誤檢,并使檢測(cè)框位置更為準(zhǔn)確,文中提出了一種新的后處理方法,分組融合剔除檢測(cè)框算法(PFR-DBB)。這種方法和NMS類(lèi)方法的思想完全不同,通過(guò)分組處理的方式,在去除冗余框的同時(shí)對(duì)檢測(cè)框進(jìn)行位置的微調(diào),使其對(duì)目標(biāo)定位更精準(zhǔn)。PFR-DBB先將檢測(cè)框分成不同的組,認(rèn)為每組檢測(cè)框框住的是同一個(gè)目標(biāo),這樣做是為了防止兩個(gè)位置較近的物體被框到一個(gè)檢測(cè)框中的情況;然后對(duì)每組中的檢測(cè)框再進(jìn)行處理,剔除多余檢測(cè)框,同時(shí)調(diào)整檢測(cè)框的大小和位置,使檢測(cè)框?qū)δ繕?biāo)的定位更為精確。

算法包括兩個(gè)部分,首先是分組過(guò)程,對(duì)應(yīng)于算法步驟中的(1)~(4),其次是在每個(gè)分組中去除冗余的檢測(cè)框,同時(shí)微調(diào)檢測(cè)框位置的過(guò)程,對(duì)應(yīng)于步驟(5)、(6)。后處理算法過(guò)程如下:

(1)將所有的檢測(cè)框按照置信度遞增排序,得到m個(gè)檢測(cè)框{R1,R2,…,Rm},放入隊(duì)列Q中,令i=1;

(2)將Ri放入組Gi中,并將其從Q中移除,將i+1→j;

(3)如果IOU(Ri,Rj)>0.6,則將Rj放入組Gi中并從Q中移除,j+1→j。若j>m轉(zhuǎn)到(4),否則轉(zhuǎn)到(3);

(4)i+1≥i,如果Q不為空,轉(zhuǎn)到(2);若Q為空,分組過(guò)程結(jié)束,這時(shí)把檢測(cè)框分成了多個(gè)組,每個(gè)待檢測(cè)目標(biāo)對(duì)應(yīng)一組檢測(cè)框;

(5)將組內(nèi)的所有檢測(cè)框按照面積遞增順序加入到一個(gè)隊(duì)列中;

(6)對(duì)于每個(gè)組對(duì)應(yīng)的隊(duì)列,從第一個(gè)檢測(cè)框開(kāi)始依次計(jì)算它與隊(duì)列中其他檢測(cè)框間的IOU值,如果IOU值大于0.7,則計(jì)算重疊區(qū)域的中心,以此為新檢測(cè)框的中心,以?xún)蓚€(gè)框的長(zhǎng)之和的一半為長(zhǎng),寬之和的一半為寬,重新構(gòu)造一個(gè)檢測(cè)框并將該框加入隊(duì)尾,刪除這兩個(gè)檢測(cè)框;否則和隊(duì)列中的下一個(gè)檢測(cè)框?qū)Ρ龋恢貜?fù)本步驟直到隊(duì)列中檢測(cè)框間的IOU均小于0.7,得到最終的檢測(cè)框。

3 實(shí)驗(yàn)設(shè)置與評(píng)價(jià)指標(biāo)

實(shí)驗(yàn)使用的是Ubuntu14.04系統(tǒng),硬件配置為Intel(R) Xeon(R) CPU E5-2690 2.60 GHz處理器、256 GB內(nèi)存和4 TB硬盤(pán),采用Caffe深度學(xué)習(xí)框架。訓(xùn)練過(guò)程中參數(shù)設(shè)置如下:初始學(xué)習(xí)率為0.01,迭代次數(shù)每增加10 000次,學(xué)習(xí)率降低0.1倍,gamma為0.1,權(quán)重衰減為0.000 5,動(dòng)量為0.9。

評(píng)價(jià)指標(biāo)包括IOU(intersection over union)、AP(average precision)、誤檢率FAR(false alarm rate)和漏檢率MR(missing ratio)。IOU指檢測(cè)得到的結(jié)果和標(biāo)注結(jié)果重合的程度;AP是查準(zhǔn)率的平均值,用來(lái)衡量檢測(cè)效果;FAR計(jì)算的是誤檢為目標(biāo)的結(jié)果的數(shù)量占目標(biāo)總數(shù)的比例;MR計(jì)算的是沒(méi)有被檢測(cè)出的目標(biāo)占目標(biāo)總數(shù)的比例。將召回率分成n級(jí),則IOU、AP、FAR、MR分別用下式計(jì)算:

(1)

(2)

(3)

(4)

(5)

其中,B是檢測(cè)得到的檢測(cè)框,BT是Ground Truth,r是查全率,TP是真正例,TN是真反例,F(xiàn)P是假正例,F(xiàn)N假反例。

4 實(shí)驗(yàn)結(jié)果和分析

4.1 飛機(jī)目標(biāo)檢測(cè)實(shí)驗(yàn)

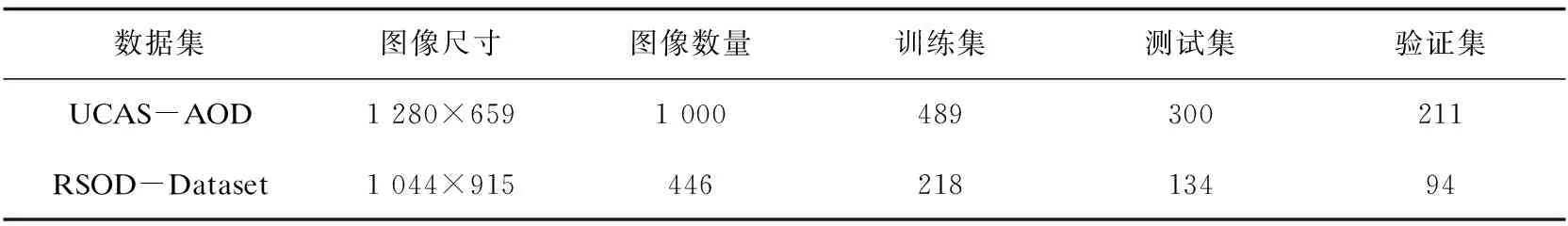

遙感數(shù)據(jù)集中的樣本相對(duì)較少,為了提高檢測(cè)精度,利用遷移學(xué)習(xí)的思想,先對(duì)模型使用Pascal VOC 2007數(shù)據(jù)集進(jìn)行預(yù)訓(xùn)練。預(yù)訓(xùn)練結(jié)束后,分別使用UCAS-AOD[18]、RSOD-Dataset[19]遙感數(shù)據(jù)集中的飛機(jī)目標(biāo)樣本對(duì)模型進(jìn)行微調(diào)訓(xùn)練,使網(wǎng)絡(luò)中的權(quán)值學(xué)習(xí)更充分。UCAS-AOD和RSOD-Dataset中的飛機(jī)數(shù)據(jù)集在實(shí)驗(yàn)中被劃分成訓(xùn)練集和驗(yàn)證集(70%)以及測(cè)試集(30%),具體信息如表1所示。

表1 UCAS-AOD、RSOD-Dataset飛機(jī)數(shù)據(jù)集

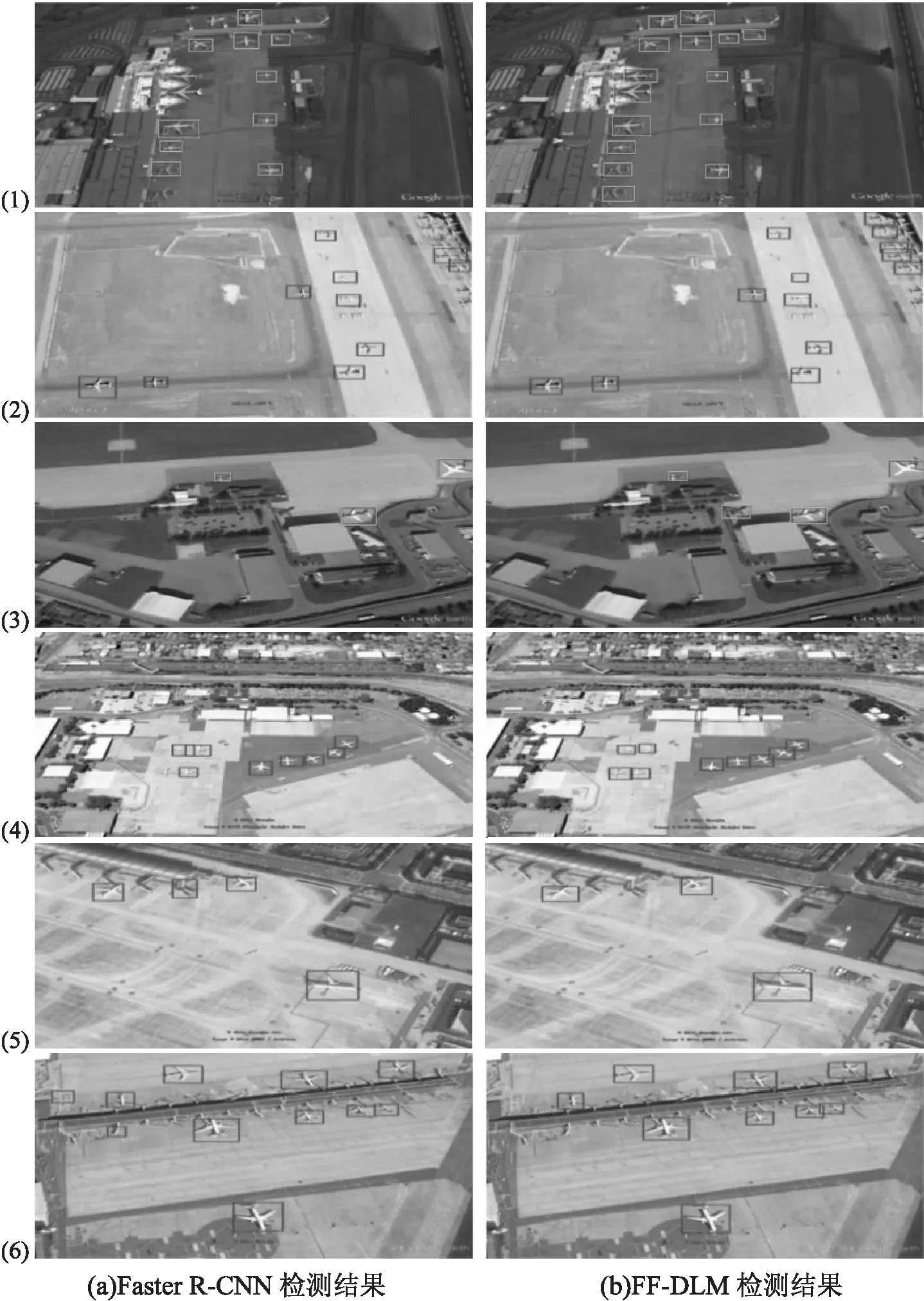

圖2給出了Faster R-CNN和FF-DLM的一些測(cè)試樣本的檢測(cè)結(jié)果。由結(jié)果可見(jiàn),在不同的場(chǎng)景以及光照條件下,F(xiàn)F-DLM的檢測(cè)結(jié)果與Faster R-CNN的檢測(cè)結(jié)果相比目標(biāo)檢出率均有提高。FF-DLM對(duì)分布密集的小目標(biāo)(即使背景和目標(biāo)的光譜特征相似)、不同尺度的目標(biāo)檢出情況較好。圖2中(1)~(4),由于場(chǎng)景中目標(biāo)和背景特征相似或目標(biāo)較小等情況,F(xiàn)aster R-CNN都有漏檢的目標(biāo),而FF-DLM較好地檢出了這些目標(biāo)。另外圖像中的被漏檢綠色的小飛機(jī)被檢測(cè)出,說(shuō)明FF-DLM的特征融合策略有利于復(fù)雜場(chǎng)景不同尺度目標(biāo)的檢出。小飛機(jī)和一些背景在形狀、顏色等方面和飛機(jī)較為相似,容易將背景誤檢為目標(biāo)。圖2中的(5)、(6)顯示了Faster R-CNN誤將背景檢測(cè)為目標(biāo),而FF-DLM減少誤檢的情況。實(shí)驗(yàn)結(jié)果表明FF-DLM模型可以在小樣本數(shù)據(jù)集上充分學(xué)習(xí),和Faster R-CNN比較,在提高檢測(cè)率的同時(shí)減少了誤檢、漏檢的情況。

圖2 不同深度目標(biāo)檢測(cè)模型飛機(jī)檢測(cè)結(jié)果

圖3顯示了FF-DLM采用PFR-DBB算法和NMS算法對(duì)檢測(cè)框進(jìn)行后處理的結(jié)果。圖3的(1)圖中(a)子圖是用NMS算法后處理的結(jié)果,其中有兩個(gè)小飛機(jī)被檢測(cè)到一個(gè)框里面,(2)、(3)圖中有的小飛機(jī)被多個(gè)檢測(cè)框框住。而采用PFR-DBB算法有效去除了多余檢測(cè)框,且沒(méi)有將兩個(gè)目標(biāo)框到一個(gè)檢測(cè)框中的情況,同時(shí)對(duì)一些檢測(cè)框的位置和大小進(jìn)行了調(diào)整,使目標(biāo)定位更加精確,從而提升了檢測(cè)精度。

圖3 檢測(cè)框后處理結(jié)果

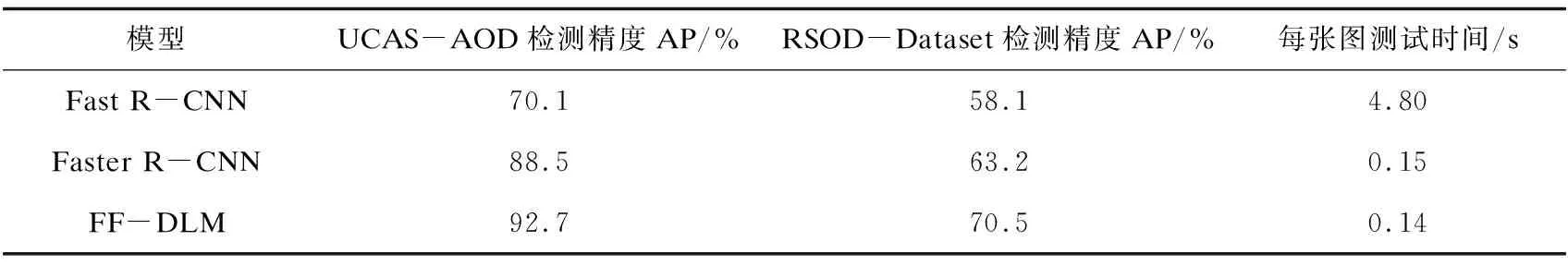

采用平均準(zhǔn)確率AP對(duì)檢測(cè)結(jié)果進(jìn)行定量評(píng)價(jià),F(xiàn)ast R-CNN、Faster R-CNN模型和FF-DLM的檢測(cè)結(jié)果和所用時(shí)間如表2所示。其中Fast R-CNN和Faster R-CNN采用ZF網(wǎng)絡(luò)作為特征提取主干網(wǎng)絡(luò),它和FF-DLM模型都采用訓(xùn)練Pascal VOC數(shù)據(jù)集得到的參數(shù)為初始參數(shù)進(jìn)行訓(xùn)練,測(cè)試時(shí)IOU設(shè)置為0.7。Fast R-CNN和Faster R-CNN未進(jìn)行特征融合,后處理方法和FF-DLM模型不同。從表2可見(jiàn),F(xiàn)F-DLM在檢測(cè)精度、檢測(cè)時(shí)間上都具有明顯的優(yōu)勢(shì)。FF-DLM使用RPN提取候選區(qū)域比Fast R-CNN使用Select search窮舉搜索提取候選區(qū)域減少了大量的時(shí)間,并且實(shí)現(xiàn)了端到端的訓(xùn)練使精度提高。和Faster R-CNN相比,F(xiàn)F-DLM進(jìn)行多級(jí)特征的融合,使模型可以更好地提取有效的特征,提高了檢測(cè)精度,降低了誤檢率。還因?yàn)镕F-DLM使用了PFR-DBB后處理算法,比Faster R-CNN使用NMS算法對(duì)目標(biāo)的定位更加精確,也為檢測(cè)精度的提高做出了貢獻(xiàn)。FF-DLM使用小型網(wǎng)絡(luò)作為主干網(wǎng)絡(luò),在樣本不是很多的情況下可以使學(xué)習(xí)更加充分,得到更好的檢測(cè)結(jié)果。

表2 不同數(shù)據(jù)集上不同模型的結(jié)果比較

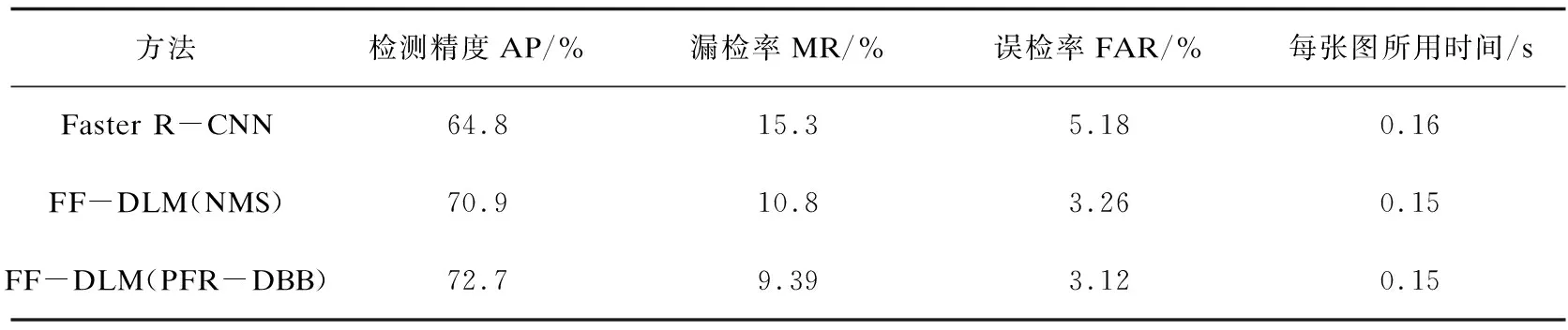

表3展示了飛機(jī)數(shù)據(jù)測(cè)試集在不同的模型上的漏檢率和誤檢率。可見(jiàn),采用PFR-DBB后處理算法的FF-DLM模型比Faster R-CNN和采用NMS后處理算法的FF-DLM模型的效果要好。由于融合不同層特征使模型對(duì)于遙感圖像中小目標(biāo)的特征能夠更好的學(xué)習(xí)與定位,提高對(duì)小目標(biāo)的檢測(cè)性能。同時(shí)因?yàn)閷?duì)特征學(xué)習(xí)的更加充分,可以降低誤檢率。此外,采用所提PFR-DBB后處理算法對(duì)于提升檢測(cè)精度也帶來(lái)了貢獻(xiàn)。

表3 Faster R-CNN和FF-DLM模型在UCAS-AOD測(cè)試集上的漏檢率和誤檢率

4.2 汽車(chē)目標(biāo)檢測(cè)實(shí)驗(yàn)

采用UCAS-AOD遙感數(shù)據(jù)集汽車(chē)目標(biāo)進(jìn)行實(shí)驗(yàn)。圖像大小為1 280×659,共用了310張圖像,其中訓(xùn)練集和驗(yàn)證集的圖像268張,測(cè)試集圖像42張。使用不同的模型進(jìn)行檢測(cè)的結(jié)果如表4所示。FF-DLM模型和Faster R-CNN的結(jié)果進(jìn)行比較,得到了較低的誤檢率、漏檢率和較高的精度。對(duì)測(cè)試集在檢測(cè)精度上FF-DLM模型比Faster R-CNN提高了7.9%。同時(shí),后處理算法PFR-DBB比NMS在提高檢測(cè)精度以及降低漏檢率和誤檢率上表現(xiàn)更好。

表4 Faster R-CNN和FF-DLM模型在汽車(chē)數(shù)據(jù)集上的檢測(cè)精度、漏檢率、誤檢率

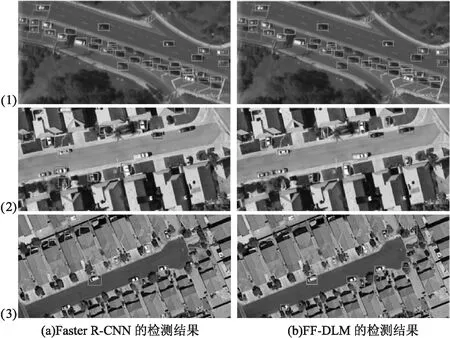

遙感圖像中的汽車(chē)目標(biāo)與飛機(jī)目標(biāo)相比,所占像素更少,汽車(chē)的方向、大小、顏色差別大,所處場(chǎng)景多變,檢測(cè)起來(lái)更加困難。從圖4可見(jiàn),F(xiàn)F-DLM模型對(duì)不同場(chǎng)景中的汽車(chē)的檢測(cè)結(jié)果比Faster R-CNN的檢測(cè)效果都好。圖4中的(1)圖顯示FF-DLM不僅減少了漏檢目標(biāo)個(gè)數(shù),而且檢測(cè)框?qū)δ繕?biāo)的定位更加精確;(2)圖中FF-DLM模型將較小以及顏色與背景相似的汽車(chē)均能檢測(cè)出來(lái),與Faster R-CNN相比誤檢汽車(chē)數(shù)大幅度減少;(3)圖中汽車(chē)尺寸更小,背景與汽車(chē)的顏色更為相似,可以明顯看出FF-DLM的檢測(cè)結(jié)果更好。

圖4 不同檢測(cè)模型對(duì)遙感圖像中汽車(chē)的檢測(cè)

Faster R-CNN僅使用較深層的特征圖,對(duì)于小目標(biāo)的檢測(cè)效果并不好,漏檢汽車(chē)的數(shù)量較多,而且檢測(cè)框?qū)δ繕?biāo)的框取不夠精確,且將很多陰影部分錯(cuò)檢為汽車(chē);FF-DLM檢出的目標(biāo)更多,沒(méi)有將陰影錯(cuò)檢為汽車(chē)。可見(jiàn)所提模型對(duì)于汽車(chē)目標(biāo)同樣取得了較好的檢測(cè)效果,表明模型在少量樣本下對(duì)于多尺度的目標(biāo)檢測(cè)具有優(yōu)勢(shì)。

5 結(jié)束語(yǔ)

提出了一種深度學(xué)習(xí)遙感圖像目標(biāo)檢測(cè)模型,針對(duì)復(fù)雜場(chǎng)景遙感圖像中密集的、大小不一、姿態(tài)各異的目標(biāo),以及訓(xùn)練樣本有限的情況,提出融合多級(jí)特征的小型卷積神經(jīng)網(wǎng)絡(luò)提取有效的目標(biāo)特征,并提出PFR-DBB后處理算法在有效去除冗余檢測(cè)框的同時(shí)微調(diào)檢測(cè)框位置。所提模型在兩個(gè)遙感圖像數(shù)據(jù)集上獲得了明顯優(yōu)于比較方法的檢測(cè)結(jié)果,在提高檢測(cè)正確率的同時(shí)降低了漏檢率和誤檢率。在更小的汽車(chē)目標(biāo)上同樣取得了明顯優(yōu)于對(duì)比方法的結(jié)果,表明所提模型在樣本有限的情況下對(duì)不同尺度的遙感目標(biāo)檢測(cè)具有優(yōu)勢(shì)。

由于所提模型在規(guī)模上、采取的特征提取手段上都是簡(jiǎn)單、適合標(biāo)記樣本不是很多的情況的,如果結(jié)合注意力、特征金字塔等更多特征提取階段的措施,性能將會(huì)進(jìn)一步提升,當(dāng)然訓(xùn)練和測(cè)試時(shí)間相應(yīng)也會(huì)增加。