基于卷積神經網絡的超聲造影圖像去噪方法

車 穎, 馮 皛, 鄭宏亮

(1. 大連醫科大學 附屬第一醫院, 遼寧 大連116011; 2. 遼寧師范大學 計算機與信息技術學院, 遼寧 大連 116029)

超聲診斷是現代臨床醫學診療中的一種重要方法. 近年來, 其新技術超聲造影檢查(contrast-enhanced ultrasound, CEUS)已成為超聲診斷的一項重要組成部分. 超聲造影圖像由于其成像原理不可避免地包含噪聲, 降低了成像的清晰度和可見性, 從而嚴重影響病理診斷的準確性. 因此, 面向超聲醫學圖像的去噪算法研究受到廣泛關注.

圖像去噪算法旨在有效地去除圖像中的噪聲, 提高圖像的質量和清晰度, 是圖像處理領域的重要研究方向. 傳統去噪方法主要分為空域像素特征去噪和變換域去噪算法. 前者是直接在圖像空間中進行處理, 而后者是間接地在圖像變換域中進行處理, 主要算法包括非局部均值(non-local means, NLM)[1-2]、 塊匹配過濾(block-matching 3D filtering, BM3D)[3-4]和加權核范數最小化(weighted nuclear norm minimization, WNNM)[5-6]. 目前, 由于深度學習(deep learning)在計算機視覺領域被成功應用, 因此使如何基于深度學習技術實現圖像去噪受到廣泛關注[7-11]. Burger等[9]首次提出了使用多層感知機(multi layer perception, MLP)實現圖像去噪; Mao等[10]提出了一種基于深度自編碼網絡(deep auto-encoders, DAE)的圖像去噪算法; Zhang等[11]提出了一種基于深層卷積神經網絡(convolutional neural network, CNN)的圖像去噪方法, 該方法通過擬合噪聲避免深層網絡導致的梯度彌散問題. 上述深度學習去噪方法, 相比于傳統BM3D等方法可有效提升去噪效果, 但他們主要面向自然圖像, 目前對面向超聲造影圖像深度學習去噪算法的研究報道較少, 去噪效果不理想.

針對上述問題, 本文提出一種基于卷積神經網絡的超聲造影圖像去噪方法. 由于超聲造影圖像樣本收集較困難, 因此本文首先使用圖像平移、 翻轉、 旋轉等數據增強方法擴充樣本數量, 然后對樣本圖像重疊切割為小圖像塊, 進一步擴充樣本數量. 生成隨機加性噪聲, 從而得到加噪圖像塊作為訓練樣本, 以已知的加性噪聲作為訓練偽標簽, 訓練基于CNN網絡的去噪模型. 為防止過擬合問題, 使用Dropout函數和BN(batch normalization)策略. 實驗結果表明, 該去噪方法可有效提升超聲造影圖像的去噪效果.

1 算法設計

本文考慮加性圖像噪聲問題, 設x和n分別表示原圖像和噪聲,y=x+n表示噪聲圖像.圖像去噪算法的目標是對于任意給定的觀測圖像y, 準確還原原圖像x.

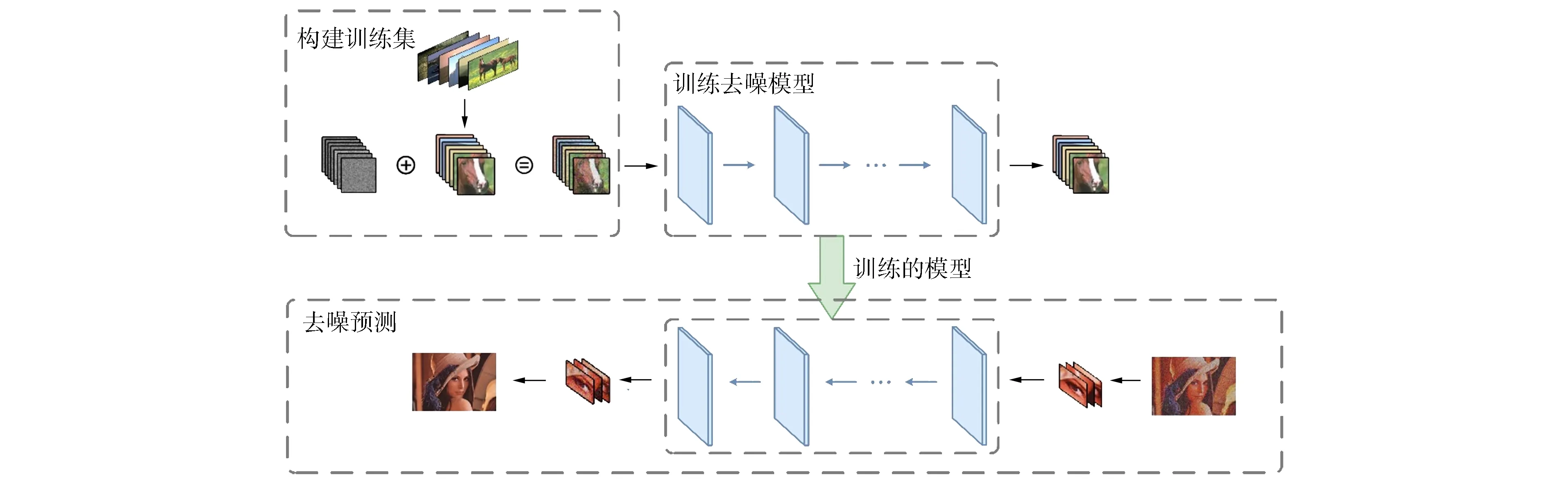

基于神經網絡圖像去噪方法的思路是將圖像去噪轉化為輸入為噪聲圖像、 輸出為去噪圖像或預測噪聲的多元輸出回歸問題, 主要包括以下過程: 1) 構建訓練數據集; 2) 訓練神經網絡去噪模型; 3) 對陌生圖像去噪預測.目前, 基于深度網絡的去噪模型存在過擬合的問題, 相比于ground-truth會丟失很多細節. 針對該問題, 本文在神經網絡隱藏層的輸出上加入輔助監督信息作為正則化約束, 并提出增強卷積去噪算法(augmented convolutional denoising network, ACDN). 圖1為算法框架示意圖.

圖1 ACDN算法框架示意圖Fig.1 Schematic diagram of ACDN algorithm

1.1 算法描述

假設每個基網絡f(·)包含L個隱藏層, 用Θ={θ1,θ2,…,θL}和Φ={φ1,φ2,…,φL}分別表示去噪通道和提議通道的網絡參數, 用Θ1→j={θ1,θ2,…,θj}和Φ1→j={φ1,φ2,…,φj}分別表示第j層前的全部網絡參數, 分別簡記為Θj和Φj.

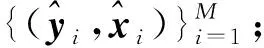

首先使用如下目標函數單獨訓練提議通道:

(1)

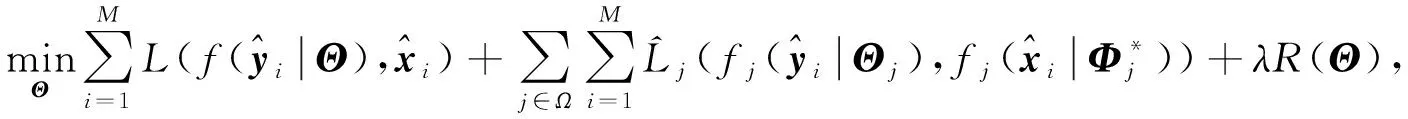

得到最優解Φ*; 然后根據下列損失函數訓練去噪通道:

(2)

1.2 去噪模型訓練

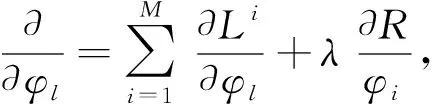

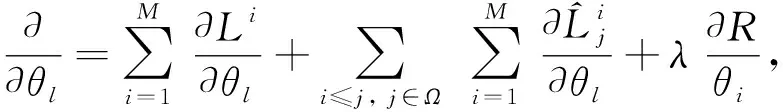

ACDN算法可使用基于梯度的方法進行優化, 對以上兩個目標函數, 每層參數{φl,θl}, ?l∈[L]的梯度分別為

(3)

(4)

1.3 去噪預測

2 實驗結果與分析

為驗證本文ACDN算法的有效性, 使用由大連醫科大學附屬第一醫院提供的20張超聲造影圖像與WNNM,BM3D,MLP和DnCNN四種傳統算法進行對比實驗. 對比的標準為視覺對比和修復性能, 圖像修復性能采用峰值信噪比(PSNR)作為衡量標準.

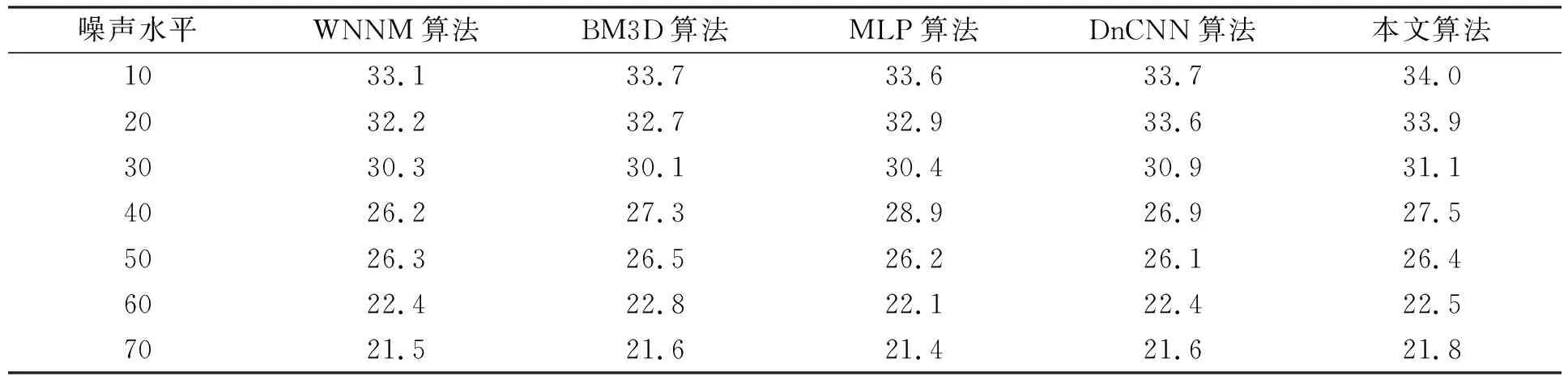

對于ACDN算法, 圖像塊的大小固定為16,32,64, 步長為3,5. 在低噪聲情形下, 建議設定為大圖像塊、 大步長, 原因是較大、 較少的圖像塊可有效去噪且可提升效率; 在高噪聲情形下, 建議設定為小圖像塊、 小步長, 原因是高噪聲需要更多的訓練圖像塊以充分訓練去噪模型, 提升去噪性能. 表1列出了在不同噪聲水平下不同算法的平均PSNR結果.

表1 峰值信噪比(dB)實驗結果

由表1可見, ACDN算法在所有噪聲強度下均可取得最佳的PSNR效果. 與基準算法WNNM,BM3D,MLP和DnCNN算法相比, ACDN算法有顯著的峰值信噪比, 增益約0.3 dB. 在噪聲水平中, 本文提出的ACDN算法性能比BM3D算法提升0.3 dB, 比DnCNN算法提升0.2 dB. 實驗結果充分說明了ACDN算法的去噪有效性.

綜上所述, 針對超聲造影圖像不可避免地包含噪聲, 降低了成像的清晰度和可見性問題, 本文基于卷積神經網絡結構, 提出了一種新的超聲圖像去噪方法. 由于超聲造影圖像的獲取成本高, 圖像樣本數量較少, 因此本文使用圖像平移、 翻轉、 旋轉等數據增強技術擴充圖像樣本數量. 通過重疊切割小圖像塊作為模型訓練樣本, 一是可統一模型輸入層的維度; 二是可進一步擴充樣本數量. 本文以圖像塊和人工噪聲作為輸入訓練集, 訓練基于卷積網絡結構的去噪模型. 實驗結果表明, 相比于BM3D和WNNM等傳統去噪方法, 本文方法對于超聲造影圖像可獲得更高的峰值信噪比, 去噪效果更明顯, 進而提高超聲造影圖像的質量, 為臨床提供更多診斷信息, 對疾病處理方式的選擇具有指導意義.