基于多尺度特征提取的交通模式識(shí)別算法

劉世澤,秦艷君,王晨星,高存遠(yuǎn),羅海勇,趙 方,王寶會(huì)

(1.北京航空航天大學(xué)軟件學(xué)院,北京 100191;2.北京郵電大學(xué)計(jì)算機(jī)學(xué)院,北京 100876;3.中國(guó)科學(xué)院計(jì)算技術(shù)研究所,北京 100190)

(?通信作者電子郵箱yhluo@ict.ac.cn)

0 引言

在移動(dòng)互聯(lián)網(wǎng)時(shí)代,智能手機(jī)的功能越來(lái)越強(qiáng)大,使得智能手機(jī)移動(dòng)設(shè)備的傳感功能的可編程性得到了廣泛的應(yīng)用,使其擁有很高的市場(chǎng)普及率,再加上第三方應(yīng)用軟件的支持和智能手機(jī)快速的發(fā)展,就成為了監(jiān)控人們行為的有效工具。因此基于移動(dòng)智能終端的場(chǎng)景感知成為場(chǎng)景感知的主要方式。

交通模式識(shí)別被認(rèn)為是一種特殊的場(chǎng)景感知[1-2]。通過(guò)智能移動(dòng)設(shè)備捕獲個(gè)人交通行為,這對(duì)許多領(lǐng)域有著非常積極的影響。例如:對(duì)個(gè)人交通行為的智能監(jiān)控,可以實(shí)現(xiàn)對(duì)移動(dòng)跟蹤,也可以利用這些信息改善城市規(guī)劃、提供合適的道路出行建議,快速為救護(hù)車安排最合適的行駛方案,以及追蹤用戶碳足跡,呼吁人們低碳出行。最后,智能監(jiān)測(cè)可以作為用戶行為分析的一部分,進(jìn)行實(shí)時(shí)旅程規(guī)劃或針對(duì)性的廣告投放。最廣泛的電子健康、營(yíng)銷、智能城市、交通管理和安全,其中有關(guān)參與者流動(dòng)性的信息構(gòu)成了所收集數(shù)據(jù)上下文的一個(gè)重要維度。

目前有研究利用全球定位系統(tǒng)(Global Positioning System,GPS)的數(shù)據(jù)來(lái)檢測(cè)運(yùn)輸方式[3-4]。然而,基于GPS 的方法存在以下缺點(diǎn):1)GPS 信號(hào)在城市峽谷、隧道或屏蔽區(qū)域,會(huì)出現(xiàn)信號(hào)丟失和錯(cuò)誤。2)GPS傳感器消耗大量的能量,并可能迅速耗盡移動(dòng)設(shè)備的電池;融合GPS 和地理信號(hào)系統(tǒng)(Geographic Information System,GIS)的交通模式識(shí)別算法,該方法利用運(yùn)輸網(wǎng)絡(luò)信息,包括實(shí)時(shí)總線的位置、空間軌道和巴士站信息,改善了GPS 的數(shù)據(jù)對(duì)交通工具識(shí)別判斷不準(zhǔn)的一些情況,但是現(xiàn)在的GIS 信息系統(tǒng)更新得仍舊不夠?qū)崟r(shí),存在功耗高的問(wèn)題。

大量研究使用基于機(jī)器學(xué)習(xí)的算法實(shí)現(xiàn)交通模式識(shí)別,例如AdaBoost 分類器、支持向量機(jī)(Support Vector Machine,SVM)[5-6]、決策樹、隨機(jī)森林[7-8]、貝葉斯網(wǎng)絡(luò)[9-10]、分層的分類器[11-14]等算法識(shí)別交通工具模式。但是這些算法需要首先根據(jù)人們的先驗(yàn)知識(shí)完成特征提取,而實(shí)現(xiàn)人工特征提取過(guò)程存在復(fù)雜、耗時(shí)和識(shí)別準(zhǔn)確率低等問(wèn)題。目前基于加速度傳感器的交通模式識(shí)別方法提取幀特征、段特征和峰特征,并使用這些特征進(jìn)行交通模式識(shí)別,但是該方法易受重力的影響,也很容易受到采集設(shè)備的噪聲干擾,這樣就會(huì)使收集數(shù)據(jù)時(shí)產(chǎn)生數(shù)據(jù)不準(zhǔn)確,導(dǎo)致最終判斷準(zhǔn)確率低。

針對(duì)上述問(wèn)題,研究者們提出了基于深度學(xué)習(xí)的交通模式識(shí)別算法,如:常見深度學(xué)習(xí)算法有基于循環(huán)神經(jīng)網(wǎng)絡(luò)(Recurrent Neural Network,RNN)、卷積神 經(jīng)網(wǎng)絡(luò)(Convolutional Neural Network,CNN)[15]、雙向長(zhǎng)短期記憶網(wǎng)絡(luò)(Bidirectional Long Short-Term Memory,BiLSTM)[16]和長(zhǎng)短期記憶(Long Short-Term Memory,LSTM)網(wǎng)絡(luò)[17-18]等算法。但這些算法存在功耗高、訓(xùn)練時(shí)間長(zhǎng)和精度低等問(wèn)題。本文提出了一種融合殘差網(wǎng)絡(luò)和帶孔卷積的算法,實(shí)現(xiàn)交通模式識(shí)別,主要工作如下:

1)使用低功耗智能手機(jī)低功耗傳感器,摒棄GPS、Wi-Fi等功耗高的傳感器。使用低功耗的傳感器包含加速度傳感器、氣壓傳感器、地磁、陀螺儀。將這些傳感器得到的原始數(shù)據(jù),通過(guò)快速傅里葉變換(Fast Fourier Transform,F(xiàn)FT)將時(shí)序數(shù)據(jù)轉(zhuǎn)換為頻域數(shù)據(jù)(頻譜圖)。將時(shí)序數(shù)據(jù)轉(zhuǎn)換成圖片數(shù)據(jù)的做法,可以有效消除采集原始數(shù)據(jù)從不同部位和不同的從而獲取更穩(wěn)定特征。

2)使用殘差網(wǎng)絡(luò)(Residual Network,ResNet)學(xué)習(xí)交通模式短時(shí)間的局部特征。由于神經(jīng)網(wǎng)絡(luò)的每一層對(duì)應(yīng)提取特征不同層次特征學(xué)習(xí),而且網(wǎng)絡(luò)結(jié)構(gòu)越深,提取的不同層次的特征越多,不同層次的信息組合也越多。由于網(wǎng)絡(luò)結(jié)構(gòu)越深,會(huì)導(dǎo)致網(wǎng)絡(luò)的梯度消失、梯度爆炸和網(wǎng)絡(luò)性能退化問(wèn)題,造成錯(cuò)誤率上升。使用殘差網(wǎng)絡(luò)可以解決上述這些問(wèn)題,更好地提升網(wǎng)絡(luò)性能,從而達(dá)到深度提取各類交通模式的深層局部特征的目的。

3)利用帶孔卷積學(xué)習(xí)長(zhǎng)時(shí)間的全局特征。對(duì)于特征提取不僅僅需要從局部提取特征,更需要從全局提取特征,去獲得更好的識(shí)別準(zhǔn)確率。在不損失數(shù)據(jù)信息的情況下增大感受野,能有效地提取基于各種交通工具的全局特征;并且可以有效降低信息的復(fù)雜度,減少運(yùn)算復(fù)雜度。

1 相關(guān)工作

在目前交通模式識(shí)別領(lǐng)域,已經(jīng)有很多的學(xué)者在研究該問(wèn)題,從算法層面主要分為兩類:一類是利用傳統(tǒng)學(xué)習(xí)方法,主要依賴手工提取特征,實(shí)現(xiàn)交通模式識(shí)別;另一類是利用神經(jīng)網(wǎng)絡(luò)方法,通過(guò)神經(jīng)網(wǎng)絡(luò)實(shí)現(xiàn)各類交通模式的深度特征提取,實(shí)現(xiàn)交通模式識(shí)別。

文獻(xiàn)[19]提出了一種利用智能手機(jī)位置信息和各種可用的地理信息(如公交站點(diǎn)位置、鐵路線路和公交位置信息)實(shí)時(shí)檢測(cè)用戶出行方式的方法。與之前的相關(guān)工作不同,用于定位的采樣率為30 s。對(duì)于接近實(shí)時(shí)的分類,作者使用了一個(gè)1 min的移動(dòng)記錄窗口(相當(dāng)于兩個(gè)位置記錄),它使用了以下屬性:平均速度、平均加速度和的變化。該方法利用的是傳統(tǒng)的手工提取特征的方法。

文獻(xiàn)[20]提出了一個(gè)基于Bi-LSTM 模型的自動(dòng)軌跡分類框架,以將原始軌跡分類為不同的運(yùn)輸方式。通過(guò)嵌入時(shí)間間隔作為外部特征進(jìn)一步提高了性能。該框架不需要耗時(shí)的復(fù)雜的人工特征提取過(guò)程,而是通過(guò)Bi-LSTM框架學(xué)習(xí)特征。

文獻(xiàn)[21]利用基于深度神經(jīng)網(wǎng)絡(luò)(Deep Neural Network,DNN)的方法,將多層神經(jīng)元堆疊起來(lái)優(yōu)化權(quán)重,從而進(jìn)行交通模式識(shí)別。

文獻(xiàn)[22]提出了一種基于樹的集成分類器,通過(guò)原始數(shù)據(jù),手工提取全局特征和局部特征相結(jié)合,因此需要一個(gè)復(fù)雜和費(fèi)時(shí)的特征工程過(guò)程。

在文獻(xiàn)[23]中基于CNN 的架構(gòu),利用原始的GPS 軌跡來(lái)預(yù)測(cè)出行方式,創(chuàng)建了一個(gè)四通道輸入量,其中每個(gè)通道代表一個(gè)基本運(yùn)動(dòng)學(xué)屬性序列,包括速度、加速/減速、跳動(dòng)和承載率,實(shí)現(xiàn)對(duì)各類交通模式進(jìn)行區(qū)分。

綜上所述,人工提取特征存在著一些重要缺陷,主要包括對(duì)交通和環(huán)境條件的脆弱性,以及在提取高效特征時(shí),對(duì)存在手機(jī)型號(hào)和采用用戶不具有普適性。為解決這些問(wèn)題考慮利用神經(jīng)網(wǎng)絡(luò)代替?zhèn)鹘y(tǒng)方法,從而自動(dòng)地從原始輸入驅(qū)動(dòng)高級(jí)特征;但是現(xiàn)在單一的一些模型并不能很好地處理原始的時(shí)間序列數(shù)據(jù)。

2 融合殘差網(wǎng)絡(luò)和帶孔卷積框架

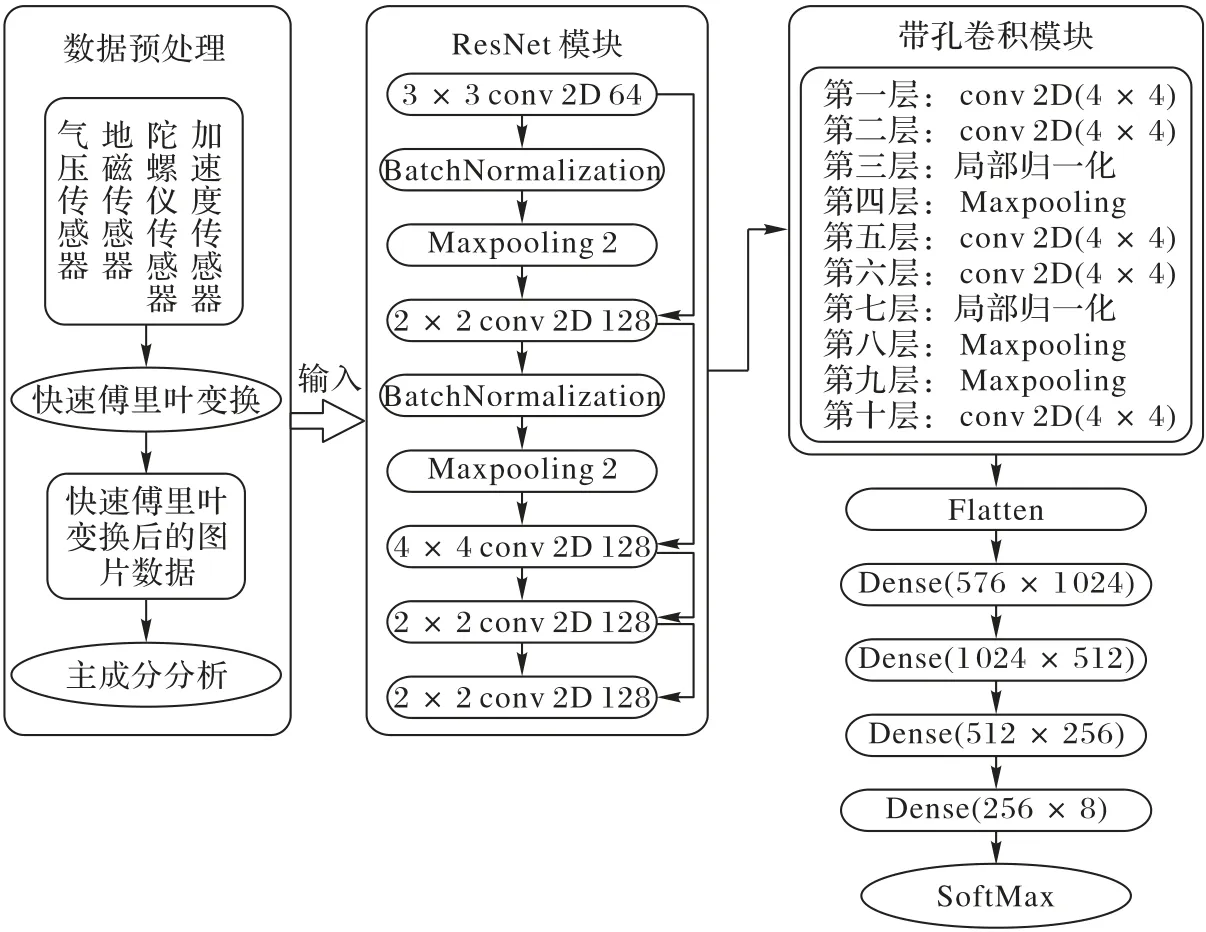

本文提出了融合殘差網(wǎng)絡(luò)和帶孔卷積的算法,實(shí)現(xiàn)交通模式識(shí)別。本文算法總體框架如圖1 所示,主要包含三個(gè)部分,分別是:數(shù)據(jù)預(yù)處理、各類交通工具局部特征提取和各類交通工具全局特征提取。這三個(gè)部分具體內(nèi)容如下:

圖1 融合殘差網(wǎng)絡(luò)和帶孔卷積交通模式識(shí)別算法框架Fig.1 Framework of transportation mode detection algorithm combining residual network and dilated convolution

1)數(shù)據(jù)預(yù)處理。使用手機(jī)采集原始數(shù)據(jù),采用不同手機(jī)采集數(shù)據(jù),會(huì)產(chǎn)生不同設(shè)備之間采集誤差。采集者會(huì)放置不同的部位,例如:手持、背包、手臂和褲袋等姿態(tài),對(duì)數(shù)據(jù)采集產(chǎn)生不同姿態(tài)誤差影響。為了避免這些誤差的影響,利用手機(jī)傳感器采集原始數(shù)據(jù),通過(guò)FFT算法,將時(shí)間序列的數(shù)據(jù)轉(zhuǎn)換成圖片數(shù)據(jù),可以有效地去除上述誤差影響。

2)局部特征。由于ResNet 網(wǎng)絡(luò)結(jié)構(gòu),對(duì)于圖片數(shù)據(jù),通過(guò)深度的學(xué)習(xí)圖片數(shù)據(jù),可以有效地提取交通工具深層局部特征。

3)全局特征提取。帶孔卷積可以在不損失圖片數(shù)據(jù)信息的情況下,增大感受野。通過(guò)每個(gè)增大卷積的卷積核,可以擴(kuò)大感受野,獲得長(zhǎng)時(shí)間依賴關(guān)系,且沒有增加參數(shù)數(shù)量,從而有效地捕獲八類交通模式圖片數(shù)據(jù)的全局特征。

最后將全局特征和局部特征通過(guò)四層全聯(lián)接層,最后通過(guò)SoftMax得到八類交通模式分類結(jié)果。

3 數(shù)據(jù)采集和數(shù)據(jù)預(yù)處理

3.1 數(shù)據(jù)采集

利用手機(jī)采集與交通模式相關(guān)數(shù)據(jù),進(jìn)行交通模式識(shí)別,已經(jīng)是非常普遍的情況[20-21]。

在本文中,數(shù)據(jù)采集人員把收集的數(shù)據(jù)和采集人員的日常生活中想要做的事情結(jié)合起來(lái),例如:參觀博物館,在一個(gè)特定的餐館吃午飯,或者騎自行車去拜訪朋友等。這樣數(shù)據(jù)集可以包含真實(shí)的活動(dòng)和典型位置。

數(shù)據(jù)收集使用了四款華為Mate 9 手機(jī),放在人們通常攜帶手機(jī)的地方:第一部手機(jī),采集者會(huì)拿在手里,或者放在胳膊上戴的臂帶中,在數(shù)據(jù)集中,這個(gè)位置稱為“手(Hand)”;第二部手機(jī),采集者放在胸袋或胸帶上(例如跑步時(shí)),在數(shù)據(jù)集中,此位置稱為“軀干(Torso)”;第三部手機(jī),采集者放在臀部的高度,通常放在褲子的前口袋里,在數(shù)據(jù)集中,此位置稱為“褲袋(Hips)”;第四部手機(jī),采集者放在背包或側(cè)包里,在數(shù)據(jù)集中,這個(gè)位置稱為“包(Bag)”。這些手機(jī)配備了專門采集數(shù)據(jù)的數(shù)據(jù)采集器。

3.2 數(shù)據(jù)預(yù)處理

本文采用了由英國(guó)薩塞克斯大學(xué)(University of Sussex)和華為公司發(fā)布的用于移動(dòng)用戶多模態(tài)運(yùn)動(dòng)分析和交通模式識(shí)別數(shù)據(jù)集(Sussex-Huawei Locomotion dataset,SHL)。

SHL 數(shù)據(jù)集用途廣泛,主要可以用于:用戶行為識(shí)別、多模態(tài)無(wú)線網(wǎng)絡(luò)覆蓋范圍估計(jì)、衛(wèi)星覆蓋范圍估計(jì)、路況分析、交通狀況分析、谷歌公司行為識(shí)別應(yīng)用程序接口(Application Programming Interface,API)、活動(dòng)發(fā)現(xiàn)、傳感器融合定位、基于視覺和聲音的行為識(shí)別等方面。

根據(jù)本文對(duì)數(shù)據(jù)集的要求,本文對(duì)數(shù)據(jù)集做了一定處理。其中,每個(gè)傳感器數(shù)據(jù)文件中包含196 072 行×500 列,對(duì)應(yīng)于196 072幀,每個(gè)幀包含500個(gè)樣本(采樣頻率為100 Hz)。

每一個(gè)樣本通過(guò)快速傅里葉變換,將其轉(zhuǎn)化為一張圖片。使用滑動(dòng)窗口大小是400,滑動(dòng)的步長(zhǎng)是1。

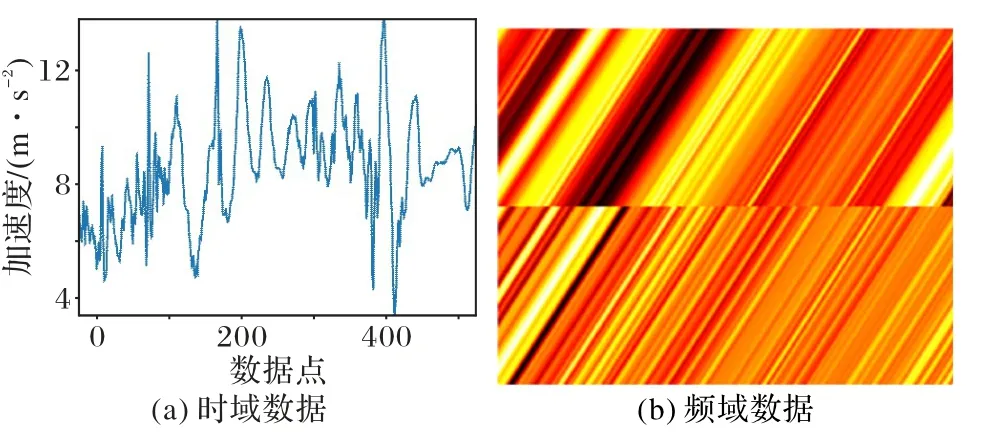

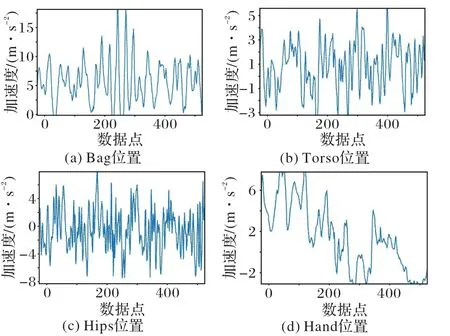

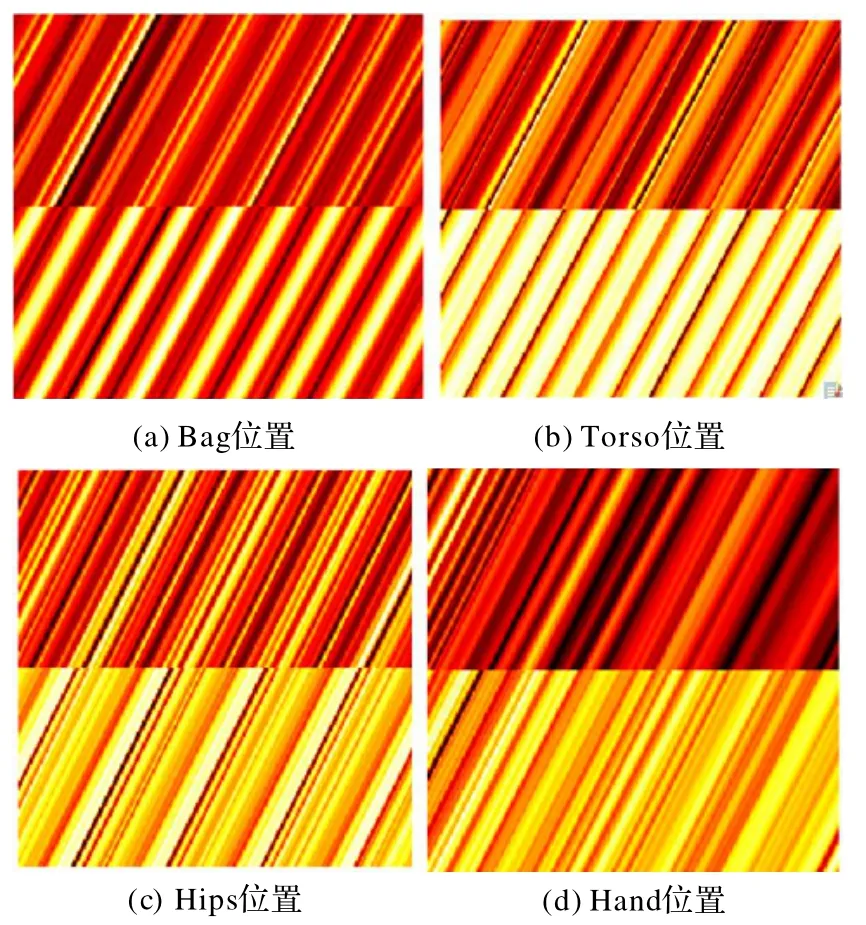

如圖2 所示,就是將加速度x軸的原始數(shù)據(jù),通過(guò)快速傅里葉變換方法,將原始時(shí)間序列數(shù)據(jù)轉(zhuǎn)換為圖片頻域數(shù)據(jù)。如圖3 所示,是在不同位置的數(shù)據(jù)采集效果呈現(xiàn),可以看出不同的位置,加速度x軸的數(shù)據(jù)變化量很大。從圖3 可以看出,時(shí)間序列的數(shù)據(jù)比較分布不均勻。在一定程度上不同采集者和位置都會(huì)有一定的變化,但是通過(guò)FFT 轉(zhuǎn)換成圖片(圖4所示)數(shù)據(jù)波動(dòng)就會(huì)很小。

圖2 將時(shí)域數(shù)據(jù)轉(zhuǎn)換為頻域圖片數(shù)據(jù)過(guò)程Fig.2 Process of converting time domain data into frequency domain image data

圖3 不同位置不同采集者采集的原始數(shù)據(jù)Fig.3 Raw data collected by different users in different locations

圖4 快速傅里葉變換后的圖片數(shù)據(jù)Fig.4 Image data after FFT

3.3 數(shù)據(jù)主成分分析

經(jīng)過(guò)FFT 處理后的表示各種交通模式特征圖片,存在圖片過(guò)大的問(wèn)題。因此會(huì)導(dǎo)致出現(xiàn)模型訓(xùn)練復(fù)雜度過(guò)大問(wèn)題,故需要對(duì)圖片進(jìn)行降采樣。如果使用普通的插值算法,可能會(huì)導(dǎo)致圖片細(xì)節(jié)過(guò)多地丟失,從而降低模型的精度。如算法1 所示,本文使用主成分分析(Principal Component Analysis,PCA)方法是先將圖片二維矩陣展開為向量,并進(jìn)行主成分分析,選取所有位置中特征值最大的50 176個(gè),將這些像素再重新組合為新的圖片,大小為224×224。

算法1 數(shù)據(jù)PCA預(yù)處理。

輸入 原始圖像數(shù)據(jù)data。

dataD←去中心化(data);

dataF←Flatten(dataD);

dataC←計(jì)算協(xié)方差矩陣(dataF);

dataS←SVD分解(dataC);

dataK←sort(dataS)[0∶50 176];

dataR←dot(dataD,dataK)

dataE←reshape(dataR)

首先,對(duì)數(shù)據(jù)進(jìn)行去中心化并展平;接下來(lái),計(jì)算整個(gè)矩陣的協(xié)方差矩陣,對(duì)協(xié)方差矩陣進(jìn)行奇異值分解(Singular Value Decomposition,SVD)選取特征值最高的50 176 個(gè)特征向量再組成矩陣;最后,將這個(gè)矩陣與原來(lái)的矩陣相乘,并轉(zhuǎn)換回大小為224×224 的圖片的形式。此時(shí)保留下來(lái)的特征點(diǎn)擁有著較大的方差,根據(jù)最大方差理論,這些特征點(diǎn)保留了原始圖像中的大部分關(guān)鍵數(shù)據(jù)。

4 局部特征提取

卷積神經(jīng)網(wǎng)絡(luò)(CNN),能夠有效地提取淺層/中級(jí)/深層特征。一般來(lái)說(shuō),層數(shù)越多,提取到的不同層次的特征就會(huì)更豐富、抽象以及富含語(yǔ)義信息。但是要想實(shí)現(xiàn)這個(gè)目標(biāo),往往需要加深CNN 網(wǎng)絡(luò)層為代價(jià),同時(shí)常常帶來(lái)參數(shù)量大、梯度消失、梯度爆炸等問(wèn)題,導(dǎo)致網(wǎng)絡(luò)無(wú)法學(xué)習(xí)到準(zhǔn)確特征。

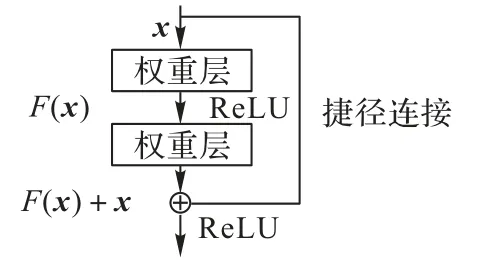

ResNet 的主要思想是,假定某部分神經(jīng)網(wǎng)絡(luò)的輸入為x,期望的輸出為H(x)。H(x)是期望的復(fù)雜潛在映射,如果要進(jìn)行學(xué)習(xí),則訓(xùn)練難度較大。可以知道的是,當(dāng)學(xué)習(xí)到較為飽和的準(zhǔn)確率時(shí)或下層網(wǎng)絡(luò)的誤差開始增大時(shí),接下來(lái)學(xué)習(xí)的目標(biāo)就需要轉(zhuǎn)變?yōu)楹愕扔成涞膶W(xué)習(xí),即:使輸入x近似于輸出H(x),以保持后面的網(wǎng)絡(luò)層中不會(huì)造成精度繼續(xù)下降。ResNet 引入了捷徑連接(Shortcut Connections)來(lái)試圖解決這一問(wèn)題。如圖5所示,直接將輸入x傳到輸出位置作為初始的結(jié)果,那么輸出則變?yōu)镠(x)=F(x)+x。當(dāng)F(x)=0 時(shí),H(x)=x,即恒等映射。因此,ResNet 的學(xué)習(xí)目標(biāo)則轉(zhuǎn)變?yōu)闅埐頕(x)=H(x)-x。之后的網(wǎng)絡(luò)層的學(xué)習(xí)目標(biāo)全部轉(zhuǎn)變?yōu)槭箽埐頕(x) →0,這樣就使得網(wǎng)絡(luò)隨著層數(shù)加深,精確率不會(huì)下降。

圖5 ResNet單元結(jié)構(gòu)Fig.5 Architecture of ResNet unit

殘差網(wǎng)絡(luò)可以有效地避免上述問(wèn)題,同時(shí)學(xué)習(xí)準(zhǔn)確各類交通模式特征。如圖6 所示,輸入層是各類交通模式圖片數(shù)據(jù),數(shù)據(jù)大小是(m,n,q),其中m、n是像素,q是通道數(shù)。本文中的殘差單元如式(1)、(2):

其中:xl是殘差單元的輸入(數(shù)據(jù)圖片);xl+1表示殘差單元的輸出;f表示激活函數(shù)(ReLU 函數(shù));F 是殘差函數(shù);h(xl)=xl;yl是第l層網(wǎng)絡(luò)的輸出;Wl是可訓(xùn)練參數(shù)矩陣。

圖6 的中間模塊是殘差網(wǎng)絡(luò)模塊,該模塊可以有效地提取交通模式的深度特征,W模塊中,使用卷積網(wǎng)絡(luò)實(shí)現(xiàn)特征提取過(guò)程。所以第i層殘差單元,計(jì)算式如式(3)~(6):

其中:wi是第i個(gè)W 模塊的輸出,s是S模塊的輸出是最大池化操作是卷積操作;v是特征矩陣,u是第l層卷積的單元。在本文設(shè)計(jì)的網(wǎng)絡(luò)架構(gòu)中,有三層殘差網(wǎng)絡(luò)模塊。

通過(guò)每一層的殘差單元,都能夠提取到一定程度特征。通過(guò)加深殘差網(wǎng)絡(luò)的深度,就能夠有效地提取八類交通模式的深層特征。由于增加捷徑連接,加入S 模塊,可以有效避免深度卷積網(wǎng)絡(luò)帶來(lái)的梯度消失和梯度爆炸問(wèn)題。

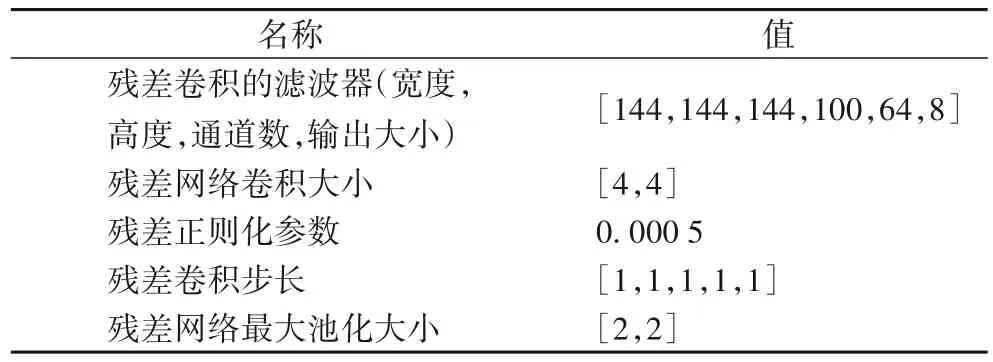

對(duì)于每一層模塊的超參數(shù)如表1所示。

表1 殘差網(wǎng)絡(luò)詳細(xì)超參數(shù)Tab.1 Detailed hyperparameters in residual network

5 全局特征提取

帶孔卷積的作用是在同層計(jì)算不增加參數(shù)量的同時(shí)擴(kuò)大感受野。感受野的大小決定了卷積過(guò)程中,一次獲取信息的多少。如圖7 所示,對(duì)于輸入,每一次映射的區(qū)域不同,第一層是每?jī)蓚€(gè)節(jié)點(diǎn)映射一個(gè)區(qū)域;第二層映射的區(qū)域面積變成每隔一個(gè)節(jié)點(diǎn)映射一次;第三層映射區(qū)域最大,變成每隔兩個(gè)節(jié)點(diǎn)映射一次。

圖7 空洞卷積表示Fig.7 Representation of dilated convolution

這樣設(shè)計(jì)的好處是,能夠在很大程度上減少參數(shù)量,且該網(wǎng)絡(luò)能夠有效保證保留內(nèi)部數(shù)據(jù)結(jié)構(gòu)(傳統(tǒng)下采樣方式就會(huì)失去數(shù)據(jù)內(nèi)部結(jié)構(gòu),導(dǎo)致特征提取不夠完整)。利用池化方法在增加感受野時(shí),會(huì)將一些數(shù)據(jù)信息丟失,但是帶孔卷積網(wǎng)絡(luò)可以在不損失信息特征的情況下,增大感受野,獲取更多信息。

最重要的是,帶孔卷積網(wǎng)絡(luò)能夠準(zhǔn)確獲取多尺度信息特征,避免提取冗余特征,可以更好地挖掘各類交通模式數(shù)據(jù)之間的內(nèi)部特征。本文利用帶孔卷積從大尺度上提取全局特征,這些全局特征能夠有效地增加交通模式識(shí)別的準(zhǔn)確率。

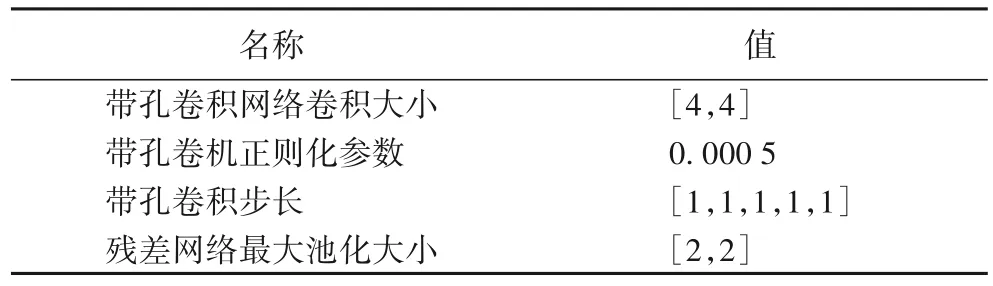

表2 是本文中帶孔卷積設(shè)計(jì)到的超參數(shù)的詳細(xì)描述,帶孔卷積的卷積核計(jì)算不同于傳統(tǒng)卷積計(jì)算方式。逐層增加了卷積核單元間隔距離,分別為0、1、2,在增加特征圖感受野面積的同時(shí)有效控制了參數(shù)量的增加。

表2 帶孔卷積網(wǎng)絡(luò)詳細(xì)超參數(shù)Tab.2 Detailed hyperparameters in dilated convolutional network

本文算法的偽代碼如算法2 所示,主要分為三個(gè)階段:數(shù)據(jù)輸入、訓(xùn)練階段和測(cè)試階段。數(shù)據(jù)輸入階段主要將數(shù)據(jù)進(jìn)行了數(shù)據(jù)標(biāo)準(zhǔn)化、FFT,以及圖像主成分分析等數(shù)據(jù)預(yù)處理方法。在訓(xùn)練和測(cè)試階段,通過(guò)殘差網(wǎng)絡(luò)實(shí)現(xiàn)數(shù)據(jù)局部特征提取,帶孔卷積實(shí)現(xiàn)數(shù)據(jù)的全局特征。然后,通過(guò)Adam 優(yōu)化器目標(biāo)的訓(xùn)練權(quán)重收斂或訓(xùn)練達(dá)到預(yù)定輪數(shù)。最終,通過(guò)SoftMax實(shí)現(xiàn)八類交通模式識(shí)別。

算法2 融合殘差網(wǎng)絡(luò)和帶孔卷積網(wǎng)絡(luò)。

輸入 SHL數(shù)據(jù)集傳感器數(shù)據(jù)data

6 實(shí)驗(yàn)與結(jié)果分析

本文融合殘差神經(jīng)網(wǎng)絡(luò)和帶孔卷積神經(jīng)網(wǎng)絡(luò),實(shí)現(xiàn)了對(duì)八類交通模式的局部特征和全局特征提取,并通過(guò)多尺度特征提取,進(jìn)行對(duì)交通模式的分類。本章通過(guò)對(duì)比實(shí)驗(yàn)驗(yàn)證了該算法的有效性。數(shù)據(jù)集區(qū)分過(guò)程,將使用的數(shù)據(jù)集,先分為五份,取其中一份作為測(cè)試集,剩下的四份作為訓(xùn)練集。

6.1 不同算法的對(duì)比實(shí)驗(yàn)

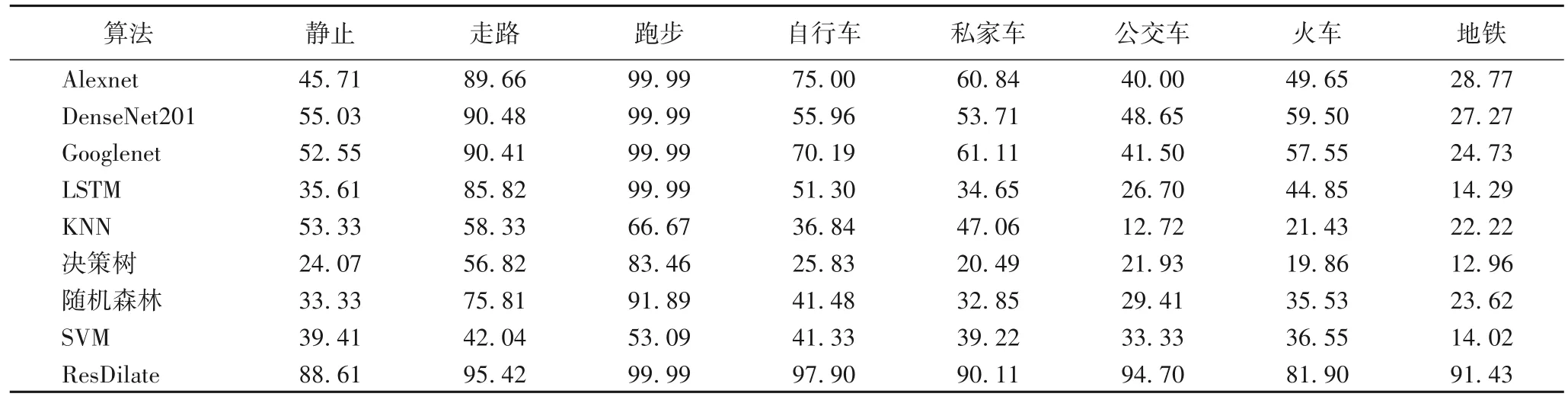

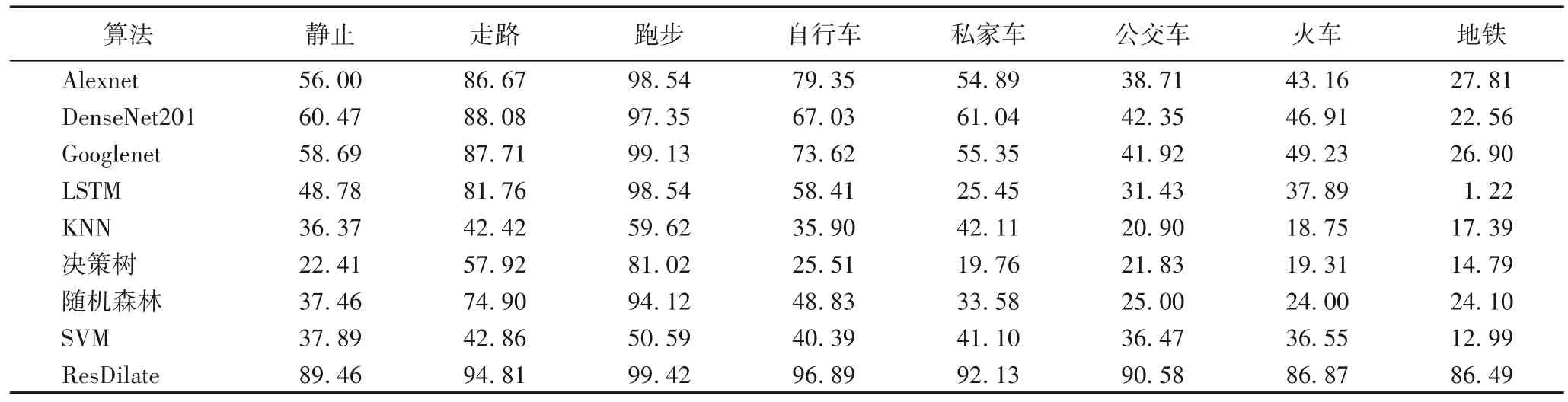

為了實(shí)現(xiàn)對(duì)比實(shí)驗(yàn)的公平性,對(duì)K最近鄰(K-Nearest Neighbor,KNN)、LSTM、Alexnet、DenseNet201、Googlenet、SVM、隨機(jī)森林、決策樹和本文算法驗(yàn)證時(shí),采用了相同的訓(xùn)練集和測(cè)試集進(jìn)行實(shí)驗(yàn)。

在表3 中記錄了各類算法在八類交通模式的準(zhǔn)確率、召回率和F1-分?jǐn)?shù)三個(gè)評(píng)判標(biāo)準(zhǔn)。從實(shí)驗(yàn)結(jié)果上看,跑步和走路這兩種模式是最容易區(qū)分的,這主要與人體的特殊運(yùn)動(dòng)方式有關(guān),人們?cè)谧呗泛团懿綍r(shí),都會(huì)有較大的震動(dòng)和固定的運(yùn)動(dòng)頻率,所以每一種算法在這兩種模式上表現(xiàn)都較好。

從表3~5 中可以看出,騎自行車這一交通模式在KNN 和SVM 上表現(xiàn)得不好,主要是由于這兩種算法不能夠很好地抓住騎自行車這一交通模式的有效特征;但是其他算法可以有效地抓住有效特征進(jìn)行識(shí)別。從表4 中可以得出,融合殘差神經(jīng)網(wǎng)絡(luò)和帶孔卷積神經(jīng)網(wǎng)絡(luò)(ResDilate)算法,在三種評(píng)價(jià)指標(biāo)上表現(xiàn)最好,全部達(dá)到了95%以上,且準(zhǔn)確率平均超過(guò)其他算法10個(gè)百分點(diǎn)。

表3 不同算法的準(zhǔn)確率比較 單位:%Tab.3 Accuracy comparison of different algorithms unit:%

表4 不同算法的召回率比較 單位:%Tab.4 Recall comparison of different algorithms unit:%

從實(shí)驗(yàn)結(jié)果可以看出,公交車和私家車這兩種交通模式,在各類算法中是比較容易混淆的。由于這兩種交通模式,在特征上存在一定的相似性,尤其是在交通堵塞以及在高速路上的情況下,公交車和私家車在速度、加速度以及拐彎等,這些特征都會(huì)非常相似,所以這兩種交通模式識(shí)別存在一定的挑戰(zhàn)性。Alexnet、DenseNet201 和Googlenet 這三種算法,在識(shí)別這兩種交通工具的三種評(píng)估下均可以達(dá)到50%以上。KNN、LSTM、隨機(jī)森林、SVM 和決策樹這五種算法在識(shí)別這兩種交融模式的準(zhǔn)確率在30%~50%。從這個(gè)角度上看,深度學(xué)習(xí)算法的性能在一定程度上可以驗(yàn)證,深度學(xué)習(xí)提取的特征比人工提取特征更有具有識(shí)別性,更有利于識(shí)別交通模式。同理,火車和地鐵在短時(shí)間內(nèi)的特征也是非常相似的。使用單一的Alexnet、DenseNet201 和Googlenet 算法提取出的同一緯度的特征,不具有較強(qiáng)的識(shí)別性。使用人工提取出的特征,利用SVM 等機(jī)器學(xué)習(xí)算法進(jìn)行分類,也不能達(dá)到所需要的準(zhǔn)確率。本文所提出的算法,在準(zhǔn)確率、召回率和F1-分?jǐn)?shù)評(píng)估方法均可以達(dá)到80%以上。

表5 不同算法的F1-分?jǐn)?shù)比較 單位:%Tab.5 F1-score comparison of different algorithms unit:%

6.2 本文算法的自對(duì)比實(shí)驗(yàn)

本文為了驗(yàn)證所提出算法各個(gè)部分的有效性,進(jìn)行了自對(duì)比實(shí)驗(yàn),實(shí)驗(yàn)結(jié)果如表6~8所示。

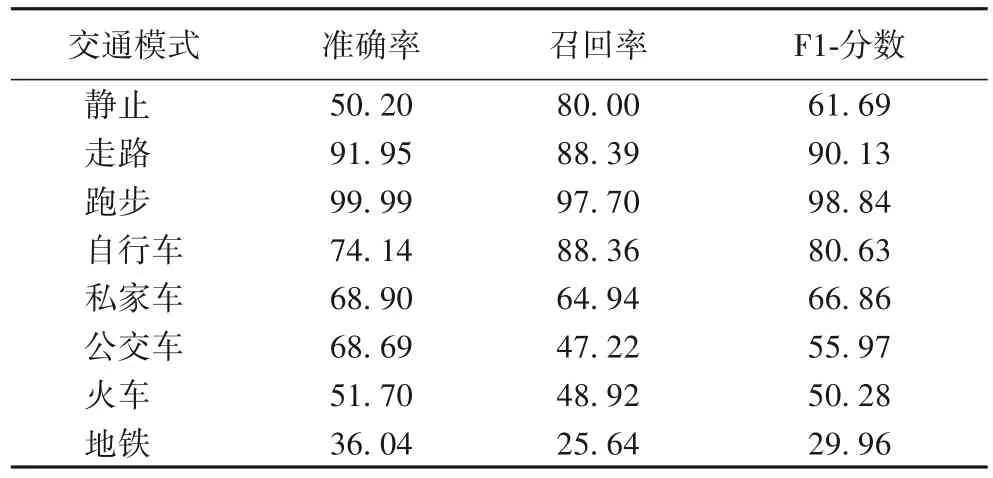

其中,表6 是單一使用殘差神經(jīng)網(wǎng)絡(luò)對(duì)交通模式進(jìn)行分類。從殘差神經(jīng)網(wǎng)絡(luò)的結(jié)構(gòu)上可以看出,該網(wǎng)絡(luò)結(jié)構(gòu)可以對(duì)數(shù)據(jù)集中的局部特征進(jìn)行有效提取,也就是說(shuō),可以將數(shù)據(jù)集中的各類交通模式上的短時(shí)間內(nèi)的特征有效提取出來(lái),因此在識(shí)別自行車、公交車、靜止和火車上可以提取出有效的特征。從實(shí)驗(yàn)結(jié)果上看,這些短時(shí)間的局部特征比長(zhǎng)時(shí)間的全局特征更加有效,準(zhǔn)確率、召回率和F1-分?jǐn)?shù)均優(yōu)于帶孔卷積神經(jīng)網(wǎng)絡(luò)。

表6 使用殘差網(wǎng)絡(luò)的實(shí)驗(yàn)結(jié)果 單位:%Tab.6 Experimental results of utilization of residual network unit:%

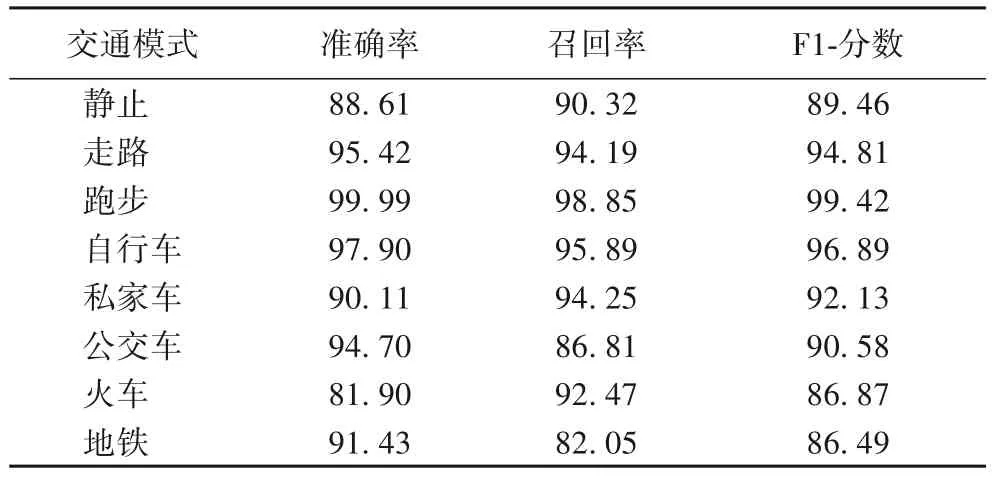

表7 是使用帶孔卷積神經(jīng)網(wǎng)絡(luò)實(shí)現(xiàn)交通模式識(shí)別實(shí)驗(yàn)結(jié)果,帶孔卷積神經(jīng)網(wǎng)絡(luò)可以在較長(zhǎng)時(shí)間內(nèi)提取全局特征。從實(shí)驗(yàn)結(jié)果可以看出,對(duì)于火車這一交通模式,獲得全局特征更有利于識(shí)別該交通模式。因?yàn)榛疖嚦3_\(yùn)行時(shí)間較長(zhǎng),而且加速度或者勻速的時(shí)間較長(zhǎng),在短時(shí)間內(nèi)提取的局部特征,往往不具備很多的區(qū)分性,所以提取長(zhǎng)時(shí)間的全局特征更加具有區(qū)分效果。

表7 使用帶孔卷積神經(jīng)網(wǎng)絡(luò)的實(shí)驗(yàn)結(jié)果 單位:%Tab.7 Experimental results of utilization of dilated convolutional network unit:%

利用殘差網(wǎng)絡(luò)學(xué)習(xí)特征圖像,可以將感受野控制在相對(duì)較小的范圍內(nèi),從而學(xué)習(xí)局部更細(xì)粒度的特征表達(dá);同理,利用帶孔卷積的卷積核間隔,在不擴(kuò)大參數(shù)規(guī)模的前提下,增加感受野,忽略掉一定的局部特征但是可以學(xué)習(xí)到全局特征。

綜合上面的實(shí)驗(yàn)結(jié)果可知,本文算法將兩種神經(jīng)網(wǎng)絡(luò)進(jìn)行融合,就可以得到表8 中的識(shí)別效果。如表8 所示,殘差網(wǎng)絡(luò)和帶孔卷積融合后,八類交通模式識(shí)別精度均有一定的提高,可以驗(yàn)證本文設(shè)計(jì)算法的有效性和兩種算法融合的必要性。

表8 融合殘差網(wǎng)絡(luò)和帶孔卷積神經(jīng)網(wǎng)絡(luò)的實(shí)驗(yàn)結(jié)果 單位:%Tab.8 Experimental results of fusion of residual network and dilated convolutional network unit:%

6.3 調(diào)參實(shí)驗(yàn)

在本文中,主要調(diào)整了模型中的超參數(shù),其中包括學(xué)習(xí)率、正則化參數(shù)值,以及殘差神經(jīng)網(wǎng)絡(luò)卷積核大小。其中本文使用效果最好的參數(shù)已經(jīng)在表1和表2給出。

本文調(diào)整的其他參數(shù)如表9 所示。通過(guò)控制變量法的原則,每次調(diào)整一個(gè)參數(shù)。從各個(gè)交通模式的準(zhǔn)確率可以看出,超級(jí)參數(shù)的調(diào)整,對(duì)于準(zhǔn)確率影響非常大,尤其是對(duì)于公交車和私家車、地鐵和火車,這些比較難以區(qū)分的交通模式有明顯準(zhǔn)確率變化。

表9 不同參數(shù)的準(zhǔn)確率比較 單位:%Tab.9 Accuracy comparison of different parameters unit:%

7 結(jié)語(yǔ)

本文通過(guò)融合殘差網(wǎng)絡(luò)和帶孔卷積,對(duì)八類交通模式識(shí)別進(jìn)行識(shí)別。首先,通過(guò)FFT 算法將一維傳感器時(shí)域數(shù)據(jù)轉(zhuǎn)換二維頻域圖像數(shù)據(jù);然后,使用PCA 算法有效降低圖像數(shù)據(jù)復(fù)雜度;接著,使用殘差網(wǎng)絡(luò)提取交通模式局部特征,使用帶孔卷積網(wǎng)絡(luò)提取全局特征;最后,通過(guò)對(duì)局部特征和全局特征的深度融合,實(shí)現(xiàn)了對(duì)交通模式的準(zhǔn)確識(shí)別,驗(yàn)證了融合殘差網(wǎng)絡(luò)和帶孔卷積網(wǎng)絡(luò)模型的準(zhǔn)確性和有效性。后續(xù)工作中將著力于繼續(xù)提升模型精度并進(jìn)一步降低模型復(fù)雜度,從而更好地滿足低功耗應(yīng)用需求。