基于深度學習的結膜血管分割方法

許子豪,曹娟,馬煜輝,陳浜,謝林春,趙一天*

(1.重慶交通大學 信息科學與工程學院,重慶 400000;2.中國科學院寧波材料與技術工程研究所 慈溪生物醫學工程研究所,浙江 寧波 315201)

0 引言

光學相干斷層掃描血管成像(Optical Coherence Tomography Angiography,OCTA)技術通過窺測紅細胞的流動[1],以獲取視網膜、脈絡膜以及結膜部位的血管影像[2]。相較于傳統的熒光素眼底血管造影與吲哚菁綠血管造影,OCTA具有非入侵、快速以及三維成像的優勢,成為眼科領域極具發展前景的血管成像技術[3]。相關臨床研究表明,如年齡相關性黃斑病變(AMD)、糖尿病視網膜病變(DR)、干眼病、青光眼病變在眼部血管中會呈現異常狀態[4],而通過對眼部血管成像,輔助醫生診斷,實現對疾病的早發現早治療,以降低失明的風險。

本文圍繞位于眼球前節(Anterior Segment,AS)的結膜OCTA血管圖像展開研究,其血管量化指標對于干眼癥診斷治療、角膜手術前后診斷治療都起著十分重要的作用[5]。特定的眼科疾病往往會引起血管密度、形態等血管量化指標的異常。為實現血管的提取與量化,對AS-OCTA血管的自動分割是一關鍵任務。所以血管的清晰呈現與準確分割,是醫生做出準確臨床診斷、精確提取量化血管指標的前提。然而AS-OCTA圖像因眼球顫動產生了大面積橫紋噪聲、血管區域與背景區域數據分布不均衡等問題,都為AS-OCTA精確、高效的自動分割帶來了巨大挑戰。

深度學習的快速發展為解決AS-OCTA血管的精確分割帶來了新思路,從而輔助醫生實現相關血管指標提取與量化,以便醫生的臨床診斷。本文基于深度學習的思想提出了AS-OCTA的自動分割方法,它主要包含如下幾部分:首先實現了AS-OCTA中橫紋噪聲去除的數據預處理任務;為了提高血管分割準確率,通過迭代的思想,在“U型”網絡結構末端連接多個“微型”網絡結構,來提高網絡的語義信息獲取能力,進而提高分割準確率;并使用Focal損失函數與Dice損失函數相結合的策略來對網絡模型進行約束,解決分割數據分布不均衡的問題。

1 相關研究工作

目前國內針對AS-OCTA眼表部位的血管分割研究還處在空白階段,但已有部分學者開展過關于OCTA的眼底血管分割的研究。如Gao等人[6]結合平均反射投影與去最大化相關投影的原理得到了en-faceOCTA的二值化血管分割圖像。Camino等人[7]提出了優化的反射調整閾值方法來對OCTA中的血管進行分割。Wu等人[8]提出了基于血管連續性分析的優化方法,最終實現了OCTA中血管提取。然而,以上基于傳統的OCTA分割方法缺乏對整張圖像語義信息的獲取能力。

深度學習在醫學圖像分割領域中展現了巨大潛力[9-10]。由Ronneberger等人[11]提出的U-Net采用了短連接的方式,極大地促進了深度學習在醫學圖像領域發展,許多以U-Net為基本框架改進的圖像分割網絡也隨之提出如ResU-Net[12]、Attention U-Net[13],并在醫學圖像分割方面取得了突出效果。Gu等人[14]基于上下文信息的編碼器提出了CE-Net,其中包含了稠密空洞卷積模塊與多核殘差池化模塊來獲取圖像中的語義信息,使得CE-Net在眼底血管分割中實現了較好的分割效果。Mou等人[15]提出了CS-Net,針對曲線型結構的醫學圖像開展分割研究。為了自適應圖像中的局部信息與整張圖像的關系,在編碼器與解碼器之間融合了基于空間與通道注意力的模塊,并在OCTA數據集中都取得了最好的分割效果。Li等人[16]基于無向池化層的投影原理,提出了投影網絡來對3D的OCTA視網膜圖像進行分割,并得到2D的血管分割結果。Ma等人[17]提出了一個新的基于分解的粗細血管分割網絡OCTA-Net,它首先生成一個血管初始置信圖,并基于分解思想來對OCTA視網膜血管進行精細化分割。Stenfan等人[18]基于深度學習的方法提出了針對OCTA數據的圖像增強、分割的網絡模型工具,并可以提供給研究者血管量化指標結果。但是在血管分割研究中采用簡單的卷積神經網絡來實現,并未發揮出神經網絡潛在的學習能力。

2 基于級聯網絡的結膜圖像分割

2.1 數據預處理

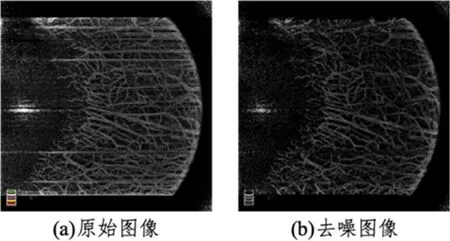

設備在采集圖像時,由于患者眼球的不自主顫動,導致圖像存在大面積橫紋噪聲,為醫生的疾病診斷與分割網絡的訓練帶來阻礙。首先通過協同一致性方法[19]來去除AS-OCTA中的橫紋噪聲,最后結果如圖1所示,其中(a)為帶橫紋噪聲的原始圖像,(b)為橫紋噪聲去除后的圖像。可以在去除橫紋噪聲的同時保留完整的血管信息,最后將去噪圖像作為網絡的數據集使用,來提高最終分割網絡的可靠性。

圖1 數據預處理

2.2 級聯網絡結構

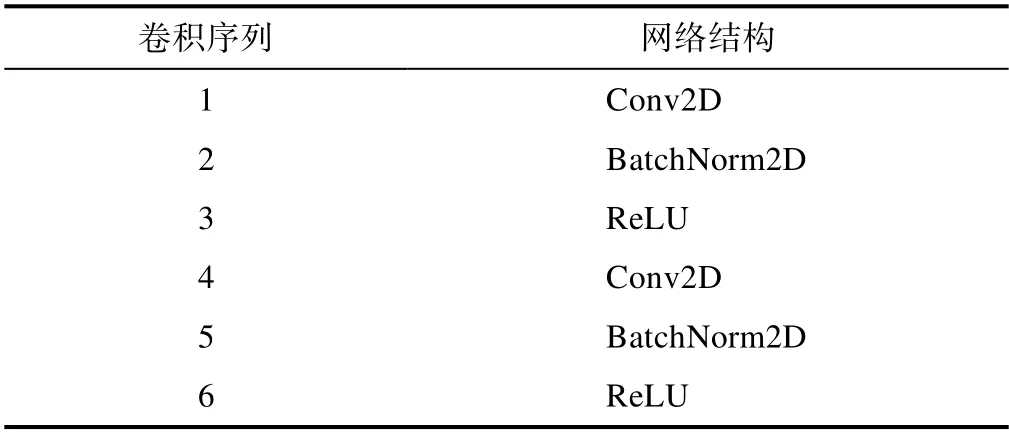

本文采用經典的“U型”結構U-Net網絡作為基礎模型,主要包含了編碼器、解碼器與跳躍連接三個部分。但傳統的U-Net網絡訓練不穩定,本文加入BatchNorm層與ReLU激活函數來防止網絡訓練時梯度消失與爆炸,同時提高神經網絡的特征提取能力,卷積模塊的設計如表1所示:

表1 本文網絡卷積模塊

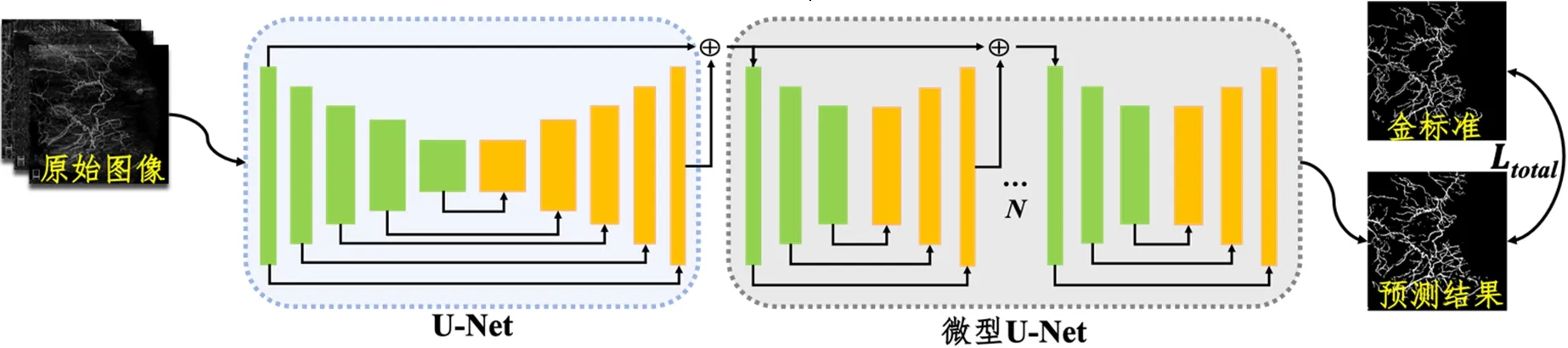

網絡中的編碼器部分每一層首先通過表1的卷積模塊,接著通過最大池化層進入到下一層編碼。解碼器部分每一層依次通過表1的卷積模塊與上采樣層,進入到上一層解碼。為保證在特征提取時,獲取更多上下文信息,將對應編碼層與解碼層的特征圖進行跳躍連接。本文采用5層的網絡結構,如圖2中U-Net所示。

圖2 本文提出的分割網絡

為對血管區域精細化分割,需獲取圖像中更多語義信息。若加深網絡深度,易導致圖像細節信息的丟失。故在第一個U-Net結構輸出后連接N個“微型U-Net”,提高網絡特征提取能力,實現對血管的準確分割。“微型U-Net”采用同表1相似的卷積結構,同時為了在特征提取時進一步優化分割結果,采用3層網絡結構對第一次U-Net輸出的分割結果進一步微調。為保證血管微調階段不丟失圖像信息,在U-Net的輸出端與“微型U-Net”的輸入端進行跳躍連接,網絡如圖2中“微型U-Net”所示。

2.3 損失函數

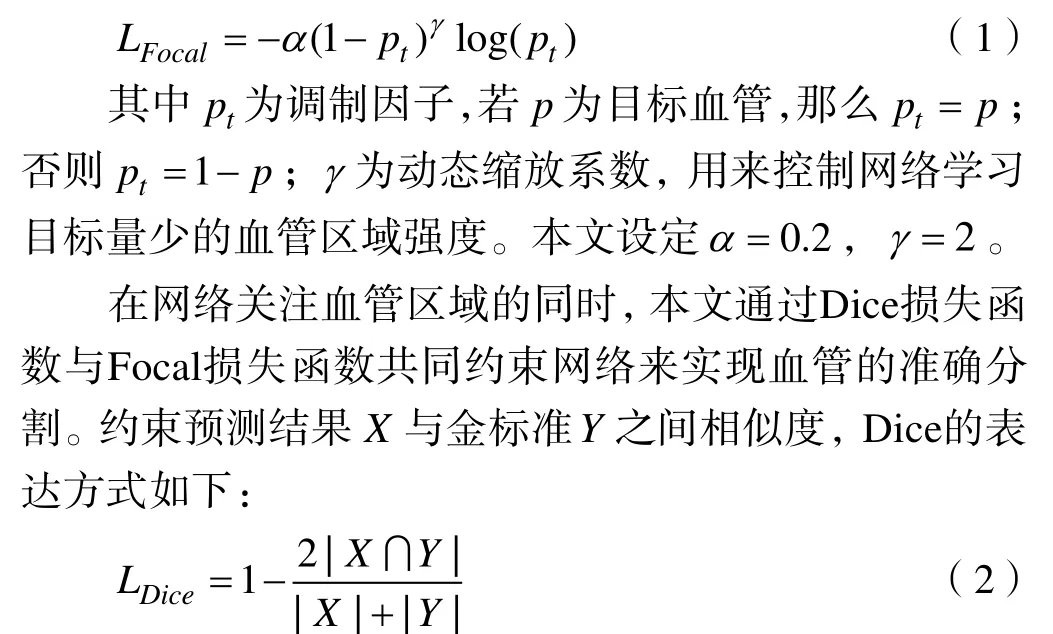

在結膜圖像中,血管區域占整張圖像較小比例,導致數據分布不均衡的問題,為神經網絡訓練帶來難度。為了解決這一難題,Focal[20]損失函數基于傳統交叉熵基礎上,為圖像中正負樣本分配不同的權值,使網絡可以關注樣本量少的血管區域。它的表達式如下:

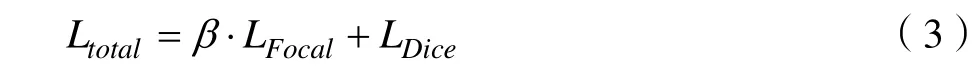

最終本文提出模型的目標約束函數如下,β為控制兩者的權重參數:

3 實驗評估

3.1 數據集與實驗設置

本文所用數據集包含了31張結膜AS-OCTA圖像,由Optovue公司的RTVue XR Avanti SD-OCT設備拍攝。采集的AS-OCTA圖像覆蓋結膜的區域,分辨率。為了驗證分割算法的有效性,AS-OCTA圖像均由眼科專家借助ImageJ軟件人工標注可見的血管像素,最終將標注結果作為實驗的金標準。如圖3所示,(a)表示AS-OCTA圖像,(b)為(a)對應的金標準。

本文提出的分割網絡的實驗環境是在Ubuntu 16.04的操作系統下基于Pytorch深度學習框架實現的,并使用NVIDIA GeForce GTX 3090顯卡進行加速。在網絡訓練過程中,選取26張圖像作為訓練集,5張作為測試集。將學習率設置為0.0001,并通過“poly”學習率衰減策略,使網絡訓練的學習率隨著訓練次數的增加逐漸衰減至0,從而加快網絡訓練擬合過程。用Adam優化算法使網絡快速達到收斂結果,批處理的大小設置為1,訓練的迭代次數(epoch)為300次,“微型U-Net”網絡個數N取3,損失函數控制參數為β=10 。

3.2 評估標準

為驗證本文算法針對血管分割的性能,需要用有效的指標來衡量分割的有效性。在醫學圖像的分割領域中,常采用AUC、準確率(Accuracy)、Dice系數這3個指標來評價分割結果的性能。其中,AUC表示的是ROC曲線之下的面積,值越大代表模型性能更佳。準確率與Dice系數的計算方式如下:

其中,TP為正確分割的血管像素,TN為正確分割的背景像素,FP為錯誤分割的血管像素,FN為錯誤分割的背景像素。

3.3 方法對比

為了驗證本文算法的有效性,將其與現有基于深度學習的圖像分割方法進行對比,主要包含了U-Net、ResU-Net、CS-Net。對比實驗的參數都與原論文保持一致,最終得到的分割效果如圖4。從黃色箭頭部分可以看出其他方法缺乏對血管連續分割,而本文提出的方法在血管分割結果中連續性更高。除此之外,相較于U-Net、ResU-Net、CS-Net,本文提出的方法并未分割出圖像中存在的噪聲背景,而且實現了更精準的血管分割結果,以方便后續醫生的疾病篩查與診斷。

圖4 本文方法與對比方法結果圖

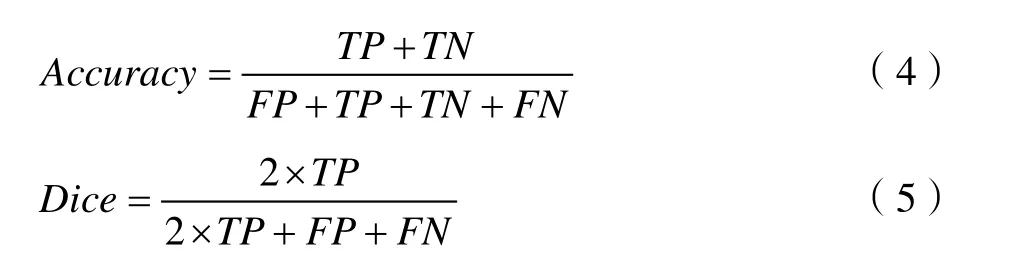

分割指標結果如表2,本文提出的方法在AUC、準確率、Dice中分別達到了95.8%、95.5%、64.6%。相比于現有的主流方法,本文提出的方法達到了最高的分割結果。AUC的值最高,代表本文提出的方法具有更穩定的分割性能。對比于基本框架U-Net,本文提出的方法在AUC、準確率、Dice系數上分別提高了2.1、0.1、3.4個百分點,實現了分割模型的優化與分割精確度的提升。

表2 對比方法實驗結果

3.4 消融實驗

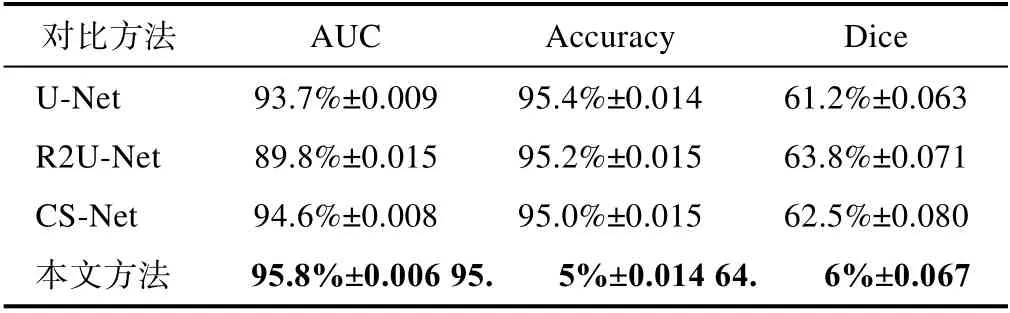

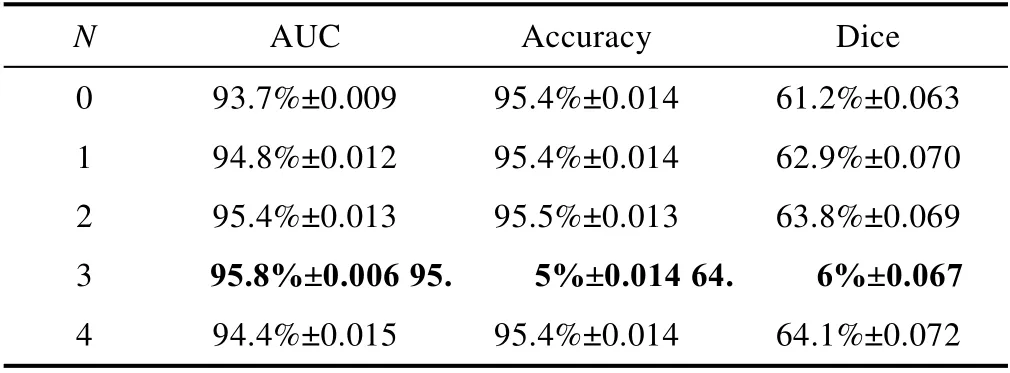

本文方法基于U-Net為基礎框架改進,并連接個N個“微型U-Net”網絡。本文討論N的取值,最終確定網絡結構得到最好的分割效果。當N=0 時,網絡模型為基礎框架U-Net。隨著N逐漸增大至4,分割實驗結果如表3所示。可以看出隨著N逐漸增大至3,AUC、準確率、Dice系數值相比于基礎框架U-Net,分割結果隨N的增大而提高;而當N=4 時,AUC、準確率、Dice系數已經保持在了一定準確率,沒有進一步提升,反而有了小幅度的下降。由于隨著網絡語義獲取層次的推進,最后反而會引起圖像細節信息丟失的問題。所以,最終本文采用3個“微型U-Net”的網絡結構為最終方法,從而實現結膜圖像中血管的自動分割。

表3 不同“微型U-Net”個數實驗

4 結語

本文針對結膜圖像開展分割方法的研究,首先對獲取的圖像進行橫紋噪聲去除的預處理任務,并作為新的數據集。基于U-Net的基礎結構上級聯3個“微型U-Net”來提高網絡對血管的準確分割能力,并聯合Focal與Dice損失函數共同約束來訓練網絡模型,解決血管圖像數據分布不均衡的問題。通過對比其他血管分割方法、討論“微型U-Net”個數,確定分割模型。最終結果表明,本文提出的方法可以有效提高血管分割的準確度,方便后續疾病篩查與診斷研究。