模糊直方圖模型的運(yùn)動(dòng)目標(biāo)跟蹤

修春波,李欣,巴富珊

(1. 天津工業(yè)大學(xué) 電氣工程與自動(dòng)化學(xué)院,天津 300387; 2. 天津工業(yè)大學(xué) 電工電能新技術(shù)天津市重點(diǎn)實(shí)驗(yàn)室,天津 300387)

運(yùn)動(dòng)目標(biāo)的識(shí)別與跟蹤在軍事、安防、工業(yè)生產(chǎn)等領(lǐng)域中有著廣泛的應(yīng)用前景[1-3]。實(shí)時(shí)跟蹤系統(tǒng)對(duì)跟蹤方法的運(yùn)算量一般有著較為嚴(yán)苛的要求[4-7]。但過于簡化的跟蹤方法對(duì)目標(biāo)特征描述不夠充分,造成難以適應(yīng)復(fù)雜場景下跟蹤準(zhǔn)確性的要求。尤其當(dāng)目標(biāo)所處場景的光照不穩(wěn)定時(shí),跟蹤系統(tǒng)對(duì)跟蹤方法的適應(yīng)能力就會(huì)提出更高要求[8-10]。在現(xiàn)有跟蹤方法中,Meanshift算法由于具有運(yùn)算量小,計(jì)算速度快等優(yōu)點(diǎn)而得到較快發(fā)展[11]。在Meanshift算法基礎(chǔ)上所提出的Camshift改進(jìn)算法能夠適應(yīng)目標(biāo)縮放變化等需求,改善了跟蹤性能[12-13]。為了提高跟蹤方法對(duì)復(fù)雜場景的適應(yīng)能力,通過融合多種輔助特征信息、抑制背景信息或突出目標(biāo)顯著性信息等方式,又提出了一系列的改進(jìn)跟蹤方法[14-16],如基于顯著性加權(quán)直方圖模型[17]及融合邊緣紋理特征的直方圖模型[18]的跟蹤方法等。

Meanshift算法、Camshift算法以及各種改進(jìn)方法均是利用目標(biāo)的色度(Hue)直方圖模型來描述目標(biāo)的基本特征,利用反向投影實(shí)現(xiàn)目標(biāo)的定位跟蹤[12-18]。因此目標(biāo)直方圖模型的穩(wěn)定性和準(zhǔn)確性直接影響著跟蹤性能。現(xiàn)有Camshift等跟蹤方法采用精確集合的定義選取劃分閾值[12-18],而實(shí)際跟蹤過程中,由于光照變化等干擾因素會(huì)造成場景圖像的色度產(chǎn)生一定的漂移。從而引起目標(biāo)直方圖模型的不穩(wěn)定,降低了目標(biāo)跟蹤的性能。

為了提高直方圖模型對(duì)色度漂移的抑制能力,結(jié)合模糊集合理論,提出了目標(biāo)模糊直方圖模型建立方法,弱化了色度等級(jí)劃分閾值的作用,根據(jù)目標(biāo)的模糊直方圖定義了新的反向投影方式,實(shí)現(xiàn)目標(biāo)定位與跟蹤,有效抑制光照變化等干擾因素對(duì)目標(biāo)跟蹤性能的影響,提高跟蹤方法的適應(yīng)能力。

1 模糊直方圖模型

目標(biāo)直方圖模型由于具有旋轉(zhuǎn)不變性及計(jì)算量小等優(yōu)點(diǎn),在許多跟蹤方法中得到有效應(yīng)用。通常選擇HSV顏色空間中H(色度)分量建立直方圖模型。設(shè)色度值H的定義域?yàn)閇0,180],色度等級(jí)劃分為 m 級(jí),0~h1為第 1 個(gè)等級(jí),hj-1~hj為第j個(gè)等級(jí),hm-1~ 180為第m個(gè)等級(jí),目標(biāo)區(qū)域中像素點(diǎn)i的坐標(biāo)為(xi,yi),其色度等級(jí)值表示為b(xi,yi),這樣目標(biāo)色度直方圖模型可建立為 q′={q?u},

式中s為目標(biāo)區(qū)域中所包含像素點(diǎn)的數(shù)量。式(1)所建立的直方圖模型是采用精確集合的方法進(jìn)行色度等級(jí)的劃分。因此光照變化等干擾,會(huì)造成目標(biāo)直方圖模型不穩(wěn)定,嚴(yán)重影響目標(biāo)跟蹤方法的性能。

模糊集合能夠通過弱化集合劃分閾值的方式實(shí)現(xiàn)不確定知識(shí)表示,從而可改善模型描述的魯棒性,因此提出了基于模糊隸屬度劃分的目標(biāo)直方圖模型表示方法。

選擇梯形色度隸屬度函數(shù),則第k個(gè)色度模糊等級(jí)的隸屬度函數(shù)μk(h)描述為

基于上述模糊劃分的色度模糊直方圖模型可表示為q={qu},,其中qu為

式(2)所建立的直方圖模型由于相鄰色度等級(jí)之間沒有明顯的界限,弱化了色度等級(jí)閾值對(duì)直方圖模型的影響,從而可有效抑制色度漂移和光照變化產(chǎn)生的干擾,提高目標(biāo)直方圖模型的穩(wěn)定性。

2 基于模糊直方圖模型的跟蹤方法

利用式(2)的目標(biāo)模糊直方圖進(jìn)行反向投影,可建立跟蹤場景的概率分布圖。由于采用模糊直方圖模型,因此反向投影方式與傳統(tǒng)方法有所不同。設(shè)跟蹤場景中像素點(diǎn)(x,y)的色度值為h(x,y),根據(jù)式(2)模糊直方圖模型定義反向投影概率分布圖中該點(diǎn)的像素灰度值p(x,y)為

式中INT()為取整函數(shù)。根據(jù)色度模糊等級(jí)的劃分,同一色度值隸屬于不同的色度等級(jí),因此,式(3)采用加權(quán)平均方式求得場景圖像反向投影概率分布圖中各像素的灰度值,灰度值越大,表示該點(diǎn)為目標(biāo)區(qū)域中的點(diǎn)的概率越大。基于式(3)的反向投影方式,目標(biāo)跟蹤的具體流程可描述為:

1)選定跟蹤目標(biāo)區(qū)域,利用式(2)建立目標(biāo)區(qū)域的色度模糊直方圖模型;

2)獲取當(dāng)前跟蹤場景,利用式(3)求取當(dāng)前跟蹤場景的反向投影概率分布圖;

3)根據(jù)場景反向投影概率分布圖中各像素點(diǎn)的灰度值,求取跟蹤搜索窗的質(zhì)心坐標(biāo)(xc,yc),即

5)平移跟蹤搜索窗的中心至質(zhì)心位置,并重復(fù)3)~5),直到移動(dòng)距離小于設(shè)定閾值;

6)更新跟蹤目標(biāo)的長L、寬W及方向角θ,即

7)返回1),根據(jù)新確定的目標(biāo)區(qū)域重建目標(biāo)模糊直方圖模型,對(duì)下一幀場景圖像進(jìn)行定位跟蹤。

跟蹤方法中采用模糊集合實(shí)現(xiàn)色度等級(jí)的劃分,并利用加權(quán)平均的解模糊方法建立了場景圖像的反向投影概率分布圖,可有效抑制光照變化和色度漂移等干擾因素對(duì)目標(biāo)模型的影響。

3 實(shí)驗(yàn)結(jié)果分析

3.1 色度漂移直方圖模型比較

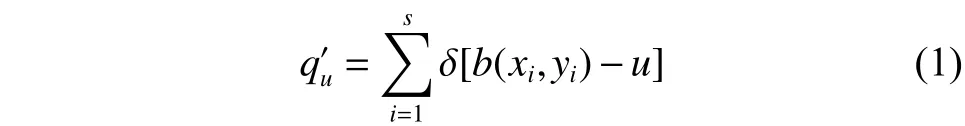

圖1為相同視角下相鄰采樣間隔得到的兩幀場景圖像。

圖1 不同采樣時(shí)刻場景Fig. 1 Scenes sampled at different times

由于采樣差異,兩個(gè)場景圖像中存在微小的色度差異。場景中白框內(nèi)的區(qū)域設(shè)定為目標(biāo)。將色度區(qū)間均勻分為12個(gè)等級(jí),即m=12,采用精確集合劃分方式建立兩幀場景中目標(biāo)的直方圖模型,如圖2所示。

圖2 不同采樣時(shí)刻場景圖中目標(biāo)直方圖Fig. 2 Target histograms in the scenes sampled at different times

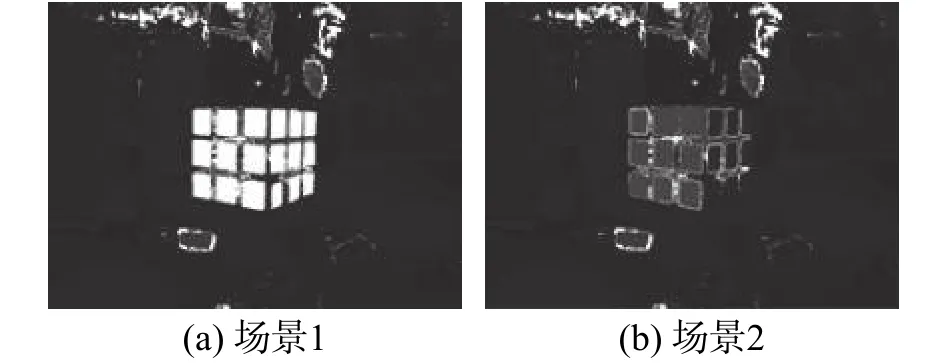

由圖2可見,場景1中的目標(biāo)直方圖與場景2中的目標(biāo)直方圖相比,二者有明顯差異。這是由于色度等級(jí)劃分閾值附近的色度值發(fā)生了微弱的漂移,從而導(dǎo)致不同時(shí)刻同一目標(biāo)的直方圖模型差異很大。分別采用圖2中的兩個(gè)直方圖模型進(jìn)行反向投影,得到圖1中兩個(gè)場景的概率分布圖如圖3和圖4所示。

圖3 基于場景1的直方圖所得反向投影Fig. 3 Projection images based on the histogram in scene 1

圖4 基于場景2的直方圖所得反向投影Fig. 4 Projection images based on the histogram in scene 2

圖3和圖4中越白的區(qū)域其灰度值越大,表示屬于目標(biāo)的概率越大。從結(jié)果可見,由于同一目標(biāo)在不同采樣時(shí)刻的直方圖模型存在明顯差異,因此利用場景中的目標(biāo)直方圖模型進(jìn)行反向投影,目標(biāo)區(qū)域具有較大概率值,而利用非場景中目標(biāo)直方圖模型進(jìn)行反向投影,目標(biāo)區(qū)域的概率值明顯降低,容易造成目標(biāo)定位不準(zhǔn)確,甚至定位錯(cuò)誤。在跟蹤算法中,均采用前一幀場景中目標(biāo)的直方圖對(duì)當(dāng)前場景進(jìn)行反向投影,因此容易造成跟蹤不穩(wěn)定,甚至跟蹤失敗。

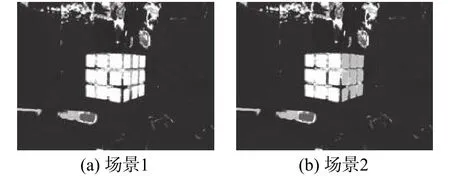

圖5給出了基于模糊劃分的兩幀圖像中目標(biāo)區(qū)域的模糊直方圖模型。

圖5 不同采樣時(shí)刻場景圖中目標(biāo)模糊直方圖Fig. 5 Target fuzzy histograms in the scenes samples at different times

由圖5可見,采用模糊劃分建立目標(biāo)區(qū)域的直方圖模型時(shí),兩個(gè)場景中目標(biāo)直方圖模型的像素點(diǎn)均集中在相同的4個(gè)等級(jí)中,且兩個(gè)直方圖模型差異不大。這是由于色度等級(jí)采用模糊劃分,弱化了劃分閾值的作用,當(dāng)色度在小范圍內(nèi)發(fā)生漂移時(shí),對(duì)直方圖模型的影響并不大,提高了所建直方圖模型的穩(wěn)定性。采用圖5中的兩個(gè)直方圖模型進(jìn)行反向投影,分別建立兩個(gè)場景的概率分布圖如圖6和圖7所示。

圖6 基于場景1的目標(biāo)模糊直方圖所得反向投影Fig. 6 Projection images based on the target fuzzy histogram in scene 1

從圖6和圖7的反向投影概率分布圖可見,由于兩個(gè)場景中目標(biāo)的直方圖模型相似,因此兩個(gè)場景中的目標(biāo)區(qū)的像素點(diǎn)都具有較大的概率值,即像素點(diǎn)的灰度值較大,這樣目標(biāo)能夠很好地從場景圖像中顯現(xiàn)出來,有利于提高目標(biāo)定位的準(zhǔn)確性。

圖7 基于場景2的目標(biāo)模糊直方圖所得反向投影Fig. 7 Projection images based on the target fuzzy histogram in scene 2

3.2 跟蹤實(shí)驗(yàn)結(jié)果

采用傳統(tǒng)直方圖模型、顯著性直方圖模型[17]、多特征融合直方圖模型[18]以及本文方法對(duì)不同光照情況下的目標(biāo)進(jìn)行對(duì)比跟蹤實(shí)驗(yàn)。

實(shí)驗(yàn)一 對(duì)PETS2001目標(biāo)跟蹤測(cè)試庫中Camera2.mov視頻中的車輛目標(biāo)進(jìn)行跟蹤,視頻光照穩(wěn)定,目標(biāo)明顯,跟蹤情況較為簡單。上述4種跟蹤方法所得跟蹤結(jié)果如圖8~11所示。

圖8 傳統(tǒng)直方圖模型跟蹤效果Fig. 8 Tracking result based on the traditionsl histogram model

圖9 顯著性直方圖模型跟蹤效果Fig. 9 Tracking result based on the saliency histogram model

圖10 多特征融合直方圖模型跟蹤效果Fig. 10 Tracking result based on multiple features fusion histogram model

圖11 模糊直方圖模型跟蹤效果Fig. 11 Tracking result based on fuzzy histogram model

從跟蹤實(shí)驗(yàn)結(jié)果可見,由于目標(biāo)所處場景光照穩(wěn)定,目標(biāo)色度漂移不明顯,目標(biāo)與其周圍背景的顏色也有較明顯的差異,因此跟蹤情況較為簡單。上述各種跟蹤方法均可較為準(zhǔn)確地完成目標(biāo)跟蹤任務(wù)。

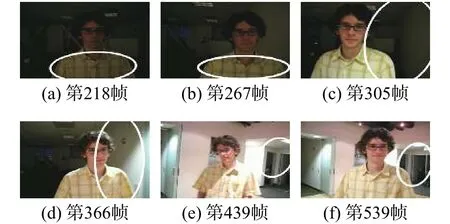

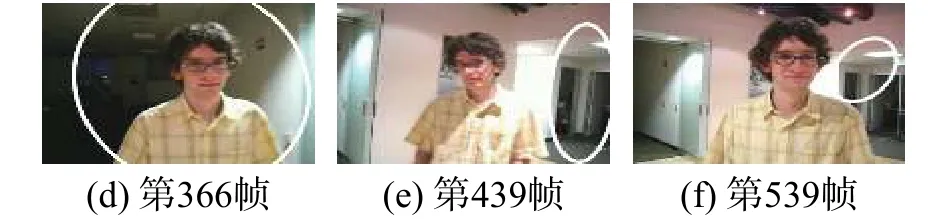

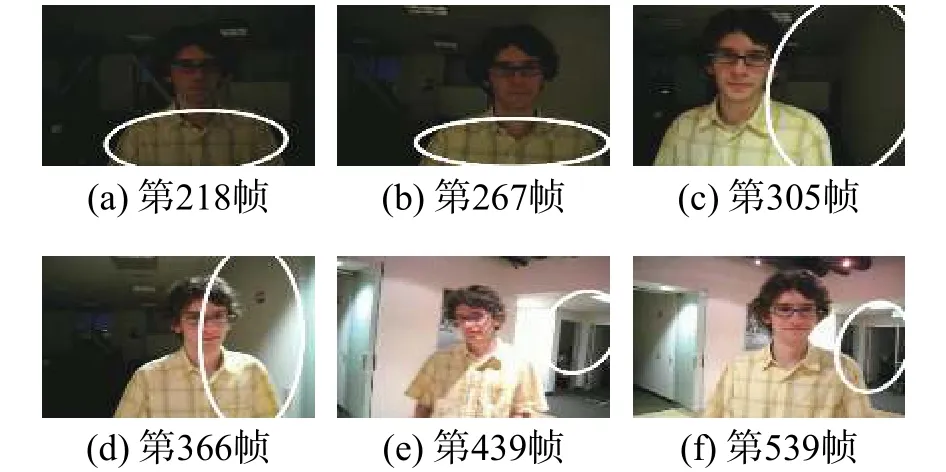

實(shí)驗(yàn)二 選擇Visual Tracker Benchmark跟蹤視頻庫中David序列圖像中的人體目標(biāo)進(jìn)行跟蹤。該跟蹤場景中運(yùn)動(dòng)目標(biāo)的光照由暗到亮變化顯著,色度漂移明顯,目標(biāo)跟蹤難度增大。圖12~15給出了上述4種跟蹤方法所得跟蹤結(jié)果。

圖12 傳統(tǒng)直方圖模型跟蹤效果Fig. 12 Tracking result based on the traditional histogram model

圖13 顯著性直方圖模型跟蹤效果Fig. 13 Tracking result based on the saliency histogram model

圖14 多特征融合直方圖模型跟蹤效果Fig. 14 Tracking result based on multiple features fusion histogram model

圖15 模糊直方圖模型跟蹤效果Fig. 15 Tracking result based on fuzzy histogram model

由跟蹤結(jié)果可見,跟蹤過程中David從光線陰暗的房間走到明亮的房間,行走過程中目標(biāo)由暗變亮,色度發(fā)生很大的變化,傳統(tǒng)直方圖模型無法適應(yīng)強(qiáng)光照變化的干擾,很快導(dǎo)致跟蹤失敗。顯著性直方圖模型及多特征直方圖模型方法利用所結(jié)合的輔助特征能夠在一定程度上改善跟蹤方法的適應(yīng)能力,但當(dāng)光照變化激烈時(shí),所融合的特征也會(huì)受到嚴(yán)重干擾而變得不穩(wěn)定,最終無法完成跟蹤任務(wù)。本文采用模糊直方圖模型對(duì)目標(biāo)進(jìn)行描述,提高了目標(biāo)模型的穩(wěn)定性,對(duì)跟蹤過程中的色度漂移能夠起到有效抑制,因此即使在光照發(fā)生明顯變化時(shí),仍然能夠保證跟蹤結(jié)果的魯棒性。

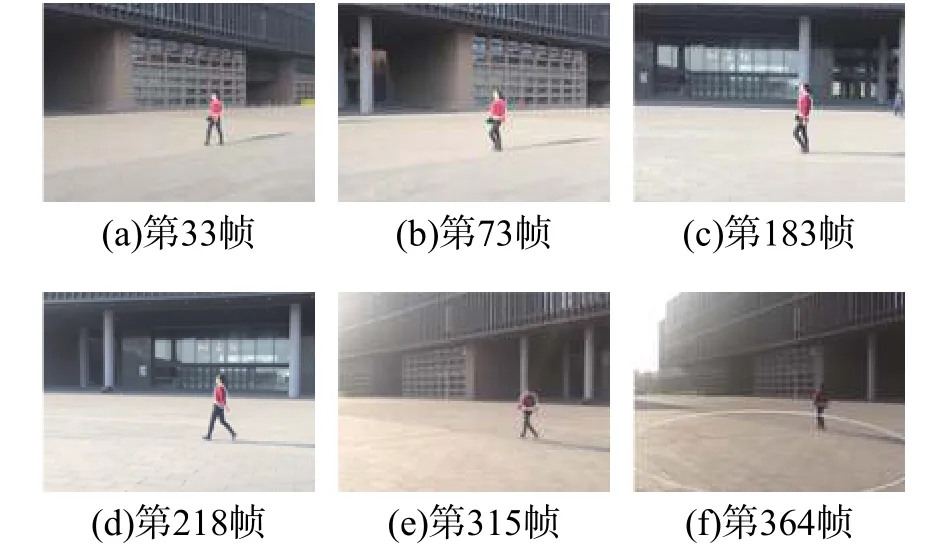

實(shí)驗(yàn)三 對(duì)實(shí)際光照變化復(fù)雜的運(yùn)動(dòng)目標(biāo)進(jìn)行跟蹤實(shí)驗(yàn),目標(biāo)運(yùn)動(dòng)過程中分別處于順光、側(cè)光以及逆光等光照狀態(tài)下,目標(biāo)區(qū)的色度變化明顯,準(zhǔn)確定位難度較大。上述各跟蹤方法的跟蹤結(jié)果如圖16~19所示。

圖16 傳統(tǒng)直方圖模型跟蹤效果Fig. 16 Tracking result based on the traditional histogram model

圖17 顯著性直方圖模型跟蹤效果Fig. 17 Tracking result based on the saliency histogram model

圖18 多特征融合直方圖模型跟蹤效果Fig. 18 Tracking result based on multiple features fusion histogram model

圖19 模糊直方圖模型跟蹤效果Fig. 19 Tracking result based on fuzzy histogram model

由于目標(biāo)運(yùn)動(dòng)過程中光照變化較大,因此目標(biāo)區(qū)的色度變化明顯,由圖16可見,傳統(tǒng)直方圖模型對(duì)光照變化十分敏感,目標(biāo)從側(cè)光變?yōu)槟婀獾倪^程中,目標(biāo)定位錯(cuò)誤,造成跟蹤失敗。在圖17中,由于目標(biāo)處于不同的光照條件下,目標(biāo)的顯著性色度信息因?yàn)樯绕埔矔?huì)變得不穩(wěn)定,因此導(dǎo)致跟蹤效果不夠理想,最終無法完成目標(biāo)全過程的跟蹤。在圖18中,多特征融合直方圖模型所融合的輔助特征能夠在一定程度上改善目標(biāo)定位的準(zhǔn)確性,但當(dāng)光照變化嚴(yán)重時(shí),輔助特征也會(huì)發(fā)生不穩(wěn)定變化,導(dǎo)致最終目標(biāo)丟失。由圖19可見,本文方法對(duì)色度化具有較好的適應(yīng)能力,模糊直方圖對(duì)光照變化引起的色度漂移具有良好的魯棒性,通過及時(shí)更新目標(biāo)模型,跟蹤方法能夠完成目標(biāo)在順光、側(cè)光以及逆光下的跟蹤。

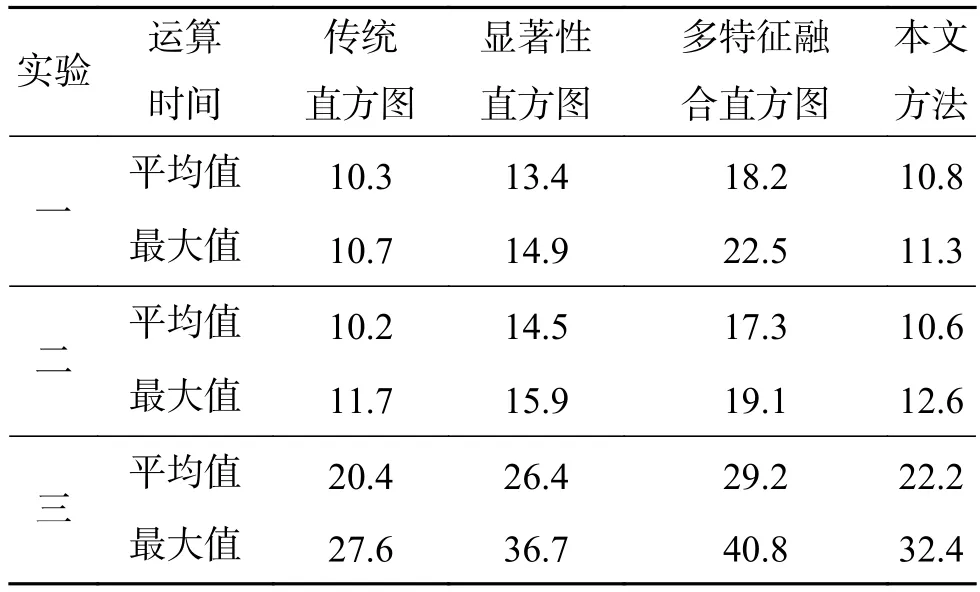

3.3 性能分析

實(shí)驗(yàn)一、二、三的結(jié)果給出了跟蹤方法的定位性能,除此之外,計(jì)算速度也是評(píng)價(jià)跟蹤方法性能的主要指標(biāo)。實(shí)驗(yàn)中有的跟蹤方法無法完成全過程跟蹤,因此本文給出了有效跟蹤時(shí)單幀平均跟蹤時(shí)間及最大跟蹤時(shí)間,如表1所示。

表1 單幀跟蹤對(duì)比時(shí)間Table 1 Tracking time of the single frame ms

由表1可見:傳統(tǒng)直方圖模型建立簡單,運(yùn)算量最小;基于顯著性直方圖模型由于需要計(jì)算背景與目標(biāo)信息的差異,因此建模所需計(jì)算量有所增加;多特征融合直方圖模型由于需要提取邊緣、紋理等輔助特征,因此建模過程中計(jì)算量增加較多。而本文方法在建立直方圖模型時(shí)僅是色度等級(jí)劃分方式有所不同,因此模型建立以及目標(biāo)定位過程中所涉及的計(jì)算量與基本Camshift方法相當(dāng),跟蹤過程中單幀最大運(yùn)算時(shí)間小于40 ms,滿足電視跟蹤等系統(tǒng)的實(shí)時(shí)性要求。

4 結(jié)束語

針對(duì)跟蹤場景中光照不穩(wěn)定造成目標(biāo)色度漂移,從而影響跟蹤性能的問題,提出了基于模糊直方圖模型的目標(biāo)跟蹤方法,采用模糊劃分色度等級(jí)的方式建立目標(biāo)直方圖模型,弱化了色度劃分閾值對(duì)直方圖模型的影響,降低了目標(biāo)模型對(duì)光照變化等干擾的敏感性,提高了跟蹤方法的適應(yīng)性。跟蹤實(shí)驗(yàn)結(jié)果表明,在光照變化明顯等情況下,與傳統(tǒng)跟蹤方法相比,該方法具有更好的跟蹤性能,能夠完成在不同光照條件下的目標(biāo)跟蹤,且目標(biāo)定位與跟蹤所需計(jì)算量較小,運(yùn)算時(shí)間滿足實(shí)時(shí)性的要求。