基于整體-星型模型的人體姿態估計

代 欽,石祥濱,喬建忠,劉 芳,

1(沈陽工程學院 信息學院,沈陽 110136)2(東北大學 計算機學院,沈陽 110819)3(沈陽航空航天大學 計算機學院,沈陽 110136)

1 引 言

人體結構用于描述人體各個部位的關聯關系,組織局部的部位構成全局的人體,是姿態估計問題中一個主要的研究內容.姿態估計中的人體結構主要包括樹型模型和星型模型等[1].樹型結構可以比較直觀地表示人體各個部位的關聯關系,并且易于使用動態規劃方法推理部位信息.因此大多數姿態估計方法采用樹型模型對人體結構建模.現有的樹型人體結構大多采用單模型表示人體部位.由于人體各個部位靈活度較高,基于單模型的樹型人體結構無法描述多樣化的人體姿態.此外,樹型結構需根據人體各部位的連接關系完成推理,當某一部位出現錯誤匹配時會將該錯誤傳輸到其孩子節點造成累計誤差,從而影響其所有子孫節點的的正確識別.

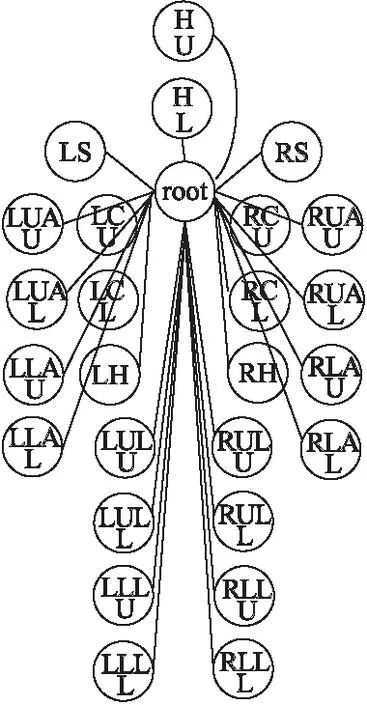

由于人體各個部位分別分布在軀干周圍的幾處相對穩定的位置(如圖2所示),可以使用星型模型[2-4]描述人體部位相對于軀干的分布關系.星型人體結構將各個部位看做獨立的局部組件,所有部位擁有相同的根節點.其優點是連接方式單一、推理簡單,某一局部部位的錯誤識別不會被傳輸至其他節點.但是,單模的星型模型仍然無法描述多樣化的人體姿態.姿態多樣化主要分為人體整體姿態的多樣化和單個部位姿態的多樣化.

針對整體姿態的多樣化問題,本文首先判斷人體軀干的方位,即整體方位,然后利用各個部位相對于整體的方位信息,描述人體部位的分布情況.這樣可以利用人的整體結構對局部部位進行修正,降低復雜姿態對部位識別的影響.例如,對于較難識別的倒立的人體,確定整體方向為倒立之后,可以根據人體部位的分布關系增加其他部位被正確識別的概率.針對單個部位姿態的多樣化問題,本文通過多模星型模型描述各個部位相對于整體不同方位的姿態.多模星型模型主要用于描述相對于軀干(整體)具有較大靈活度的四肢.例如,舉起的手臂與垂下的手臂分別位于軀干的不同位置,使用單一的星型人體結構很難準確檢測到手臂.因此,使用多個模型表示人體結構易于捕獲處于不同方位的人體部位.此外,由于星型模型無法描述人體部位的相鄰連接關系,需要融合樹型模型來完成人體結構建模.

本文提出一種結合多模整體模型和多模星型模型的人體姿態估計方法.首先,使用多模整體模型檢測人體整體(表示軀干)方位;然后提出一種多模型的星型模型表示具有一定方位偏差的人體部位和整體之間的關系.為了更好地描述相鄰部位之間的分布關系,在整體-星型模型中融合樹型模型.

2 相關工作

人體結構主要包括星型模型和樹型模型.目前大多數姿態估計方法都采用樹型模型完成人體結構的建模[5-8].其各個部位以樹形結構組織為一個整體,每一部位節點只有唯一的父節點,便于有效地推理.但是樹形結構容易受到累計誤差的影響,導致人體姿態的整體錯誤[1].星型模型將各個人體部位視為獨立的節點,各個節點之間無直接的幾何關系[1].例如,Poselets[9]使用星型模型為人體部位建立各自的表觀模型,為了更好地識別特征相似的相鄰部位,將其作為一個部位集合完成建模.文獻[2-4]提出了利用星型模型(constellation model)的目標識別方法,識別單個整體目標時將其表示為若干局部部件,并使用星型模型結構表示各個部位的關系.該方法主要用于剛體目標的識別,例如汽車,但對于人體局部部位的描述具有一定的局限性.

針對姿態多樣性問題,國內外研究者提出了多種基于整體多樣化和部位多樣化的姿態估計方法.Yang等[7]提出了FMP模型,使用基于多方向的部位檢測器完成人體整體姿態的估計.但該模型主要使用了單個部位方向的檢測器,未考慮整體方位的影響.Pishchulin等[10]提出使用Poselets描述人體部位集合,并根據人體結構方向的星型先驗信息將這些部位集合關聯為一個人體.該論文重點考慮了局部的方向,未使用單獨的整體方向檢測器.Felzenszwalb等[11]提出了DPM(deformable part model)完成了人體檢測,首先從低分辨率HOG(histogram of oriented gradient)特征獲取人體整體方位,然后在高分辨率HOG特征中完成多個形變部位的搜索.該方法獲得較高的行人檢測準確率,但所捕獲的局部部位的信息不夠準確.Toshev等[12]使用深度學習方法,提出DeepPose姿態估計方法,優化了人體部位檢測器.通過級聯DeepPose回歸器完成了對圖像的整體推理,獲得了當時較好的姿態估計結果.通過對多個姿態估計方法結果分析發現,目前的基于PS模型的方法對于人的頭部和軀干的識別結果較準確,而對肢體的識別率較低.Dai等[13]提出一種基于整體方向的姿態估計方法,通過人的頭-軀干檢測器確定人體方位,進而提高整體的姿態估計效率.但是該方法只考慮了相鄰部位的位置關系,未考慮整體方向與各個局部部位的相對分布關系.文獻[14]提出的基于abstraction部位的姿態估計方法,通過對稱部位的合并將推理過程中的簡單循環去除,并且可以通過動態規劃有效地找到部位位置的計算.文獻[15]提出端對端姿態估計框架,包括DCNNs和DMP(deformable mixture of parts),將領域先驗知識加入到框架中,調整了學習過程,不管是循環模型或者樹型模型都提高了靈活性.文獻[16]提出一種基于個體的卷積神經網絡完成姿態估計,使用一種針對遮擋的自我評價模型,通過個性化的外觀特征完成人體部位的針對性識別.

為了降低樹型人體結構的累積誤差,并解決姿態估計受到人體姿態多樣化影響的問題,特別是非直立姿態誤檢率較高的問題,本文提出結合整體模型和星型部位模型的人體姿態估計方法.

3 問題分析

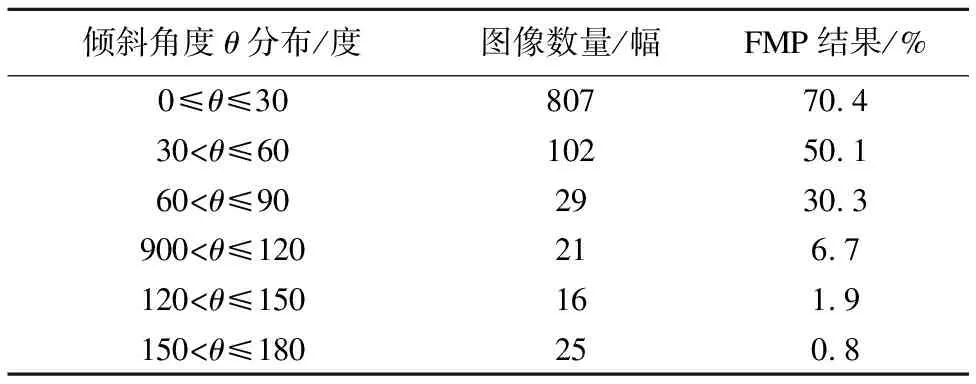

大多數的人體姿態估計方法都采用樹型結構模型,根據人體各個部位的物理關聯關系將人體表示為一個樹型連接剛體結構.例如,PS模型[5]通過描述人體單個部位和相鄰兩個部位的關系建立人體結構模型,根據以上兩項的匹配得分確定最終的姿態結果.該方法對于相對直立的人體姿態獲得了較好的結果[7],但是當人體處于非直立狀態(特別是倒立)時基于樹型結構的方法結果會出現較多錯誤匹配.主要原因是:首先,樹型模型中父節點的誤識別直接影響了孩子節點以及其他子孫節點的識別.例如軀干錯誤會傳輸至腿部.其次,由于人體整體和部位姿態的多樣性,無法使用統一的單模型表示人體結構.例如,非直立人體易被誤判為直立狀態.在標準數據集和日常圖像中存在大量的非直立人體,例如,LSP測試集的1000幅圖像中人體軀干傾斜角度分布情況和對應的FMP姿態估計結果,如表1所示.

表1 軀干傾斜角度θ分布和相應的FMP[7]結果

Table 1 Distribution of torso inclination θ and corresponding result of FMP[7]

傾斜角度θ分布/度圖像數量/幅FMP結果/%0≤θ≤3080770.430<θ≤6010250.160<θ≤902930.3900<θ≤120216.7120<θ≤150161.9150<θ≤180250.8

由表1可見,人體傾斜角度越大姿態估計準確率越低,因此針對人體整體姿態的多樣性,需要充分考慮人的整體方位,建立人體多模整體模型,再根據整體方位計算各個部位的分布位置.準確的整體方位可以通過圖像的全局引導,完成各個單個部位的正確識別.

圖1給出了FMP(flexible mixture of parts)[7]方法對非直立人體的姿態估計結果,如圖1所示,該方法為基于PS的較好方法之一.其中包含了3個非直立的人體圖像,FMP方法將以上人的姿態直接誤判為直立狀態,而導致姿態估計錯誤.主要原因是未考慮人體整體方向導致部位誤匹配,根據樹型關聯關系搜索部位,繼而引起累計誤差.

針對樹型模型的累計誤差問題,可以引入星型模型簡化人體結構,減少誤差信息的傳播.由人體部位分布圖2可見,各個部位集中在軀干周圍的幾處相對穩定的位置,因此可以根據頭部和四肢相對于軀干的位置完成星型人體結構的建模.文獻[2-4]提出的基于星型模型(constellation model)的物體識別方法,通過星型結構表示單個目標的各個部位之間關系.但是,現有的單模星型模型未充分考慮人體整體和部位姿態的多樣性.針對人體部位姿態的多樣性,本文需要構建多模星型人體結構,表示各個部位相對于整體的多種方位信息.

圖1 FMP[7]姿態估計結果Fig.1 Pose estimation result of FMP[7]

圖2給出了人體部位相對于軀干的分布圖.根據標準數據集LSP中人體各個部位的位置,以軀干部位作為基準映射出其他部位的分布情況.

圖2 人體各個部位的分布Fig.2 Layout of human body parts

綜上所述,為了減少部位之間傳輸信息的累積誤差,并表示多樣化的人體姿態,本文提出一種結合整體模型和星型模型的人體結構表示部位之間的關系,使用多模型的整體-星型人體結構表示具有多個位置的人體部位.同時,因為人體目標的特殊性,簡單地使用星型模型描述各個部位結構特征不利于表示人體相鄰部位間的關聯性.因此,根據整體模型、星型模型和樹型模型共同完成姿態估計.

4 基于整體-星型模型的姿態估計

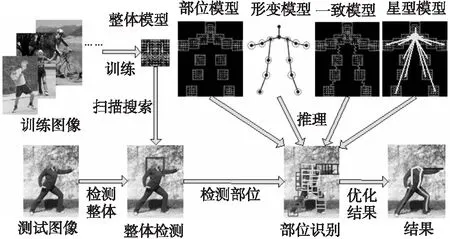

本文提出一種多模型的整體-星型人體結構完成人體姿態估計.整體流程如圖3所示.

訓練時分別對訓練集中人體整體和K個部位完成T個方向的聚類,從而獲得整體模型、部位模型、星型模型和樹型模型(包括一致性模型).為了融合星型模型和樹型模型完成姿態估計,需要在訓練過程中同時使用2個模型完成參數的學習.

在檢測階段,首先通過整體模型獲得人的方位,然后分別根據單個部位模型、形變模型、一致模型和星型模型的匹配得分獲得姿態估計總體匹配分數,完成優化處理獲得最佳姿態.計算方法如公式(1)所示.

S(I,p,t)=R(I,p)+P(I,p)+D(I,p)+C(t)

(1)

其中,S(I,p,t)表示某一姿態的總體得分,R(I,p)為星型模型匹配得分,P(I,p)為單個部位模型匹配得分,D(I,p)為形變模型匹配得分,C(t)為一致性模型匹配得分.整體模型匹配得分計算方法在4.1節給出,星型模型得分R(I,p)在4.2中給出,單個部位模型、形變模型和一致性模型在文獻[13]中給出.

圖3 基于整體-星型模型的姿態估計Fig.3 Pose estimation with global and constellation model

設I表示測試圖像;pi表示第i個部位信息,pi=(x,y,s),分別描述了第i個部位在圖像中的x,y坐標值和尺度.第i個部位的方向使用ti表示.其中部位編號i∈{1,…,K},pi∈{1,…,L},ti∈{1,…,T}.

4.1 多模人體整體模型

通過對多個研究的實驗結果的總結發現,姿態估計中人的頭部和肢體部位的檢測率較高,腿部次之,胳膊-手部位的檢測率較低.主要原因是,人的四肢具有相當大的自由度,在背景和衣著比較混亂的情況下很難正確檢測.為了在后續的部件檢測過程中獲取更多的先驗信息,減少各部件的搜索范圍,首先判斷圖像中人的整體位置和方向.整體模型描述了人體的2D位置和方向,位置由頭-肢體窗口確定,方向根據頭部和肢體的相對位置確定.因為目前的算法對于頭部和肢體的檢測準確較高,同時為了提高執行效率,本文只使用頭部和肩部建立整體模型,不考慮四肢.圖4給出了人體整體模型.

圖4 四個方向的人體整體模型圖Fig.4 Global body model for 4 orientation

為了描述人體的整體姿態多樣性,準確檢測人體整體的多個方位,圖4給出T=4個不同的整體檢測器完成人體檢測.多個模型更有利于捕獲處于不同狀態的人體整體方位.多模整體模型匹配得分計算方法如公式(2)所示.

(2)

人體整體檢測過程如下:

Step2.計算測試圖像I的各個位置及尺度pG=(xG,yG,sG)的HOG特征φ(I,pG)[17];

Step3.對于圖像I的所有位置和尺度pG分別計算第tG個模態整體模型的匹配分數G(I,p),獲取候選整體姿態.后續星型模型中需要根據人體整體方位完成各個部位的形變模型匹配得分的計算,因此為了保留正確的人體姿態需根據設定閾值獲取若干整體方位.

4.2 多模星型部位模型

星型人體部位模型作為一種人體結構的幾何約束關系,表示了各個部位相對于整體的分布配置[18].大多數的人體結構都采用樹型模型,主要是因為樹型結構較簡單且易于推理[11].但是樹結構[19,20]只使用了各個部位的相鄰關系,未考慮整體分布情況,容易造成誤差積累.

針對樹型人體模型中出現的誤匹配問題,本文提出多模星型部位模型,描述人體各個部位的整體分布信息,如圖5所示.

圖5 星型部位模型圖Fig.5 Constellated part model

星型部位模型給出了所有人體部位相對于根節點(root)的分布關系,根節點為人體整體方位.文獻[2-4]中使用的星型模型為每一部位的單一模型且未給出整體方位信息.而本文的星型模型為相對于人體整體模型的ti個不同方位的多模型.這樣可以更加有效地捕獲具有位置偏差的單個部位,并有效地完成各個部位的約束.該模型主要通過人體整體和單個部位的相對距離關系,計算各個部位的分布匹配得分.具體方法如公式(3)所示.

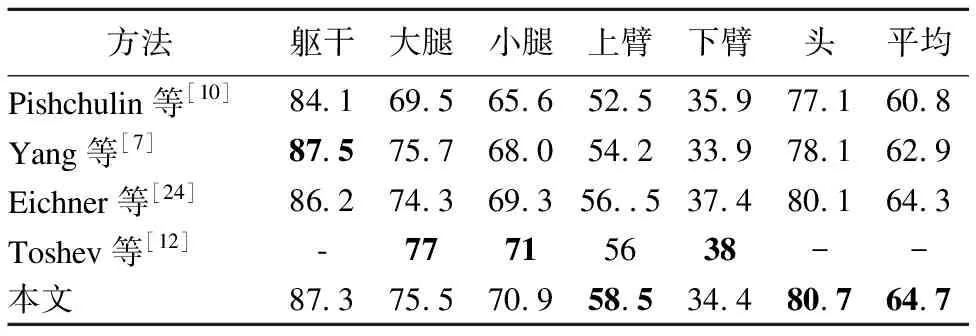

(3)

ψ(pi-pG)=[dxdx2dydy2]

(4)

多模星型模型計算過程如下:

Step2.計算測試圖像I中人體整體方位與各個部位之間的歐氏距離ψ(pi-pG)[11];

Step3.對于圖像I的所有位置和尺度p,分別計算第tG個整體模型與所有第i個部位的匹配分數之和R(I,p).

4.3 算法描述

本文首先通過整體模型獲得人的整體方位;然后分別根據單個部位模型、樹型形變模型和星型模型的匹配得分獲得姿態估計總體匹配分數;最終完成優化處理獲得最佳姿態.基于整體-星型模型的姿態估計具體算法如下所示.

輸出:人體各個部位模型匹配得分P(I,p)

1 獲取測試圖像I

2 for each測試圖像Ildo

3 for each第ti個類別 do

5 end

6Il←縮小圖像I為Il+1,縮放比例為1.2

7 ifIl長或寬<σ(最小圖像大小)

8 break

9 end

10 end

12 for each 測試圖像Ildo

13 for each 第i個部位do

14 for each第ti個類別 do

17 for each 孩子節點部位

19 end

20 end

21 獲得第i個節點的得分S(I,pi,ti)

22 end

23 獲得根節點的得分S(I,p,t)

24Il←縮小圖像Il為Il+1,縮放比例為1.2

25 ifIl長或寬<σ(σ為閾值)

26 break

27 end

28 end

5 訓 練

訓練的目的是獲得人體模型的參數,即選擇一系列的最有識別參數[1].

S(I,z)=β·Φ(I,z)

(5)

s.t.yi(βT·ρ(I,z)+b)≥1-yi·fβ(Ii,zi)

(6)

其中C表示懲罰因子,fβ表示決策函數.通過隨機梯度下降法獲得最優參數β.

6 推 理

通過調整圖像I中的人體部位的位置p以及方向t,使得公式(1)結果最大化.為了準確有效地計算出各個部位的數據,同時融合了星型模型和樹型模型完成推理,具體計算方法,如公式(7)所示.

(7)

(8)

mi(tj,pj)計算了節點j在位置pj和方向tj情況下節點i傳遞到父節點j的得分.保證scorei(I,ti,pi)為當前節點的最大值,當獲得根節點的得分最大值時的pi與ti即為最優姿態.

7 實 驗

7.1 實驗設置

數據集.本文在數據集IP(image parse)[21]和LSP(leeds sport poses)[22]上進行訓練和測試,以上兩個數據集中圖像均為包含整個人的圖像.人體正樣本分別使用標準數據集IP的100幅圖像和LSP的1000幅圖像.負樣本采用INRIA[17]數據集中不包含人體的圖像.將人體部位數量設置為K=26,人體整體和局部部位的方向T=6.

時間效率.實驗環境為win7操作系統;i5,3.1G的CPU;matlab代碼實現算法.在IP數據集上每幅圖像姿態估計平均時間為2秒,在LSP數據集上每幅圖像平均時間為1秒.因為在IP數據集中完成了對原始圖像的旋轉和對稱之后進行訓練,實際訓練圖像為1000幅,IP數據集上訓練時間約為40小時,LSP數據集上約為30小時.

評價方法.本文采用部位正確比例PCP[23]完成人體姿態估計的量化評價.目前主要有兩種評價標準strict PCP和loose PCP[23].本文采用第一種標準完成結果比較.

7.2 IP數據集結果

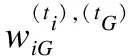

本文在IP數據集上與其他姿態估計方法完成比較,給出了strict PCP結果如表2所示.

表2 數據集IP上的結果比較(%)

Table 2 Comparison on IP dataset(%)

方法軀干大腿小腿上臂下臂頭平均Andriluka等[25]86.366.360.054.635.672.759.2Yang等[7]82.936.063.955.135.477.660.7Pishchulin等[10]82.274.663.754.939.870.762.9Yang等[26]85.974.968.363.442.786.867.1Johnson等[26]87.674.767.167.345.876.867.4Toshev等-80757150--本文方法87.876.672.062.042.084.967.8

從IP數據集的實驗結果(表2)可知,本文的軀干和平均結果均超出了其他算法(Toshev等[12]未給出頭部和軀干的識別結果).Andriluka等[25]采用基本的PS結構模型,說明本文提出的整體星型分布模型有利于表示處于多個方向的人體整體和部位.Yang等[7]提出的FMP使用部位的方向表示各個部位的姿態多樣性.Yang等[26]在其改進的FMP模型獲得了較高的姿態估計結果,頭部識別率達到86.8%.本文在此基礎上額外考慮了整體方位和部位分布,在軀干、腿部和平均結果超出了文獻[26].Pishchulin等[10]提出poselet表示人體姿態的中層特征,獲得62.9%的結果.Johnson等[26]訓練模型時使用額外的10000幅圖像,提高了多種人體姿態下的算法健壯性.本文使用約定的100幅圖像作為數據集完成模型的訓練,仍然在軀干、腿部、頭部和平均結果超出了文獻[26].說明本文的基于星型模型方法具有較好的健壯性.Toshev等[12]提出DeepPose方法,挖掘人體姿態的多層特征,同時使用LSP原始和擴展[26]兩個數據集總共11000幅圖像完成了模型訓練.本文的訓練數據集的100幅圖像,均為IP數據集約定的訓練圖像,因此訓練數據量方面明顯處于劣勢.

圖6給出了數據集IP上,本文方法(右圖)與FMP[7]方法(左圖)的比較結果.

由圖6可見,FMP方法將非直立人體姿態誤判為正立姿態,而本文的整體-星型模型正確地捕獲了人體整體方位和大部分的部位分布位置.主要原因是本文算法的整體模型可以捕獲多個方位的人體.但是由于受到遮擋、衣物、光照等噪聲的影響,有些局部部位的識別結果不夠理想.

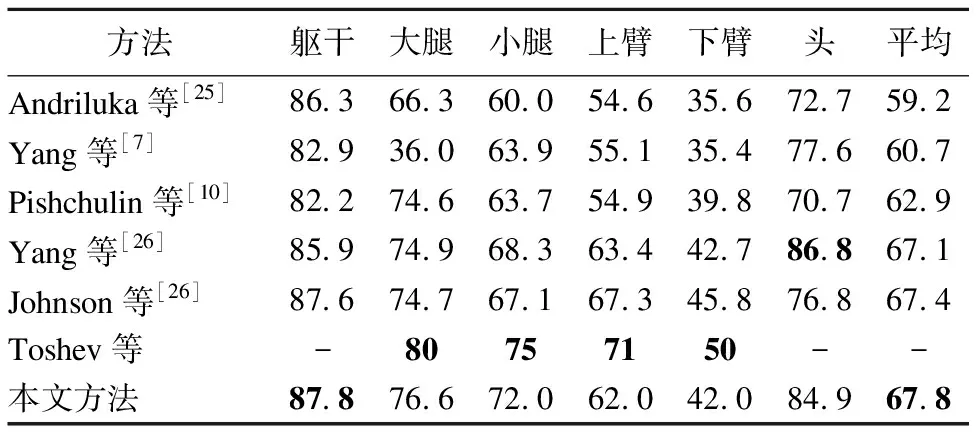

7.3 LSP數據集結果

LSP數據集上與其他姿態估計算法的比較結果如表3所示.

由LSP數據集的實驗結果(表3)可知,本文的上臂、頭部和平均結果均高于其他算法.Pishchulin等[10]的基于poselets的方法通過人體部位的中層特征描述了整體姿態,平均PCP達到60.8%.Yang等[7]的基于FMP的方法,提出局部部位方向的表示方法,獲得了較好的軀干部位的識別結果.Eichner等[24]在FMP方法基礎之上提出分別對前景和背景一致性的表示方法,提高了FMP識別結果.說明本文的星型模型有利于描述人體部位分布情況.Toshev等[12]的DeepPose方法在該數據集上同樣使用了11000幅圖像作為訓練集(標準訓練集為1000幅),獲得了較高的識別結果,但本文方法在上臂的識別結果高于該方法.說明本文在該數據集上的訓練數據量方面處于劣勢,但通過整體模型和星型模型描述人體整體方位和局部部位的分布,較好地捕獲了人體各個部位.

圖6 數據集IP上與FMP方法的姿態估計結果比較Fig.6 Pose estimation result on IP compared with FMP

由于本文引入星型部位模型表示人體整體部位的分布,對于多樣化的人體姿態估計結果優于其他算法.如圖7所示,給出了本文(右圖)與FMP[7]方法(左圖)的比較結果.

圖7 數據集LSP上與FMP方法的姿態估計結果比較Fig.7 Pose estimation result on LSP compared with FMP

由圖7可見,本文方法與FMP方法結果比較可知,FMP方法將大部分的非直立人體姿態判斷為正立姿態,但本文的星型模型正確地捕獲了大部分的人體部位分布位置,例如(a),(b),(c),(d),(e).根據準確的整體部位分布信息,獲得了較好的局部部位識別結果,例如(a)和(c);部分圖像則獲得了大多數部位正確的結果,例如(b),(d)和(e).對于部分具有挑戰性的人體姿態結果不夠理想,例如(f).

8 結 論

針對人體姿態的整體和局部部位多樣性問題,本文提出一種結合整體模型和星型模型的人體姿態估計方法,引入多模的整體-星型模型描述人體結構.首先,使用人體整體檢測器完成人體整體方位的檢測,獲取整體姿態多樣化的人體方位信息,為后續工作提供準確的整體信息,避免出現人體整體姿態誤檢導致的誤差累計問題;然后,提出一種多模型的星型

表3 數據集LSP上的結果比較(%)

Table 3 Comparison on LSP dataset(%)

方法軀干大腿小腿上臂下臂頭平均Pishchulin等[10]84.169.565.652.535.977.160.8Yang等[7]87.575.768.054.233.978.162.9Eichner等[24]86.274.369.356..537.480.164.3Toshev等[12]-77715638--本文87.375.570.958.534.480.764.7

結構表示人體各個部位和整體之間的若干個關系.該模型通過人體整體和單個部位的相對距離關系,計算各個部位的分布匹配得分,可以有效地捕獲具有位置偏差的單個部位,完成各個部位相對于整體的約束.最后,為了更好地描述相鄰部位之間的分布關系,在整體-星型模型中融合樹型模型完成姿態估計.數據集IP和LSP的結果表明,該方法提高了姿態估計準確率,尤其提高在人體姿態多樣的情況下的結果.