改進空間細節提取策略的分量替換遙感圖像融合方法

王文卿 劉涵 謝國 劉偉

摘 要:針對多光譜圖像與全色圖像間的局部空間差異引起的空譜失真問題,提出了一種改進空間細節提取策略的分量替換遙感圖像融合方法。與傳統空間細節提取方法不同,該方法旨在合成高質量的強度圖像,用其取代空間細節提取步驟中全色圖像的位置,以獲取匹配多光譜圖像的空間細節信息。首先,借助低分辨率強度圖像與高分辨率強度圖像的流形結構一致性,利用基于局部線性嵌入的圖像重建方法重構第一幅高分辨率強度圖像;其次,對低分辨率強度圖像與全色圖像分別進行小波分解,保留低分辨率強度圖像的低頻信息與全色圖像的高頻信息,利用逆小波變換重構第二幅高分辨率強度圖像;然后,將兩幅高分辨率強度圖像進行稀疏融合,獲得高質量強度圖像;最后,將合成的高分辨率強度圖像應用到分量替換融合框架,獲取最終融合圖像。實驗結果表明,與另外11種融合方法相比,所提方法得到的融合圖像具有較高的空間分辨率和較低的光譜失真度,該方法的平均相關系數、均方根誤差、相對整體維數合成誤差、光譜角匹配指數和基于四元數理論的指標在三組GeoEye-1融合圖像上的均值分別為:0.9439、24.3479、2.7643、3.9376和0.9082,明顯優于對比方法的相應評價指標。該方法可有效地消除局部空間差異對分量替換融合框架性能的影響。

關鍵詞:多光譜圖像;全色圖像;分量替換融合框架;空間細節提取;稀疏融合

中圖分類號: TP751.1文獻標志碼:A

Component substitution-based fusion method for remote sensing images via

improving spatial detail extraction scheme

WANG Wenqing1,2*, LIU Han1,2, XIE Guo1,2, LIU Wei1,2

(1. School of Automation and Information Engineering, Xian University of Technology, Xian Shaanxi 710048, China;

2. Shaanxi Key Laboratory of Complex System Control and Intelligent Information Processing

(Xian University of Technology), Xian Shaanxi 710048, China)

Abstract: Concerning the spatial and spectral distortions caused by the local spatial dissimilarity between the multispectral and panchromatic images, a component substitution-based remote sensing image fusion method was proposed via improving spatial detail extraction scheme. Different from the classical spatial detail extraction methods, a high-resolution intensity image was synthesized by the proposed method to replace the panchromatic image in spatial detail extraction with the aim of acquiring spatial detail information matching the multispectral image. Firstly, according the manifold consistency between the low-resolution intensity image and the high-resolution intensity image, locally linear embedding-based reconstruction method was used to reconstruct the first high-resolution intensity image. Secondly, after decomposing the low-resolution intensity image and the panchromatic image with the wavelet technique respectively, the low-frequency information of the low-resolution intensity image and the high-frequency information of the panchromatic image were retained, and the inverse wavelet transformation was performed to reconstruct the second high-resolution intensity image. Thirdly, sparse fusion was performed on the two high-resolution intensity images to acquire the high-quality intensity image. Finally, the synthesized high-resolution intensity image was input in the component substitution-based fusion framework to obtain the fused image. The experimental results show that, compared with the other eleven fusion methods, the proposed method has the fused images with higher spatial resolution and lower spectral distortion. For the proposed method, the mean values of the objective evaluation indexes such as correlation coefficient, root mean squared error, erreur relative global adimensionnelle de synthese, spectral angle mapper and quaternion theory-based quality index on three groups of GeoEye-1 fused images are 0.9439, 24.3479, 2.7643, 3.9376 and 0.9082 respectively. These values are better than those of the other eleven fusion methods. The proposed method can efficiently reduce the effect of local spatial dissimilarity on the performance of the component substitution-based fusion framework.

Key words: multispectral image; panchromatic image; component substitution-based fusion framework; spatial detail extraction; sparse fusion

0 引言

隨著人類對未知空間的不斷深入探索,衛星遙感系統已成為大范圍場景監測的重要工具,在深空探測、大氣監測、對地遙感、戰場偵察等領域發揮著日趨廣泛的作用。高空間分辨率和高光譜分辨率遙感影像成為用戶的迫切需求。然而,光譜傳感器探測多個波段,光譜帶寬狹窄,需具有較大瞬時視場角才能獲得可接受的信噪比。瞬時視場角大小是決定地面瞬時視場角大小(即空間分辨率)的直接因素,增大瞬時視場角大小意味著空間分辨率降低。因此,傳感器的空譜分辨率之間相互制約,難以同時獲取高空間分辨率與高光譜分辨率的遙感影像。光學遙感衛星,如GeoEye-1,一般搭載光譜成像傳感器和全色成像傳感器,獲取兩類圖像:多光譜 (MultiSpectral, MS) 圖像與全色(PANchromatic, PAN) 圖像。MS圖像擁有多個波段,具備高光譜分辨率,但其空間分辨率較低。與之相反,PAN圖像具備高空間分辨率,但其僅有單個波段,缺乏光譜信息。遙感圖像融合技術的提出,實現了MS圖像與PAN圖像的有效結合,獲得高空間分辨率多光譜(High spatial resolution MultiSpectral, HMS)圖像, 從“軟件”層面為解決遙感影像空譜分辨率矛盾提供了有效途徑[1,2]。

經過數十年發展,MS圖像與PAN圖像融合已經成為遙感圖像處理的熱點研究問題。諸多基于不同理論框架的MS與PAN圖像融合方法被提出,主要劃分為三類:分量替換方法、多分辨率分析方法與基于模型的方法[3-4]。分量替換融合框架以其簡單、高效、良好的銳化效果等優點被廣泛應用。分量替換融合方法包括基于強度色度飽和度(Intensity-Hue-Saturation, IHS)變換的融合方法、基于主分量分析(Principal Component Analysis, PCA)的融合方法與基于施密特正交(Gram Schmidt, GS)變換的融合方法等[1],其中基于IHS變換的融合方法最為經典。針對分量替換融合方法光譜失真嚴重的問題,該研究領域學者主要從如下兩個方面對其進行改進:空間細節信息提取方法與空間細節信息注入方法[5]。經典空間細節信息提取方法通過尋求最優譜權重,增強強度圖像與PAN圖像的相關性,獲取最佳空間細節圖像。經典IHS方法僅考慮了藍、綠、紅三波段融合,強度圖像與PAN圖像的低相關性使融合圖像嚴重光譜失真。文獻[6]提出了廣義強度色度飽和度 (Generalized IHS, GIHS)融合方法,適用于四波段多光譜圖像融合,其中譜權重設定為1/4。考慮MS圖像各波段光譜響應曲線與PAN圖像光譜響應曲線的重疊關系,文獻[7]提出了固定譜權重的IHS融合方法。然而,固定譜權重并不適用于所有類型的遙感數據。為此,文獻[8-9]提出了自適應譜權重的IHS融合方法,分別利用多元回歸分析和粒子群優化算法計算最優譜權重。文獻[10]提出了非線性IHS方法,采用局部與全局合成方法來構建強度圖像。然而,MS圖像與PAN圖像間的局部空間差異難以通過空間細節提取方案消除,細節信息的過度注入致使融合圖像空譜失真。為解決該問題,空間細節信息注入方法被提出。文獻[11]提出基于統計比率的高頻細節注入模型,通過部分替代的方式實現空間細節信息有效注入。文獻[12]提出了基于邊緣自適應的IHS融合方法,利用指數邊緣檢測算子設計空間細節信息注入模型。文獻[5]在文獻[12]方法的基礎上,考慮PAN圖像與MS圖像的邊緣特性,提出了改進的自適應邊緣注入模型,提高了融合圖像的空間與光譜質量。

基于多分辨率分析的方法則是利用金字塔變換、小波變換、曲波變換、輪廓波變換與脊波變換等[1]提取PAN圖像的高頻細節信息,并將其融入MS圖像來構建HMS圖像。文獻[13]將基于多分辨分析的融合方法歸納為統一框架,主要包含兩大步驟:空間細節信息提取與空間細節信息注入。空間細節信息提取利用空間濾波器提取單尺度或多尺度高頻信息。空間細節注入模型是設計波段增益系數調整注入MS圖像中細節信息數量。相較于分量替換融合方法,多分辨率分析融合方法可有效減少融合圖像光譜失真,但其計算復雜度更高,會產生空間畸變。

基于模型的融合框架是通過建立低分辨率MS(Low-resolution MS, LMS)圖像、PAN圖像與HMS圖像的關系模型,結合HMS圖像先驗特性,構建與求解目標函數重建融合圖像。此類方法所用經典圖像先驗模型包括:自回歸模型[14]、高斯馬爾可夫隨機場模型[15]、圖割模型[16]、全變分模型[17]、空間海森特征模型[18]等。近年來,稀疏表示理論被廣泛應用于遙感圖像融合領域。文獻[19]首先將壓縮感知與稀疏表示理論用于遙感圖像融合,稀疏性保證了HMS圖像的高質量重構。在此基礎上,研究者相繼提出了諸多基于稀疏表示的遙感圖像融合方法[20-26]。基于模型的融合框架可實現空譜信息的有效融合,大幅度降低空譜失真,但其高計算復雜度制約該類方法的實際應用前景。

在已有分量替換融合方法的基礎上,針對MS圖像與PAN圖像間局部空間差異引起的空譜失真問題,本文提出了一種改進空間細節提取策略的分量替換融合方法。與傳統空間細節提取方案不同,該方法利用基于局部線性嵌入的圖像重建方法和小波融合方法分別生成兩幅高分辨率強度圖像,然后利用稀疏融合方法對兩幅高分辨率強度圖像進行信息互補,消除MS圖像與PAN圖像因成像機理不同產生的局部空間差異,獲取匹配MS圖像特性的高質量空間細節圖像。相比前面介紹的三類方法,本文算法在避免光譜失真的同時,生成空間結構特征更加清晰的融合圖像。本文算法在客觀評價指標上也優于對比算法。

1 分量替換融合框架通用模型

分量替換融合框架是遙感圖像融合的典型方法,在現實生活中得到廣泛應用,其核心思想是特征空間變換與主分量替換。分量替換融合框架的主要實現步驟[11]如下:

1)對LMS圖像進行插值,使其與PAN圖像尺寸相同。

2)將上采樣LMS圖像變換到指定特征空間,其主要分量定義為 IR,如式 (1)所示:

其中:MSRn 表示上采樣LMS圖像的第n個譜段;Cn 表示變換后的第n個分量;c表示前向變換矩陣。

3)對PAN圖像進行直方圖匹配,然后用其替換式 (1) 中的主要分量IR。

4)利用式(2)實現逆變換,獲得HMS圖像:

其中:PH表示直方圖匹配后的PAN圖像;MSHn表示HMS圖像的第n個譜段;g表示逆變換矩陣。

上述內容表明實現分量替換融合方法的關鍵步驟為特征空間變換與主分量替換。然而,兩次矩陣變換會使分量替換融合方法產生較高計算復雜度。文獻[11]研究發現,典型分量替換融合框架經過式 (3) 演化,可形成通用模型,如式 (4) 所示。

其中:gn表示第n個波段的調制系數;δ表示從PAN圖像中提取的空間細節圖像。從分量替換融合框架通用模型可以看出,融合圖像的質量依賴于形成空間細節圖像δ的譜權重系數cn與調制系數gn。

2 改進空間細節提取策略的分量替換融合

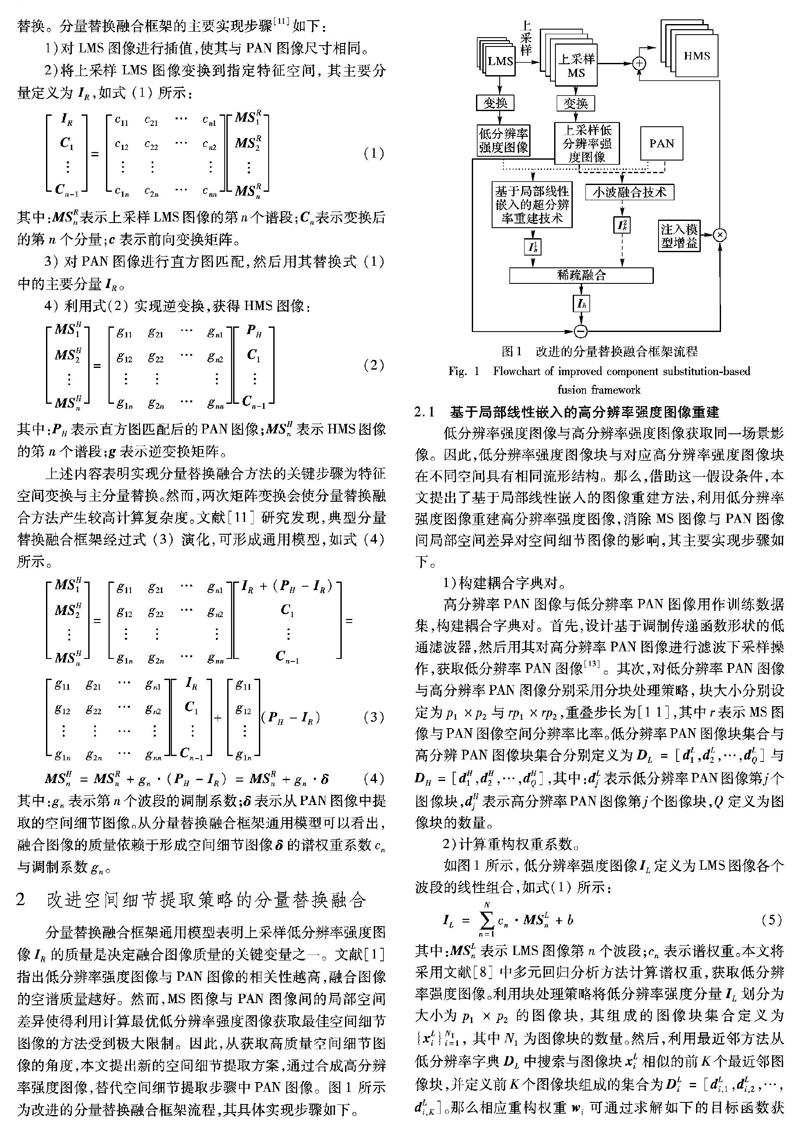

分量替換融合框架通用模型表明上采樣低分辨率強度圖像IR的質量是決定融合圖像質量的關鍵變量之一。文獻[1]指出低分辨率強度圖像與PAN圖像的相關性越高,融合圖像的空譜質量越好。然而,MS圖像與PAN圖像間的局部空間差異使得利用計算最優低分辨率強度圖像獲取最佳空間細節圖像的方法受到極大限制。因此,從獲取高質量空間細節圖像的角度,本文提出新的空間細節提取方案,通過合成高分辨率強度圖像,替代空間細節提取步驟中PAN圖像。圖1 所示為改進的分量替換融合框架流程,其具體實現步驟如下。

2.1 基于局部線性嵌入的高分辨率強度圖像重建

低分辨率強度圖像與高分辨率強度圖像獲取同一場景影像。因此,低分辨率強度圖像塊與對應高分辨率強度圖像塊在不同空間具有相同流形結構。那么,借助這一假設條件,本文提出了基于局部線性嵌入的圖像重建方法,利用低分辨率強度圖像重建高分辨率強度圖像,消除MS圖像與PAN圖像間局部空間差異對空間細節圖像的影響,其主要實現步驟如下。

1)構建耦合字典對。

高分辨率PAN圖像與低分辨率PAN圖像用作訓練數據集,構建耦合字典對。首先,設計基于調制傳遞函數形狀的低通濾波器,然后用其對高分辨率PAN圖像進行濾波下采樣操作,獲取低分辨率PAN圖像[13]。其次,對低分辨率PAN圖像與高分辨率PAN圖像分別采用分塊處理策略,塊大小分別設定為p1×p2與rp1×rp2,重疊步長為[1 1],其中r表示MS圖像與PAN圖像空間分辨率比率。低分辨率PAN圖像塊集合與高分辨PAN圖像塊集合分別定義為DL=[dL1,dL2,…,dLQ]與DH=[dH1,dH2,…,dHQ],其中:dLj表示低分辨率PAN圖像第j個圖像塊,dHj表示高分辨率PAN圖像第j個圖像塊,Q 定義為圖像塊的數量。

2)計算重構權重系數。

如圖1 所示,低分辨率強度圖像IL定義為LMS圖像各個波段的線性組合,如式(1)所示:

IL=∑Nn=1cn·MSLn+b(5)

其中:MSLn表示LMS圖像第n個波段;cn表示譜權重。本文將采用文獻[8]中多元回歸分析方法計算譜權重,獲取低分辨率強度圖像。利用塊處理策略將低分辨率強度分量IL劃分為大小為p1×p2的圖像塊,其組成的圖像塊集合定義為{xLi}N1i=1, 其中N1為圖像塊的數量。然后,利用最近鄰方法從低分辨率字典DL中搜索與圖像塊xLi相似的前K個最近鄰圖像塊,并定義前K個圖像塊組成的集合為DLi=[dLi,1,dLi,2,…,dLi,K]。那么相應重構權重wi可通過求解如下的目標函數獲取[27]:

其中:Ui是第i個圖像塊的局部格拉姆矩陣;1表示全1的向量。

3)重構高分辨率強度圖像I1h。

根據前文假定條件,低分辨率圖像塊與高分辨率圖像塊間存在流形結構一致,那么與xLi對應的高分辨率圖像塊xHi可通過如下計算式進行重構:

xHi=∑Kk=1i,kdHi,k(9)

其中,DHi=[dHi,1,dHi,2,…,dHi,K]表示圖像塊xHi在高分辨率字典DH中尋到的前K個最近鄰圖像塊。然后,將圖像塊重疊區域平均處理后可重構高分辨率強度圖像I1h。

2.2 合成高分辨率強度分量I2h

上述方法合成高分辨率強度分量I1h,利用了低分辨率圖像塊與高分辨率圖像塊間的隱性關系,同時利用了強度圖像與PAN圖像的結構相似性。然而,該方法合成的高分辨率強度圖像局部區域存在空間細節模糊,會影響空間細節圖像的質量,進而影響融合圖像的效果。為此,本節利用小波變換方法生成高分辨率強度分量I2h,然后再通過局部融合的方式來獲取質量更高的強度圖像[28],其具體實現步驟如下:

1)小波分解。

利用Matlab函數多層二維小波變換wavedec2對上采樣強度圖像IR與直方圖匹配后的PAN圖像進行分解,其分解層級設定為3層。定義cA1與aA1分別表示強度圖像與PAN圖像的低頻分量,且cD1、cD2、cD3與aD1、aD2、aD3分別表示兩幅圖像的高頻分量。

2)系數替換。

強度圖像的低頻分量包含著多光譜圖像的絕大部分光譜信息,因此需要保留下來。PAN圖像的空間細節信息要比強度圖像的空間細節信息清晰,為了提升強度圖像的空間分辨率,PAN圖像的高頻細節信息被完整保留。因此,本文用PAN圖像的高頻細節系數替換強度圖像的高頻細節系數。

3)小波逆變換。

對保留下來的cA1、aD1、aD2、aD3等分量進行小波逆變換后,可獲得高分辨率強度圖像I2h。

研究發現,通過小波變換方法獲取的高分辨率強度圖像在局部區域同樣存在空間細節丟失的問題。

2.3 稀疏融合策略

為了改進高分辨率強度圖像局部區域質量,本節提出稀疏融合策略,從局部區域實現兩幅高分辨率強度圖像的信息互補。稀疏融合的流程如圖2所示,具體實現步驟如下:

1)采用塊處理策略,首先將高分辨率強度圖像I1h與I2h分別按照塊大小q1×q2進行分塊處理,并定義圖像塊集合{vs1}Ss=1與{vs2}Ss=1,其中S表示圖像塊數量。

其中:αs1 與αs2分別表示第s個圖像塊的稀疏系數;ε為重構誤差;D 表示字典矩陣,其基原子由離散余弦變換、小波“db1”、Gabor與脊波變換的基構成[29]。該字典綜合了四種多尺度幾何字典的優點,能夠有效地表征紋理、細節與線條等幾何結構。

3)稀疏系數表征圖像塊的主要結構特征,為了互補局部區域的信息,本文采用如下融合規則:

αsf=αs1, ‖αs1‖2≥‖αs2‖2

αs2,‖αs1‖2<‖αs2‖2 (12)

其中αsf表示第s個融合圖像塊的稀疏系數。該融合規則選擇具有最大能量值的稀疏系數作為融合系數。融合圖像塊vsf可通過如下方式求得:vsf=Dαsf。對圖像塊重疊區域求平均后可實現高分辨率強度圖像Ih重構。

經過上述步驟后,獲取了高分辨率強度圖像Ih。在式(4)中,利用強度圖像Ih替換PAN圖像PH,可得到新的空間細節圖像δ1=Ih-IR。將空間細節圖像δ1應用于分量替換融合框架后,可獲得融合圖像。

3 實驗與結果分析

3.1 實驗數據與評價方法

本文采用GeoEye-1遙感數據來驗證算法有效性。該遙感數據呈現澳大利亞霍巴特地區的場景,包含城區、郊區、山脈、森林、河流等地物景象,其可提供2m空間分辨率的MS圖像與0.5m空間分辨率的PAN圖像。MS圖像包含藍色(Blue, B)、綠(Green, G)、紅(Red, R)與近紅外(Near InfRared, NIR)四個波段。

視覺分析與量化評估是遙感圖像質量評價的兩種主要方式。視覺分析屬于主觀評價策略,主要依賴人類視覺系統對圖像質量的感知。人類視覺系統對圖像的結構特征,例如輪廓、線條、紋理、邊緣細節等,更加敏感;同時,對圖像中的模糊、振鈴、光暈等效應也可清晰判別。然而,單純依賴視覺分析并不可靠,因此采用五種經典量化評價方法來客觀評估融合算法性能。五種評價方法分別是相關系數(Correlation Coefficient, CC)、均方根誤差(Root Mean Squared Error, RMSE)、相對整體維數合成誤差(Erreur Relative Global Adimensionnelle de Synthese, ERGAS)、波譜角匹配指數(Spectral Angle Mapper, SAM) 與基于四元數理論的指標(Quaternion theory-based Quality index, Q4)[30]。CC描述參考圖像與融合圖像的相關性,RMSE測量參考圖像與融合圖像的誤差大小,ERGAS測量融合圖像的空間失真,SAM測量融合圖像的光譜失真,Q4測量融合圖像空間與光譜整體質量。五種評價指標的理想值依次為1、0、0、0、1。CC與Q4的數值結果越接近1,表明融合圖像的質量越好。RMSE、ERGAS與SAM的數值結果越接近0,表明融合圖像的質量越好。五種客觀評價指標均需要參考圖像,但真實遙感數據并不提供參考圖像,因此,本文利用仿真數據驗證算法性能。首先,將2m空間分辨率的MS圖像與0.5m空間分辨率的PAN圖像進行降質,獲得8m空間分辨率MS圖像與2m空間分辨率的PAN圖像,并將其作為測試數據。以原始2m空間分辨率的MS圖像作為參考圖像。

3.2 參數設置

本文算法中,譜權重系數通過多元回歸分析方法獲取,具體步驟參考文獻[8]。構建高分辨率強度圖像I1h時圖像塊大小設定為5×5,參數K的值設定為20。構建高分辨率強度圖像I2h時,利用小波“sym8”實現圖像分解。在稀疏融合步驟中,重構誤差ε設定為0.01,注入模型增益系數設定為1。

稀疏融合過程中圖像塊大小對算法性能產生很大影響。本實驗在固定上述參數的情況下,探討了當圖像塊大小分別為5×5、7×7、9×9、11×11和13×13時,本文算法性能的變化過程。實驗在第一組GeoEye-1遙感數據上進行。本文算法融合結果隨著圖像塊大小變化的客觀評價指標性能曲線如圖3 所示,其中,縱坐標為歸一化后的CC、RMSE、ERGAS、SAM與Q4量化評價指標數值結果與算法運行時間。由圖3可知,當圖像塊大小為7×7時,本文算法給出了最大Q4數值結果和最小RMSE、ERGAS與SAM數值結果。本文算法在圖像塊大小為7×7時給出的CC數值結果相較圖像塊大小為9×9、11×11、13×13時都要低。圖3中還給出了本文算法的運行時間隨著圖像塊大小的變化情況。分析可知,隨著圖像塊逐漸變大,本文算法的運行時間越來越多。綜合考量客觀評價指標數值結果與算法的運行時間,在圖像塊大小設定為7×7時,本文算法的性能最優。因此,在下面的實驗中,稀疏融合步驟中圖像塊大小設定為7×7。

3.3 不同高分辨率強度圖像下融合結果分析

本節討論與分析三幅高分辨率強度圖像I1h、I2h與Ih分別用于分量替換融合框架后獲得融合圖像的質量,如圖4所示。圖4 (a)~(c) 分別為由三幅高分辨率強度圖像獲得的空間細節圖像。圖4(a)與圖4(b)相比較可以發現:(a)中大矩形框標定區域細節信息不如(b)中大矩形框標定區域細節信息清晰;相反,(a)中小矩形框標定區域要比(b)中小矩形框標定區域的細節信息更加豐富。圖4(c)所示為稀疏融合后的高分辨率強度圖像生成的空間細節圖像,與圖4(a)與圖4(b)相比,該圖局部區域細節信息更加清晰。

圖4(d)~(f)對應于三幅高分辨率強度圖像的融合結果。圖4(f)的空間細節信息明顯比圖4(d)與圖4(e)的空間細節信息保留得更加完整。因此,通過稀疏融合策略將I1h與I2h的互補信息進行整合,可有效提升融合圖像的質量,減少局部差異引起的空譜失真。

3.4 比較結果分析

為驗證本文算法的融合性能,實驗采用11種不同類型融合算法作為對比算法。這11種算法涵蓋了遙感圖像融合技術三大類算法且具有代表性。其中,分量替換融合算法有:GIHS[6]、自適應GIHS(GIHS Adaptive, GIHSA)[8]、自適應GS(GS Adaptive, GSA)[8]、自適應IHS(Adaptive IHS, AIHS)[12]、改進的AIHS(Improved AIHS, IAIHS)[5]與基于部分置換的自適應分量替換(Partial Replacement-based Adaptive Component Substitution, PRACS)方法[11]。基于多分辨率分析的融合算法有:基于局部參數估計的波段相關空間細節(Band-Dependent Spatial-Detail with local parameter estimation, BDSD)方法[31]、基于調制傳遞函數匹配濾波器與高通調制注入模型的廣義拉普拉斯金字塔(GLP with MTF-matched filter and High-Pass Modulation injection model, MTF-GLP-HPM)方法 [13]、 加性小波亮度比例(Additive Wavelet Luminance Proportion, AWLP) 方法[32]、基于支撐值變換(Support Value Transformation, SVT)的融合方法 [33]。基于稀疏表示的融合方法有塊向量歸一化的兩步稀疏編碼方法(Two Step Sparse Coding method with Patch Normalization, PN-TSSC) [34]。本文所有對比融合方法的參數設定參考相應文獻。

第一組仿真數據、參考圖像與不同融合算法的融合結果如圖5 所示。圖5中,(a)與(b)分別表示8m空間分辨率的MS圖像與2m空間分辨率的PAN圖像;(c)所示為2m空間分辨率的參考HMS圖像;(d)所示為GIHS方法的融合結果,它具備清晰空間分辨率,但局部區域存在光譜失真,綠色植被區域顏色失真最明顯。GIHSA與GSA方法的融合結果如圖5(e)與(f)所示,與GIHS方法的融合圖像相比,這兩幅融合圖像顯示出更好的顏色特征與空間質量。圖5(g)~(j)所示為AIHS、IAIHS、PRACS與BDSD的融合結果。AIHS融合圖像空間分辨率明顯增強,細節信息清晰,光譜特征保留完整。IAIHS與PRACS方法的融合圖像呈現模糊效果。BDSD方法融合圖像的空間細節過銳化,且與參考圖像相比,局部區域呈現非自然色彩。圖5(k)~(m)所示為MTF-GLP-HPM、AWLP與SVT方法的融合結果。三幅圖像具有清晰空間分辨率且光譜失真度較小,色彩自然。圖5(n)所示為PN-TSSC的融合結果,其光譜特征與參考圖像光譜特征相匹配,空間與光譜質量較好。本文算法融合結果如圖5(o)所示,相較于參考圖像與其他對比算法的融合圖像,該圖像的空間細節清晰,光譜特征自然,具備更好的空間與光譜質量。表1給出了圖5融合圖像的客觀評價指標數值結果,其中:最佳數值結果標記為粗體,次最佳結果用下劃線標記。從表1中可以看出,本文算法提供了最佳CC數值結果,且GIHSA給出了次最佳結果。關于RMSE與ERGAS,本文算法給出了最佳值,而PRACS方法給出了次最佳值。本文算法在RMSE與ERGAS指標上要明顯優于其他融合方法。關于評價指標SAM,最佳數值結果由MTF-GLP-HPM方法給出,而次最佳數值結果由PRACS方法給出。本文算法在SAM指標上要比MTF-GLP-HPM、PRACS與SVT方法略差。本文算法給出了最佳Q4數值結果,而SVT方法給出了次最佳Q4數值結果。

第二組GeoEye-1衛星源數據、參考圖像與不同算法下的融合圖像如圖6所示。圖6中,(a)與(b)分別表示8m空間分辨率的MS圖像與2m空間分辨率的PAN圖像;(c)所示為2m空間分辨率的參考HMS圖像。圖6(d)~(n)所示依次為11種比較算法的融合結果;(o)所示為本文算法的融合圖像。與參考圖像相比,GIHS、GIHSA、GSA、AIHS、BDSD、MTF-GLP-HPM、SVT與PN-TSSC等方法融合圖像的空間細節信息清晰,空間質量良好。IAIHS、PRACS與AWLP方法融合圖像的空間細節信息不夠清晰,呈現模糊效果。GIHS、GIHSA、BDSD與SVT方法的融合結果具有明顯光譜失真,尤其是在綠色植被區域。而GSA、AIHS、IAIHS、PRACS、MTF-GLP-HPM與PN-TSSC方法的融合結果具有良好的光譜質量。與參考圖像與其他比較算法的融合圖像相比,本文算法融合圖像的空間結構特征表現良好,具有較好的顏色特征信息。表2給出了圖6融合圖像的客觀評價指標數值結果,其中:最佳數值結果標記為粗體,次最佳結果用下劃線標記。從表2中可以看出,本文算法提供了最佳的CC、RMSE、ERGAS、SAM與Q4數值結果。GIHSA方法給出了次最佳CC數值結果,PRACS方法給出了次最佳RMSE與ERGAS數值結果,MTF-GLP-HPM方法給出了次最佳SAM數值結果,SVT方法給出了次最佳Q4數值結果。

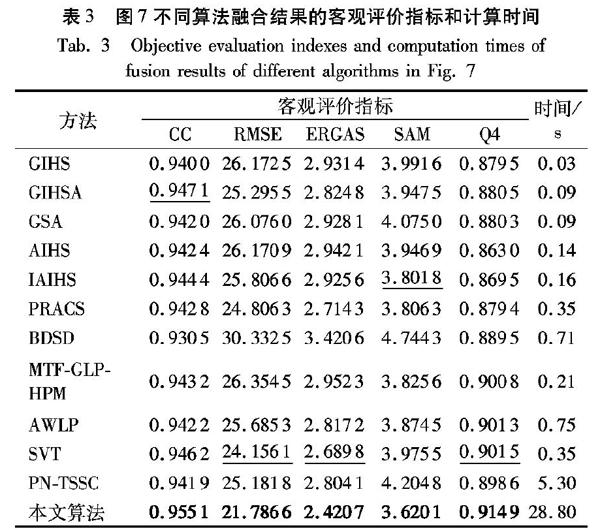

第三組GeoEye-1衛星源數據、參考圖像與不同算法下的融合圖像如圖7所示。圖7中,(a)~(c)分別表示8m空間分辨率的MS圖像、2m空間分辨率的全色圖像與2m空間分辨率的參考HMS圖像;(d)~(o)所示依次為11種比較算法的融合圖像與本文算法的融合圖像。與參考圖像相比,GIHS方法的融合圖像因細節信息過度注入導致過銳化現象,出現光譜失真。GIHSA、GSA、BDSD、MTF-GLP-HPM、SVT與PN-TSSC方法的融合圖像呈現良好的空間與光譜質量。AIHS、IAIHS、PRACS與AWLP的融合圖像光譜失真較小,但呈現出全局模糊,空間細節信息不清晰。本文算法的融合圖像空間細節信息豐富,結構清晰,光譜特征良好。表3 給出了圖7 融合圖像的客觀評價指標數值結果,其中:最佳數值結果標記為粗體,次最佳數值結果用下劃線標記。從表3中可以看出,本文算法給出了最佳的CC、RMSE、ERGAS、SAM與Q4數值結果。GIHSA給出了次最佳CC數值結果,IAIHS給出了次最佳SAM數值結果,SVT給出了次最佳RMSE、ERGAS與Q4數值結果。

綜合以上三組衛星遙感數據融合圖像的主客觀評價結果,本文算法的融合性能相較11種對比方法更優。

表1~3中同時給出了本文算法與對比算法的計算時間。從表1~3中可看出,絕大部分融合方法的計算時間要小于1s。這些方法都隸屬于分量替換融合框架與多分辨率分析融合框架,且絕大部分分量替換融合算法的計算復雜度要低于多分辨率分析融合方法的計算復雜度。PN-TSSC方法與本文算法的計算時間均大于1s,且本文算法的計算時間最長。研究發現,本文算法的時間損耗主要集中在稀疏融合步驟,實現該步驟采用塊處理策略,大量圖像塊的稀疏分解過程導致本文方法計算復雜度高。該問題可通過多核處理器并行處理來解決。

4 結語

本文針對多光譜圖像與全色圖像間局部空間差異引起的空譜失真問題,提出了一種改進空間細節提取方法的分量替換融合框架。首先,利用局部線性嵌入超分辨率重建技術與小波融合技術分別重構兩幅高分辨率強度圖像;然后,利用稀疏融合策略實現兩幅高分辨率強度圖像信息互補,獲取一幅更高質量的強度圖像,進而獲得高質量空間細節圖像;最后,將高質量空間細節圖像應用到分量替換融合框架中,獲得所需要的HMS圖像。在GeoEye-1遙感數據上進行了測試,實驗結果表明本文算法的融合圖像主觀上相較其他算法的融合圖像具有更好的空間與光譜質量,而且客觀上各項評價相較其他算法綜合來看也是最優的。這表明本文算法能夠有效地消除多光譜圖像與全色圖像局部空間差異的影響,進一步提高分量替換融合框架的性能。

稀疏融合步驟的高計算復雜度是導致本文算法的運行時間比傳統分量替換方法和多分辨率分析方法長的主要原因。在接下來的研究工作中,我們將嘗試利用多核處理器實現算法的并行運算,降低本文算法的運行時間。本文算法僅考慮通過改進空間細節提取策略來提升分量替換融合方法的性能,下一步我們將研究空間細節注入模型,進一步提升分量替換融合方法的性能。

參考文獻 (References)

[1]THOMAS C, RANCHIN T, WALD L, et al. Synthesis of multispectral images to high spatial resolution: a critical review of fusion methods based on remote sensing physics [J]. IEEE Transactions on Geoscience and Remote Sensing, 2008, 46 (5): 1301-1312.

[2]LI S, KANG X, FANG L, et al. Pixel-level image fusion: a survey of the state of the art [J]. Information Fusion, 2017, 33: 100-112.

[3]吳宗駿,吳煒,楊曉敏,等.改進的基于稀疏表示的全色銳化算法[J].計算機應用,2019,39(2):540-545.(WU Z J, WU W, YANG X M, et al. Improved panchromatic sharpening algorithm based on sparse representation [J]. Journal of Computer Applications, 2019, 39(2): 540-545.)

[4]LONCAN L, DE ALMEIDA L B, BIOUCAS-DIAS J M, et al. Hyperspectral pansharpening: a review [J]. IEEE Geoscience and Remote Sensing Magazine, 2015, 3(3): 27-46.

[5]LEUNG Y, LIU J, ZHANG J. An improved adaptive intensity-hue-saturation method for the fusion of remote sensing images [J]. IEEE Geoscience and Remote Sensing Letters, 2014, 11(5): 985-989.

[6]TU T, HUANG P, HUNG C, et al. A fast intensity-hue-saturation fusion technique with spectral adjustment for IKONOS imagery [J]. IEEE Geoscience and Remote Sensing Letters, 2004, 1(4): 309-312.

[7]CHOI M. A new intensity-hue-saturation fusion approach to image fusion with a tradeoff parameter [J]. IEEE Transactions on Geoscience and Remote Sensing, 2006, 44(6): 1672-1682.

[8]AIAZZI B, BARONTI S, SELVA M. Improving component substitution pansharpening through multivariate regression of MS+Pan data [J]. IEEE Transactions on Geoscience and Remote Sensing, 2007, 45(10): 3230-3239.

[9]WANG W, JIAO L, YANG S. Novel adaptive component-substitution-based pan-sharpening using particle swarm optimization [J]. IEEE Geoscience and Remote Sensing Letters, 2015, 12(4): 781-785.

[10]GHANREMANI M, GHASSEMIAN H. Nonlinear IHS: a promising method for pan-sharpening [J]. IEEE Geoscience and Remote Sensing Letters, 2016, 13(11): 1606 -1610.

[11]CHOI J, YU K, KIM Y. A new adaptive component-substitution-based satellite image fusion by using partial replacement [J]. IEEE Transactions on Geoscience and Remote Sensing, 2011, 49(1): 295-309.

[12]RAHMANI S, STRAIT M, MERKURJEV D, et al. An adaptive IHS pan-sharpening method [J]. IEEE Geoscience and Remote Sensing Letters, 2010, 7(4): 746-750.

[13]VIVONE G, ALPARONE L, CHANUSSOT J, et al. A critical comparison among pansharpening algorithms [J]. IEEE Transactions on Geoscience and Remote Sensing, 2015, 53(5): 2565-2586.

[14]JOSHI M V, BRUZZONE L, CHAUDHURI S. A model-based approach to multiresolution fusion in remotely sensed images [J]. IEEE Transactions on Geoscience and Remote Sensing, 2006, 44(9): 2549-2562.

[15]UPLA K P, JOSHI M V, GAJJAR P P. An edge preserving multiresolution fusion: use of contourlet transform and MRF prior [J]. IEEE Transactions on Geoscience and Remote Sensing, 2015, 53(6): 3210-3220.

[16]HARIKUMAR V, GAJJAR P P, JOSHI M V, et al. Multiresolution image fusion: use of compressive sensing and graph cuts [J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2014, 7(5): 1771-1780.

[17]PALSSON F, SVEINSSON J R, ULFARSSON M O. A new pansharpening algorithm based on total variation [J]. IEEE Geoscience and Remote Sensing Letters, 2013, 11(1): 318-322.

[18]LIU P, XIAO L, ZHANG J, et al. Spatial-Hessian-feature-guided variational model for pan-sharpening [J]. IEEE Transactions on Geoscience and Remote Sensing, 2015, 54(4): 2235-2253.

[19]LI S, YANG B. A new pan-sharpening method using a compressed sensing technique [J]. IEEE Transactions on Geoscience and Remote Sensing, 2011, 49(2): 738-746.

[20]LI S, YIN H, FANG L. Remote sensing image fusion via sparse representations over learned dictionaries [J]. IEEE Transactions on Geoscience and Remote Sensing, 2013, 51(9): 4779-4789.

[21]WANG W, JIAO L, YANG S. Fusion of multispectral and panchromatic images via sparse representation and local autoregressive model [J]. Information Fusion, 2014, 20: 73-87.

[22]WANG W, JIAO L, YANG S, et al. Distributed compressed sensing-based pan-sharpening with hybrid dictionary [J]. Neurocomputing, 2015, 155: 320-333.

[23]ZHU X X, BAMLER R. A sparse image fusion algorithm with application to pan-sharpening [J]. IEEE Transactions on Geoscience and Remote Sensing, 2013, 51(5): 2827-2836.

[24]HAN C, ZHANG H, GAO C, et al. A remote sensing image fusion method based on the analysis sparse model [J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2016, 9(1): 439-453.

[25]ZHU X, GROHNFELDT C, BAMLER R. Exploiting joint sparsity for pansharpening: the J-SparseFI algorithm [J]. IEEE Transactions on Geoscience and Remote Sensing, 2016, 54(5): 2664-2681.

[26]JIANG C, ZHANG H, SHEN H, et al. Two-step sparse coding for the pan-sharpening of remote sensing images [J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2014, 7(5): 1792-1805.

[27]ROWEIS S T, SAUL L K. Nonlinear dimensionality reduction by locally linear embedding [J]. Science, 2000, 290(5500): 2323-2326.

[28]ZHANG Y, HONG G. An IHS and wavelet integrated approach to improve pan-sharpening visual quality of natural colour IKONOS and QuickBird images [J]. Information Fusion, 2005, 6(3): 225-234.

[29]YANG B, LI S. Pixel-level image fusion with simultaneous orthogonal matching pursuit [J]. Information Fusion, 2012, 13(1): 10-19.

[30]PALSSON F, SVEINSSON J R, ULFARSSON M O, et al. Quantitative quality evaluation of pansharpened imagery: consistency versus synthesis [J]. IEEE Transactions on Geoscience and Remote Sensing, 2015, 54(3): 1247-1259.

[31]GARZELLI A, NENCINI F, CAPOBIANCO L. Optimal MMSE pan sharpening of very high resolution multispectral images [J]. IEEE Transactions on Geoscience and Remote Sensing, 2008, 46(1): 228-236.

[32]NUNEZ J, OTAZU X, FORS O, et al. Multiresolution-based image fusion with additive wavelet decomposition [J]. IEEE Transactions on Geoscience and Remote Sensing, 1999, 37(3): 1204-1211.

[33]ZHENG S, SHI W, LIU J, et al. Remote sensing image fusion using multiscale mapped LS-SVM [J]. IEEE Transactions on Geoscience and Remote Sensing, 2008, 46(5): 1313-1322.

[34]JIANG C, ZHANG H, SHEN H, et al. Two-step sparse coding for the pan-sharpening of remote sensing images [J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2014, 7(5): 1792-1805.

This work is partially supported by the National Natural Science Foundation of China (61703334), the China Postdoctoral Science Foundation (2016M602942XB), the Natural Science Basic Research Plan of Shaanxi Province (2017JQ6050), the Key Research and Development Program of Shaanxi Province (2018ZDXM-GY-089).

WANG Wenqing, born in 1986, Ph. D., lecturer. His research interests include remote sensing image processing and interpretation, intelligent information processing, machine learning.

LIU Han, born in 1972, Ph. D., professor. His research interests include modeling and control of complex industrial process, machine learning, artificial intelligence, intelligent information processing.

XIE Guo, born in 1982, Ph. D., professor. His research interests include intelligent information processing, intelligent rail transit, data analysis, fault diagnosis.

LIU Wei, born in 1982, Ph. D., lecturer. His research interests include computer vision.

收稿日期:2019-06-24;修回日期:2019-09-11;錄用日期:2019-09-25。基金項目:國家自然科學基金資助項目(61703334);中國博士后科學基金資助項目(2016M602942XB);陜西省自然科學基礎研究計劃項目(2017JQ6050);陜西省重點研發計劃項目(2018ZDXM-GY-089)。

作者簡介:王文卿(1986—),男,山東萊蕪人,講師,博士,CCF會員(No.76518M),主要研究方向:遙感影像處理與解譯、智能信息處理、機器學習;劉涵(1972—),男,陜西西安人,教授,博士,主要研究方向:復雜工業過程建模與控制、機器學習、人工智能、智能信息處理; 謝國(1982—),男,湖北當陽人,教授,博士,主要研究方向:智能信息處理、智能軌道交通、數據分析、故障診斷; 劉偉(1982—),男,陜西漢中人,講師,博士,主要研究方向:計算機視覺。

文章編號:1001-9081(2019)12-3650-09 DOI:10.11772/j.issn.1001-9081.2019061063