基于局部相位量化與多通道顏色的魯棒人臉識別*

張妍琰, 段 娜

(河南城建學院計算機科學與工程學院,河南 平頂山 467036)

基于局部相位量化與多通道顏色的魯棒人臉識別*

張妍琰, 段 娜

(河南城建學院計算機科學與工程學院,河南 平頂山 467036)

針對非可控條件下的人臉識別問題,提出了一種新的融合多顏色通道的局部相位量化方法。首先,在不同顏色空間的各顏色通道圖像上計算局部相位量化響應圖,然后對每幅響應圖分塊計算統計直方圖,最后將特定顏色通道的相似度進行融合。該方法充分利用了圖像不同顏色通道間的互補特性。實驗結果表明,該方法實用性好,魯棒性強,在大規模非可控人臉數據庫上取得了較好的結果。

人臉識別;局部相位量化;顏色空間

人臉識別研究試圖賦予計算機根據面孔辨別人物身份的能力。該研究具有重要的科學意義和巨大的應用價值。目前主流的特征描述子有Gabor描述子[1]、SIFT (Scale-Invariant Feature Transform)描述子[2]、HOG (Histograms of Oriented Gradients)描述子[3]以及局部二值模式描述子[4]。Gabor描述子在計算上只利用了其傅里葉變換后的幅值信息且二維圖像卷積操作計算量極大,不適用于對實時性要求很高的人臉識別系統,而SIFT與HOG描述子表示人臉的能力遠不及表示物體或行人,因而這兩種描述子更多地被應用于物體檢測或行人檢測,局部二值模式描述子雖然計算量較小,但是表示能力有限。在上述描述子的實際使用中,往往只利用圖像的灰度信息[5]而摒棄了信息量豐富的顏色信息。本文提出了一種新的融合多顏色通道的局部相位量化方法。其主要特點包括:(1)利用圖像傅里葉變換后的相位信息提取高效的、具有判別性的人臉特征;(2)充分利用不同的顏色空間;(3)在FRGC人臉數據庫上達到了較好的性能。

1 局部相位量化

局部相位量化(Local Phase Quantization,簡稱LPQ)最早用于圖像的紋理分類問題[6]。它利用傅里葉變換相位的模糊不變性,提高了對模糊圖像識別的魯棒性。該描述子在圖像中每個像素點的鄰域內計算傅里葉變換后的相位信息,并在四組低頻分量上進行量化進而形成直方圖。該方法形式上有些類似局部二值模式[4]。

在數字圖像處理領域,對原始圖像進行空間不變的模糊可以用卷積的形式來表示,用f(x)表示原始圖像,g(x)表示卷積后的圖像,則模糊模型可以表示為

g(x)=(f*h)(x),

式中:h(x)是描述模糊的點擴散方程(PointSpreadFunction,簡稱PSF);*表示空間內的二維卷積操作;x是坐標向量[x,y]T。模糊模型在傅里葉頻域內對應于

G(u)=F(u)·H(u),

式中:G(u)、F(u)和H(u)分別是模糊后圖像g(x)、原始圖像f(x)以及模糊的點擴散方程h(x)的離散傅里葉變換后的結果;u為頻域內的坐標向量[u,v]T。將幅值和相位信息分開,則幅值部分可以表示為

而相位部分可以表示為

angle(G(u))=angle(F(u))+angle(H(u))。

如果假設模糊的點擴散方程(PSF)中h(x)是中心對稱的,即h(x)=h(-x),那么h(x)的傅里葉變換總是實數,并且它的相位部分只是一個二值函數

這就意味著

angle(G(u))=angle (F(u)), for all H(u)≥0。

(1)

在H(u)為正的頻率下,模糊后圖像的相位angle(G(u))對于具有中心對稱性質的模糊具有不變性。在理想的由運動造成的模糊和由失焦造成的模糊情形下,h(x)的剖面圖是矩形[7],這就導致了該剖面圖下的頻譜H(u)是一個同樣包含負值的辛格函數(sincfunction)。在滿足條件的頻率(blurlength/samplingfrequency)下,H(u)的值也總是正的。在點擴散方程(PSF)是高斯的情況下(模擬大氣紊流造成的模糊),H(u)也是一個只有正值的高斯分布,并且總是滿足式1。

在實踐中,由于最終觀察到的模糊后圖像的大小是有限的,所以不可能完全達到模糊不變性。由于對理想圖像用模糊核(PSF)進行卷積后的圖像超出了原始圖像的邊緣,而超出邊緣的那部分信息則丟失了,所以當模糊的寬度相比于圖像大小足夠大時,邊緣信息丟失的現象就會變得非常明顯。

2 用于紋理分類的局部相位量化

2.1 短時傅里葉變換

局部相位量化這個方法是基于傅里葉相位譜對模糊的不變性設計出來的。它對通過二維離散傅里葉變換提取的局部相位信息進行量化,更精確地講,是在圖像f(x)的每一個像素點x周圍M乘M的鄰域x內計算短時傅里葉變換,可以將上述描述定義為:

(2)

式中:Wu是二維離散傅里葉變換在頻率u下的基向量;fx為x區域的所有M2個采樣像素點。從式2可以看出,一個高效的計算短時傅里葉變換的方式就是對所有u進行二維卷積操作f(x)*e-2πjuTx。由于基函數是分開的,所以可以分別對行和列進行一維卷積計算。在局部量化方法中,只考慮4個復數系數,它們對應于二維頻率下的u1=[a,0]T、u2=[0,a]T、u3=[a,a]T和u4=[a,-a]T,其中a是低于滿足式1的H(u)的第一個過零點的標量頻率值,則

其中符號Re{·}和Im{·}分別表示復數值的實部和虛部。對應這4個參數下的8乘M2的轉移矩陣為

W=[Re{wu1,wu2,wu3,wu4},Im{wu1,wu2,wu3,wu4}]T

進而有

Fx=Wfx。

2.2 對系數的統計學分析

因此,轉換系數向量Fx的協方差矩陣為

D=WCWT

當ρ>0時D不是一個對角矩陣,這意味著系數之間存在著相關性,而信息只有在各系數統計獨立的情況下才能最大范圍地被保留,故在真正量化之前,需要對系數進行去相關操作。這里用高斯分布作為假設,獨立性可以通過白化過程獲得,即

Gx=VTFx

其中V是對矩陣D進行奇異值分解(SVD)后的正交矩陣

D=USVT

這里V在已知ρ的情況下可以提前計算獲得。在所有圖像的像素點上計算Gx,x∈{x1,x2,…,xN},最終的結果使用一個簡單的標量量化子進行量化

其中gj是Gx的第j個元素。使用二進制編碼對量化后的系數進行編碼,編碼的結果為十進制整數。最終,可以在任何圖像區域內提取統計直方圖(256維)并用于后續的分類問題

3 跨顏色空間的通道組合

圖1 橙子RGB圖像、NTSC圖像 與YIQ各分量圖像

人臉識別領域中,許多方法只是利用圖像的灰度信息,也有少部分利用了圖像的彩色信息,本文提出了一種新的利用顏色信息的方法,即融合不同顏色空間的不同通道,進而更加高效地描述人臉信息。例如,實驗中既在RGB顏色空間的R、G、B三個通道圖像上進行特征抽取(以本文為例,提取局部相位量化特征),也在YIQ、YCbCr顏色空間的相應通道上進行特征抽取,最后從每個顏色空間中選取性能最好的通道進行相似度級別的融合。

4 實驗

4.1 實驗數據庫一

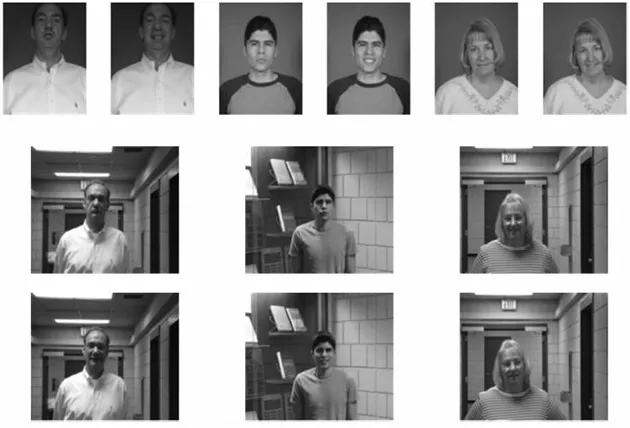

Face Recognition Grand Challenge (簡稱FRGC) 2.0人臉數據庫是一個由美國政府出資贊助并在圣母諾特丹大學采集的大規模人臉數據集。FRGC 2.0人臉數據庫是目前已公開的最大規模的人臉數據庫,包含了在可控與非可控條件下采集的三維掃描圖像和高分辨率的二維圖像,圖像數目超過50 000幅。FRGC 2.0數據分為訓練集和校驗集兩個部分。訓練集是在2002—2003年之間采集的,包括兩部分:一部分是大規模靜態圖像訓練集,包含了222個對象的12 776幅圖像(可控條件下6 388幅圖像與非可控條件下6 388幅圖像);另一部分是三維圖像訓練集,包括三維掃描圖像和來自943個時期的可控與非可控條件下采集的圖像。校驗集是在2003—2004年之間采集的,包含了466個對象、來自4 007個時期的圖像。

FRGC 2.0測試協議中提供了6個實驗:實驗1、2、4是針對二維圖像上識別算法的評測,實驗3、5、6是針對三維圖像上識別算法的評測。在每個實驗中,算法的輸入包括兩個集合:目標集和查詢集。其中,目標集中的圖像身份是已知的,查詢集中的圖像身份是未知的。識別算法的輸出是一個相似度矩陣,該矩陣包含了查詢集與目標集中的所有圖像對。

圖2 FRGC數據集樣例(其中第一行 為目標集,第二行、第三行為查詢集)

4.2 實驗數據庫二

FERET人臉識別數據庫是由美國國防部通過DARPA(Defense Advanced Research Products Agency)資助的FERET計劃構建,用來測試不同識別方法的性能[14]。該人臉識別庫總共包含了14 051幅多姿態的人臉圖像。1998年到2001年間發布的數據包含了3 737幅圖像,也被稱為訓練圖像。該數據庫嚴格劃分了人臉的注冊圖像集合和測試圖像集合。圖3給出了FERET人臉數據庫的部分示例圖像。

4.3 實驗設置

圖3 FERET人臉庫的示例

實驗中使用的局部相位量化描述子窗口半徑為3個像素,每個子塊大小為8×8個像素,在每個子塊提取統計直方圖,并將各子塊直方圖串接起來進行主成分分析(Principal Component Analysis,簡稱PCA)和線性判別分析(Linear Discriminant Analysis,簡稱LDA)。PCA保留的維數依據能量準則(保持95%的能量),LDA降維后的特征維數統一設置為300,其后特征向量之間的距離度量采用向量間的余弦夾角。最后,進行人臉確認實驗時需對計算出來的相似度矩陣按列進行零均值一方差的歸一化操作,進而計算在錯誤接受率為千分之一(FAR=0.1%)情形下的驗證率,人臉識別實驗采用的分類器為最近鄰分類器。

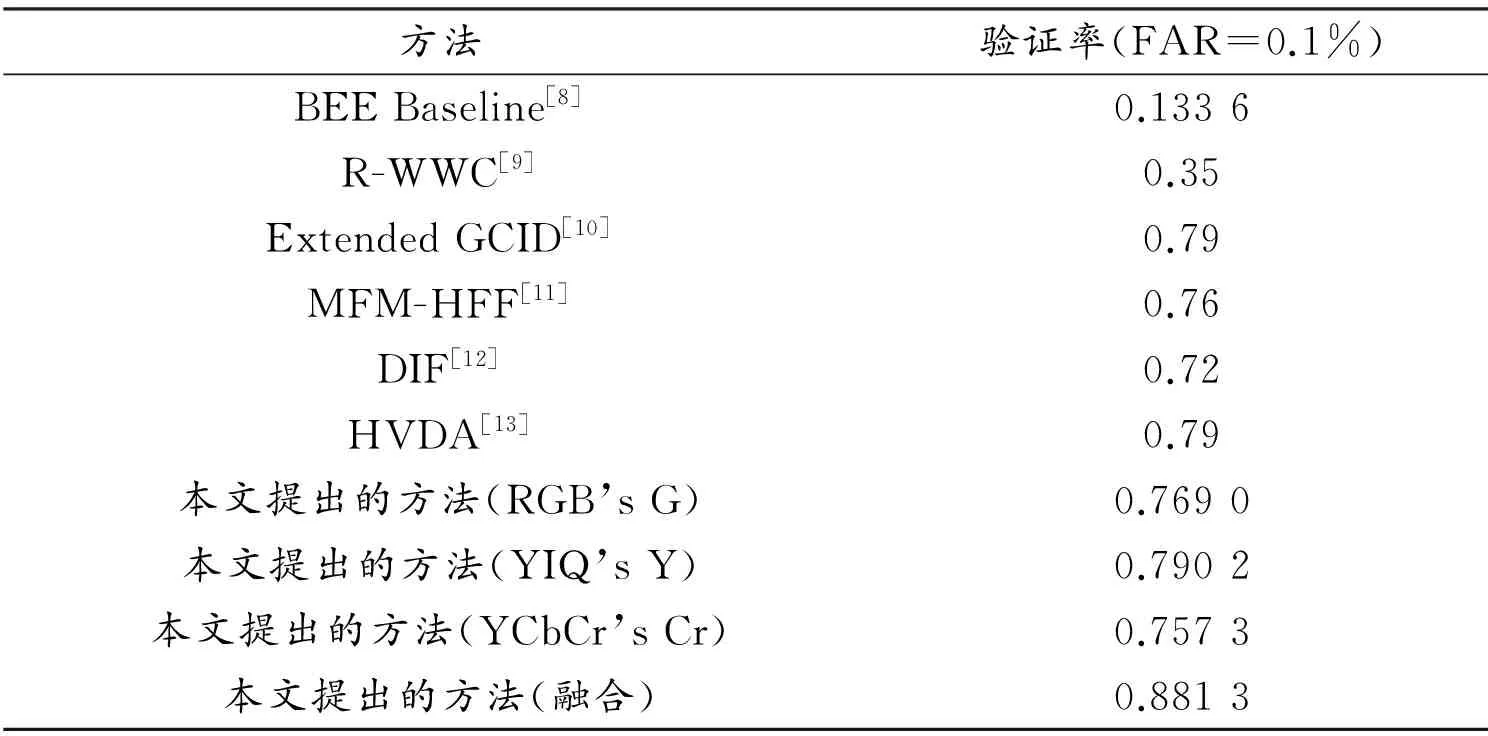

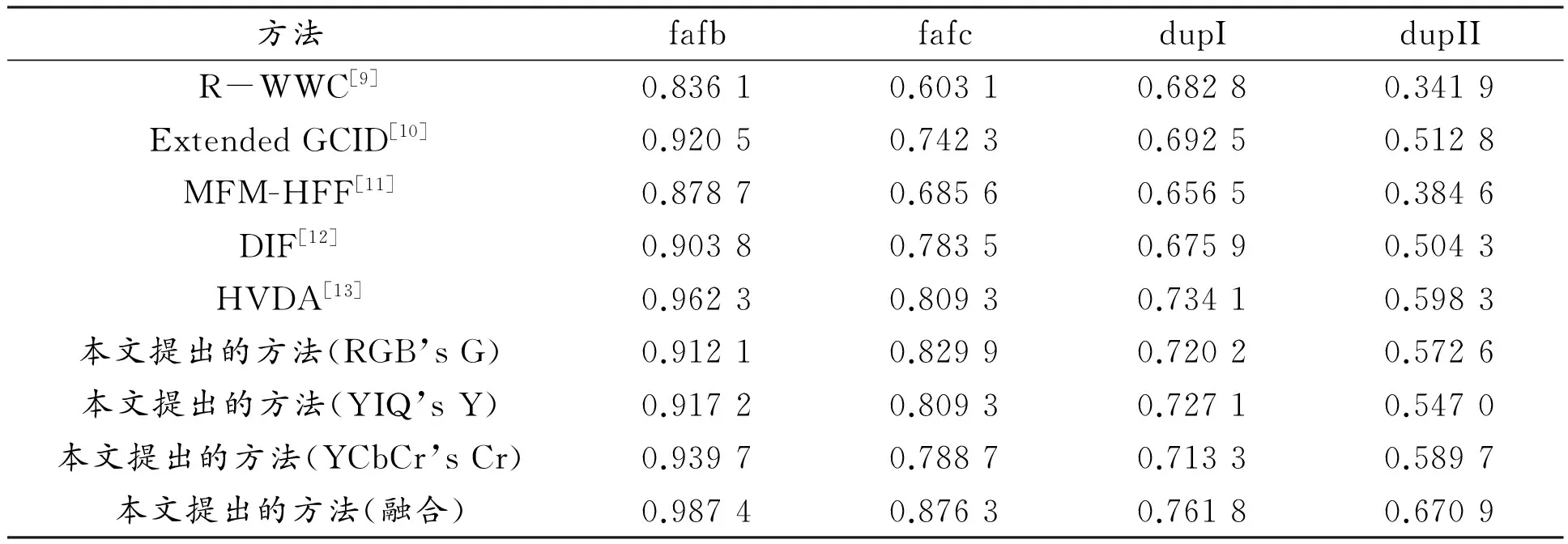

4.4 實驗結果及分析

表1、2列出了FRGC數據庫和FERET數據庫上各個方法的性能匯總,可以看到本文方法達到了目前已知的最好效果。即使只是用單個顏色通道,局部相位量化描述子也可以達到與表1、表2中最佳性能比的效果,一旦融合多個顏色空間性能將進一步提升,這也表明按照本文方法選擇的顏色通道具有很好的互補性能。

表1 FRGC數據庫實驗四方法性能匯總

表2 FERET數據庫方法性能匯總

5 結束語

本文提出了一種基于局部相位量化與跨顏色空間的多通道顏色相結合的魯棒人臉識別算法,該算法充分利用了人臉圖像的顏色信息及傅里葉變換后的相位信息,從而在人臉區域提取了有效的判別性信息,最終在大規模非可控人臉數據庫上達到目前最好的結果。

[1] Liu Chengjun, Wechsler H. Independent component analysis of Gabor features for face recognition[J]. Neural Networks,2003,14(4):919- 928.

[2] Lowe D G. Object recognition from local scale-invariant features: Computer vision[C]// The proceedings of the seventh IEEE international conference, 1999: 1150-1157.

[3] Dalal N, Triggs B. Histograms of oriented gradients for human detection[C]// IEEE Computer Society Conference on Computer Vision and Pattern Recognition.San Diego: USA(IEEE), 2005:886-893.

[4] Ahonen T, Hadid A, Pietikainen M. Face recognition with local binary patterns: Computer Vision[C]//ECCV 2004. Springer Berlin Heidelberg, 2004: 469-481.

[5] Brunelli R, Poggio T. Face recognition: features versus templates[J]. Pattern Analysis and Machine Intelligence, 1993, 15(10):1042-1052.

[6] Ojansivu V, Heikkil J. Blur insensitive texture classification using local phase quantization[C]//Image and Signal Processing.France: Springer Berlin Heidelberg,2008:236-243.

[7] Banham M R, Katsaggelos A K. Digital image restoration[J]. IEEE Signal Processing,1997,14(2): 24-41.

[8] Phillips P, Flynn P, Scruggs T, et al. Overview of the face recognition grand challenge[C]//IEEE Computer Society Conference on Computer Vision and Pattern Recognition.San Diego:IEEE, 2005:947-954.

[9] Liu Chengjun. The bayes decision rule induced similarity measures[J].Pattern Analysis and Machine Intelligence, 2007,29(6):1086-1090.

[10]Yang J, Liu C. Color image discriminant models and algorithms for face recognition[J]. Neural Networks,2008,19(12):2088-2098.

[11]Hwang W, Park G, Lee J, et al. Multiple face model of hybrid fourier feature for large face image set[C]//IEEE Computer Society Conference on Computer Vision and Pattern Recognition. San Diego: IEEE, 2006: 1574-1581.

[12]Liu C. Capitalize on dimensionality increasing techniques for improving face recognition grand challenge performance[J]. Pattern Analysis and Machine Intelligence,2006,28(5):725-737.

[13]Yang J, Liu C. Horizontal and vertical 2dpca-based discriminant analysis for face verification on a large-scale database[J]. Information Forensics and Security,2007,2(4):781-792.

[14]Phillips P J, Moon H, Rizvi S A,et al. The FERET Evaluation Methodology for Face-Recognition Algorithms[C]//IEEE Transactions on Pattern Analysis and Machine Intelligence.USA:IEEE,2000:1090-1104.

Local phase quantization and multi-color channel based robust face recognition

ZHANG Yan-yan, DUAN Na

(1.DepartmentofComputerScienceandEngineering,HenanUniversityofUrbanConstruction,Pingdingshan467036,China)

In order to solve the problems that exist in uncontrolled condition face recognition, a variational method based on fusion of local phase quantization information with multi-color channel was proposed. First,compute the local phase quantization image on every color channel of different color spaces. Then,extract the statistic histograms on the local phase quantization images. And finally, fuse the similarity scores from different color channels. The proposed method utilizes the complementarity of different color channels. The experimental results show that the proposed method has effectiveness and better robustness, and it achieves state-of-the-art performance on large scale uncontrolled condition face database (FRGC).

face recognition; local phase quantization; color space

河南省教育廳科學技術研究重點項目(12A520006)。

2013-10-12

張妍琰(1981-),女,河南平頂山人,碩士,河南城建學院計算機科學與工程學院講師。

1674-7046(2014)01-0067-06

TP391.41

A