基于條件隨機場和斯塔克爾伯格模型的決策系統研究

【摘" 要】文章依托駕駛模擬器平臺,對CarSim、Simulink和VeriStand等軟件進行設置,搭建硬件在環仿真平臺,使用頭部姿態估計網絡算法檢測頭部姿態,采集試驗數據。建立基于條件隨機場的駕駛意圖在線識別系統,對左換道、右換道和車道保持3種駕駛意圖進行識別,與隱馬爾可夫模型對比,證明該系統能夠穩定輸出駕駛員的駕駛意圖。建立基于斯塔克爾伯格博弈模型的人機共駕決策系統,設立仿真試驗場景,驗證基于駕駛意圖識別的人機共駕決策系統的有效性。

【關鍵詞】駕駛模擬器;條件隨機場;駕駛意圖識別;斯塔克爾伯格博弈模型

中圖分類號:U463.6" " 文獻標識碼:A" " 文章編號:1003-8639( 2024 )08-0006-06

Research on Decision-making System Based on Conditional Random Fields and Stackelberg Models

ZHANG Heng,CHEN Huanming,LI Xuehan

(College of Mechanical and Electrical Engineering,Automotive Dynamic Simulation Laboratory,

Qingdao University,Qingdao 266071,China)

【Abstract】Based on the driving simulator platform,this paper establishes a hardware-in-the-loop simulation platform using software such as CarSim,Simulink,and Veristand. The head attitude estimation network algorithm is utilized to detect head attitude and collect experimental data. Furthermore,an online recognition system of driving intention based on conditional random field is developed to accurately identify three driving intentions: left lane change,right lane change,and lane keeping. The effectiveness of the system is demonstrated by comparing it with the hidden Markov model in terms of stable output of driver's driving intention. Additionally,a human-machine co-driving decision-making system based on Stackelberg game model is established and its effectiveness is verified through a simulation experiment scenario.

【Key words】driving simulator;conditional random field;riving intention recognition;Stackelberg game model

1" 前言

高級駕駛輔助系統(ADAS)成為解決因人為因素導致交通事故問題的重要技術,并逐漸成為車輛標配系統。現階段的ADAS仍處于2級駕駛自動化,距離3級駕駛自動化仍有差距。除技術方面的不足外,事故責任的劃分也讓各大廠商對將自動駕駛汽車投放市場舉棋不定,因而未來搭載ADAS系統的汽車仍將在市場中占有較大比例。

目前大部分ADAS系統仍屬于自成一環,其探測、決策乃至部分執行都是不考慮駕駛員意圖的,會導致部分決策偏離駕駛員的想法乃至完全相反。駕駛員作為交通-駕駛員-車輛的中心環節,其駕駛操作應得到重視。通過識別駕駛員的駕駛意圖,能夠讓其成為機器決策的重要參考,降低人機沖突概率,提高機器決策的正確性,減少駕駛員因機器決策導致的不適感。對于駕駛意圖的研究,眾多科研人員提出了許多識別方法。算法方面,長短時記憶網[1]、支持向量機[2]、隱馬爾可夫[3]、貝斯葉網絡[4]、反向傳播神經網絡[5]和條件隨機場[6]等算法在駕駛意圖識別方面效果較好,受到廣泛應用。此前對駕駛員意圖的研究多集中于縱向[7],研究成果較多且實用性高,在此基礎上許多學者開始研究更為復雜的橫向駕駛員意圖。

基于以上問題,本文通過頭部姿態和車輛運動數據,基于條件隨機場算法,研究駕駛員操作意圖,實現駕駛意圖識別,并對自車和其他車輛博弈問題進行研究,建立斯塔克爾伯格模型,決策換道時機,對降低駕駛員工作量、ADAS決策偏離導致的不安感、提高駕駛安全性等都具有重要意義。

2" 試驗數據采集

2.1" 駕駛模擬器

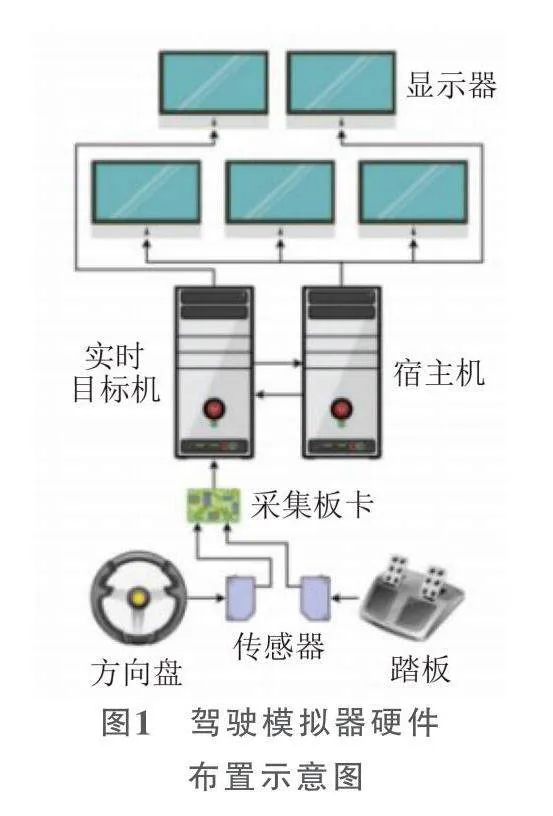

本文需要記錄駕駛員在行車過程中的操作數據為駕駛員的意圖識別提供試驗樣本。駕駛員的數據采集可分為兩類:實車采集和基于硬件在環仿真的方式采集[8]。在綜合考慮硬件設備、數據采集方便性、駕駛員行車安全性等多方面因素,本文選取駕駛模擬器來采集駕駛人的行車試驗數據。駕駛模擬器硬件布置示意圖如圖1所示。

駕駛模擬器可基于宿主機上的仿真軟件CarSim搭建試驗環境和模擬試驗車輛,經由傳感器檢測得到轉向盤和踏板的輸出數據,通過VeriStand將傳感器的數據由實時目標機傳送給宿主機,在CarSim中計算車輛的行駛狀態和車輛與道路的交互情況,實現硬件在環仿真。為了盡可能模擬在實車中的駕駛體驗,該模擬器由3塊顯示器組合輸出試驗場景,讓試驗人員的視野盡可能與實車相近。由2塊顯示器展示目標機的狀態和控制試驗進程,安裝攝像頭觀察記錄試驗人員的駕駛行為。駕駛模擬器如圖2所示。

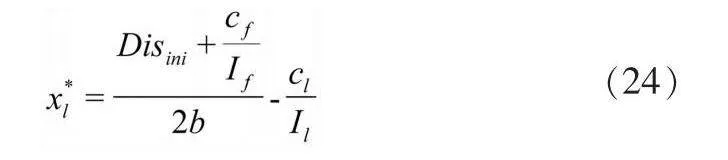

2.2" 頭部姿態估計網絡

頭部姿態估計網絡是一種以單張圖像就可進行姿態估算,且不需要提供人臉關鍵點,直接對人臉的姿態進行回歸估計的方法[9]。本文以頭部姿態估計的理念為基礎,把采集到的視頻數據進行逐幀計算,得到最終的試驗數據。本文使用頭部姿態估計網絡模塊,在框架內實現人臉的姿態估計,頭部姿態估計網絡流程如圖3所示。

2.3" 試驗模擬環境

按照道路行車規范的要求,駕駛員在彎道等特殊行車工況下禁止換道,因此本文搭建的試驗模擬道路為直線車道。在車輛行駛方向的各車道上,不同位置放置了車速不同的障礙車輛,保證試驗數據的隨機性和獨特性,避免固定障礙帶來的換道決策的雷同和單一,更符合實際的駕駛決策。

選擇不同年齡階段的試驗人員15名,均保持良好的行車習慣。為了盡可能減少無效試驗數據,試驗人員均參加了駕駛模擬器的培訓。同時,為了保證試驗正常進行和提高試驗效率,在試驗人員進行駕駛模擬時,配備一名操作員進行現場指導并及時保存試驗數據。最終測試人員在70~100km/h的速度區間內采集了45組駕駛數據,包含155次有效換道行為,其中77次左換道,78次右換道。

3" 駕駛意圖識別模塊

3.1" 選取特征參數

在正常行駛狀態下,駕駛員的意圖主要分為車道保持(LK)、左換道(LCL)和右換道(LCR)3種,選擇的特征參數需滿足在左右換道和車道保持時取值的區間不同且差別較大。

綜合多方面考量,特征參數的選取分為車輛換道意圖參數和駕駛員觀察意圖參數。車輛換道意圖參數選擇車身橫擺角、轉向盤轉角、轉向盤角速率、橫向速度和橫向加速度來表征車輛的換道行為。駕駛員觀察意圖參數選擇駕駛員頭部橫擺角來輸出駕駛員頭部在橫向、縱向的相對角度。

3.2" 識別區段劃分

區段的劃分主要從車輛換道意圖參數換道區段和駕駛員觀察意圖參數換道區段著手。從試驗數據中隨機取一段包含換道階段的數據,以車輛質心越過車道線點為中點,向時間軸前后各取400個采樣點,采樣時間為8s,對比車輛質心點的橫坐標與轉向盤轉角數據,如圖4所示。

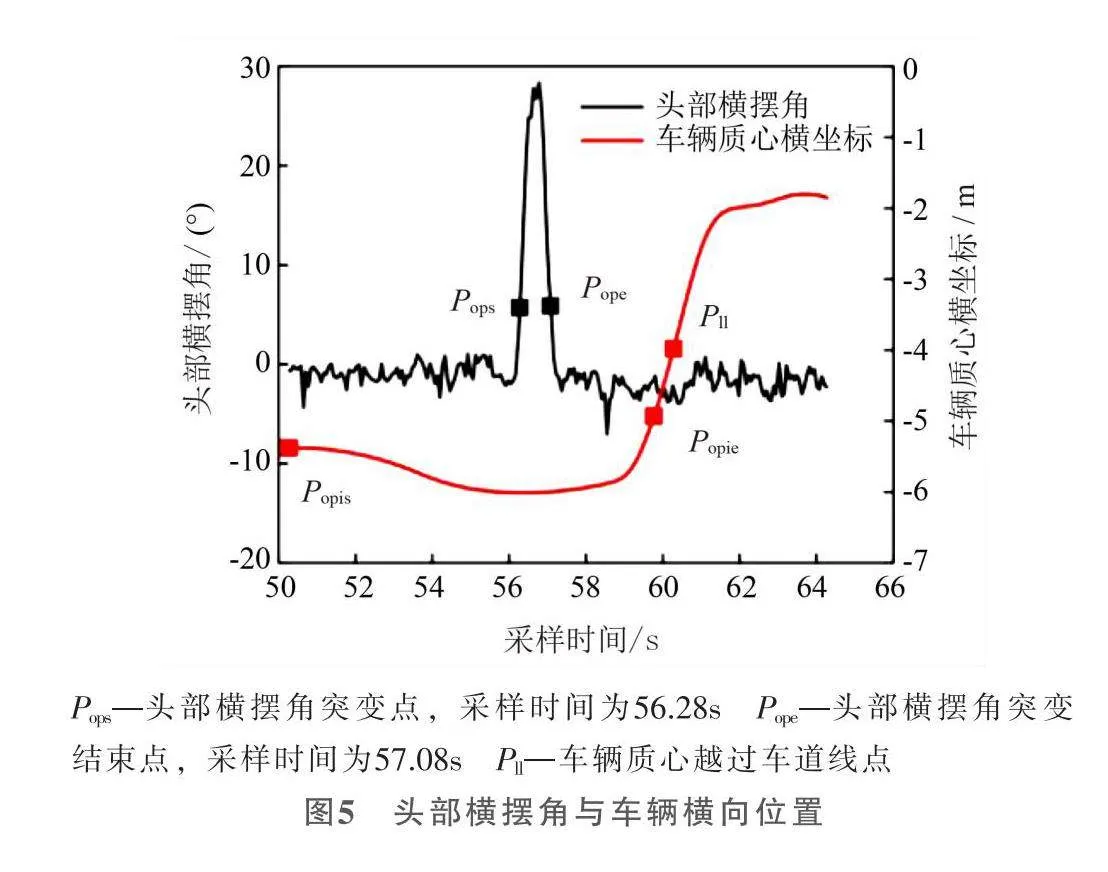

駕駛員會在換道前通過注視兩側后視鏡觀察臨近車道內是否有車輛在換道過程中有可能危及到自車,在該過程中,駕駛員的頭部橫擺角會發生變化。取圖4換道區段中頭部橫擺角數據,以車輛質心越過車道線點為中點,時間軸向前取1000個采樣點,向后取400個采樣點,采樣時間為14s,如圖5所示。

由此,本文確定駕駛員觀察意圖參數換道區段起始點為車輛質心過車道線前10s,終止點和車輛換道意圖參數區段相同,為車輛質心過車道線前0.5s。圖5中Popis點—Popie點即為駕駛員觀察意圖參數識別換道區段。

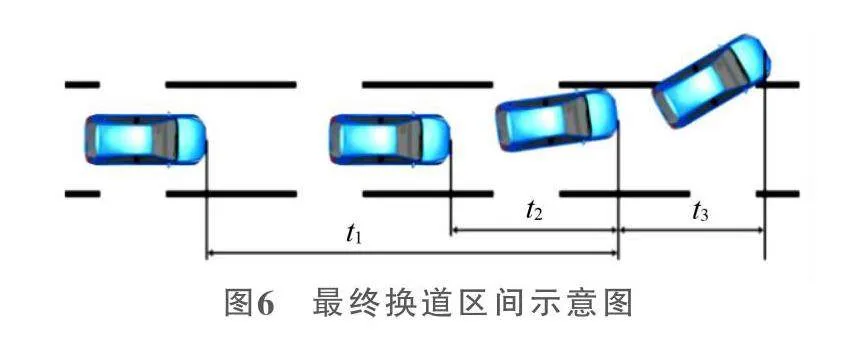

最終換道區間示意圖如圖6所示。其中t1段為駕駛員觀察意圖參數區段,長度為9.5s;t2段為車輛換道意圖參數區段,長度為3.5s;t3段為從車輛越過車道線到車輛質心過車道線區段,長度為0.5s。

3.3" 條件隨機場

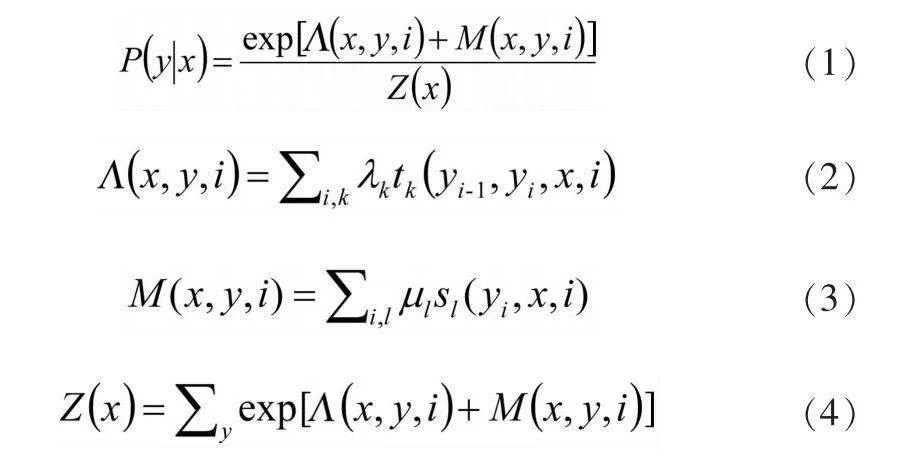

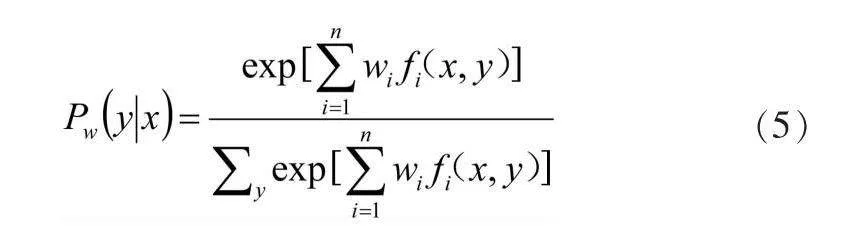

條件隨機場(Conditional Random Field,CRF)通過定義特征函數和權重系數來轉換成機器可以學習的模型。狀態序列y的條件概率為:

式中:Z(x)——歸一化因子,是對標簽序列所有可能取值求和;tk——轉移特征函數;λk——權重系數,依賴于當前節點與前一個節點;sl ——狀態特征函數;l——權重系數,只依賴于當前節點。

應用BFGS法進行模型學習。對于條件隨機場模型:

其學習的優化目標函數為:

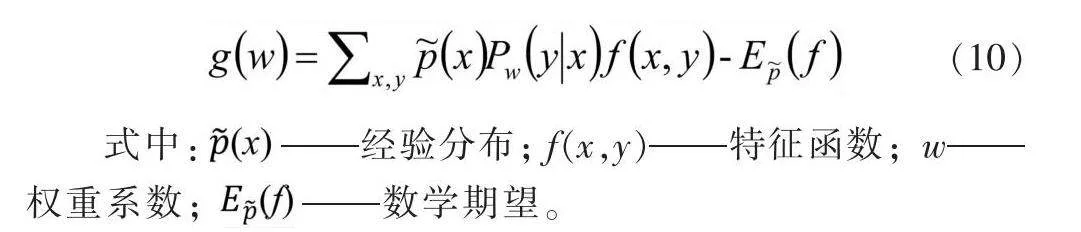

其梯度函數為:

式中:" "——經驗分布;f(x,y)——特征函數;w——權重系數;" " ——數學期望。

3.4" 模型訓練與試驗驗證

由前文確定換道區間劃分方法,并考慮到CRF算法特性,對試驗采集到的原始數據進行預處理,將駕駛員觀察意圖參數和車輛換道意圖參數分別提取,以換道點位置為標志分組,并進行數據標記,LCL、LK和LCR分別標記為1、2、3。

前文試驗中共采集155次有效換道數據,隨機選取60份左換道數據和60份右換道數據作為訓練樣本,并從未選取的數據中隨機挑選20份作為測試樣本。為作對比,數據同時導入CRF算法模型和HMM算法模型進行訓練。LCL識別結果和概率如圖7所示。

圖7a中,CRF識別結果與原始數據標記基本一致,而HMM則明顯滯后。而圖7c中,兩者結果和原始數據標記均差別不大,顯示出CRF在多參數情況下能有更為優良的識別效果。

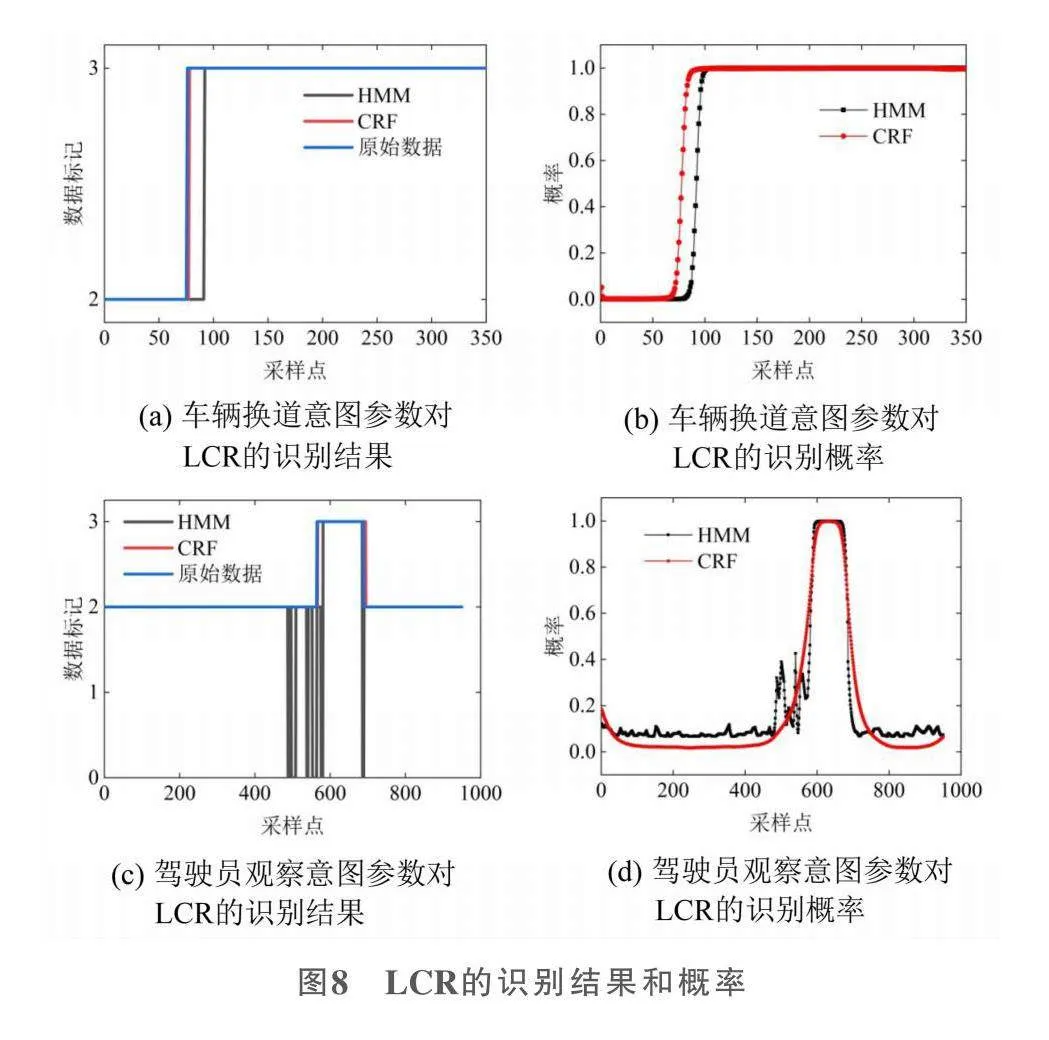

LCR識別結果和概率如圖8所示。

LCR的識別結果和LCL基本一致。但圖8c中,HMM出現多次識別異常點,有兩處長達0.12s,對照圖8d,識別概率也發生了較大起伏,而CRF無論識別結果還是概率都比較平穩,表明CRF有更好的識別穩定性。

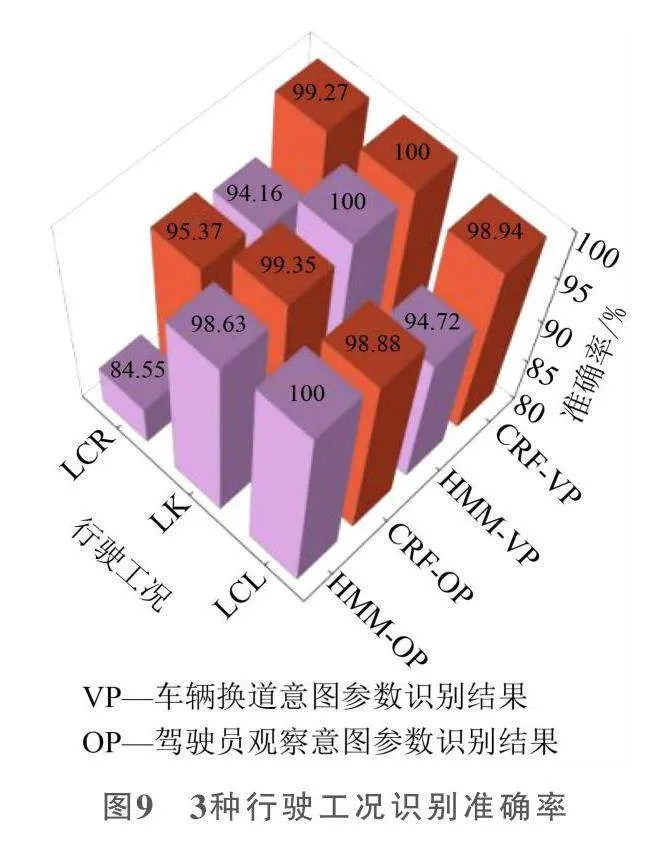

3種行駛工況識別準確率如圖9所示。CRF的準確率基本都優于HMM,達到98%以上,能夠在車輛質心越過車道線的1.92s前識別駕駛員的換道意圖;駕駛員觀察意圖參數方面,除LCL識別結果外,CRF的識別率相比HMM都具有優勢,達到95%以上,能夠在車輛質心越過車道線的5.63s前識別駕駛員的換道意圖。

借助MATLAB內置計時函數記錄兩種算法的識別用時,CRF算法的車輛換道意圖參數和駕駛員觀察意圖參數分別為0.0032s和0.0145s,而HMM算法兩種意圖參數的用時為0.0189s和1.9746s。在對兩類參數的識別上,CRF所用時間基本占HMM所用時間的18%以下,在實時性上具有明顯的優勢。

4" 人機共駕決策系統

4.1" 對旁側車道車輛碰撞預警

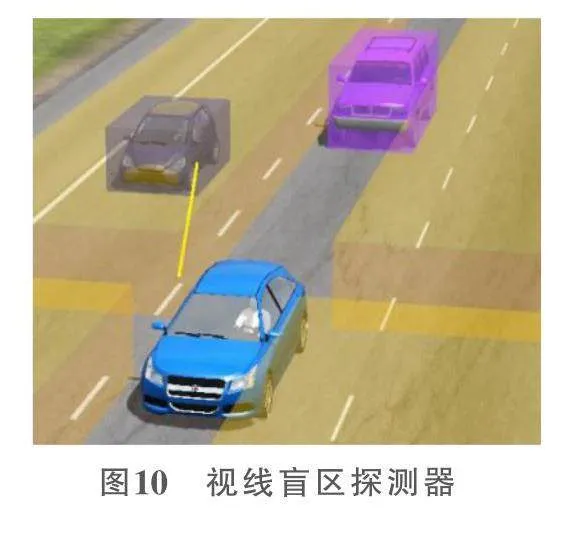

本文在車型C-Class Hatchback2012基礎上,在車身加裝4個視線盲區探測傳感器,探測旁側車道前后方的車輛,如圖10所示。

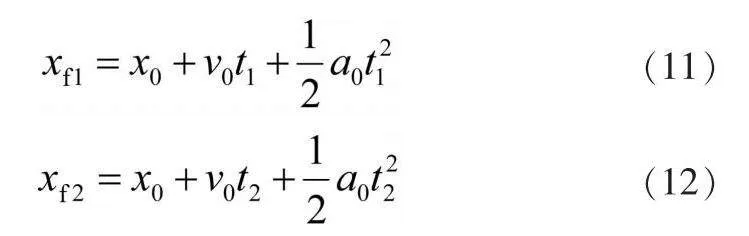

傳感器的探測范圍為50m,設置輸出數據為傳感器對探測到車輛的相對位置x0和相對速度v0,并對速度求導,得到車輛的相對加速度a0,利用公式(11)和公式(12)預測車輛的位置。

式中:t1——換道所需時間;t2——安全預留時間,用于防止換道后與車道內車輛距離過近;xf1、xf2——目前的車速和車加速度的情況下,被測車經過t1、t2的時間后與本車的相對位置。本文選擇雙駕雙控人機共駕模式作為換道決策系統的架構進行研究。

4.2" 博弈系統

4.2.1" 斯塔克爾伯格博弈模型

在斯塔克爾伯格模型中,處于主導地位的被稱為領導者,而處于較弱一方的被稱為跟隨者。領導者會首先做出決策,而后跟隨者們會根據領導者的決策而決策。與跟隨者們不同,領導者會預期到自己的決策對跟隨者們的影響,為追求最大收益,領導者會考慮這種影響,在決策時將跟隨者的反應函數視為約束條件,此時達到斯塔克爾伯格平衡。

設整體的需求函數為:

(13)

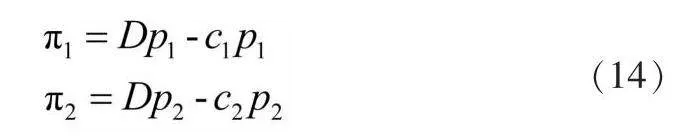

式中:p1和p2——領導者和跟隨者的決策。此時,各自的收益分別為:

式中:c1和c2——領導者廠商和跟隨者廠商的成本系數。

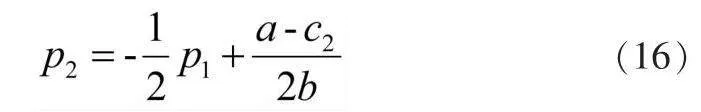

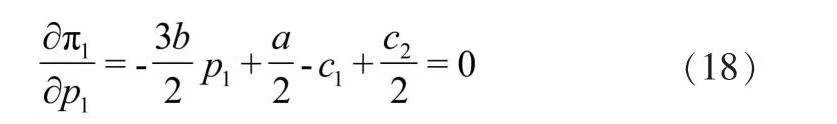

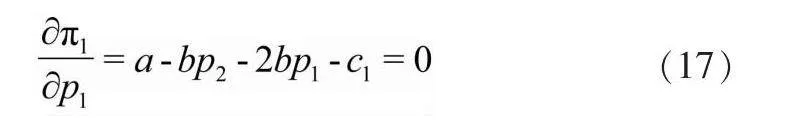

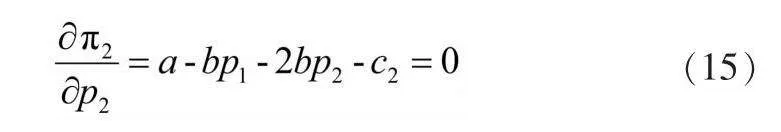

領導者作出決策后,跟隨者將考慮領導者的決策做出讓自身收益最大化的決策。而其收益最大化的一階條件是:

即領導者做出決策時,跟隨者可以獲得最大收益。除此點之外,跟隨者的收益會相比更低。可以理解為只要領導者存在,跟隨者的最高收益則為定值,無法取得更高的收益。而此時也可得出跟隨者的反應函數:

領導者可以根據跟隨者的決策做出自己的決策,即該反應函數是領導者決定產量的約束。在跟隨者取得最高收益時,領導者能取得收益最大化的一階條件為:

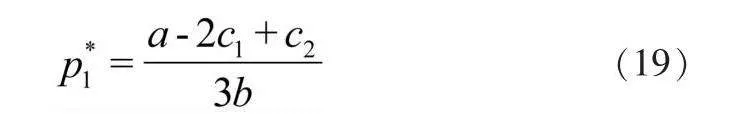

將式(16)帶入式(17),得:

此時領導者取得最大收益,其決策為:

將式(19)代入式(16),可得跟隨者的決策:

式中:p1*和p2*——領導者廠商和跟隨者廠商在達到斯塔克爾伯格平衡時的最佳決策。

4.2.2" 雙車博弈收益分析

結合斯塔克爾伯格模型特點,將自車(HV)和換道目標車道內的跟隨車輛(FV)分別視為領導者和跟隨者,以識別到駕駛員換道意圖為博弈開始點,博弈順序為HV(駕駛員意圖)→FV(碰撞預警模塊數據)→HV(根據FV數據確定最終收益)。

博弈開始時的道路空間視為總體需求,其隨著博弈雙方對道路空間的占用而降低,表達形式如下:

式中:Disfin——博弈結束時的道路空間;Disini——博弈開始時的道路空間;xd ——博弈開始時HV與FV的縱向距離;xr——安全預留距離,考慮到駕駛過程中舒適性要求的最大縱向加速度,取值為20m;xl ——HV能夠取得的空間;xf ——FV能夠取得的空間。

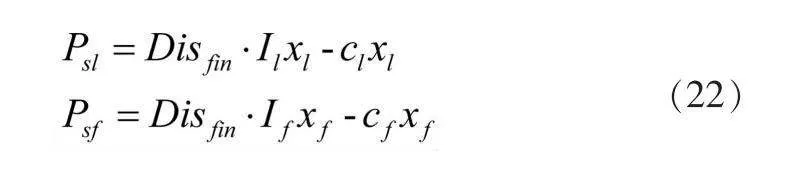

考慮兩車信息的差異性,將安全距離收益函數定為如下形式:

(22)

式中:Psl ——HV的安全距離收益函數;Psf ——FV的安全距離收益函數;Il和If ——HV和FV的決心系數;cl和cf ——安全成本系數。

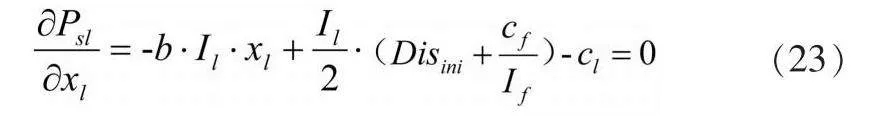

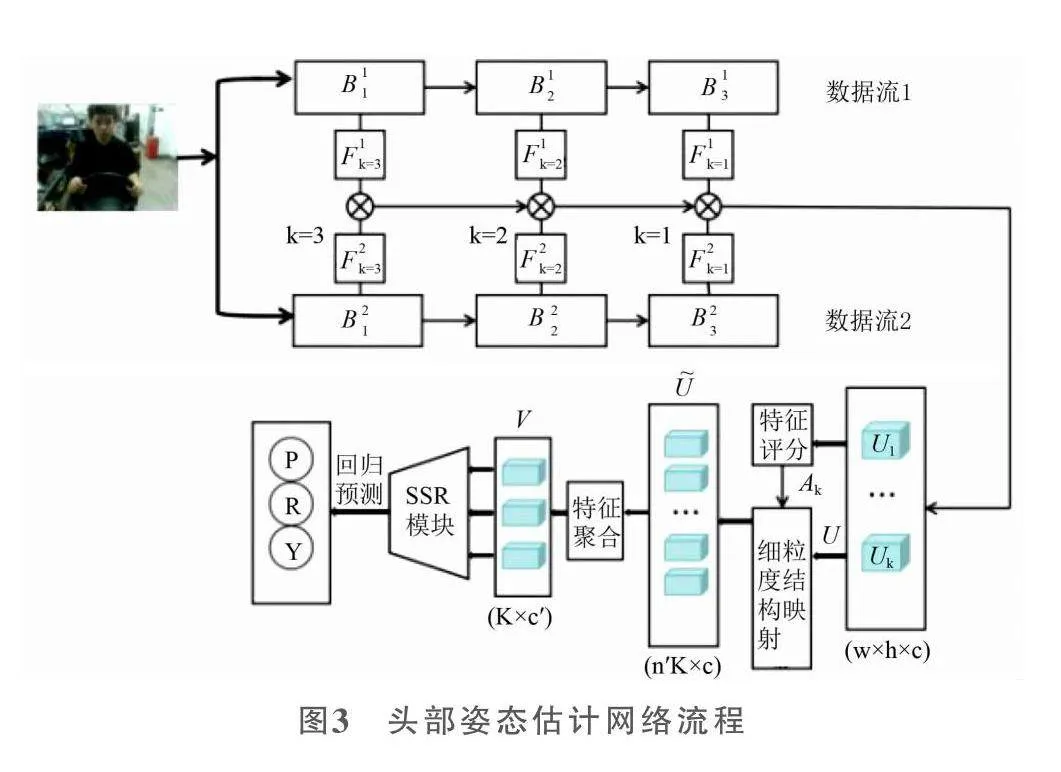

HV取得最大收益時,公式為:

其xl 解即為HV換道后能夠獲取的安全距離:

(24)

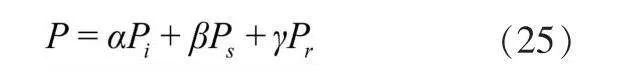

對于HV決定是否換道而言,除安全性外,駕駛員的心理感受和預期以及是否有換道的必要性也是關鍵的影響因素,由此建立HV換道收益函數:

(25)

式中:α、β和γ——每項的權重,根據場景不同,調整相應取值,匹配不同場景下3種收益的重要性;Pi、Ps和Pr——駕駛意圖收益、安全收益和加速空間收益。

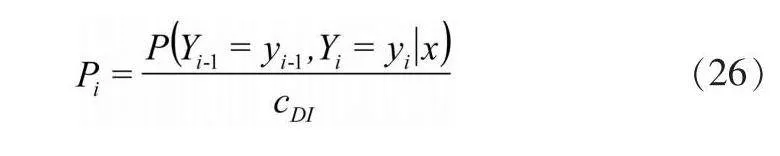

駕駛意圖收益函數具體形式如下:

式中:cDI——駕駛員意圖穩定系數,取值0.98。

安全收益反映的是換道后能夠用于操作的空間大小,其值取決于前文經過斯塔克爾伯格模型博弈后HV能夠獲取的最大空間,其具體形式如下:

式中:slD ——換道安全限制距離,根據試驗數據分析,在單車場景時取值30m。

加速空間收益函數具體形式如下:

當目標車道僅后方有FV時,Pr取值為1;當目標車道前方有FV時,用公式(21)和(22)計算比較HV所在車道前車與目標車道前方FV,FV的xf1和xf2均大于HV所在車道前車時,Pr取值為1,否則為0。

4.3" 場景驗證

4.3.1" 后方單車場景

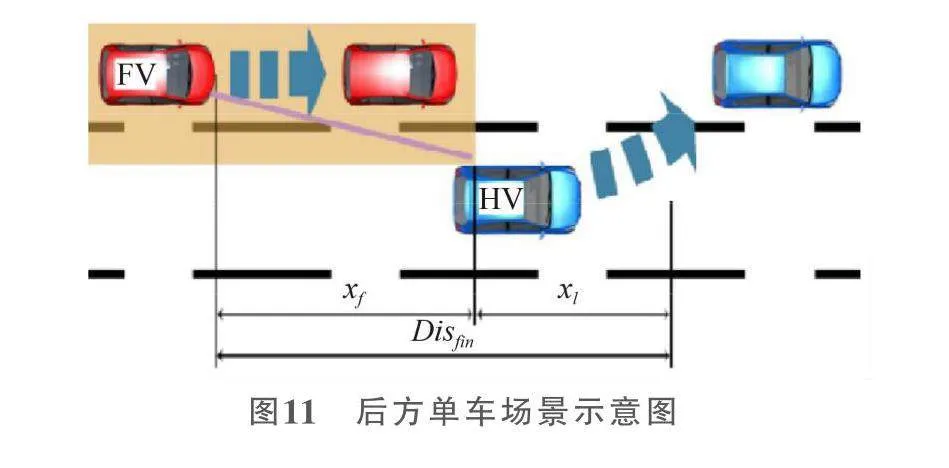

在僅車輛后方有FV時,開始博弈時的道路空間如圖11所示。

考慮駕駛意圖收益、安全收益和加速空間收益在換道過程中的重要性,取α、β和γ分別為0.3、0.3、0.4。當HV換道收益大于1時,決策換道。從樣本中隨機挑選一段換道數據,如圖12所示。

在Popc點(27.02s)時,通過駕駛員觀察意圖參數識別到駕駛員換道意圖。隨后在Ppm點(27.61s)時,HV換道收益大于1,即綜合考量駕駛員意圖、安全距離和加速空間下適合換道,此時駕駛員換道意圖概率為0.99,與FV的相對距離為41.10m;在Pvpc點(29.57s)時,通過車輛換道意圖參數識別到駕駛員換道意圖,同時開始換道。最后于31.45s車輛質心越過車道線,換道無法終止。整個換道過程中,與FV始終保持安全距離,未發生碰撞。

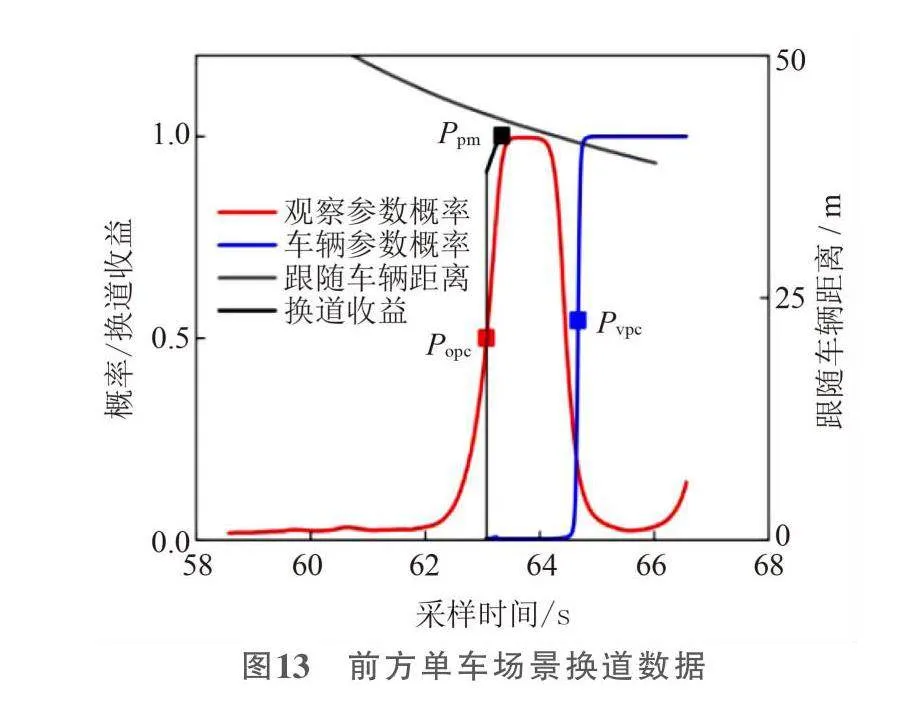

4.3.2" 前方單車場景

在僅HV前方有FV時,其博弈空間與圖11相似,不過跟隨車輛在HV前方,顯然加速空間是否存在對于換道行為相比后方單車場景更為重要,故取α、β和γ分別為0.2、0.3、0.5。從樣本中隨機挑選一段換道數據,如圖13所示。

在Popc點(63.07s)時,通過駕駛員觀察意圖參數識別到駕駛員換道意圖,隨后在Ppm點(63.34s)時,HV換道收益大于1,即綜合考慮駕駛員意圖、安全距離和加速空間下適合換道,此時駕駛員換道意圖概率為0.94,與FV的相對距離為43.39m。在Pvpc點(64.67s)時,通過車輛換道意圖參數識別到駕駛員換道意圖,同時開始換道。最后于67.06s車輛質心越過車道線,換道無法終止。整個換道過程中,與FV始終保持安全距離,未發生碰撞。

5" 總結

本文以駕駛模擬器為試驗平臺,采用頭部姿態估計網絡算法識別頭部姿態,搭建硬件在環仿真平臺,采集試驗數據;建立基于CRF算法的駕駛意圖識別模型,能夠穩定輸出駕駛員的駕駛意圖,并驗證了該系統能夠正確識別駕駛意圖;建立基于斯塔克爾伯格博弈模型的人機共駕決策系統,結合駕駛意圖收益和加速空間收益進行人機共駕決策,驗證了基于駕駛意圖識別的人機共駕決策系統的有效性。

參考文獻:

[1] Wang S,Zhao X,Yu Q,et al. Identification of driver braking intention based on long short-term memory(LSTM)network[J]. IEEE Access,2020,8(2):180422-180432.

[2] 密俊霞,于會龍,席軍強. 基于MLP-SVM的駕駛員換道行為預測[J]. 兵工學報,2022,43(12):3020-3029.

[3] Liu S,Zheng K,Zhao L,et al. A driving intention prediction method based on hidden Markov model for autonomous driving[J]. Computer Communications,2020 (157):143-149.

[4] Song R.Driver intention prediction using model-added Bayesian network[J]. Proceedings of the Institution of Mechanical Engineers,Part D: Journal of Automobile Engineering,2021,235(5):1236-1244.

[5] 郎悅茹. 基于高速公路的駕駛員換道意圖識別[J]. 汽車實用技術,2022,47(14):109-112.

[6] 趙巖,陳煥明,王亞倫,等. 基于條件隨機場的駕駛行為識別研究[J]. 青島大學學報(工程技術版),2021,36(1):14-21.

[7] Ju J,Bi L,Feleke A G. Detection of Emergency Braking Intention From Soft Braking and Normal Driving Intentions Using EMG Signals[J]. IEEE Access,2021,9:131637-131647.

[8] 劉志強,吳雪剛,倪捷,等. 基于HMM和SVM級聯算法的駕駛意圖識別[J]. 汽車工程,2018,40(7):858-864.

[9] Tsun-Yi Yang,Yi-Ting Chen,Yen-Yu Lin,et al. FSA-Net: Learning Fine-Grained Structure Aggregation for Head Pose Estimation From a Single Image[C]//2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition(CVPR). New York:IEEE,2019:1087-1096.

(編輯" 楊凱麟)