基于 CLAHE 與 U-Net 模型的無人機橋梁裂縫檢測方法

基金項目:

2021年度廣西高校中青年教師科研基礎(chǔ)能力提升項目“基于多傳感器融合技術(shù)的新型自動駕駛控制系統(tǒng)的研究與開發(fā)”(編號:桂科2021KY1130);2021年度廣西科技重大專項“限定區(qū)域和特定場景智能網(wǎng)聯(lián)汽車技術(shù)開發(fā)與示范應(yīng)用”(編號:桂科AA22068101)

作者簡介:

林土淦(1988—),工程師,研究方向:智能交通產(chǎn)品研發(fā)。

摘要:文章提出一種基于無人機與深度學(xué)習(xí)結(jié)合的橋梁表面裂縫分割方法。該方法采用無人機遍歷橋梁各區(qū)域采集圖像,通過網(wǎng)絡(luò)傳輸?shù)綐蛄毫芽p檢測系統(tǒng)進行圖像分析;采用U-Net深度學(xué)習(xí)網(wǎng)絡(luò)對橋梁圖像進行訓(xùn)練與特征提取,以提高系統(tǒng)準(zhǔn)確率;針對圖像存在光照不均勻、低對比度問題,采用對比度受限自適應(yīng)直方圖均衡化對數(shù)據(jù)進行處理以提高圖像的邊緣對比度,獲得更細膩的裂縫特征。通過驗證實驗表明,該方法相比于原始的U-Net和YOLOv8-seg網(wǎng)絡(luò),其mAP分別提高了1.63%、2.01%。

關(guān)鍵詞:橋梁裂縫檢測;圖像分割;CLAHE;U-Net模型

中圖分類號:U446.2文獻標(biāo)識碼:A 01 001 3

0 引言

橋梁設(shè)施的有效維護和損傷的預(yù)防依賴于對橋梁缺陷的及時檢測,如裂縫、坑洞、車轍、沉降或其他表面損傷[1]。由于我國公路和橋梁的總里程數(shù)不斷增加,傳統(tǒng)的人工橋梁檢測方法往往需要借助橋梁檢查車及特殊設(shè)備(如梯子等)進行觀測,需要耗費大量的人力、物力資源。在地震或極端天氣發(fā)生時,對橋梁設(shè)施的緊急維護和檢查尤為重要,采用人工檢測存在巨大的安全隱患。因此,隨著技術(shù)的發(fā)展,業(yè)界開始探索使用無人機進行橋梁設(shè)施檢測,以打造更為安全和高效的檢查系統(tǒng),再結(jié)合機器視覺技術(shù)有望實現(xiàn)橋梁設(shè)施的自動檢測[2]。

通過對無人機捕獲的圖像進行處理,能夠有效識別橋梁表面的損傷[3]。最初,研究人員使用閾值化、像素對比度、邊緣檢測等方法檢測圖像中是否存在裂縫,大致是通過手動處理圖像特征,根據(jù)像素強度分布對圖像有無裂縫進行分類。隨著人工智能技術(shù)的不斷發(fā)展,研究人員引入了機器學(xué)習(xí)方法來進行啟發(fā)式橋梁裂縫檢測,為處理各種類似的裂縫提供了一種自適應(yīng)解決方案。然而,由于模型簡單與特征提取能力不足,預(yù)測精度會受到限制。另一方面,深度卷積神經(jīng)網(wǎng)絡(luò)具有多層級抽象和深度分解已識別特征的能力,在橋梁表面圖像處理領(lǐng)域得到廣泛應(yīng)用[4],并取得較好的裂縫分類精度。在此背景下,業(yè)界對橋梁表面檢測系統(tǒng)提出了更高的要求,在準(zhǔn)確分類的基礎(chǔ)上,探索能準(zhǔn)確識別橋梁裂縫的更多信息(如位置、大小、形狀等)。李澤榮等[5]提出一種可用于水下機器人的橋梁水下結(jié)構(gòu)缺陷自動識別方法,通過圖像增強算法獲取高對比度圖像,使用改進YOLOv7-tiny網(wǎng)絡(luò)模型進行裂縫目標(biāo)檢測,準(zhǔn)確率明顯提升。

雖然目標(biāo)檢測算法能夠識別裂縫及其位置,但是無法獲得像素層面的裂縫信息,難以進一步定量評估裂縫對橋梁健康狀態(tài)的影響,還需要在候選框內(nèi)結(jié)合閾值或邊緣檢測算法提取裂縫像素。與傳統(tǒng)圖像分割算法相比,基于深度學(xué)習(xí)的圖像分割算法能直接從圖像中高效提取裂縫像素,其中全卷積神經(jīng)網(wǎng)絡(luò)、YOLO、U-Net、Mask R-CNN等在圖像分割任務(wù)上獲得顯著成效。譚國金等[6]基于改進DeepLabv3+的圖像分割模型在大量實際橋梁裂縫圖像中達到了90%以上的像素準(zhǔn)確率。余加勇等[7]提出基于YOLOv5和U-Net算法構(gòu)建裂縫定位與分割一體化橋梁裂縫智能識別方法。然而,由于裂縫圖像分割數(shù)據(jù)集的標(biāo)注成本較高,標(biāo)注質(zhì)量難以保證,使得在裂縫圖像分割任務(wù)上模型難以訓(xùn)練且性能較差。因此,需根據(jù)特定任務(wù)與數(shù)據(jù)量選擇合適的模型。

本文提出了一種混合方法,通過無人機航行攝像來采集橋梁的表面圖像,將對比度受限自適應(yīng)直方圖均衡化(Contrast Limited Adaptive Histogram Equalization,CLAHE)技術(shù)與U-Net網(wǎng)絡(luò)相結(jié)合,實現(xiàn)高效、高精度的橋梁裂縫圖像分割任務(wù)。首先,對圖像進行灰度化處理并進行CLAHE處理,然后將增強處理后的圖像用于訓(xùn)練U-Net模型,實現(xiàn)裂縫圖像的特征提取與分割。最后,在不同數(shù)據(jù)集以及無人機捕獲的圖像上進行的實驗表明,與基于U-Net模型、YOLOv8-seg模型的裂縫檢測方法相比,所提出的具有CLAHE對比度增強的U-Net更有優(yōu)勢。該方法將無人機與深度學(xué)習(xí)圖像處理技術(shù)相結(jié)合,提高了裂縫檢測的效率和準(zhǔn)確性,同時降低了檢測成本并保障了檢查員的安全。

1 系統(tǒng)設(shè)計

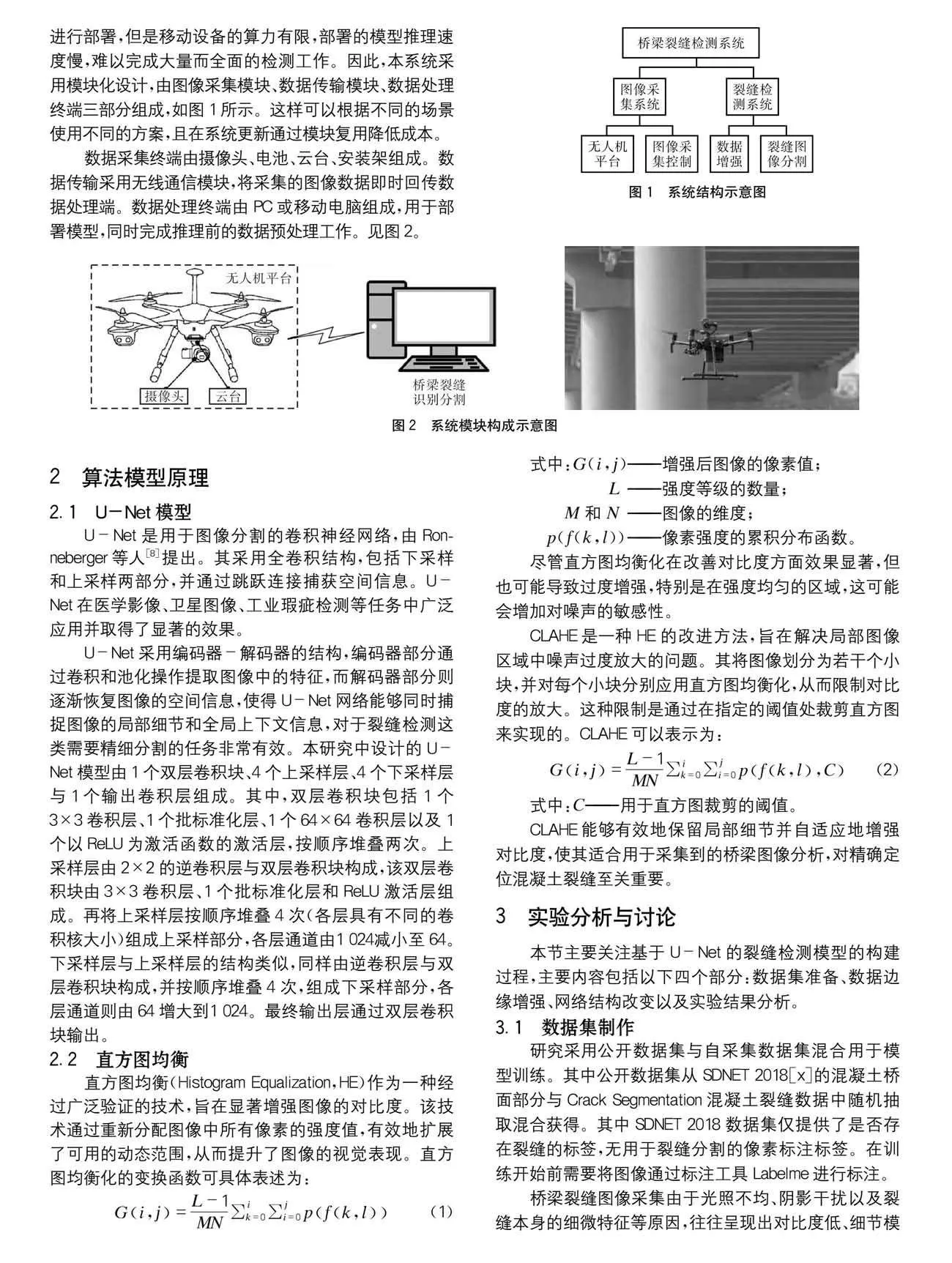

在橋梁的日常維護和檢修工作中,系統(tǒng)不僅需要滿足一定頻率的巡檢任務(wù),而且需要實現(xiàn)自動圖像采集與處理。研究人員嘗試在移動設(shè)備上(如手機、無人機等)進行部署,但是移動設(shè)備的算力有限,部署的模型推理速度慢,難以完成大量而全面的檢測工作。因此,本系統(tǒng)采用模塊化設(shè)計,由圖像采集模塊、數(shù)據(jù)傳輸模塊、數(shù)據(jù)處理終端三部分組成,如圖1所示。這樣可以根據(jù)不同的場景使用不同的方案,且在系統(tǒng)更新通過模塊復(fù)用降低成本。

數(shù)據(jù)采集終端由攝像頭、電池、云臺、安裝架組成。數(shù)據(jù)傳輸采用無線通信模塊,將采集的圖像數(shù)據(jù)即時回傳數(shù)據(jù)處理端。數(shù)據(jù)處理終端由PC或移動電腦組成,用于部署模型,同時完成推理前的數(shù)據(jù)預(yù)處理工作。見圖2。

2 算法模型原理

2.1 U-Net模型

U-Net是用于圖像分割的卷積神經(jīng)網(wǎng)絡(luò),由Ronneberger等人[8]提出。其采用全卷積結(jié)構(gòu),包括下采樣和上采樣兩部分,并通過跳躍連接捕獲空間信息。U-Net在醫(yī)學(xué)影像、衛(wèi)星圖像、工業(yè)瑕疵檢測等任務(wù)中廣泛應(yīng)用并取得了顯著的效果。

U-Net采用編碼器-解碼器的結(jié)構(gòu),編碼器部分通過卷積和池化操作提取圖像中的特征,而解碼器部分則逐漸恢復(fù)圖像的空間信息,使得U-Net網(wǎng)絡(luò)能夠同時捕捉圖像的局部細節(jié)和全局上下文信息,對于裂縫檢測這類需要精細分割的任務(wù)非常有效。本研究中設(shè)計的U-Net模型由1個雙層卷積塊、4個上采樣層、4個下采樣層與1個輸出卷積層組成。其中,雙層卷積塊包括1個3×3卷積層、1個批標(biāo)準(zhǔn)化層、1個64×64卷積層以及1個以ReLU為激活函數(shù)的激活層,按順序堆疊兩次。上采樣層由2×2的逆卷積層與雙層卷積塊構(gòu)成,該雙層卷積塊由3×3卷積層、1個批標(biāo)準(zhǔn)化層和ReLU激活層組成。再將上采樣層按順序堆疊4次(各層具有不同的卷積核大小)組成上采樣部分,各層通道由1 024減小至64。下采樣層與上采樣層的結(jié)構(gòu)類似,同樣由逆卷積層與雙層卷積塊構(gòu)成,并按順序堆疊4次,組成下采樣部分,各層通道則由64增大到1 024。最終輸出層通過雙層卷積塊輸出。

2.2 直方圖均衡

直方圖均衡(Histogram Equalization,HE)作為一種經(jīng)過廣泛驗證的技術(shù),旨在顯著增強圖像的對比度。該技術(shù)通過重新分配圖像中所有像素的強度值,有效地擴展了可用的動態(tài)范圍,從而提升了圖像的視覺表現(xiàn)。直方圖均衡化的變換函數(shù)可具體表述為:

Gi,j=L-1MN∑ik=0 ∑ji=0pfk,l

(1)

式中:G(i,j)——增強后圖像的像素值;

L——強度等級的數(shù)量;

M和N——圖像的維度;

p(f(k,l))——像素強度的累積分布函數(shù)。

盡管直方圖均衡化在改善對比度方面效果顯著,但也可能導(dǎo)致過度增強,特別是在強度均勻的區(qū)域,這可能會增加對噪聲的敏感性。

CLAHE是一種HE的改進方法,旨在解決局部圖像區(qū)域中噪聲過度放大的問題。其將圖像劃分為若干個小塊,并對每個小塊分別應(yīng)用直方圖均衡化,從而限制對比度的放大。這種限制是通過在指定的閾值處裁剪直方圖來實現(xiàn)的。CLAHE可以表示為:

Gi,j=L-1MN∑ik=0 ∑ji=0pfk,l,C

(2)

式中:C——用于直方圖裁剪的閾值。

CLAHE能夠有效地保留局部細節(jié)并自適應(yīng)地增強對比度,使其適合用于采集到的橋梁圖像分析,對精確定位混凝土裂縫至關(guān)重要。

3 實驗分析與討論

本節(jié)主要關(guān)注基于U-Net的裂縫檢測模型的構(gòu)建過程,主要內(nèi)容包括以下四個部分:數(shù)據(jù)集準(zhǔn)備、數(shù)據(jù)邊緣增強、網(wǎng)絡(luò)結(jié)構(gòu)改變以及實驗結(jié)果分析。

3.1 數(shù)據(jù)集制作

研究采用公開數(shù)據(jù)集與自采集數(shù)據(jù)集混合用于模型訓(xùn)練。其中公開數(shù)據(jù)集從SDNET 2018[x]的混凝土橋面部分與Crack Segmentation混凝土裂縫數(shù)據(jù)中隨機抽取混合獲得。其中SDNET 2018數(shù)據(jù)集僅提供了是否存在裂縫的標(biāo)簽,無用于裂縫分割的像素標(biāo)注標(biāo)簽。在訓(xùn)練開始前需要將圖像通過標(biāo)注工具Labelme進行標(biāo)注。

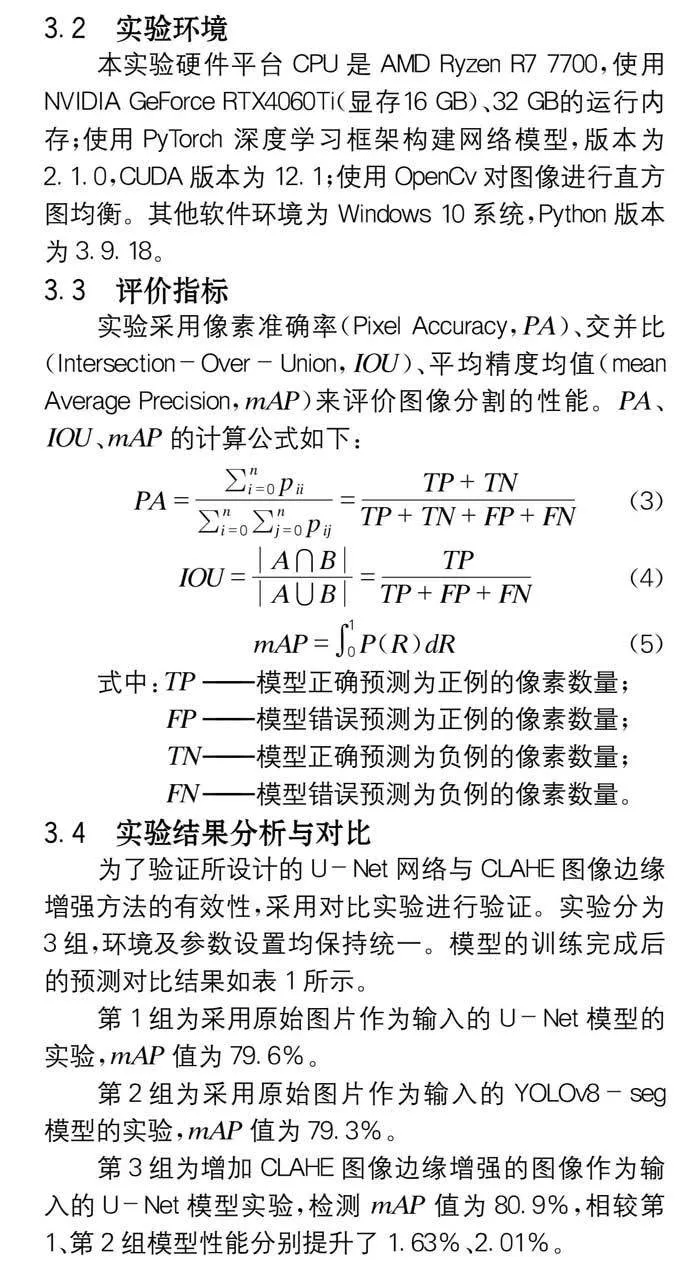

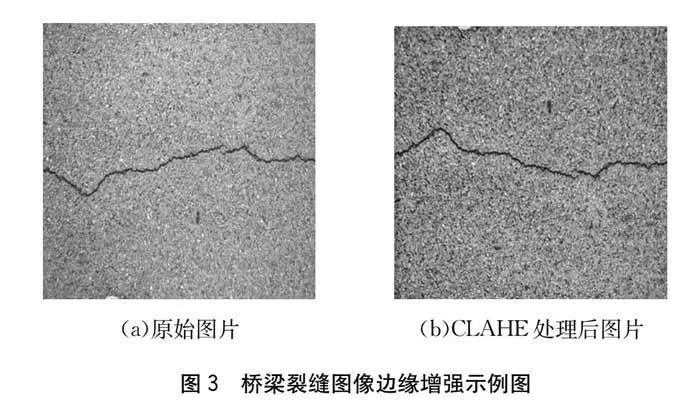

橋梁裂縫圖像采集由于光照不均、陰影干擾以及裂縫本身的細微特征等原因,往往呈現(xiàn)出對比度低、細節(jié)模糊等問題。CLAHE方法通過局部直方圖均衡化和對比度限制,有效地增強了圖像的局部對比度,同時避免了過度增強導(dǎo)致的噪聲放大。在橋梁裂縫圖像處理中,CLAHE能夠針對裂縫區(qū)域的局部特征,自適應(yīng)地調(diào)整像素值的分布,如圖3所示,可以看到裂縫細節(jié)更加突出。

3.2 實驗環(huán)境

本實驗硬件平臺CPU是AMD Ryzen R7 7700,使用NVIDIA GeForce RTX4060Ti(顯存16 GB)、32 GB的運行內(nèi)存;使用PyTorch深度學(xué)習(xí)框架構(gòu)建網(wǎng)絡(luò)模型,版本為2.1.0,CUDA版本為12.1;使用OpenCv對圖像進行直方圖均衡。其他軟件環(huán)境為Windows 10系統(tǒng),Python版本為3.9.18。

3.3 評價指標(biāo)

實驗采用像素準(zhǔn)確率(Pixel Accuracy,PA)、交并比(Intersection-Over-Union,IOU)、平均精度均值(mean Average Precision,mAP)來評價圖像分割的性能。PA、IOU、mAP的計算公式如下:

PA=∑ni=0 pii∑ni=0 ∑nj=0 pij=TP+TNTP+TN+FP+FN

(3)

IOU=A∩BA∪B=TPTP+FP+FN

(4)

mAP=10P(R)dR

(5)

式中:TP——模型正確預(yù)測為正例的像素數(shù)量;

FP——模型錯誤預(yù)測為正例的像素數(shù)量;

TN——模型正確預(yù)測為負例的像素數(shù)量;

FN——模型錯誤預(yù)測為負例的像素數(shù)量。

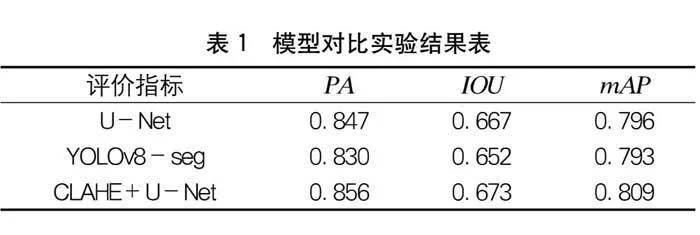

3.4 實驗結(jié)果分析與對比

為了驗證所設(shè)計的U-Net網(wǎng)絡(luò)與CLAHE圖像邊緣增強方法的有效性,采用對比實驗進行驗證。實驗分為3組,環(huán)境及參數(shù)設(shè)置均保持統(tǒng)一。模型的訓(xùn)練完成后的預(yù)測對比結(jié)果如表1所示。

第1組為采用原始圖片作為輸入的U-Net模型的實驗,mAP值為79.6%。

第2組為采用原始圖片作為輸入的YOLOv8-seg模型的實驗,mAP值為79.3%。

第3組為增加CLAHE圖像邊緣增強的圖像作為輸入的U-Net模型實驗,檢測mAP值為80.9%,相較第1、第2組模型性能分別提升了1.63%、2.01%。

訓(xùn)練過程中,隨著訓(xùn)練批次的增加,兩次實驗的損失逐漸下降。經(jīng)過50個批次訓(xùn)練后,U-Net與CLAHE+U-Net模型最終的損失在0.16附近,且CLAHE+U-Net模型的損失更低,為0.165 4。

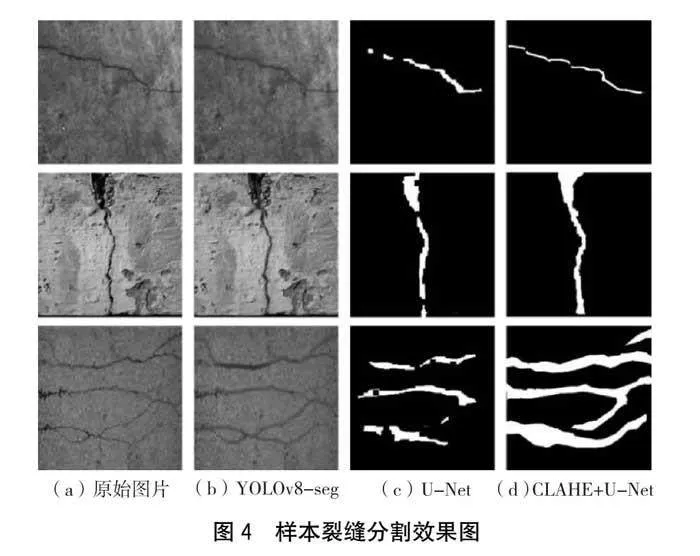

實驗結(jié)果顯示,U-Net模型在橋梁裂縫分割上的可用性,且其相較YOLOv8-seg模型效果略好,其原因可能是YOLOv8-seg網(wǎng)絡(luò)框架復(fù)雜,參數(shù)量大,在有限的數(shù)據(jù)集下無法充分發(fā)揮其優(yōu)勢。另外,經(jīng)CLAHE處理后的U-Net模型相較原模型,其精確度提升了1.63%,證明了橋梁裂縫圖像經(jīng)過邊緣增強后,模型效果得到提升。圖4展示了具有代表性的部分測試圖片在模型U-Net、YOLOv8-seg和采用CLAHE增強的U-Net圖像分割效果。由圖4可以看出,在細小的規(guī)整裂縫下,YOLOv8-seg的分割效果更好,但不規(guī)整、復(fù)雜裂縫情況下效果較差。另外,在細小裂縫上,經(jīng)過CLAHE處理后獲得的圖像分割結(jié)果相較原始U-Net更準(zhǔn)確;在明顯裂縫圖像上,兩個模型分割效果相近,但CLAHE處理的圖像效果略好;在多裂縫圖像上,CLAHE+U-Net的效果明顯好于未采用CLAHE增強的U-Net模型。

4 結(jié)語

本研究針對傳統(tǒng)橋梁裂縫人工檢測方法存在的問題,將無人機與深度學(xué)習(xí)圖像處理技術(shù)相結(jié)合,提出了一種基于CLAHE與U-Net的橋梁裂縫檢測方法。通過采用對比度受限自適應(yīng)直方圖均衡化(CLAHE)進行數(shù)據(jù)預(yù)處理,克服圖像質(zhì)量低、邊緣不明顯等問題。在對公開數(shù)據(jù)集和自采集數(shù)據(jù)集的模型進行訓(xùn)練后,驗證了所提方法的有效性。試驗結(jié)果表明,所提方法在準(zhǔn)確性和平均精度(mAP)方面均優(yōu)于原始模型,分別提高了1.06%和1.63%,

表明基于CLAHE與U-Net模型的橋梁裂縫檢測方法在提升橋梁裂縫分割性能方面效果顯著,有望在實際應(yīng)用中發(fā)揮重要作用,提高橋梁裂縫檢測的效率和準(zhǔn)確性,為土木工程領(lǐng)域的結(jié)構(gòu)安全和質(zhì)量管理提供有力支持。

參考文獻

[1]杜彥良,孫寶臣,吳智深,等. 關(guān)于建立健全交通基礎(chǔ)設(shè)施長壽命安全保障體系的戰(zhàn)略思考[J]. 中國工程科學(xué),2017,19(6):1-5.

[2]劉 睿. 基于無人機的橋梁病害檢測系統(tǒng)研究[J]. 北方交通,2024(1):17-20.

[3]鐘新谷,彭 雄,沈明燕. 基于無人飛機成像的橋梁裂縫寬度識別可行性研究[J]. 土木工程學(xué)報,2019,52(4):52-61.

[4]楊杰文,章 光,陳西江,等. 基于深度學(xué)習(xí)的較復(fù)雜背景下橋梁裂縫檢測[J]. 鐵道科學(xué)與工程學(xué)報,2020,17(11):2 722-2 728.

[5]李澤榮,劉愛榮,陳炳聰,等. 基于融合圖像增強與改進YOLOv7算法的橋梁水下結(jié)構(gòu)缺陷識別[J]. 工程力學(xué),2024,41(S1):245-252.

[6]譚國金,歐 吉,艾永明,等. 基于改進DeepLabv3+模型的橋梁裂縫圖像分割方法[J]. 吉林大學(xué)學(xué)報(工學(xué)版),2024,54(1):173-179.

[7]余加勇,劉寶麟,尹 東,等. 基于YOLOv5和U-Net3+的橋梁裂縫智能識別與測量[J]. 湖南大學(xué)學(xué)報(自然科學(xué)版),2023,50(5):65-73.

[8]Ronneberger O,F(xiàn)ischer P,Brox T. U-Net:Convolutional Networks for Biomedical Image Segmentation[C].International Conference on Medical Image Computing and Computer-Assisted Intervention,2015.