基于遷移學習的腦部磁共振圖像的阿茲海默病分類的應用研究

摘 要:隨著社會人口老齡化問題的加劇,阿茲海默病,越來越影響人們的生活質量和家庭幸福,也造成了巨大的社會負擔。利用人工智能技術對AD進行早期診斷有助于預防或減緩AD病程,減輕家庭和社會負擔。現有文獻表明,基于磁共振圖像的AI分類算法可用于AD早期診斷。針對基于磁共振圖像的AD分類問題,設計實現了兩種分類遷移學習方法,分別是微調方法和時域視覺提示方法,并通過在公開數據集上驗證,證實這些方法的分類精度得到提升。

關鍵詞:阿茲海默病;磁共振圖像;醫學圖像分類;遷移學習

中圖分類號:TP391.4 文獻標識碼:A 文章編號:2096-4706(2024)16-0039-06

Application Research on Alzheimer's Disease Classification of Brain Magnetic Resonance Image Based on Transfer Learning

Abstract: As the aging of the social population intensifies, Alzheimer's disease (AD), is increasingly affecting people's life quality and family happiness, and has also caused a huge social burden. Using Artificial Intelligence technology to conduct the early diagnosis of AD can help prevent or slow down the course of AD and reduce the burden on families and society. Existing literature shows that AI classification algorithms based on magnetic resonance images can be used for early diagnosis of AD. Aiming at the AD classification problem based on magnetic resonance images, this paper designs and implements two classification Transfer Learning methods, namely fine-tuning method and time-domain visual prompting method. Through verification on public data sets, it is confirmed that the classification accuracy of these methods is improved.

Keywords: AD; magnetic resonance image; medical image classification; Transfer Learning

0 引 言

為了對AD(Alzheimer Disease)患者進行準確診斷,醫生會對患者進行諸如計算機斷層掃描(CT)和磁共振成像(MRI)的腦部掃描以排除其他病因。CT和MRI都有助于識別腦瘤、中風、阿茲海默病或其他腦部疾病。CT掃描使用X射線掃描大腦的圖像;核磁共振成像使用強磁場掃描,可以呈現大腦圖像的更多細節。阿茲海默病診斷所用的MRI圖像有T1加權、T2加權和液體衰減反轉恢復(FLAIR)圖像。目前已經有許多醫學研究表明磁共振成像在診斷阿茲海默病方面具有優越性。

與擁有大規模標記的數據集(如ImageNet)的自然圖像分析相比,醫學圖像分類的一大挑戰是數據集樣本太少。標記醫學圖像成本高、耗時長,是需要專科醫生、放射科醫生和其他專家共同參與的勞動密集型工作。因此,不需要大規模數據集的遷移學習引起了醫學圖像分類研究者們越來越多的關注。醫療圖像分類領域中,許多研究人員已經投身于使用遷移學習方法進行各種機器學習任務的優化[1]。

利用人工智能技術輔助AD的早期診斷對延緩AD的發展具有重要意義。結構磁共振成像(sMRI)在計算機輔助AD診斷方面顯示出巨大的實用價值。在現實場景中,受來自不同來源或采集域的數據的影響,MRI數據通常會出現域偏移問題。本文針對基于磁共振圖像的AD分類的域適應問題進行研究,實現了基于微調和基于視覺提示的兩種分類領域適應,以處理具有域移位問題的MRI數據,并實現AD、輕度認知障礙(MCI)和認知正常(NC)的自動輔助診斷。

1 遷移學習方法與領域適應問題

1.1 遷移學習介紹

遷移學習是通過從已經學習過的相關任務中遷移知識來改進新任務中的學習。雖然大多數機器學習算法都是為處理單個任務而設計的,但遷移學習的算法的開發是機器學習界持續關注的話題[2]。

遷移學習的目標是通過利用源任務中的知識來改進目標任務中的學習。有三種常見的措施可以通過遷移來改善學習性能:一是在進行任何進一步學習之前,與無遷移的性能相比,僅使用遷移學習方法才可實現的性能;二是與從頭開始學習目標任務的時間相比,在給定遷移知識的情況下完全學習目標任務所需的時間;三是與沒有實現遷移方法的最終性能相比,目標任務中可達到的最終性能水平[3]。

給定具有相應源任務TS的源域DS,和具有相應目標任務TT的目標域DT(其中DS≠DT,TS≠TT),遷移學習是根據DS和TS的相關信息對目標預測函數ft(·)進行優化的過程。

1.2 領域適應問題

域由特征空間和邊緣概率分布P(X)組成,其中X={x1,…,xn}∈X。給定特定域D={X,P(X )},任務T由特征空間Y和目標預測函數f組成,從概率的角度來看,目標預測函數也可以被視為條件概率分布P(Y |X )。一般來說,我們可以通過有監督的方式從標記數據{xi,yi}中學習P(Y |X ),其中xi∈X,yi∈Y。

假設我們有兩個域:具有足夠標記數據的訓練數據集是源域Ds={X sP(X )s},具有少量標記數據或沒有標記數據的測試數據集是目標域域Ds={X sP(X )s}。每個域都與其任務關聯:前者是T s={Y s,P(Y s|X s)s},后者是T s={Y s,P(Y s|X s)s}。類似地,P(Y s|X s)可以從源標記數據{,}中學習,而P(Y t|X t)可以從標記的目標數據{,}和未標記的數據{}中學習。

本文提出了適用于3D MRI圖像分類模型的領域適應方法,以提高AD、MCI和NC的分類模型在不同數據源上的分類準確率。將不同型號磁共振機器掃描所得到的磁共振圖像進行統一的預處理,從源域訓練出預訓練模型。在不對預訓練模型參數做任何改動的前提下,通過視覺提示來提升源域預訓練模型在目標域上的分類準確率,從而緩解3D MRI圖像分類的領域適應問題。本文方法結合殘差神經網絡和微調方法產生3D MRI的分類預訓練模型,實驗表明使用視覺提示方法成功地提升了源域分類模型在目標域上的分類準確率,有效提高了3D MRI圖像分類的準確率。

2 數據預處理與分類模型構建

2.1 數據預處理

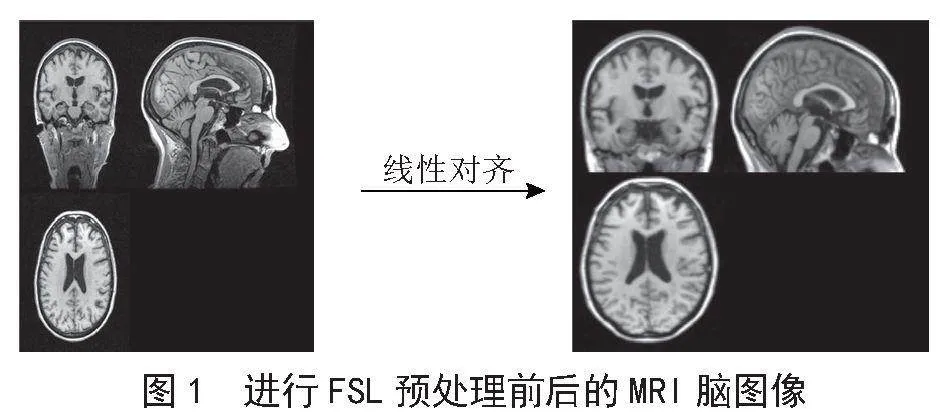

采用阿茲海默神經影像計劃[4](The Alzheimer's Disease Neuroimaging Initiative, ADNI)數據集中的A、B兩個數據集。在此基礎上使用英國牛津大學腦功能磁共振成像中心軟件庫[5](FMRIB's Software Library, FSL)對數據進行預處理。FLIRT[6]是FMRIB的線性圖像配準工具,在預處理操作中,對于每一個MRI影像,使用FSL軟件中的FLIRT命令線性配準到MNI-2 mm模板影像上,使相同的解剖結構在相同的坐標上。

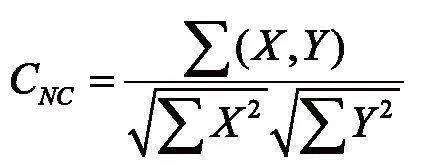

配準要求找到兩個體積腦圖像的最佳幾何對齊[7]。將這兩個圖像稱為配準后的Y圖像和配準前的X圖像。配準的目標是當將配準操作應用于X圖像時,最大化Y圖像和X圖像之間的“相似性”。要解決這個問題,需要構造一個量化兩個圖像之間的不相似性的成本函數,然后找到最小成本的變換T *,其公式化表達為:

ST是變換空間,C(I1,I2)是成本函數,T(X )表示圖像經過變換后的結果。圖像配準問題可選擇許多不同的成本函數[8],我們的配準中選擇歸一化相關函數CNC:

選擇了成本函數后,只需要尋找能產生最小成本值的轉換T *即可。

實驗中所使用的MRI腦圖像的數據處理前后對比結果如圖1所示,因為本文使用的數據集樣本較少,不同數據集中MRI腦圖像又存在組織結構在體積空間中未對齊的情況,因此采用該線性配準方法。

2.2 分類模型構建

深度殘差網絡由多個殘差學習單元[9]堆疊而成。我們首先將輸入數據作為深度殘差網絡輸入層,數據依次經過卷積層、非線性激活函數層和歸一化層[10],然后將處理的結果進一步傳入多個殘差單元,再經過歸一化層和多個全連接層最后得到輸出結果。

設計的殘差網絡在輸出通道數為64、步幅為2的卷積層后,接步幅為2的最大匯聚層,每個卷積層后增加了規范化層。使用4個由殘差塊組成的模塊,每個模塊使用若干個同樣輸出通道數的殘差塊。第一個模塊的通道數同輸入通道數一致。由于之前已經使用了步幅為2的最大匯聚層,所以無須減小高和寬。之后的每個模塊在第一個殘差塊里將上一個模塊的通道數翻倍,并將高和寬減半。每個模塊有4個卷積層(不包括恒等映射的卷積層)。加上第一個卷積層和最后一個全連接層,共有10層。接著加入所有殘差塊,每個模塊使用2個殘差塊。最后在加入全局平均匯聚層,以及全連接層輸出。

2.3 名詞解釋與分類結果

2.3.1 名詞解釋

TP表示真陽性,陽性受試者的分類結果為陽性。FP表示假陽性,陰性受試者的分類結果為陽性。TN表示真陰性,陰性受試者的分類結果為陰性。FN表示假陰性,陽性受試者的分類結果為陰性。

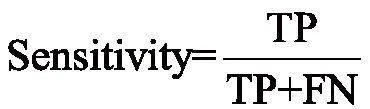

敏感性(Sensitivity)表示正確識別陽性受試者的能力:

特異性(Specificity)表示正確識別陰性受試者的能力:

ROC表示以敏感性為y軸,以(1-Specificity)為x軸繪制出的曲線。

AUC表示ROC曲線下面積,表示分類模型的性能。AUC值越高(越靠近1),表示模型越能區分出患者。

C(DS,DT)表示分類模型C在數據集DS上訓練,在數據集DT上測試。

R10表示我們所設計的10層殘差神經網絡。

+BS表示在R10的基礎上使用批采樣器處理方法,根據權重采樣,保證批次里邊每個類別都有相近的數量。

+AG表示在上一條的模型的基礎上加上數據增強處理。

+WG表示在上一條的模型的基礎上加上權重衰減處理,對網絡的矩陣權重做均方值,降低網絡的過擬合程度,提高網絡的泛化性。

2.3.2 分類結果

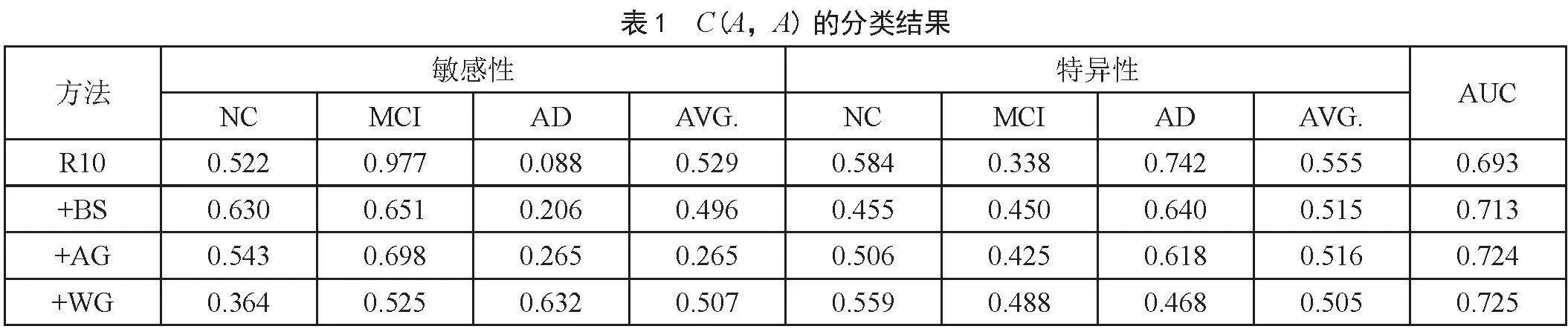

A數據集共613條數據,其中NC/MCI/AD:為231:213:169。隨機劃分數據集為訓練集/驗證集/測試集為392:98:123,保持數據集類別比例不變,分類結果如表1所示。

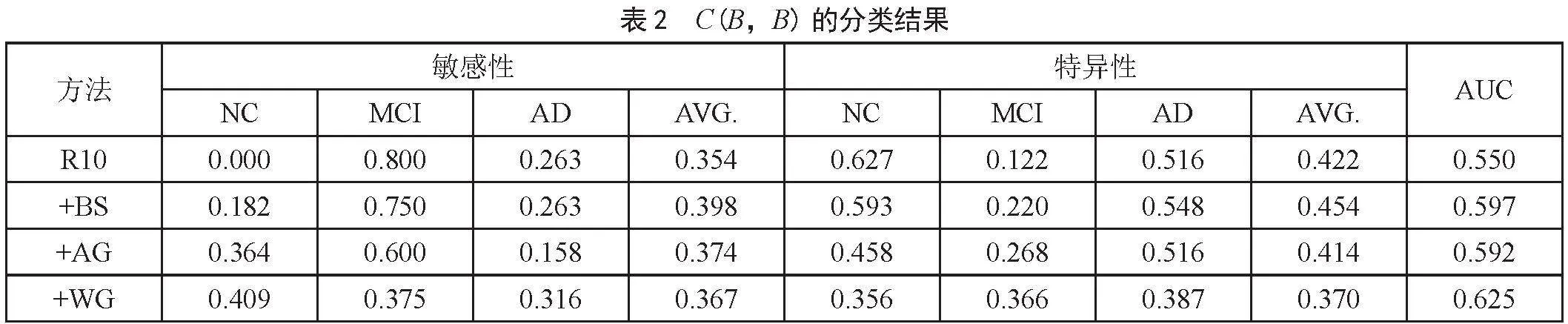

B數據集共401條數據,其中NC/MCI/AD為107:201:93。隨機劃分數據集為訓練集/驗證集/測試集為256:64:81,保持數據集類別比例不變,分類結果如表2所示。

C(A,A)和C(B,B)的分類結果效果不好,猜測是訓練集數據量太小導致的。本次實驗把兩個數據集數據合并后作為訓練數據集,使用訓練模型R10并且使用批采樣器和數據增強方法,然后分別將模型在A數據集和B數據集上進行測試,分類結果如表3所示。

后續將設計實驗方法使分類精度在此結果上提升。

3 方法設計與實現

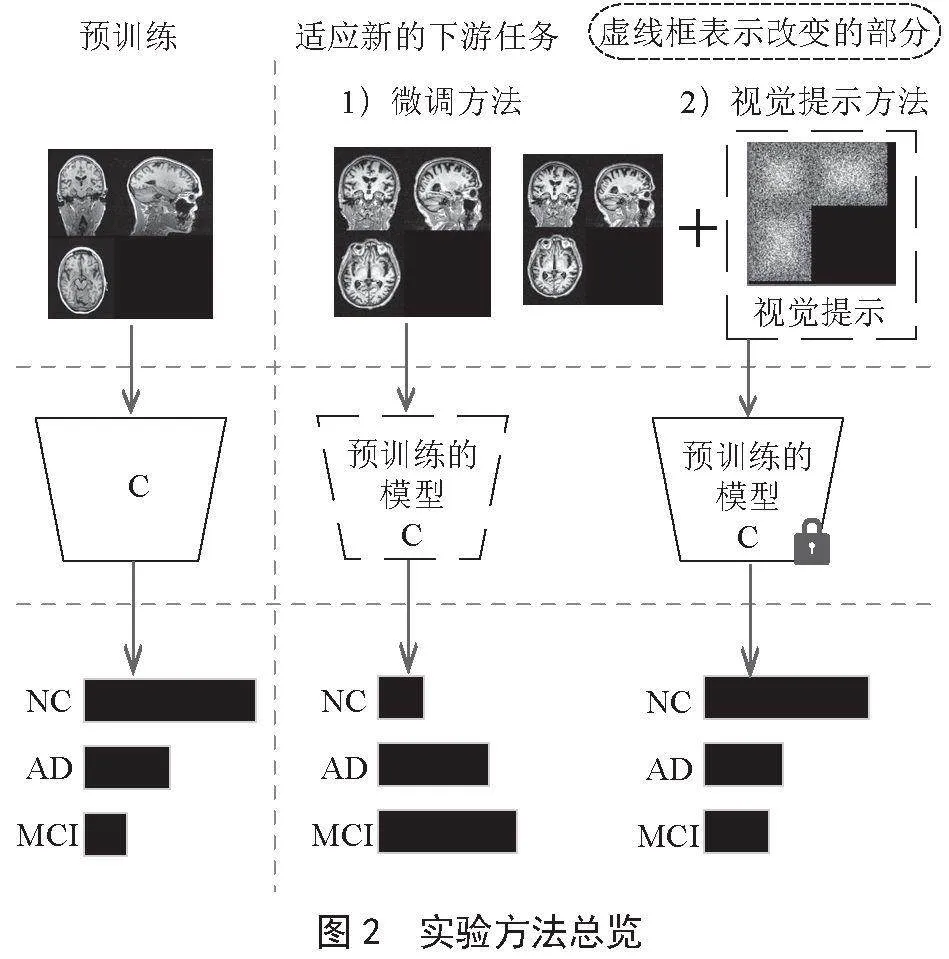

圖2展示了本文所涉及的不同領域適應方法的對比,可以看出微調方法對預訓練模型參數做出權重優化以使其適應不同數據集任務;視覺提示方法則既不改變模型參數,也不加入新的層,而是通過給輸入加一個視覺提示的方法來使模型適應新的數據集任務。

下文中將分別介紹微調方法和時域視覺提示方法的設計與實現,并對比分析不同方法的結果。

3.1 微調方法

在機器學習中,微調是一種遷移學習的方法,即在新的數據集上進行預訓練模型的權重優化[11]。微調可以在整個神經網絡上或者只在其所有層的子集上進行。在這種情況下,沒有被微調的層被"凍結"(即在反向傳播步驟中不更新)。

3.1.1 設計與實現

對于某些架構,如卷積神經網絡,通常保持早期的層(最接近輸入層的層)被凍結[12],因為它們捕捉的是較低級別的特征,而后期的層往往能分辨出與模型訓練的任務更相關的高級特征。

將微調方法用于預訓練的分類網絡,選擇凍結卷積層,對全連接層進行重新訓練。

選擇A數據集分類中最優秀的模型CA并且凍結它的卷積層模型參數,重新建立全連接層,并將微調后的模型在B數據集上測試;同理,選擇B數據集分類中最優秀的模型CB并且凍結它的卷積層模型參數,重新建立全連接層,并將微調后的模型在A數據集上測試。

實驗中微調的具體操作過程如下:

1)采用預先用A數據集訓練的CA深度殘差神經網絡和預先用B數據集訓練的CB深度殘差神經網絡。

2)加載預訓練網絡,從網絡中刪除完全連接層頭。

3)將新初始化的完全連接層頭放置在分類網絡的頭部。

4)凍結分類網絡骨干中各卷積層的權重。

5)使用預先訓練的卷積層權重和新初始化的全連接層在新的數據集上重新訓練模型,評估其分類性能。

3.1.2 實驗結果

利用B數據集對CA預訓練模型的全連接層進行訓練并與無微調操作的訓練結果進行對比,結果如表4所示。

由于B數據集樣本量太小,凍結預訓練模型卷積層參數而用B數據訓練全連接層的微調方法效果并不好。

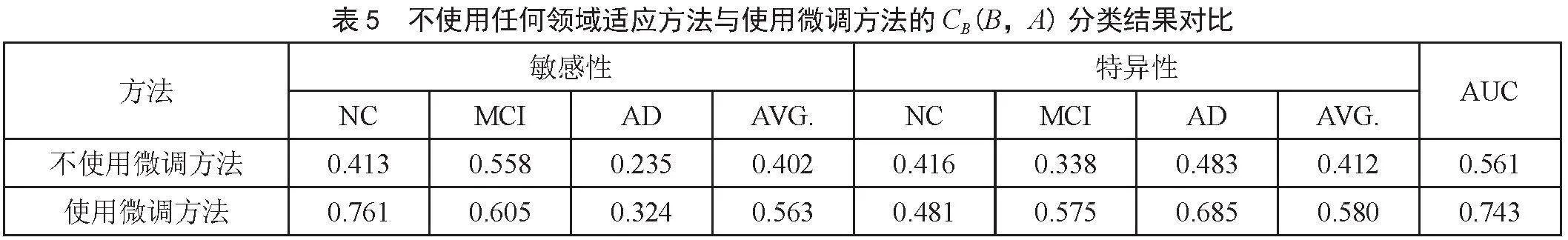

利用A數據集對CB預訓練模型的全連接層進行訓練并與無微調操作的訓練結果進行對比,結果如表5所示。

由于A數據集樣本量比B略大,凍結B的預訓練模型卷積層參數而用A數據訓練全連接層的微調方法效果相比之前有所提升。

3.2 時域視覺提示方法

提示學習首先在NLP中被引入[13],提示意味著設計一個模板來重新制定下游數據集,這樣預訓練的凍結模型就可以直接應用于新任務,而無須更新參數。通過手動設計合適的提示,可以提高下游任務的性能。這一思想已經擴展到與視覺語言模型相結合的視覺任務中。

目標是通過只修改輸入圖像的像素,使預訓練的模型適應其他數據集的分類任務。我們89b4003ad60016321b0e4b9d2b1c0f6f427d8c18b1cc09e7055b1ea019c63e21嘗試給每個任務學習一個固定的提示。給定凍結的預訓練模型F和下游任務數據集D=(x1,y1),…,(xm,ym),我們的目標是學習由參數化的視覺提示。提示被添加到輸入圖像以形成提示圖像x+vφ。在訓練過程中,模型使正確標簽y的可能性最大:

maxPθ;φ(y|x+vφ)

更新僅應用于提示參數φ,并且模型參數θ保持凍結。在評估過程中,我們將優化的提示應用于所有測試圖像,然后通過凍結的模型F對其進行處理。

3.2.1 設計與實現

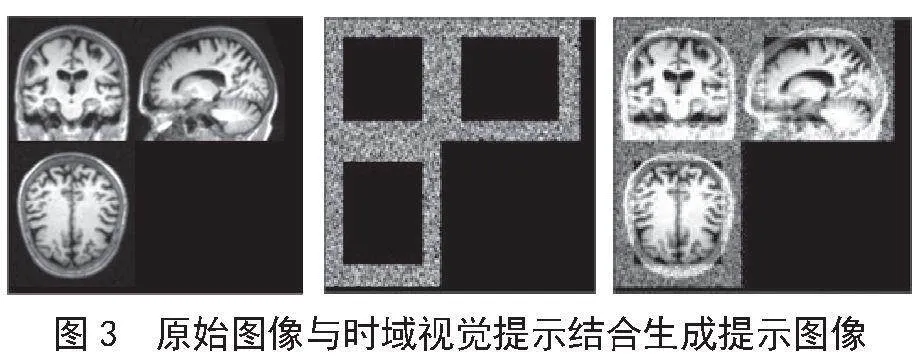

圖像大小為(91,109,91),如圖3所示,時域下的提示設計為在圖像外框部體素賦隨機值,輸入預訓練模型并對外框隨機數值進行優化。

接下來的目標是通過使用目標數據集Dt和凍結的預訓練的分類模型CM來訓練可學習的視覺提示,稱為vr。通過這種方式,我們可以獲得目標數據集的優化時域視覺提示。

實驗中使用的視覺模板是外圈固定位置體素的隨機數值,通過探索各種提示比例p,與其他設計選擇相比,p=0.3的補丁實現了最佳性能,我們在后續的實驗中都把它作為默認值。

創建大小為(91,109,91)的隨機int32數值圖像并將其中心部分(14:77,16:93,14:77)賦值為0,即只保留外圈隨機值。將該圖像作為視覺提示和原始圖像一起在神經網絡進行優化訓練,并得到最終的視覺提示。

3.2.2 實驗結果

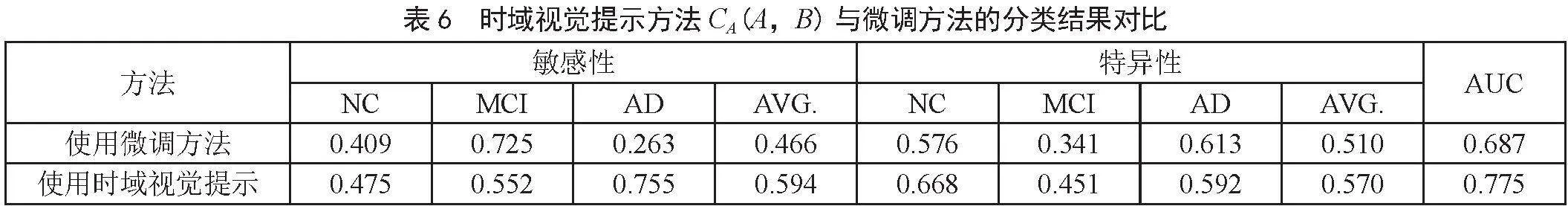

利用A數據集在凍結的預訓練模型CA上進行訓練并得到最優視覺提示,將該提示與B數據集結合并在凍結的預訓練模型CA上驗證其分類結果,結果如表6所示。

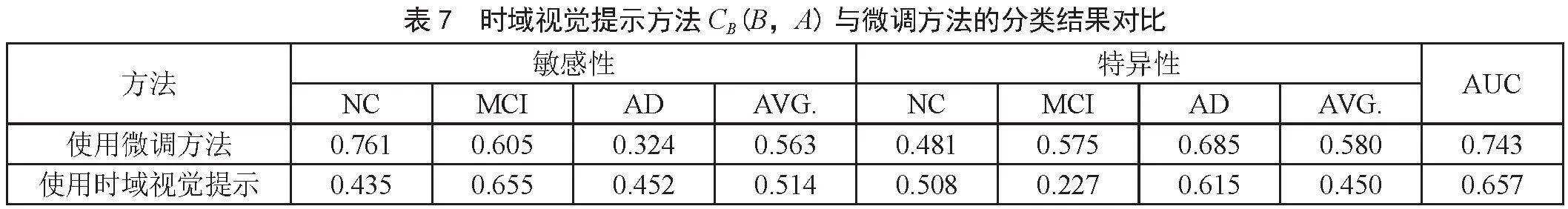

利用B數據集在凍結的預訓練模型CB上進行訓練并得到最優視覺提示,將該視覺提示與A數據集結合并在凍結的預訓練模型CB上驗證其分類結果,結果如表7所示。

根據結果可看出,時域下視覺提示方法對緩解領域適應問題起到一定作用,當訓練集樣本較大時,模型分類準確率有所提升;當訓練集樣本較小時,模型分類性能不如微調方法。

4 結 論

針對基于磁共振圖像的阿茲海默病分類的分類問題進行研究,利用殘差神經網絡架構,搭建阿茲海默病磁共振圖像分類模型,實現了基于微調和基于視覺提示的遷移學習方法,有效提高預訓練的阿茲海默病分類模型在其他數據源磁共振腦圖像上的阿茲海默病分類準確率。

參考文獻:

[1] RAGHU M,ZHANG C,KLEINBERG J,et al. Transfusion: Understanding Transfer Learning for Medical Imaging [C]//Advances in Neural Information Processing Systems 32 (NeurIPS 2019).Vancouver:NIPS,2019:1-11.

[2] WEISS K,KHOSHGOFTAAR T M,WANG D D. A Survey of Transfer Learning [J].Journal of Big data,2016,3(1):1-40.

[3] TORREY L,SHAVLIK J. Transfer Learning [M]//Handbook of Research on Machine Learning Applications and Trends:Algorithms,Methods,and Techniques.IGI global,2010:242-264.

[4] WEINER M W,VEITCH D P,AISEN P S,et al. The Alzheimer's Disease Neuroimaging Initiative 3: Continued Innovation for Clinical Trial Improvement [J].Alzheimer's & Dementia,2017,13(5):561-571.

[5] JENKINSON M,BECKMANN C F,Behrens T E J,et al. FSL [J].Neuroimage,2012,62(2):782-790.

[6] WOOLRICH M W,JBABDI S,Patenaude B,et al. Bayesian Analysis of Neuroimaging Data in FSL [J].Neuroimage,2009,45(1):S173-S186.

[7] SMITH S M,JENKINSON M,WOOLRICH M W,et al. Advances in Functional and Structural MR Image Analysis and Implementation as FSL [J].Neuroimage,2004,23:208-219.

[8] JENKINSON M,BANNISTER P,BRADY M,et al. Improved Optimization for the Robust and Accurate Linear Registration and Motion Correction of Brain Images [J].Neuroimage,2002,17(2):825-841.

[9] AV?AR E,SAL?IN K. Detection and Classification of Brain Tumours from MRI Images Using Faster R-CNN [J].Tehni?ki Glasnik,2019,13(4):337-342.jHFWpY4wAqWXIDSNjlFtQBTUgHRhLkZdWdJB7QpfqKI=

[10] SANTURKAR S,TSIPRAS D,ILYAS A,et al. How does Batch Normalization Help Optimization? [C]//Advances in Neural Information Processing Systems.NIPS,2018:1-11.

[11] TAJBAKHSH N,SHIN J Y,GURUDU S R,et al. Convolutional Neural Networks for Medical Image Analysis: Full Training or Fine Tuning? [J].IEEE Transactions on Medical Imaging,2016,35(5):1299-1312.

[12] ANDERSON G W,CASTANO D J. Measures of Fine Tuning [J].Physics Letters B,1995,347(3-4):300-308.

[13] LIU P,YUAN W,FU J,et al. Pre-train, Prompt, and Predict: A Systematic Survey of Prompting Methods in Natural Language Processing [J].ACM Computing Surveys,2023,55(9):1-35.