基于深度強化學習帶時間窗的綠色車輛路徑問題研究

摘 要:如何在客戶規定的時間內合理安排車輛運輸路線,一直是物流領域亟待解決的問題。基于此,文章提出使用基于軟更新策略的決斗雙重深度Q網絡(Dueling Double Deep Q-network, D3QN),設計動作空間、狀態空間與獎勵函數,對帶時間窗的綠色車輛路徑問題進行建模與求解。選擇了小、中、大規模的總計18個算例,將三種算法的實驗結果在平均獎勵、平均調度車輛數、平均里程和運算時間四個維度進行比較。實驗結果表明:在大多數算例中,與Double DQN和Dueling DQN相比,D3QN能在可接受的增加時間范圍內,獲得更高的獎勵函數,調度更少的車輛數,運輸更短的里程,實現綠色調度的目標。

關鍵詞:深度強化學習;路徑優化;決斗雙重深度Q網絡;D3QN算法;車輛路徑問題

中圖分類號:U116.2 文獻標志碼:A DOI:10.13714/j.cnki.1002-3100.2024.19.017

Abstract: How to reasonably arrange vehicle transportation routes within the time specified by customers has always been an urgent problem in the field of logistics. Based on this, this paper proposes to use Dueling Double Deep Q-network(D3QN)based on soft update strategy to design action space, state space and reward function to model and solve the green vehicle routing problem with time window. A total of 18 small, medium and large scale examples are selected, and the experimental results of the three algorithms are compared in four dimensions: Average reward, average number of scheduled vehicles, average mileage and operation time. The experimental results show that, in most examples, compared with Double DQN and Dueling DQN, D3QN can obtain higher reward function, dispatch fewer vehicles, transport shorter mileage, and achieve the goal of green dispatch within the range of acceptable increase in time.

Key words: deep reinforcement learning; path optimization; Dueling Double Deep Q network; D3QN algorithm; vehicle routing problem

0 引 言

帶時間窗的車輛路徑問題(Vehicle Routing Problems with Time Windows,VRPTW)是指在時間窗口約束下,將一定數量的配送或服務點分配給若干個車輛,使得所有配送或服務點被訪問一次,并滿足各車輛容量約束條件的配送路徑問題。VRPTW問題最早可以追溯到20世紀70年代末和80年代初,它通常基于圖論建立數學模型,是一個典型的NP-hard問題。

隨著計算機算力的提升,深度學習算法逐步用于解決實際問題。2013年,Mnih et al.[1]首次提出了深度Q網絡(Deep Q

-network)模型,該模型是一個卷積神經網絡,用Q學習的變體訓練,成功地直接從高維感覺輸入中學習控制策略。2016年,Silver et al.[2]將深度強化學習算法運用到圍棋游戲中,并且引入了蒙特卡洛樹搜索法。在此算法的基礎上,他們編寫了程序AlphaGo。同年3月,AlphaGo以4比1的總比分戰勝了圍棋世界冠軍李世石,成為第一個直接擊敗人類選手的人工智能機器人。由于傳統的Q學習算法在某些情況下會高估動作值,從而使得整體的決策無法達到最優,Hasselt et al.[3]提出了深度雙Q網絡(Double DQN, DDQN)算法。Wang et al.[4]提出了對決深度Q網絡(Dueling DQN)算法,這種算法能夠更準確地估計狀態的價值,區分不同動作的重要性。

強化學習的經典算法包括深度Q網絡,在此基礎上又衍生出了深度雙Q網絡,決斗深度Q網絡和決斗雙重深度Q網絡等。決斗雙重深度Q網絡作為前兩者算法的演化與升級,在其他領域取得了優于前二者算法的表現。袁帥等[5]借助帶經驗回放機制的D3QN算法,實現移動機器人在未知環境中更好地獲取最優路徑。在收斂速度方面,相比DQN提升了56%。韓磊等[6]使用改進的D3QN算法,提升了可變限速控制策略的靈活性。此外,也有學者將強化學習的方法運用到經典的路徑優化問題中。Kool et al.[7]使用借助基于注意力機制和指針網絡的強化學習解決旅行社問題,其結果接近其他專業算法。Nazari et al.[8]提出了一個端到端的強化學習框架來解決車輛路徑問題,該模型僅通過觀察獎勵信號并遵循可行性規則,就可以從給定分布中采樣問題實例找到接近最優的解決方案。其計算質量優于經典的啟發式方法和Google的OR-Tools,并且計算時間相當。Lin et al.[9]運用深度強化學習研究電動汽車車隊的路徑優化問題,所提出的模型能夠有效解決現有方法難以求解的大規模調度問題。

帶時間窗的車輛路徑問題作為一個經典的物流領域調度規劃問題,不少學者使用精確式算法、近似算法對該問題及其變種問題進行建模和求解。隨著環保理念的深入,學者們對考慮環境影響、碳排放的車輛路徑優化問題也逐漸深入,車輛路徑優化問題逐漸向著綠色調度的方向發展。

此外,隨著人工智能技術的發展,強化學習的方法逐步運用到路徑優化問題的求解中,并且取得了一定的成效。以往的研究往往借助基礎的深度Q網絡,對VRPTW問題進行求解,該方法容易造成對Q值的高估,從而降低訓練的質量。雙重深度Q網絡算法作為一種新興的算法,在解決此類問題上仍然有較大的潛力。傳統的深度Q網絡使用的是硬更新的方式對目標網絡進行更新。本文運用了基于策略的深度強化學習方法中的參數更新方式,使用基于軟更新策略的決斗雙重深度Q網絡算法,定義狀態空間、動作空間和獎勵函數,借助算法的智能體決策解決帶時間窗的運輸問題,驗證了該算法在解決帶時間窗的綠色車輛路徑問題上的有效性。

1 算法概述

1.1 深度雙Q網絡與競爭深度Q網絡

在原始的DQN算法中,由于原始算法采用的是新策略的方法,容易出現Q值估計偏高的情形。算法每次在學習時,不是使用下一次交互使用的真實動作,而是使用當前策略認為的價值最大的動作,產生最大化偏差,使得估計動作的Q值偏大。

為了解決這個問題,將動作選擇和價值估計進行解耦,Hasselt等提出了深度雙Q網絡。DDQN算法相較于DQN算法,改變了目標值的計算方法,這使得訓練過程更加穩定,能夠有效地解決后者對于動作價值的高估問題,提高了算法的收斂性和性能。

DDQN基于經驗回放機制與目標網絡技巧,構建兩個動作價值神經網絡,一個用于估計動作,另外一個用于估計該動作的價值。DDQN算法不直接通過最大化的方式選取目標網絡計算的所有可能Q值,而是首先通過評估網絡選取最大Q值對應的動作。

接著,再將評估網絡選擇出的動作a,輸入目標網絡計算目標值:

式中:y表示目標值,w表示評估網絡參數,w表示目標網絡參數。

Dueling DQN算法是傳統DQN的一個拓展,它包含了一種新的神經網絡結構——競爭網絡(Duel Network)。Dueling DQN通過引入一個基準網絡和一個優勢網絡,將值函數的估計分解為狀態值和動作優勢。狀態值表示在給定狀態下的期望回報,而動作優勢表示每個動作相對于平均值的優劣程度。通過這種分解,Dueling DQN可以將注意力集中在對狀態值的學習上,而無需為每個動作單獨計算值。這使得算法更加高效,并且能夠更好地處理動作空間較大的環境。Dueling DQN的評估網絡結構如下:

式中:V為最優狀態價值函數,A為最優優勢函數,第三項為在動作a平均取值情況下的優勢函數,一般為0。

1.2 軟更新策略的決斗雙重深度Q網絡

決斗雙重深度Q網絡(D3QN)結合了Double DQN和Dueling DQN算法的思想,進一步提升了算法的性能,是二者的演化與升級。它與Dueling DQN算法的唯一區別在于計算目標值的方式,其目標網絡計算方式借鑒了Double DQN的思想,即利用評估網絡獲取s狀態下最優動作價值對應的動作,然后利用目標網絡計算該動作的動作價值,從而得到目標值。

本文使用基于軟更新策略的D3QN來解決VRPTW問題。D3QN的目標網絡與評估網絡的模型和參數完全一致。這兩個網絡的更新方式包括硬更新和軟更新,本文采取軟更新的方式對評估網絡的參數進行更新。評估網絡的參數每更新迭代一次,目標網絡的參數也會隨之更新。軟更新通過在每次更新時將一小部分評估網絡的參數與目標網絡的參數進行混合,從而使目標網絡的更新過程平滑化。這種混合比例由超參數tau控制。具體更新公式如下:

w=tau*w+1-tau*w (4)

軟更新可以減輕強化學習算法中的不穩定性問題。盡管相比于硬更新,其學習速度可能相對較慢,但如軟更新在訓練過程中提供了一種平滑的、逐漸更新的方式,更能增加算法的穩定性。

2 帶時間窗的綠色車輛路徑問題描述

2.1 問題描述

本文所研究的帶時間窗的綠色車輛路徑問題,在規劃路線過程中考慮了環境保護和可持續性的因素,旨在最小化運輸成本的同時,減少運輸過程中的碳排放。綠色車輛問題的優化可以通過車輛調度和路徑規劃、車輛種類的選擇以及燃料消耗等方面實現,降低對環境的影響[10]。在本文的模型中,所有的配送車輛被認為是相同的,因此,它們的排放量也相同。對于綠色車輛路徑問題,本文的攻克重點放在車輛的調度數量和路線的距離上。車輛啟動所排放的二氧化碳量是固定的,因此,調度越少的車輛,服務單位客戶的碳排放越低。基于此,本文模型的優化目標為:首先實現調度車輛數量最小化,其次實現運輸路線距離最小化,以期實現對環境的最小影響。獎勵與懲罰函數的設置也關系到模型的優劣程度。本文對于車輛的調度成本設置為120個單位,而服務單個客戶的成本為90個單位。對于智能體而言,需要服務至少兩個客戶,才能實現正收益,進一步保證了運輸的有效性和調度的綠色性。

VRPTW問題的模型目標為:設計一組使總成本最小化的路線,首先最小化調度車輛數,其次最小化總運輸距離。該問題的其他調度規則有:

每一個顧客僅服務一次;

每一條路線從0節點開始,到n+1節點結束;

能夠實時觀測到客戶的時間窗,車輛的容量限制;

車輛在節點之間的移動距離在數值上等同于移動所花費的時間。

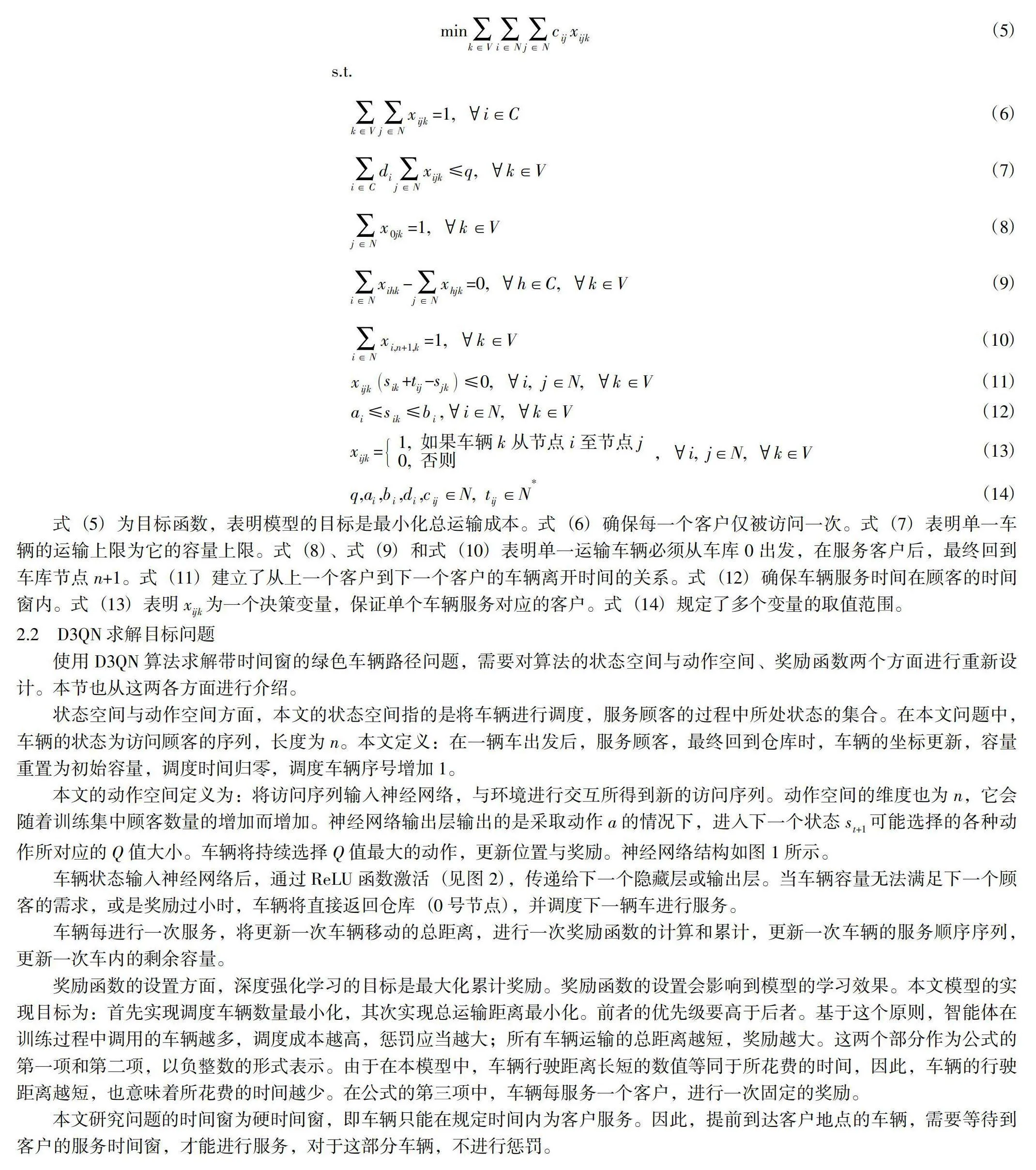

VRPTW問題的模型如下:

式(5)為目標函數,表明模型的目標是最小化總運輸成本。式(6)確保每一個客戶僅被訪問一次。式(7)表明單一車輛的運輸上限為它的容量上限。式(8)、式(9)和式(10)表明單一運輸車輛必須從車庫0出發,在服務客戶后,最終回到車庫節點n+1。式(11)建立了從上一個客戶到下一個客戶的車輛離開時間的關系。式(12)確保車輛服務時間在顧客的時間窗內。式(13)表明x為一個決策變量,保證單個車輛服務對應的客戶。式(14)規定了多個變量的取值范圍。

2.2 D3QN求解目標問題

使用D3QN算法求解帶時間窗的綠色車輛路徑問題,需要對算法的狀態空間與動作空間、獎勵函數兩個方面進行重新設計。本節也從這兩各方面進行介紹。

狀態空間與動作空間方面,本文的狀態空間指的是將車輛進行調度,服務顧客的過程中所處狀態的集合。在本文問題中,車輛的狀態為訪問顧客的序列,長度為n。本文定義:在一輛車出發后,服務顧客,最終回到倉庫時,車輛的坐標更新,容量重置為初始容量,調度時間歸零,調度車輛序號增加1。

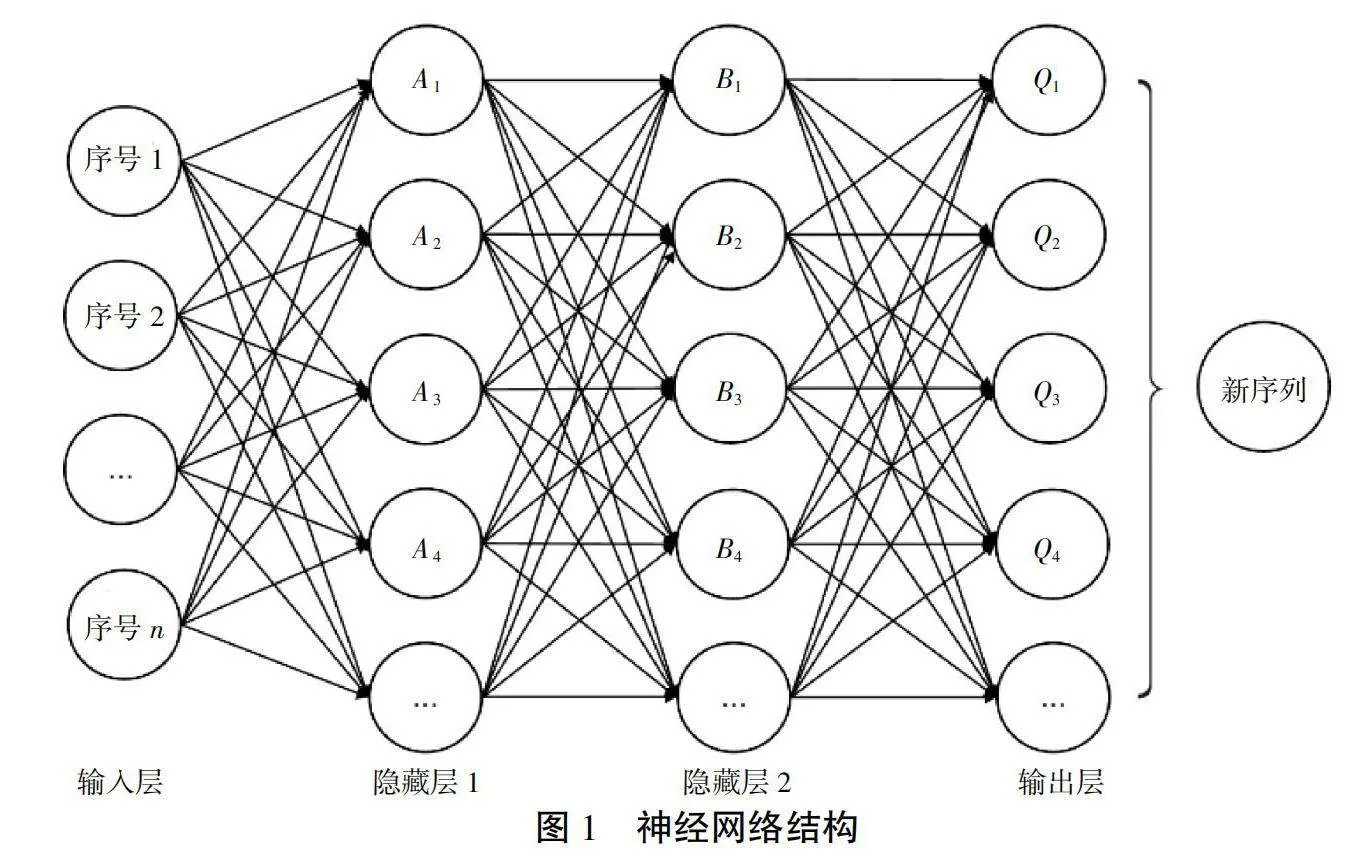

本文的動作空間定義為:將訪問序列輸入神經網絡D60+iQ6532T6fe0KTWa+RohNF66HWZiwyOj1lIJa4os=,與環境進行交互所得到新的訪問序列。動作空間的維度也為n,它會隨著訓練集中顧客數量的增加而增加。神經網絡輸出層輸出的是采取動作a的情況下,進入下一個狀態s可能選擇的各種動作所對應的Q值大小。車輛將持續選擇Q值最大的動作,更新位置與獎勵。神經網絡結構如圖1所示。

車輛狀態輸入神經網絡后,通過ReLU函數激活(見圖2),傳遞給下一個隱藏層或輸出層。當車輛容量無法滿足下一個顧客的需求,或是獎勵過小時,車輛將直接返回倉庫(0號節點),并調度下一輛車進行服務。

車輛每進行一次服務,將更新一次車輛移動的總距離,進行一次獎勵函數的計算和累計,更新一次車輛的服務順序序列,更新一次車內的剩余容量。

獎勵函數的設置方面,深度強化學習的目標是最大化累計獎勵。獎勵函數的設置會影響到模型的學習效果。本文模型的實現目標為:首先實現調度車輛數量最小化,其次實現總運輸距離最小化。前者的優先級要高于后者。基于這個原則,智能體在訓練過程中調用的車輛越多,調度成本越高,懲罰應當越大;所有車輛運輸的總距離越短,獎勵越大。這兩個部分作為公式的第一項和第二項,以負整數的形式表示。由于在本模型中,車輛行駛距離長短的數值等同于所花費的時間,因此,車輛的行駛距離越短,也意味著所花費的時間越少。在公式的第三項中,車輛每服務一個客戶,進行一次固定的獎勵。

本文研究問題的時間窗為硬時間窗,即車輛只能在規定時間內為客戶服務。因此,提前到達客戶地點的車輛,需要等待到客戶的服務時間窗,才能進行服務,對于這部分車輛,不進行懲罰。

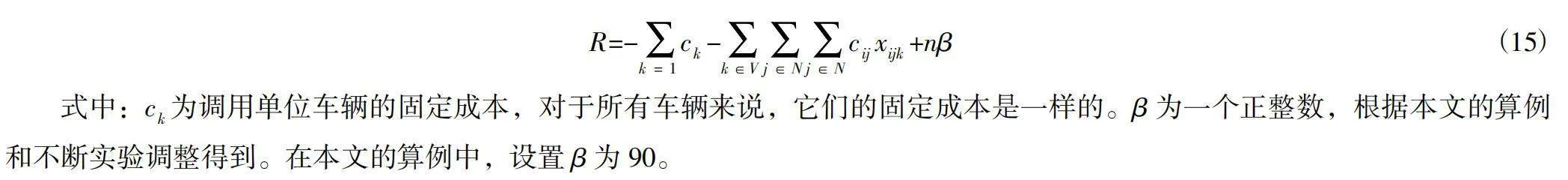

因此,將D3QN的累計獎勵函數設置為三部分之和,具體公式如下:

R=-c-cx+nβ (15)

式中:c為調用單位車輛的固定成本,對于所有車輛來說,它們的固定成本是一樣的。β為一個正整數,根據本文的算例和不斷實驗調整得到。在本文的算例中,設置β為90。

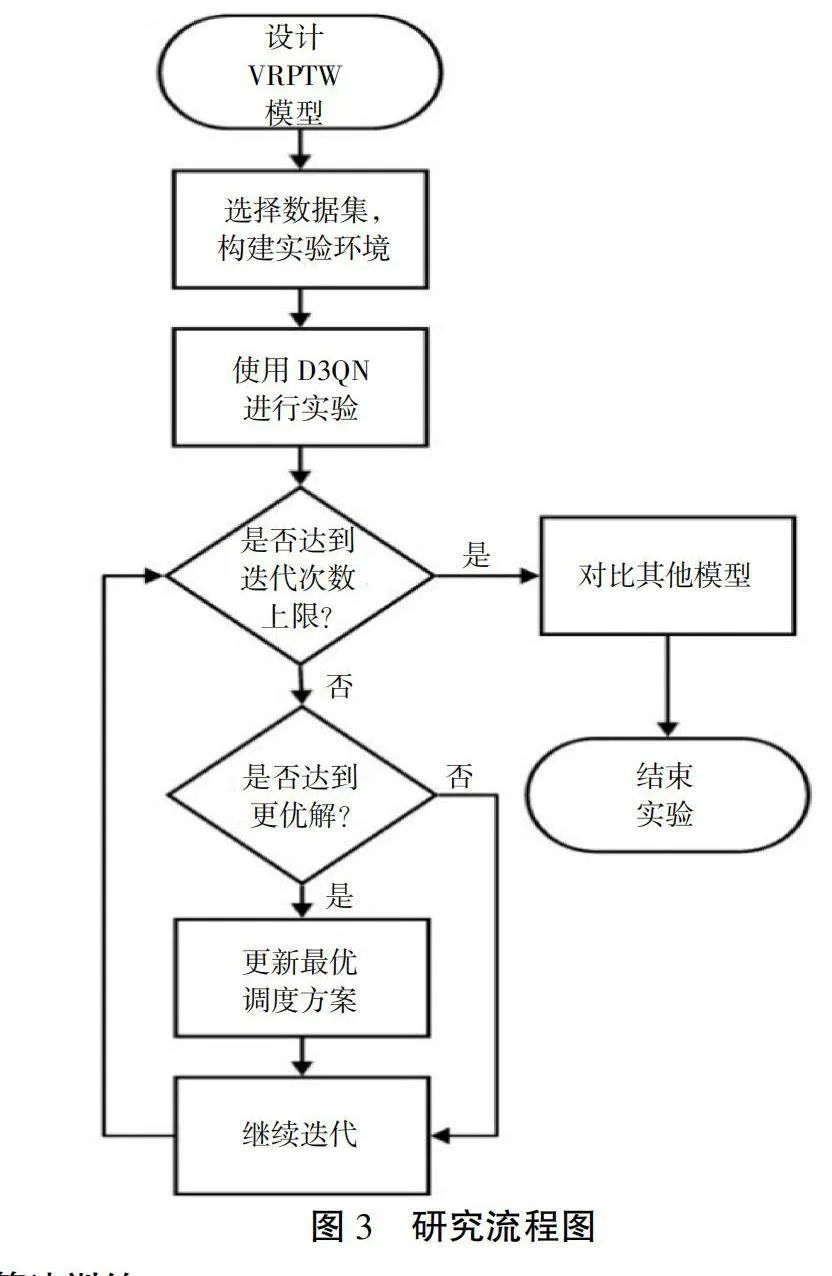

2.3 研究與算法流程

本文的研究流程如圖3所示。

本文算法的偽代碼如表1所示。

3 算法訓練

3.1 算法模型與參數設置

本文應用算法為基于軟更新策略的決斗雙重深度Q網絡,基于Python3.9語言與Pytorch1.13框架實現,配置12th Gen Intel(R)Core(TM)i9-12900H 2.50 GHz,RAM 16.0GB。VRPTW模型借助Python中的gym庫進行編譯。

探索策略方面,本文使用ε-貪心策略(epsilon-greedy)來對目標問題進行求解。

式中:ε為一個小于1的正數,P=ε表示算法以ε的概率隨機選擇動作空間的動作,P=1-ε表示算法以1-ε的概率選擇當前時間步內價值最大的動作作為下個時間步要執行的動作。

算法方面,D3QN的評估網絡共有四層網絡結構。算法的第一層為輸入層,共有四個輸入維度,分別是:當前車輛所在節點的序號、車內的實時容量、當前的時間以及當前調度車輛的序號。算法的第二層、第三層和第四層為隱藏層,它們都是有128個神經元結點的全連接層,使用ReLU函數進行激活。算法的第五層為輸出層,輸出層輸出的是對于各個動作的價值評估,輸出維度會隨著客戶數量的變化而變化。根據各個動作的價值,智能體選擇價值最高的動作采取下一步的行動。本文使用Adam優化器進行梯度下降法的求解。

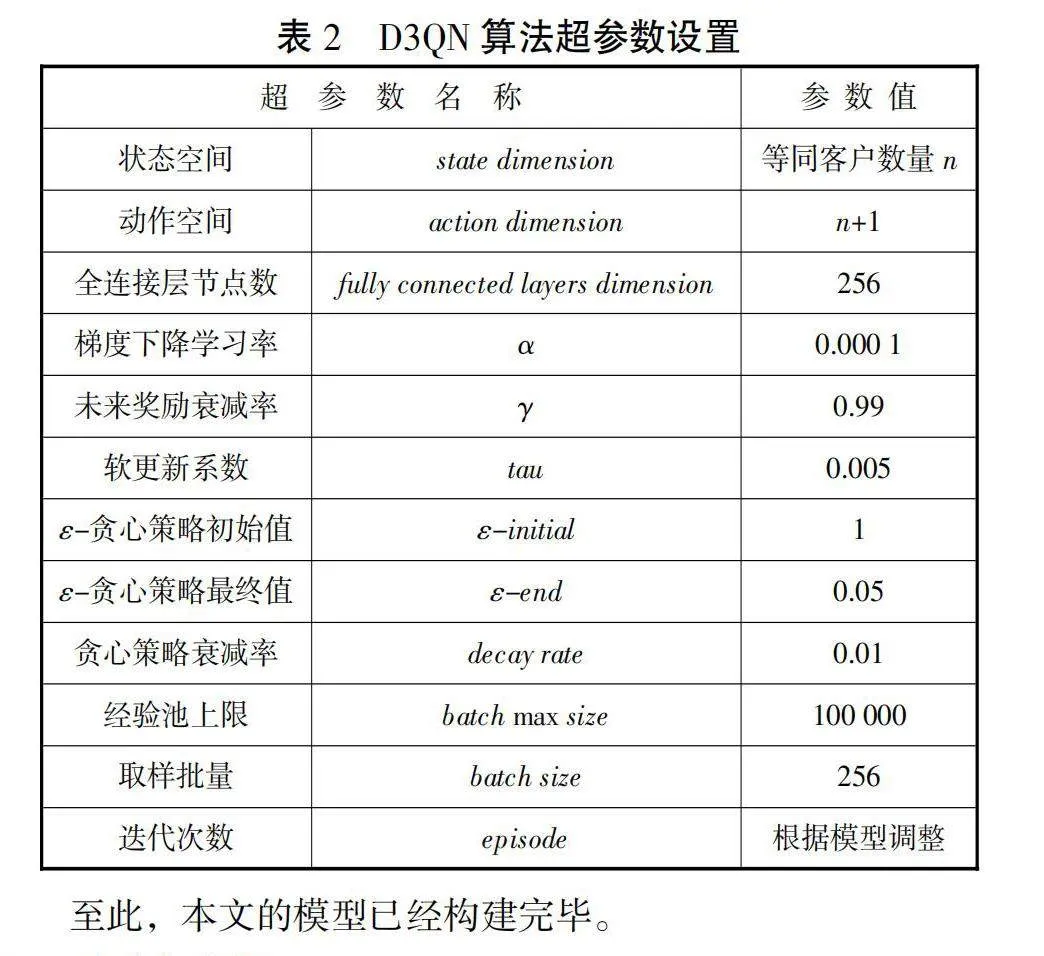

D3QN算法的超參數設置如表2所示。

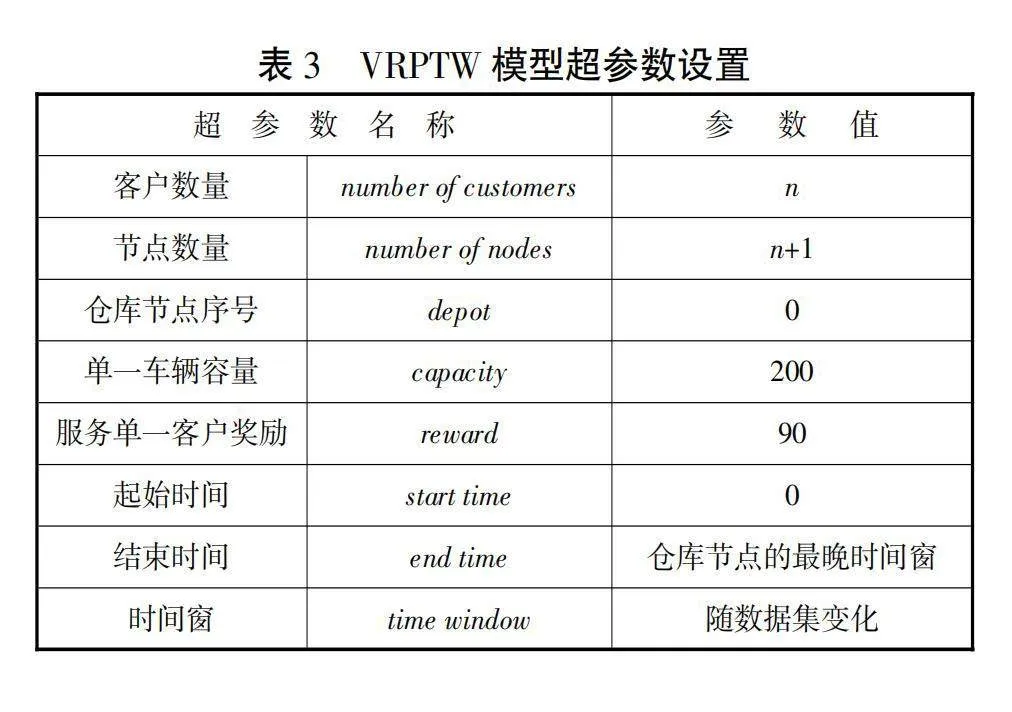

模型方面,借助gym庫,構建了VRPTW模型的虛擬環境,以便接入強化學習算法中進行訓練。本文選擇了客戶數量分別為10、20和50的多個數據集,分別代表小規模,中規模和大規模調度問題,以便驗證算法在不同規模上的性能。越大規模的問題,智能體獲得獎勵的函數趨近收斂所需要的實驗迭代次數越多。因此,針對不同規模的調度問題,本文也設置了不同的約束和實驗的迭代次數。模型的部分超參數如表3所示。

至此,本文的模型已經構建完畢。

3.2 實驗與分析

本文選擇了Double DQN以及Dueling DQN算法,將它們與D3QN算法在不同問題規模的數據集上進行對比實驗,以檢驗D3QN算法在解決此類問題上的優越性。

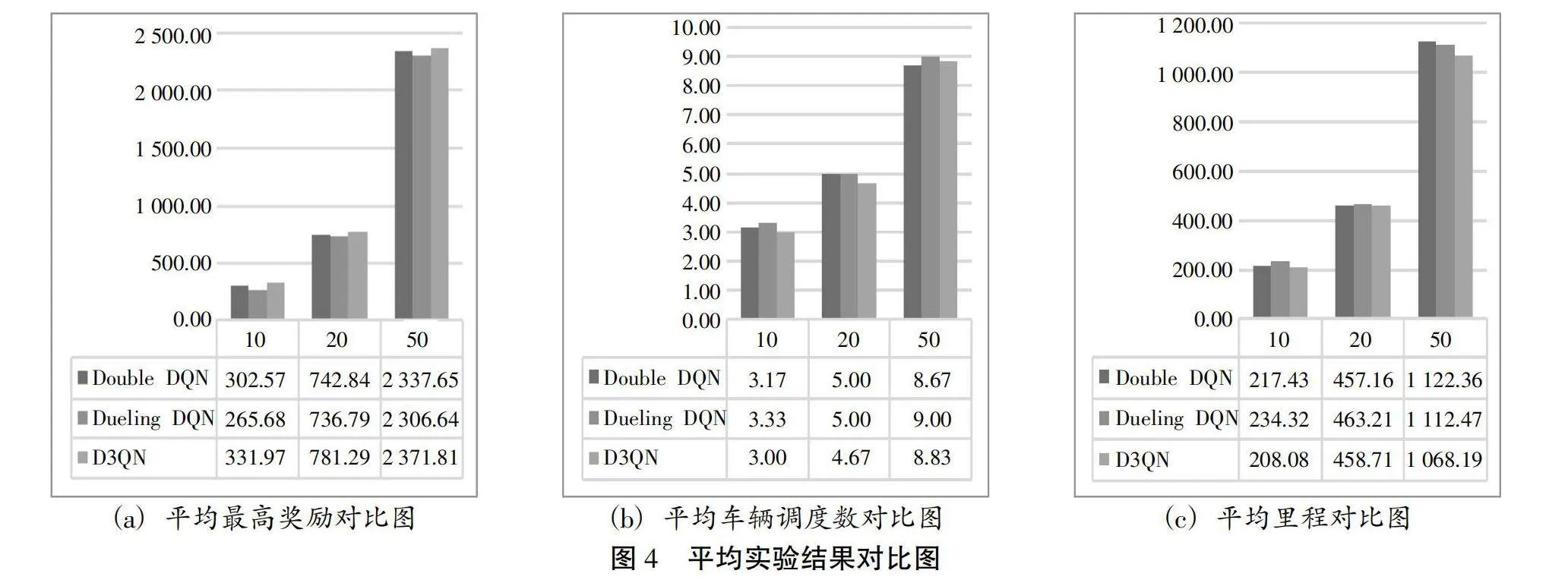

在表4所展示的18個不同規模的實驗結果中,有14個實例中,D3QN取得了最高的獎勵,占總實驗次數的77.8%。由于本文實驗的研究目標為:首先最小化調度車輛數量,其次最小化運輸距離。因此,基于研究問題的綠色性原則,取得最高獎勵的實驗案例,運輸里程未必最短。將三種算法在不同規模實例下的實驗結果進行平均取值,具體結果如圖4所示:

從圖4發現:在平均最高獎勵方面,D3QN算法比Double DQN高5.45%,比Dueling DQN高11.27%;在平均車輛調度數方面,D3QN算法比Double DQN低3.34%,比Dueling DQN低6.17%;在平均里程方面,D3QN算法比Double DQN低2.93%,比Dueling DQN低5.38%。

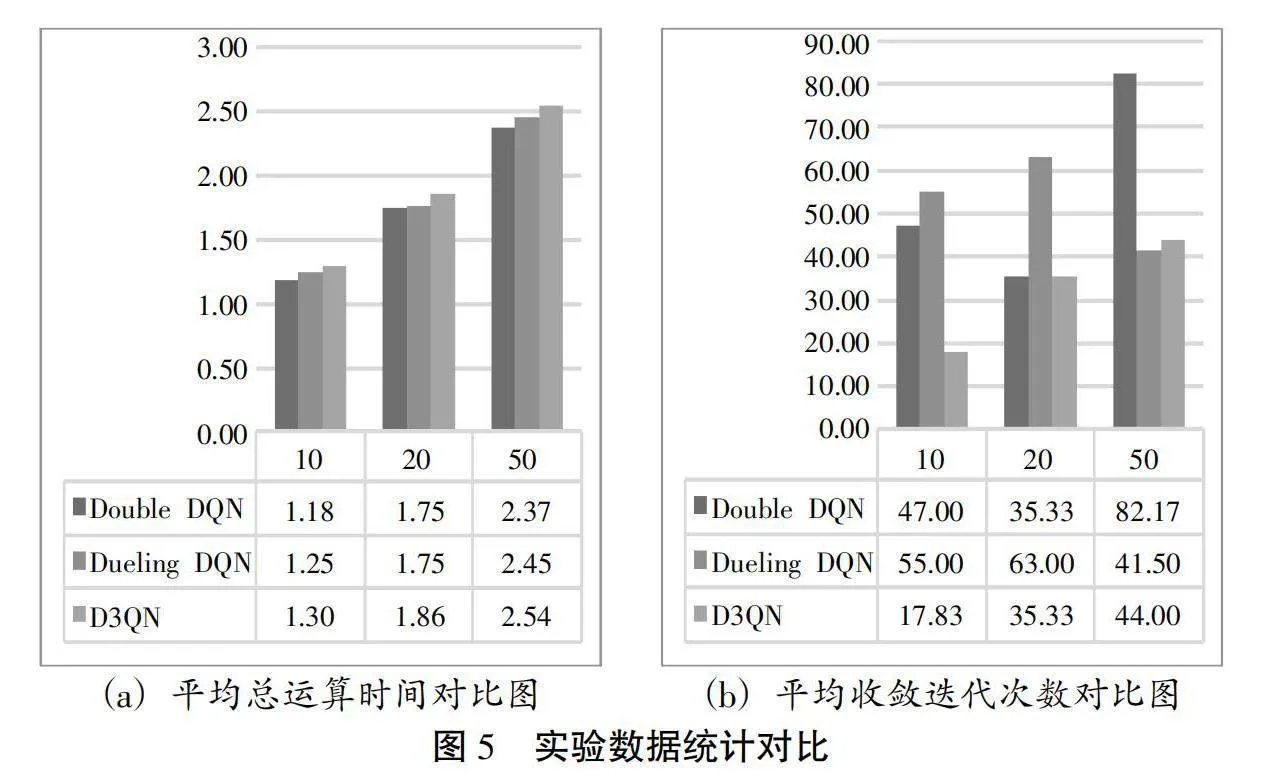

此外,本文還對實驗的總運算時間和收斂時的迭代次數兩個變量進行了統計,具體結果如表5所示:

?; 本文分別設置模型規模為10、20、50的算例的總迭代次數為100、200和300次。總體而言,三種算法總運算時間較短,收斂時的迭代次數較快。將統計數據進行平均取值,具體結果展示如圖5所示。

從圖5中發現:在平均總運算時間方面,D3QN比Double DQN多7.71%,絕對值為0.13s,比Dueling DQN多4.35%,絕對值為0.08s;在平均收斂迭代次數方面,D3QN比Double DQN少36.17%,比Dueling DQN少35.16%。造成這種結果的原因可能是算法的結構不同。D3QN算法作為后兩者算法的組合,其計算復雜度要更高,因而會耗費更長的時間。但是,從絕對數值的角度分析,D3QN多增加的運算時間平均保持在0.15s內,在實際應用中處于可接受范圍內。此外,由于D3QN算法比后兩者算法收斂速度要快,因此,在減少相同迭代次數的情況下,D3QN算法會比后兩者算法花費更少的時間收斂。

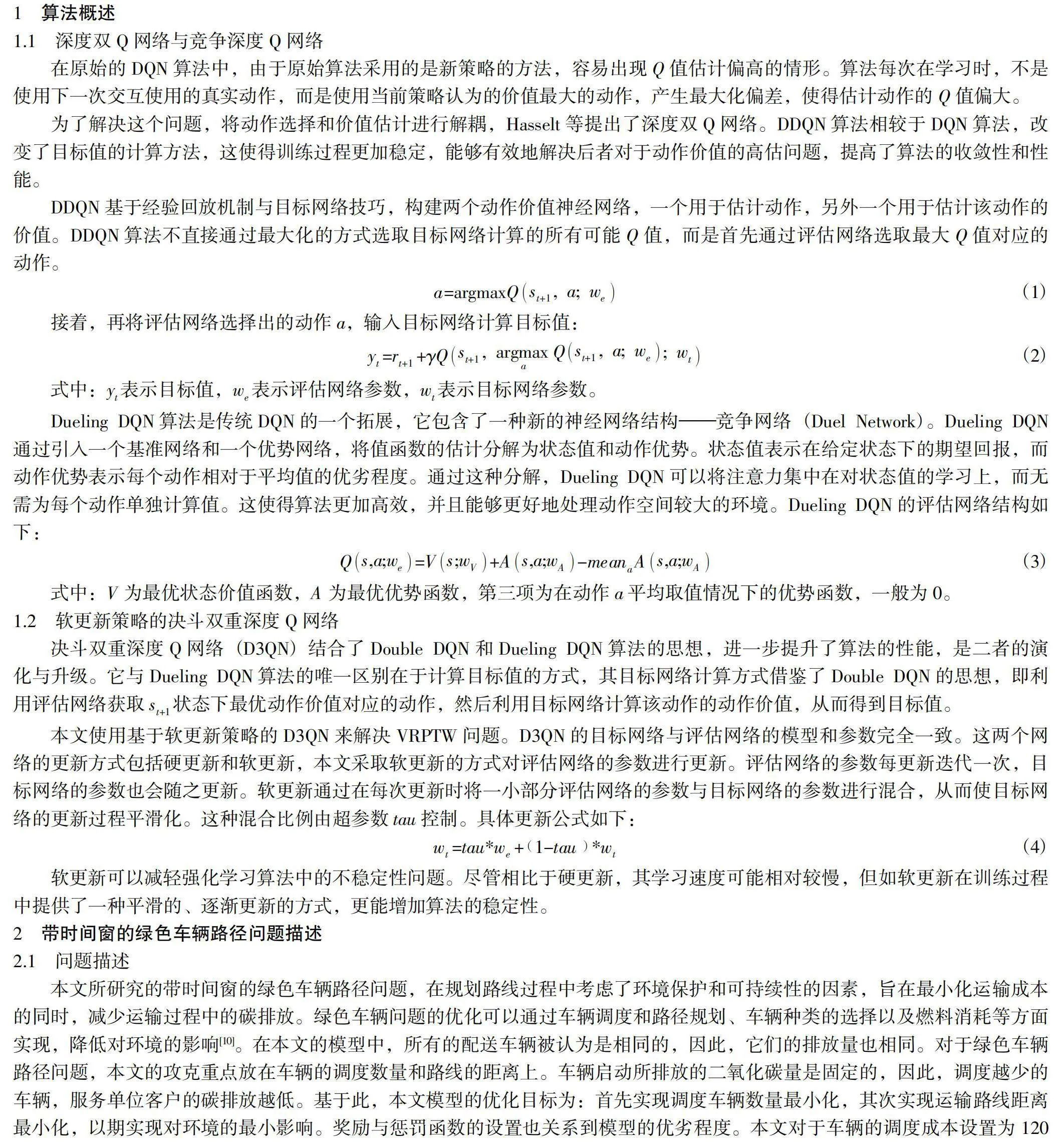

圖6展示了在客戶為50個的問題下,以C204數據進行實驗的三種算法的獎勵變化、調度車輛變化以及里程的變化。為了更直觀地展示實驗效果,本文設置實驗次數為150輪。在前40輪中,D3QN算法最高獎勵的上升速度較快,并且最先收斂。在此實例的實驗中,三種算法所得到的最高獎勵值接近,且用時均在2s以內。在圖6(c)中,里程變化是上下波動的,因為調度車輛的減少可能導致獎勵值和運輸里程的增加。這也印證了本文研究問題的綠色性。

通過上述表格以及圖,得出結論:在可接受的增加運算時間的情況下,基于軟更新策略的D3QN算法相比于Double DQN和Dueling DQN算法能更快的收斂,得出更優的解。在帶時間窗的綠色車輛路徑優化問題中,D3QN算法相比于后兩者算法更具備優越性。前者在算法層面結合了后者的優點。由于強化學習算法的探索具有一定的隨機性,算法的表現基于不同的算例可能有差異。同時,算法的表現也受到實驗參數、獎勵函數、訓練次數和深度以及計算機性能等方面因素的影響。隨著這些因素的不斷調整與優化,算法的表現也會越來越好。

4 結論與展望

本文使用基于軟更新策略的D3QN算法對帶時間窗的綠色車輛路徑問題進行研究,將車輛的調度問題轉化成顧客訪問的排序問題;通過設置獎勵函數,優先實現最小化調度車輛的目標,保證運輸的綠色低碳;借助Python中的gym庫,使算法的智能體與環境進行交互,重新規劃序列。D3QN算法結合了Double DQN和Dueling DQN算法的技巧。在大部分算例中,D3QN算法在此類問題上的表現要優于這二者,能更快地尋找到更優質量的解。

本文的主要貢獻如下:

(1)使用D3QN算法為帶時間窗的綠色車輛路徑問題設計了相應的動作空間與狀態空間和獎勵函數,能夠較好地將問題轉化為強化學習中智能體的運算與迭代。

(2)使用軟更新的策略對D3QN算法的評估網絡參數進行更新,能保證算法的穩定性和收斂性。

(3)在小、中、大的共18個數據集上進行了實驗,將Double DQN與Dueling DQN作為對比,驗證了D3QN算法的有效性。

綜上所述,D3QN算法在解決VRPTW問題上仍然有較大的潛力。隨著模型的優化和計算機算力的提升,該算法的性能也會進一步提升。

參考文獻:

[1] MNIH V, KAVUKCUOGLU K, SILVER D, et al. Playing atari with deep reinforcement learning[EB/OL]. (2021-12-19)[2023-09-20]. https://arXiv.org/pdf/1312.5602.pdf.

[2] SILVER D, HUANG A, MADDISON C, et al. Mastering the game of go with deep neural networks and tree search[J]. Nature, 2016,529:484-489.

[3] VAN HASSELT H, GUEZ A, SILVER D. Deep reinforcement learning with double q-learning[C] // Proceedings of the AAAI Conference on Artificial Lintelligence, 2016.

[4] WANG Z, SCHAUL T, HESSEL M, et al. Dueling network architectures for deep reinforcement learning[C] // International Conference on Machine Learning PMLR, 2016:1995-2003.

[5] 袁帥,張莉莉,顧琦然,等. 移動機器人優先采樣D3QN路徑規劃方法研究[J]. 小型微型計算機系統,2023,44(5):923-929.

[6] 韓磊,張輪,郭為安. 混合交通流環境下基于改進強化學習的可變限速控制策略[J]. 交通運輸系統工程與信息,2023,23(3):110-122.

[7] KOOL W, VAN HOOF H, WELLING M. Attention, learn to solve routing problems![EB/OL]. (2021-10-24)[2003-09-20]. https://github.com/wouterkool/attention-learn-to-route.

[8] NAZARI M, OROOJLOOY A, SNYDER L, et al. Reinforcement learning for solving the vehicle routing problem[EB/OL]. (2023-09-08)[2023-09-20]. https://github.com/optML Group/VRP-RL.

[9] LIN B, GHADDAR B, NATHWANI J. Deep reinforcement learning for the electric vehicle routing problem with time windows[J]. IEEE Transactions on Intelligent Transportation Systems, 2021,23(8):11528-11538.

[10] ASGHARI M, AL-E S M J M. Green vehicle routing problem: A state-of-the-art review[J]. International Journal of Production Economics, 2021,231:107899.

[11] SOLOMONMM. Vehicle routing and scheduling with time window constraints: Imodels and algorithms (heuris tics)[D]. University of Pennsylvania, 1984.

[12] SAVELSBERGH M W P. The vehicle routing problem with time windows: Minimizing route duration[J]. ORSA Journal on Computing, 1992,4(2):146-154.

[13] MARTIN DESROCHERS, JACQUES DESROSIERS, MARIUS SOLOMON. A new optimization algorithm for the vehicle routing problem with time windows[J]. Operations Research, 1992,40(2):342-354.

[14] K C TAN, L H LEE, K OU. Artificial intelligence heuristics insolving vehicle routing problems with time window constraints[J]. Engineering Applications of Artificial Intelligence, 2001,14(6):825-837.

[15] 劉虹慶,王世民. 基于強化學習的車輛路徑規劃問題研究[J]. 計算機應用與軟件,2021,38(8):303-308.

[16] SAMUEL A L. Some studies in machine learning using the game of checkers[J]. IBM Journal of Research and Development, 1959,3(3):210-229.

[17] WATKINS C J C H, DAYAN P. Q-learning[J]. Machine Learning, 1992(8):279-292.

[18] HUANG Y, WEI G L, WANG Y X. VD D3QN: The variant of double deep q-learning network with dueling architecture

[C] // 第37屆中國控制會議論文集(F),2018.

[19] KALLEHAUGE B, LARSEN J, MADSEN O B G, et al. Vehicle routing problem with time windows[M]. Springer US, 2005.

[20] 韓巖峰. 基于深度強化學習的無人物流車隊配送路徑規劃研究[D]. 大連:大連理工大學,2021.

[21] 周瑤瑤,李燁. 基于排序優先經驗回放的競爭深度Q網絡學習[J]. 計算機應用研究,2020,37(2):486-488.

[22] 馮超. 強化學習精要[M]. 北京:電子工業出版社,2018.

[23] 劉馳,王占健,戴子彭. 深度強化學習學術前沿與實戰應用[M]. 北京:機械工業出版社,2020.

[24] YANG S, XU Z, WANG J. Intelligent decision-making of scheduling for dynamic permutation flowshop via deep reinforcement learning[J]. Sensors, 2021,21(3):1019.

[25] 孫滬增,李章維,秦子豪,等. 帶時間窗車輛路徑規劃算法研究與實現[J]. 小型微型計算機7a4019138b4b6d4f1e2855f6b56a0e9290d1caf14133d0fb1134951c9679e173系統,2020(5):972-977.

[26] TICHA H B, ABSI N, FEILLET D, et al. Multigraph modeling and adaptive large neighborhood search for the vehicle routing problem with time windows[J]. Computers & Operations Research, 2019,104:113-122.

[27] 李茹楊,彭慧民,李仁剛,等. 強化學習算法與應用綜述[J]. 計算機系統應用,2020,29(12):17-29.

[28] BURSUC A, GUETTIER C, et al. Optimal solving of constrained path-planning problemswith graph convolutional networks and optimized tree search[C] // 2019 IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS), IEEE, 2019:3519-3525.