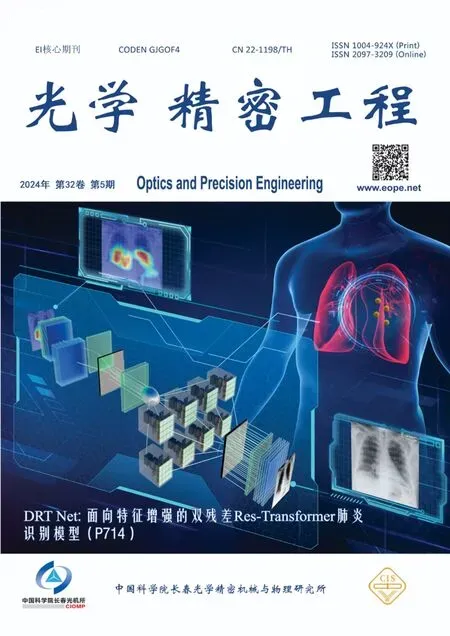

DRT Net:面向特征增強的雙殘差Res-Transformer肺炎識別模型

周 濤,彭彩月*,杜玉虎,黨 培,劉鳳珍,陸惠玲

(1.北方民族大學 計算機科學與工程學院,寧夏 銀川 750021;2.北方民族大學 圖像圖形智能處理國家民委重點實驗室,寧夏 銀川 750021;3.寧夏醫科大學 醫學信息與工程學院,寧夏 銀川 750004)

1 引言

肺炎作為一種常見的胸部疾病,是由微生物和其他環境因素引起的呼吸道感染。它導致肺部積液和呼吸困難,對人體的呼吸系統造成了嚴重的危害。2019 年下半年爆發的新型冠狀病毒感染(Corona Virus Disease2019,COVID-19),已影響全球人口的健康[1]。傳統的肺炎診斷手段主要依賴于醫生多年的臨床經驗,可能存在主觀誤差,且難以大規模實施。胸部影像學在肺部感染性病變的診斷中具有重要的價值,對患者進行療效評價可利用高分辨率胸部CT[2]及X 線檢查[3]。利用深度學習技術對患者肺部影像特征進行分析,從而進行病情評估,能夠降低復雜的醫學數據給醫務人員帶來的負擔,提高診斷效率,輔助醫生盡快形成針對性診療方案[4]。

殘差神經網絡(Residual Neural Network,ResNet)[5]廣泛應用在醫學圖像領域,目前在肺部疾病的臨床輔助診斷方面取得了良好的效果。Zhou 等[6]提出一種基于CT 圖像的改進的注意力ResNet 新冠肺炎識別模型,以適應新冠肺炎病灶區域的特性,實現對于新冠肺炎的識別。Chen等[7]提出一種基于Inception-ResNet的COVID-19診斷三分類模型,在Inception-Resnet 中使用自注意力機制對肺部病變進行分類,進一步提升了卷積神經網絡的分類性能。Huang 等[8]提出了一種名為非局部通道注意力ResNet 的深度學習神經網絡,將ResNet 與非局部模塊和信道注意力機制相結合,用于監測COVID-19 PN 患者的肺水腫程度,幫助臨床醫生為患者制定適當的治療方法。……