基于改進(jìn)EfficientNetV2網(wǎng)絡(luò)的腦腫瘤分類(lèi)方法

崔 博, 賈兆年, 姬 鵬, 李秀華, 侯阿臨

(長(zhǎng)春工業(yè)大學(xué) 計(jì)算機(jī)科學(xué)與工程學(xué)院, 長(zhǎng)春 130012)

醫(yī)學(xué)成像技術(shù)是非侵入性的, 常用于檢測(cè)腫瘤, 是目前用于癌癥類(lèi)型分類(lèi)最常見(jiàn)和最可靠的技術(shù)[1]. 磁共振成像(magnetic resonance imaging, MRI)技術(shù)是醫(yī)學(xué)成像技術(shù)的一種, 在腦腫瘤的分類(lèi)中尤其適用于提供高分辨率的腦組織圖像[2]. 腦腫瘤分為150種, 其中包括良性腫瘤和惡性腫瘤[3]. 腦腫瘤的早期診斷和準(zhǔn)確分類(lèi)對(duì)挽救病人生命至關(guān)重要, 腦部MRI圖像可分為不同的腫瘤類(lèi)型. 自動(dòng)分類(lèi)可以在放射科醫(yī)生最少干預(yù)的情況下對(duì)腦腫瘤MRI圖像進(jìn)行分類(lèi)[4].

卷積神經(jīng)網(wǎng)絡(luò)(convolutional neural networks, CNN)是深度學(xué)習(xí)的主要代表算法之一. Shelhamer等[5]提出了一種深度、 粗層和細(xì)層相結(jié)合的雙路徑CNN跳躍結(jié)構(gòu), 實(shí)現(xiàn)了對(duì)腦癌的精確分割. Cheng等[6]利用T1-MRI數(shù)據(jù)研究了腦腫瘤的三級(jí)分類(lèi)問(wèn)題, 該方法先利用圖像膨脹擴(kuò)大腫瘤區(qū)域, 然后將其劃分為逐漸細(xì)小的環(huán)狀子區(qū)域. Das等[7]使用包含3 064張T1加權(quán)對(duì)比增強(qiáng)MRI圖像的卷積神經(jīng)網(wǎng)絡(luò)識(shí)別各種腦癌, 如膠質(zhì)瘤、 腦膜瘤和腦垂體瘤. CNN模型通過(guò)基于可變大小的卷積濾波器/核調(diào)整卷積網(wǎng)絡(luò)的大小, 獲得了94%的準(zhǔn)確率. Bad?a等[8]提出了一種新的CNN結(jié)構(gòu), 該結(jié)構(gòu)基于對(duì)現(xiàn)有的預(yù)訓(xùn)練網(wǎng)絡(luò)的改進(jìn), 使用T1加權(quán)對(duì)比增強(qiáng)磁共振圖像對(duì)腦腫瘤進(jìn)行分類(lèi), 該模型的準(zhǔn)確率為96.56%, 其由兩個(gè)10倍交叉驗(yàn)證技術(shù)組成, 使用增強(qiáng)圖片. Mzoughi等[9]采用基于灰度歸一化和自適應(yīng)對(duì)比度增強(qiáng)的預(yù)處理方法, 提出了一種完全自動(dòng)化的腦膠質(zhì)瘤三維細(xì)胞神經(jīng)網(wǎng)絡(luò)模型, 用于腦膠質(zhì)瘤的低級(jí)別和高級(jí)別分類(lèi).

深度學(xué)習(xí)中的CNN是目前較好的圖像處理方法[10]. AlexNet[11],VGG[12]等CNN的發(fā)展證明了增加網(wǎng)絡(luò)深度能在一定程度上提高網(wǎng)絡(luò)性能. 但卷積核作為其中數(shù)量最多的參數(shù), 對(duì)網(wǎng)絡(luò)性能的影響較大[13]. 若只通過(guò)簡(jiǎn)單的網(wǎng)絡(luò)層堆疊增加深度會(huì)導(dǎo)致網(wǎng)絡(luò)出現(xiàn)梯度消失和過(guò)擬合的情況[14]. 為解決這類(lèi)問(wèn)題, 本文提出基于改進(jìn)EfficientnetV2網(wǎng)絡(luò)的方法, 實(shí)驗(yàn)結(jié)果表明, 與其他算法相比, 將其運(yùn)用到腦腫瘤分類(lèi)的任務(wù)中, 準(zhǔn)確率更高.

1 模型架構(gòu)

1.1 EfficientNetV2網(wǎng)絡(luò)模型

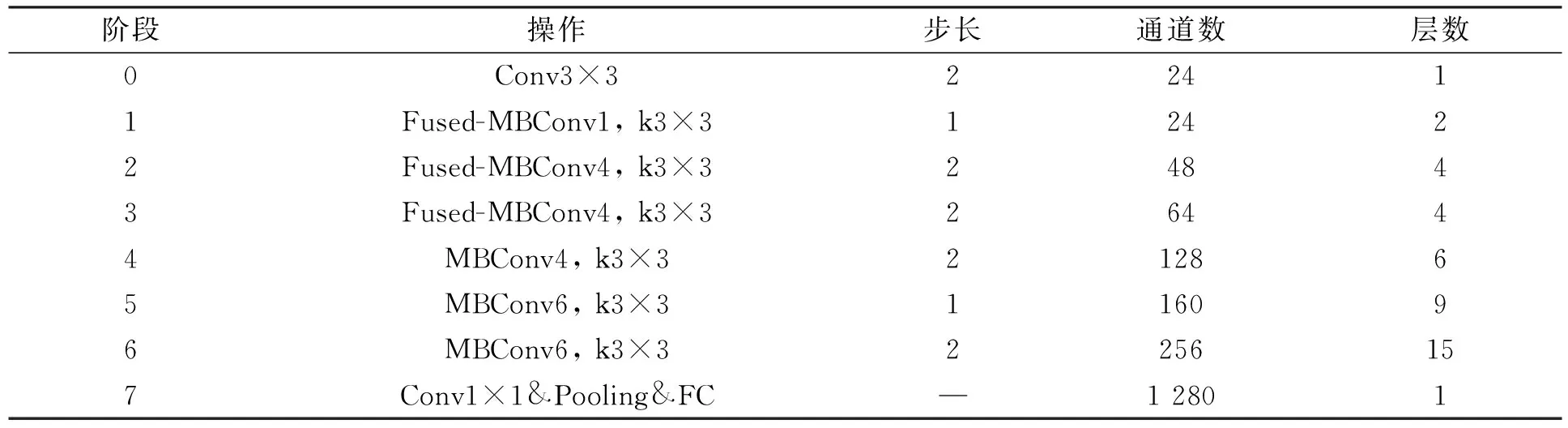

EffcicentNetV2[15]是根據(jù)EfficientNet[16]的基本思想進(jìn)行改進(jìn)的網(wǎng)絡(luò). 該網(wǎng)絡(luò)通過(guò)改變網(wǎng)絡(luò)的深度、 寬度和輸入圖像分辨率的參數(shù)提高網(wǎng)絡(luò)性能[16]. EfficientNetV2是一種采用神經(jīng)結(jié)構(gòu)搜索技術(shù)(neural architecture search, NAS)和復(fù)合模型擴(kuò)張方法的分類(lèi)識(shí)別網(wǎng)絡(luò), 它能選擇最優(yōu)的復(fù)合系數(shù), 即按比例擴(kuò)展網(wǎng)絡(luò)的深度、 寬度和輸入圖像分辨率3個(gè)維度, 以找到最大識(shí)別特征精度所需的最優(yōu)參數(shù). EfficientNetV2通過(guò)自適應(yīng)地平衡3個(gè)維度, 成功減少了模型訓(xùn)練的參數(shù)量和復(fù)雜度, 從而大幅度提高了模型性能. 與單一維度的縮放相比, 這種方法能獲得更好的效果, 同時(shí)在訓(xùn)練速度上也有明顯的提升. EffcicentNetV2網(wǎng)絡(luò)主要由Fused-MBConv[17]和MBConv模塊堆疊而成, 網(wǎng)絡(luò)結(jié)構(gòu)列于表1.

表1 EfficientNetV2網(wǎng)絡(luò)結(jié)構(gòu)Table 1 EfficientNetV2 network architecture

理論上, 隨著硬件設(shè)備的優(yōu)化和算法設(shè)計(jì)的改進(jìn), 普通卷積在某些條件下可能會(huì)比之前更有效. 為驗(yàn)證這兩者對(duì)卷積計(jì)算速度的影響, 在淺層卷積使用Fused-MBConv, 在深層卷積使用深度可分離卷積MBConv.

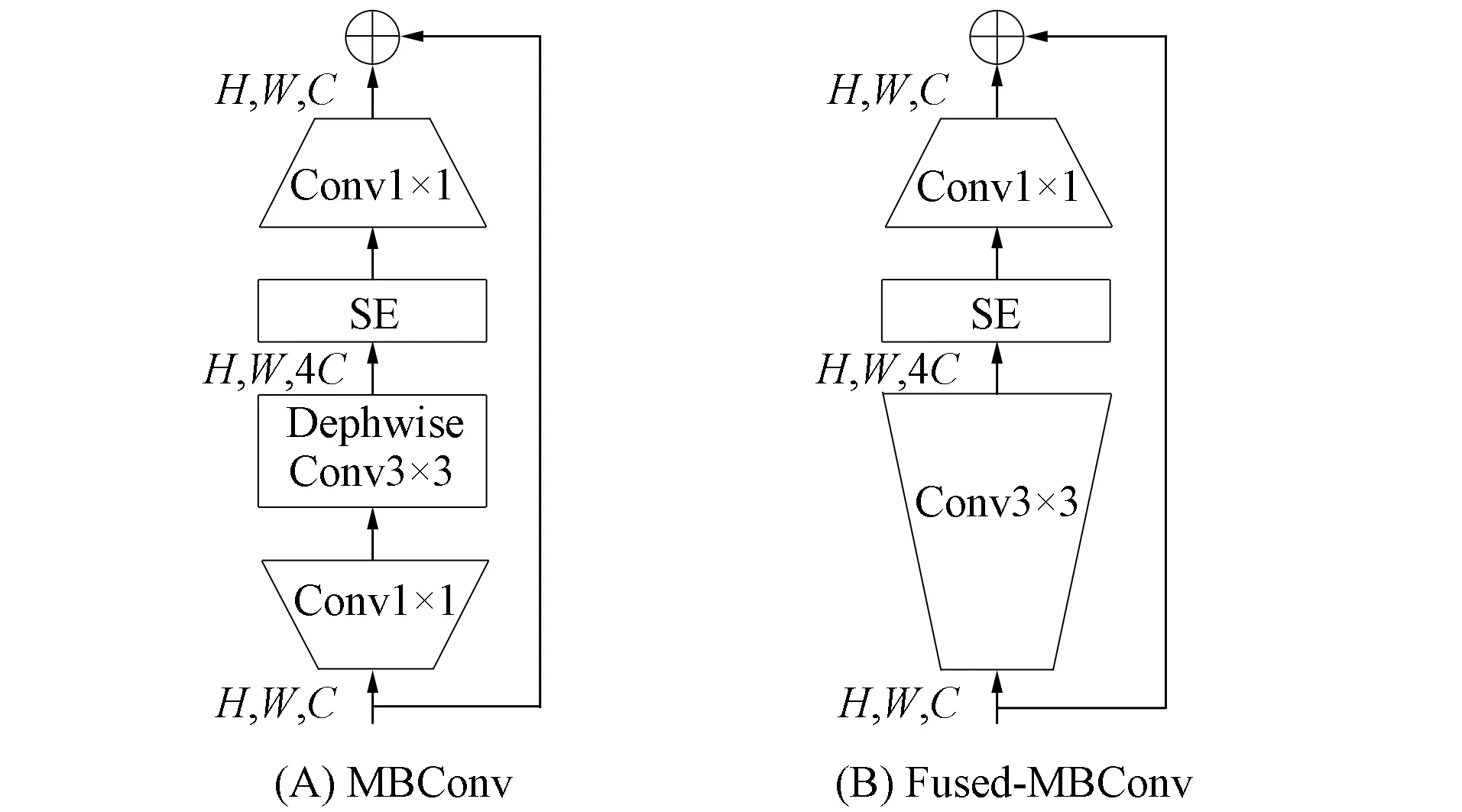

為使網(wǎng)絡(luò)運(yùn)算速度更快, 該網(wǎng)絡(luò)在淺層卷積中使用Fused-MBConv模塊, 在深層卷積中使用深度可分離卷積MBConv模塊, MBConv模塊由2個(gè)1×1卷積、 1個(gè)3×3深度可分離卷積、 SE(squeeze-and-excitation)注意力模塊組成, 如圖1(A)所示; 由于深度可分離卷積用在淺層卷積中會(huì)拖慢運(yùn)行速度, 因此Fused-MBConv模塊是在MBConv中使用一個(gè)普通的3×3卷積結(jié)構(gòu)替換1×1的升維卷積和3×3的深度卷積, 如圖1(B)所示.

圖1 模塊結(jié)構(gòu)Fig.1 Module structure

SE注意力模塊由全局平均池化和兩個(gè)全連接層組成. 該模塊首先進(jìn)行Squeeze操作, 將每個(gè)通道的特征壓縮為全局特征, 然后通過(guò)Excitation操作將全局特征轉(zhuǎn)化為權(quán)重系數(shù), 從而實(shí)現(xiàn)模型對(duì)不同通道間特征的區(qū)分.

1.2 坐標(biāo)注意力機(jī)制

坐標(biāo)注意力(coordinate attention, CA)機(jī)制[18]是一種新型輕量級(jí)即插即用的注意力機(jī)制, 它可以很容易地插入到移動(dòng)網(wǎng)絡(luò)的經(jīng)典模塊中, 不僅可獲取通道的輸入特征信息, 還可獲取方向和位置的特征信息, 有助于模型更準(zhǔn)確地定位和識(shí)別感興趣的對(duì)象, 重點(diǎn)關(guān)注重要信息的目標(biāo)區(qū)域, 有效抑制背景信息給檢測(cè)結(jié)果產(chǎn)生的影響, 緩解信息丟失問(wèn)題[19]. 并且同時(shí)考慮水平和垂直方向的特征信息, 在可學(xué)習(xí)參數(shù)和計(jì)算代價(jià)相當(dāng)?shù)那闆r下, 坐標(biāo)信息嵌入更有助于圖像分類(lèi). CA結(jié)構(gòu)如圖2所示.

圖2 CA機(jī)制模塊Fig.2 CA mechanism module

2 本文算法設(shè)計(jì)

2.1 改進(jìn)的網(wǎng)絡(luò)結(jié)構(gòu)

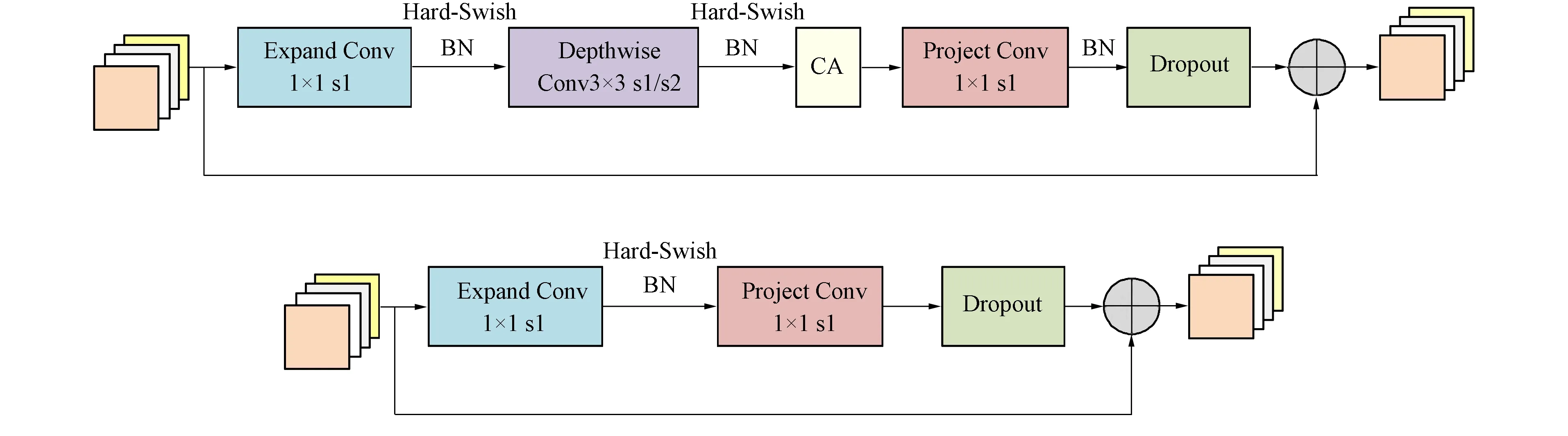

由于人的大腦組織結(jié)構(gòu)復(fù)雜, 因此要想將腦部腫瘤精確分類(lèi), 就要精準(zhǔn)地獲取輸入的腦腫瘤MRI圖像的特征信息. EfficientNetV2網(wǎng)絡(luò)模型中MBConv模塊加入了SE注意力機(jī)制, SE注意力機(jī)制只考慮對(duì)通道間信息進(jìn)行編碼, 而忽略了位置信息的重要性, 導(dǎo)致注意力機(jī)制提取腦腫瘤的特征信息不全面, 從而使模型的分類(lèi)精準(zhǔn)度較低. 而CA注意力模塊恰好可以更準(zhǔn)確地獲取輸入的位置特征信息, 有助于網(wǎng)絡(luò)更準(zhǔn)確地定位感興趣的對(duì)象, 同時(shí)使網(wǎng)絡(luò)覆蓋更大的區(qū)域. 坐標(biāo)注意力模塊可以自適應(yīng)地選擇輸入腦腫瘤圖像的感受野大小和位置, 使其能更好地適應(yīng)不同尺度和形狀的輸入圖像, 從而提高腦腫瘤分類(lèi)模型的魯棒性和泛化能力, 因此將SE注意力模塊替換為CA注意力模塊. 在替換時(shí), 需要保持注意力模塊的輸入和輸出維度不變, 以保證模型的正確性. 為使該網(wǎng)絡(luò)計(jì)算速度更快, 對(duì)量化更友好, 進(jìn)一步提高腦腫瘤分類(lèi)的正確率, 本文將原網(wǎng)絡(luò)中的SiLU激活函數(shù)換為Hard-Swish激活函數(shù), 改進(jìn)后的網(wǎng)絡(luò)結(jié)構(gòu)如圖3所示.

圖3 改進(jìn)后的網(wǎng)絡(luò)結(jié)構(gòu)Fig.3 Improved network structure

該實(shí)驗(yàn)?zāi)X腫瘤MRI圖像的樣本數(shù)量較少, 網(wǎng)絡(luò)中用Dropout層減少訓(xùn)練網(wǎng)絡(luò)中部分神經(jīng)元的活性, 以防止網(wǎng)絡(luò)過(guò)擬合的發(fā)生, BN(batch normalization)[20]通過(guò)減少梯度對(duì)參數(shù)或其初始值尺度的依賴, 從而能使用更高的學(xué)習(xí)率, 極大加快了深層神經(jīng)網(wǎng)絡(luò)的訓(xùn)練速度.

2.2 激活函數(shù)

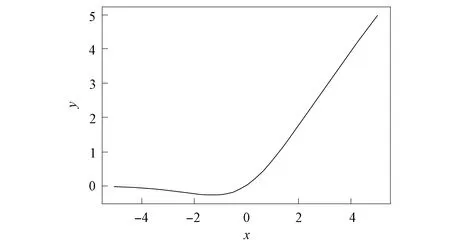

在原EfficientNetV2網(wǎng)絡(luò)使用的SiLU激活函數(shù)是Swish激活函數(shù)的一個(gè)特例, 當(dāng)β=1時(shí), Swish激活函數(shù)稱(chēng)為SiLU激活函數(shù). 該激活函數(shù)存在一些潛在的缺點(diǎn): SiLU激活函數(shù)的導(dǎo)數(shù)對(duì)于較大的負(fù)輸入可能會(huì)變得非常小, 可能導(dǎo)致反向傳播期間梯度消失. 對(duì)于深度神經(jīng)網(wǎng)絡(luò), 會(huì)導(dǎo)致訓(xùn)練變得困難; 雖然SiLU是一種靈活的激活函數(shù), 但它表達(dá)能力有限, 可能會(huì)限制其在數(shù)據(jù)中表示復(fù)雜函數(shù)和模式的能力; SiLU激活函數(shù)缺乏可解釋性, 與其他一些激活函數(shù)(如Sigmoid或雙曲正切)不同, SiLU函數(shù)沒(méi)有明確的概率解釋, 可能會(huì)使解釋模型的行為和輸出的含義變得更困難. SiLU激活函數(shù)曲線如圖4所示.

圖4 SiLU激活函數(shù)曲線Fig.4 SiLU activation function curve

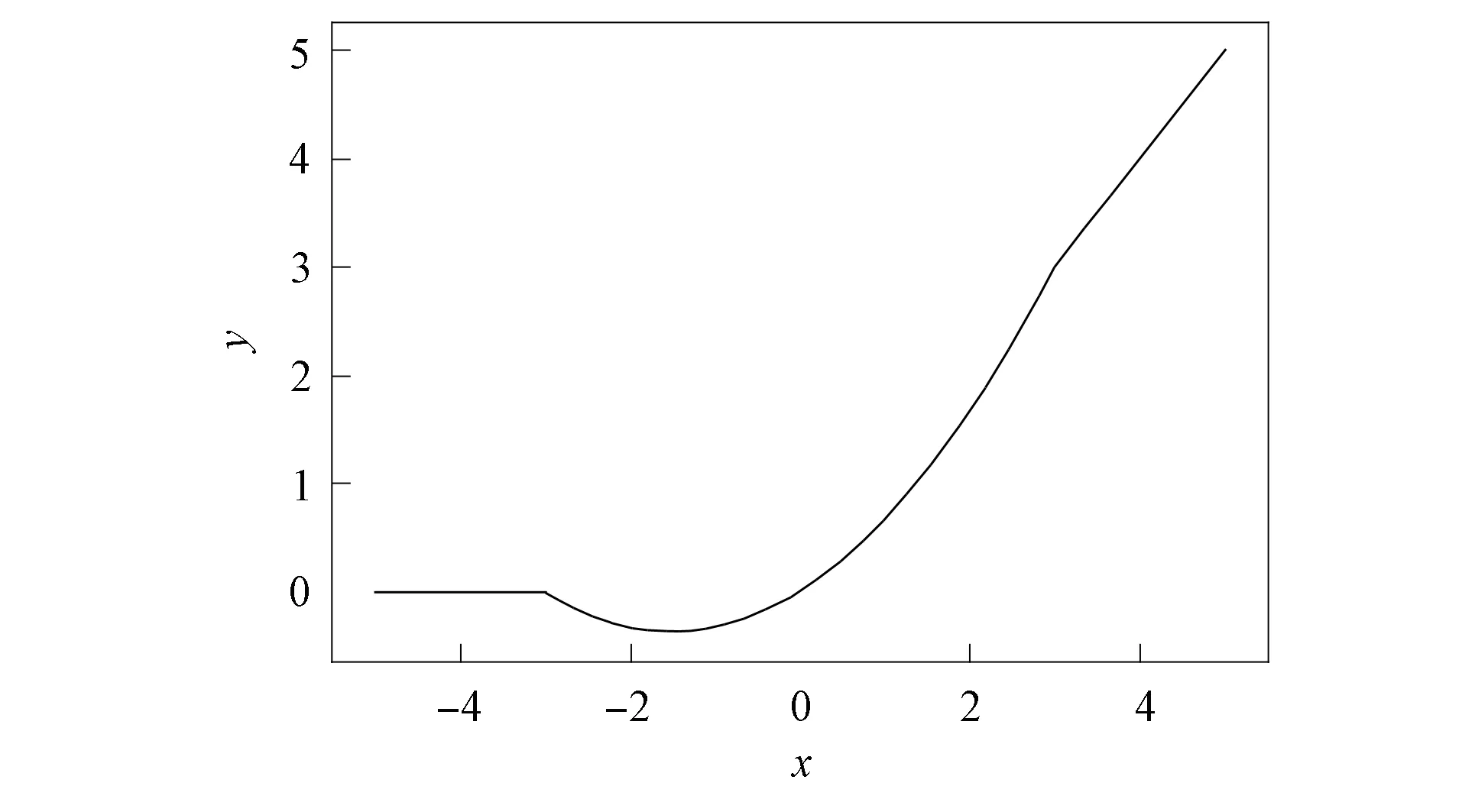

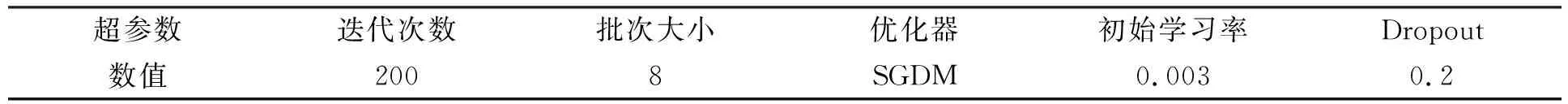

Hard-Swish激活函數(shù)[21]是Swish激活函數(shù)非線性改進(jìn)版本, 其計(jì)算速度更快, 計(jì)算過(guò)程只涉及基本的數(shù)學(xué)運(yùn)算, 如乘法和加法, 實(shí)現(xiàn)相對(duì)簡(jiǎn)單, 而SiLU涉及指數(shù)運(yùn)算, 計(jì)算速度相對(duì)較慢. 并且Hard-Swish激活函數(shù)對(duì)量化更友好, 更適合深度卷積網(wǎng)絡(luò), 同時(shí)也可增加腦腫瘤分類(lèi)的正確率. 因此本文將原網(wǎng)絡(luò)中的SiLU激活函數(shù)換為Hard-Swish激活函數(shù). Hard-Swish激活函數(shù)曲線如圖5所示.

圖5 Hard-Swish激活函數(shù)曲線Fig.5 Hard-Swish activation function curve

訓(xùn)練卷積網(wǎng)絡(luò)時(shí), 在梯度下降的過(guò)程中, 梯度消失是一個(gè)常見(jiàn)的問(wèn)題. 相比于SiLU激活函數(shù), Hard-Swish激活函數(shù)在輸入接近于0時(shí)的梯度更大, 因此在這種情況下出現(xiàn)梯度消失問(wèn)題的概率更小. Hard-Swish激活函數(shù)更復(fù)雜, 因此在訓(xùn)練深層神經(jīng)網(wǎng)絡(luò)時(shí)可以更好地捕捉特征, 從而提高訓(xùn)練效果.

Swish函數(shù)表達(dá)式為

Swish(x)=x×Sigmoid(βx),

(1)

其中β表示可調(diào)參數(shù). Hard-Swish函數(shù)表達(dá)式為

(2)

3 實(shí)驗(yàn)與分析

3.1 數(shù)據(jù)集與預(yù)處理

本文使用的腦腫瘤圖像數(shù)據(jù)集來(lái)自公開(kāi)數(shù)據(jù)集figshare(www.figshare.com), 該數(shù)據(jù)集由233名患者的腦部MRI圖像組成, 包括橫斷面、 冠狀面和矢狀面共3 064張圖像, 其中腦膜瘤切片708張, 膠質(zhì)瘤切片1 426張, 垂體瘤切片930張.

本文預(yù)處理首先將腦腫瘤圖像數(shù)據(jù)集中的每張圖像調(diào)整尺寸大小至512像素×512像素; 其次將MRI圖像原始數(shù)據(jù)信息進(jìn)行特征提取, 得到帶有標(biāo)簽的樣本集合; 最后將數(shù)據(jù)集按照80%和20%劃分為訓(xùn)練集和驗(yàn)證集. 分類(lèi)標(biāo)簽包括腦膜瘤、 膠質(zhì)瘤、 垂體瘤3種類(lèi)別標(biāo)簽.

3.2 參數(shù)設(shè)置與評(píng)價(jià)指標(biāo)

3.2.1 實(shí)驗(yàn)環(huán)境

本文實(shí)驗(yàn)基于PyTorch深度學(xué)習(xí)框架, 使用Python 3.6語(yǔ)言實(shí)現(xiàn), 搭建了基于改進(jìn)EfficientNetV2網(wǎng)絡(luò)的腦腫瘤圖像三分類(lèi)框架. 在Linux CentOS7環(huán)境下完成, CUDA版本為10.2. 硬件設(shè)備為: Intel(R) Xeon(R) CPU E5-2650 2.2 GHz CPU, NVIDIA TITAN XP×2顯卡, 12 GB×2顯存.

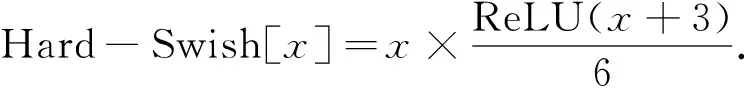

3.2.2 參數(shù)設(shè)置

在訓(xùn)練過(guò)程中, 本文實(shí)驗(yàn)使用隨機(jī)梯度下降(SGDM)優(yōu)化器優(yōu)化所設(shè)計(jì)的模型, 網(wǎng)絡(luò)模型訓(xùn)練過(guò)程中涉及的超參數(shù)設(shè)置列于表2.

表2 訓(xùn)練過(guò)程的超參數(shù)設(shè)置Table 2 Hyperparameter settings for training process

因?yàn)閮H憑準(zhǔn)確率評(píng)價(jià)指標(biāo)并不能充分證明網(wǎng)絡(luò)設(shè)計(jì)及參數(shù)調(diào)整的合理性, 因此, 為全面評(píng)價(jià)本文改進(jìn)的EfficientNetV2網(wǎng)絡(luò)的性能, 使用準(zhǔn)確率和混淆矩陣作為評(píng)價(jià)指標(biāo). 混淆矩陣是一種用于總結(jié)分類(lèi)算法性能的技術(shù). 如果每個(gè)類(lèi)別中的觀察數(shù)不相等, 或者數(shù)據(jù)集中有兩個(gè)以上類(lèi)別, 則僅憑分類(lèi)準(zhǔn)確性可能會(huì)產(chǎn)生誤導(dǎo). 混淆矩陣提供真陽(yáng)性(TP), 即預(yù)測(cè)為正、 事實(shí)為正; 真陰性(TN), 即預(yù)測(cè)為負(fù)、 事實(shí)為負(fù); 假陽(yáng)性(FP), 即預(yù)測(cè)為正、 事實(shí)為負(fù); 假陰性(FN), 即預(yù)測(cè)為負(fù)、 事實(shí)為正的值.

在經(jīng)過(guò)準(zhǔn)確率和混淆矩陣進(jìn)行網(wǎng)絡(luò)模型評(píng)估后, 這些值可用于計(jì)算本文算法的準(zhǔn)確率、 精確度、 召回率和F1-Score的數(shù)值[22-23]. 其中F1-Score是準(zhǔn)確率和召回率的調(diào)和平均評(píng)估指標(biāo)[24]. 本文用這5個(gè)評(píng)價(jià)指標(biāo)作為實(shí)驗(yàn)結(jié)果的評(píng)判標(biāo)準(zhǔn).

準(zhǔn)確率表示所有預(yù)測(cè)正確的樣本占總樣本的百分?jǐn)?shù), 用公式表示為

(3)

精確度表示預(yù)測(cè)正確的正類(lèi)樣本占所有預(yù)測(cè)為正類(lèi)樣本的百分?jǐn)?shù), 用公式表示為

(4)

召回率表示預(yù)測(cè)正確的正類(lèi)樣本占所有事實(shí)正類(lèi)樣本情況的百分?jǐn)?shù). 召回率在醫(yī)學(xué)圖像分類(lèi)問(wèn)題中又被稱(chēng)為靈敏度, 靈敏度越高, 說(shuō)明對(duì)病灶區(qū)域越敏感, 用公式表示為

(5)

F1-Score表示精確率和召回率的調(diào)和平均數(shù), 綜合考慮了精確率和召回率, 是一個(gè)綜合評(píng)價(jià)指標(biāo), 通常被用作分類(lèi)模型性能的重要指標(biāo)之一[25], 用公式表示為

(6)

3.3 實(shí)驗(yàn)結(jié)果與分析

為證明本文基于改進(jìn)的EfficientNetV2網(wǎng)絡(luò)的MRI腦腫瘤圖像分類(lèi)算法的有效性, 實(shí)驗(yàn)選擇引入坐標(biāo)注意力機(jī)制的分類(lèi)模型, 模型中還結(jié)合了Hard-Swish激活函數(shù)、 BN以及Dropout層. 同時(shí)選擇了SE,CBAM(convolutional block attention module)和ECA(efficient channel attention)注意力模塊進(jìn)行對(duì)比實(shí)驗(yàn), 觀察模型算法并進(jìn)行分析.

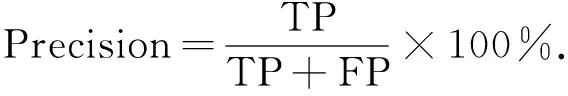

數(shù)據(jù)集上訓(xùn)練和驗(yàn)證過(guò)程的準(zhǔn)確率和損失函數(shù)曲線如圖6所示, 其中: 灰色曲線表示EfficientNetV2原模型中引入的SE注意力模塊的訓(xùn)練曲線; 橙色、 綠色曲線分別表示將EfficientNetV2模型中的SE替換為CBAM和ECA; 紫色曲線為本文改進(jìn)的引入CA注意力模塊的訓(xùn)練曲線. 將改進(jìn)的EfficientNetV2模型稱(chēng)CA-EfficientNetV2模型. 準(zhǔn)確率的變化曲線能反應(yīng)模型訓(xùn)練過(guò)程中對(duì)腦腫瘤的分類(lèi)精度, 準(zhǔn)確率的值越高表示模型的分類(lèi)正確率越高. 損失值的變化曲線能反應(yīng)模型訓(xùn)練過(guò)程中的優(yōu)化結(jié)果, 損失值越小表示模型的魯棒性越好, 當(dāng)損失值趨于平穩(wěn)時(shí), 表示模型訓(xùn)練達(dá)到了局部最優(yōu)值.

圖6 訓(xùn)練和驗(yàn)證的準(zhǔn)確率和損失函數(shù)曲線Fig.6 Accuracy and loss function curves for training and validation

由圖6可見(jiàn): 在訓(xùn)練過(guò)程中4種模型的訓(xùn)練效果均較穩(wěn)定, 但CA-EfficientNetV2模型的精度明顯高于其他3種模型, 達(dá)到了98.9%, 損失函數(shù)值明顯低于其他3種模型, 達(dá)到了0.022; 在驗(yàn)證過(guò)程中, CA-EfficientNetV2模型的準(zhǔn)確率有明顯提升, 訓(xùn)練曲線平穩(wěn)且收斂效果好, 達(dá)到了98.4%, 其他3種模型訓(xùn)練過(guò)程中的振蕩較嚴(yán)重, 且準(zhǔn)確率明顯低于CA-EfficientNetV2模型; 在損失函數(shù)值上, 其他3種模型訓(xùn)練過(guò)程中的振蕩極其嚴(yán)重, 而CA-EfficientNetV2模型的訓(xùn)練過(guò)程較穩(wěn)定, 雖有輕微振蕩, 但不影響實(shí)驗(yàn)結(jié)果, 并且損失函數(shù)值低于其他模型.

總體分析CA-EfficientNetV2模型的訓(xùn)練曲線, 由圖6(A)和(B)可見(jiàn), 模型在前100輪保持穩(wěn)定的上升趨勢(shì), 在后100輪準(zhǔn)確率保持穩(wěn)定, 說(shuō)明模型得到了擬合. 由圖6(C)和(D)可見(jiàn), 模型在前40輪下降速度較快, 在后面的輪數(shù)中下降趨于平緩, 最后保持穩(wěn)定, 說(shuō)明模型在訓(xùn)練過(guò)程中得到收斂. 因此可證明CA-EfficientNetV2模型對(duì)腦腫瘤有良好的分類(lèi)效果.

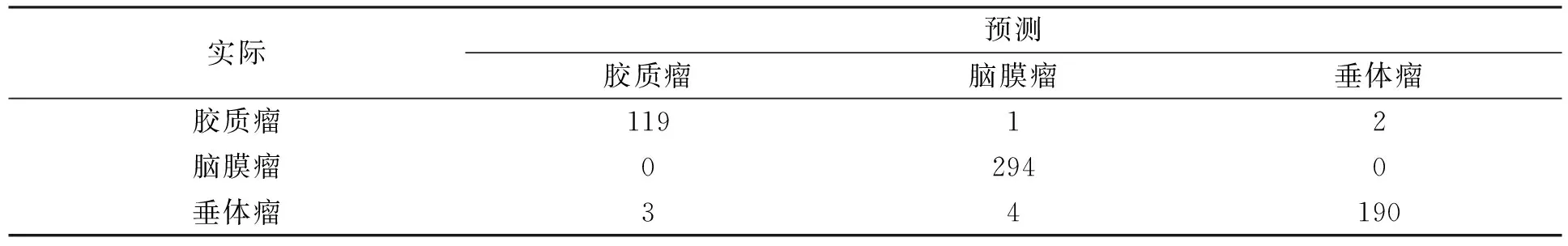

為更清楚地表達(dá)CA-EfficientNetV2網(wǎng)絡(luò)對(duì)每個(gè)類(lèi)別的預(yù)測(cè)結(jié)果, 也為更準(zhǔn)確、 更方便地計(jì)算評(píng)判模型的評(píng)價(jià)指標(biāo), 本文給出了腦腫瘤圖像數(shù)據(jù)集在該模型下預(yù)測(cè)結(jié)果的混淆矩陣, 結(jié)果列于表3. 在混淆矩陣中, 從左上到右下的對(duì)角線表明每個(gè)類(lèi)別正確預(yù)測(cè)的個(gè)數(shù), 對(duì)角線上的數(shù)量越多, 說(shuō)明模型對(duì)驗(yàn)證集數(shù)據(jù)的預(yù)測(cè)效果越好, 以此進(jìn)一步評(píng)估模型的性能.

表3 預(yù)測(cè)結(jié)果的混淆矩陣Table 3 Confusion matrix for prediction results

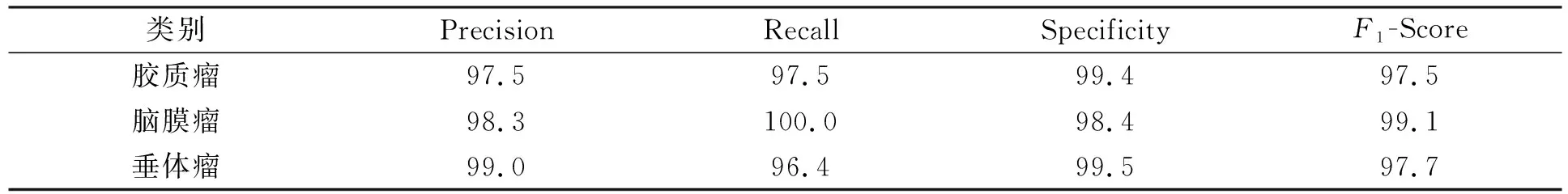

由表3可見(jiàn): 122例腦膜瘤中只有3例被錯(cuò)誤預(yù)測(cè)為垂體瘤; 299例腦膠質(zhì)瘤中有1例被錯(cuò)誤預(yù)測(cè)為腦膜瘤, 4例被錯(cuò)誤預(yù)測(cè)為垂體瘤; 192例垂體瘤中只有2例被錯(cuò)誤預(yù)測(cè)為膠質(zhì)瘤. 為更直觀地表達(dá)本文網(wǎng)絡(luò)模型的分類(lèi)效果, 將腦膜瘤、 膠質(zhì)瘤、 垂體瘤三類(lèi)在Precision,Recall,Specificity,F1-Score評(píng)價(jià)指標(biāo)上進(jìn)行詳細(xì)分析, 結(jié)果列于表4.

表4 本文網(wǎng)絡(luò)模型的評(píng)價(jià)指標(biāo)Table 4 Evaluation indexes of proposed network model %

經(jīng)公式計(jì)算該模型在Precision,Recall,Specificity,F1-Score 4個(gè)評(píng)價(jià)指標(biāo)上的均值達(dá)到98.3%,98.0%,99.1%,98.1%, 進(jìn)一步證明了改進(jìn)的網(wǎng)絡(luò)模型在腦腫瘤分類(lèi)中的穩(wěn)定性和魯棒性.

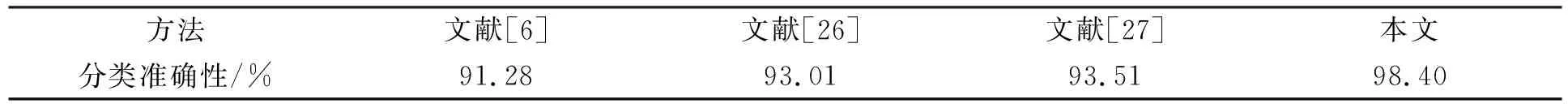

本文將CA-EfficientNetV2網(wǎng)絡(luò)模型與其他文獻(xiàn)中使用的相同數(shù)據(jù)集的分類(lèi)方法進(jìn)行對(duì)比, 對(duì)比結(jié)果列于表5. 由表5可見(jiàn): 文獻(xiàn)[6]使用傳統(tǒng)機(jī)器學(xué)習(xí)的方法, 采用灰度直方圖、 灰度共生矩陣(GLCM)和詞袋模型(BOW)3種特征提取方法對(duì)腦腫瘤進(jìn)行分類(lèi), 該方法最終的分類(lèi)準(zhǔn)確率為91.28%; 文獻(xiàn)[26]采用GAN網(wǎng)絡(luò)作為鑒別器, 用Softmax分類(lèi)器代替最后一個(gè)全連接層, 最終對(duì)腦腫瘤的分類(lèi)準(zhǔn)確率為93.01%; 文獻(xiàn)[27]采用多尺寸卷積核模塊和多深度融合殘差塊相結(jié)合的方法, 最終得到的腦腫瘤分類(lèi)準(zhǔn)確率為93.51%; 本文方法得到的分類(lèi)準(zhǔn)確率達(dá)到98.4%. 實(shí)驗(yàn)結(jié)果表明, 本文方法對(duì)腦膜瘤、 腦膠質(zhì)瘤和垂體瘤3種腦部腫瘤有良好的分類(lèi)效果.

表5 不同方法的分類(lèi)準(zhǔn)確率對(duì)比Table 5 Comparison of classification accuracy of different methods

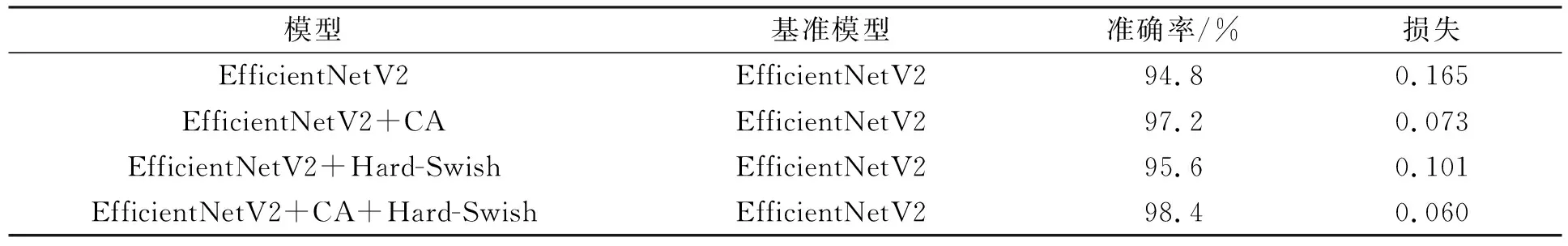

3.4 消融實(shí)驗(yàn)與分析

為更好地評(píng)估CA-EfficientNetV2網(wǎng)絡(luò)模型的性能, 本文進(jìn)行了消融實(shí)驗(yàn). 實(shí)驗(yàn)將分別驗(yàn)證引入坐標(biāo)注意力模塊和Hard-Swish激活函數(shù)這兩個(gè)改進(jìn)方法對(duì)模型準(zhǔn)確率和損失率的影響.

首先在原始數(shù)據(jù)集上進(jìn)行測(cè)試, 雖然模型在復(fù)雜程度上有所增加, 但改進(jìn)后的模型分類(lèi)精確度有明顯優(yōu)勢(shì), 在不同模塊部分的消融對(duì)比結(jié)果列于表6. 由表6可見(jiàn): 僅將SiLU激活函數(shù)替換為Hard-Swish激活函數(shù)的實(shí)驗(yàn)表明, 雖然在模型性能方面有所提升, 但準(zhǔn)確率提升并不明顯; 當(dāng)引入了坐標(biāo)注意力模塊后, 模型的準(zhǔn)確率顯著提高, 損失率也有所改善; 同時(shí)引入以上兩個(gè)模塊, 腦腫瘤圖像分類(lèi)的網(wǎng)絡(luò)性能得到明顯提升. 通過(guò)消融實(shí)驗(yàn), 進(jìn)一步證明了改進(jìn)后的模型具有更好的分類(lèi)性能.

表6 在不同模塊部分的消融對(duì)比結(jié)果Table 6 Comparison of ablation results in different module sections

綜上所述, 針對(duì)腦腫瘤磁共振圖像分類(lèi)問(wèn)題中過(guò)擬合及分類(lèi)準(zhǔn)確率較低的問(wèn)題, 本文提出了一種基于改進(jìn)EfficientNetV2網(wǎng)絡(luò)的腦腫瘤分類(lèi)方法. 首先, 介紹了注意力機(jī)制的原理和模塊, 同時(shí)介紹了改進(jìn)的Hard-Swish激活函數(shù); 其次, 介紹了基于改進(jìn)EfficientNetV2網(wǎng)絡(luò)的腦腫瘤分類(lèi)方法, 將原網(wǎng)絡(luò)中的SE注意力機(jī)制替換成CA注意力機(jī)制, 解決了因SE注意力機(jī)制在捕獲特征信息不足時(shí)產(chǎn)生網(wǎng)絡(luò)分類(lèi)精度低的問(wèn)題, 實(shí)驗(yàn)結(jié)果表明, CA注意力機(jī)制在EfficentNetV2網(wǎng)絡(luò)模型中針對(duì)腦腫瘤分類(lèi)的精度有很大提升; 再次, 本文改進(jìn)了Hard-Swish激活函數(shù)并且融合了BN和Dropout層, 加快了網(wǎng)絡(luò)計(jì)算速度, 避免發(fā)生過(guò)擬合問(wèn)題, 使網(wǎng)絡(luò)在穩(wěn)定性更好的前提下增加了準(zhǔn)確率, 因此改進(jìn)后的模型相對(duì)于其他模型有較高的分類(lèi)精度, 并且性能也優(yōu)于其他模型, 分類(lèi)準(zhǔn)確率達(dá)到98.4%; 最后, 通過(guò)對(duì)比實(shí)驗(yàn)和消融實(shí)驗(yàn)驗(yàn)證了改進(jìn)腦腫瘤分類(lèi)模型的先進(jìn)性和有效性, 該模型能有效提高醫(yī)生的診斷效率.

吉林大學(xué)學(xué)報(bào)(理學(xué)版)2023年5期

吉林大學(xué)學(xué)報(bào)(理學(xué)版)2023年5期

- 吉林大學(xué)學(xué)報(bào)(理學(xué)版)的其它文章

- 《吉林大學(xué)學(xué)報(bào)(理學(xué)版)》征稿簡(jiǎn)則

- Brief Introduction to “Journal of Jilin University (Science Edition)”

- 次線性期望下m-END序列加權(quán)和的幾乎處處收斂性

- 異喹啉修飾金屬有機(jī)骨架配合物的合成及其二氧化碳和碘的吸附性能

- 一種多功能性Keggin型多酸基配合物的合成、 結(jié)構(gòu)及性能

- 基于擴(kuò)展Span表示的電力變壓器運(yùn)維知識(shí)抽取與知識(shí)圖譜構(gòu)建