面向蘋果葉部病害識別的細粒度蒸餾模型

李大湘,滑翠云,劉 穎

面向蘋果葉部病害識別的細粒度蒸餾模型

李大湘,滑翠云,劉 穎

(西安郵電大學通信與信息工程學院,西安 710121)

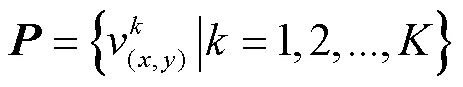

為了提高輕型卷積神經網絡(convolutional neural networks,CNN)在蘋果葉部病害識別中的精度,使其更加適于布署到智慧農業移動終端,該研究設計了一種細粒度知識蒸餾(fine-grained knowledge distillation,FGKD)模型。首先,利用上下文信息與空間-語義關系分別設計了上下文空間注意力(spatial attention,SA)與細粒度特征提取(fine-grained feature extraction,FGFE)模塊,且將它們嵌入到Resnet50與設計的輕型CNN,分別作為教師與學生網絡;然后,構造SA與FGFE知識蒸餾損失函數,以將教師網絡中的特征提取與細粒度知識表示能力遷移到學生網絡之中,以增強其對蘋果葉部病害圖像的局部特征提取能力與高層語義表達能力,使輕型學生網絡在參數量很小的條件下,其性能接近復雜的教師網絡。基于標準蘋果葉部病害數據集的對比試驗結果表明,經知識蒸餾之后的學生網絡精度為98.60%,模型參數量僅0.75 MB,平均推理時間為25.51 ms,能夠有效地滿足實際智慧農業移動端對模型的需求,快速準確地實現蘋果葉部病害自動識別。

計算機視覺;圖像處理;蘋果樹葉病害識別;細粒度知識蒸餾;上下文空間注意力

0 引 言

在蘋果樹生長的過程中,容易受到天氣、環境和微生物等的影響而產生各種病害。植株葉部是病癥最常出現的部位,由于病害區域較小且癥狀具有一定的相似性,僅靠種植者肉眼觀察和經驗判斷不能及時診斷病害類型,造成巨大損失。因此,基于計算機視覺技術研究面向蘋果葉部病害的識別算法,是確保蘋果高效生產且可持續發展的一種重要手段[1]。

近年來,由于深度學習技術可自動提取病害特征,具有避免人工依賴的特點,在作物病害識別中取得了一系列的研究成果,SHIN等[2]使用6種不同的深度學習模型來檢測草莓數據集的白粉疾病;張善文等[3]提出一種基于多尺度融合卷積神經網絡(convolutional neural networks, CNN)的黃瓜病害葉片分割方法,平均分割準確率為93.12%;AGARWAL等[4]提出了一種基于CNN體系結構的番茄葉部疾病檢測方法;李子茂等[5]提出一種基于遷移學習的SE-DenseNet-FL茶葉病害識別方法,利用SE-Net及Focal Loss方法,在小樣本及樣本分布不均情景下,對茶葉病害的識別準確率達到92.66%;李大湘等[6]提出全局與局部特征交互耦合的方法,以提升模型對蘋果葉部病害圖像的特征提取能力,其識別準確率達到98.23%;HU等[7]提出了一種用于玉米葉部疾病識別的CNN算法,通過使用數據擴充來增強訓練集,并使用遷移學習技術來提高CNN模型的準確性,優化后CNN在包含4類玉米葉片的Plant Village數據集的子集上平均準確率達到97.6%。盡管深度學習的方法在特定病害識別任務上取得了理想的識別精度,但也存在網絡參數多、計算量大且模型復雜的問題,實用性較差。

為解決深度學習模型的移動部署問題,研究者們提出了各種輕量級架構,為作物病害識別方法落地部署提供強有力的技術支撐,SEMBIRING等[8]提出了一種輕量級CNN,用于對番茄植物的葉片圖像病害進行分類識別;DURMUS等[9]利用SqueezeNet檢測番茄葉部疾病;BIR等[10]利用預訓練的EfficientNet-B0對番茄葉部病害識別,在保持模型尺寸和計算量較低的同時,實現了與最先進技術相當的精度;王春山等[11]在ResNet18的基礎上,通過增加多尺度特征提取模塊改變殘差層的連接方式,分解大卷積核并進行群卷積運算,提出了改進的多尺度殘差(Multi-scale ResNet)模型,顯著降低了模型參數和存儲空間,在Plant Village數據集上取得了95.95%的準確率,在自己收集的7個真實環境疾病數據集上取得了93.05%的準確率;LIU等[12]提出了一種新的CNN結構來識別蘋果葉部疾病,該網絡由AlexNet-precursor網絡和初始網絡級聯而成,用Inception網絡取代了傳統AlexNet模型中的全連接層,顯著減少可訓練參數的數量,從而降低了存儲需求。但是,上述CNN模型只是直接運用或者改進現有的輕型卷積網絡,未能針對蘋果葉部病害“類間方差小、類內方差大”的細粒度問題[13-14]作進一步優化。

為兼顧蘋果葉部病害粗粒度全局特征和細粒度局部病害的特點,現有方法通常采用多重CNN框架或者注意力模塊[15-16],額外添加了參數量,不符合智慧農業對移動端部署的要求。本文提出面向蘋果葉部病害識別的細粒度知識蒸餾(fine-grained knowledge distillation,FGKD)模型,即利用上下文信息和空間語義關系分別設計了空間注意力和細粒度提取模塊,且將它們嵌入到教師網絡和設計的輕型學生網絡之中,旨在通過教師網絡去指導學生網絡的學習,使輕型學生網絡在參數量很小的條件下,更能關注葉片中的病害區域,且提取到更具鑒別能力的細粒度特征而提高識別精度。

1 試驗數據與評價指標

1.1 試驗數據

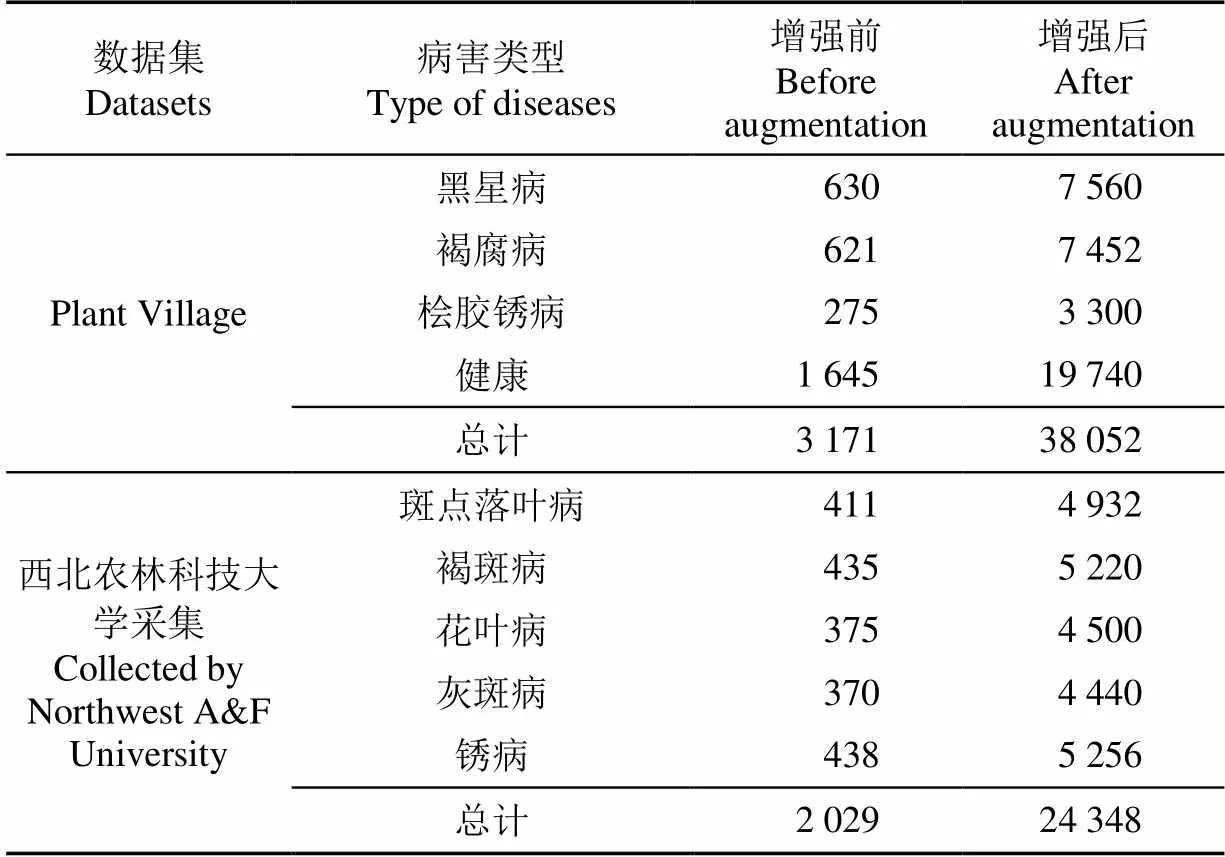

試驗數據來源于Plant Village[17]和西北農林科技大學采集數據[18],其基本信息如下:1)Plant Village:植物病害數據集包含來自14種植物的54 305張植物葉片圖,共38種常見病害,葉片圖像均為實驗室環境下拍攝的單一背景圖像,本文只取其中的4類(黑星病、褐腐病、檜膠銹病和健康)蘋果葉部病害圖像;2)西北農林科技大學蘋果病害數據集:在晴天光線良好的條件下獲取,部分圖像在陰雨天進行采集,不同的采集條件進一步增強了數據集的多樣性,包含5類(花葉病、銹病、灰斑病、斑點落葉病、褐斑病)蘋果葉部病害。

為保證模型的訓練效果,避免因訓練數據不足導致過擬合,對圖像集進行增強,即采用隨機翻轉、尺度及亮度變換等方法對每張原圖像進行擴充,圖像集增強前后詳細信息如表1所示。

表1 數據集信息

1.2 模型評價指標

1)準確率

準確率為分類正確的樣本占總樣本個數的比例[11]。

2)混淆矩陣

混淆矩陣是總結分類模型預測結果的情形分析表,以矩陣形式將數據集中的記錄按照真實的類別與分類模型預測的類別判斷兩個標準進行匯總[7]。

3)參數量

參數量是衡量深度學習算法的重要指標,對應的是算法的空間復雜度,參數量的減少能降低計算機內存資源的消耗。深度卷積神經網絡的參數量主要是卷積層和全連接層[12]。

4)平均推理時間

在深度學習中,推理指的是神經網絡的一次前向傳播過程,也就是將輸入數據送入神經網絡,然后從中得到輸出結果的過程。使用平均推理時間來觀察模型是否適合加載到移動端[12]。

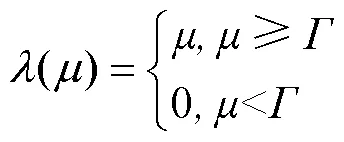

2 整體框架構建

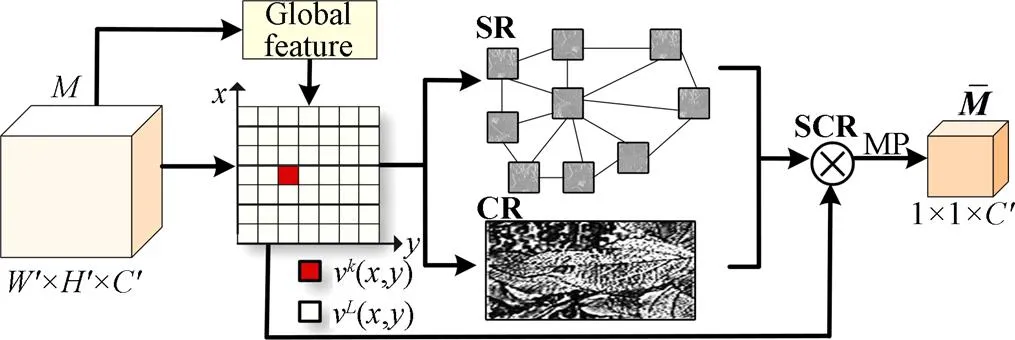

本節設計了面向蘋果葉部病害識別的細粒度蒸餾模型(FGKD),如圖1所示。該模型主要由三大部分組成,即:復雜的教師網絡、輕型的學生網絡與蒸餾函數模塊,旨在通過設計的知識蒸餾函數迫使教師網絡教授學生網絡如何通過知識蒸餾提取細粒度特征,使其在參數量適宜移動端的條件下,具有與教師網絡同等的局部特征提取與高層語義表達能力,以獲得更高的病害識別精度。

2.1 教師網絡的設計

在知識蒸餾模型中,由于教師網絡要用于指導學生網絡的訓練,其性能直接影響到整個模型的精度。如圖1中的教師網絡所示,本研究利用上下文信息與局部語義關系,分別設計了空間注意力(spatial attention, SA)與細粒度特征提取(fine-grained feature extraction, FGFE)模塊,且將它們分別加入到ResNet50[19]的第一層和第五層卷積塊之后作為教師網絡,具體來說,為了使教師網絡的前端卷積更能聚焦到蘋果葉部圖像的病變區域,故將SA模塊加入到第一層卷積塊之后;為增強FGKD模型對蘋果葉部病害圖像的高層語義表達能力,故將FGFE模塊加入到第5層卷積塊之后。

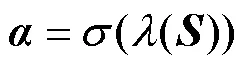

2.1.1 基于上下文信息的SA模塊

由于具有判別性的病害部位通常分布在蘋果葉部圖像中的局部區域,散亂且形狀不統一。為了使教師網絡的前端卷積操作更能聚焦到葉部圖像的病變區域,最常用的方法是使用最大及平均池化來生成SA圖譜[20-21]。當這些方法用于蘋果葉部病害識別時,存在的缺點是:在產生注意力時,只利用通道維度的最大值或平均值,沒有考慮到相鄰像素的上下文信息,且對病變區域的旋轉性不具有適應能力。

圖1 面向蘋果葉部病害識別的細粒度蒸餾模型(FGKD)結構示意圖

Fig.1 Schematic diagram of a fine-grained distillation model (FGKD) for apple leaf disease identification

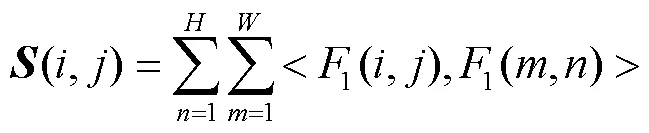

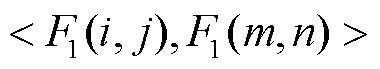

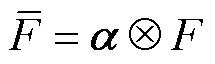

注:F是輸入SA模塊的特征圖譜,W、H與C分別代表其寬度、高度和通道數,F1是經過1×1卷積后的特征圖譜,S(i, j)是基于上下文的相似性矩陣,α是SA權重矩陣,是經過SA之后的特征圖譜。Note: F is the feature map of the input SA module, W、H and C is the width, height and number of channels, F1 is characteristic map after 1 × 1 convolution, S(i, j) is context-based similarity matrix,αis the SA weight matrix, is the feature map after SA.

綜上所述,SA加權過程可總結為

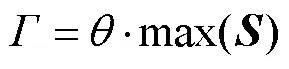

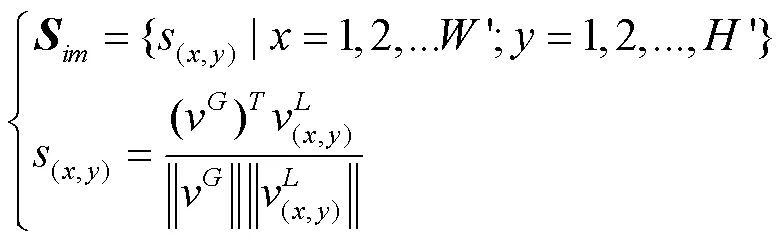

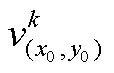

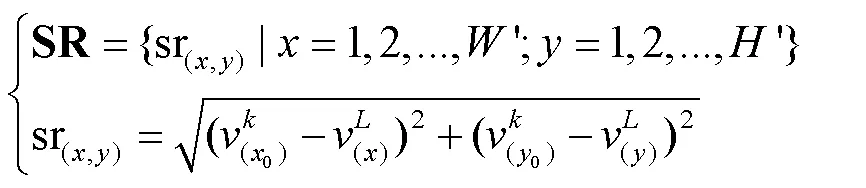

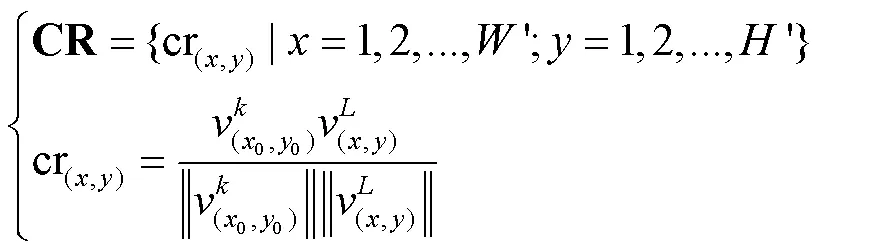

2.1.2 基于空間-語義關系的FGFE模塊

由于不同的蘋果病害只在葉部某個局部有細微差異,具有“高類內方差、低類間方差”的特點,屬于典型的細粒度圖像識別問題,則如圖3所示,本節基于空間-語義關系設計了一個FGFE模塊。

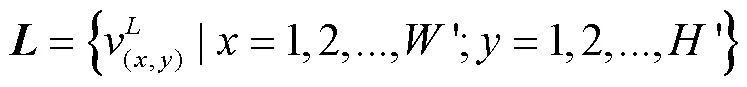

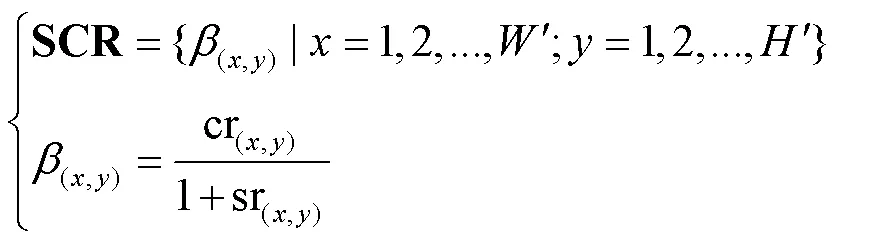

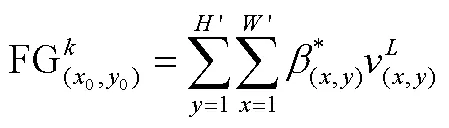

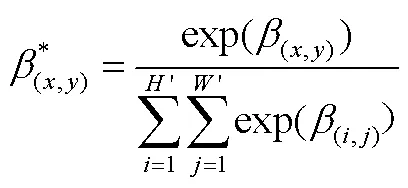

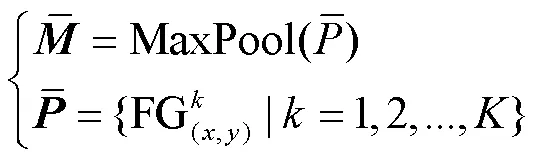

注:是第5個殘差模塊輸出的特征圖譜,W'、H'、C'分別代表其寬度、高度和通道數,Global feature是全局特征,x、y是橫縱坐標軸,是顯著特征,vL是局部特征,SR是空間依賴關系,CR是通道依賴關系,SCR是空間-語義關系,是融合細粒度特征,MP是最大池化。Note: is the feature map output by the fifth residual module, W', H', C' is the width, height and number of channels, global feature is global feature, x, y are the horizontal and vertical axes,is distinctive features, vL are local features, SR is a spatial dependency, and CR is a channel dependency,SCR is a spatial-semantic relationship andis a fusion of fine-grained features, MP is max pooling .

1)顯著特征篩選

為了從特征圖譜中篩選出有鑒別能力的局部區域從而獲得其蘊含的細粒度特征,將中每個位置沿通道維度的數據抽取出來,稱之為“局部特征”,記為

2)聚合空間-語義關系的FGFE方法

基于空間依賴關系SR與語義依賴關系CR,定義“空間-語義關系”SCR如下:

2.2 學生網絡及知識蒸餾

2.2.1 學生網絡設計

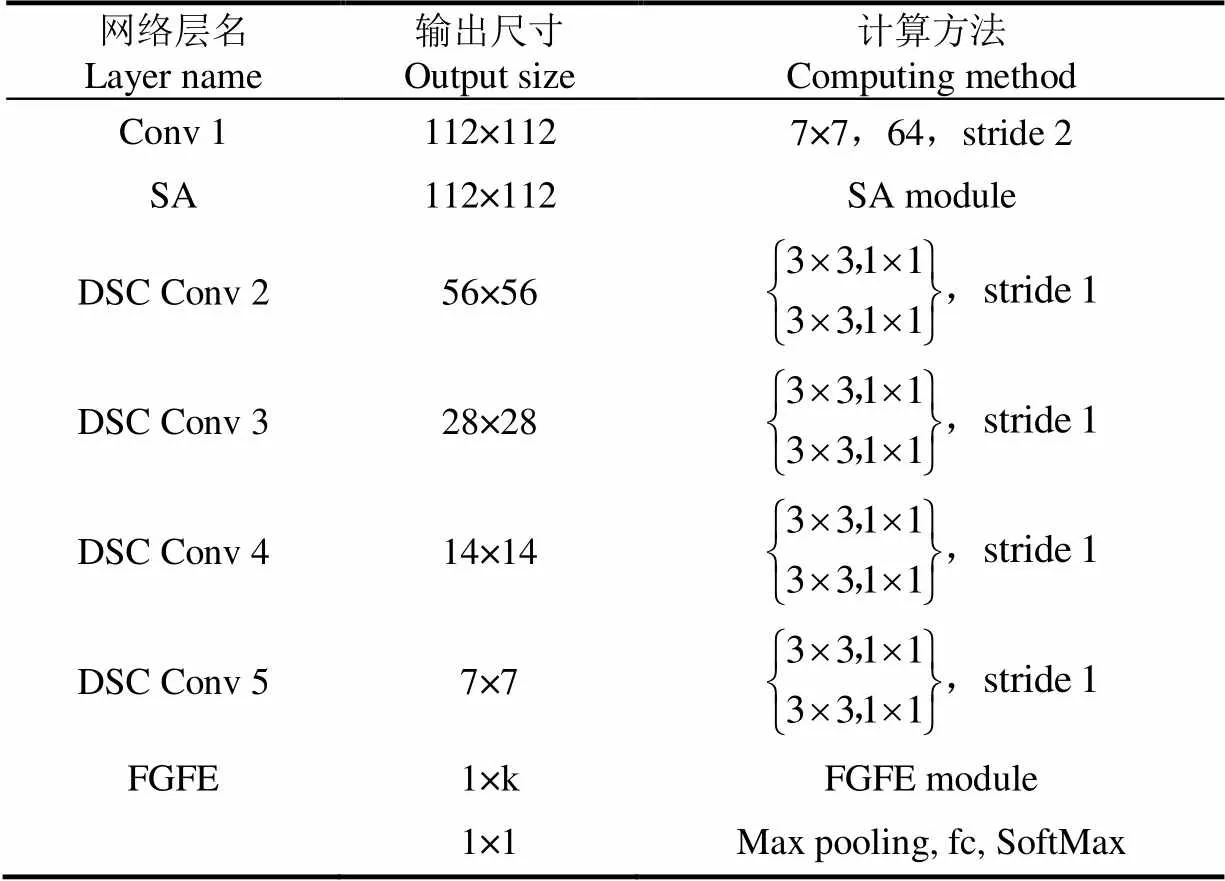

復雜的教師網絡精度優良,但無法滿足模型加載在移動設備上的需求,因此,參照Resnet18網絡[4]結構,如表2所示,設計了一個包含5個卷積模塊的輕型學生網絡,為了進一步減少網絡參數,設計的學生網絡除第一個卷積模塊之外,將另4個卷積模塊中的普通卷積替換為深度可分離卷積(depthwise separable convolution, DSC)[22],同時在第一和第五個卷積模塊之后也各自添加了與教師網絡相同的SA和FGFE模塊,使其能在保持自身輕量級框架的同時,可蒸餾教師網絡的特征提取和高層語義表示能力。

表2 學生網絡設計

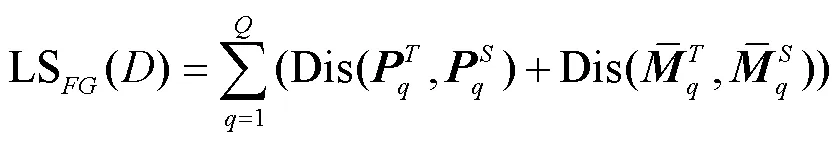

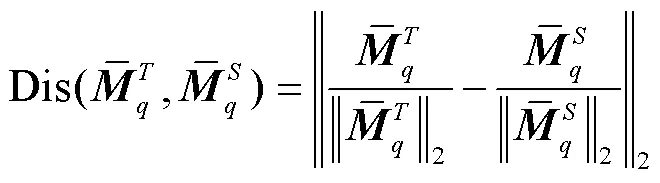

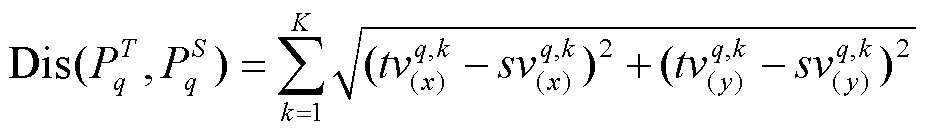

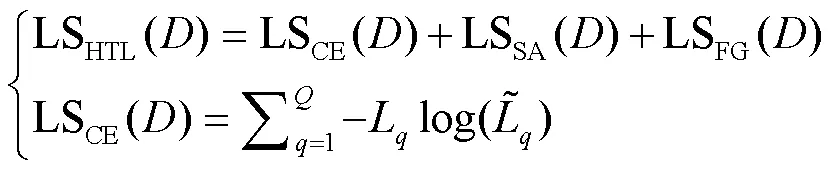

2.2.2 知識蒸餾設計

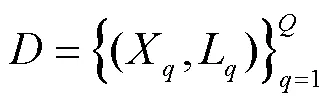

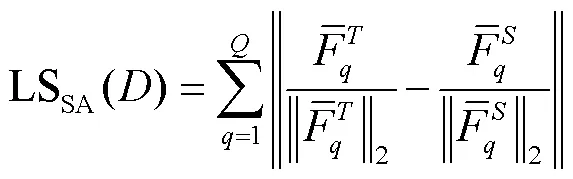

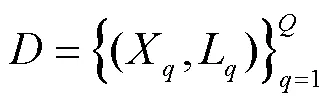

知識蒸餾是一種有效的模型壓縮方法,首次被HITON等[23]提出,其利用復雜的教師網絡向輕型的學生網絡遷移知識,有效地改善了學生網絡性能高度依賴于模型復雜度的問題,降低了其訓練與應用成本而更有利于CNN模型的實施與部署。隨后,ROMERO等[24]在知識蒸餾的基礎上進行擴展,將教師網絡的輸出層和中間層特征作為指導信息,遷移到學生網絡中;YIM等[25]將蒸餾的知識看作成一種解決問題的流,它是由不同層之間的特征通過內積計算得到,該方法可以使學生網絡學的更快,同時使其性能超過教師網絡,且適用于遷移學習;除此之外,還有ZAGORUYKO等[26]引入注意力、ZHOU[27]等提出教師和學生網絡共享權重與AHN等[28]引入互信息知識的蒸餾方法。為了將教師網絡中的SA與細粒度知識遷移到學生網絡之中,本節設計了兩種知識蒸餾函數,具體方法如下:

1)SA知識蒸餾

2)細粒度知識蒸餾

2.3 聯合損失及算法步驟

算法:知識蒸餾學生網絡訓練及測試

預處理:根據批量大小Q,對中的圖像進行分批;

Step 1:訓練教師網絡

For epoch in Epochs:

3)采用余弦衰減策略更新學習率l。

End for

Step 2:訓練學生網絡

For epoch in Epochs:

7)采余弦衰減策略更新學習率l。

End for

Step 3:識別測試圖像

3 結果與分析

3.1 試驗配置

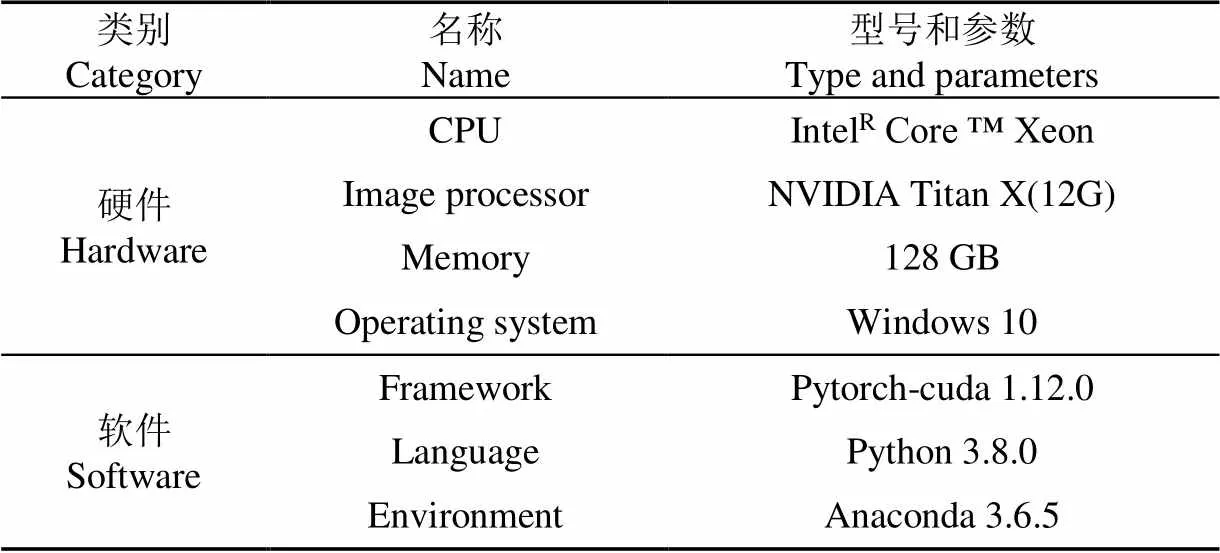

在試驗過程中,采用的軟硬件平臺配置如表3所示。首先,為了適應模型需求,將所有圖片尺寸統一調整為224×224,然后按照8:2的比例將數據集隨機劃分為訓練集和測試集,分別用于模型的訓練與測試。在訓練與測試過程中,選擇Adam優化器,初始學習率l設置為0.001,且采用余弦退火衰減策略進行更新,批量大小Q設置為32,epochs設置為300。

表3 試驗平臺配置

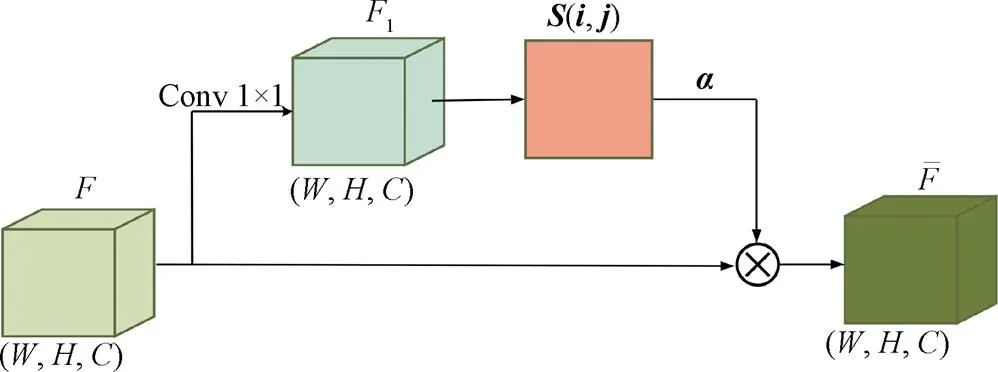

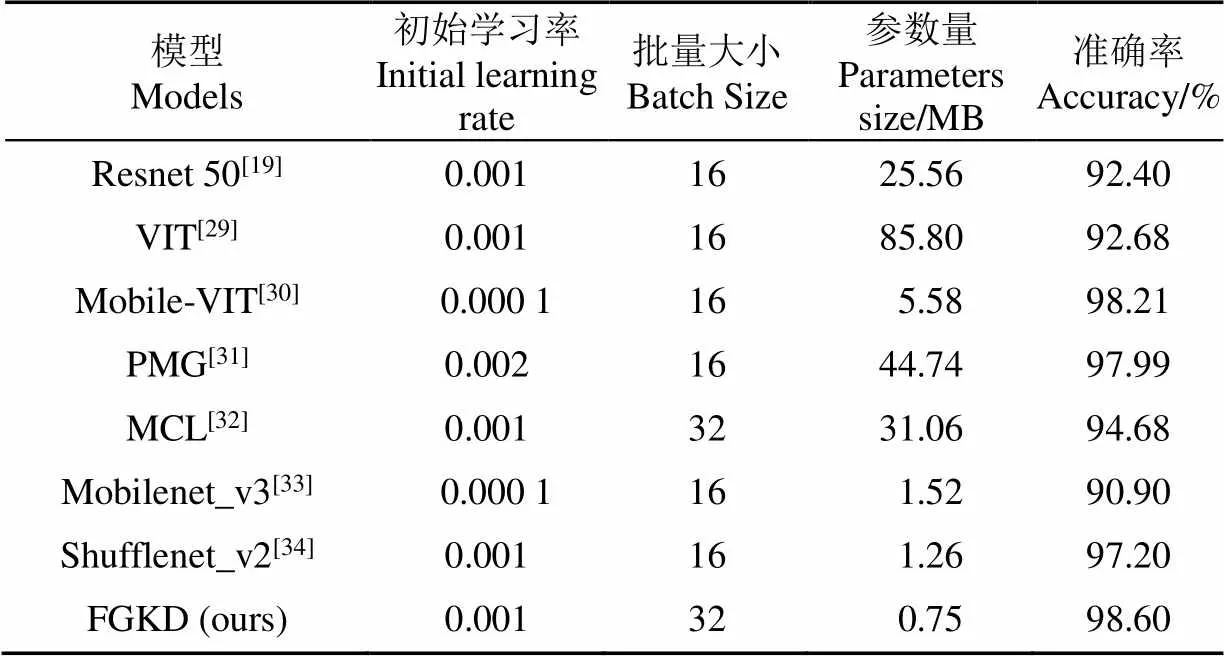

3.2 綜合對比試驗

為了驗證所提FGKD模型的有效性,基于上述蘋果葉部病害數據集與試驗方法,與近幾年最新的病害識別算法以及經典的CNN模型,進行了對比試驗,其中包括深度學習、細粒度識別與輕量級網絡等相關方法。試驗過程中,所有網絡均在Plant Village數據集上完成預訓練,然后將參數遷移到西北農林數據集上進行試驗,識別精度與模型參數量如表4所示。

表4 模型結果對比

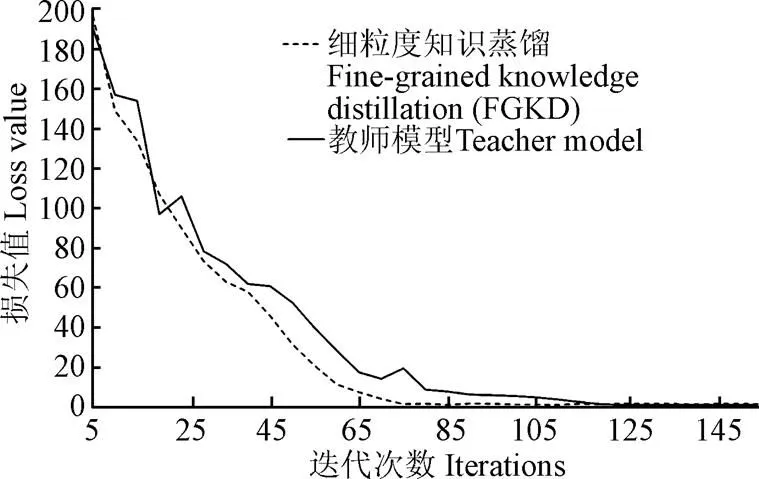

在表4中,對比模型參數量可知,所提FGKD模型的學生網絡的參數量為0.75 M,少于其他所有模型,在模型復雜度方面是最低的,較之經典的MobileNet V3[33]與Sufficient V2[34]網絡,其參數量降低了50.66%與40.48%,相比于教師網絡,參數量降低了97.10%;對比識別精度可知,除教師網絡之外,所提FGKD模型是最高的,達到了98.60%,均優于其他識別方法。綜上所述,所提FGKD模型在蘋果病害識別任務中是有效的,能在參數量很小的條件下,具備接近教師網絡的識別精度,更加適合部署到資源受限的農業物聯網終端設備。為觀察所提FGKD模型在訓練過程中的損失變化情況,如圖4所示,展示了1~70次迭代的損失變化曲線。

圖4 模型訓練過程中的損失變化曲線

從圖4所示的兩條損失曲線可知,教師模型在訓練的時候波動大,隨著訓練輪數的增加損失趨于平穩,在約117輪后達到收斂;所提FGKD模型的學生網絡在訓練過程中波動小且在約60輪后達到收斂,相比于教師網絡收斂速度較快,這主要得益于FGKD模型中學生網絡構造兩種知識蒸餾,以將教師網絡中訓練成功的特征提取與細粒度知識表示能力遷移到學生網絡之中,有效地提高了學生網絡的訓練效率。

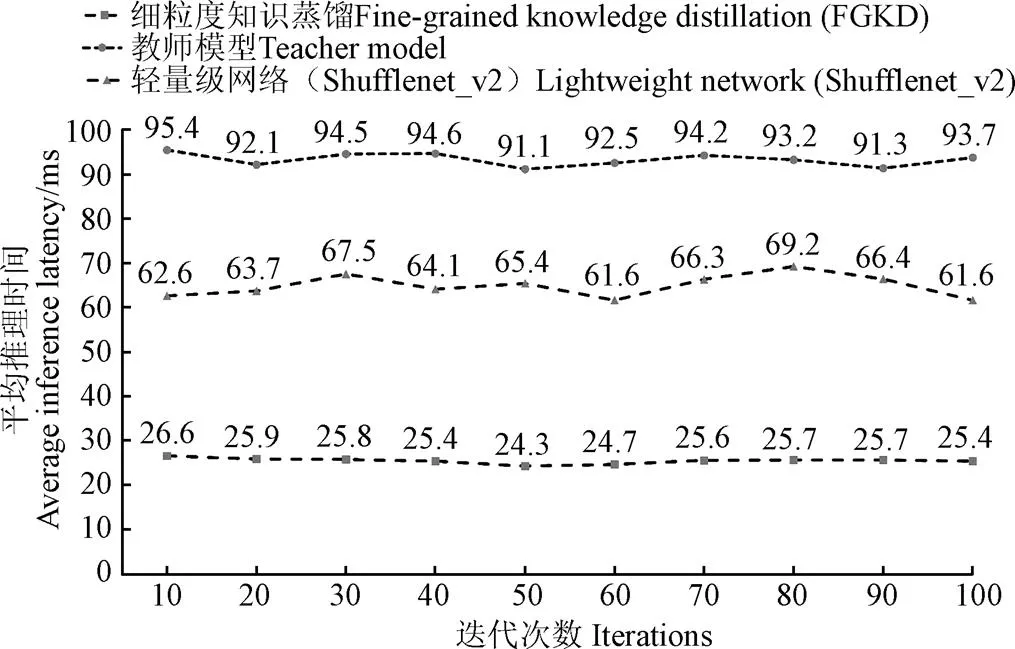

為了進一步觀察所提FGKD模型的推理時間,使用perf_counter函數每隔10次迭代,依次輸出多個CNN模型在第1~100次迭代內對蘋果葉部病害識別的平均推理時間(ms),如圖5所示。

圖5 不同模型平均推理時間

從圖5所示的平均推理時間曲線可知,所提FGKD模型的學生網絡每次的平均推理時間在25.51 ms左右,少于其他所有模型,總體上來說是平穩的且可滿足實時性要求,且較之經典的Sufficient V2[34]網絡,其平均推理時間降低了60.66%,相比于教師網絡,平均推理時間降低了72.65%,這主要得益于設計的FGFE模塊復雜度不高,即設計的學生網絡是輕型CNN網絡(從表4可知它的參數量僅為0.75 MB)。

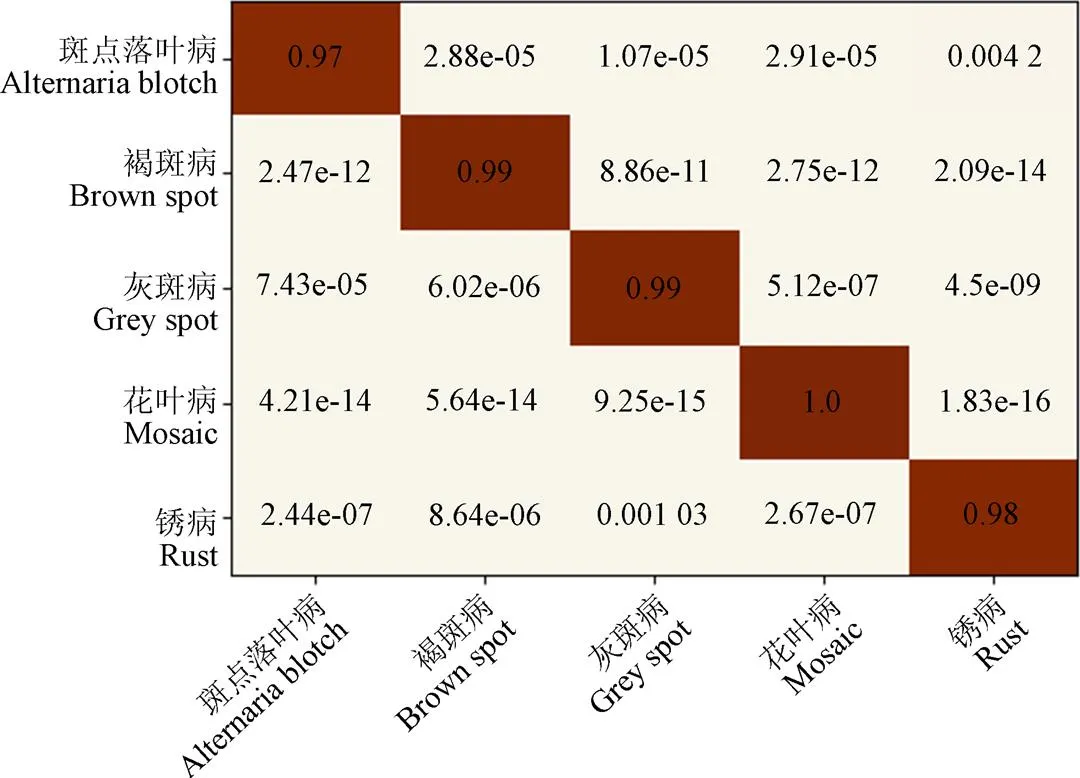

為了進一步觀察所提FGKD模型在蘋果葉部病害每個類別中的具體表現,如圖6所示,繪制了5種病害預測的混淆矩陣。該矩陣中的每列表示預測標簽,每列數據之和表示預測為該類的圖像概率;每行表示測試圖像的真實標簽,每行數據之和代表該類別的圖像概率,對角線單元格中的數值表示預測正確率,而非對角單元格中的數據則表示不同類別預測的錯誤率。

圖6 蘋果病害模型混淆矩陣

圖6中5類蘋果病害的測試集中,平均識別精度可達98.60%,比較容易發生混淆的類別在斑點落葉病與銹病之間,這是因為兩者具有相似的病害紋理形狀,在發生病害的時候,斑點落葉病葉片表面呈現褐色圓形枯死斑,rust葉片表面出現橘紅色小圓點,容易混淆。

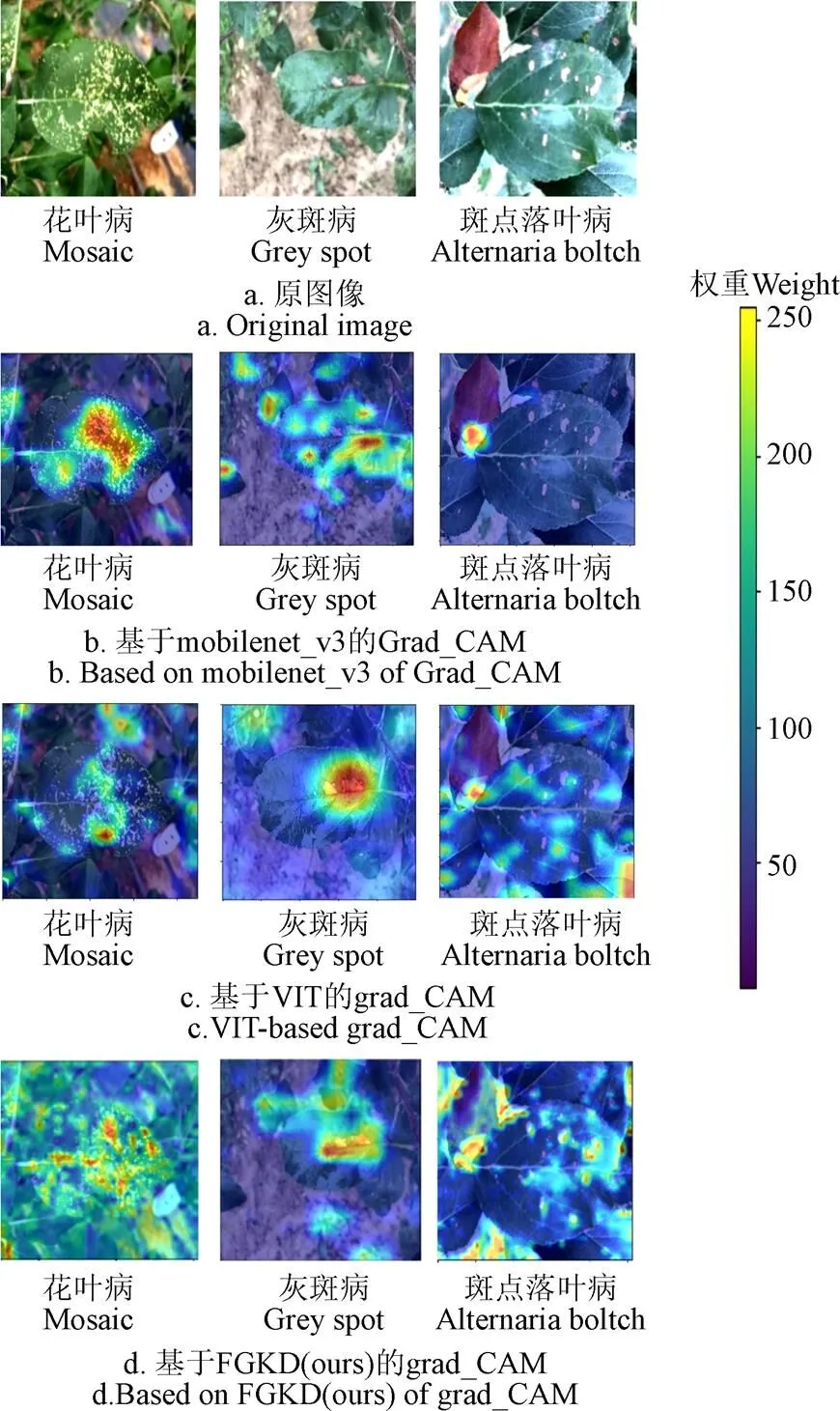

在所提FGFE模型中,為了驗證設計的SA模塊在蘋果葉部病害識別過程中,所關注的是局部區域,如圖7所示,使用Grad-CAM[35]將經過訓練的學生網絡進行了可視化,即利用梯度來計算最后一個卷積層中每個神經元的重要性,可視化結果顯示圖像中的哪個區域是模型做出分類決策的重要特征,熱圖中顯示越紅的區域表示這些地方更具辨別力,是模型在對該圖像進行分類時最感興趣的區域。從圖7所示熱圖可見,較之經典的Mobile Net V3和VIT網絡,學生網絡FGKD在擁有復雜背景的病害識別中,其注意力聚焦的感興趣區域更加精準且完整,這主要原因是:SA模塊使得學生網絡自適應病害區域;FGFE模塊幫助學生網絡提取信息更加豐富的細粒度區域;SA和FGFE知識蒸餾,以將教師網絡中的特征提取與細粒度知識表示能力遷移到學生網絡之中,增強其對蘋果葉部病害圖像的局部特征提取能力與高層語義表達能力,三個模塊相輔相成,促進學生網絡的性能更接近教師網絡。

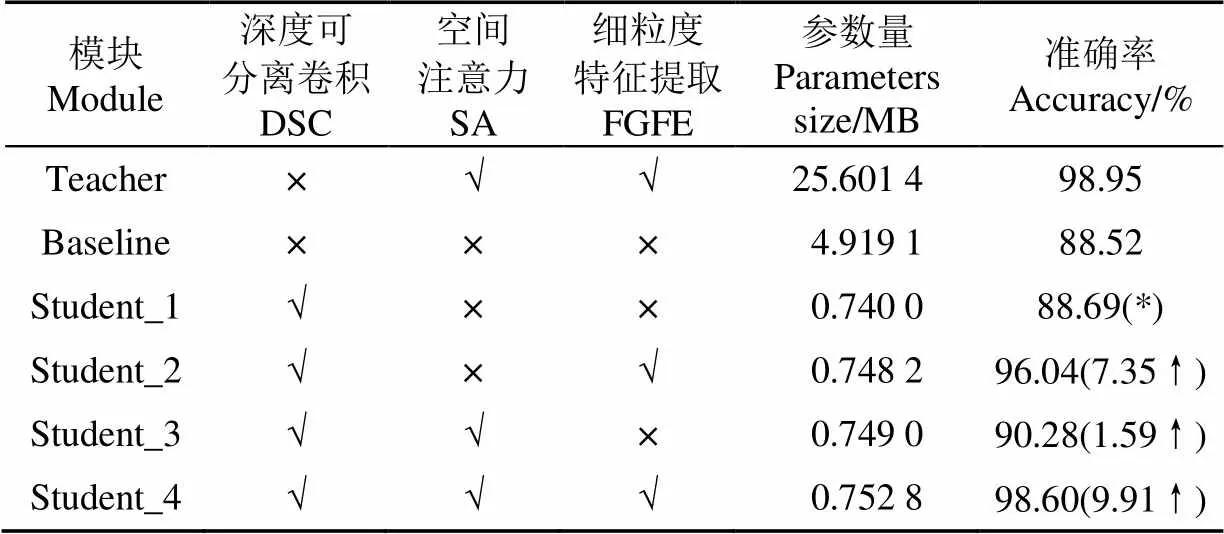

3.3 消融試驗

在蘋果葉部病害識別中,為了驗證所設計的SA與FGFE知識蒸餾模塊的有效性,本節對設計的FGKD模型進行了消融試驗,當不同的知識從教師網絡中被蒸餾到學生網絡之中,測試結果如表5所示。其中:“Baseline”指學生網絡在訓練時只使用標簽作為監督信息,即式(20)中LSHTL()只保留LSCE(),學生網絡的訓練不使用任何蒸餾知識,且5個卷積模塊中采用的是普通卷積操作;“Student_1”、“Student_2”、“Student_3”與“Student_4”指在學生網絡中分別采用“DSC”、“DSC+FGFE”、“DSC +SA”及“DSC +SA+FGFE”模塊,以指導學生網絡的訓練;“Teacher”指用“算法”中“Step 1”訓練的教師網絡。

注:權重越大越有利于蘋果葉病害的正確分類。

從表5所示消融試驗結果可以發現,在“Student_1”中采用DSC替換普通的卷積操作,學生網絡的參數量降低到“Baseline”的84.96%,且它們的識別精度幾乎相同;同時也可發現,較之無任何知識蒸餾的原始學生網絡“Student_1”,采用SA蒸餾的學生網絡“Student_3”平均精度提高了1.59個百分點,而采用FGFE蒸餾的學生網絡“Student_2”精度提高了7.35個百分點。顯然,本文設計的DSC、FGFE及SA模塊是有效的,能提高病害分類精度,主要原因是:SA模塊將上下文信息與空間注意力相結合,且設計了一個SA蒸餾函數,能將教師網絡的SA知識有效地傳遞給學生網絡,以提升其提取病害局部信息的能力;FGFE模塊在學生網絡訓練過程中,能將每幅訓練圖像的細粒度特征利用空間-語義關系進行聚合,且利用FGFE蒸餾函數可將教師網絡中FGFE知識遷移到學生網絡之中,增強其對病害的高層語義提取與表達能力。同時也可看出,兩個知識蒸餾模塊同時使用的“Student_4”平均精度提高,比用任意一個模塊提升更高,其識別精度達到98.60%,接近教師網絡(但教師網絡的參數量遠高于學生網絡),這證實了兩個蒸餾模塊可以相互補充,在蘋果病害識別中是有效的。

表5 消融試驗模型參數量和精度

注:√表示試驗中采用了該模塊,×表示試驗中未采用該模塊,*表示對比對象,↑表示增加量。

Note: √means the module was used in the experiment, × means the module was not used in the experiment, *represent the comparison object,↑indicates an increase in quantity.

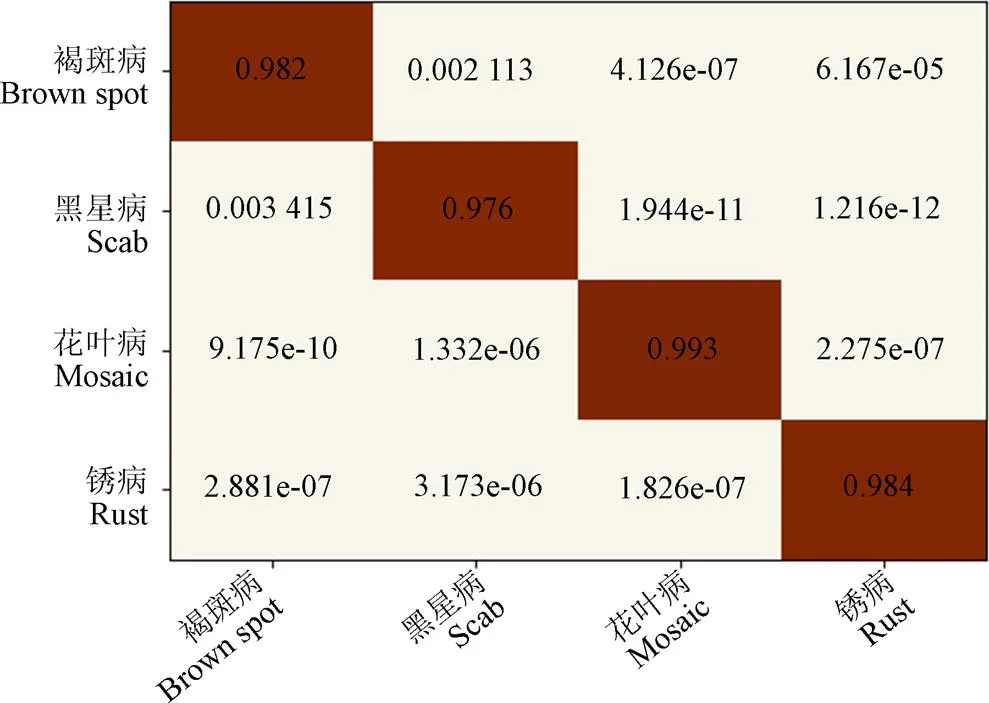

3.4 實際應用驗證試驗

為了進一步驗證所提FGKD模型的實際應用性能,采用2022年7-10月在陜西省銅川市耀州區小丘鎮移村秦脆蘋果園種植基地拍攝的圖像建立試驗數據集。采集工具為華為nova8智能手機,拍攝距離10~15 cm,圖像分辨率為2 268×4 032,共采集到病害圖像2 213張(含535張褐斑病、669張黑星病、515張花葉病和494張銹病)。增強后的數據集被隨機分為訓練集(80%)和測試集(20%),再使用綜合試驗所述的方法對模型進行訓練與測試,混淆矩陣如圖8所示。

Fig.8 Example of disease in Qin crisp apple orchard

圖8 蘋果病害實際應用驗證混淆矩陣

從圖8所示的混淆矩陣可知,在實際采集的數據集中,4類蘋果病害的測試集平均識別精度可達98.38%,其中比較容易發生混淆的類別在褐斑病與黑星病之間,這是因為兩者的病變區域具有相似的顏色特征與葉斑形態,即它們在顏色方面通常均呈暗褐色,在葉斑形態方面通常均由數個近圓紋理結構連接在一起而形成的病理圖案。

4 結 論

針對蘋果葉部病害形態各異且占比小的特點,本研究設計了一種面向蘋果葉部病害識別的細粒度蒸餾模型,通過對比試驗與分析,得出如下結論:

1)設計的FGKD(fine-grained knowledge distillation)模型的學生網絡參數量為0.75M,在標準數據集上的識別準確率達98.60%,平均推理時間在25.51ms左右,試驗結果表明,對比其他主流的細粒度和輕量級卷積神經網絡,FGKD模型的識別效果更好,參數量更少,推理時間更短;

2)利用上下文信息與空間注意力結合設計SA模塊與 SA蒸餾函數,有效提升了模型提取病害局部信息的能力,消融試驗表明,對比無任何知識蒸餾的原始學生網絡“Student_1”,采用SA蒸餾的學生網絡“Student_3”平均精度提高了1.59個百分點;

3)利用空間-語義關系聚合細粒度特征,增強其對病害的高層語義提取與表達能力,消融試驗表明,對比無任何知識蒸餾的原始學生網絡“Student_1”,采用FGFE訓練的學生網絡“Student_2”精度提高了7.35個百分點。

綜上所述,在本研究設計的SA和FGFE知識蒸餾模塊,可以將教師網絡中的特征提取與細粒度知識表示能力遷移到學生網絡之中,使輕型學生網絡在參數量很小的條件下,其性能接近復雜的教師網絡,識別精度優于其他各種先進方法,有利于后期模型在移動端和其他小型設備的部署和應用,提升了深度學習模型在病害識別領域的實用性。在后續工作中,將重點研究復雜背景下細粒度病害識別的可解釋性分析,進一步降低模型的參數量和推理時間,并把研究成果延伸到其他作物病害中,以提升模型的泛化應用價值。

[1] 邵明月,張建華,馮全,等. 深度學習在植物葉部病害檢測與識別的研究進展[J]. 智慧農業(中英文),2022,4(1):29-46. SHAO Mingyue, ZHANG Jianhua, FENG Quan, et al. Research Progress of deep learning in detection and recognition of plant leaf diseases[J]. Smart Agriculture, 2022, 4(1): 29-46. (in Chinese with English abstract)

[2] SHIN J, CHANG Y K, HEUNG B, et al. A deep learning approach for RGB image-based powdery mildew disease detection on strawberry leaves[J]. Computers and Electronics in Agriculture, 2021, 183: 106042.

[3] 張善文,王振,王祖良. 多尺度融合卷積神經網絡的黃瓜病害葉片圖像分割方法[J]. 農業工程學報,2020,36(16):149-157.

ZHANG Shanwen, WANG Zhen, WANG Zuliang. Method for image segmentation of cucumber disease leaves based on multi-scale fusion convolutional neural networks[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2020, 36(16): 149-157. (in Chinese with English abstract)

[4] AGARWAL M, SINGH A, ARJARIA S, et al. ToLeD: Tomato leaf disease detection using convolution neural network[J]. Procedia Computer Science, 2020, 167: 293-301.

[5] 李子茂,徐杰,鄭祿,等. 基于改進DenseNet的茶葉病害小樣本識別方法[J]. 農業工程學報,2022,38(10):182-190.

LI Zimao, XU Jie, ZHENG Lu, et al. Small sample recognition method of tea disease based on improved DenseNet[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2022, 38(10): 182-190. (in Chinese with English abstract)

[6] 李大湘,曾小通,劉穎. 耦合全局與局部特征的蘋果葉部病害識別模型[J]. 農業工程學報,2022,38(16):207-214.

LI Daxiang, ZENG Xiaotong, LIU Ying. Apple leaf disease identification model by coupling global and patch features[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2022, 38(16): 207-214. (in Chinese with English abstract)

[7] HU R, ZHANG S, WANG P, et al. The identification of corn leaf diseases based on transfer learning and data augmentation[C]//Proceedings of the 2020 3rd International Conference on Computer Science and Software Engineering. Beijing, China: 2020: 58-65.

[8] SEMBIRING A, Away Y, ARNIA F, et al. Development of concise convolutional neural network for tomato plant disease classification based on leaf images[C]// International Conference on Industrial Automation, Smart Grid and its Application (ICIASGA) 2020. Jawa Timur, Indonesia: IOP Publishing, 2021, 1845(1): 012009.

[9] DURMUS H, GVNES E O, KIRCI M. Disease detection on the leaves of the tomato plants by using deep learning[C]// 2017 6th International Conference on Agro-geoinformatics. Fairfax, VA, USA: IEEE, 2017: 1-5.

[10] BIR P, KUMAR R, SINGH G. Transfer learning based tomato leaf disease detection for mobile applications[C]// 2020 IEEE International Conference on Computing, Power and Communication Technologies (GUCON). Greater Noida Fairfax: IEEE, 2020: 34-39.

[11] 王春山,趙春江,吳華瑞,等. 采用雙模態聯合表征學習方法識別作物病害[J]. 農業工程學報,2021,37(11):180-188.

WANG Chunshan, ZHAO Chunjiang, WU Huarui, et al. Recognizing crop diseases using bimodal joint representation learning[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2021, 37(11): 180-188. (in Chinese with English abstract)

[12] LIU B, ZHANG Y, HE D J, et al. Identification of apple leaf diseases based on deep convolutional neural networks[J]. Symmetry, 2017, 10(1): 11.

[13] XIANG X, ZHANG Y, JIN L, et al. Sub-region localized hashing for fine-grained image retrieval[J]. IEEE Transactions on Image Processing, 2021, 31: 314-326.

[14] LIU X, MIN W, MEI S, et al. Plant disease recognition: A large-scale benchmark dataset and a visual region and loss reweighting approach[J]. IEEE Transactions on Image Processing, 2021, 30: 2003-2015.

[15] WU Y, FENG X, CHEN G. Plant leaf diseases fine-grained categorization using convolutional neural networks[J]. IEEE Access, 2022, 10: 41087-41096.

[16] ZHENG X, SUN H, LU X, et al. Rotation-Invariant Attention Network for Hyperspectral Image Classification[J]. IEEE Transactions on Image Processing, 2022,4251-4265.

[17] HUGHES D, SALATHE M. An open access repository of images on plant health to enable the development of mobile disease diagnostics [EB/OL]. (2015-11-25). [2022-11-24]. https://arxiv.org/abs/1511.08060.

[18] 周敏敏. 基于遷移學習的蘋果葉面病害Android檢測系統研究[D]. 楊凌:西北農林科技大學,2019.

ZHOU Minmin. Apple Foliage Diseases Recognition in Android System with Transfer Learning-based[J]. Yangling: Northwest A&F University, China, 2019. (in Chinese with English abstract)

[19] HE K, ZHANG X, REN S, et al. Deep residual learning for image recognition[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. Las Vegas, NV, USA: IEEE, 2016: 770-778.

[20] HU J, SHEN L, SUN G. Squeeze-and-excitation networks[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. Salt Lake City, UT, USA: IEEE, 2018: 7132-7141.

[21] WOO S, PARK J, LEE J Y, et al. Cbam: Convolutional block attention module[C]//Proceedings of the European Conference on Computer Vision (ECCV). Munich, Germany: Springer, Cham, 2018: 3-19.

[22] CHOLLET F. Xception: Deep learning with depthwise separable convolutions[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. Honolulu, HI, USA: IEEE, 2017: 1251-1258.

[23] HINTON G, VINYALS O, DEAN J. Distilling the knowledge in a neural network [EB/OL]. (2015-03-09). [2022-11-24]. https://arxiv.org/abs/1503.02531.

[24] ROMERO A, BALLAS N, KAHOU S E, et al. Fitnets: Hints for thin deep nets [EB/OL]. (2014-12-19). [2022-11-24]. https://arxiv.org/abs/1412.6550.

[25] YIM J, JOO D, BAE J, et al. A gift from knowledge distillation: Fast optimization, network minimization and transfer learning[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. Honolulu, HI, USA, IEEE, 2017: 4133-4141.

[26] ZAGORUYKO S, KOMODAKIS N. Paying more attention to attention: Improving the performance of convolutional neural networks via attention transfer [EB/OL]. (2016-12-12). [2022-11-24]. https://arxiv.org/abs/1612.03928.

[27] ZHOU G, FAN Y, CUI R, et al. Rocket launching: A universal and efficient framework for training well-performing light net[C]//Proceedings of the AAAI Conference on Artificial Intelligence. Palo Alto, California USA: Computer Science, 2018, 32(1).

[28] AHN S, HU S X, DAMIANOU A, et al. Variational information distillation for knowledge transfer[C]// Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. Beach, CA, USA: 2019: IEEE, 9163-9171.

[29] DOSOVITSKIY A, BEYER L, KOLESNIKOV A, et al. An image is worth 16x16 words: Transformers for image recognition at scale [EB/OL]. (2020-10-22). [2022-11-24]. https://arxiv.org/abs/2010.11929.

[30] MEHTA S, RASTEGARI M. Mobilevit: light-weight, general-purpose, and mobile-friendly vision transformer [EB/OL].(2021-10-05).[2022-11-24].https://arxiv.org/abs/2110.02178.

[31] DU R, CHANG D, BHUNIA A K, et al. Fine-grained visual classification via progressive multi-granularity training of jigsaw patches[C]//European Conference on Computer Vision. Glasgow, UK: Springer, Cham, 2020: 153-168.

[32] CHANG D, DING Y, XIE J, et al. The devil is in the channels: Mutual-channel loss for fine-grained image classification[J]. IEEE Transactions on Image Processing, 2020, 29: 4683-4695.

[33] HOWARD A, SANDLER M, CHU G, et al. Searching for mobilenetv3[C]//Proceedings of the IEEE/CVF international conference on computer vision. Seoul, Korea (South): IEEE,2019: 1314-1324.

[34] MA N, ZHANG X, ZHENG H T, et al. Shufflenet v2: Practical guidelines for efficient cnn architecture design[C]//Proceedings of the European Conference on Computer Vision (ECCV). Munich, Germany: Springer, Cham,2018: 116-131.

[35] SELVARAJU R R, COGSWELL M, DAS A, et al. Grad-cam: Visual explanations from deep networks via gradient-based localization[C]//Proceedings of the IEEE International Conference on Computer Vision.Venice, Italy:IEEE, 2017: 618-626.

Identifying apple leaf disease using a fine-grained distillation model

LI Daxiang, HUA Cuiyun, LIU Ying

(,,710121,)

Apple trees are susceptible to various diseases that caused by weather, environment and microorganisms. The leaves of plants are the most common parts of the disease. The small area and similar symptoms of diseases have also posed great challenges on the manual observation and experience judgment in recent years. The disease type cannot be diagnosed in time, resulting in the huge losses in apple production. Deep learning can automatically extract features in crop diseases, but it also suffers from an excessive number of parameters and high computational effort. Furthermore, various lightweight architectures have been constructed to provide the strong technical support for the deployment of crop disease identifications, such as less network parameters, less computation, simple models, and low practicability of deep learning models. However, the direct application or improvement of the existing light convolutional neural network (CNN) can fail to further optimize the fine-grained problem in "small variance between classes and large variance within classes" of apple leaf diseases. Multiple CNN frameworks or attention modules can be utilized to consider the coarse-grained global and fine-grained local features of apple leaf diseases. It is necessary for the small number of parameters to meet the requirements of smart agriculture for mobile deployment. In this study, a fine-grained knowledge distillation (FGKD) model was proposed to improve the CNN accuracy in the disease identification of apple leaf suitable for the deployment to smart agricultural mobile terminals. Firstly, contextual information and spatial-semantic relations were used to design the spatial attention (SA) and fine-grained feature extraction (FGFE) modules respectively, and they were embedded into Resnet50 and the designed light CNN as teacher and student networks. Secondly, the SA and FGFE knowledge distillation loss functions were constructed to transfer the feature extraction and fine-grained knowledge representation of the teacher to the student network, in order to enhance the local feature extraction and high-level semantic expression of apple leaf disease images. Finally, the performance of the light student network was close to that of the complex teacher network under the condition of a small number of parameters. The comparative test was carried out on the standard apple leaf disease dataset. The results show that the accuracy of the student network was 98.60% after knowledge distillation, while the number of model parameters was only 0.75 MB, and the average inference time was 25.51 ms. The automatic identification of apple leaf diseases was be rapidly and accurately realized to fully meet the needs of the model of the actual smart agriculture mobile terminals. The SA module and SA distillation function were designed to combine the contextual information and spatial attention, in order to effectively improve the extraction of local information about the disease. The spatial-semantic relationship aggregation of fine-grained features was used to enhance the extraction and expression of high-level semantic information about the disease.

computer vision; image processing; apple tree leaf disease identification; fine grain knowledge distillation; contextual spatial attention

2022-11-24

2023-03-22

國家自然科學基金(62071379);陜西省自然科學基金(2017KW-013);西安郵電大學創新基金(CXJJYL2022014)

李大湘,博士,副教授,碩士生導師,研究方向為遙感圖像分類、病害圖像識別與機器學習。Email:www_ldx@163.com

10.11975/j.issn.1002-6819.202211209

S24; TP391.4; S431.9

A

1002-6819(2023)-07-0185-10

李大湘,滑翠云,劉穎. 面向蘋果葉部病害識別的細粒度蒸餾模型[J]. 農業工程學報,2023,39(7):185-194. doi:10.11975/j.issn.1002-6819.202211209 http://www.tcsae.org

LI Daxiang, HUA Cuiyun, LIU Ying. Identifying apple leaf disease using a fine-grained distillation model[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2023, 39(7): 185-194. (in Chinese with English abstract) doi:10.11975/j.issn.1002-6819.202211209 http://www.tcsae.org