基于光照自適應(yīng)調(diào)節(jié)和模糊分類的人臉圖像質(zhì)量提升算法研究

景 輝,戴琳琳,候亞偉,朱宇豪,隨玉騰

(1. 中國鐵道科學(xué)研究院集團(tuán)有限公司 電子計算技術(shù)研究所,北京 100081;2. 北京經(jīng)緯信息技術(shù)有限公司,北京 100081)

人臉識別技術(shù)在鐵路人臉核驗閘機(jī)中得到了廣泛的應(yīng)用[1-3]。受限于鐵路的復(fù)雜場景,采集到的人臉會受到光照條件和人臉圖像模糊等因素的影響。為提高人臉識別的準(zhǔn)確率,提升旅客的進(jìn)站體驗,亟需解決鐵路場景中采集人臉圖像光照條件不理想和模糊的問題。

非理想的光照條件下采集的圖像可能存在大面積的高響應(yīng)區(qū)域或缺失紋理細(xì)節(jié)的低響應(yīng)區(qū)域,這種光照異常的圖像會降低人臉識別算法的準(zhǔn)確率。同時,旅客的個人習(xí)慣會導(dǎo)致閘機(jī)采集到部分模糊圖像。通常,模糊類別主要包括失焦模糊[4]和運(yùn)動模糊[5]。失焦模糊由相機(jī)和物體間聚焦失準(zhǔn)導(dǎo)致,運(yùn)動模糊由相機(jī)和物體的相對位移造成。由于采用了自動對焦等技術(shù),運(yùn)動模糊是當(dāng)前鐵路場景人臉圖像模糊的主要因素。運(yùn)動模糊的人臉圖像在人臉識別算法處理的過程中,會降低人臉的可分辨性,增加人臉識別算法的誤識率。

針對上述問題,現(xiàn)有的研究多聚焦于基于光照補(bǔ)償和去模糊的圖像增強(qiáng)算法。針對非理想光照問題,文獻(xiàn)[6]提出基于方向濾波和自商圖像的人臉光照補(bǔ)償;文獻(xiàn)[7]提出基于改進(jìn)Gamma校正的人臉圖像光照補(bǔ)償算法;文獻(xiàn)[8]提出基于小波商圖像的人臉光照補(bǔ)償;文獻(xiàn)[9]提出基于線性子空間和商圖像理論的人臉光照補(bǔ)償。本文在分析了多種人臉光照補(bǔ)償方法后,提出一種人臉光照自適應(yīng)調(diào)節(jié)算法。該算法能根據(jù)人臉亮度對人臉的光照強(qiáng)度進(jìn)行自適應(yīng)調(diào)節(jié),減小光照對人臉圖像的影響。

針對人臉模糊問題,文獻(xiàn)[10—11]將人臉模糊歸到人臉質(zhì)量問題中,結(jié)合人臉識別完成人臉質(zhì)量評估;文獻(xiàn)[12—13]通過對模糊人臉進(jìn)行去模糊,來消除人臉模糊問題;文獻(xiàn)[14]通過對運(yùn)動模糊圖像的模糊核進(jìn)行估計,來解決圖像模糊。然而,通過去模糊技術(shù)消除模糊人臉的方法很難保證其泛化性。為更好的解決人臉運(yùn)動模糊問題,本文發(fā)現(xiàn)將人臉運(yùn)動模糊問題當(dāng)作分類問題進(jìn)行解決效果顯著。因此,本文設(shè)計了一個分類模型,以解決人臉運(yùn)動模糊問題。

1 人臉光照自適應(yīng)調(diào)節(jié)算法

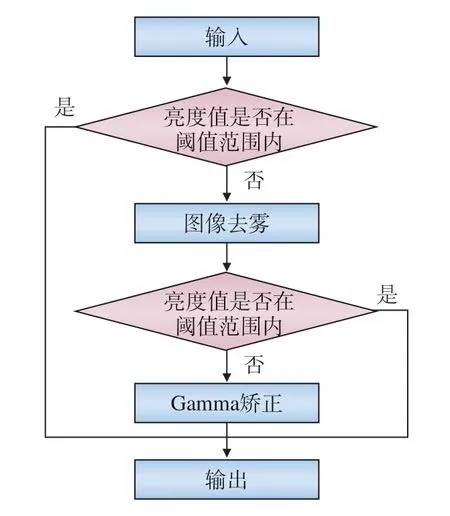

鐵路站房設(shè)計的不統(tǒng)一和車站閘機(jī)擺放位置的差異,導(dǎo)致閘機(jī)采集到的面部圖像亮度差異較大,本文使用AFLW2000數(shù)據(jù)集的圖片模擬鐵路場景光照對人臉的影響,如圖1所示。為消除人臉圖像亮度差異對人臉識別算法造成的影響,本文設(shè)計了人臉光照自適應(yīng)調(diào)節(jié)算法,算法步驟如圖2所示。

圖1 模擬鐵路場景光照對人臉影響

圖2 人臉光照自適應(yīng)調(diào)節(jié)算法流程

本文通過HSV顏色空間的亮度值來判斷圖像的亮度值,對亮度值不在閾值范圍內(nèi)的圖像,先進(jìn)行去霧處理,對去霧后的圖像,再次進(jìn)行亮度值判斷,若亮度值仍不在閾值范圍,對圖像進(jìn)行Gamma矯正后輸出。

1.1 顏色空間轉(zhuǎn)換

攝像頭采集到的圖像多為RGB顏色空間,RGB顏色空間不能表示圖像的亮度信息。為了能夠根據(jù)圖像的亮度對人臉圖像進(jìn)行光照自適應(yīng)調(diào)節(jié),需要進(jìn)行圖像的顏色空間轉(zhuǎn)換,即將圖像由RGB空間轉(zhuǎn)換到HSV空間。HSV空間中的明度(V,Value)表示顏色明亮的程度,通過計算圖像明度的均值,能夠較好的體現(xiàn)圖像的亮度信息。本文的顏色空間轉(zhuǎn)換僅用于圖像亮度值的判斷,在暗通道去霧和圖像Gamma矯正中,均使用RGB圖像作為輸入。

1.2 基于暗通道的圖像去霧

暗通道先驗理論[15]是基于對大量戶外無霧圖像的觀察所得到的統(tǒng)計規(guī)律,即在大多數(shù)不包含天空區(qū)域的圖像中,存在一些像素點至少有一個通道的像素值接近于0。用J表示沒有霧的圖像,則圖像的暗通道像素值可表示為

其中,J dark表示圖像的暗通道像素值;J c表示圖像的r、g、b 3個通道的像素值,通過遍歷處理J c的像素值生成J dark;x為圖像遍歷過程中的錨點;Ω(x)表示以x為中心的方形窗口;y表示本窗口內(nèi)所有的像素值。

根據(jù)暗通道先驗理論優(yōu)化有霧圖像,需分析有霧圖像的形成模型,一般采用的公式為

其中,I(x)表示有霧圖像;x指圖像中每個像素點;J(x)表示無霧圖像;t(x)是光線在散射作用下的傳輸函數(shù);A表示全局大氣光成分;1 -t(x)表示光照散射作用的系數(shù)。該模型認(rèn)為有霧圖像由兩部分組成:(1)J(x)t(x)為有霧圖像中成像物體反射光的部分,成像物體反射光受大氣中懸浮粒子的吸收和散射作用,造成目標(biāo)反射光能量的衰減;(2)A·(1-t(x))表示有霧圖像中大氣光部分,太陽光等環(huán)境光受大氣散射介質(zhì)的散射作用形成背景光。

采用暗通道去除的方法進(jìn)行圖像去霧,處理公式為

其中,t0表示預(yù)設(shè)的傳輸函數(shù)的最小值,通常取0.1。可對采集到的不滿足光照約束的人臉圖像進(jìn)行去霧,并對去霧后的圖像依據(jù)圖像亮度值判斷當(dāng)前圖像是否需要進(jìn)行光照調(diào)節(jié),若需要,則進(jìn)行圖像Gamma矯正。

1.3 圖像Gamma矯正

由于人眼對光照的感受是呈非線性變化的,對暗區(qū)的變化較敏感,對亮區(qū)的變化較遲鈍。為使圖像在展示時符合人眼的習(xí)慣,在圖像采集的過程中,會進(jìn)行非線性編碼。但由于圖像編碼位寬的限制,圖像在編碼過程中會丟失部分?jǐn)?shù)據(jù),造成圖像質(zhì)量的降低,通常采用Gamma矯正[16]的方法進(jìn)行圖像質(zhì)量的提升。Gamma矯正采用冪函數(shù)的形式

其中,N(x)是圖像像素值歸一化到[0,1]后的像素值;f(x)是圖像經(jīng)過Gamma矯正后的輸出值;gamma是常量,根據(jù)任務(wù)的不同設(shè)置不同的值,如對過亮、對比度過大的圖像,設(shè)置gamma>1,對亮度值過暗、對比度過小的圖像,設(shè)置gamma<1。

為實現(xiàn)人臉光照自適應(yīng)調(diào)節(jié),本文提出自適應(yīng)Gamma調(diào)節(jié)算法,公式為

其中,f(x)表示經(jīng)過自適應(yīng)Gamma矯正后的輸出值;K(x)表 示原始圖像的像素值; mean(K(x))表示圖像的亮度均值,代表圖像的整體亮度值;std(K(x))表示圖像的亮度標(biāo)準(zhǔn)差,代表圖像的對比度。本方法可根據(jù)圖像的亮度和對比度情況,自適應(yīng)設(shè)置gamma值,實現(xiàn)圖像亮度和對比對度的自適應(yīng)調(diào)節(jié)。

2 模糊識別模型

本文提出一種人臉模糊識別數(shù)據(jù)集的制作方法,基于MobileNetV2的深度可分離模塊設(shè)計了特征值注意力模塊,構(gòu)建了最基礎(chǔ)的模糊識別模型,在此基礎(chǔ)上,設(shè)計了局部賦權(quán)模塊,對模糊識別模型中人臉圖像上不同的圖塊賦予不同的權(quán)值,并提出使用Arcface loss[4]作為人模糊識別模型的損失函數(shù)。

2.1 數(shù)據(jù)集的制作

在模糊識別領(lǐng)域,公開數(shù)據(jù)集主要集中在通用模糊識別方向,由于人臉模糊識別的特殊性,如面部區(qū)域平滑,缺少有效的邊緣信息等特點,缺少充足的公開數(shù)據(jù)進(jìn)行算法訓(xùn)練。本文在研究過程中發(fā)現(xiàn),鐵路領(lǐng)域人臉圖像的模糊主要由旅客在過閘機(jī)時的瞬間移動造成,由運(yùn)動方向和運(yùn)動程度2個因素決定[17]。因此,本文基于高斯濾波理論,設(shè)計了人臉模糊圖像生成算法,使用高斯核尺寸模擬運(yùn)動模糊程度,使用高斯核方向模擬運(yùn)動方向。將人臉運(yùn)動方向劃分為18個區(qū)間,每個區(qū)間表示20度。將運(yùn)動程度分為7個級別,分別使用高斯核尺寸3、4、5、6、7、8、9表示。在角度為20的情況下,不同運(yùn)動程度生成的模糊圖像如圖3所示。

圖3 清晰圖像與不同運(yùn)動程度生成的運(yùn)動模糊圖像

本文把人臉模糊識別算法定義為二分類任務(wù),即模糊、非模糊兩類。按不同的運(yùn)動程度,把原圖、1級、2級、3級4類圖像歸為清晰圖像,把4級、5級、6級、7級4類圖像歸為模糊圖像。

2.2 網(wǎng)絡(luò)模型設(shè)計

為提升人臉模糊圖像識別準(zhǔn)確率,解決圖像局部模糊識別,增加模糊識別的可控性,設(shè)計了特征圖注意力模塊和局部賦權(quán)模糊識別算法。

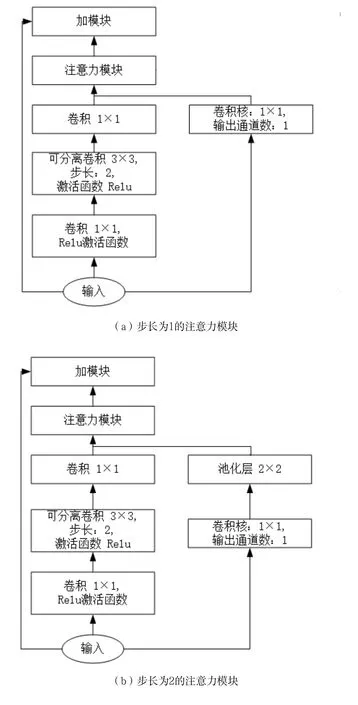

2.2.1 特征圖注意力模塊

疫情期間,旅客乘坐列車需佩戴口罩,由于口罩缺少皮膚紋理和邊緣信息,會影響模糊識別算法的準(zhǔn)確率。因此,本文設(shè)計了特征圖注意力模塊,以提升網(wǎng)絡(luò)對口罩部分的過濾和非口罩區(qū)域的關(guān)注。本模塊基于MobileNetV2的深度可分離模塊,在輸入和輸出間增加了一個1×1的卷積,該卷積把圖像從多通道映射為單通道的特征圖,本特征層可有效提升模型對不同區(qū)域的注意力分布,以提升在佩戴口罩情況下的模糊人臉圖像識別準(zhǔn)確率。針對卷積步長為1和卷積步長為2,設(shè)計了2種模塊,模塊的結(jié)構(gòu)如圖4所示。

圖4 特征圖注意力模塊結(jié)構(gòu)

2.2.2 局部賦權(quán)模塊

為避免背景模糊和局部模糊對人臉模糊識別準(zhǔn)確率的影響,本文設(shè)計了局部賦權(quán)模塊,輸入是經(jīng)過人臉檢測算法后的面部圖像,在輸入網(wǎng)絡(luò)前會經(jīng)過尺度變換,尺寸統(tǒng)一變換為3×112×112,如圖5所示。

本文設(shè)計的主干網(wǎng)絡(luò)包含7個注意力模塊,把3×112×112的圖像映射為1 024×4×4的特征圖,特征圖中的每個位置對應(yīng)圖5(b)中相應(yīng)位置的特征值。最后通過1×1卷積,把1 024個通道映射為2個通道,對應(yīng)清晰與模糊兩個類別,再通過softmax計算清晰和模糊的概率值,作為神經(jīng)網(wǎng)絡(luò)的輸出,網(wǎng)絡(luò)結(jié)構(gòu)如圖6所示。

圖5 圖像分塊示意

圖6 局部賦權(quán)模塊網(wǎng)絡(luò)結(jié)構(gòu)

圖像在經(jīng)過模型的計算后,輸出2×4×4的介于[0,1]之間的2個通道的數(shù)組,其中第1個通道表示清晰程度的概率值,第2個通道表示模糊程度的概率值。

本文根據(jù)不同的面部塊包含人臉信息的重要程度,對數(shù)據(jù)進(jìn)行了進(jìn)一步的處理,對每塊賦予不同的權(quán)值,網(wǎng)絡(luò)輸出的第1個通道(圖像塊清晰概率值)與權(quán)重數(shù)組的點乘結(jié)果即為最終的得分,計算過程如圖7所示。

圖7 圖像清晰度計算過程

本文設(shè)0.3為是否清晰的判斷閾值,即最終得分大于0.3為清晰圖像,最終得分小于0.3為模糊圖像。

2.2.3 損失函數(shù)設(shè)計

在分類問題中一般采用softmax損失函數(shù),公式為

其中,N為批尺寸;n為類別數(shù);xi為第i個樣本的輸出;yi為第i個樣本所屬類別的輸出;Wj為第j個類別的權(quán)重;bj為第j個類別的偏置。

softmax損失函數(shù)雖然可實現(xiàn)分類的目的,但在分類時不能同時增大類內(nèi)相似性與類間差異性,降低了模型的分類性能。為此,本文采用ArcFace[18]損失函數(shù),公式為

其中,s為縮放比例; θyi為本類樣本與本類樣本特征值中心的特征值間的夾角;θj為非本類樣本與本類中心的特征值間的夾角。

為增大類內(nèi)相似性與類間差異性,對本類樣本與本類中心的特征值間加上一個決策邊界m,則損失函數(shù)為

3 算法實驗

3.1 圖像預(yù)處理

為提高模型的識別準(zhǔn)確率,需對輸入的圖像進(jìn)行預(yù)處理,圖8展示了人臉光照自適應(yīng)調(diào)節(jié)算法處理前后部分圖像的對比情況。

圖8 光照自適應(yīng)調(diào)節(jié)前后圖像對比

由圖8可看出,本文設(shè)計的人臉光照自適應(yīng)調(diào)節(jié)算法能較好地解決鐵路場景下人臉光照問題,經(jīng)過人臉光照自適應(yīng)調(diào)節(jié)算法處理后的圖像中的人臉更加清晰。

3.2 實驗與結(jié)果分析

本文的測試數(shù)據(jù)集采用自建的鐵路人臉模糊數(shù)據(jù)集,圖像均經(jīng)過光照自適應(yīng)調(diào)節(jié)算法處理。測試數(shù)據(jù)集中清晰圖像15 436張,模糊圖像794張。實驗環(huán)境:Win10操作系統(tǒng)、PyTorch1.8.1(CPU版)、Intel i7-8565U CPU、8 G內(nèi)存,使用Python進(jìn)行測試。

模糊識別作為一個分類任務(wù),可與主流的分類任務(wù)模型MobileNetV2進(jìn)行對比實驗,本文使用準(zhǔn)確率和召回率作為評價指標(biāo),對MobileNetV2模型、僅包含特征圖注意力模塊的基礎(chǔ)模糊識別模型(模糊識別模型-A)、使用了局部賦權(quán)模塊的模糊識別模型(模糊識別模型-B)和使用了局部賦權(quán)模塊與Arcface損失函數(shù)的模糊識別模型(模糊識別模型-C)進(jìn)行對比測試。準(zhǔn)確率的公式為

其中,TP表示正確的正例;FN表示錯誤的反例;FP表示錯誤的正例;TN表示正確的反例。

本實驗對使用不同的組件進(jìn)行了對比實驗。判斷是否清晰的閾值確定方式為:以0.01為步長,遍歷所有的0到1之間的數(shù),計算不同閾值情況下的模型準(zhǔn)確率,取準(zhǔn)確率最高的閾值作為模型的閾值。由表1可知,模糊識別模型-C的圖像識別準(zhǔn)確率提升到97.21%。

表1 不同模型的性能參數(shù)及準(zhǔn)確率

4 結(jié)束語

本文設(shè)計了人臉光照自適應(yīng)調(diào)節(jié)算法,該算法能夠較好地解決鐵路場景中的人臉光照問題,使人臉圖像亮度更適合進(jìn)行人臉識別。通過對人臉模糊情況進(jìn)行分析,設(shè)計了人臉模糊圖像制作的方法,構(gòu)建了鐵路人臉模糊數(shù)據(jù)集。設(shè)計并改進(jìn)了模糊識別算法模型,有效提升人臉模糊圖像的識別準(zhǔn)確率。