增強CT圖像的深度學習分類技術在卵巢腫瘤良惡性預測中的應用

廖 蔚,黃 強,張雅琳,高雪梅,梅 劼,

(1.西南醫科大學臨床醫學院,四川 瀘州 646000; 2.四川省醫學科學院·四川省人民醫院產科,四川 成都 610072; 3.電子科技大學臨床醫學院,四川 成都 610072)

卵巢惡性腫瘤早期多無特異性癥狀,因缺乏有效的早期診斷手段,當出現癥狀時往往已經進入晚期,因此卵巢惡性腫瘤患者的五年生存率低。相關研究表明,卵巢惡性腫瘤若能早期發現、及時準確的治療,患者五年生存率則可以得到的改善[1]。因此,若能找到一項對卵巢惡性腫瘤的早診斷有幫助的新技術,就可能幫助患者改善預后。經陰道超聲是目前臨床上篩查卵巢惡性腫瘤的最常用的影像學手段,但腸道氣體干擾、偽影、強度衰減、難以攝取全部圖像、重疊等因素使其應用存在一定局限性,導致篩查特異性低,甚至誤診[2]。計算機斷層掃描(computed tomography,CT)檢查可更好地顯示腫塊組織特征和判斷與周圍器官的關系,增強CT在卵巢腫瘤的診斷、術前評估、指導臨床治療中發揮著重要的作用[3]。但是在醫學成像領域,疾病的準確診斷取決于圖像采集和圖像解釋[4],依賴于醫生的技術水平和個人經驗,存在較大的主觀性,尤其是住院醫師以及偏遠基層醫院的影像醫師,他們臨床經驗有限,通過增強CT對卵巢腫瘤良惡性進行鑒別是有困難的。而人工智能在幫助我們提高診斷的準確性和客觀性上有著巨大的潛力。

深度學習(deep learning, DL)技術是目前人工智能(artificial intelligence,AI)領域的核心技術,它模仿人腦的神經網絡[5],能夠學習樣本數據的內在規律和表示層次,對原始數據處理能力強[6]。它的最終目標是讓計算機能夠像人一樣具有分析學習能力,能夠識別文字、圖像和聲音等數據。近幾年來,基于深度學習的圖像分析的相關研究已經涉及肝臟、腦部、甲狀腺、血管等部位[7~10]以及惡性腫瘤(如乳腺癌、肝臟癌癥)等病灶組織的識別[11],它不僅提高了醫學影像處理效率,還能夠通過算法和預處理等操作提高處理精度。

本次研究嘗試尋找適合卵巢腫瘤良惡性分類的深度學習模型。我們利用卵巢腫瘤患者的增強CT圖像對深度學習中的NASNet神經網模型進行訓練,以手術后的組織病理學檢查結果為確診標準,建立基于卵巢腫瘤增強CT圖像良惡性預測二分類模型,評估其在鑒別卵巢包塊良惡性的臨床價值。在研究中將建立的DL模型同影像專科主治醫師的診斷水平做比較,以此來證明我們建立的DL模型可以在影像科住院醫師及基層醫生通過CT判斷卵巢腫瘤良惡性時提供比較準確的結果供他們參考。

1 資料與方法

1.1 一般資料收集2018年7月至2022年5月在四川省人民醫院因卵巢腫瘤住院行盆腹腔增強CT檢查的114例卵巢腫瘤患者,對患者信息進行脫敏處理后編號,其中1~75號為術后病理檢查確診為惡性腫瘤患者,76~114號為確診為良性腫瘤患者。按2∶1的比例隨機劃分為訓練集和測試集。在PACS系統中選取盆腹腔增強CT圖中病灶區域完整且邊緣清晰易于標注的圖像,其中訓練集76例共計2991幅圖像,包含惡性腫瘤病例50例1698幅圖像,良性腫瘤病例26例1293幅圖像。測試集38例共2050幅圖像,惡性腫瘤病例25例1284幅圖像,良性腫瘤患者病例13例766幅圖像。存儲為醫學數字成像和通信(digital imaging and communications in medicine, DICOM)格式。

1.2 方法

1.2.1訓練集標簽圖制作及模型的建立 為了最大程度保證訓練數據的準確性與客觀性,由一名影像專科主治醫師手動勾畫出訓練集卵巢病灶的邊界。標簽值分為兩類,標注的區域為病灶,其余為背景。標注完成后,使用Python腳本生成遮罩圖像,考慮到直接使用原始增強CT圖像會引入大量與腫瘤良惡性判斷無關的干擾信息,最終選擇通過分割后的遮罩圖確定原始增強CT圖像中腫瘤的位置,隱去其余部分得到僅包含腫瘤組織的增強CT圖像, 將完成預處理后的訓練集數據預處理送入NASNet神經網絡完成模型訓練。

1.2.2分組測試 分別由影像專科主治醫師和訓練成功的DL模型分別對測試集進行良惡性診斷,在DL模型診斷測試集時使用本研究中同時建立的改進U-Net模型算法對測試集進行自動分割,所得分割結果經訓練后的NASNet神經網絡分類。測試結果中,單個病例的CT圖像惡性占比超過34%即患者判定為惡性患者。將分類結果同影像專科主治醫師的判斷結果做比較。

1.3 觀察指標計算DL模型分類的靈敏度、特異度、準確性、AUC作為衡量模型效能的指標。利用約登指數(Yu-denlndx,YI)最大法確定單個病例判定為惡性腫瘤的CT圖片百分比閾值。

1.4 統計學方法應用SPSS 22.0統計學軟件對數據進行分析。統計學方法使用配對卡方檢驗以及Kappa一致性檢驗。Kappa值>0.75表示組間比較一致性好。P<0.05為差異有統計學意義。

2 結果

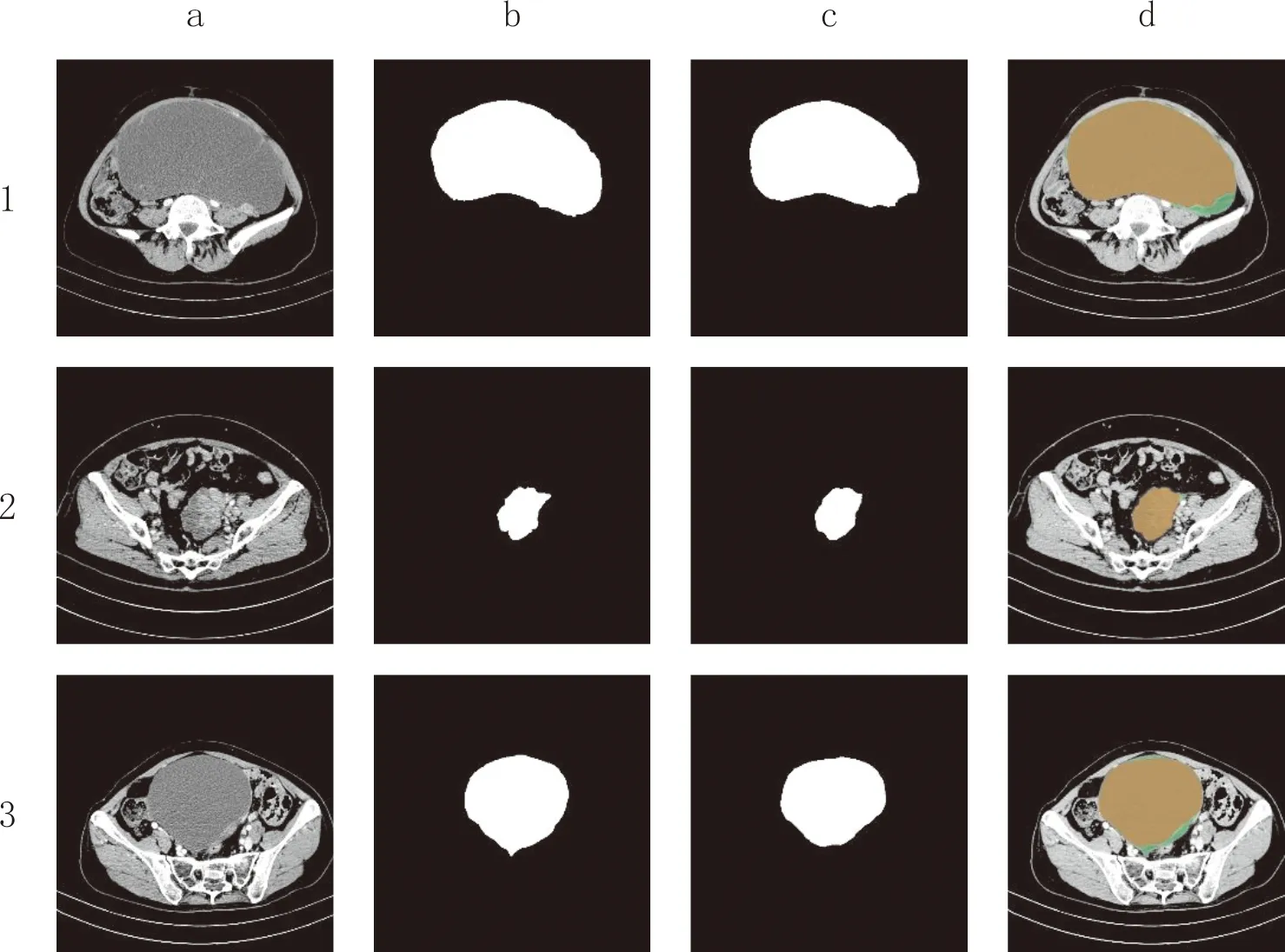

2.1 自動分割結果利用本研究同時建立的改良U-Net算法模型實現測試集的自動分割,實現了分割-診斷自動化。即由U-Net分割模型自動勾畫出卵巢腫瘤病灶(如圖1、2),然后提供給NASNet神經網模型實現良惡性自動預測。圖1圖2中,a列代表原始圖,b列代表手動勾畫邊界,c列代表自動分割邊界,d列代表分割耦合圖像。在分割耦合圖像中,深黃色區域代表模型的分割結果,綠色區域代表標簽手動分割圖像。可以看出自動分割的結果與影像專科醫師手動分割的結果高度吻合,可以為NASNet神經網絡分類模型提供準確的測試標簽。

圖1 惡性腫瘤病例使用改進U-Net自動分割效果

圖2 良性腫瘤病例使用改進U-Net分割效果

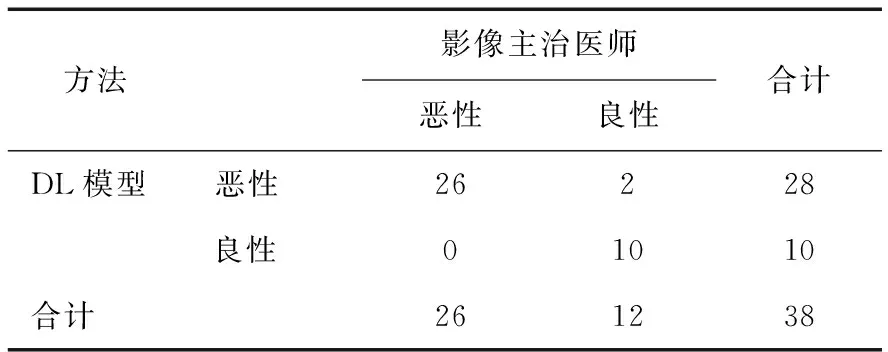

2.2 分類測試結果最大YI為0.769,對應閾值的惡性圖片占比為34%,此情況下模型的靈敏度為100%,特異度為76.9%,準確度為92.1%,AUC為0.88(如圖3)。影像專科主治醫師對測試集良惡性診斷的靈敏度為96%,特異性84.6%,準確性92.1%。通過U-Net分割模型對分類模型自動提供標簽,約21分鐘就對38例測試患者完成了良惡性的判斷,而影像專科主治醫師耗時約為5.5小時。影像專科主治醫師同DL模型診斷效果比較差異無統計學意義(P>0.05);Kappa=0.872(Kappa>0.75),兩者診斷效能高度一致。見表1。

表1 DL模型與影像專科主治醫師測試結果比較 (n)

圖3 DL模型診斷卵巢腫瘤良惡性的ROC曲線圖

3 討論

卵巢惡性腫瘤若能早期發現,及早治療,則可以擁有較好的五年生存率[1]。CT檢查成像結果在卵巢腫瘤疾病診斷、手術術前評估、指導臨床治療中發揮著重要的作用,但醫學影像診斷始終存在主觀性,會不可避免的造成對部分圖像診斷的偏差。同時,我國醫療影像數據每年30%的速度增長,而影像醫生的年增速僅為 4%~6%[12],人工讀片的效率低,花費時間多,僅靠人工讀片已難以滿足影像數據增加所帶來的需求。因此,我們嘗試在深度學習技術中尋找合適的算法模型,結合卵巢腫瘤的增強CT圖建立預測卵巢腫瘤良惡性的二分類模型。

在本研究中,我們利用卵巢腫瘤患者的增強CT圖片訓練了深度學習中的NASNet神經網絡模型,建立了預測卵巢腫瘤良惡性的二分類模型,預測的靈敏度為100%,特異度為76.9%,準確度為92.1%,AUC為0.88。相對于影像專科主治醫師,DL分類模型顯示出更高的靈敏度,類似的準確性和稍差的特異性。兩者的診斷效果在通過配對卡方檢驗在統計學上相比較P值為0.5>0.05,兩者差異無統計學意義。通過kappa一致性檢驗對比,Kappa值為0.872>0.75,說明本DL模型對卵巢腫瘤良惡性的預測結果與影像專科主治醫師的診斷結果有高度的一致性,且DL模型的效率約是影像專科主治醫師的16倍,效率更高。既往研究中,Liu[13]等發表的Meta分析指出CT診斷惡性卵巢腫瘤的靈敏度可以達到85%,特異性達86%;Dodge等[14]發表的系統綜述指出CT對可疑為卵巢惡性腫瘤的附件包塊診斷的靈敏度為87.2%,特異性為84.0%。而在傳統機器學習領域,Akazawa等[15]通過使用機器學習算法根據卵巢腫瘤患者的術前檢查數據建立模型預測卵巢腫瘤的病理診斷,最終得出梯度增強模型的預測準確率最高可達到80%。Martinez-Mas等[16]通過分析348卵巢癌患者的超聲圖像特征,運用機器學習算法建立分類模型,最優的分類模型對卵巢腫瘤的良惡分類的準確率可以達到85%。本研究利用卵巢腫瘤增強CT圖像建立的DL分類模型對卵巢腫瘤良惡性的判定結果與影像專科主治醫師有較好的一致性。而對比之前建立的傳統機器學習模型,深度學習技術應用于診斷卵巢腫瘤良惡性的效果也更好,且可自動提取原始數據的特征,效率更高,模型的效能更是會隨著訓練數據量的增加而增加。但相對于經驗豐富的影像專科醫生,本研究所建的分類模型特異性相對低,因此需要在測試中不斷反饋良性腫瘤的數據,提高模型的特異性。

在模型建立的過程中,總體病例數較小可能是影響模型特異性相對偏低的一個原因。此外,訓練集中良性患者病例少于惡性患者病例,這也可能導致本分類模型在測試時將結果偏向數據量更大的惡性患者,導致出現假陽性,引起特異性低。但是深度學習技術的模型性能會隨著訓練數據的提升而改善,因此,只要不斷的補充數據進行訓練,分類模型的性能就能得到提升。

利用深度學習技術對醫學圖像進行分割的相關研究在近幾年也迅速興起。本研究中分類模型測試集分割則采用在本研究中同時建立的改良的U-net分割模型進行,分割結果如圖1、圖2,自動分割的結果與影像專科醫師手動分割的結果高度吻合,可以為NASNet神經網絡分類模型提供準確的測試標簽,實現了卵巢腫瘤CT圖像的自動分割到良惡性診斷一體化,工作效率相較于影像科專科主治醫生大大提高。未來,我們還計劃將患者的術前腫瘤標志物同卵巢腫瘤的增強CT的圖像相結合,建立一個融合模型來預測卵巢腫瘤的良惡性,進一步提升模型的診斷效能。

本研究也存在很多局限性,此研究為單一的醫療中心進行的回顧性研究,病例數量相對較少,尤其是良性腫瘤患者的增強CT數據收集較困難,因此分類模型可能出現過度擬合[17]。模型的性能需要在未來的多中心研究、前瞻性研究中進一步得到驗證并且進行反饋優化。

綜上,利用卵巢腫瘤增強CT圖像訓練得到的DL二分類模型對卵巢良惡性的判斷具有較好的靈敏度、準確度、特異度,在卵巢腫瘤良惡性判別上是可行的,且結合U-net自動分割模型可以提高工作效率。