基于Gist和IPCA算法的多文種離線手寫簽名識別*

韓 輝,麥合甫熱提,吾爾尼沙·買買提,朱亞俐,庫爾班·吾布力,

(1.新疆大學信息科學與工程學院,新疆 烏魯木齊 830046;2.新疆多語種信息技術重點實驗室,新疆 烏魯木齊 830046;3.新疆大學教務處,新疆 烏魯木齊 830046)

1 引言

生物特征為人體所固有且不可復制、不會失竊和不會被遺忘,利用生物特征進行身份識別安全、可靠、準確。手寫簽名作為一種有效并且被法律認可的生物行為特征,被廣泛應用于金融、司法、銀行和保險等各個領域[1]。手寫簽名根據數據獲取方式的不同分為在線手寫簽名和離線手寫簽名[1,2];根據數據組成和分類方法的不同可分為手寫簽名識別和手寫簽名鑒別[2]。手寫簽名自被提出可以用于進行身份識別至今,針對世界主流語言文字的研究已經取得了豐碩的成果,但是對于我國少數民族語言以及多文種混合的簽名識別研究仍處于發展階段。

Ubul等人[3]通過提取維吾爾文離線手寫簽名的多維改進的網格信息特征,并采用歐氏距離ED(Euclidean Distance)、K近鄰KNN(K-Nearest Neighbor)和貝葉斯網絡3種分類器對維吾爾文離線手寫簽名進行分類識別,最終得到了93.53%的平均準確率。Pal等人[4]提出了一種基于前景和背景的雙語脫機簽名識別技術,采用梯度直方圖HOG(Histogram of Oriented Gradient)和Zernike矩等特征,在支持向量機SVM(Support Vector Machine)分類器下得到了最高為97.70%的識別率,但是該工作只進行了文種的識別,并沒有實現把簽名圖像分類到用戶個體。Serdouk等人[5]從CEDAR和GPDS-300這2個數據集中提取了圖像的梯度局部二值模式GLBP(Gradient Local Binary Patterns)并利用SVM分類器進行簽名鑒別,最終在2個數據集上分別得到了9.58%和14.01%的平均錯誤率。劉利利[6]采用形狀上下文特征在GPDS960和自建的離線手寫簽名鑒別數據庫上進行了實驗,分別得到了誤拒率為9.75%、誤納率為12.89%和誤拒率為12.38%、誤納率為18.27%的效果。魏佳敏等人[7]通過提取圖像的靜態特征和偽動態特征并進行有效融合,在極限學習機和稀疏表示的兩階段分類中取得了95.53%的平均準確率,但是該工作的缺點是分類數量少,文字形式單一。艾海提·伊敏等人[8]通過提取局部中心點和ETDT 2種特征并進行有效融合,同時使用絕對距離、歐氏距離、卡方距離和cosine距離進行分類識別,最終得到了最高為98.70%的平均準確率。Mo等人[9]提出了一種基于離散曲波變換的多文種離線手寫簽名識別方法,在我國2種少數民族語言維吾爾語和柯爾克孜語中實現了較好的識別準確率。

本文針對多文種混合模式的離線手寫簽名識別展開研究。由于離線手寫簽名圖像有效的筆畫部分普遍比較稀疏,存在大量的無效白色背景,但是目前現有的特征提取方法大多是對圖像整體表層內容進行描述,這樣會使得提取到的特征存在大量的冗余,不利于提高識別準確率。而如果想要提高識別準確率,則需要依賴大量的訓練數據和提取多個特征并進行有效融合,這樣又會造成提取的特征過多和特征維度過大,最終計算困難影響識別效率。為此,本文提出了一種基于Gist和增量主成分分析IPCA(Incremental Principal Component Analysis)算法的多文種離線手寫簽名識別方法,利用Gist特征對靜態圖像的宏觀全局意義上的特征進行描述,使其在特征提取的過程中更多地聚焦到簽名圖像的整體布局和筆畫部分,而忽略圖像無效白色背景;同時,利用IPCA算法的批處理方式,把提取的數據特征逐批加載到內存中,遞增式更新特征的主成分,以達到在對識別效果影響很小的情況下大大提高運行效率。本文使用漢語、英語和我國少數民族語言維吾爾語3個不同的數據集對本文方法進行實驗。由于這3種語言來自不同中文的語系(漢語:漢藏語系,英語:印歐語系,維語:阿爾泰語系),所以能有效證明本文所提方法的有效性,而且本文還混合3種數據后進行了實驗,最后都使用SVM分類器進行識別分類。實驗結果表明,本文提出的方法即使使用少量的訓練數據,無論是在單文種還是在多文種混合的數據上進行實驗,其識別準確率與之前相關研究相比都表現較優。

2 離線手寫簽名識別

離線手寫簽名識別是模式識別研究領域的一個重要研究方向。類似于其他模式識別問題的實驗流程,離線手寫簽名識別的基本步驟包括簽名圖像數據采集、圖像預處理、特征提取、分類決策4個步驟。本文方法的具體實驗流程如圖1所示。

Figure 1 Experimental procedure of the proposed method圖1 本文方法實驗流程

(1)簽名數據采集。在數據采集的過程中,首先要求每位簽名者將自己的名字書寫在已被等分成橫七豎三共21個矩形方框的一張A4紙上。之后,把每一份手寫簽名樣本通過掃描儀以300 dpi的分辨率掃描成電子圖像,并以“.jpg”格式保存在計算機中。然后,使用切圖工具將其處理成一個個單獨的簽名樣本圖像,并以“.bmp”格式24位圖像保存在數據集中。

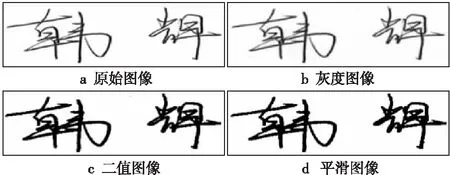

(2)數據預處理。為了更好地保留簽名圖像類內相似性和類間差異性,在對簽名圖像進行特征提取之前需要先對其進行預處理操作,以最大限度地保留簽名本身的信息。本文首先依次使用高斯濾波、全局平均閾值和Unger平滑算法[10]對圖像進行去噪、二值化和平滑等預處理操作;然后去除簽名圖像無效邊緣背景,并使用最鄰近插值法進行簽名圖像的尺寸歸一化(96*384)。預處理后的圖像如圖2所示。

Figure 2 Pre-processing renderings圖2 預處理效果圖

(3)特征提取。特征提取是簽名識別過程中最重要的一環,提取的特征優異與否,將直接影響分類識別的結果。本文針對離線手寫簽名有效特征稀疏難以提取的問題,提出了一種基于Gist和IPCA算法的多文種離線手寫簽名識別方法,且分別將特征維度k設置為60,80,100,120和140進行對比實驗。

(4)訓練和測試。本文選取每位簽名者的前S(=5,8,11,14,17)個簽名用于訓練,其余的用于測試,使用SVM分類器對實驗數據進行分類識別,并對實驗結果進行比較分析。

3 特征提取與降維

3.1 Gist特征提取

“Gist”最初源自于1979年Friedman的論文[11],用來對場景進行抽象的描述。2001年被Oliva等人[12]借用來代指空間包絡特征,用于對經過分塊的輸入圖像進行離散傅里葉變換和窗口傅里葉變換,進而提取其全局特征信息。隨后,在2003年由Torralba等人[13]繼續研究并進行改進,用6個方向、4尺度的小波變換代替傅里葉變換進行紋理特征提取。2004年,Renninger等人[14]又采用Gabor濾波對其進行改進,用于提取靜態場景圖像的Gist特征。2007年,Siagian等人[15]基于生物的中央周圍濾波特征,將圖像分成方向、顏色和密度3種特征通道,共34個次通道,每幅圖像分割為4*4共16個小模塊,采用Gabor濾波算法提取圖像的Gist全局特征信息。

Gist特征是一種全局的特征描述方式,它能夠很好地捕捉到場景圖像的整體特征。對靜態場景圖像進行識別時,不需要對圖像進行分割和局部特征提取就可以實現快速的靜態場景圖像的分類[16,17]。與以往的特征提取方法不同的是,Gist特征利用Gabor變換多尺度和多方向的特性,能很好地模擬人類視覺,以盡可能地關注到簽名圖像的筆畫和整體,并將變換后的多通道圖像分別分塊取平均,再將這些平均值進行直方圖均衡化得到最終的特征數據。與其他單通道圖像特征提取方法相比,上述方法更加全面具體,有效解決了有效特征難以提取的問題。其計算公式如式(5)所示:

(1)

(2)

kv=2-(v+2)/2π

(3)

(4)

其中,σ為常數,i為虛數單位,z表示圖像矩陣中元素的坐標值。u和v分別表示對應Gabor濾波器的方向和尺度。

將一副大小為h*w的輸入圖像分成n*n個圖像塊,每個圖像塊g(x,y)分別與u尺度、v方向的Gabor濾波器ψ(z)進行卷積濾波,每個網格內取平均值得到一個特征,并將這些特征進行級聯拼接,得到圖像的Gist特征,其計算公式如式(5)所示:

Gψ,g(x,y,μ,υ)=g(x,y)?ψμ,υ(z)

(5)

其中?在此定義為卷積運算符。這樣每幅輸入圖像就獲得了u*v*n*n維的Gist特征數據。

3.2 IPCA降維

增量主成分分析IPCA算法是主成分分析PCA(Principal Component Analysis)算法的一種改進,用于解決因樣本數量或特征維數大而造成的系統資源占用問題[18]。與深度學習在數據量過大時的加載方法一致,IPCA是將數據分成多個批次,然后每次都只從外存中取一個批次的數據輸入到內存中,直接用新樣本對已有的主成分進行增量式修正,進而得到最終的樣本最優降維。

λh=Ah

(6)

其中,λ是對應的特征值。將A替換為樣本協方差矩陣,對于每一個時間步長i,向量h替換為其在第m批樣本向量待求的第i個特征,記為hi(m),每個批次一個樣本數據,即m=1,2,…,n。令v=λh,可以得到式(7):

(7)

其中,v(m)是對v的第m步的估計值。考慮到h=v/‖v‖,并且在一開始,設v(0)=h(1)作為數據擴展的第一個方向,并令hi(m)=v(m-1)/‖v(m-1)‖,從而式(7)可以推出增量表達式及其遞歸形式,如式(8)所示:

(8)

其中,(m-1)/m是之前估計的權重,1/m是新數據的權重。

4 支持向量機

支持向量機SVM是一種有監督學習的二元分類的廣義線性分類器[19],其決策邊界是對學習樣本求解的最大邊距超平面。SVM通過核函數將輸入數據映射至高維空間,為了將輸入特征向量映射到高維特征空間,本文使用高斯徑向基核函數,將問題轉換成線性可分問題進行非線性分類,并使用其軟邊矩SVM分類方法對簽名數據進行分類計算,具體實現公式如式(9)所示:

s.t.{yi(wTXi+b)≥1-ξi,ξi≥0

(9)

其中,ξi為松弛變量,用于把一些離群點向中心集中;C為懲罰因子,其值越大,對誤分類的懲罰越大,這樣對訓練集測試時準確率就高,但泛化能力弱,反之,泛化能力較強;N表示樣本個數,yi表示學習目標。經過實驗對比,本文實驗中設置C=1e3。

5 實驗

5.1 實驗數據

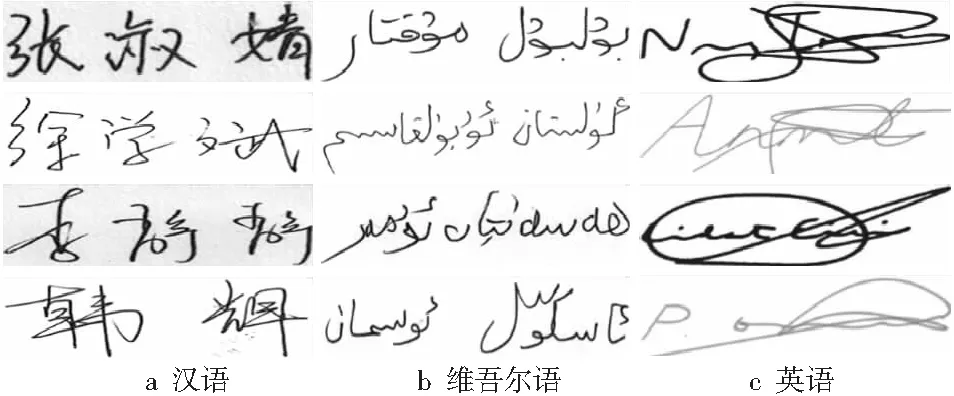

本文共采集和使用了3個完全不同語系的離線手寫簽名數據集,其中包括漢語、少數民族語言維吾爾語和西文英語。

(1)漢語離線手寫簽名數據集:漢語歸屬于漢藏語系,其特點是字與字之間有明顯的間隔,單個字體的書寫較為緊湊。該數據集包含160人的離線手寫簽名,每人21個,共3 360幅離線手寫簽名圖像。

(2)維吾爾語離線手寫簽名數據集:維吾爾語歸屬于阿爾泰語系,其書寫特點是字母與字母之間連寫構成一個音節,幾個音節寫在一起構成一個詞,詞與詞之間分開書寫。該數據集也包含160人的離線手寫簽名,每人21個,共3 360幅離線手寫簽名圖像。

(3)西文英語離線手寫簽名數據集:英語歸屬于印歐語系,其書寫方式和維吾爾語大致相同,但兩者字母結構完全不同。本文使用的是公開數據集GPDS Synthetic Off-Line Signature[20,21]中前160人的前21個真實簽名樣本圖像,共3 360幅離線手寫簽名圖像。

3個數據集共3*3360=10080幅離線手寫簽名圖像。圖3所示是本文實驗數據樣本圖像。

Figure 3 Presentation of data samples圖3 數據樣本展示

在實驗過程中,由于簽名圖像并沒有先后順序,所以本文使用每個數據集中每個人前S(=5,8,11,14,17)個簽名圖像作為訓練數據,其余圖像作為測試數據。

5.2 運行環境和評價標準

本文所有實驗均在64位Ubuntu 18.04.5 LTS的環境下進行,其CPU為Intel i5-4200M,2.40 GHz,內存為8 GB,具體程序通過基于PyCharm實現。

由于本文實驗的是多分類任務,所以只使用平均準確率AAR(Average Accuracy Rate)作為評價指標,其計算公式如式(10)所示:

(10)

其中,T表示所有參與測試的數據量;CT表示參與預測的數據中得到正確結果的數據量;N=10,表示本文把每次實驗進行10次,并取平均值得到AAR。

5.3 結果分析

5.3.1 Gabor濾波器尺度和方向的選擇

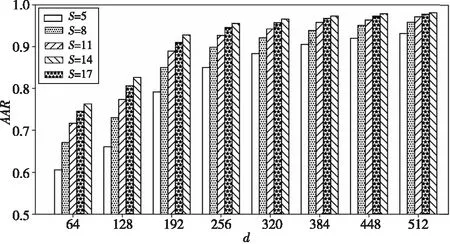

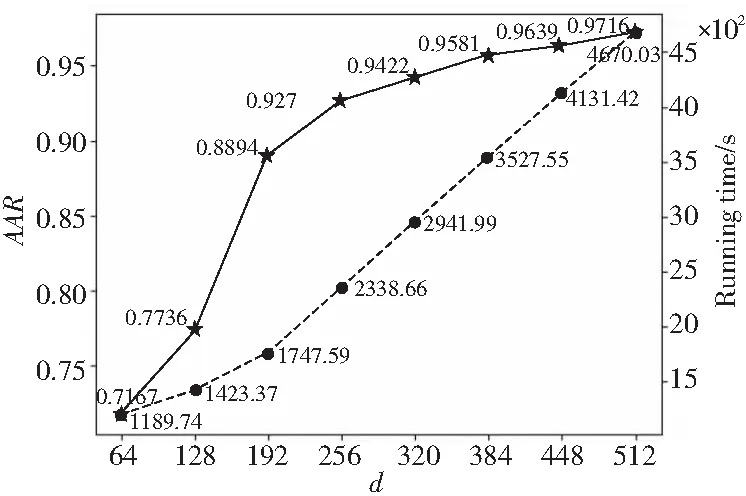

首先,本文混合3個數據集的所有數據,分別使用不同尺度u(=1,2,3,…,8)的Gabor濾波進行Gist特征提取,得到對應的8種d(=64,128,192,256,320,384,448,512)維Gist特征。其對應的識別結果如圖4所示。

Figure 4 Experimental results of classification using Gist features with different scales圖4 使用不同尺度Gist特征的分類結果

一般情況下,提取的特征維度越小,特征數據就越難以完整表示原本的圖像數據,進而直接導致分類結果差。由圖4可以看出,當使用1尺度4個方向的Gabor濾波器提取得到64維Gist特征時,識別準確率最高為76.26%;當提取的特征維度為384維(6尺度4個方向)時,即使訓練數據個數S僅為5,識別準確率也達到了90.54%。但是,隨著提取特征的維度不斷增大,識別準確率增幅越來越小,而實驗運行時間復雜度的增幅也越來越大。

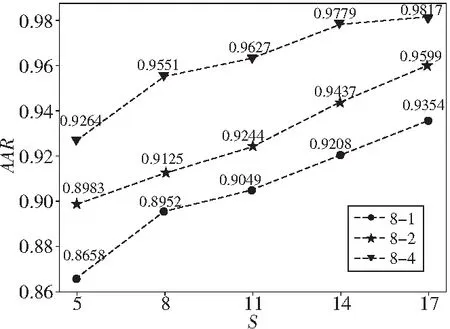

對于不同方向的Gabor濾波器,本文使用8尺度1個方向(0°)、8尺度2個方向(0°和90°)和8尺度4個方向(0°,45°,90°和135°)進行對比,如圖5所示。不難看出,使用的方向越多,提取到的特征越詳細,具體識別準確率也就越高。

Figure 5 Experimental results of classification using different directional GIST features圖5 使用不同方向Gist特征的分類結果

圖6給出了當每個人的訓練數據個數S為11時,不同方向的Gist特征在不進行降維的情況下的識別準確率與實驗運行時間對比。

Figure 6 Comparison of running effects when S=11圖6 S=11時運行效果對比

所以,本文選用8尺度4個方向的Gabor濾波器進行Gist特征提取,共得到d=512維的特征數據。

5.3.2 IPCA降維維度選擇

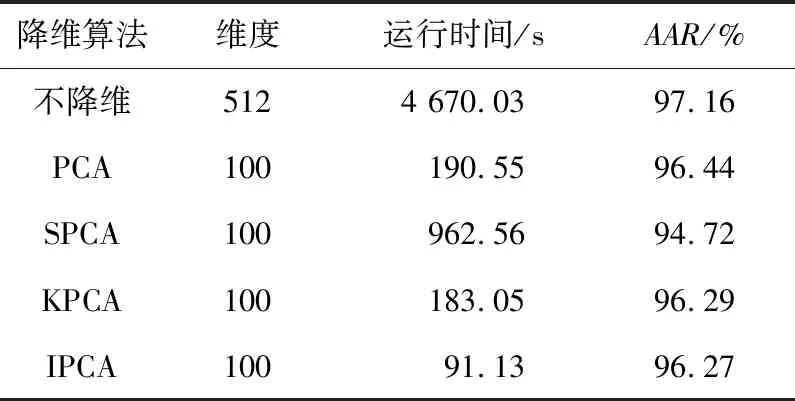

一般情況下,特征數據降維后,其表示能力也會相對降低,而實驗運行速度會相應提高。本文使用不同降維算法:主成分分析法PCA、稀疏主成分分析法SPCA(Sparse Principal Component Analysis)和核主成分分析法KPCA(Kernel Principal Component Analysis),把特征維度約減到100維后進行識別得到的實驗結果如表1所示。

如表1所示,使用不同的降維算法的分類識別在識別準確率上,IPCA算法相對最低,但是只比使用PCA算法的識別準確率低了0.17%,而其實驗運行時間只有使用原始特征的1/50以下,只有核主成分分析算法KPCA的1/2。在保證識別準確率變化不大的情況下,極大地提高了實驗運行效率,可見這種算法在實際應用中是可行的。所以,本文使用IPCA算法進行維度約減,并利用IPCA算法批處理的能力來提高運行效率。

Table 1 Experimental results of classification using different dimensionality-reduction methods

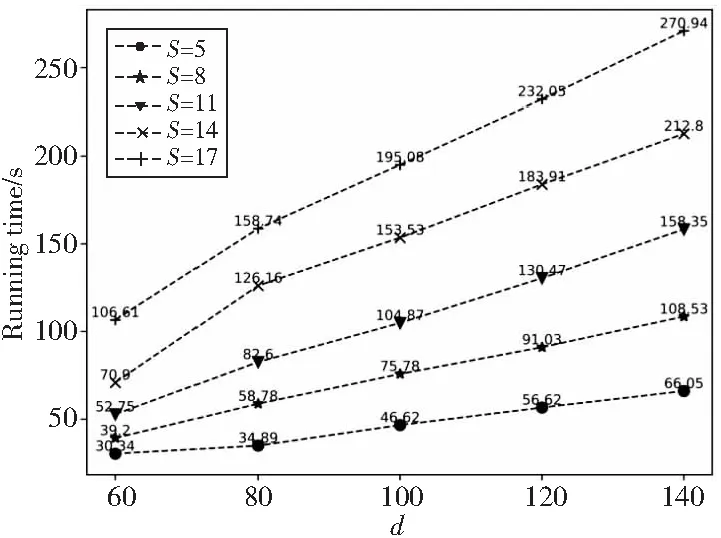

除此之外,本文把提取得到的512維的Gist特征分別約減到k(=60,80,100,120,140)維,并進行識別實驗。圖7和圖8分別為使用不同維度的Gist特征的分類識別效果對比。

Figure 7 Recognition results of classification using different dimension features圖7 不同維度特征的分類識別結果

Figure 8 Running time of classification using different dimension features圖8 不同維度特征的實驗運行時間

與使用原始特征數據的識別結果相比,圖7中的實驗結果表明,當維度降到一定程度時,識別準確率會大大減小,但是與表1中使用原始低維特征數據的實驗結果相比,即使維度約減到k=60維時,識別準確率依然比使用原始64維(1尺度4個方向)特征的平均高出10%以上。當維度k=80時,即使訓練數據個數為5,其實驗結果依然能達到90%以上。本文希望在不影響實驗結果的情況下,盡可能地提高運行效率,所以在接下來的工作中只展示了維度約減到k=100時的實驗結果。

5.3.3 實驗結果

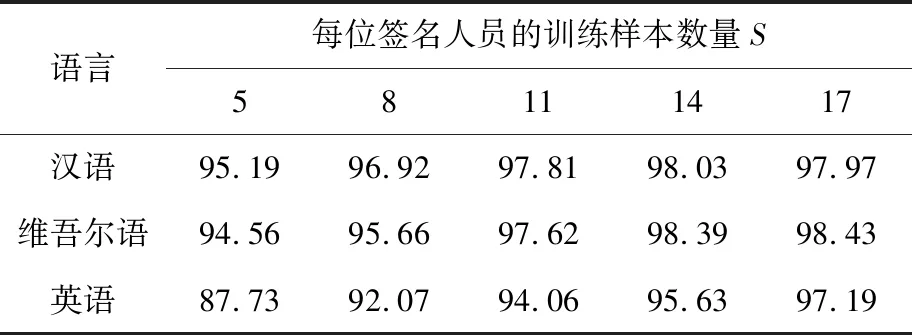

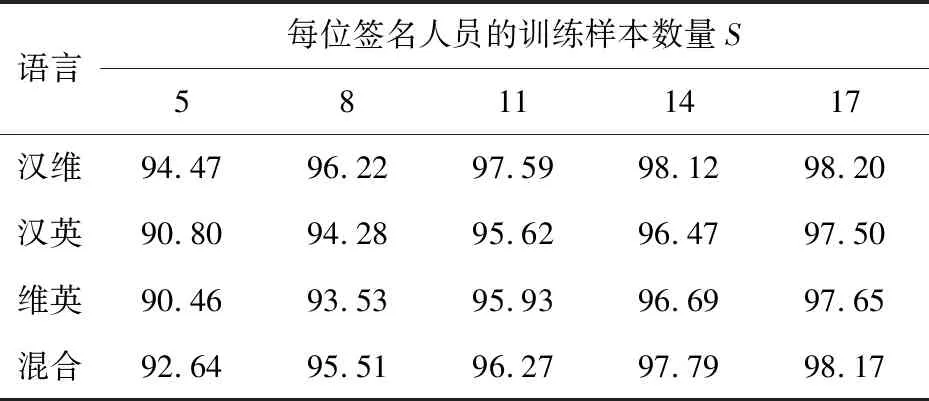

上述實驗結果展示了3個數據集混合情況下的識別結果,除此之外,本文還在單文種及兩兩混合的實驗數據集上分別進行了識別實驗。表2和表3分別表示單文種和兩兩混合實驗數據集上的簽名識別結果。

Table 2 Experimental results of classification on single-language dataset

Table 3 Experimental results of classification on mutil-language dataset

通過表2和表3可知,就單文種的離線手寫簽名識別結果而言,英語數據集上的識別結果相對較差。以往實驗經驗和實驗結果證實,維吾爾語數據集上的識別準確率會相對較高,但是本文提取的Gist特征在漢語的離線簽名數據集上的識別準確率較好。這是因為之前的實驗大部分提取的是局部特征,維吾爾語的離線手寫簽名筆畫較為稠密,有效的局部特征表示能力相對較強;而在整體性方面漢語手寫簽名特征表示能力較強;對于英語數據集中的簽名數據,其筆畫相對稀疏,也不似中文漢字簽名那樣字與字之間具有整體性,且不同的2個簽名間的整體差異更大,所以其識別結果較差。對于兩兩語種混合的數據集,由于類別數翻倍,所以識別準確率有所下降,但降低幅度不大,這樣正說明了本文算法的有效性和實用性。

5.4 對比分析

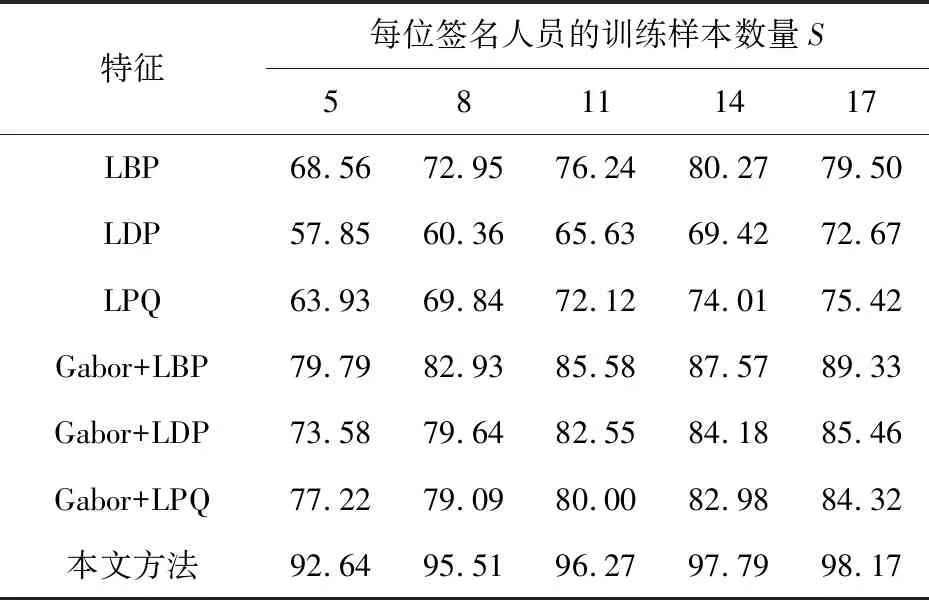

為了證明本文所提方法的有效性,本文使用了幾種常見的紋理特征提取方法:局部二值模式LBP(Local Binary Pattern)、局部方向模式LDP(Local Direction Pattern)和局部相位量化LPQ(Local Phase Quantization),并分別結合Gabor變換進行特征提取,結果如表4所示。

Table 4 Experimental results of classification using different amount of training data

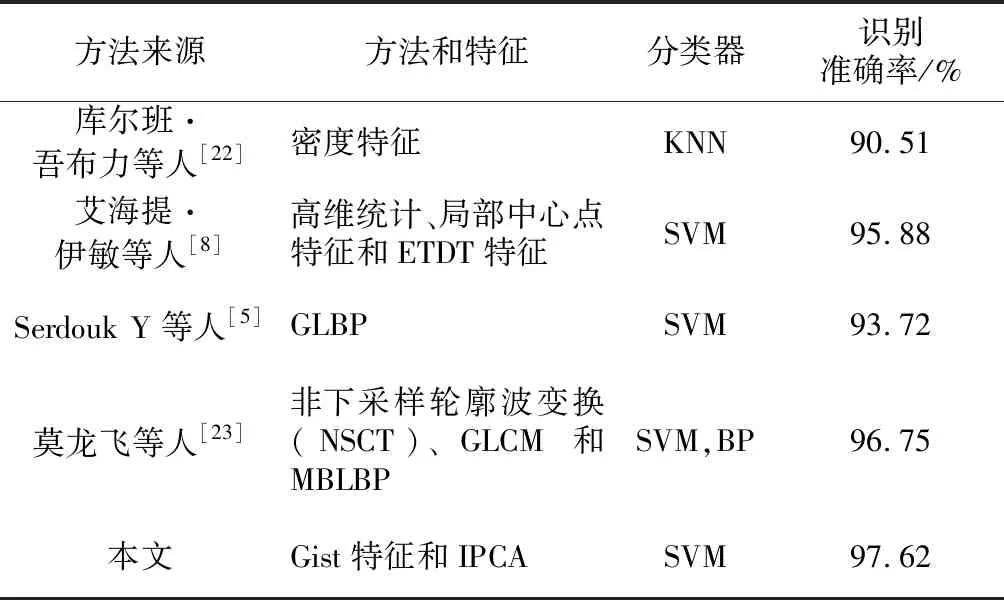

根據上述實驗結果易知,本文提出的基于Gist特征的離線手寫簽名識別方法,無論是在單文種還是在3種不同語系的手寫簽名混合的數據集上,即使使用少量的訓練數據,也都具有較高的識別準確率。同時,為了提高實驗的運行效率,本文使用IPCA算法對提取的特征數據進行特征降維,與使用原始特征的運動時間進行對比,降維后的實驗運行效率得到了很大的提高。為了表明本文方法準確有效,本文與之前相關方法的實驗結果進行了比較,如表5所示。

Table 5 Comparison between the proposed method and related methods表5 本文方法與相關方法的對比

通過實驗對比,本文提出的基于Gist特征的多文種混合模式的離線手寫簽名識別方法有效地實現了多文種混合方式下的多文種離線手寫簽名識別,而且即使使用少量的訓練數據,依然有很好的識別結果。

6 結束語

針對多文種混合模式的離線手寫簽名識別,本文提出了一種基于Gist特征的方法:利用Gist特征對靜態圖像的宏觀表示能力,提取了具有較強表示能力的數據特征,提高了識別準確率;同時使用IPCA算法進行特征維度約減,提高了實驗運行效率。與之前的研究方法相比,本文方法在實驗結果和實驗效率上都相對較優。本文方法是一種傳統的模式識別方法,與目前比較流行的深度學習方法相比,本文方法所需中間步驟較多,如預處理、特征提取和分類決策;相對而言,傳統方法的優點在于所需訓練數據較少、運行效率較高、運行環境要求較低等。所以,在接下來的工作中,將致力于實現更加高效的和實用的多文種離線手寫簽名識別方法。