歐盟數據保護影響評估制度及其鏡鑒

□肖君擁 張雪亭

[北京理工大學 北京 100081]

引言

數字化為促進經濟發展提供了新的機會,但也增加了數據主體潛在的數據泄露風險。為幫助數據控制者或處理者評估其數據處理的必要性和適當性,歐盟《通用數據保護條例》(以下簡稱“GDPR”)在隱私影響評估(Privacy Impact Assessment,以下簡稱“PIA”)的基礎上專門創設了數據影響評估(Data Protection Impact Assessment,以下簡稱“DPIA”)制度。DPIA制度作為歐盟數據保護框架中的核心內容,不僅成為了各國個人數據安全治理的重要手段,而且為各國企業合規管理、經濟數字化轉型以及數據安全治理法律體系的構建提供了理想范本。據檢索,歐盟學術界目前僅有David Wright、Clarke Roger、F. Bieker等少數幾位學者對隱私影響評估( PIA)制度的必要性以及相關學理進行了初步闡述,而國內的相關研究僅停留在泛泛而談DPIA制度的演化背景、DPIA制度的理論基礎,相關研究還不夠深入細致。

歐盟GDPR框架下創設的DPIA制度,是否是給歐盟境內外企業增加的又一項新的合規義務?落實DPIA制度僅是為了指引、強制企業遵守GDPR數據合規的相關規定?何種場景下企業應當進行DPIA?如何開展DPIA的具體流程?本文聚焦于對歐盟的DPIA制度的演化、應用場景及評估流程等全方位的介紹、分析與評論,佐以相關實踐案例說明落實數據安全風險評估制度的重要性。希望能為我國企業數據合規的思路轉換、數據安全保障、數字經濟的轉型以及構建具有中國特色的數據治理體系提供參考。

一、歐盟數據保護影響評估(DPIA)制度的起源與特點

(一)DPIA制度的源起:從PIA制度到DPIA制度

西方社會的隱私意識覺醒較早,對于隱私問題的較普遍關注,可以追溯到20世紀60年代末的歐洲的公平信息實踐(fair information practices,FIPs)運動[1]。為了提高公民福利水平,政府開始利用電子數據庫搜集和存儲大量的公民個人信息。FIPs運動的最初目的是確保“企業和政府在進行經濟活動時,信息技術之手不會導致對隱私的過度侵犯”[2]。FIPs運動在最初期關注的是組織的信息安全,隨著對隱私問題認識的深入,人們關注的焦點才逐漸轉向個體隱私。FIPs運動成為人們開始關注個體隱私問題的導火索,由此確立的FIPs原則(即FIPP)也成為《OECD隱私指南》《APEC隱私框架》和“ISO/IEC 29100:2011《信息技術安全技術隱私框架》”《美國隱私法案》等后續世界各國(地區)的隱私保護立法的重要準則。

盡管西方社會層面有隱私意識覺醒,但各國政府并未在立法層面給予及時回應。直到20世紀90年代,隨著信息時代的到來,隱私泄露風險的遽增,隱私影響評估制度才應運而生并逐漸成為一種保護個體隱私的常規手段。

歐洲議會和歐盟理事會于1995年10月24日通過了《關于涉及個人數據處理的個人保護以及此類數據自由流通的第95/46/EC/號指令》(EU Data Protection Directive 95/46/EC,以下簡稱《95指令》)。該指令要求各成員國保護自然人各項基本權利和自由,尤其是加強與個人數據相關的隱私權的保護。《95指令》第20條要求信息系統需要通過“預先校驗(prior checking)”以驗證應用標準的符合性,即要求商業機構收集個人信息必須事先獲得個人的明確同意。為適應《95指令》,英國在1998年出臺了《數據保護法》,其中規定事先審查這一合規性審查方式,該制度使得英國成為最早實施 PIA 制度的國家。2017年,國際標準化組織發布的ISO/IEC 29134:2017成為PIA最具代表性的標準之一。其將PIA定義為:在組織更廣泛的風險管理框架內進行的識別、分析、評估、咨詢、溝通和計劃處置與個人身份信息處理相關的潛在隱私影響的整個過程,還對PIA的評估過程、評估報告的結構和內容做了詳細的規定[3]。

大數據時代背景下,為進一步保護數據主體的權利和自由,2009年,歐盟委員會啟動對《95指令》的修訂。2012年,歐盟委員會出臺了替代《95指令》的歐盟《通用數據保護條例》(GDPR)草案。2016年,GDPR經歐盟委員會投票通過,并于2018 年 5月25日生效。GDPR強化了數據主體的各項權利,同時對義務主體提出了更嚴格的要求,加重了后者的數據保護義務和責任。GDPR中增加了數據控制者或處理者的多項義務,其中旨在通過評估數據處理行為的必要性和適當性,并通過評估內容幫助企業最小化個人數據處理活動風險的數據保護影響評估(DPIA)制度,在全球范圍內引起了廣泛關注。

(二)歐盟DPIA制度的特點

歐盟GDPR中沒有正式周詳定義DPIA制度。GDPR僅在第35條第(1)款規定:當某種類型的處理—特別是使用新技術進行的處理—很可能會對自然人的權利與自由帶來高風險時,在考慮了處理的性質、范圍、語境與目的后,控制者應當在處理之前評估計劃的處理進程對個人數據保護的影響。若多項高風險處理活動屬于同一種類,那么此時僅對其中某一項活動進行評估即可①。即DPIA旨在成為一種靈活的、能夠幫助數據控制者或處理者分析、識別和最小化數據保護風險的事前審查工具,或者可以說DPIA是建立和證明數據控制者或處理者數據處理合規的過程,它能幫助管理數據控制者或處理者處理個人數據對自然人權利和自由造成的風險。歐盟DPIA制度有以下三方面特點:

第一,規制對象的變化。需要注意的是,作為PIA制度的延伸,DPIA的規制對象不再是“個人隱私”,規制主體變成了“個人數據”。GDPR第4條規定:“個人數據”是指與已識別或可識別的自然人(“數據主體”)相關的任何信息①。“數據”作為接近事實的最小單元,作為網絡中由各種設備存儲、傳輸的各類信息的載體,其范圍要遠遠大于隱私。由此可見,與以往的隱私規則相比,GDPR對“個人數據”的范圍進行定義,相較于PIA的規制對象“個人隱私”來說有所擴大。GDPR對獲取和管理數據的一整條數據供應鏈自上而下都提出了更為嚴格的要求,并賦予數據主體明確的權利,為強化個人數據安全和保護邁出了重要的一步。

第二,法律義務的強化。GDPR第35條第1款對數據控制者或處理者執行DPIA這里用的是“應當”而不是“可以”,當其數據處理行為有可能對數據主體的數據權利和自由帶來高風險時,數據控制者或處理者必須進行事前評估。也就是說,DPIA不再像PIA一樣僅僅作為一項商業風險防控的手段或監管部門的建議,而是上升為數據控制者或處理者的一項強制性法定義務。

第三,加強問責的合規導向。盡管DPIA僅僅能夠幫助數據控制者或處理者最小化風險,不能幫助數據控制者或處理者消除風險,且DPIA是在GDPR下履行問責義務的關鍵部分,但DPIA不應當僅僅被視為一種加重數據控制者或處理者義務的工具。在Facebook深陷“劍橋分析”數據泄密丑聞事件,認罰50億美元與美國聯邦貿易委員會達成和解后,Facebook首席產品隱私官米歇爾?普羅蒂(Michel Protti)在公司官方博客中寫道:“這項協議已經給我們公司帶來了根本性的變化,在保護用戶隱私方面,我們取得了前所未有的進步。更重要的是,它帶來了一種新的問責制,同時確保隱私問題成為了Facebook每位員工所肩負的責任。”[4]可見,施行DPIA制度,可以倒逼企業內部數據合規制度的完善。數據控制者或處理者可以根據其數據處理過程的特點,開發符合自身特點的DPIA模板和流程。盡管DPIA模板和流程的設計不是一次性的練習,需要定期審核、持續更新以及動態監管,但數據控制者或處理者如果將DPIA制度落實到位,不僅可以幫助企業證明合規性,甚至可以為企業帶來良好的社會聲譽進而為其帶來其所期待的商業利益。

二、歐盟數據保護影響評估(DPIA)制度的啟動與要求

(一)數據控制者或處理者啟動DPIA的場景

通過上文對GDPR第35條第(1)款分析可知,并非數據控制者或處理者的每個數據處理操作都需要執行DPIA,只有涉及高風險數據處理過程時,數據控制者或處理者才需要進行事前評估。那么究竟什么是高風險數據處理過程呢?由表1可以看出DPIA風險評價的兩個維度,縱坐標是影響層面的維度,橫坐標是風險交叉可能性的維度,二者交叉便可得出是否構成高風險的綜合結論。GDPR對于何為數據控制者或處理者的“高風險”活動,并未采取傳統的下定義的方式,而是列舉了尤其需要進行DPIA的三種高風險典型場景。

GDPR第35條第(3)款規定了需要進行事前評估的三種情形:(1)對自然人進行系統性和廣泛性的個人情況評估,且該評估基于自動化處理(包括數據畫像)并且基于該評估作出對該自然人產生法律效力或類似重要影響的決定;(2)大規模處理本條例第9條第1款規定的特定類型的數據,或者第10條規定的有關刑事定罪和犯罪的個人數據;(3)對公共區域的大規模系統性監控①。

此外關于何種場景下需要進行DPIA,GDPR還從正反兩個方面進行規制,第35條第(4)款規定,監管機構應建立一份歐盟通用的需要強制執行DPIA的處理操作清單。需要DPIA的數據處理如:銀行根據信用參考數據庫對其客戶進行篩選;一家醫院即將實施一個新的健康信息數據庫,其中包含患者的健康數據;公交運營商即將實施車載攝像頭,以監控駕駛員和乘客的行為。第35條第(5)款規定,監管機構還應當建立一份不需要進行DPIA操作的歐盟通用公開性的列表。例如:社區醫生處理患者的個人數據不需要DPIA,因為社區醫生處理的患者數量不是大規模的。當數據控制者或處理者不確定是否需要進行DPIA時,GDPR第35條第(2)款和第36條第(1)款共同規定了數據控制者或處理者應當向數據保護官咨詢以及數據控制者或處理者何時事前咨詢監管機構的標準。

由此可見,監管機構不僅要建立需要進行DPIA義務的清單,還要制定無需進行DPIA的清單。只有數據控制者或處理者的行為滿足了主管部門規定的正面清單要求,才能夠被豁免不需履行DPIA義務,否則數據處理行為均需要執行DPIA方法。盡管GDPR竭盡全力從正反兩方面描述了需要進行DPIA和不需進行DPIA的情形,且建立了一系列具體的清單,但相較于數據控制者或處理者紛繁復雜的數據處理過程來說,DPIA在具體適用過程中的規定仍然較為模糊和有限,企業在實際數據處理過程中究竟何時需要進行DPIA在法律框架內仍需結合監管機構和數據保護官的意見。

(二)數據控制者或處理者實施DPIA的基本要求

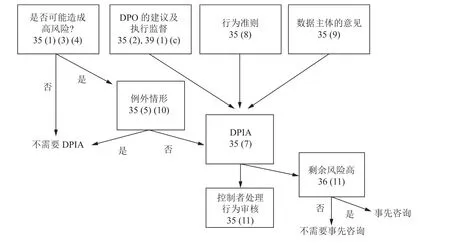

歐盟GDPR框架數據控制者或處理者主動執行DPIA的基本流程主要包含以下四個步驟(見圖1):(1)對是否可能造成高風險的判斷;(2)對是否適用于例外情形的判斷;(3)執行 DPIA方法;(4)對剩余風險是否仍然高的判斷,而后數據控制者或處理者再決定是否執行DPIA。

圖1 DPIA 制度的基本流程

首先,在進行DPIA之前,數據控制者或處理者應當充分考慮其數據處理行為是否屬于GDPR第35條第(1)(3)(4)款所提到的高風險行為。若數據處理過程不涉及高風險行為,則無需進行DPIA。即便屬于高風險行為,若數據處理過程被列入GDPR第35條第(5)(10)款中監管機構制定的無需進行DPIA清單,數據控制者或處理者也無需進行DPIA。這種情況的前提是數據處理過程嚴格在清單所提及的程序范圍內,且繼續數據處理過程應完全符合GDPR的所有相關要求。

其次,若存在以下三種情形,也應當進行DPIA:(1)數據保護官及監管機構認為數據處理過程需要進行DPIA時,且數據控制者或處理者應當將相關建議如實記錄在DPIA中;(2)數據控制者或處理者在進行DPIA時,應當合理考慮其對第40條所規定的已生效的行為準則的遵守,比如已經生效的歐盟成員國、行業協會等機構制定的行為準則等;(3)在不影響商業利益公共利益、數據處理操作的安全性的前提下,數據主體預期數據處理進行DPIA時,應當充分考慮、咨詢數據主體對于數據處理的觀點,如果數據控制者或處理者的最終決定與數據主體的觀點不同,則應記錄其進行或不進行DPIA的原因。

最后,執行DPIA并不是一勞永逸的,而是一個動態監管的過程。為了管理關于自然人的權利和自由的風險,在對風險進行一次識別、分析、評估、處理后還應當進行定期審查。數據控制者或處理者并不能以已經執行DPIA來抗辯其數據保護義務和責任。因此,若進行DPIA后仍顯示出較高的剩余風險,如數據控制者或處理者涉及數據的共享、數據跨境傳輸或軟件更新后,他們可能進行DPIA后仍會顯示高風險。此時數據控制者或處理者需要咨詢監管機構。在數據控制者或處理者提供DPIA后,監管機構應在規定限期內向其提供書面建議。

三、歐盟建構DPIA制度的實踐與動因解析

(一)基于企業合規的需要

DPIA制度堪稱一項保障企業數據合規的工具。企業向數據主體展示數據控制者或處理者的責任制度,甚至向數據主體公開DPIA模板,有利于獲取數據主體的信任。試舉兩例如下:

Knuddels.de是德國的一家社交平臺。2018年,因未采取任何保障措施,80萬封電子郵件地址和180多萬個用戶名和密碼被黑客以明文形式公布在互聯網上。Knuddels.de平臺在處理大量用戶數據前,未進行數據保護影響評估,德國數據保護當局決定對其處2萬歐元的罰款[5]。

2020年芬蘭數據保護申訴專員辦公室對違規處理員工位置數據的開曼?韋西公司處以16 000歐元的罰款。該公司使用車輛信息系統跟蹤車輛來分析其員工的位置數據,且在處理之前未進行DPIA,其數據處理過程涉嫌侵犯員工隱私[6]。根據不同的違規使用數據行為,GDPR第83條定義了兩類處罰標準,第一等級最高可處以1 000萬歐元,或上一財年全球營業額2%的行政處罰,以較高者為準;第二等級最高可處以2 000萬歐元,或上一財年全球營業額4%的行政處罰,以較高者為準①。

可見,數據處理過程中若企業需要進行DPIA時未履行相關義務,可能會因違反GDPR而面臨十分嚴厲的執法處罰。可以說,進行DPIA并發布數據評估報告是證明企業遵守了GDPR的一種廣泛性合規手段。因此,對可能個人數據造成高風險的數據處理過程開展DPIA,不僅能夠降低對數據主體合法權益的不利影響,而且出于審慎經營的目的,執行DPIA能夠為企業的聲譽維護和品牌建設等帶來更為廣泛的利益。

(二)基于人權保護的需要

進行DPIA不僅是基于企業合規的要求,更是保障特殊群體人權的重要措施。2018年7月17日,葡萄牙數據監管機構(CNPD)對違反了“數據最小化原則”的Barreiro醫院處以40萬歐元的罰款。Barreiro因為將臨床數據的訪問權限分開,在傳送患者醫療數據前未進行DPIA,導致患者臨床數據泄露[7]。

2020年,挪威數據保護局對Raelingen市處以47,500歐元的行政罰款。該市市政當局使用了一款名為Showbie的app處理有特殊需要的兒童健康數據,但在應用程序投入使用之前,未盡到數據安全保障義務,導致未被處理的其他兒童的個人數據大面積泄露。早在2018年12月,挪威數據監察局就因卑爾根市違反挪威隱私條例對其處以了17萬歐元的處罰。挪威數據監察局認為卑爾根市小學使用的計算機系統中的個人數據安全性不夠,導致卑爾根市35 000多名用戶(主要是兒童)的用戶名和密碼文件被泄露。2019年4月29日,挪威數據保護監管機構對奧斯陸市教育局做出200萬挪威克朗(約20.3萬歐元或153萬人民幣)處罰決定[8]。

2019年8月20日,瑞典數據檢查局對Anderstorps高中處以20萬瑞典克朗,約合2萬歐元的罰款。盡管Anderstorps高中在處理學生人臉識別信息時已經征得了其監護人的同意,但依舊有導致學生出勤信息被泄露的風險。學校的數據處理行為既未進行事前評估,也沒有事先咨詢瑞典數據保護機構。因此,瑞典數據檢查局認為,學校不能以監護人事前同意作為其數據處理行為合法性的基礎[9]。

綜上,對待特殊主體的數據尤其是弱勢群體如兒童數據、健康醫療數據的安全,歐洲國家的監管當局的態度相當嚴厲。數據控制者或處理者在對弱勢群體的相關數據進行處理前應當格外謹慎,包括但不限于實施對數據進行DPIA、匿名化處理、通過區塊鏈等技術對共享數據進行保護、定期測試和評估處理過程的有效性等措施,以防止重大安全漏洞。

(三)基于經濟高質量發展的需要

2022年4月21日,美國商務部宣布將成立全球跨境隱私規則論壇(CBPR)。CBPR宣言聲明建立的論壇“以促進互操作性”,并“在數據保護和隱私的不同監管方法之間架起橋梁”。目標包括基于亞太經合組織CBPR和PRP系統的認證體系,定期審查成員的數據保護和隱私標準,以及促進與其他數據保護和隱私框架的互操作性。根據其運營目標,論壇成員將進行磋商和交換意見,并分享研究、分析和政策想法。宣言指出,參與“原則上旨在向那些接受論壇目標的司法管轄區開放”,成員共識將決定未來的參與。

可見,全球化經濟時代,企業若想走向國際市場,實現長足發展,將世界各國的數據保護規則合規落地是必不可少的環節。如GDPR適用長臂管轄原則,若信息的采集和處理過程均是在歐盟境外完成,則GDPR不適用。但是,如果數據是企業通過提供面向歐盟的服務而在線收集而來的,則受到GDPR的管轄。例如,某App有德語版本,并在德國宣傳其可為德國游客在中國的旅行提供服務,則該德國用戶的數據需受GDPR管轄。

由此推論,我國外向型涉數字類企業應實行數據保護的思路轉換,協調各國數據保護法律的一致性。在處理敏感數據、利用數據進行自動化決策等高風險處理活動時,嚴格依法落實事前數據安全風險評估制度,對于企業和相關監管部門發現潛在的數據安全風險,具有十分重要的意義。

2021年7月22日,荷蘭數據保護局決定對短視頻社交平臺TikTok(“抖音”國際版)處以75萬歐元的罰款。這一事件意味著GDPR實施三年以來,中國企業(包括其控制的海外平臺)第一次因違反GDPR相關條款而遭受處罰,具有一定標志性意義[10]。

本案中,罰金之所以為75萬歐元,是因為荷蘭為執行GDPR而制定了適用本國企業的認定規則《2019年行政處罰管理規則》,相對于GDPR的處罰規定優先適用。如果荷蘭沒有制定此類處罰管理規則,Tiktok理論上將自動適用GDPR第83條第(4)款的規定,即高達1 000萬歐元或前一年全球營業額總額的2%的行政罰款。實際上,歐盟成員國制定這類在本國適用的處罰管理規則并不多見。同時,荷蘭對Tiktok進行處罰后,引起了一系列的連鎖反應,歐盟其他成員國對Tiktok是否侵害其境內兒童的隱私問題也開始進行調查,所有調查結束后,Tiktok所面臨的處罰總額可能更大。

因此,上市公司對可能出現的數據違規行為進行總結,在公布隱私政策時,考慮不同數據主體的特殊性進而進行事前的數據風險評估,加強內部合規管理的制度建設,不僅是企業在海外市場長足發展的重要舉措,同時,對我國有效防控市場風險、提高經濟發展質量、打造有韌性有活力的資本市場也具有重要而深遠的意義。

(四)基于國家安全的需要

2007年Facebook增加了開放應用接口以增加用戶App使用時間,用戶授權后可對用戶的姓名、性別、政治立場等個人信息進行收集。劍橋分析(Cambridge Analytica)是英國一家數據分析公司,其開發了一款針對選民的測試軟件,在用戶不知情的情況下對政治立場信息進行收集,利用該測試軟件,劍橋分析公司獲得了用于分析預測用戶政治立場的高達 3 000 萬份問卷。受雇于特朗普的劍橋分析公司利用Facebook的用戶數據,通過客戶政治立場的精準畫像,進行相關廣告投放,對特朗普贏得美國總統大選起到了至關重要的作用。

截至2021年3月31日,作為最大出行平臺的滴滴擁有全球年活躍用戶近 5 億,平均日交易量達到4 100 萬單,每天新增數據超過108TB。而在赴美上市的審計底稿里,所有數據都是未經過脫敏的原始數據。滴滴的用戶數據、會議記錄、電子郵件以及政府部門往來的所有機密信息的數量都是其行業中當之無愧的第一名。2021年7月1日,滴滴在官網未發布任何公告、未敲鐘的情況下,在美悄悄上市。隨即中央網信辦以“防范風險擴大”為由對滴滴啟動調查程序的深入,滴滴事件一時間引爆輿論[11]。

隨著國際環境的日益復雜,實行類似DPIA制度也是貫徹落實總體國家安全觀的需要。各國數據安全保護影響評估制度都強調,DPIA不是一個靜態的過程,出具評估報告也不是DPIA的終結,識別和控制風險應當貫穿數據處理過程程序或系統開發生命周期的始終。對于擁有海量數據的企業來說,內部在進行系統更新或數據跨境傳輸等高風險處理活動前,應當設立DPIA內部審核機制,對后續的數據處理過程持續跟進評估。對于我國相關監管機構來說,加強第三方監督工作力度,對企業數據合規采取包括但不限于DPIA手段在內的更加嚴格的監管手段,探索出一條大數據時代的企業合規監管路徑不僅是建立數據安全治理體系的需要,更是貫徹落實總體國家安全觀的必由之路。

四、歐盟DPIA制度與我國PISIA制度的異同

(一)歐盟DPIA制度與我國PISIA制度適用條件的異同

我國在個人信息安全影響評估領域起步較晚,從2017年開始實施的《網絡安全法》開始,《數據安全法》《個人信息保護法》以及從民事權利角度強化對個人信息的保護的《民法典》相繼出臺,呈現出“山頂千門次第開”的景象。

2020年發布的 《信息安全技術個人信息安全影響評估指南》(GB/T 39335—2020,以下簡稱《評估指南》)在充分借鑒了美、歐等國家和地區最新法律規定、制度設計和實踐做法后,為《個人信息保護法》的實施提供了堅實且科學的基礎。

《網絡安全法》在第17條、26條、29條、38條、53條、54條規定開展網絡安全風險評估活動,對關鍵信息基礎設施進行,建立健全網絡安全風險評估機制,對網絡安全風險信息進行分析評估,但僅有模糊性的原則性規定,無具體的實施細則。2017年由全國信息安全標準化技術委員會制定并發布的《信息安全技術個人信息安全規范》(GB/T 35273—2017)(以下簡稱《規范》)首次提出開展 “個人信息安全影響評估”的要求,在信安標委制定的諸多信息安全技術國家標準中,《評估指南》為數據安全影響評估提供了更為具體的方法論和指引。

2021年11月1日起施行的《個人信息保護法》為我國數據保護影響評估制度提供了法律依據。《個人信息保護法》第61條第(4)款規定,推進個人信息保護社會化服務體系建設,支持有關機構開展個人信息保護評估、認證服務,為監管部門執法以及企業合規工作提供了評估原理、實施流程、評估要點以及參考方法。《個人信息保護法》及《評估指南》的出臺使我國首次有了較為權威的評估個人信息安全的方法論與路線圖。

從二者的主要內容來看(見表2),歐盟DPIA制度側重于判斷是否可能導致自然人權利與自由的高風險,我國PISIA制度則列舉了更多評估場景的細分,如《評估指南》中列舉了4種場景:(1)業務模式、互聯網安全環境、外部環境發生重大變化;(2)發生重大個人信息安全事件;(3)發生收購、兼并、重組等;(4)其他。二者適用情況相似,并具有部分重疊,僅在側重點方面略有不同。

(二)歐盟DPIA制度與我國PISIA制度適用階段的異同

從二者的適用階段來看(見表3),我國PISIA制度和歐盟DPIA制度的適宜階段傾向略有不同。歐盟DPIA制度側重于個人信息處理活動前以及持續關注風險的態度,來發現隨時可能發生潛在對自然人權利和自由帶來高度風險的情況。我國PISIA制度其核心思路是從四個可能存在風險或發生安全事件的維度出發,評估可能對個人權益造成的影響以及風險。

(三)歐盟DPIA制度與我國PISIA制度評估目標的異同

從二者的評估目標來看(見表4),歐盟DPIA制度與我國PISIA制度側重的適用階段傾向不同。歐盟DPIA制度側重于個人信息處理活動前以及持續關注風險的態度來發現隨時可能發生潛在對自然人權利和自由帶來高度風險的情況。我國PISIA制度根據適用條件,按需進行,包括不限于個人信息處理活動的事前事中定期持續、外部因素變化等情況。

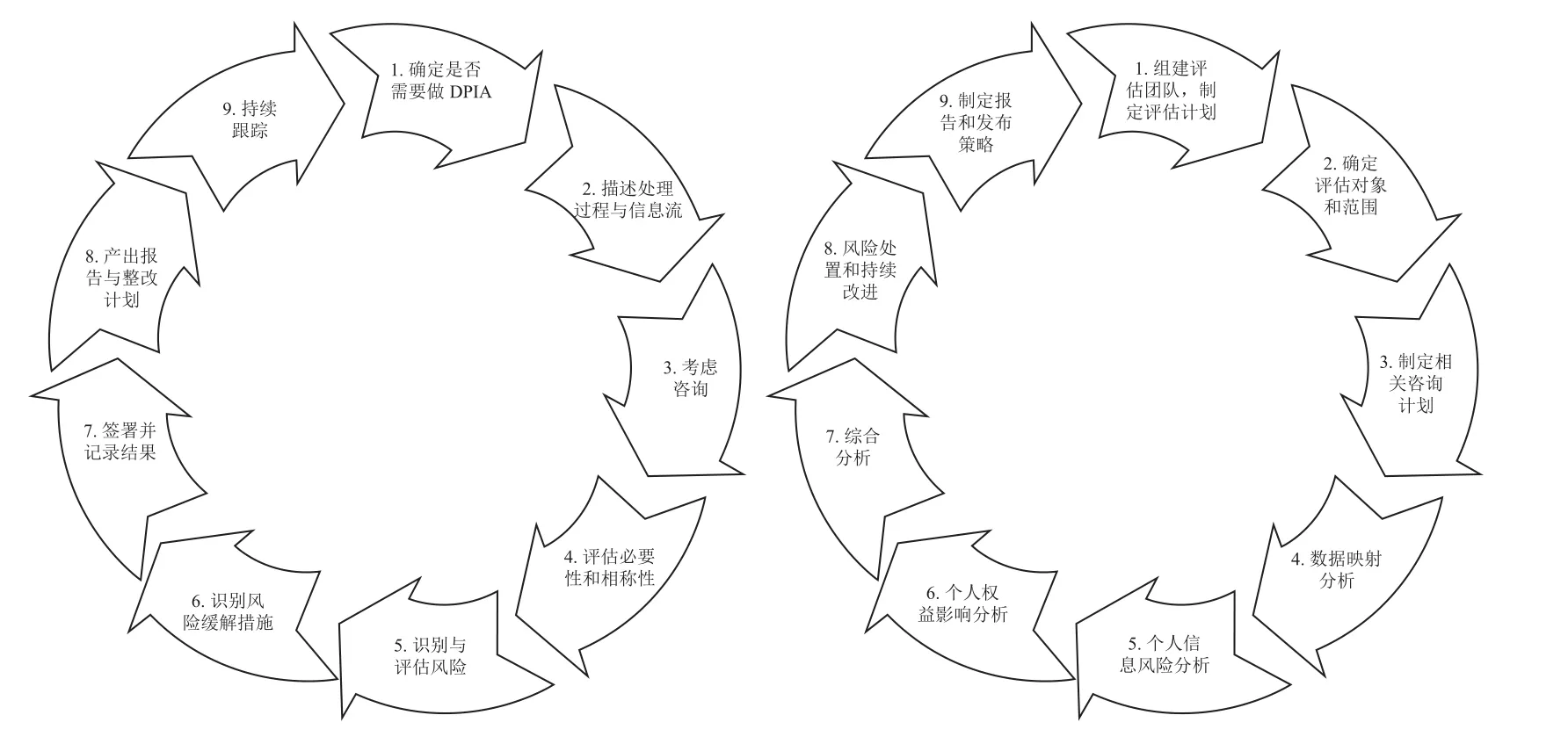

(四)歐盟DPIA制度與我國PISIA制度評估步驟對比

從二者的評估步驟來看(見圖2),歐盟DPIA制度與我國PISIA制度在評估步驟的流程上大致相同。從評估的發起主體來看,我國PISIA制度分為兩種,一種是數據控制者或處理者自行發起對個人信息處理過程的自評估,一種企業等上級組織或監管部門對數據控制者或處理者發起的檢查評估。從評估的實施主體來看,企業既可以在內部設置專門的法務或合規部門負責評估,也可以委托第三方專業機構進行評估,如網絡安全評估機構、律師事務所等。

圖2 歐盟DPIA制度與我國PISIA制度評估步驟對比

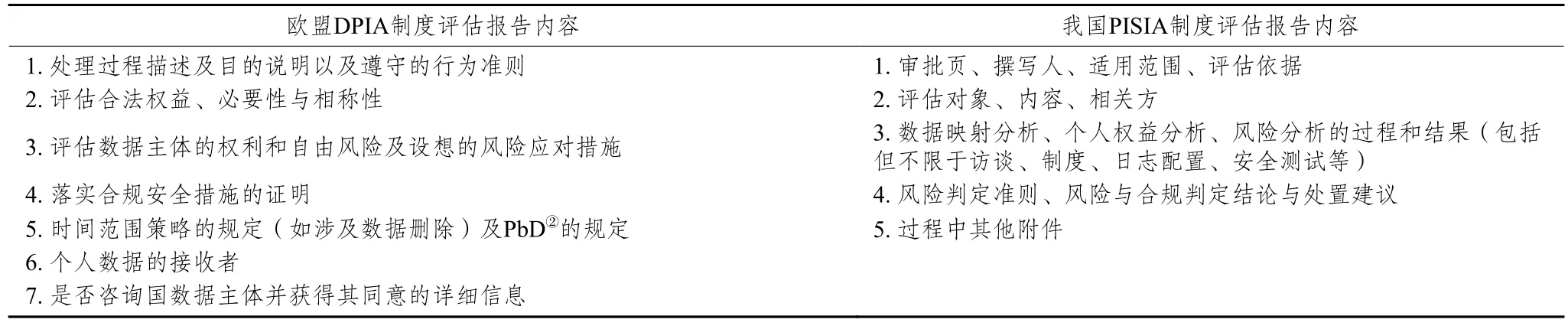

(五)歐盟DPIA制度與我國PISIA制度評估產物的異同

從二者的評估產物—評估報告來看(見表5),二者的評估報告十分相似甚至有相當部分的重疊,僅在某些細節上略有區別。歐盟DPIA制度中的評估報告對數據主體權益和自由的合規評估更加突出,而我國PISIA制度中均衡了隱私權益和信息安全保護措施,視情況會有實際安全測試、安全審計報告。相比于歐盟的DPIA制度,我國PISIA制度的評估報告的側重點更加突出“安全”,信息安全要素權重占比更高。在數據控制者或處理者發生數據安全事件時,盡管出具數據評估報告不能豁免企業的相關責任,但評估報告及其形成報告過程中的相關記錄,有助于減輕企業的相關責任和名譽損失,更重要的是有利于進一步查找企業的數據安全風險的漏洞所在。

表5 歐盟DPIA制度與我國PISIA制度評估報告內容對比

(六)歐盟DPIA制度與我國PISIA制度執行力度的異同

從二者的執行力度來看(見表6),我國PISIA制度的執行力度稍顯不足。GDPR第83條定義了兩類處罰標準,第一等級最高可處以1 000萬歐元,或上一財年全球營業額2%的行政處罰,以較高者為準;第二等級最高可處以2 000萬歐元,或上一財年全球營業額4%的行政處罰,以較高者為準①。我國《個人信息保護法》第66條也規定了兩類處罰標準,第一種:情節較輕的,由相關部門責令改正,給予警告,沒收違法所得,責令暫停或者終止提供服務;拒不改正的,并處100萬元以下罰款;對相關責任人處1萬元以上10萬元以下罰款。第二種:情節嚴重的,由相關部門責令暫停相關業務、停業整頓或吊銷相關許可、營業執照;并處以5 000萬元以下或者上一年度營業額5%以下罰款。對相關人員處10萬元以上100元以下罰款。《個人信息保護法》第68條規定了監管機構未履行相關責任對懲罰機制,第69條規定了數據控制者或處理者的侵權責任歸責原則采用過錯推定原則,即個人信息處理者不能證明自己沒有過錯的,應當承擔損害賠償等侵權責任。

表6 我國《個人信息保護法》相關執法案例

僅從法律責任的規定來看,我國《個人信息保護法》通過專章設置了較為嚴格法律責任,并對違法行為實施分類處罰,為監管執法提供了更為明確的上位法依據。但由于《個人信息保護法》實施時間短,執法層面相對落實不到位的情況仍然普遍存在。

盡管隨著《個人信息保護法》《規范》《評估指南》等文件的出臺,清晰地表明了我國在整體合規趨勢上的立法態度,但通過威科先行?法律信息庫對違法《個人信息保護法》的實務案件進行搜索,我們發現相比于歐盟DPIA制度來說,我國相關執法案例仍然較少,且處罰基本以警告為主,責令停產停業為輔,仍存在處罰過輕、執行力度不足等問題。

五、歐盟DPIA制度對我國的鏡鑒

(一)聚焦數據安全,加快數據安全風險評估標準的研制

隨著數字經濟時代的到來,數據作為推動全球經濟高質量增長的資源性要素,已經成為國際競爭的戰略制高點。21世紀以來,歐美等西方國家都開始著手建立本國的數據安全風險評估標準。習近平總書記認為“數字技術正以新理念、新業態、新模式全面融入人類經濟、政治、文化、社會、生態文明建設各領域和全過程,給人類生產生活帶來廣泛而深刻的影響”。2022年6月22日,中央全面深化改革委員會第二十六次會議審議通過了《關于構建數據基礎制度更好發揮數據要素作用的意見》,習近平總書記強調,數據基礎制度建設事關國家發展和安全大局,要維護數據安全,保護個人信息和商業秘密,促進數據高效流通使用、賦能實體經濟,統籌推進數據產權、流通交易、收益分配、安全治理,加快構建數據基礎制度體系[12]。利用大數據技術手段提升國家治理體系和治理能力現代化是大勢所趨,統籌數據安全和發展并重,加快數據安全風險評估標準的研制,已經成為構建中國特色數據安全治理體系的必然要求。

我國數據安全行業正處于高速發展期:2018~2021年,國內網絡安全市場整體增速約20%~23%,同期數據安全市場增速約30%~35%,是同期網安整體增速的1.5倍以上,可見數據安全市場在網安整體市場中占有舉足輕重的地位。2021年數據安全市場規模已達近70億元,未來3~5年,數據安全市場規模將繼續保持繼續高速增長態勢[13]。盡管我國在法律層面,已有“3法+1條例”作為支撐,但遠遠不能滿足市場需求。

數據并非可靠,偽造數據、數據失真、數據失效不僅會使得數據分析、預測失真,而且會導致數據在傳輸、使用、共享等過程中引發敏感信息泄露風險。隨著企業數據量和復雜性的不斷增長,數據的應用具有范圍廣、場景多、過程復雜等特點,一旦發生數據安全事件后造成的影響不可估量。為進一步應對日益嚴峻的國內外數據安全形勢,適應新形勢下新技術、新應用、新業態帶來的評估對象范圍、方式方法的變化,規范企業數據安全產品互聯互通框架、提升數據安全服務能力,加強新技術新應用帶來的安全問題的風險防控,因此,加快探索并建立并研制包括數據安全風險評估在內的等一批急需關鍵標準勢在必行。

(二)加強行業自律,建立內外審相結合的數據安全風險評估機制

大數據具有“大量、高速、多樣、價值、真實性”即“5V”的特點,區別于傳統的單線內、外審操作,推進將原有的單向規制轉變為內外審相結合的雙向數據安全風險評估,有利于在信息化時代建立執行力度更大、速度更快、縱深和延展性更好的數據安全風險評估制度。從《評估指南》中描述的評估發起主體來看,評估工作既可以由企業專門部門負責也可以由外部專業機構開展。但無論是企業指定的內部責任部門還是外部專業獨立第三方機構進行數據安全風險評估工作,我們都應當加強行業自律,應當充分保證該部門及相關人員的獨立性,保證實施過程的客觀性,以免受到被評估方法的影響而使評估過程流于形式。

此外,GDPR第35條第(1)款規定,“一次評估可能涉及一組具有類似高風險的類似處理操作”①。例如全國鐵路運營商可以采用統一的數據安全風險評估流程、全國售樓處可以使用統一的數據安全評析評估流程等,以減少對自然人的肖像權等權利造成高風險的情況發生。構建不同行業數據的制式評估流程相比于企業對單個數據處理流程能夠大大提高數據安全風險評估的效率。

在我國尚未研制出數據安全風險評估標準以及建立起基本的數據保護法律體系框架之前,由各省市出臺因地制宜的政策,行業協會及頭部企業充分發揮其協調、帶頭作用,探索出針對行業共性問題的解決方案。相關行業協會應帶頭建立起本行業的大數據審計平臺和數據運營管理機制,利用數據湖架構搜集和存儲企業內、外部結構化和非結構化數據,對行業數據全生命周期的風險進行事前防控。如針對擁有客戶靜態資產數據以及動態交易數據最多的銀行業,其涉及的業務之多、范圍之廣、關系之復雜是其他行業無法比擬的,行業協會在保障儲戶金融數據安全方面具有義不容辭的責任。行業協會應當帶頭建立起包括采集、加工、轉換、存儲、交換、關聯、共享和管理的全過程數據安全風險防控機制。

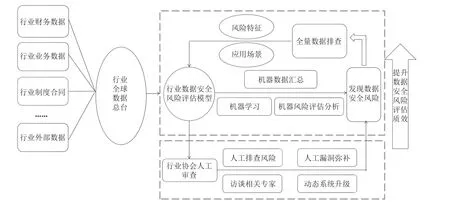

因此,行業協會可以建立本行業的數據處理統一平臺(見圖3)。此平臺應加大人工智能、MySQL、HIVE打標與自動掃描、算法黑箱等流程自動化工具的使用,以實現全面提升數據安全風險評估質效的目標。相關人工智能技術可以幫助人員完成外部數據采集、比對分析、系統安全檢查以及數據安全風險評估底稿采編等重復性的事務工作。通過相關技術采用文字識別、人臉識別、語音識別等技術還能夠對數據安全風險評估中的海量文本、電子證照、錄音等非結構化數據的全樣本檢查后,形成隱形的數據關系,為人工審核提供了一條基于數據的風險和識別路徑。此外,通過對機器學習模型后的結果展開進一步分析,可以擴展原有的行業各類數據模型的范圍并提高其數據風險識別精度。加強行業自律、發揮企業的主觀能動性。采用國家標準與行業自律相結合的方式,才是我國建立內外審相結合的數據安全風險評估機制的最佳選擇。

圖3 行業統一平臺進行全量風險排查示意圖

(三)推進閾值分析,全面推進數據分類分級制度的落地應用

就我國而言,盡管《評估指南》規定了在開展評估前,需要對評估的對象形成清晰的數據清單及數據映射圖表,但尚未建立起提高PISIA可操作性的“小規模”數據安全風險評估機制。歐盟DPIA在英國應用時,英國并未將其規定為一項強制性義務,而是用隱私閾值分析(PTA)工具來確定英國進行“全面PIA”還是小規模“PIA”[14]。通過PTA 發現,如果只有一個或兩個方面引起隱私問題,那么可以通過小規模 PIA來解決這些問題;如果多個問題的答案是肯定的,則需要全面的 PIA。

DPIA在實踐中最大的痛點和難點即在一般的企業場景中,觸發DPIA的概率并不算高,但啟動DPIA的成本卻很高。若對于具體數據評估的必要性存在模糊性和較大的不確定性,就難免存在數據安全風險評估疏漏、實效性差的情況,數據安全風險評估就很有可能陷入被動和低效。因此,我國可以借鑒英國經驗,通過 PTA 來記錄已經進行數據處理行為,進行閾值分析,推動數據分類分級制度的落地,不僅有利于全面提高數據安全風險評估質效,而且已經成為數字經濟時代數據治理的必選題。

通過數據分類對不同數據資產進行編目、標準化,為數據進行確權、管理數據安全風險、責任數據安全落實等提供依據;通過數據分級將數據根據敏感程度和遭到篡改、破壞、泄露或非法利用后對社會的影響程度按照一定的原則和方法進行排序,為數據資產的共享、利用、數據安全風險評估提供依據。實施數據分類分級要以業務為基礎,以技術為支撐,利用數據標簽技術、知識圖譜技術進行系統自動化掃描簡化數據分類分級的過程,根據預定參數對數據進行分類分級。數據分類分級制度的落地,將對企業的數據安全風險評估起到指引作用。哪些數據可以使用,哪些不可以使用,哪些能夠對外開放,哪些不能對外開放,不同等級的數據在不同場景使用哪種數據安全風險評估策略將一目了然。

數據分類分級不僅是企業安全合規使用數據的基礎,更是提升數據安全風險評估質效的良方。最小化數據風險和提升數據安全風險評估質效之間采取保持一種復雜而微妙的動態平衡,兼顧效率和公平,是推動我國數據安全風險評估機制建立的關鍵所在。

(四)建立咨詢制度,構筑全方位立體化監管體系

歐盟DPIA制度一改傳統數據保護的靜態監管模式,由于存在數量可觀的數據處理行為,且信息傳播風險具有廣泛性和未知性,相比于事后懲戒機制,數據保護影響評估機制注重損害發生前的評估和管理,是數據保護的最佳方案。

相比于歐盟的 DPIA 制度,我國《評估指南》在評估流程設計上缺乏根據實際風險程度決定是否向監管機構進行咨詢的事前咨詢制度。《個人信息保護法》第64條僅對執法部門在發現個人信息處理活動存在較大風險以及信息安全事件后的補救措施進行規定,卻未對數據控制者或處理者在未發生數據安全事件前的事前咨詢、上報風險等作出相關規定。數據控制者或處理者向監管機構進行事前咨詢、上報風險并尋求建議等過程,必然能夠大大提升數據安全風險評估的實施過程的實效性[15]。盡管《個人信息保護法》第60條規定,由國家網信部門負責統籌,國務院相關部門以及縣級以上地方人民政府有關部門進行監督管理,但面對如此權責不清、管轄競合,監管主體缺位的問題依然存在。

從實踐來看,由于審計線索不足而導致的數據泄露是危害數據安全的重要因素之一,監控整個組織中的數據操作是追查取證的重要手段。一旦無法監視數據和操作合規性異常、無法收集數據活動審計的詳細信息,就會造成數據泄露無法追溯,產生嚴重的組織風險。數據安全審計是指審計機關遵循大數據理念,運用數據技術方法和工具,利用數量巨大、來源分散、格式多樣的經濟社會運行數據,開展跨層級、跨地域、跨系統、跨部門和跨業務的深入挖掘與分析,提升審計監督能力和效率。《網絡數據安全管理條例(征求意見稿)》第58條中提出,國家建立數據安全審計制度。可見,我國可以考慮建立通過委托第三方機構對包括但不限于企業的數據安全情況、自身承諾執行情況以及數據安全風險評估情況進行合規審計的數據安全審計制度。審計標準可以參考,如中國注冊會計師協會、國際標準化組織認證制度或具有公認的隱私數據認證,以及符合國際標準化組織IEC17020質量管理體系標準[16]。

因此,建議國家建立統一的數據安全風險評估處理平臺,企業將具有法律效力的數據安全審計報告上傳至統一平臺,將負責個人信息保護的部門業務進一步細化,構筑一個廣泛使用、橫縱交織的數據安全風險評估監管體系,如此方能兼顧可操作性和經濟性、效率和公平。

六、結語

區別于傳統的風險評估,歐盟DPIA制度通過直接設定個人數據處理環節的具體行為規范,即直接明確“規定動作”,要求數據控制者或處理者通過事前評估“規定動作”得出“自選動作”。其超越“靜態底線式”的風險保護路徑,對日益復雜化、泛在化、鏈條化的數據處理活動的數據風險防控起到了至關重要的作用,從而取得動態優化式的權益保護效果。在我國以數字經濟轉型推動經濟高質量發展的宏觀背景下,借鑒歐盟DPIA制度是我國完善數據安全風險評估標準、構建數據安全風險評估制度的可行途徑。這也是強化安全等級保護、完善數字經濟治理的必然要求。我國在實施《數據安全法》時,應結合實踐情況不斷完善評估流程設計、構建全方位監管體系,以提升數據安全風險評估質效、全面維護國家數據安全。

注釋

① Regulation (EU) 2016/679 of the European Parliament and of the Council of 27 April 2016 on the protection of natural persons with regard to the processing of personal data and on the free movement of such data, and repealing Directive 95/46/EC (GDPR).

② PbD 即“Privacy by Design”的縮寫,其字面意思是“隱私保護設計”。PbD是目前國際隱私保護實踐中所共同推崇的理念,它是個人信息保護鏈條上的第一環,要求以技術手段運用到產品和服務的形態設計中。GDPR第25條明確要求,數據控制者應須遵守“設計及默認的數據保護”(data protection by design and by default,“DPbDD”)義務,并采取適當的措施和必要的保障。