面向電商的多模態商品檢索引擎設計

潘 巍,林榆森,施自凱,林世翔

(哈爾濱華德學院 數據科學與人工智能學院,哈爾濱 150025)

0 引 言

近年來,隨著互聯網技術的發展以及人們對生活便利的需求,網購電商平臺得到了飛速的發展,網上消費和選購心儀商品成為大多數人的首選。當前,隨著網購模式的快速普及,雖然電商平臺已經儲備了海量的用戶商品購買行為數據,但人們在網上購物時,若想在電商平臺中有效檢索出符合自身偏好的商品卻越來越難,該問題的存在使得電商平臺的現有檢索系統面臨著巨大挑戰。此外,經常使用電商購物平臺(如淘寶,京東和亞馬遜)的用戶還會發現,這些平臺僅支持語音搜索、文本搜索、圖片搜索等單模態檢索方式,不能滿足用戶精準定位的商品需求。

1 多模態商品檢索引擎需求分析

商品搜索引擎以多模態商品檢索條件數據作為輸入,并將這些數據和數據庫里的用戶行為信息一起提取特征,進行多模態融合得到融合后的特征向量,并把特征向量,構建出一種全新的多模態個性化商品檢索引擎,主要應用于電商的多模態商品檢索、商品個性化推薦和商品問答機器人。目的是為了提高檢索的準確度,提高用戶購物體驗的滿意度。可以說檢索引擎為用戶帶來了線上購物的極大便利,對相關的電商平臺帶來了巨大的盈利效益。

多模態的商品檢索引擎需要處理多種數據類型的數據,如圖片,音頻和文本信息。如何將多模態數據進行特征表達和融合是其要解決的關鍵性問題。此外,在現有的電商商品交易系統中存在海量的多模態數據,若能從中自動提取出商品特征,有效的檢索出用戶偏好的商品集合也是其有待解決的重要問題。相比傳統的機器學習方法,深度學習可通過多個隱含層的仿射變換來自動提取多種類型數據的特征,并且對于海量數據處理任務表現出極好的學習泛化能力。從而利用深度學習來構建多模態的商品檢索引擎是最好的選擇。

2 基于深度學習的特征表示和提取技術

在多模態的商品檢索引擎中,主要提取文字、圖像和聲音數據的特征,并有效的將其融合。其特征提取可依賴于深度學習技術來完成。

2.1 基于深度學習模型的圖像處理技術

近年來,基于深度學習的卷積神經網絡,在圖像識別方面獲得了巨大的成功,其可以通過多層卷積操作來獲得圖像特征的深度表達,如ResNet、LeNet5、AlexNet、Inception Net等。Vision Transformer的提出,相較于卷積神經網絡來說,使用了一種自注意力機制,該模型的學習能力超越了前面所提到的基于深度學習的神經網絡模型。2021年3月,微軟公布了Swin Transformer模型,該模型使用移動窗口來計算多尺度的圖像特征,并減少了模型的計算復雜度。同年,美團和阿德萊德大學提出了Twins Transformer(Twins-PCPVT),其設計出空間自注意力機制,使其在圖像分類、目標檢測和語義分割任務上超越了Swin Transformer模型。Twins-PCPVT通過將PVT中的位置編碼替換為CPVT中提出的條件位置編碼CPE,使其在分類和下游任務上直接獲得大幅度的性能提升。尤其是在稠密任務上,由于條件編碼CPE支持輸入可變長度,使得對于圖像的處理上,可以靈活處理來自不同空間尺度的特征。

2.2 基于深度學習模型的音頻處理技術

眾所周知,早期的語音識別系統通常由兩部分組成:一是利用輸入的waveform,人為提取MFCC特征;二是通過分類模型來對聲音進行識別。隨著深度神經網絡技術的發展,可以通過CNN、DNN、LSTM等深度神經網絡結構來自動化提取特征,相對于非端對端模型,減少了工程的復雜度,并廣泛的應用到語音識別中獲得了良好的效果。

2006年以來,雖然基于深度學習的CTC模型(如LSTM-CTC、RNN-CTC等)在語音識別聲學建模上獲得了巨大的成功,但該模型也存在如下問題:一是缺乏語言模型建模能力,不能整合語言模型進行聯合優化;二是不能構造模型輸出之間的依賴關系。針對CTC的不足,Alex Graves提出了RNN-T模型。RNN-T模型巧妙的將語言模型與聲學模型整合在一起,同時進行聯合優化。2020年2月,谷歌團隊提出了Transformer Transducer。其是一款在RNN-T模型基礎上,把LSTM encoding替換為transformer encoders的模型,利用有限寬度的上下文時序信息,在基本不損失精度的條件下,可以滿足流式語音識別的要求,獲得了巨大成功。

2.3 基于深度學習模型的文本處理技術

近年來,NLP自然語言處理在文本識別方面獲得了巨大的成功,可以通過文本嵌入技術來獲得文本特征的深度表達。例如Skip-Gram、Word2vec和GloVe等等。基于深度學習的文本處理任務存在很多模型,如ABCNN、IndRNN和TextCNN模型等。在此基礎上,2017年谷歌公司提出了基于多頭注意力機制的Transformer的模型,該模型并沒有沿用典型的循環神經網絡結構,而是通過多頭注意力來學習文本的語義,并在性能方面超越了其它模型。

2.4 多模態特征融合技術

眾所周知,對于多模態任務,如VQA、視覺定位等,都需要融合兩個模態的特征。近年來,多模態融合最常用的方法是拼接(concatenation)、按位乘(element-wise product)、按位加(element-wise sum)。而多模態緊湊雙線性池(MCB)的作者認為,這些簡單的操作融合效果不如外積,不足以建模兩個模態間的復雜關系。MCB將外積的結果映射到低維空間中,使其計算更為方便。雙線性池化首先對特征提取,得到特征映射每個位置的特征向量進行向量外積計算,然后對所有位置外積計算的結果進行平均池化得到特征向量;最后經過L2范數標準化得到最后的特征。

3 基于深度學習的多模態的商品檢索引擎

根據深度學習的特點,本文設計了一種全新的基于深度學習的多模態商品檢索引擎。其整體結構框架如圖1所示。該引擎的工作流程如下:首先采用深度學習模型對用戶偏好信息中的文本和圖片信息進行特征提取,即對商品數據庫中的文本和圖片進行特征提取;然后對用戶輸入的檢索條件(如文本、音頻和圖片)信息進行特征提取;計算兩種商品特征的相似度,選取相似度超過一定閾值的商品,組成用戶偏好商品集合;之后求得商品數據庫內的商品信息和用戶檢索查詢之間的商品特征向量相似度,選取相似度超過一定閾值的商品組成用戶檢索查詢的商品集合。如果上述兩個集合有交集,在交集中根據商品特征相似度,選取前個商品作為多模態商品檢索的結果;否則,就將用戶檢索查詢的商品集合中根據商品特征相似度選取前個商品作為多模態商品檢索的結果。

圖1 多模態的商品檢索引擎結構圖Fig.1 Structure diagram of multimodal commodity retrieval engine

多模態特征融合信息主要分為兩類:一類是對于用戶檢索的條件包含了音頻、文本和圖像的特征融合;還有一類是對于商品數據庫信息和用戶偏好信息的融合(如文本和圖像特征融合)。

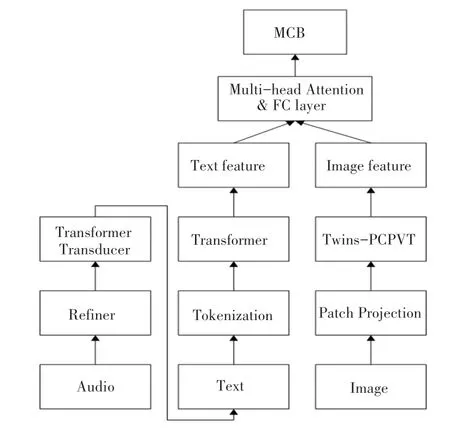

關于音頻、文本和圖像的特征提取以及融合如圖2所示。首先采用LCMV算法對音頻進行增強,然后將音頻分成Refiner段,再把Refiner段帶入Transformer Transducer模型得到文本轉換信息;然后把這些文本信息和用戶檢索查詢的文本進行串聯拼接,再對拼接后的文本進行Skip-Gram嵌入分詞得到Tokenization,將其帶入Transformer模型得到文本的特征向量;之后圖像的處理也是如此,先將圖像進行分割成Patch Projection,再將其帶入Twins-PCPVT模型進行特征提取,得到圖像的特征向量;最后再將文本的特征向量和圖像的特征向量采用多頭注意力機制和全連接層的處理,得到了處理后的商品信息的文本和圖像的特征向量,再將這兩個特征向量帶入MCB模型進行融合。

圖2 多模態特征融合的結構圖Fig.2 Structure diagram of multi-modal feature fusion

4 實驗及分析

本文選用KDD Cup 2020挑戰賽中的多模態商品數據集,該數據集中包含用戶文本檢索數據和圖像檢索數據,從中選取10萬條數據作為實驗數據集,在此基礎上添加了用戶的偏好信息,并為數據集中50%的樣本添加了商品語音檢索信息,構造出實驗所需的多模態商品數據集(MCDB)。實驗環境為Ubuntu13.04操作系統,Intel i9 109000x處理器,內存32G,GPU RTX3090 32G,硬板1T。實驗中使用Python3.6和Pytorch1.10深度學習框架編寫程序來實現模型并對上述模型進行訓練。

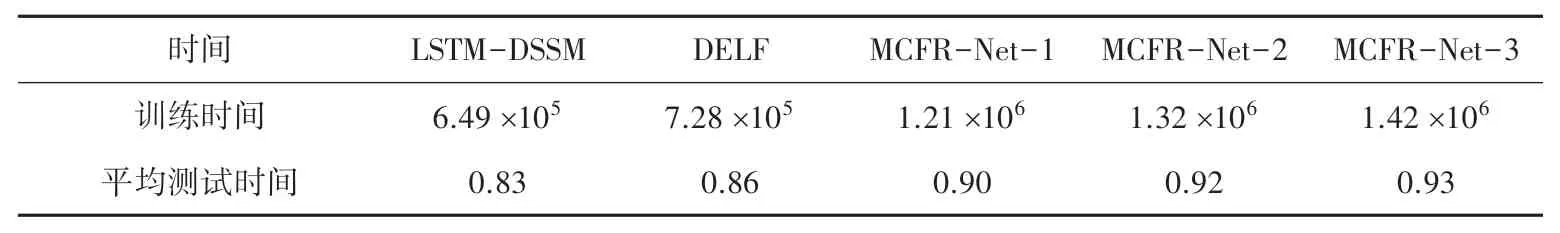

為了驗證本文模型的有效性,選取具有代表性的文本檢索模型LSTM-DSSM和圖像檢索模型DELF與本文提出的多模態商品檢索模型MCFRNet模型進行運行時間效率對比實驗,實驗結果見表1。

表1 單模態與多模態商品檢索模型的時間效率Tab.1 Time efficiency of unimodal and multimodal commodity retrieval models s

表1中,MCFR-Net-1表示利用圖像和文本進行商品檢索的模型,MCFR-Net-2表示利用聲音和文本進行商品檢索的模型,MCFR-Net-3表示利用圖像、文本和聲音進行商品檢索的模型。在模型訓練階段,隨機選取MCDB數據集上的80%樣本進行訓練,其余的作為測試樣本。通過表1可以看出,本文提出的MCFR-Net模型相比LSTM-DSSM和DELF模型需要更多的訓練時間才能使模型收斂,但對于測試樣本的平均測試時間不存在明顯差異。

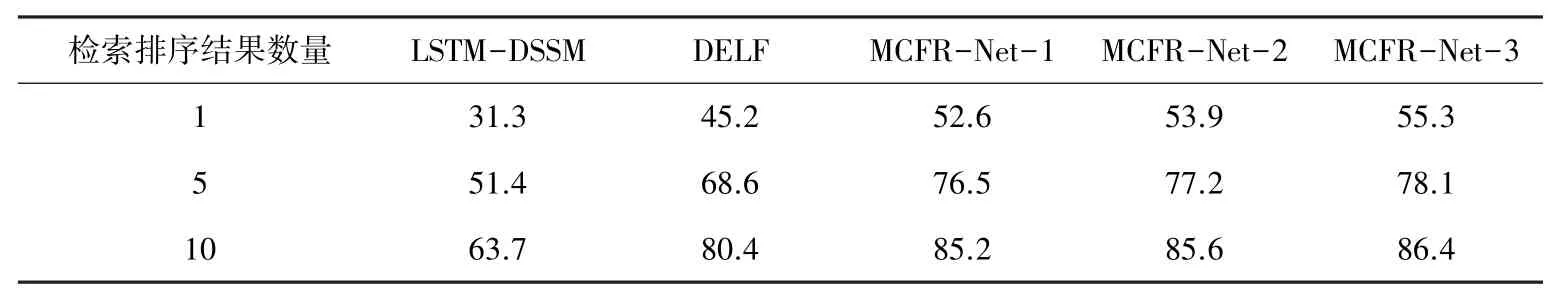

根據檢索召回率對比LSTM-DSSM、DELF和MCFR-Net的性能,實驗結果見表2。

表2 單模態與多模態商品檢索模型的召回率Tab.2 Recall rate of unimodal and multimodal commodity retrieval models %

通過表2可以看出,隨著檢索排序結果數量的增加,各模型的檢索召回率都有明顯提升。DELF模型的性能要高于LSTM-DSSM模型,而本文提出的MCFR-Net系列模型的召回率明顯高于DELF和LSTM-DSSM,并且MCFR-Net-3模型的性能最好。

5 結束語

綜上所述,本文設計了一種全新的多模態商品檢索引擎,采用深度學習和特征融合技術實現了多模態數據同時應用在一次搜索行為中。實驗證明,面對多種多樣的信息來源(如語音,圖像和文本)時,可以使用多模態檢索引擎模型來提升搜索的準確性,解決了單模態檢索模型特征表示能力有限和準確性較低的問題。