采用融合規則與BERT-FLAT模型對營養健康領域命名實體識別

鄭麗敏,任樂樂

采用融合規則與BERT-FLAT模型對營養健康領域命名實體識別

鄭麗敏1,任樂樂2

(1. 食品質量與安全北京實驗室,北京 100083;2. 中國農業大學信息與電氣工程學院,北京 100083)

人類營養健康命名實體識別旨在檢測營養健康文本中的營養實體,是進一步挖掘營養健康信息的關鍵步驟。雖然深度學習模型廣泛應用在人類營養健康命名實體識別中,但沒有充分考慮到營養健康文本中含有大量的復雜實體而出現長距離依賴的特點,且未能充分考慮詞匯信息和位置信息。針對人類營養健康文本的特點,該研究提出了融合規則與BERT-FLAT(Bidirectional Encoder Representations from Transfromers-Flat Lattice Transformer,轉換器的雙向編碼器表征量-平格變壓器)模型的營養健康文本命名實體識別方法,識別了營養健康領域中食物、營養物質、人群、部位、病癥和功效作用6類實體。首先通BERT模型將字符信息和詞匯信息進行嵌入以提高模型對實體類別的識別能力,再通過位置編碼與詞匯邊界信息結合的Transformer模型進行編碼以提高模型對實體邊界的識別效果,利用CRF(Coditional Random Field,條件隨機場)獲取字符預測序列,最后通過規則對預測序列進行修正。試驗結果表明,融合規則與BERT-FLAT模型的人類營養健康領域識別的準確率為95.00%,召回率為88.88%,F1分數為91.81%。研究表明,該方法是一種有效的人類營養健康領域實體識別方法,可以為農業、醫療、食品安全等其他領域復雜命名實體識別提供新思路。

營養;健康;食物;命名實體識別;自注意力機制;BERT模型;Transformer模型

0 引 言

隨著中國居民生活水平不斷提高,人們健康意識不斷增強,人們的飲食觀念從吃飽到吃好,再向實現營養均衡調理身體健康轉變,從有病治病向無病預防轉變[1]。通過良好的飲食習慣、注重食物的營養搭配以及食用具有健康功能的食物可以防止和降低疾病發生率[2]。但是目前人們無法在海量的互聯網信息中快速定位準確的個性化健康信息,無法滿足精準營養需求[3]。構建人類營養健康領域知識圖譜,存儲食物和病癥數據,幫助用戶提供符合營養標準的個性化飲食[4-5],對指導人們個性化健康飲食具有重要意義。營養健康實體識別是構建人類營養健康領域知識圖譜的關鍵步驟,實體識別的效果會直接影響知識圖譜的質量[6]。因此,需要研究有效的實體識別算法,準確識別營養健康領域實體,為營養健康知識圖譜的構建提供數據支撐。

命名實體識別(Named Entity Recognition,NER)在很多領域進行了應用,并且隨著深度學習的發展,模型能夠融合多種特征,捕捉更深層次的語義關系,達到理想的識別效果[7-9]。楊培等[10]使用注意力機制對化學領域藥物類別實體進行識別,解決了實體標簽的全文非一致性問題。Li等[11]將BiLSTM(Bi-directional Long Short-Term Memory,雙向長短時記憶網絡)與CRF(Coditional Random Field,條件隨機場)結合實現了中文電子病歷領域NER,張晗等[12]通過引入對抗訓練的方式結合注意力機制與BiLSTM-CRF實現了軍事領域NER,董哲等[13]通過BERT與對抗網絡訓練結合實現了食品領域的命名實體識別。任媛等[6]提出了融合注意力機制與BERT+BILSTM+CRF模型的漁業標準定量指標識別方法,解決了漁業標準定量指標識別準確率不高的問題。以上方法對領域內實體識別效果較好,但是無法直接使用到營養健康領域識別復雜實體。

在營養健康領域,王璐[14]使用基于統計的特征模板和CRF模型對健康膳食知識進行命名實體識別,對于具有文本特征的數據取得了較好的識別效果,但是需依靠特征模板,對于多源數據,需編制不同的特征模板,無法全面概括文本特征。遲楊[15]采用了基于詞典與統計機器學習相結合的方法,解決了在健康飲食領域非結構化數據中獲取實體的問題,可以在一定程度上保證實體的質量,但是無法識別詞典以外的實體以及復雜實體。以上垂直領域命名實體識別方法僅預測了實體邊界和字符類別標簽,但是在中文命名實體識別任務中,沒有明顯的詞匯邊界,導致序列模型難以識別出復雜實體[16],據研究發現,結合詞匯信息的字-詞格結構[17-19]對命名實體識別任務很有效,但是由于晶格結構復雜,不能實現并行計算,通常推理速度較慢。Li[20]等將格子結構轉化為數個區間組成的平面結構,提出FLAT(Flat Lattice Transformer)模型,借助轉換器充分利用格子信息,實現并行化處理,且識別性能達到最優。

在分析融合詞匯信息方法的基礎上,研究營養健康領域實體識別方法,對營養健康領域中食物、營養物質、人群、部位、病癥和功效6類實體進行識別,提出了融合規則與BERT-FLAT模型的營養健康領域命名實體識別方法,以實現營養健康領域實體的精準識別,為農業、醫療、食品等領域實體識別提供新思路。

1 材料與方法

1.1 數據采集與數據預處理

1.1.1 語料采集

營養健康領域命名實體識別沒有公開的語料數據集,本研究的數據來源主要通過Python語言構建爬蟲框架,獲取各網站(如生命時報網、中華養生網、食品科學網等)中關于飲食健康、食療和養生文本語料,共獲取2 135篇文本語料。

營養健康領域詞典涉及到多個實體類型,且沒有公共詞典,本研究通過爬蟲構建營養健康領域詞典,詞匯主要來源為《中國居民膳食營養素參考攝入量》2013修訂版[21]、搜狗輸入法細胞詞庫、百度輸入法詞庫、清華大學自然語言處理(Natural Language Processing,NLP)詞庫以及現有醫學數據庫北京大學SymMap[22],共計170 000詞匯。

1.1.2 語料處理

試驗數據包含大量網頁標簽、鏈接、特殊字符等非文本數據結構,影響數據標注的質量。首先對數據進行初步清洗,刪除包含特殊字符、無關營養健康等噪聲文本。將初步清洗的文本語料進行分句,并清除噪聲句子,最終得到113 747個句子。

1.1.3 詞典處理

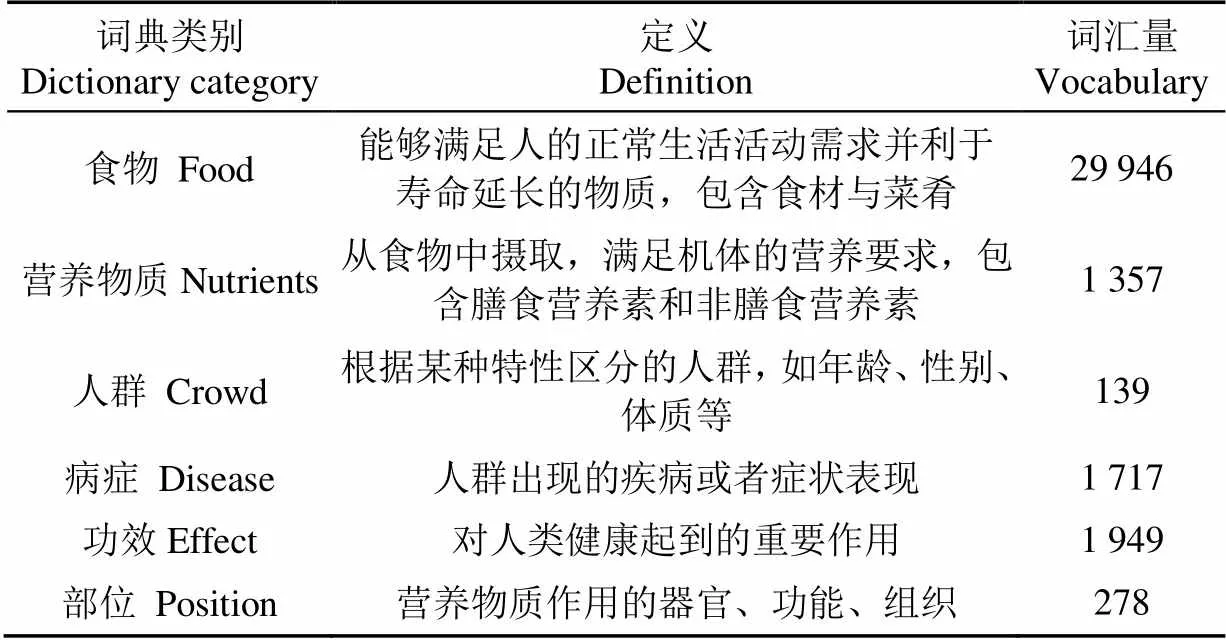

對營養健康領域詞匯進行分類,包括食物、營養物質、人群、病癥、功效和部位6類。其中營養物質包括《中國居民膳食營養素參考攝入量》中包含的33種膳食營養元素,而非膳食營養素目前研究較少沒有明確的定義,但對人體的健康具有非常重要的作用,本研究將除膳食營養元素的物質均定義為非膳食營養元素。通過對詞匯人工清洗,最終構建了6類詞典,各類詞典定義及詞匯量如表1所示。

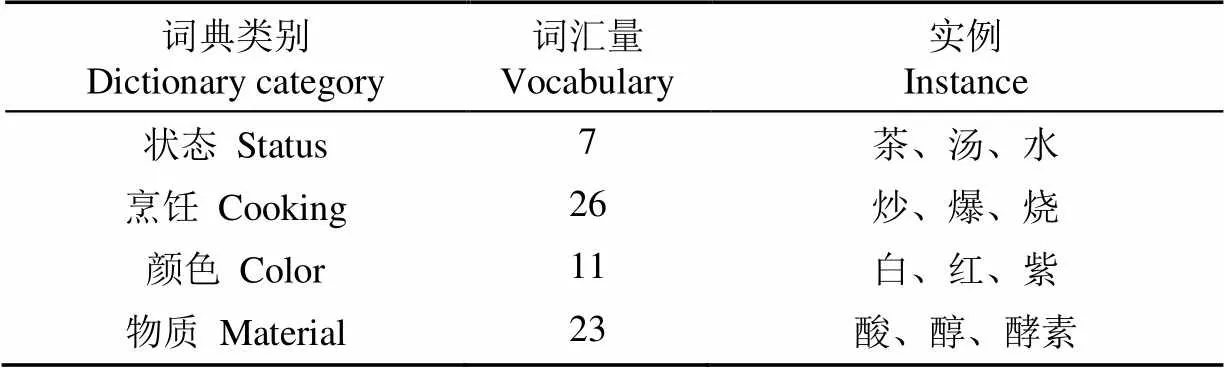

另外根據獲取的詞匯,定義了4類特征詞典,其中烹飪詞典表示菜肴的烹飪方式,顏色詞典表示食材中常見的顏色,狀態詞匯和物質詞匯分別表示食物和營養物質常見的詞尾,4類特征詞典詞匯量與實例如表2所示。

1.1.4 語料標注

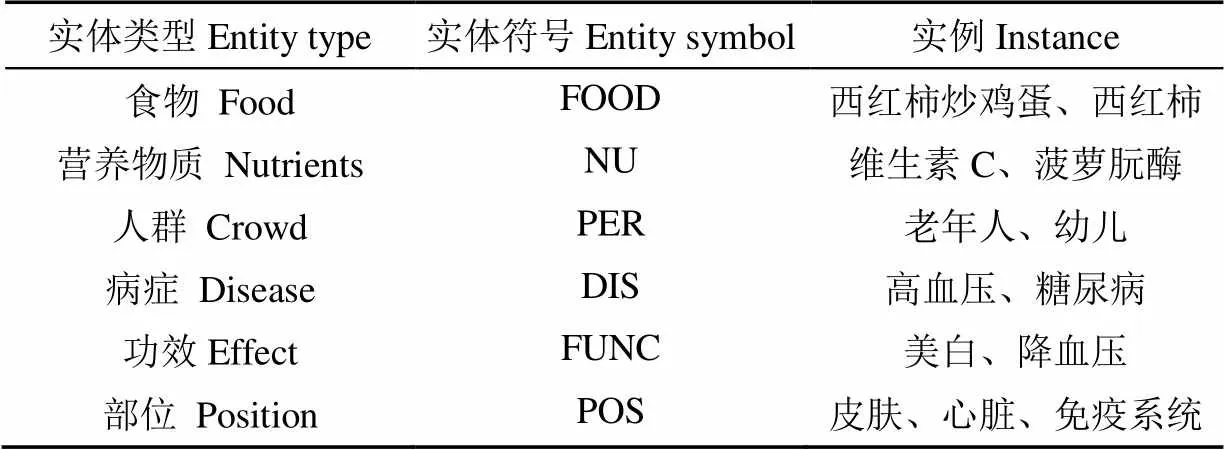

由于營養健康領域的標注數據庫的匱乏,領域中沒有一個廣泛使用的標注規范[23]。結合營養健康領域知識特點,采用人工標注方式進行語料庫標注,語料庫包含實體共89 574個,其中食物40 582個、營養物質13 848個、人群2 528個、病癥11 626個、功效13 797個和部位7 196個。不同類型實體標注符號與實例如表3所示。語料庫標注示例如圖1所示。

表1 領域詞典類別、定義及詞匯量

表2 4類特征詞典詞匯量與實例

表3 營養健康實體標注符號與示例

1.2 融合規則與BERT-FLAT的營養健康領域命名實體識別模型

1.2.1 模型總體架構設計

在營養健康領域中存在大量的復雜實體和專有名詞,如果使用基于字粒度的命名實體識別模型,會導致字在詞匯中的語義表達缺失,并且丟失詞邊界信息,如果使用基于詞粒度的命名實體識別模型會出現分詞錯誤傳播問題[17],詞匯邊界對實體邊界通常起著至關重要的作用,因此提出將字符與詞匯進行融合的實體識別方法。此外,由于部分營養健康領域的文本序列較長,若采用固定長度的上下文變量,會導致語料分片之間無法信息共享,丟失上下文信息,需要采用有效的方法解決長距離依賴問題。在設計營養健康領域實體識別模型時需要考慮字粒度和詞粒度信息融合、詞匯邊界信息和長距離依賴等問題。

對常用的命名實體識別模型研究發現,BERT預訓練模型可以用來提取包含上下文的文本信息,但是BERT在垂直領域命名實體識別任務中需要領域內的詞匯信息加持;Transformer的自注意力機制能夠捕捉句子之間的長距離依賴;CRF能夠對預測標簽進行解碼;根據營養健康文本特點,制定文本規則,能夠對解碼序列進一步修正。因此,提出了一種融合規則與BERT-FLAT的命名實體識別方法。

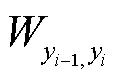

融合規則與BERT-FLAT模型總體結構如圖2所示。共分為3層網絡模型,首先將字符信息和詞匯信息進行拼接,輸入到BERT模型中進行實體識別模型的預訓練處理,然后為每個字符和詞匯構建頭位置編碼和尾位置編碼,表示字或詞的開始位置和結束位置,將BERT層輸出作為字符嵌入和構建的詞嵌入輸入到FLAT層進行編碼,獲取編碼序列,為了解決梯度消失問題在自注意力機制和全連接層均加入殘差連接與歸一化,保證信息的無差傳遞。再將FLAT層輸出的編碼序列輸入到CRF層進行解碼,獲取單詞的預測標簽,最后根據營養健康領域文本規則修正序列標簽,得到最終預測結果。

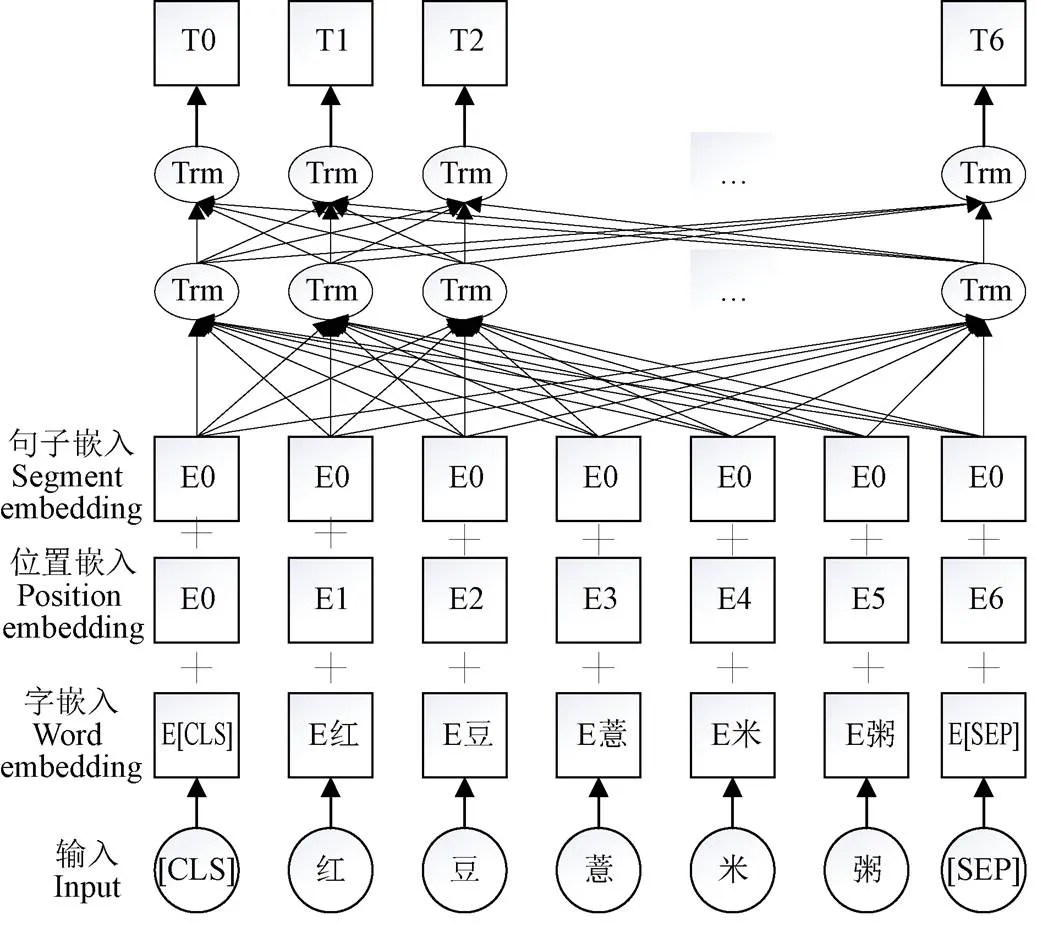

1.2.2 嵌入層

嵌入層是將中文文本序列轉換為字符或詞匯的密集向量表示或分布式表示[24]。BERT模型是一個包含字符級、句子級特征的預訓練語言模型[25],為捕捉上下文信息,BERT采用雙向Transformer作為編碼器,通過注意力機制對文本進行建模。BERT模型的輸入將字嵌入、位置嵌入和句子嵌入進行拼接,輸入堆疊的Transformer模型中進行特征提取,進而得到輸出序列向量作為字符嵌入。BERT模型結構如圖3所示。

注:[CLS]和[SEP]表示BERT對序列的標記,[CLS]標識序列開始位置,[SEP]標識句子見分割;E表示每個字符的分布式表達;Trm表示BERT模型中堆疊的Transformer模型;T表示BERT模型輸出的序列向量。

詞嵌入即用向量表示詞匯,主要分為兩種:基于計數方法和基于推理方法。基于計數的方法是獲取語料庫的統計數據,一次性處理全部學習數據,但當詞匯量很大時,會導致計算機難以處理。而基于推理的方法是通過神經網絡在部分數據上學習,并反復更新權重[26]。Word2vec是基于推理方法實現的詞嵌入學習模型,能夠將神經網絡中耗時的線性隱藏層去除,研究表明Word2vec模型的效果較好[27],因此本研究采取Word2vec訓練詞嵌入。

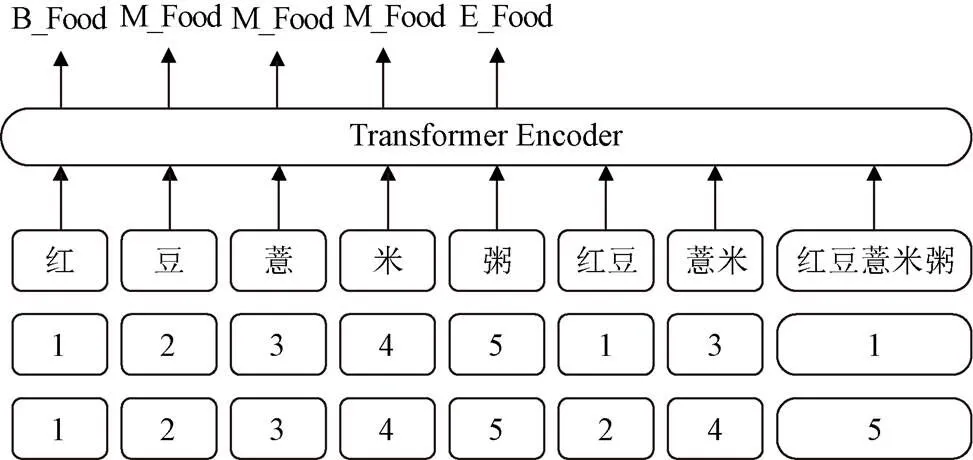

1.2.3 FLAT層

營養健康領域中存在大量的復雜實體,且實體中存在潛在實體,不同順序的輸入序列標識不同的實體,因此輸入序列的位置信息對于NER任務非常重要。Transformer模型不僅可以對序列中的長距離依賴進行建模[20],同時還標記了序列的位置信息。本研究在Transformer編碼器的基礎上改進位置編碼,為每個字符和詞匯構建頭位置與尾位置,分別表示字符和詞匯的開始位置與結束位置,若頭位置與尾位置相同表示當前表示為字符,反之為詞匯。將BERT模型輸出的字符嵌入與構建的詞嵌入結合輸入到FLAT層的Transformer編碼器中,獲取編碼序列,字符嵌入和詞匯嵌入如圖4所示。

注:Transformer Encoder表示Transformer模型編碼器;B_Food、M_Food、E_Food分別對應食物類型實體的開始位置、中間位置和結束位置。

Note: Transformer Encoder represents the encoder of the Transformer; B_Food, M_Food, E_Food represent the begin, middle, and end positions of the food type entity respectively.

圖4 字符嵌入和詞匯嵌入

Fig.4 Character embedding and vocabulary embedding

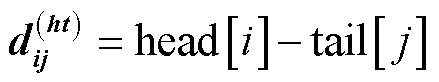

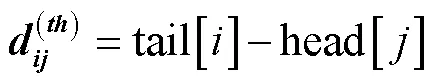

根據每個區間的頭位置和尾位置,可將區間間的關系劃分為包含、相交、相離。為表示3種區間關系,首先通過式(1)~式(4)構建區間的相對位置矩陣。

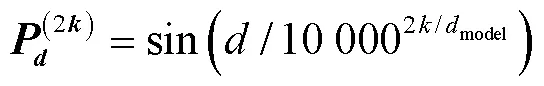

然后將4個相對位置矩陣拼接,計算區間x、x相對位置編碼,如式(5)所示。

式中表示輸入區間相對距離,表示位置編碼的維度索引,model表示多頭注意力機制中映射的向量維度。

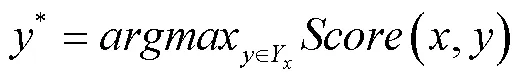

1.2.4 解碼層

1.2.5 規則修正

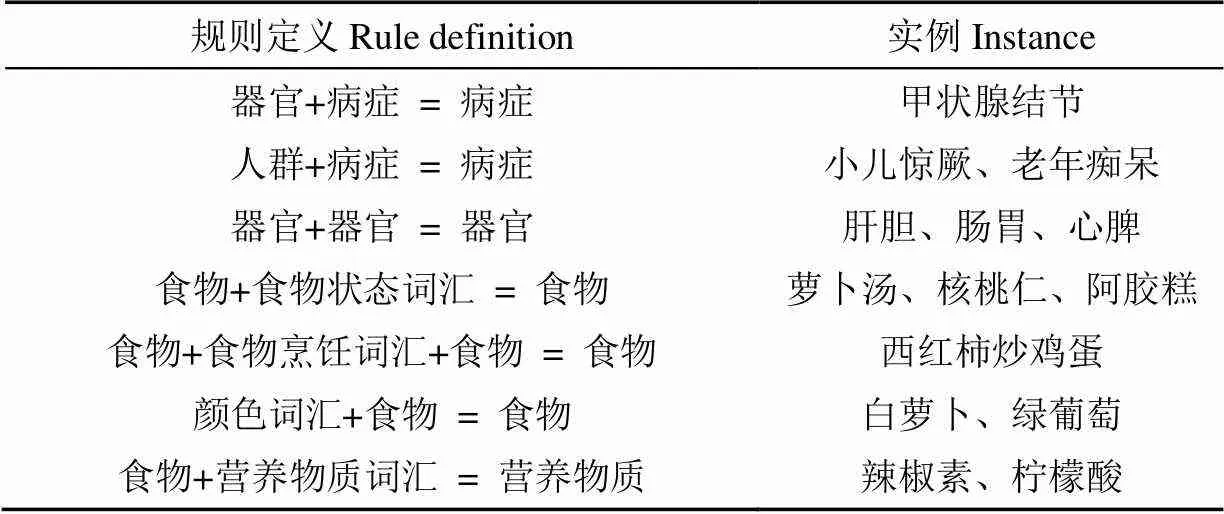

由于營養健康領域中存在大量的復雜實體且實體規則性較強,本研究制定了相應的規則對BERT-FLAT模型的初步預測結果進行修正,具體的修正規則如下:

1)食物類型實體:部分食物名稱存在實體重疊現象,設定規則當食物實體中前后緊鄰食物詞匯、烹飪詞匯、表示顏色的詞匯等,將其共同修正為食物實體;

2)營養物質類型實體:食物中含有的營養物質名稱,如“類胡蘿卜素”,模型將其預測為“O|B_FOOD| M_FOOD|E_FOOD|O”和“O|B_FOOD| M_FOOD| M_FOOD|E_FOOD”,沒有對營養物質正確預測,因此設定規則將食物詞匯周圍出現的營養詞匯,合并為營養物質實體;

3)病癥類型實體:對于病癥類型的實體,若緊鄰詞匯中出現了人群、器官等,則將其修正為病癥類型實體;

4)器官類型實體:對于器官類型的實體,若緊鄰詞匯中出現了器官,則將其修正為器官類型的實體。

在規則修正過程中,定義滑動窗口大小為1,以關鍵詞為中心,對上下文搜索1個實體,即若相鄰預測標簽為O,則判斷是否為特征詞匯,將特征詞匯合并為相關實體,若相鄰預測標簽為實體詞匯,則查找對應規則合并為相關實體,營養文本規則如表4所示。

1.3 試驗設計

1.3.1 試驗語料

語料標注的主要來源是從分句結果中選取與食物、營養物質、病癥等相關的文本共計24 000句,如西紅柿、紅豆薏米粥、補血、膳食纖維、胡蘿卜素等。將標注數據集按照8∶2的比例劃分為訓練集與測試集進行試驗。

表4 營養文本規則

注:+表示連接相鄰的實體類型;=表示連接后形成的新實體類型。

Note: + indicates the type of entities that are connected adjacent to each other; = indicates the type of new entities formed after the connection.

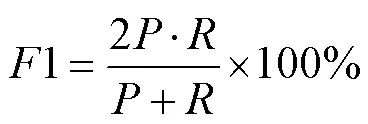

1.3.2 評價指標

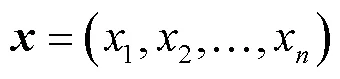

在對比不同模型的能力時,需要采用相同的性能度量。命名實體識別任務中常使用準確率、召回率和1分數作為度量標準,并且1分數能夠綜合評價模型的識別性能[31]。本研究的目標是通過融合規則與BERT-FLAT模型自動識別文本中的實體,為構建營養健康領域知識圖譜提供數據支撐,因此使用準確率、召回率和1分數衡量實體抽取效果,3種指標根據式(11)~式(13)計算。

式中表示精確率,表示召回率,1表示1分數。

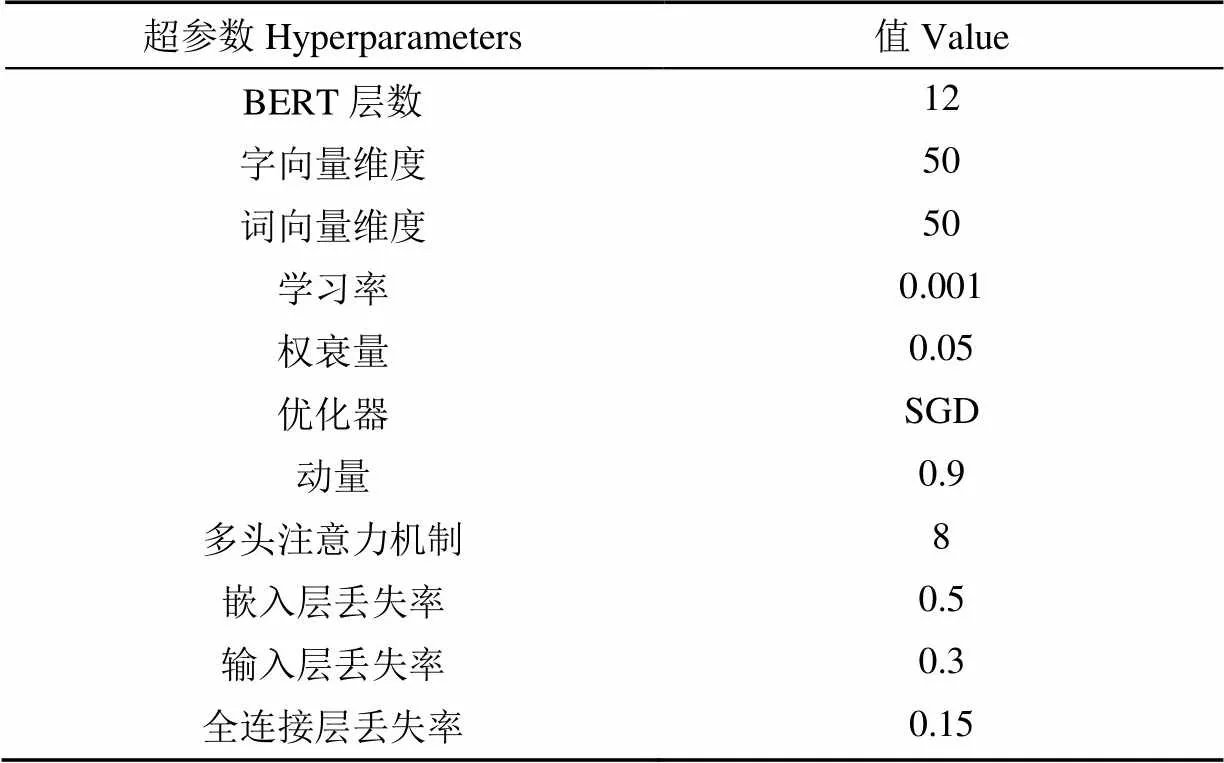

1.3.3 試驗參數

神經網絡模型中超參數的設置對模型的性能有很大的影響,學習率用于控制權值的更新速度,加快模型訓練并提升識別能力。優化器用來更新和計算影響模型訓練和輸出的網絡參數,使其逼近或達到最優值[32],動量用以控制梯度下降的速度。權重衰減、丟失率、多頭注意力機制3個參數會影響模型的收斂速度,需要設置合適的值以防模型出現過擬合。通過對數據集進行訓練,融合規則與BERT-FLAT模型的參數設置如表5所示。

表5 融合規則與BERET-FLAT模型的參數設置

2 結果與分析

2.1 預試驗

驗證所使用的相對位置編碼和外部詞表引入的有效性,對BERT+BiLSTM+CRF模型和融入位置信息的BERT+BiLSTM+CRF模型進行了試驗。融合位置信息的BERT+BiLSTM+CRF是對輸入序列中單字標識為0,多字詞開始位置標識為1,中間位置標識為2,結束位置標識為3,然后將輸入文本序列的詞匯相對位置編碼信息與BERT模型輸出進行拼接,試驗結果如表6所示。從表6中可以看出在加入位置信息后,對營養健康領域命名實體識別的準確率、召回率和1分數分別為86.56%、91.01%和88.72%,與BERT+BiLSTM+CRF模型相比,準確率、召回率和1分數分別提升了1.55、0.20、0.32個百分點,說明位置信息的引入對營養健康領域命名實體識別任務有提升作用。

表6 預試驗識別效果

注:BERT*+BiLSTM+CRF表示融合位置信息的BERT+BiLSTM+CRF模型。

Note: BERT*+BiLSTM+CRF represents the BERT+BiLSTM+CRF model fused with location information.

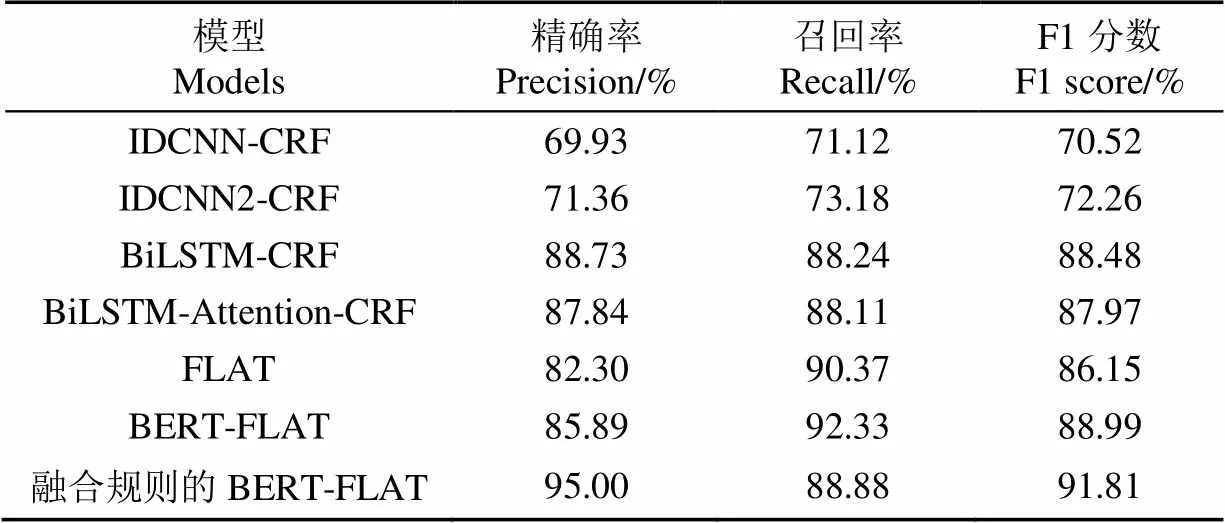

2.2 模型性能比較分析

使用精確率、召回率和F1分數三值作為評價指標,首先在BERT+BiLSTM+CRF[25]、迭代膨脹卷積神經網絡[33](Iterated dilated convolutional neural networks,IDCNN)、BiLSTM+CRF[34]、FLAT等幾個主流的命名實體識別模型進行了對比試驗,試驗結果如表7所示。

表7 不同模型的命名實體識別效果

注:IDCNN2和IDCNN的區別在于卷積層和全連接層的參數不同。

Note: The difference between IDCNN2 and IDCNN is the parameters of the convolutional layer and the fully connected layer.

從表8中可以看出,在IDCNN-CRF、IDCNN2-CRF、BiLSMT-CRF、BiLSTM-Attention-CRF、FLAT、BERT- FLAT中BERT-FLAT模型取得了最優結果,準確率、召回率、F1分數分別為85.89%、92.33%、88.99%,說明使用BERT預訓練語言模型結合字詞融合模型能夠有效的對實體進行識別。BERT-FLAT模型性能提升的主要原因在于模型中引入的詞匯、字符的相對位置關系有利于定位實體,其次引入詞嵌入作為先驗知識融入到模型中有利于實體的分類。在BERT-FLAT模型的基礎上增加了營養領域文本規則修正解碼序列,融合規則與BERT-FLAT模型具有很好的識別效果,雖然召回率低于BERT-FLAT模型,其主要原因在于部分正確識別的實體由于規則的引入調整為錯誤實體,導致召回率偏高,但是準確率和1分數分別提升了9.11和2.82個百分點,因此,通過試驗證明了規則的加入在一定程度上對融合規則與BERT-FLAT模型的預測結果進行了優化,對部分錯誤標簽實現了修正功能,且修正的數量大于干擾的數量。

2.3 識別詳情分析

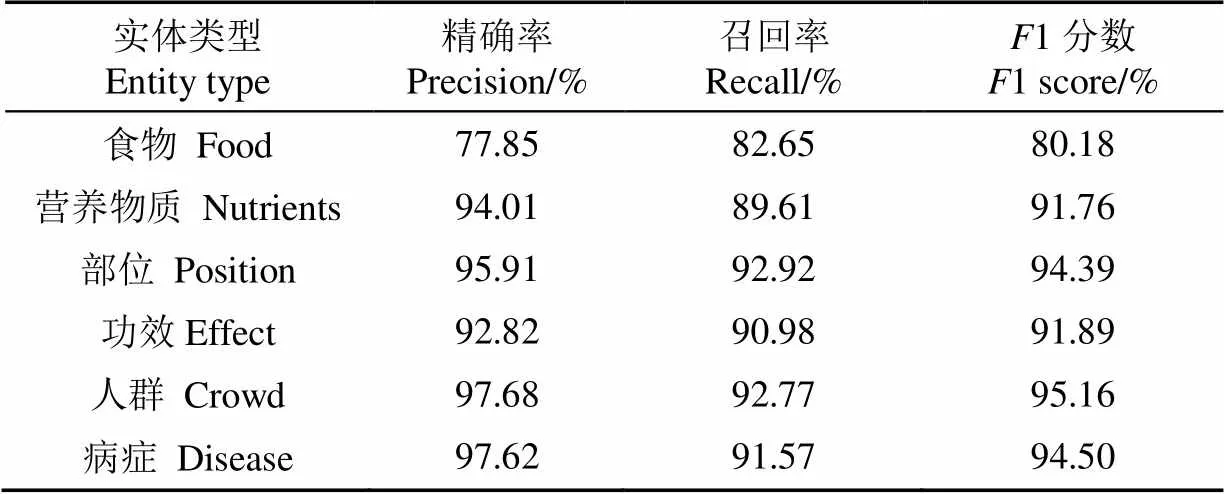

融合規則與BERT-FLAT模型在營養健康領域文本中各實體類別精確率、召回率、1分數如表8所示。從表中可以看出,無論在準確率、召回率還是1分數方面,食物類型實體相比于其他實體類型識別性能較低,主要包含了2個原因:1)食物實體類型中包含了大部分的嵌套實體,導致實體識別的不完全;2)由于規則的制定,導致詞匯融合錯誤,干擾了模型的識別性能。除食物類型實體,其他實體類型的精確率、召回率和1分數大部分在90%以上,且人群實體準確率和1分數達到了97.68%和95.16%,說明本模型整體識別性能較好。

表8 融合規則與BERT-FLAT模型各類實體識別效果

3 結 論

1)本研究針對人類營養健康領域含有大量復雜實體且文本序列較長問題,提出了將字符信息與詞匯信息融合的方法,結合外部此表為文本中的詞匯構建位置向量,并通過預試驗證明了詞表及位置特征對于命名實體任務的有效性。

2)針對營養健康領域實體識別準確率不高的問題,根據營養健康文本特征,定義7種營養文本規則,并設計了融合規則與BERT-FLAT模型的營養健康命名實體識別方法,該方法通過BERT模型進行預訓練,并借助位置向量定位實體位置,實現字符與詞匯的交互,使用自注意力機制捕捉長距離依賴,通過規則后處理的方式,對解碼序列進行修正。相比于BERT-FLAT模型,本研究提出的融合規則與BERT-FLAT模型的識別效果有了明顯的提升,1分數為91.81%,解決了營養健康領域實體識別準確率不高的問題,是一種有效的人類營養健康領域實體識別方法,可以為農業、醫療、食品安全等其他領域復雜命名實體識別提供新思路。

雖然本研究提出的融合規則與BERT-FLAT模型證明在人類營養健康領域命名實體識別任務中有效,但是在提高食物類型實體識別準確度、復雜實體抽取、規則處理等方面仍有提升空間。

[1] 周旻. 中國特膳食品發展現狀及建議[J]. 合作經濟與科技,2021(14):52-54.

Zhou Min. Development status and suggestions of special food in China[J]. CO-Oerativeconomy & Science, 2021(14): 52-54. (in Chinese with English abstract)

[2] 任發政. 乳的營養與健康[J]. 中國食品學報,2020,20(7):1-9.

Ren Fazheng. Advances in milk nutrition and human health[J]. Journal of Chinese Institute of Food Science and Technology, 2020, 20(7): 1-9. (in Chinese with English abstract)

[3] 喻兵. 基于多維度特征的飲食干預方法研究[D]. 湘潭:湘潭大學,2019.

Yu Bing. Research on Dietary Intervention Bases on Multi-dimensional Characteristics[D]. Xiangtan: Xiangtan University, 2019. (in Chinese with English abstract)

[4] 董洪偉. 基于知識圖譜的菜品推薦系統[D]. 北京:北京林業大學,2020.

Dong Hongwei. Dish Recommendation System Based on Knowledge Graph[D]. Beijing: Beijing Forestry University, 2020. (in Chinese with English abstract)

[5] 金碧漪. 基于多源UGC數據的健康領域知識圖譜構建[D]. 上海:華東師范大學,2016.

Jin Biyi. Construction of Health Knowledge Graph Based on Multi-source UGC data[D]. Shanghai: East China Normal Unversity, 2016. (in Chinese with English abstract)

[6] 任媛,于紅,楊鶴,等. 融合注意力機制與BERT+BiLSTM+CRF模型的漁業標準定量指標識別[J]. 農業工程學報,2021,37(10):135-141.

Ren Yuan, Yu Hong, Yang He, et al. Recognition of quantitative indicator of fishery standard using attention mechanism and the BERT+BiLSTM+CRF model[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2021, 37(10): 135-141. (in Chinese with English abstract)

[7] 檀穩. 基于深度學習的植物知識圖譜的構建[D]. 北京:北京林業大學,2019.

Tan Wen. The Construction of Plant Knowledge Graph Based on Deep Learning[D]. Beijing: Beijing Forestry University, 2020. (in Chinese with English abstract)

[8] 王蓬輝,李明正,李思. 基于數據增強的中文醫療命名實體識別[J]. 北京郵電大學學報:2020,43(5):84-90.

Wang Penghui, Li Mingzheng, Li Si. Data augmentatoin for Chinese clinical named entity recognition[J]. Journal of Beijing University of Posts and Telecommunications, 2020, 43(5): 84-90. (in Chinese with English abstract)

[9] 吳賽賽,周愛蓮,謝能付,等. 基于深度學習的作物病蟲害可視化知識圖譜構建[J]. 農業工程學報,2020,36(24):177-185.

Wu Saisai, Zhou Ailian, Xie Nengfu, et al. Construction of visualization domain-specific knowledge graph of crop diseases and pests based on deep learning[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2020, 36(24): 177-185. (in Chinese with English abstract)

[10] 楊培,楊志豪,羅凌,等. 基于注意機制的化學藥物命名實體識別[J]. 計算機研究與發展,2018,55(7):1548-1556.

Yang Pei, Yang Zhihao, Luo Ling, et al. An attention-based approach for chemical compound and drug named entity recognition[J]. Journal of Computer Research and Development, 2018, 55(7): 1548-1556. (in Chinese with English abstract)

[11] Li L, Hou L. Named entity recognition in Chinese electronic medical records based on the model of bidirectional long short-term memory with a conditional random field Layer[J]. Studies in Health Technology and Informatics, 2019, 264: 1524-1525.

[12] 張晗,郭淵博,李濤. 結合GAN與BiLSTM-Attention-CRF的領域命名實體識別[J]. 計算機研究與發展,2019,56(9):1851-1858.

Zhang Han, Guo Yuanbo, Li Tao. Domain named entity recognition combining GAN and BiLSTM-Attention-CRF[J]. Journal of Computer Research and Development, 2019, 56(9): 1851-1858. (in Chinese with English abstract)

[13] 董哲,邵若琦,陳玉梁,等. 基于BERT和對抗訓練的食品領域命名實體識別[J]. 計算機科學,2021,48(5):247-253.

Dong Zhe, Shao Ruoqi, Chen Yuliang, et al. Named entity recognition in food field based on BERT and adversarial training[J]. Computer Science, 2021, 48(5): 247-253. (in Chinese with English abstract)

[14] 王璐. 基于知識圖譜的健康膳食知識智能問答系統[D]. 蘭州:蘭州大學,2020.

Wang Lu. A Healthy Diet Knowledge Q/A system Based on Knowledge Graph[D]. Lanzhou: Lanzhou University, 2020. (in Chinese with English abstract)

[15] 遲楊. 健康飲食領域知識圖譜構建與應用研究[D]. 長春:吉林大學,2019.

Chi Yang. Knowledge Graph Construction and Application in Healthy Diet Domain[D]. Changchun: Jilin University, 2019. (in Chinese with English abstract)

[16] 武樂飛. 基于邊界的嵌套命名實體識別方法研究[D]. 貴陽:貴州大學,2020.

Wu Lefei. Recreach on Recognition Method of Nested Named Entity Based on Boundary[D]. Guiyang: Guizhou University, 2020. (in Chinese with English abstract)

[17] Yue Z, Jie Y. Chinese NER using lattice LSTM[C]//The 56thAnnual Meeting of the Association for Computational Linguistics (ACL). Melbourne, AUS: Melbourne Convention and Exhibition Centre, 2018.

[18] Sui D, Chen Y, Liu K, et al. Leverage lexical knowledge for Chinese named entity recognition via collaborative graph network[C]//Proceedings of the 2019 Conference on Empirical Methods in Natural Language Processing and the 9th International Joint Conference on Natural Language Processing (EMNLP-IJCNLP). Hong Kong, China: World Expo, 2019.

[19] Gui T, Ma R, Zhang Q, et al. CNN-based Chinese NER with lexicon rethinking[C]//Twenty-Eighth International Joint Conference on Artificial Intelligence IJCAI-19. Macao, China: Venice Macao people Conference Center, 2019.

[20] Li X, Yan H, Qiu X, et al. FLAT: Chinese NER using flat-lattice transformer[C]//Proceedings of the 58thAnnual Meeting of the Association for Computational Linguistics. 2020.

[21] 中國營養學會. 中國居民膳食營養素參考攝入量速查手冊:2013版[M]. 北京:中國標準出版社,2014.

[22] Wu Y, Zhang F, Yang K, et al. SymMap: An integrative database of traditional Chinese medicine enhanced by symptom mapping[J]. Nuclc Acids Research, 2018(D1): D1110-D1117.

[23] 鐘友林. 營養學領域的知識抽取相關技術研究[D]. 哈爾濱:哈爾濱工業大學,2019.

Zhong Youlin. Research on Technologies of Knowledge Extraction in Nutrition[D]. Harbin: Harbin Institute of Technology, 2019. (in Chinese with English abstract)

[24] 郭旭超,唐詹,刁磊,等. 基于部首嵌入和注意力機制的病蟲害命名實體識別[J]. 農業機械學報,2020,51(Supp2):335-343.

Guo Xuchao, Tang Zhan, Diao Lei, et al. Recognition of Chinese agricultural diseases and pests named entity with joint radical embedding and self-attention mechanism[J]. Transactions of the Chinese Society for Agricultural Machinery, 2020, 51(Supp2): 335-343. (in Chinese with English abstract)

[25] Devlin J, Chang M-W, Lee K, et al. BERT: Pre-training of deep bidirectional transformers for language understanding[J]// Melbourne, AUS: Melbourne Convention and Exhibition Centre, 2018.

[26] 齋藤康毅. 深度學習進階:自然語言處理,陸宇杰譯[M]. 北京:人民郵電出版社,2020. 10.

[27] Mikolov T, Sutskever I, Chen K, et al. Distributed representations of words and phrases and their compositionality[C]//Advances in neural information processing systems, Lake Tahoe, US: MIT Press, 2013.

[28] Dai Z, Yang Z, Yang Y, et al. Transformer-XL: Attentive Language Models beyond a Fixed-Length Context[C]//Proceedings of the 57thAnnual Meeting of the Association for Computational Linguistics. Florence, Italy, 2019.

[29] 王乃鈺,葉育鑫,劉露,等. 基于深度學習的語言模型研究進展[J]. 軟件學報,2021,32(4):1082-1115.

Wang Naiyu, Ye Yuxin, Liu Lu, et al. Language models based on deep learning: a review[J]. Journal of Software, 2021, 32(4): 1082-1115. (in Chinese with English abstract)

[30] 王海寧,周菊香,徐天偉. 融合深度學習與規則的民族工藝品領域命名實體識別[J]. 云南師范大學學報:自然科學版,2020,40(2):48-54.

Wang Haining, Zhou Juxiang, Xu Tianwei. Named entity recogniton in ethnic handicraft field with the deep learning and rules[J]. Journal of Yunnan Normal University: Natural Sciences Edition, 2020, 40(2): 48-54. (in Chinese with English abstract)

[31] 李明揚,孔芳. 融入自注意力機制的社交媒體命名實體識別[J]. 清華大學學報:自然科學版,2019,59(6):461-467.

Li Mingyang, Kong Fang. Combined self-attention mechanism for named entity recognition in social media[J]. Journal of Tsinghua University: Science and Technology, 2019, 59(6): 461-467. (in Chinese with English abstract)

[32] 劉全,翟建偉,章宗長,等. 深度強化學習綜述[J]. 計算機學報,2018,41(1):1-27.

Liu Quan, Zhai Jianwei, Zhang Zongzhang, et al. A survey on deep reinforcement learning[J]. Chinese Journal of Computers, 2018, 41(1): 1-27. (in Chinese with English abstract)

[33] Strubell E, Verga P, Belanger D, et al. Fast and Accurate Entity Recognition with Iterated Dilated Convolutions[M]//Association for Computational Linguistics, Copenhagen, Denmark, 2017: 2670-2680.

[34] Huang Z, Wei X, Kai Y. Bidirectional LSTM-CRF Models for Sequence Tagging[J]. Computer Science, 2015, 20(2): 508-517.

Named entity recognition in human nutrition and health domain using rule and BERT-FLAT

Zheng Limin1, Ren Lele2

(1.,100083,; 2.,,100083,)

A nutritious and healthy diet can be widely expected to reduce the incidence of disease, while improving body health after the disease occurs. The nutritional diet knowledge can be acquired mostly through the Internet in recent years. However, reliable and integrated information is highly difficult to discern using time-consuming searching of the huge amount of Internet data. It is an urgent need to integrate the complicated data, and then construct the knowledge graph of nutrition and health, particularly with timely and accurate feedback. Among them, a key step is to accurately identify entities in nutritional health texts, providing effective location data support to the construction of knowledge graphs. In this study, a BRET+BiLSTM+CRF (Bidirectional Encoder Representations from Transformers + Bi-directional Long Short-Term Memory + Conditional Random Field) model was first used with location information. It was found that the precision of the model was 86.56%, the recall rate was 91.01%, and the F1 score was 88.72%, compared with the model without location information, indicating improved by 1.55, 0.20, and 0.32 percentage points. A named entity recognition was also proposed to accurately obtain six types of entities in text: food, nutrients, population, location, disease, and efficacy in the field of human nutritional health, combining rules with BERT-FLAT (Bidirectional Encoder Representations from Transformers-Flat Lattice Transformer) model. Firstly, the character and vocabulary information were stitched together and pre-trained in the BERT model to improve the recognition ability of the model to entity categories. Then, a position code was created for the head and tail position of each character and vocabulary, where the entity position was located with the help of a position vector, in order to improve the recognition of entity boundary. A long-distance dependency was also captured using the Transformer model. Specifically, the output of the BERT model was embedded into the Transformer as a character-embedding conjunction word, thus for the character-vocabulary fusion. Then the text prediction sequence was obtained from the CRF layer. Finally, seven rules were formulated, according to the text characteristics in the field of nutrition and health, where the prediction sequence was modified according to the rules. The experimental results showed that the F1 score of the BERT-FLAT model was 88.99%. The BERT model combined with the word fusion performed the best, compared with that without the Bert model, indicating an effective recognition performance. Correspondingly, the named entity recognition model in the field of nutrition and health using fusion rules and the BERT-FLAT model presented an accuracy rate of 95.00%, a recall rate of 88.88%, and an F1 score of 91.81%. The F1 score increased by 2.82 percentage points than before. The finding can provide an effective entity recognition in the field of human nutrition and health.

nutrition; health; food; named entity recognition; self-attention mechanism; BERT model; transformer model

鄭麗敏,任樂樂. 采用融合規則與BERT-FLAT模型對營養健康領域命名實體識別[J]. 農業工程學報,2021,37(20):211-218.doi:10.11975/j.issn.1002-6819.2021.20.024 http://www.tcsae.org

Zheng Limin, Ren Lele. Named entity recognition in human nutrition and health domain using rule and BERT-FLAT[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2021, 37(20): 211-218. (in Chinese with English abstract) doi:10.11975/j.issn.1002-6819.2021.20.024 http://www.tcsae.org

2021-02-20

2021-08-10

現代農業產業技術體系北京市生豬產業創新團隊項目(BAIC02-2021);國家重點研發計劃(2017YFC1601803)

鄭麗敏,教授,碩士生導師,研究方向為人工智能、知識圖譜等。Email:zhenglimin@cau.edu.cn

10.11975/j.issn.1002-6819.2021.20.024

TP391.1

A

1002-6819(2021)-20-0211-08