基于生成式對抗網絡的聯邦學習后門攻擊方案

陳大衛 付安民 周純毅 陳珍珠

1(南京理工大學計算機科學與工程學院 南京 210094) 2(信息安全國家重點實驗室(中國科學院信息工程研究所) 北京 100093) (894346698@qq.com)

聯邦學習[1]將深度學習模型與分布式訓練相結合,使得多方用戶在不共享數據的情況下,協同參與訓練全局模型,降低了傳統集中式學習中的用戶隱私泄露風險和通信開銷[2],從技術層面可以打破數據孤島,明顯提高深度學習的性能,能夠實現多個領域的落地應用,比如智慧醫療、智慧金融、智慧零售和智慧交通等[3-4].聯邦學習作為大數據使用的新范式,是破解數據隱私保護與數據孤島難題的新思路,一經提出就成為國際學術界和產業界關注的焦點.

海量的用戶數據、豐富的應用場景促進了聯邦學習技術的蓬勃發展,但聯邦學習數以萬計的用戶中可能存在惡意用戶,并且用戶的本地訓練過程對于服務器不可見,服務器無法驗證用戶更新的正確性[5-7],特別是服務器采用加權平均算法對參數進行更新,限制了異常檢測的使用,這些缺陷的存在使得聯邦學習框架極易遭受投毒攻擊[8]、對抗樣本攻擊[9-11]和后門攻擊[12].

后門攻擊通過在攜帶觸發器的數據上訓練模型,使得模型能夠在不包含觸發器的場景下正常進行分類任務.但當模型識別到觸發器的特征時,后門被激發,模型會定向分類攻擊者指定的標簽.后門攻擊的本質在于模型對于觸發器的特征過擬合,當神經網絡中神經元同時遇到普通特征與觸發器特征時,會優先分類為觸發器特征對應的標簽.Yao等人[13]在網絡上發布植入后門的預訓練模型,并通過遷移學習感染用戶模型,提高了后門攻擊的隱蔽性.Liu等人[14]研究不同觸發器與神經網絡中內在神經元之間的聯系,建立起觸發器與關鍵神經元之前的強聯系,模型識別觸發器時,所選神經元就會觸發,導致偽裝式輸出.這使得后門攻擊的隱蔽性與危害性得到了顯著的提升.

后門攻擊在集中式學習與聯邦學習中的實現方式有所差異,集中式學習中攻擊者一般在本地訓練后門模型,將其上傳至云端服務器,供用戶下載,從而實現后門攻擊.而在聯邦學習中,攻擊者在本地將觸發器植入訓練數據生成后門樣本數據集,在每個訓練批次內同時訓練本地樣本以及后門樣本,從而訓練后門模型.后門模型經過參數聚合過程,逐漸影響整個聯邦環境下用戶的本地模型,因此危害面更廣.Bagdasaryan等人[15]首次提出了針對聯邦學習的后門攻擊,攻擊者上傳植入后門的模型,并通過優化算法縮放本地模型權重,進而替換全局模型.當全局模型在執行分類任務時,會按照攻擊者指定的目標標簽進行分類.Xie等人[16]在現有的攻擊方式上,提出了分布式后門攻擊(distributed backdoor attack, DBA),該方案采用多個觸發器植入后門,多個局部觸發器組合成全局觸發器,提升了后門攻擊的精度.

針對存在的后門攻擊,研究人員也提出了不同防御手段[17],包括神經元檢測、觸發器重構技術等.Liu等人[18]采用人工腦刺激(artificial brain stimula-tion, ABS)技術識別對特定標簽有較高異常值的關鍵神經元,能成功檢測出模型中是否存在隱藏的后門.Wang等人[19]通過重構觸發器來識別后門模型.針對所有輸出標簽類,使用反向工程重構觸發器以識別后門樣本,以修剪與觸發器相關的神經元的方式防御后門攻擊.由于目前后門攻擊方案需要執行多輪后門訓練才能使后門模型收斂,造成了額外的計算開銷,并且后門方案中的觸發器采用隨機性圖片或像素點,與訓練數據集中樣本存在較大的差異,使觸發器容易被檢測、重構,影響了后門攻擊的效果.

因此,針對后門攻擊中收斂速率較慢以及觸發器與干凈樣本差異較大而易被檢測等問題,本文提出了一種新型聯邦學習后門攻擊方案Bac_GAN,通過采用生成式對抗網絡(generative adversarial networks, GAN)技術[20-22]設計了1個觸發器生成算法Trig_GAN,能夠降低觸發器樣本與訓練樣本間的差異,從而提升觸發器的隱蔽性.并且通過良性特征混合訓練以及縮放后門模型大幅縮短模型的收斂速率,從而顯著提升后門攻擊成功率.本文的主要貢獻有3個方面:

1) 設計了1個新的基于生成式對抗網絡的觸發器生成算法Trig_GAN,從聯邦學習樣本中直接生成觸發器,將觸發器以水印[23]的形式植入干凈樣本,明顯降低了觸發器樣本與訓練樣本的差異,從而提升了觸發器的隱蔽性.

2) 基于設計的觸發器算法,提出了一種新型聯邦學習后門攻擊方案Bac_GAN,該方案通過良性特征混合訓練保證了后門任務與正常分類任務的精度.特別是,通過縮放后門模型,避免了參數聚合過程中后門貢獻被抵消的問題,使得后門模型能夠短時間內達到收斂,進而提升后門攻擊成功率.

3) 通過從觸發器生成、水印系數、縮放系數等后門攻擊核心要素進行了實驗測試,給出了影響后門攻擊性能的最佳參數,并與在MNIST與CIFAR-10數據集上對比現有典型后門攻擊方案,實驗證明Bac_GAN能夠顯著提升后門攻擊的收斂速率與攻擊成功率.

1 相關技術

1.1 聯邦學習框架

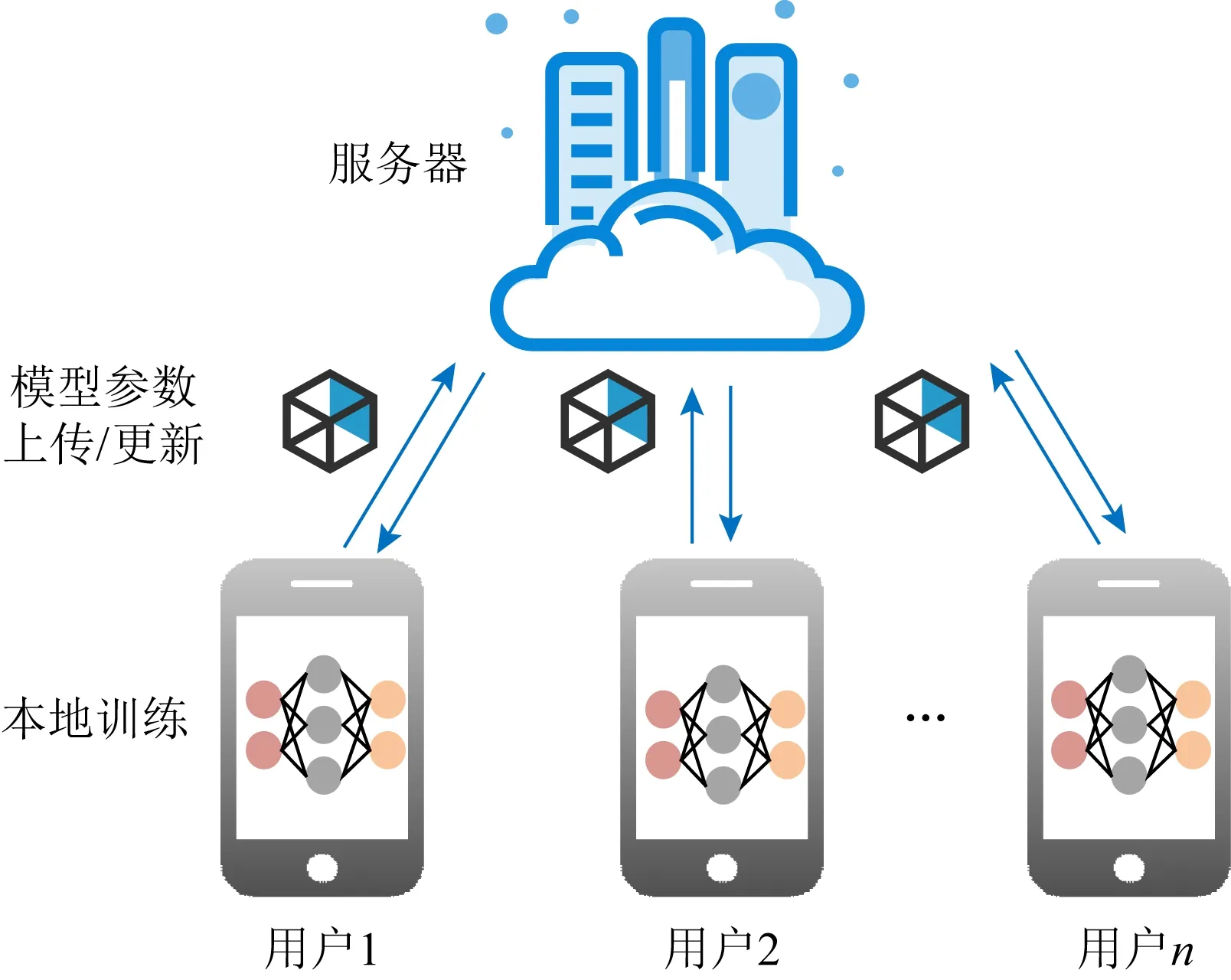

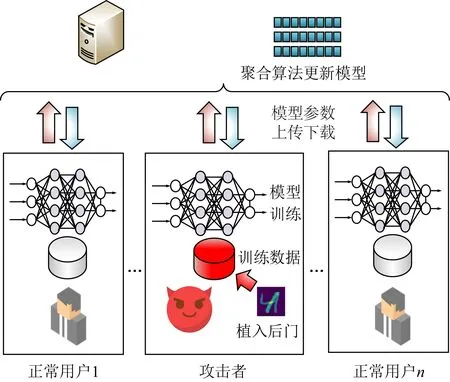

圖1顯示了聯邦學習的框架,用戶首先下載初始的全局模型參數,根據服務器提供的學習算法在本地進行訓練并上傳本地模型參數,服務器對用戶上傳的參數采用加權平均算法更新全局模型,然后用戶即可下載新的全局模型參數進行下一輪訓練.

Fig.1 The architecture of federated learning圖1 聯邦學習框架

具體來說,聯邦學習目的在于將用戶本地模型聚合成1個全局模型,將深度學習任務分配給n個用戶.首先,在每輪t中,服務器隨機挑選m個用戶,并向他們分發初始的全局模型Gt.每個被選中的用戶對其本地數據進行訓練,然后將該模型更新為新的本地模型Lt+1,并將差異Lt+1-Gt返回服務器.服務器對接收到的更新進行聚合,以獲得新的全局模型:

(1)

1.2 生成式對抗網絡

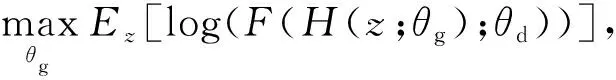

生成式對抗網絡GAN是2014年Goodfellow等人[24]首次提出,旨在解決如何從現有樣本中訓練新樣本的問題,從而達到拓展數據集的目的.GAN技術的關鍵在于學習訓練樣本的數據分布,從而發現隨機變量演變到訓練樣本的映射函數.GAN主要包含2部分,即生成器模型與判別器模型.生成器是1個由多層感知器組成的神經網絡模型,其作用在于將隨機的一維噪聲轉換為新的數據樣本.判別器則是判斷樣本是真實樣本還是生成網絡產生的假樣本的概率.首先,生成器通過輸入滿足先驗概率分布的隨機噪聲z,生成偽造的數據.其目的在于使偽造的數據與真實數據無差別,即判別器識別數據G(z,θg)為真的概率盡可能大.目標函數為

(2)

θd,θg分別為判別器與生成器的模型參數,x為真實樣本,F(·)表示x來自于真實數據分布的概率,H(·)表示將輸入的噪聲z映射成數據.判別器的功能是判斷生成的樣本是否為真,即使輸出為真實數據x的概率盡可能高,而使輸出為生成器生成的假樣本H(z,θg)的概率盡可能低,其目標函數為

(3)

2 基于生成式對抗網絡的后門攻擊

為了降低觸發器特征與原樣本特征之間的差異同時提高后門模型的收斂速率,我們利用GAN技術生成接近真實樣本的觸發器,進而實現了Bac_GAN后門攻擊方案.下面我們先闡述聯邦學習后門攻擊模型,然后給出觸發器算法Trig_GAN的設計,最后詳細說明構建的后門攻擊方案Bac_GAN.

2.1 聯邦學習后門攻擊模型

圖2顯示了聯邦學習場景下的后門攻擊模型.攻擊者偽裝成良性用戶參與聯邦學習,在本地訓練過程中,攻擊者在攜帶觸發器的數據集上訓練后門模型,上傳的后門模型通過加權平均等算法進一步改變原始數據的原始分布和學習算法邏輯,從而試圖控制聯邦學習系統產生1個全局模型,使得全局模型在帶有觸發器的目標輸入上實現較高的攻擊成功率,同時在其主要分類任務上保持較高的精度.在分類任務的背景下,我們定義3個指標來評價后門攻擊性能:

1) 后門攻擊準確率.即攻擊成功率,指帶有觸發器樣本的分類置信度,使全局模型將帶有觸發器的圖像分類為攻擊者指定的標簽;

2) 主要任務準確率.表示全局模型對干凈樣本應具有較高的分類精度,以防止全局模型被丟棄;

3) 收斂速率.達到相同準確精度,模型訓練的輪數.

Fig.2 The Backdoor attack model of federated learning圖2 聯邦學習后門攻擊模型

通常,我們假設攻擊者具有4種能力:

1) 攻擊者控制本地訓練數據;

2) 控制本地訓練過程和模型結構以及超參數,如epoch數和學習率;

3) 在將生成的本地模型提交聚合之前,可以對本地模型參數進行修改;

4) 可以自適應地逐輪改變模型的局部訓練.

2.2 觸發器算法Trig_GAN設計

實施后門攻擊的關鍵在于建立隱蔽、巧妙的觸發器生成算法,而使用其他良性用戶的真實訓練樣本作為觸發器,不僅能增加觸發器的隱蔽性,同時能使得后門模型在相同的訓練輪數下更快收斂.為了使攻擊者獲得其他用戶多個類的部分真實訓練樣本,同時判斷出真實訓練樣本中的主要標簽,本文提出了一種基于生成對抗網絡的觸發器生成算法Trig_GAN.該算法利用GAN模型生成其他用戶的真實樣本作為觸發器.

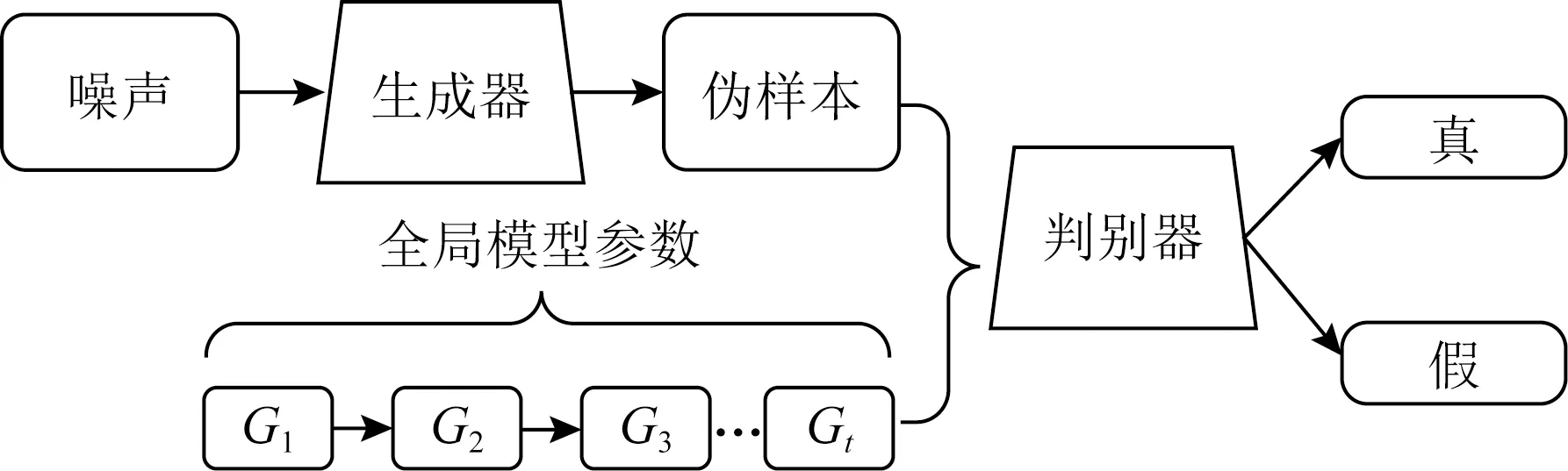

GAN模型中需要真實樣本作為判別器的輸入,而在聯邦學習模式下全局模型參數是通過在每個參與者的上傳數據進行模型訓練后加權平均生成,因此可以用來更新判別器的模型參數.這相當于直接在其他用戶的真實訓練樣本上訓練判別器.這種巧妙的方式使得生成器可以很容易地產生與真實訓練樣本相似的偽樣本.圖3為聯邦學習模式下GAN模型示意圖,其中判別器與全局模型有著相同的結構(網絡層數相同,輸出不同),并且隨著用戶與服務器迭代次數的增加而更新其網絡參數.在聯邦學習過程中,一方面本地用戶模型的更新會促進全局模型的收斂,另一方面判別器模型作為全局模型的更新也會通過全局模型參數進行同步更新.同時,生成器以噪聲Znoise為輸入,有條件地生成特定的樣本.

Fig.3 GAN model of federated learning mode圖3 聯邦學習模式下GAN模型

本文將生成的偽樣本反向輸入全局模型中,選擇準確率最高的一類作為觸發器.算法1給出了觸發器生成算法的形式化描述.在每輪迭代中,攻擊者首先下載全局模型Gt并且初始化判別器的模型參數.生成器接受隨機噪聲后產生偽樣本xfake,并且將這些樣本發送到判別器.如果判別器將xfake的標簽判斷屬于樣本空間的一類,將xfake賦值于xm,否則更新式(1).最后攻擊者將選擇的標簽ym分配給xm并將其添加到觸發器集合中.如果攻擊者在聯邦學習中不斷加入,生成器可以生成大量的偽樣本集合,進而生成大量的觸發器集合.將觸發器集合按照標簽進行分類,反向輸入模型進行預測,最后輸出準確值最高的樣本作為本文選擇的觸發器.

在整個聯邦學習訓練過程中,由于觸發器的樣本占所有用戶樣本的絕大部分,因此全局模型在某種程度上,對于觸發器的特征過擬合.將觸發器加入到攻擊者的訓練樣本上,能夠使得后門模型在短時間內達到收斂.同時觸發器的特征接近真實樣本的特征,避免觸發器被檢測、重構,提升了觸發器的隱蔽性.

算法1.觸發器生成算法Trig_GAN.

輸入:全局模型參數Gt、噪聲樣本Znoise、標簽分布Y;

輸出:觸發器樣本Dtrigger.

① 初始化判別器與生成器;

Repeat

② 使用Gt更新判別器的模型參數;

Repeat

③ 運行生成器生成偽樣本xfake,并將其發送至判別器;

④ 如果偽樣本屬于目標標簽ym,使得xm=xfake,否則基于式(2)更新生成器;

⑤ 如果xm的標簽等于ym,分配標簽ym給樣本xm,并將樣本(xm,ym)添加到Dtrigger;

Untilepoch周期結束;

Repeat

⑥ 將觸發器集合Dtrigger按照標簽分類,反向輸模型,記錄準確率較高的一類;

UntilDtrigger集合全部遍歷;

Until通信結束;

Return觸發器樣本Dtrigger.

2.3 后門攻擊Bac_GAN構建

基于Trig_GAN觸發器生成算法,我們提出了一種新的后門攻擊方案Bac_GAN,圖4描述了該后門攻擊方案的架構圖.攻擊者首先下載全局模型參數更新判別器,進而生成觸發器集合,然后將觸發器以水印的方式植入訓練樣本生成后門訓練數據,最后攻擊者訓練本地后門模型上傳攻擊全局模型.攻擊者具體按照5個步驟實施后門攻擊:

1) 攻擊者從服務器下載初始全局模型參數,更新本地模型以及判別器模型.攻擊者偽裝成良性用戶訓練模型,并上傳模型參數;

2) 攻擊者正常參與聯邦學習的過程中,根據觸發器生成算法Trig_GAN,生成觸發器集合直到觸發器準確率達到期望閾值;

3) 攻擊者按照算法2將觸發器以水印的方式植入本地樣本,并修改其標簽,生成后門訓練集Dbackdoor.原樣本的特征與觸發器的特征進行重疊,同時保持視覺上的不同.觸發器的特征會融入到本地訓練樣本中,即使經過再訓練,也會使觸發器保持在目標實例的特征空間附近;

4) 攻擊者通過混合良性特征訓練,訓練后門模型,如算法3所示.其中良性特征混合訓練即相同批次內在干凈樣本(正常訓練的樣本)、后門樣本(觸發器樣本與干凈樣本的混合樣本)和觸發器樣本(攜帶觸發器的樣本)中共同訓練;

5) 攻擊者采用后門模型B替換全局模型Gt,并通過縮放系數C放大全局模型,使得后門模型能在加權平均期間保留后門模型的貢獻.

B=C(B-Gt)+Gt.

(4)

在Bac_GAN后門攻擊方案的構建過程中,利用GAN模型生成了接近真實訓練樣本的觸發器集合,降低了觸發器與訓練數據之間的差異.在訓練后門模型階段,我們通過良性特征混合訓練以及縮放后門模型,能夠使得后門模型短時間內達到收斂.

Fig.4 The architecture diagram of Bac_GAN圖4 Bac_GAN方案架構圖

算法2.Dbackdoor生成算法.

輸入:本地訓練樣本Dlocal、觸發器Dtrigger、水印系數S、攻擊標簽yattack、觸發器樣本標簽ytrigger;

輸出:后門訓練集Dbackdoor.

Repeat

① 如果Dlocal中樣本的標簽等于攻擊者想要攻擊的標簽yattack,將攻擊樣本加上觸發器×水印系數S,賦值于xbac;

② 將(xbac,ytrigger)添加到Dbackdoor;

Until集合遍歷結束;

Return后門訓練集Dbackdoor.

算法3.Bac_GAN后門攻擊方案訓練算法.

輸入:本地訓練樣本Dlocal、后門訓練樣本Dbackdoor、觸發器樣本Dtrigger;

輸出:上傳的本地后門模型B.

① 初始化后門模型B與損失函數

Repeat

② 判斷后門模型B是否收斂,收斂則退出循環;

Repeat

③ 在訓練批次中同時訓練本地樣本Dlocal、后門樣本Dbackdoor、觸發器樣本Dtrigger,并更新攻擊模型B;

Until batch_size結束

④ 根據模型梯度更新學習率;

Until epoch結束

⑤ 通過式(4)縮放本地模型參數;

Return后門模型B.

3 實驗分析

我們在MNIST[25],CIFAR-10[26]數據集上實現生成式對抗網絡的后門攻擊方案,從觸發器生成、水印系數、縮放系數等后門攻擊核心要素進行了實驗測試,探討和分析影響后門攻擊性能的最佳參數,并與現有典型后門攻擊方案進行對比,分析后門攻擊方案Bac_GAN的有效性.

Fig.5 Simulation of trigger generation圖5 模擬觸發器生成結果

3.1 實驗設置

我們模擬了真實聯邦學習場景下的實驗環境,通過socket技術實現服務器與用戶端的模型參數上傳下載過程.其中服務器端硬件為:Intel的i5-9300H(2.40 GHz)CPU和64 GB內存.用戶端硬件為:Intel的i5-6500CPU和16 GB內存.服務器和用戶端軟件使用的是:Windows10操作系統,Python 3.7.3和PyTorch 1.4.0+cu92.

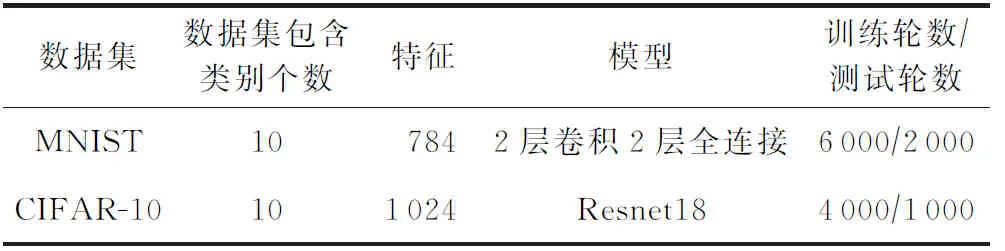

本實驗選擇不同規模的數據集進行訓練,表1中包含了MNIST數據集與CIFAR-10數據集的信息摘要.其中MNIST:包含10個類別的手寫數字數據集,本實驗將采用2層卷積2層全連接的卷積神經網絡[27]進行訓練.CIFAR-10數據集:包含10個類別普適物體的彩色圖像數據集,該數據集較為復雜,本實驗將采用Rsnet18模型進行訓練.

Table 1 Dataset Summary表1 數據集摘要

3.2 觸發器生成實驗

我們首先在MNIST與CIFAR-10數據集對GAN生成的樣本進行可視化,按照觸發器生成算法生成觸發器集合.其中判別器的網絡模型在每輪迭代過程中都通過全局模型進行更新.攻擊者將在全局模型的準確度達到85%時進行迭代,生成偽樣本集合.在樣本總和與參與用戶總數不變的情況下,實驗對于2種數據集分別迭代200次,從而利用生成器GAN生成偽樣本.

圖5分別顯示了MNIST與CIFAR10數據集隨聯邦學習迭代生成的偽樣本.由圖5可以看出,100輪左右重建結果已經逐漸靠近真實的MNIST與CIFAR10數據集樣本,而在150輪到200輪左右,由于生成器的性能隨著更新逐漸提升,因此產生的樣本更加清晰.其中MNIST數據集由于圖片簡單、特征少,已經接近真實樣本,而CIFAR10中的數據更加復雜,需要更多的訓練輪數.

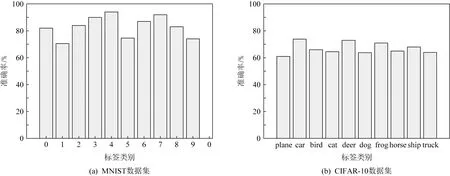

圖6顯示了將生成的偽樣本集合反向輸入模型得到的各種標簽的準確率.由圖6可知,利用Trig_GAN算法生成的圖像分別在MNSIT與CIFAR-10分類模型中都有較高的準確率.特別是,從圖6可以看出,得到“4”與“car”標簽的準確率最高.原因在于聯邦學習中“4”與“car”標簽的樣本在訓練數據集中占絕大多數,模型對于這些標簽的樣本的分類逐漸達到收斂.因此,我們將在后續實驗中分別選擇“4”與“car”標簽的樣本作為觸發器.

Fig.6 Accuracy results of trigger collection圖6 觸發器集合準確率

3.3 水印系數實驗分析

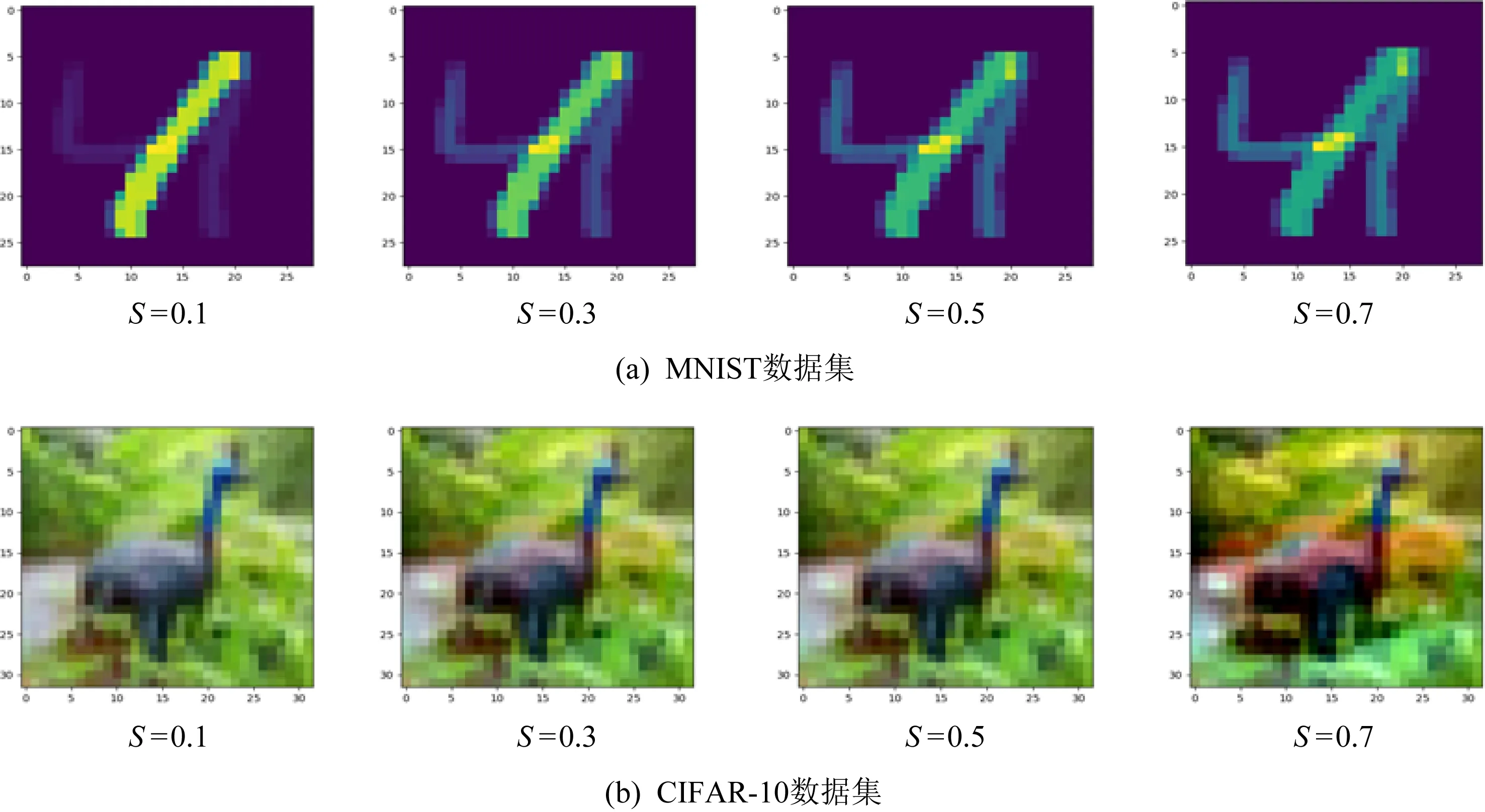

水印系數是影響觸發器隱蔽的關鍵因素,本節將討論不同水印系數S對于觸發器的顯示效果以及對于后門任務攻擊準確率的影響.

圖7顯示了后門數據樣本分別在水印系數S為0.1,0.3,0.5,0.7下的重構圖像.以圖7(a)MNIST數據集為例,我們重建了不同水印系數S情況下標簽“4”做為觸發器的后門數據集.其中在水印系數為0.1情形下的觸發器幾乎不可見,隱蔽性較高,但其特征不明顯.而在水印為0.5以及0.7的情況下,觸發器與原樣本的特征開始重疊,此時觸發器的特征會融入訓練樣本,從而達到后門植入的目的.

Fig.7 Reconstructed samples under different watermark coefficients圖7 不同水印系數下的重構樣本

為進一步驗證水印系數對于方案性能的影響,我們對不同水印系數下后門攻擊準確率隨訓練樣本的變化情況進行了測試.圖8給出了實驗在MNIST與CIFAR-10數據集中后門攻擊方案準確率的結果.由圖8可以看出,在水印系數0.1與0.3時,準確率較低,而在水印系數為0.5與0.7時準確率相差不大,這是因為觸發器的特征在水印系數為0.5時就已經逐漸與普通樣本重疊,此時提升水印系數的效果已經逐漸接近閾值.因此,我們在后續實驗中采用水印系數為0.5,以便同時保證后門準確率與隱蔽性.

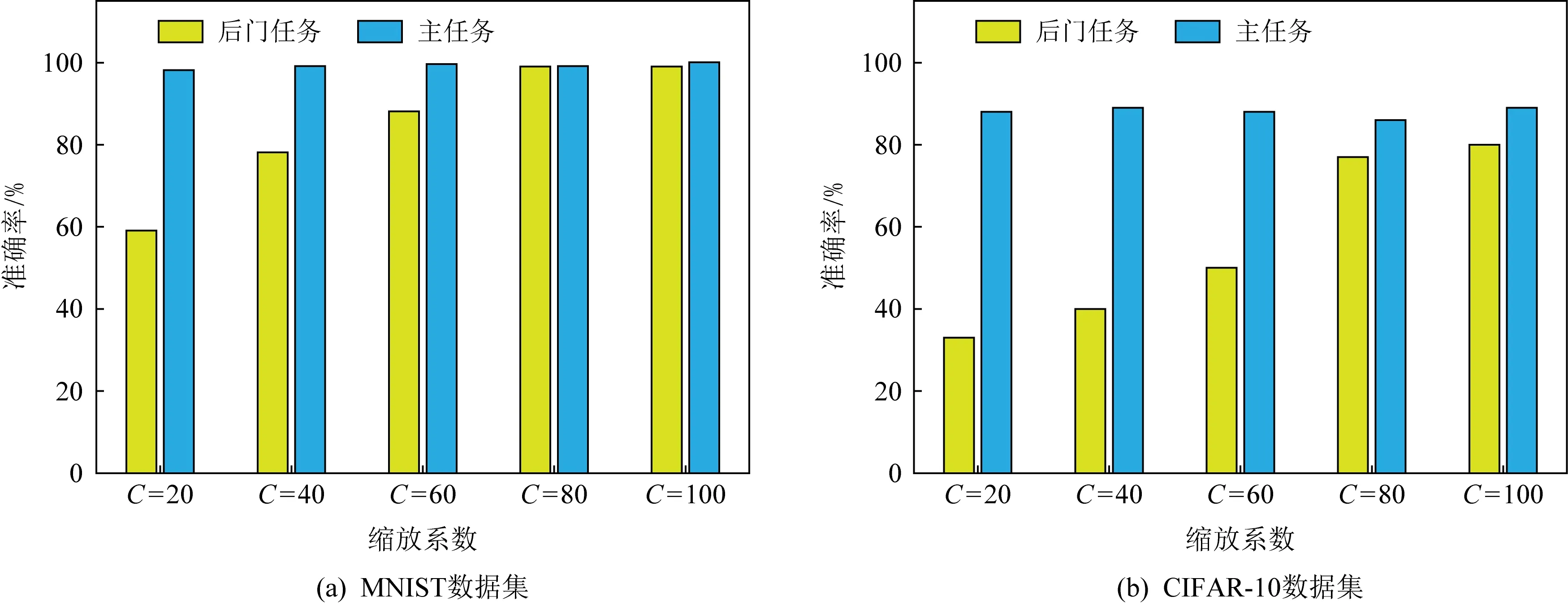

3.4 縮放系數實驗分析

在聯邦學習中,由于服務器端采用加權平均算法導致后門模型的貢獻被抵消,全局模型很快會遺忘后門,攻擊者持續參與模型聚合才能夠成功.因此攻擊者會通過縮放后門模型,使得后門模型能在加權平均期間保留后門模型的貢獻.

Fig.8 Accuracy results of backdoor attack schemes under different watermark coefficients圖8 不同水印系數下的后門攻擊方案準確率結果

圖9顯示了設置不同縮放系數對后門任務與主要任務的準確率影響.為更準確地說明實驗結果,我們選取并運行200輪聯邦學習迭代,并取不同縮放系數情況下(C=20,40,60,80,100)準確率的平均值作為評判依據.

由圖9可以看出,縮放系數越高對于后門任務的準確性有著相應地提升,特別是圖9(a)中在縮放系數為80時,后門模型性能的提升開始放緩,并基本接近100%.而由于CIFAR-10數據集過于復雜,攻擊者擁有著較少的訓練樣本,從而限制了后門的性能,但我們的Bac_GAN方案的攻擊成功率也達到了80%.

Fig.9 Accuracy results of backdoor attack schemes under different scaling factors圖9 不同縮放系數下的后門攻擊方案準確率結果

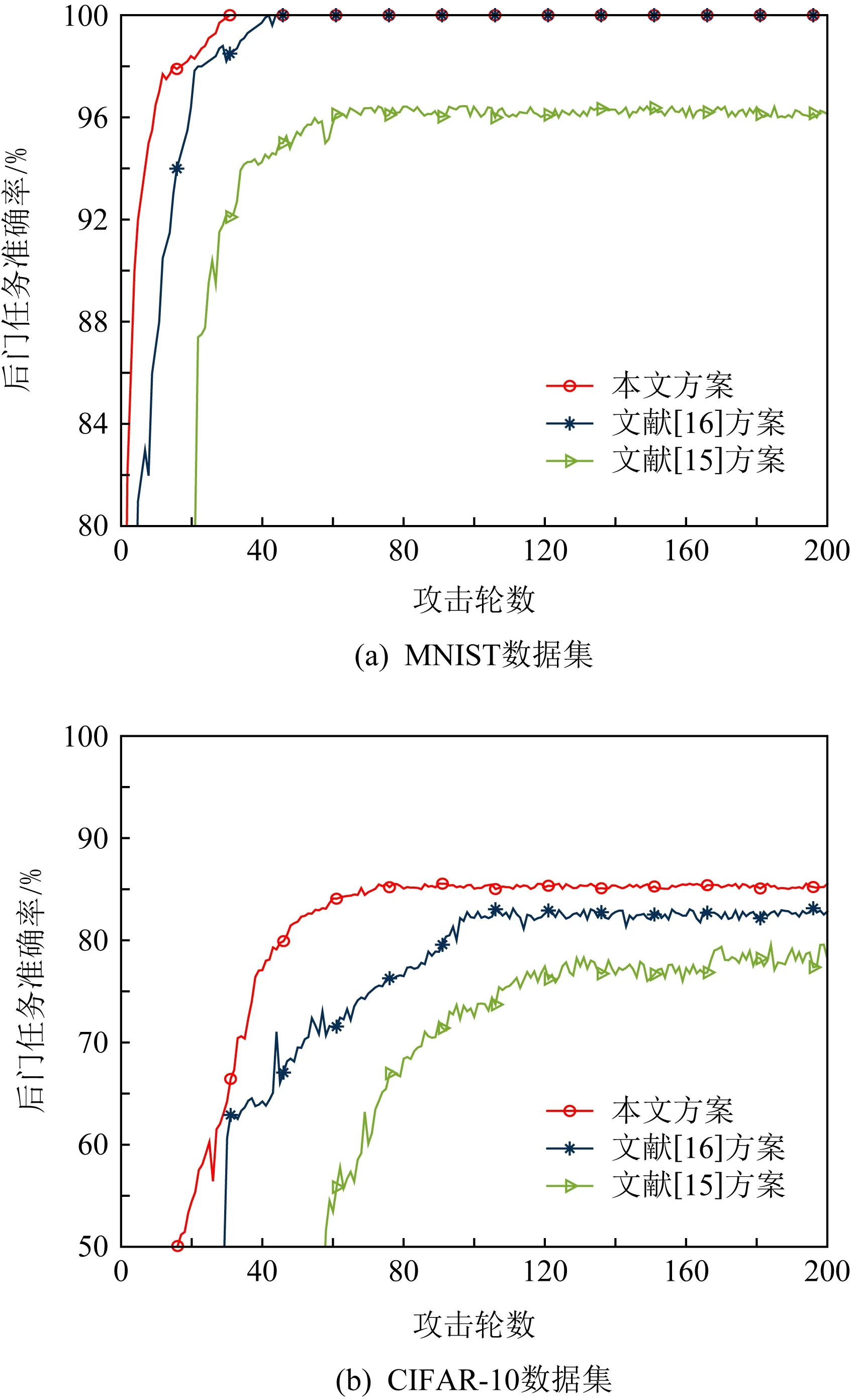

3.5 后門攻擊方案對比分析

為了進一步評估方案Bac_GAN的有效性,我們與現有典型后門攻擊方案進行了實驗對比.為了顯示后門攻擊的效果,我們將在多輪迭代中,同時以縮放系數為100實施完整的后門樣本訓練.

圖10給出了Bac_GAN方案與現有典型后門攻擊方案的準確率對比結果.由圖10可以看出,Bac_GAN攻擊方案的成功率一直優于經典后門攻擊方案.即使在MNSIT數據集中與方案[16]同時達到了100%,方案Bac_GAN依然保證了更快的收斂速率,比方案[16]提高了10輪.而在CIFAR-10數據集上,方案Bac_GAN的成功率總是在所有情況下都優于現有后門攻擊方案,同時保證更高的收斂速率.例如,方案Bac_GAN在70輪左右就達到收斂,而方案[16]需要100輪左右.

Fig.10 Comparison results of the accuracy of backdoor attack schemes under different rounds圖10 不同輪數下的后門攻擊方案準確率對比結果

3.6 討 論

經過在MNIST與CIFAR-10數據集中的多輪對比實驗,我們發現在相同的后門樣本數量下,水印系數越高攻擊成功率越高,但此時的觸發器隱蔽性逐漸降低.因此在實現后門攻擊時,我們應權衡隱蔽性與成功率之間的取舍.在選擇合適的水印系數狀況下,模型的縮放系數成為實現攻擊的關鍵因素.縮放系數越高后門攻擊全局模型的速率越快,但這將導致與正常用戶更新差異增加,增加被檢測和識別的可能性.最后通過與現有典型后門攻擊方案比較分析來看,本文所提方案Bac_GAN實現了更高的攻擊成功率以及更快的模型收斂速率.歸根結底在于Trig_GAN觸發器來源于聯邦學習中的絕大多數樣本,全局模型對于采用的觸發器已經從某種程度過擬合,從而能縮短后門模型的收斂速率.

4 結束語

本文提出一種基于生成式對抗網絡的聯邦學習后門攻擊方案Bac_GAN,方案使用Trig_GAN算法重構聯邦學習中樣本數據,作為攻擊者的候選觸發器,降低了觸發器特征與干凈樣本特征之間的差異,并通過以水印的方式添加至干凈樣本,提升了觸發器的隱蔽性.同時,通過縮放模型技術使得后門模型在短時間內達到收斂,從而提升了攻擊成功率.與現有典型后門攻擊方案相比,所提方案Bac_GAN在短時間內使得后門模型收斂,同時有效提升后門攻擊的成功率.在未來工作中,我們將進一步研究觸發器特征與樣本特征之間的聯系,從特征層面植入后門觸發器,以便設計更加隱蔽的后門攻擊方案.