基于計算機視覺的運動動作無標記識別技術研究進展

孫 冬,宋 楊,2,岑炫震,2,盛 博,顧耀東

(1.寧波大學體育學院,浙江寧波315211;2.塞格德大學工程學院,匈牙利塞格德6700;3.上海大學機電工程與自動化學院,上海200444)

當前,動作捕捉系統(Motion Capture System,MoCap)及相關技術已廣泛應用于運動科學、生物力學以及康復醫學等領域[1-6]。例如,可穿戴的慣性傳感測量元件(Inertial Measurement Unit,IMU)包含了加速度計、陀螺儀和磁強計傳感器等組件,可以進行三軸測量,基于人體運動的分層結構,分別量化加速度、角速度和運動方向[7]。由于輕便、無線和便于操作等特性,其已被成功應用于足球、游泳、高山滑雪、跑步等項目的動作識別[8-11]。然而,在競技比賽中,實驗控制條件的受限以及禁止在體表粘貼標記點和佩戴傳感器的要求提示上述動作捕捉技術存在劣勢[12]。

近年來,基于計算機視覺的無標記動作捕捉技術使得復雜環境下的人體動作識別(human activity recognition)成為可能。通過攝像設備進行無標記動作捕捉,遠程獲取比賽中的運動學信息,依托計算機視覺的機器學習(machine learning)算法,將檢測到的人體活動表示為與特定動作相對應的波信號特征并提取到計算機終端,進而同步完成視頻的自動分析、信息的自動提取以及快速反饋[13-17]。基于計算機視覺圖像的動作分析首先需要預測或估計目標在圖像序列中的位置和方向,通過識別連續圖像中具有相同或相近特征的目標,進而實現對位移參數的實時追蹤和獲取[18]。在當前實際應用中,通常將人體結構簡化為由無摩擦的轉動關節連接而成的一系列剛體,便于機器的識別與追蹤[19],然而事實上人體運動十分復雜,并且由于肌肉、肌腱等軟組織的存在,并不能以簡單的剛體模型進行描述。因此,精準跟蹤和量化動態的人體姿態成為當前計算機視覺、機器學習以及運動科學等領域專家所面臨的難點之一[20-22]。

此外,傳統的機器學習算法對原始運動學數據的處理能力有限,無法有效地對不連續、有噪聲以及存在缺失值的高維數據進行訓練[23-24],并且總是需要對原始數據進行預處理,包括卡爾曼濾波(Kalman Filter)、傅里葉快速變換(Fast Fourier Transform,FFT)以及包括主成分分析(Principal Component Analysis,PCA)和 向 量 編 碼 技 術(vector coding techniques)的降維等一系列步驟[23,25-28]。值得注意的是,與實驗室環境下的三維動作捕捉分析相比,基于比賽現場的計算機視覺運動分析系統魯棒性、準確性以及有效性的平衡依賴于算法的改良和硬件的優化[29]。近年來,結合深度學習(deep learning)算法進行人體姿態自動識別引起計算機視覺等領域專家學者的廣泛關注[30]。

深度學習是機器學習的一個重要分支,其特點是具有更深層次的神經網絡模型架構,其理念來源于人腦的生物神經網絡[31]。該算法大多使用人工標記的圖像數據來訓練神經網絡,隨后將圖像或視頻輸入經過訓練后的網絡,從而進行人體姿態、關節中心和骨骼位置的估計和識別[32]。與基于紅、綠、藍三原色(Red-Green-Blue,RGB)深度圖像的微軟Kinect攝像機相比,深度學習算法對攝像機與待測目標之間的距離及視頻記錄采樣頻率等約束較少[33-34]。當前,以深度學習為基礎的方法已實現從二維RGB圖像自動估計人體關節中心,并輸出圖像中的二維坐標[35]。同時,通過使用多臺攝像機聯動,同步多視角攝像機圖像中的人體二維關節位置,并結合深度學習算法能夠實現三維空間內對人體關節中心點和關鍵骨性標記點的定位[36]。基于人體三維姿態識別的深度學習計算機視覺研究正嘗試使用一種算法進行姿勢位置的估計和追蹤,并且已有研究[37-38]探索了基于單目攝像機的三維人體姿態識別。

基于上述研究現狀,本文通過系統回顧國內外基于計算機視覺的無標記動作捕捉技術,包括圖像識別技術、機器學習算法以及深度學習算法在運動動作識別領域的應用現狀,揭示無標記動作捕捉在運動檢測和特征動作識別領域的潛在應用,如可實現日常訓練比賽中運動員動作的無干擾識別與快速反饋,為教練員訓練決策提供參考。

1 研究方法

1.1 文獻檢索策略

為確保納入文獻的全面性,本文的文獻篩選過程依據系統評價和meta分析的PRISMA(Preferred Reporting Items for Systematic Reviews and Meta-Analysis)聲明[39],對Web of Science、PubMed、Scopus、Google Scholar、IEEE Xplore、中國知網(CNKI)6個數據庫進行文獻檢索。檢索時間為2000年1月1日—2020年6月30日。檢索中英文關鍵詞運用“AND/OR”布爾運算符進行組合連接。英文檢索詞包括:(Sports OR Exercise OR Movement OR Motion OR Athlete OR Player OR Match OR Competition OR Game OR Training)AND(Movement OR Motor OR Action OR Skill)AND(Vision OR Computer Vision OR Machine Vision OR Camera OR Video OR Footage OR Motion)AND(Capture OR Recognition OR Detection OR Classification)。中文檢索詞包括:(運動OR運動員OR球員OR比賽OR競賽OR訓練)AND(運動動作OR移動OR行動OR技能)AND(視覺OR計算機視覺OR機器視覺OR攝像機OR視頻OR鏡頭OR動作)AND(捕捉OR識別OR檢測OR分類)。依據以上檢索關鍵詞依次對文獻的標題、摘要進行篩選,隨后提取文獻全文進行評估。同時為避免遺漏,對檢索文獻的參考文獻進行二次溯源檢測。文獻檢索流程如圖1所示。

圖1 文獻檢索流程Figure 1 Flow diagram of the study selection process

1.2 納入/排除文獻標準

納入文獻標準:①研究文獻是公開發表的中文或英文論文;②研究聚焦具體的體育運動或動作,有計算機視覺輸入作為模型訓練數據庫;③機器學習算法,數據處理過程定義清晰;④動作識別過程為半自動或全自動化。排除文獻標準:①綜述類論文;②研究不涉及具體的運動動作,或與臨床或康復應用相關;③研究關注點為運動器材而非運動員本身;④數據處理過程和機器學習識別模型定義不明確。

1.3 研究信息篩選與提取

首先由2名作者分別對納入文獻的關鍵信息進行提取,使用Microsoft Excel 2016收集整理關鍵信息,不一致的信息由第3名作者綜合評估判斷。納入文獻關鍵信息包括第一作者、發表年份、運動類型/目標動作、樣本量、受試者性別、運動員等級、攝像機數量、攝像機規格、采集頻率、圖像特征提取技術、動作識別技術、動作識別質量評估方法、圖像數據訓練與驗證、動作識別精度表現14個指標。通過前期文獻研究結果,發現受試者即采集對象的年齡對機器學習模型的識別精度幾乎無影響,因此未將受試者年齡因素納入考慮范圍。動作識別技術包括將視頻數據集轉換為便于識別的預處理過程,以及將目標運動或動作進行分割的處理階段(包括特征識別和提取技術,以及所采用的機器學習算法等)。

2 研究結果

2.1 文獻篩選結果

本文共檢索到研究文獻1 387篇,其中,通過Web of Science、PubMed、Scopus、Google Scholar、IEEE Xplore 5個英文數據庫檢索獲得文獻1 362篇,通過中國知網(CNKI)中文數據庫檢索獲得文獻25篇。統一導入文獻管理軟件Mendeley(2020)去重后得到1 046篇文獻,由2名作者通過關鍵詞、標題、摘要、全文進行獨立審查,結合前文制定的納入與排除標準進一步篩選剔除,最終納入23篇文獻,如圖1所示。

2.2 納入文獻實驗設計

本文納入研究文獻均為基于計算機視覺的無標記動作捕捉技術,結合機器(深度)學習算法對多種運動項目及相關動作進行的識別和應用。在納入的23篇文獻中,涉及網球運動的有3項[40-42]、籃球運動的有3項[43-45]、體操運動的有2項[46-47]、拳擊運動的有2項[48-49]、冰球運動的有2項[50-51]、高爾夫運動的有1項[52]、足球運動的有1項[53]、跳水運動的有1項[54]、排球運動的有1項[55]、空手道運動的有1項[56],1項研究同時包含游泳和網球運動[57],1項研究同時包含高爾夫和棒球運動[58],1項研究涉及步行、反向跳、擲球等基礎動作[12],1項研究同時包含自行車和單板滑雪運動[59],1項研究涉及多種競技運動組合,其數據集包含110萬個經過標記的視頻以及400余種不同的運動動作[60]。納入研究多以職業運動員為研究對象(n=17),有16項研究報告了選取的運動員性別,其中14項研究[12,42-45,47-50,52-53,56,58-59]的受試者僅為男性,1項研究[46]的受試者為女性,1項研究[41]同時包含男性和女性受試者。目前,無標記動作捕捉前處理環節較為主流的方法是針對目標運動特征進行分類處理,例如將網球運動分類為發球、正手擊球和反手擊球3類[40-42],將游泳運動按照泳姿分為蛙泳、仰泳、蝶泳和自由泳4類[57,61]。基于深度學習算法的語義描述模型,能夠實現對運動員訓練動作、技術水平及疲勞程度的分類和預測,例如對體操鞍馬旋轉動作的分類等[47]。

2.3 計算機視覺圖像獲取途徑

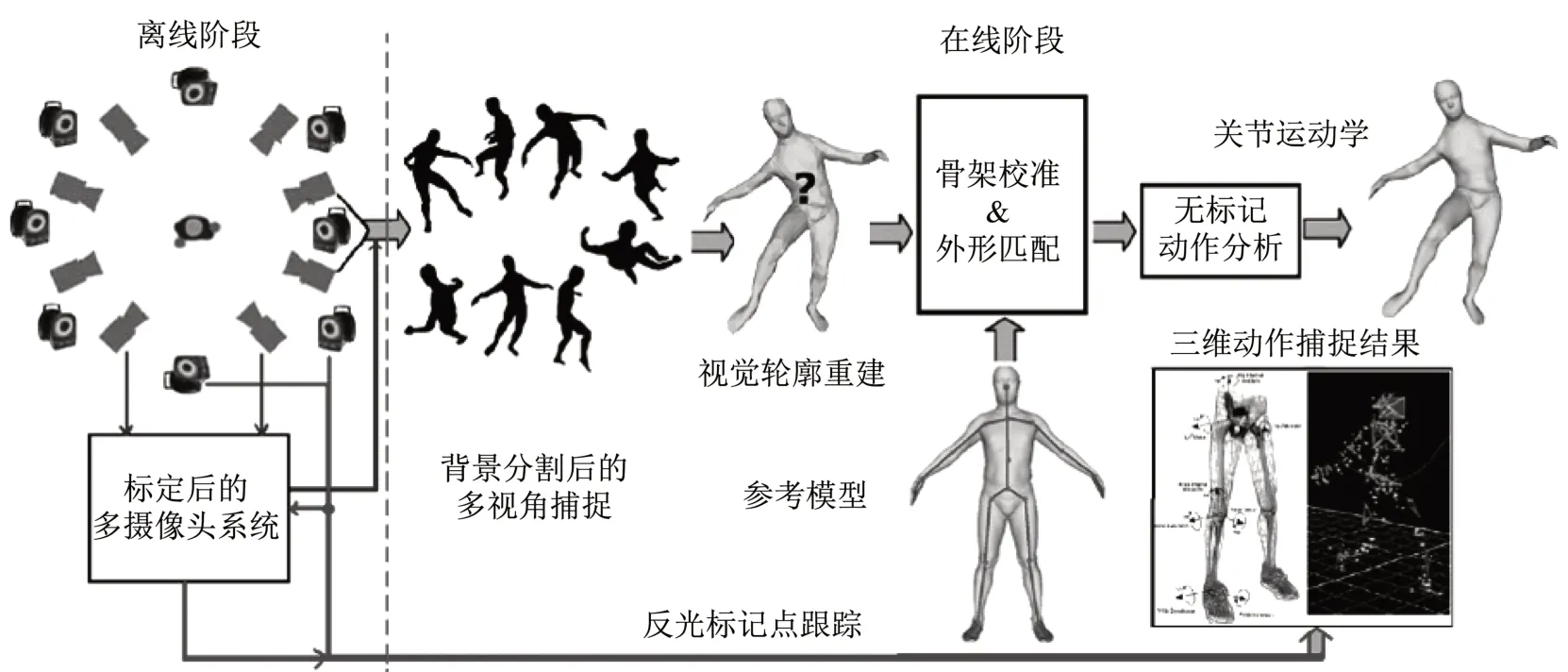

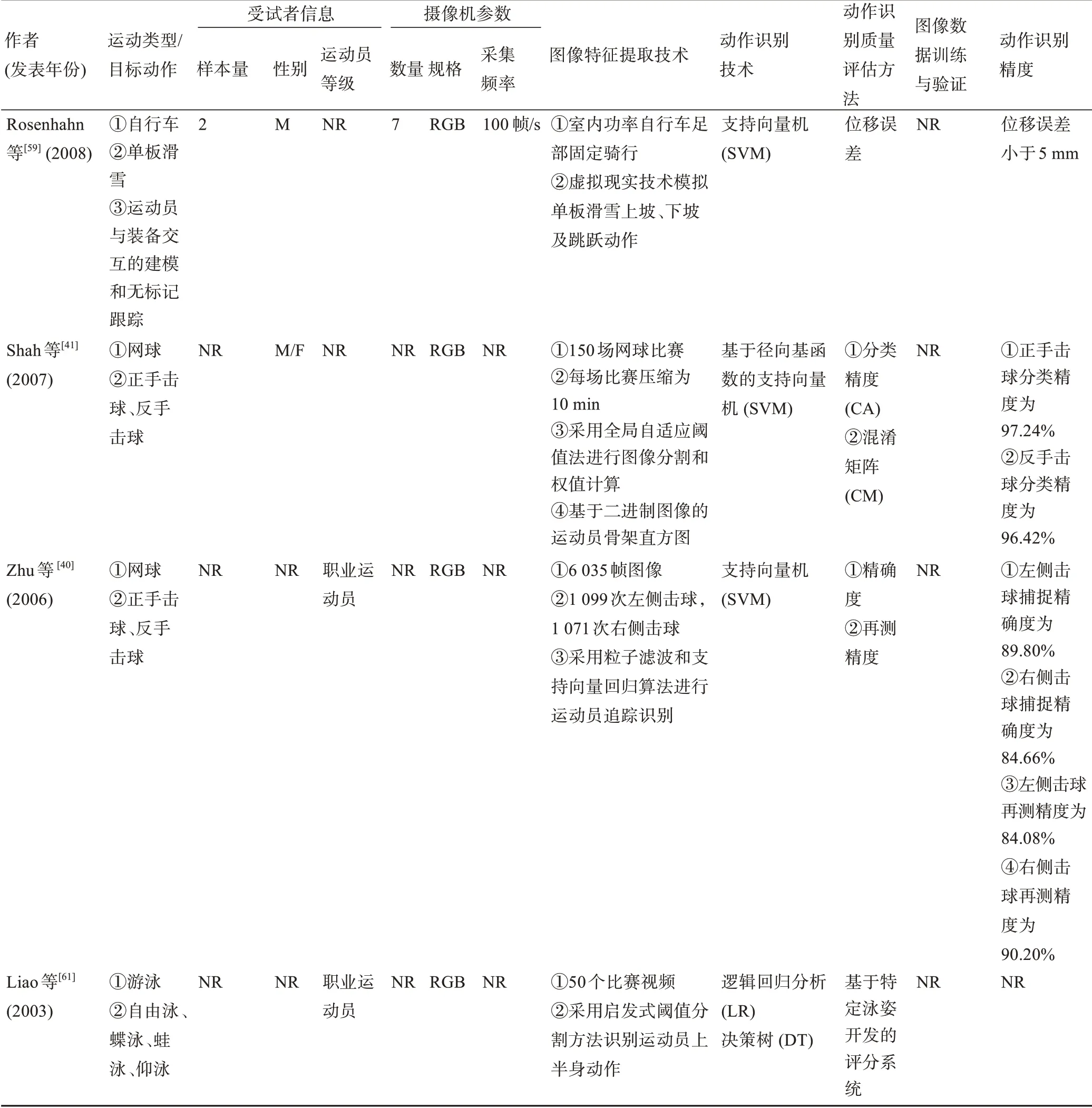

本文選取的23項研究包含了多種不同的實驗設計及計算機視覺圖像獲取方式,如表1所示。傳統的基于反光標記追蹤的紅外三維動作捕捉與基于計算機視覺的無標記動作捕捉流程如圖2所示。有16項研究[12,40-44,46,50,52-54,56-59,61]的計算機視覺圖像采集依靠主流的RGB攝像機進行,3項研究[47-49]采用深度攝像頭對競技運動場的三維圖像進行深度感知和獲取,此外還有4項研究[45,51,55,60]的攝像頭類型未給出。從攝像頭數量以及設置的角度看,10項研究[43-44,46-49,52,54,56,58]采用單目鏡頭完成全部圖像的采集和獲取,其中3項使用深度攝像頭的研究[47-49]均使用單目鏡頭。1項研究[53]采用了16個環繞足球場的RGB攝像頭,以“鳥瞰(bird'seyeview)”視角對全場運動圖像進行采集。此外,共有11項研究[12,43,46,48-49,52-53,56-59]報道了攝像機的采集頻率,從25幀/s到210幀/s不等。O′Conaire等[42]使用1個俯視鏡頭及8個圍繞網球場邊線的鏡頭對運動員的發球、正手擊球和反手擊球動作進行識別,但由于障礙遮擋等因素,僅有2個攝像頭捕捉的圖像可用于最終的動作識別分析。

圖2 無標記計算機視覺輪廓動作捕捉與反光標記紅外三維動作捕捉流程[62]Figure2 Themarkerlesscomputer vision motion captureand themarker-based infrared three-dimensional motion capture

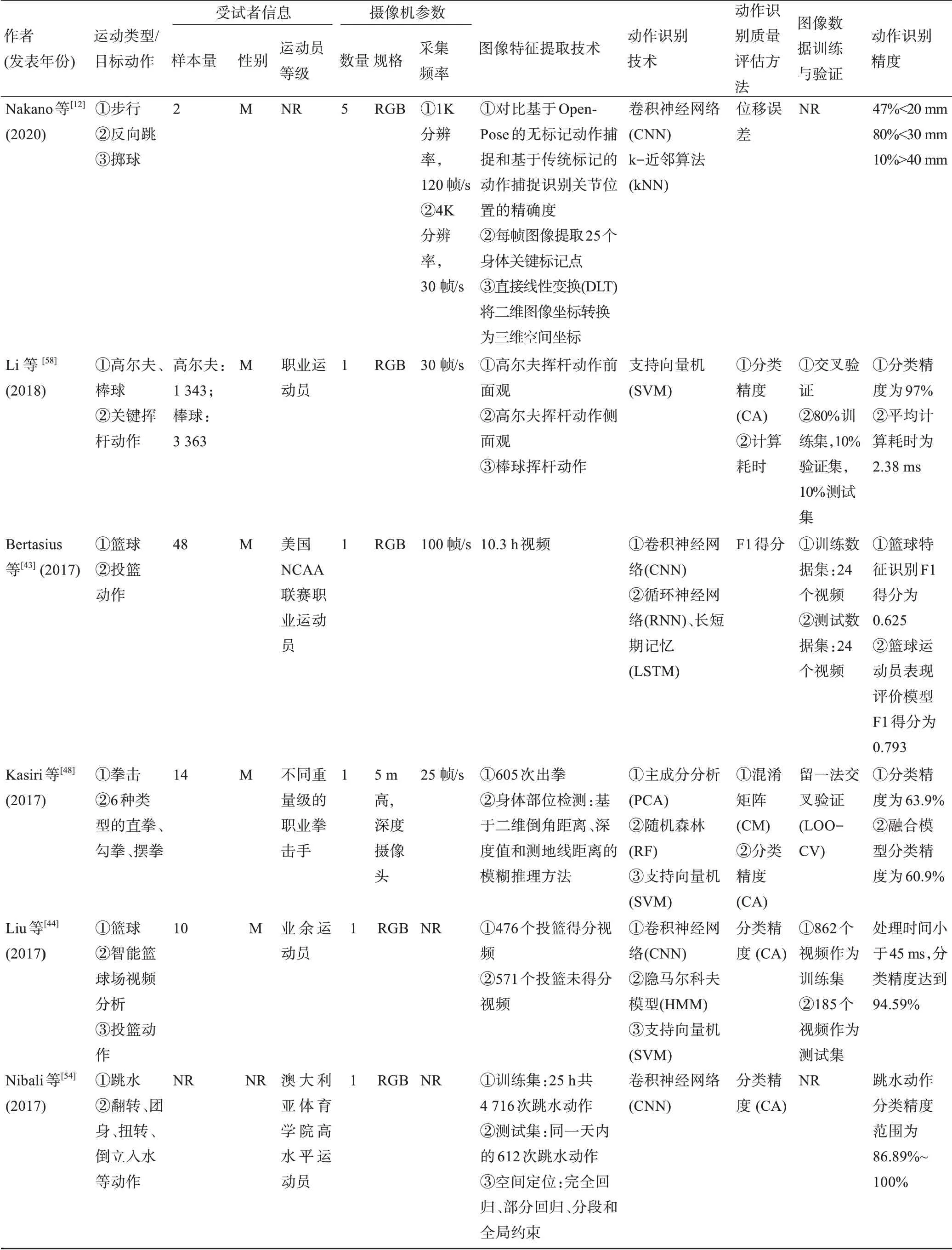

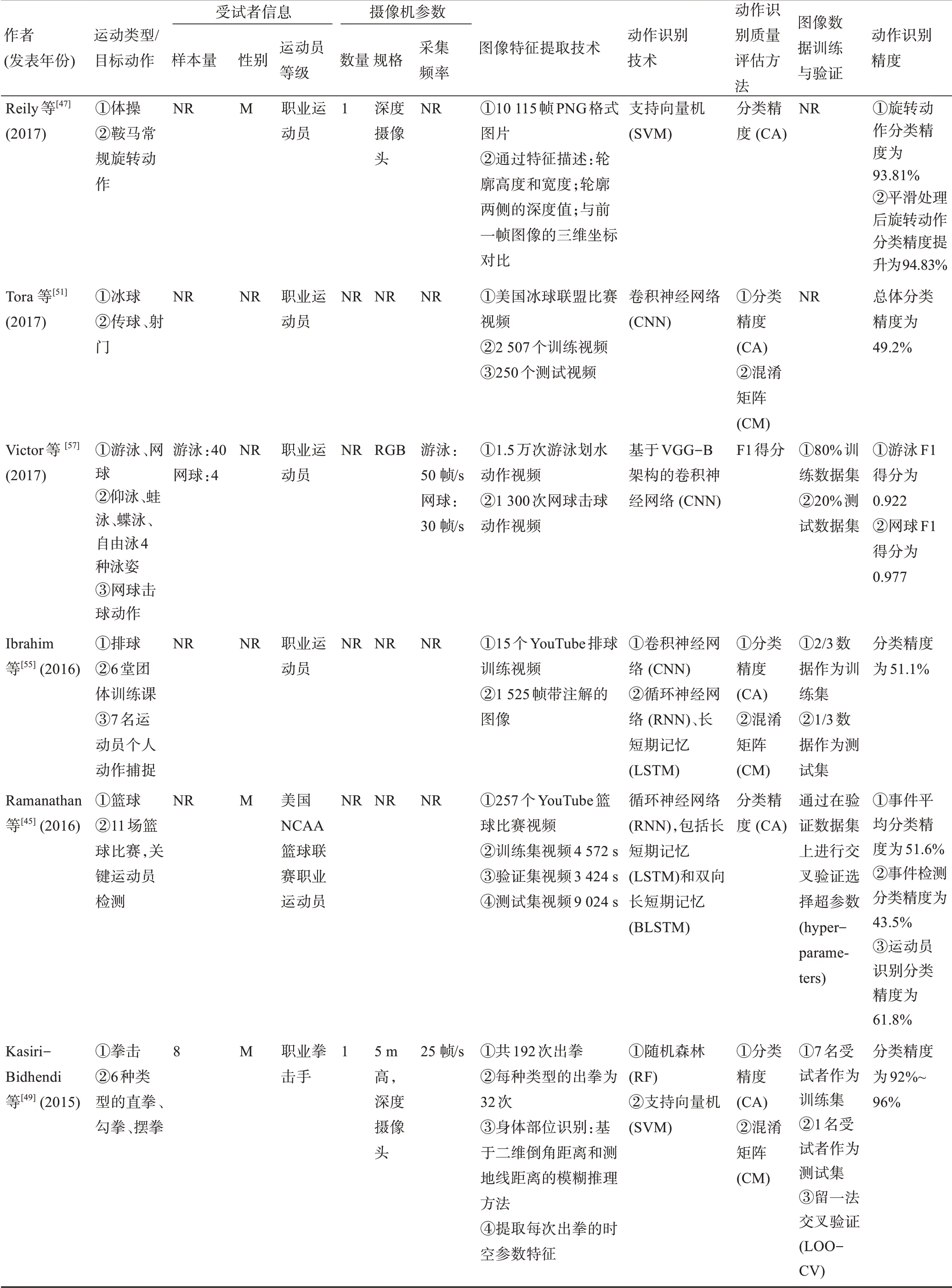

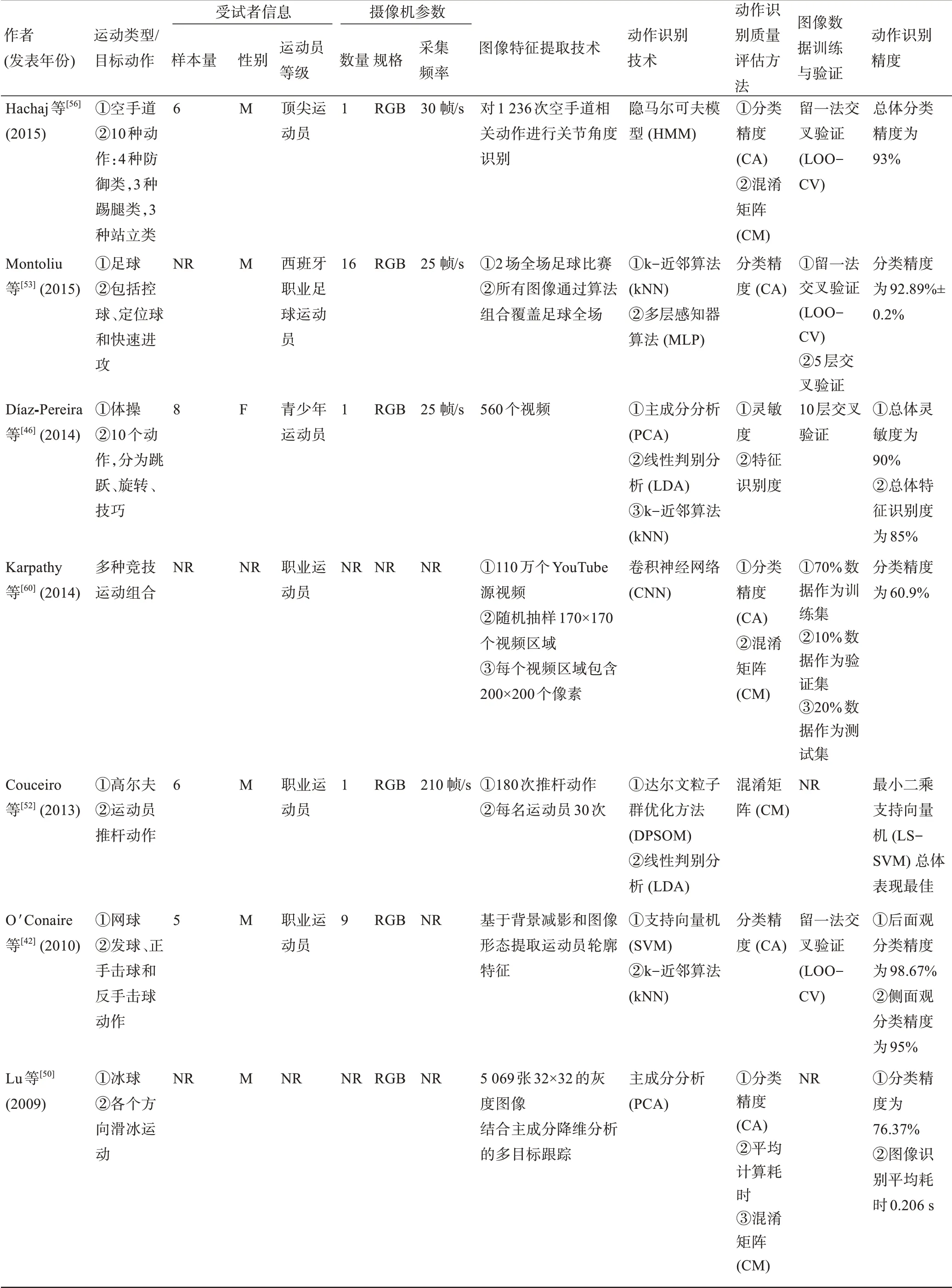

表1 基于計算機視覺的無標記動作捕捉相關研究關鍵信息提取(N=23)Table 1 Extraction of key information related to studies on vision-based markerless motion capture studies(N=23)

續表1

續表1

續表1

2.4 圖像特征提取與動作識別技術

基于機器學習和深度學習算法的計算機視覺捕捉圖像特征提取是本文涉及的23項研究采用的主流方法,主要體現在二維圖像的轉換以及輸入圖像數據的分割等處理步驟。納入研究均報道了圖像特征提取采用的關鍵算法和技術,其中單純使用機器學習算法的研究[40-42,46-50,52-53,56,58-59,61]有14項,僅借助深度學習算法的研究[43,45,51,54-55,57,60]有7項,同時結合機器學習和深度學習算法的研究[12,44]有2項。

納入文獻中共有9項研究[40-42,44,47-49,58-59]采用支持向量機(Support Vector Machine,SVM)相關算法,其中:2006—2008、2012、2015、2018年各1項,2017年3項,共占所有研究的39%;2009、2013、2014、2017年共有4項研究[46,48,50,52]采用基于機器學習的降維算法,其中包括主成分分析和線性判別分析(Linear Discriminant Analysis,LDA);2010、2014、2015、2019年共有4項研究[12,42,46,53]采 用k-近 鄰 算 法(k-Nearest Neighbour,kNN);2015和2017年共有2項研究[44,56]采用隱馬爾科夫模型(Hidden Markov Model,HMM)相關算法,另有2項研究[48-49]采用隨機森林(Random Forest,RF)算法;2003年有2項研究,其中1項采用邏輯回歸分析算法(Logistic Regression,LR)相關算法[61],另外1項采用決策樹(Decision Tree,DT)算法[61];2015年有1項研究[53]采用多層感知(Multilayer Perceptron,MLP)算法,2013年有1項研究[52]采用達爾文粒子群優化方法(Darwinian Particle Swarm Optimization Method,DPSOM)。在所有使用深度學習相關算法的研究中,采用卷積神經網絡(Convolutional Neural Network,CNN)相關算法的研究[12,43-44,51,54-55,57,60]有8項,其中僅2017年就有5項,另外3項研究分別發表于2014、2016、2019年;此外,2015、2016、2017年有3項研究[43,45,55]采 用 了 循 環 神 經 網 絡(Recurrent Neural Network,RNN)相關算法。

2.5 動作識別質量評估與精度表現

如表1所示,基于計算機視覺的動作識別質量評估方法大部分采用定量評估,其中采用分類精度方法(Classification Accuracy,CA)進 行 評 估 的 研究[41-42,44-45,47-51,53,55-56,58,60]有14項,占所有研究的65%。從識別精度表現角度評估,分類精度值越接近100%,說明動作識別精度越高。納入研究的分類精度范圍為49.2%~100%,其中分類精度值范圍小于80%的研究[45,48,50-51,55,60]有6項,分類精度值范圍在90%~100%的研究[41-42,44,47,49,53,56,58]有8項,有1項研究[54]的分類精度值范圍在80%~100%。采用混淆矩陣(Confusion Matrix,CM)對模型動作識別結果進行可視化的研究[41,48-52,55-56,60]有9項。有2項研究[43,57]采用F1得分來判斷動作識別算法的精確度,研究的目標運動為籃球,以及游泳和網球。2項研究[12,59]采用位移誤差評估識別精度,其中:1項研究的動作識別位移誤差小于5 mm;另1項研究基于OpenPose開源人體姿態估計算法的無標記動作捕捉,80%的位移誤差在30 mm以下,但有10%的位移誤差在40 mm以上,識別精度較為局限。

3 討論

隨著計算機技術、圖像識別處理技術以及人工智能等相關算法的發展進步,全自動、實時、無標記的動作捕捉應是未來運動科學領域進行動作識別和動作技術分析的主流方式。相比于傳統的實驗室運動學測量分析,無標記動作捕捉技術的優勢[15]:一方面能夠擺脫場地等限制因素,降低測試前準備工作量;另一方面能夠大大提升動作捕捉的效率,做到實時反饋甚至超前預判,為教練員的訓練決策和運動員場上動作技術改進提供依據。目前,基于計算機視覺的無標記動作捕捉在競技體育和運動科學領域的應用較少,相關識別技術、算法有待進一步開發,同時系統的魯棒性、準確性、靈敏性也需要進一步驗證。傳統的基于紅外攝像機的三維動作捕捉系統僅需要識別粘貼在受試者體表骨性標志的反光點,隨后基于追蹤的標記點三維坐標構建人體骨架模型。然而,在無標記動作捕捉領域,就需要借助相關的機器學習算法識別人體動作,構建人體運動學模型,完成連續圖像中的運動學參數獲取[17]。基于計算機視覺的無標記動作捕捉系統主要由4個組成部分:①攝像機系統;②人體圖像識別模型構建;③圖像特征提取;④機器學習識別算法的應用。在以上4個部分中,圖像參數的捕捉和獲取是離線(off-line)處理部分,圖像特征提取、識別模型構建以及算法應用是在線(on-line)處理部分,機器學習識別算法的優化通常需要大量的圖像數據訓練以提升識別效果。下文結合計算機視覺無標記動作捕捉系統的4個組成部分以及動作捕捉精度進行具體分析,并提出當前無標記動作捕捉技術的局限性和未來研究方向。

3.1 運動圖像捕捉及模型構建

本文納入的研究多數采用單目RGB攝像機配置。與多個攝像機相比,單個攝像機輸出的數據可以最大限度地減少需要處理的數據量,降低計算工作量。然而,由于遮擋和視角變化,單攝像機在細節特征捕捉以及多個體參與的團隊競賽中存在局限性,但多攝像機配置會增加處理時間和模型計算的復雜程度[63]。因此,需要對計算量和運動捕捉的精度進行有效平衡,使攝像頭的放置位置和數量適應運動目標的生物力學特征及捕捉環境。本文納入的研究大多是基于運動現場的實時動作捕捉,即需要快速反饋,因此使用便攜式的單目RGB攝像頭易于在動態環境中捕捉運動圖像,節省校準和標定耗時。當前,用于圖像捕捉的攝像機主要包含2種類型:①傳統的識別圖像顏色、亮度等特征的RGB攝像機;②能夠識別圖像中每個像素點到攝像頭距離的深度攝像機[64]。相比于傳統攝像機,深度攝像機受光線、陰影、反射和復雜背景的影響較小。可以同時獲取圖像顏色和深度值的RGB-D傳感相機系統通過光線傳輸時間(Time of Fight,ToF)技術,采用紅外線作為光源,記錄光源強度信息以及光線從光源到圖像中像素點的時間,能夠對人體全身的三維姿態進行有效估計。目前該技術已應用在微軟Kinect人機交互系統,能夠感知三維環境中的人體姿態[65]。當前已有研究比較基于ToF技術的深度相機和基于反光標記的動作捕捉系統識別人體下蹲動作的運動學參數,但需要注意的是,深度相機較低的采集頻率(通常為30幀/s以下)和對自然光線高度的敏感性以及多深度傳感器之間的干擾可能會限制其在運動科學中的應用[64]。

無標記動作捕捉建立的人體模型與基于反光標記三維動作捕捉建立的人體骨架模型類似,均是由骨骼以及相鄰骨骼組成的關節構成,通常采用骨骼長度、關節相對位移以及關節角度等指標量化模型特征[66]。基于無標記動作捕捉的人體模型構建通常需要識別圖像中人體的輪廓和體積特征,再通過進一步的算法提取人體模型中的關節運動軌跡等運動學參數[67]。早期研究通常采用簡化的圓柱幾何形狀近似表示人體模型的輪廓和體積特征,該模型以人體骨架為基礎,在已知四肢長度和人體姿態的前提下,可以通過空間三維高斯函數(Spatial 3D Gaussians)排列簡化的立體幾何形態,將體積參數賦予骨架模型,從而生成人體模型輪廓[68]。這種識別模型仍然有其應用的場景,原因是該模型僅需要提取相對簡單的圖像特征,實現對人體位置快速和近實時擬合,但缺點是擬合精度有限,難以在精確定量的運動分析中應用[69]。目前,三維統計形狀模型(3D Statistical Shape Model)方法已被應用于人體建模,該方法通過識別圖像中的關鍵點,結合形狀對齊、相似變換(similarity transformation)、主成分分析降維處理等操作步驟,使用數量較少的二維參數擬合圖像中的人體形態[70-71]。但由于統計形狀模型方法聚焦的重點是人體模型的表層形態,對模型底層的骨架結構能否實現精確模擬還需要進一步驗證。現階段基于計算機視覺的無標記動作捕捉大多構建的是簡化后的人體參數模型,識別的有效性和準確度在很大程度上取決于識別算法的質量[72-73]。

3.2 基于計算機視覺的圖像特征

數字圖像由二維數字網格排列而成,其中每個網格中的數字代表該網格的顏色與亮度,即像素。確定像素與物體之間的關系是計算機視覺的一項根本任務,如何提取圖像中的人體運動特征是實現無標記動作捕捉的核心環節和技術難點,而基于標記點的動作捕捉不存在圖像特征提取和識別的問題[74]。無標記動作捕捉的首要任務是確定圖像的范圍和捕捉目標的位置。傳統的捕捉目標提取和圖像背景分割通常采用色度差分法,該方法將圖像背景預涂為特定顏色,要求被捕捉目標使用色差較大的對比色,即可將目標輪廓從圖像中快速分割出來[63]。對于圖像背景復雜,無法使用色度差分法的情況,則可以使用背景減除算法,但該方法較容易受到陰影、反射、遮擋、光線變化以及捕捉目標之間的相互影響。圖像輪廓的模糊為特征識別增加了難度,僅通過輪廓特征無法提供被觀察對象與攝像機的距離參數、相對位置以及朝向等信息,可以通過增加攝像機數量,使用更為復雜的圖像輪廓特征識別算法降低處理過程的模糊性[75]。

在攝像機數量充足的前提下,可以通過不同角度的圖像輪廓擬合,實現捕捉目標的三維形態轉換,獲得圖像輪廓視覺外殼(visual hull)[76]。該方法對多臺攝像機的觀察目標進行三維輪廓重建,基于不同方向角度捕捉到的二維圖像,結合每臺攝像機捕捉的視錐區域交點,形成三維的圖像輪廓視覺外殼[75]。捕捉目標三維建模精確度和復雜程度的提升會導致運算時長和算法復雜程度增加。需要注意的是,圖像輪廓的三維重建不能解決所有的圖像擬合問題,還需要結合額外的信息輸入以識別圖像輪廓的位置與身體各環節的對應關系[29]。捕捉目標的輪廓識別是無標記動作捕捉的重要組成部分,Liu等[77]基于1臺RGB攝像機對籃球投籃動作進行圖像輪廓解析,相較于基于標記點的動作捕捉,圖像分類精度達到了94.59%,實現了較為精確的圖像輪廓識別,并且可進行多目標跟蹤。使用圖像輪廓識別技術可以提高魯棒性,降低識別目標模糊程度,減少攝像機的使用數量并簡化無標記動作捕捉流程。隨著深度學習算法的應用,圖像識別過程將得到進一步簡化,使用單機位進行被捕捉目標的三維動作識別成為可能[78]。

3.3 基于機器學習的識別算法

用于識別圖像中人體姿態的機器學習算法可以分為生成式算法(generative algorithm)和判別式算法(discriminativealgorithm),統稱為監督式學習[79]。監督式學習算法在基于計算機視覺的無標記動作識別領域占主導地位,訓練數據集的生成首先需要對視頻進行手動標記和注釋等前處理過程,如果是由多攝像機跟蹤的多目標運動,前處理難度會顯著增加。例如,Victor等[57]對高達15 000個游泳和網球視頻進行了手動標記,耗時較長,工作量較大。生成式算法對基于訓練數據的學習進行預測,模型參數可以根據圖像數據生成假設,隨后對該假設進行評估,通過進一步的迭代優化,從而確定最佳的預測匹配[80-81]。生成式算法包括樸素貝葉斯算法(naive Bayes)、隱馬爾可夫算法、k-近鄰算法等[82]。判別式算法直接使用圖像數據推斷模型參數,避免了反復調整人體模型參數適應圖像的過程,因此也被稱為無模型算法。與生成式算法相比,判別式算法處理時間較短,對異常值判別的魯棒性更高。常用的判別式算法包括邏輯回歸、支持向量機、決策樹、線性判別分析、神經網絡(Neural Network,NN)等[83]。

在基于生成式算法的無標記動作識別中,人體的姿勢形態是通過將人體模型與從圖像中提取的信息進行匹配確定的。例如,對于一組給定的模型參數(身體形狀、骨骼長度、關節角度等),首先可以生成對應的模型預測參數,隨后將預測參數與圖像提取特征進行比較,從而計算單個“誤差值”,該“誤差值”可以表示假設值與觀測值的差異程度[84]。有研究[75,85]將預測得到的三維網格投影到二維圖像中,調整網格與捕捉目標輪廓重疊程度最大化,通過迭代最近點算法(Iterative Closest Point,ICP)可以實現圖像視覺外殼與捕捉目標各頂點的匹配度對比。生成式算法的關鍵是對算法函數的準確定義,從而將特定假設與圖像信息進行比對,如果算法函數失準,則無法實現最優模型參數的匹配,導致運動約束降低和出現異常值的概率增加[86]。構建針對較高圖像噪聲和較低模型配置的高魯棒性算法函數較為困難,一方面由于生成式算法需要對模型參數進行合理可靠的初始推測,另一方面被捕捉目標需要在開始階段以特定的姿勢進行初始標定[87]。在沒有人為干預的情況下,由于遮擋、圖像噪聲或其他因素導致的精度下降,算法函數是無法進行自我糾正和還原的。前期已有研究[88]嘗試改進相關算法函數,或通過結合生成式算法和判別式算法來解決這一難點。當前,無標記動作識別主要通過機器學習算法實現,但該文納入的9項研究采用了深度學習算法,其中基于卷積神經網絡(CNN)算法的總體計算用時最短,在相同硬件條件下的計算量更少,因此被其中的8項研究所采用。作為判別式算法的主要組成部分,深度學習將隨著硬件設施的提升、數據量的擴大而得到越來越多的應用[31,89]。

3.4 無標記動作捕捉精度

無標記動作捕捉的精度表現可以通過可視化的模型預測結果與真實測量結果之間的比較進行量化,其中分類精度是最常使用的量化方法,其次是混淆矩陣。上述方法能夠較為清晰地呈現模型預測結果與實測結果之間的差異,從而呈現模型預測精度。后續測量包括模型靈敏度、精確度和再測精度,測量結果越接近1.0表明模型預測精度越高,效果越好[17]。F1得分(F1-Score)也稱F測量,是推導模型預測精度和靈敏度之間平衡性能的重要指標,可以對人體運動識別表現進行深入分析。具體的模型精度預測方法和算法的使用需要根據數據類型,傳統的誤差率或錯誤率統計方法一般使用默認的決策閾值,因此并不適用基于復雜的訓練數據集開發的模型[90-91]。分類模型評估方法還包括接收者操作特征曲線(Receiver Operating Characteristic Curve,ROC),曲線下的包絡面積是ROC的重要特征,面積越接近1表示模型識別能力越強[92]。每種研究方法都有其特定的參數設置、特征向量和模型訓練算法,因此,評估不同研究方法的合理性和有效性是較為復雜的。Wolpert[93]在1996年提出的“無免費午餐定理(No-Free-Lunch theorems)”,即NFL定理是機器學習及搜索優化算法的重要理論基石,該定理指出,不存在單一的或通用的機器學習算法去解決和優化所有的識別問題。因此,建議針對某一特定問題和數據集采用組合方法,輸入任務的先驗假設(prior assumption)來適應模型輸入和相關參數,以提高模型預測的整體成功率[94]。

本文納入的大多數研究是基于運動場的實時無標記動作捕捉和運動員特定動作參數獲取的,包括執行動作的數量、類型和強度等特征統計,可以應用于運動負荷監控、運動員個性化動作技術分析、自動化打分評估系統開發和團體球類運動的傳球投籃動作質量評估等領域[47,95]。對于足球、橄欖球等室外運動,由于動作本身的復雜性和環境干擾,個體化模型的一致性和跟蹤精度是當前面臨的主要挑戰。例如,足球射門和傳球動作的分類精度在封閉的實驗室環境要高于室外足球場環境[96]。攝像機擺放位置和視頻分辨率對無標記動作捕捉精度同樣有較大影響。Corazza等[75]使用高分辨率攝像機并調整攝像機位置后,關節中心點位移誤差從調整前的(79±12)mm降低至(15±10)mm。現有研究[45,51,55]顯示,基于計算機視覺的深度學習算法在籃球、排球和冰球等團體球類項目中具有較為穩定的捕捉精度表現,預測模型的計算效率、結果精度和復雜程度之間的平衡也是需要考慮的重要因素。

3.5 研究局限與未來展望

在本文納入的23項研究中,由于選取的模型參數和評估方法等差異,研究之間異質性較大,無法進行定量的薈萃分析。納入研究的動作識別技術限定在機器學習以及深度學習算法領域,未考慮其他算法,例如線性判別函數分析等。此外,運動項目的不同以及運動場地大小的差異也可能是影響技術選擇的重要因素,但由于納入文獻數量的限制及側重點不同,本文并未對其進行進一步歸納分析。無標記動作捕捉系統的精確度和魯棒性往往取決于研究領域和特定的采集環境,在不同領域的應用方式是不統一的。運動生物力學和康復醫學等領域要求無標記運動分析系統具有高度精確性和較強適應性以檢測運動過程中的細微變化[15]。基于上述部分應用場景對無標記動作捕捉系統的準確性和穩定性等方面需求,Elhayek等[78]提出將魯棒性較高的判別分析方法與無輪廓運動學模型擬合方法相融合,以提升精度表現。當前,跑步運動的無標記動作捕捉可以實現步長、步頻等時空參數的精確捕捉,并實現實時反饋[67]。三維關節角度等較為復雜的運動學參數需要對跟蹤對象進行建模和在線捕捉采集,隨后進行一定時間的離線處理,較難實現實時反饋。上述無標記動作捕捉過程,不需要對受試者、環境等進行特殊準備和標定等前處理,實現了訓練實踐和運動科學研究的同步,快速實時的反饋為教練員訓練方案選取和運動員動作技術優化提供依據。但是,攝像機分辨率和捕捉精度需求的提升將導致視頻存儲和參數處理工作量大大增加,因此需要進行有效平衡,增加無標記動作捕捉的可操作性和實用價值。

4 結論與啟示

(1)本文對機器學習、深度學習和相關算法技術在基于計算機視覺的無標記動作捕捉系統中的應用研究進行歸納綜述,在動作技術識別和運動表現分析等領域,計算機視覺動作捕捉和相關模型、算法開發等已顯示出良好的應用前景。其中支持向量機、主成分降維分析等傳統機器學習算法仍是目前采用的主流動作識別技術。但隨著卷積神經網絡和循環神經網絡等深度學習算法的開發與應用,在部分場景下的動作捕捉和識別效果要優于傳統的機器學習方法。

(2)計算機視覺識別裝置,包括常規的RGB攝像機和深度攝像機,其位置的擺放和設置、鏡頭分辨率、識別算法的選取以及數據存儲處理等過程需要結合具體的運動場景(室內/室外/規模)、捕捉對象(單人/多人)和目標運動特點。室外運動和多目標運動項目容易受到捕捉環境、設備儀器和識別算法等的限制,因此,目前要實現對運動員動作的精確捕捉和實時反饋仍具有一定的挑戰性。

(3)未來研究可以針對特定運動動作識別和運動表現評估,將傳統的機器學習算法與深度學習識別算法進行對比,從而為動作識別技術和相關算法的選取與融合應用提供依據。計算機視覺圖像可以與可穿戴無線慣性傳感等裝置配合使用,實現運動過程的多參數聯合采集,提升無標記動作識別的效果、效率和魯棒性。

作者貢獻聲明:

孫 冬:設計論文框架,撰寫論文;

宋 楊:搜索資料,修改論文;

岑炫震:核實數據,修改論文;

盛 博:核實數據,修改論文;

顧耀東:設計選題,指導并修改論文。