多層特征融合及興趣區域的花卉圖像分類

楊旺功,淮永建,2

(1.北京林業大學 信息學院,北京 100083;2.國家林業和草原局林業智能信息處理工程技術研究中心,北京 100083)

基于機器學習的植物圖像分類方法克服了人工分類方法的局限性。傳統細粒度分類算法,采用尺度不變特征變換(scale invariant featuretrans form,SIFT)[1]或方向梯度直方圖(histogram of oriented gradient,HOG)[2]提取局部特征手段,利用局部聚集描述符向量(vector of locally aggregated descriptors,VLAD)[3]或Fisher vector[4]等編碼模型進行特征編碼。張娟等[5]按照紋理、形狀、顏色等手工特征對梅花進行分類,方法不具有通用性。Nilsback等[6]提出了基于花卉幾何形狀的自動分割算法。周偉等[7]提出了基于顯著圖的花卉分類算法,為避免分割的依賴關系,將顯著圖融入特征提取過程,融合顏色和尺度不變特征變換,并采用支持向量機(support vector machines,SVM)進行分類。主流細粒度分類方法基于卷積神經網絡[8-12]。本文提出了基于多層特征融合及興趣區域的花卉圖像分類方法。該方法基于VGG16[13]框架,提出基于興趣區域的特征強化算法,抑制無效信息區域,強化細微特征提取。融合多層網絡特征圖,采用全局平均池化取代全連接層[14]達到降維目的,從而防止過擬合。采用改進的損失函數pre_softmax完成分類任務,提高了訓練網絡的識別率。

1 圖像預處理

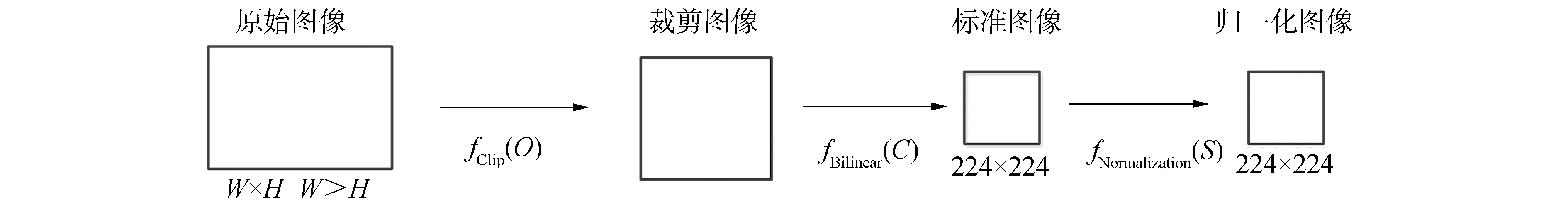

使用深度學習進行圖像分類任務時,要求輸入的圖像尺寸固定,采用圖像縮放的方法直接將圖像縮放至神經網絡可輸入的圖像尺寸。圖像的寬高不等,導致圖像不同程度的變形,有效形態特征信息被壓縮,從而引起圖像細節信息損失,影響圖像的分類結果。為了強化圖像有效信息,抑制邊界信息的干擾,提高神經網絡模型的泛化能力,本研究針對花卉的特性,設計的圖像預處理流程如圖1所示。

圖1 圖像預處理流程Fig.1 Process of image preprocessing

1.1 圖像剪切算法

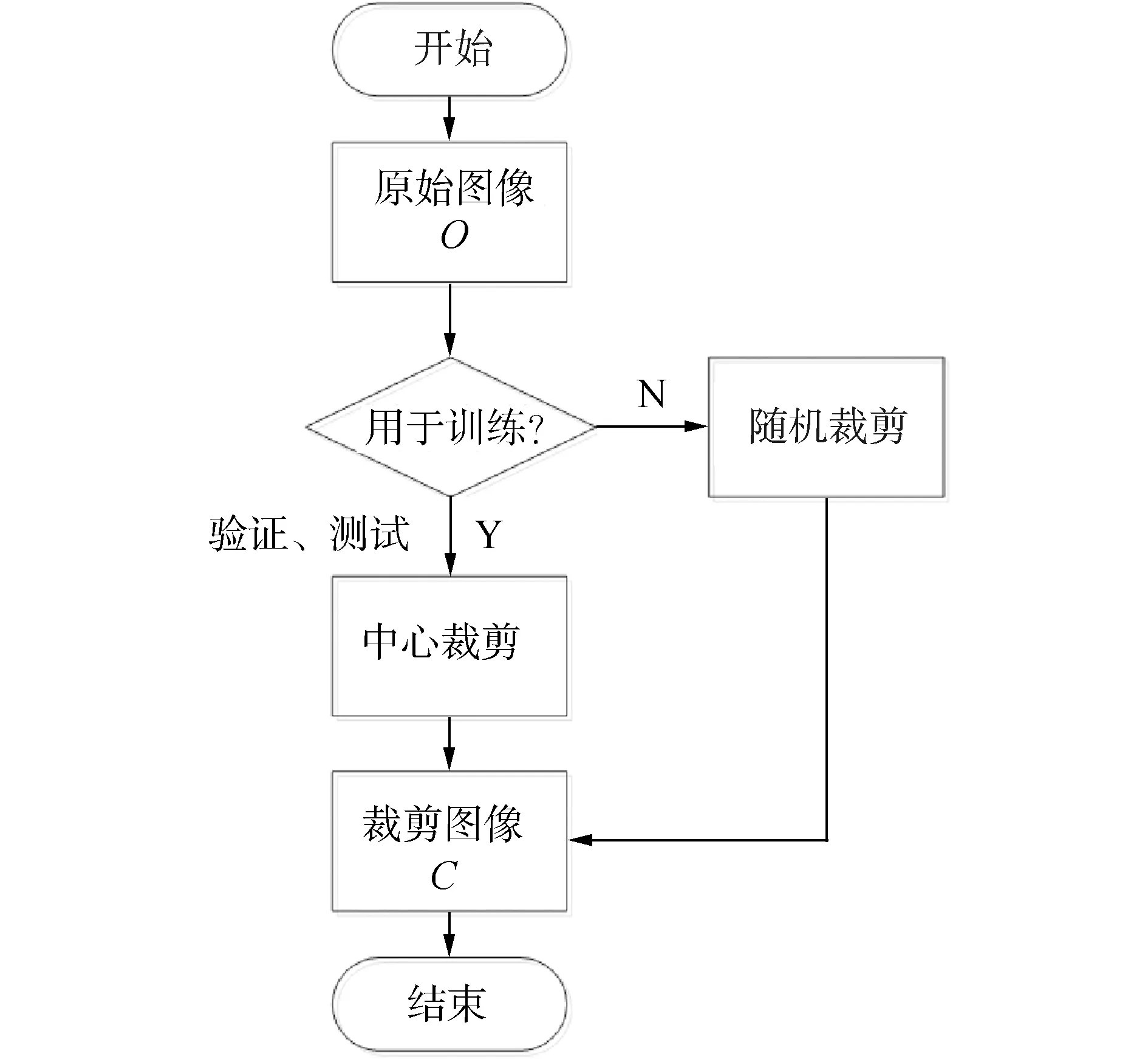

由于花卉數據集圖像的長寬并非全部相等,若采用非等比率縮放圖像,會導致圖像變形,導致識別目標的細粒度特征變形,從而影響模型的性能。若采用按最短邊截取的方法使用圖像,相對于模型訓練階段,自動拋棄未被截取的圖像信息,影響模型的泛化能力。在模型訓練階段,需要更有效的利用細粒度特征信息;在測試階段,需要準確截取圖像中具有細粒度特征的部分。本研究采用分而治之的策略,訓練階段采用隨機截取函數截取圖像;測試階段采用中心截取函數截取圖像。這樣在模型階段具有數據擴充的功能,在測試階段具有識別目標精準定位的作用。截取函數的關鍵算法如圖2所示。

圖2 圖像截取流程Fig.2 Flow chart of image clipping

中心剪切是在圖像的中心位置以原圖像寬、高的最短邊,截取正方形圖像。中心剪切可以獲取花卉圖像的主要信息,用于模型驗證和測試階段。

(1)

式中:函數box是對原圖O截取子圖,其4個參數分別表示子圖左邊界距原圖左邊界的距離、子圖上邊界距原圖上邊界的距離、子圖右邊界距原圖左邊界的距離、子圖下邊界距原圖上邊界的距離。

隨機剪切是在圖像區域范圍內,按正態隨機概率分布的形式,截取以原圖像短邊長度為邊長的正方形圖像。隨機剪切可以有效豐富圖像信息,提升訓練模型的泛化能力,其數學表示為:

(2)

式中:frandom(x)表示可產生[0,x]隨機數的隨機函數。具有識別度的有用信息通常位于圖像中間,背景及無用信息位于圖像邊沿。為了強化圖像中間的有用信息,抑制原始圖像中的邊緣背景信息和噪聲信息,frandom(x)采用符合正態分布概率的隨機生成函數。

1.2 插值及圖像歸一化

深度學習的圖像預處理常采用圖像縮放的方法。圖像縮放過程中需要使用使用插值算法來確定坐標像素值。常用的插值算法有最近鄰插值、雙線性插值、雙立方插值、Lanczos插值算法等。相比較而言,最近鄰插值算法效率最高,效果最差;雙立方插值和Lanczos插值算法的效果較好,但比較耗時。雙線性插值算法是性能和效果介于中間的算法。本研究從性能和效果上綜合考慮,采用雙線性插值縮小圖像。圖像歸一化處理可使得神經網絡最優解的尋優過程更加平穩,更容易收斂于最優解。圖像歸一化處理最常用的是最大最小值歸一化[15]方法。計算過程是將原像素值[0,255]進行線性變換,使結果落到[0,1]:

(3)

式中xi表示圖像像素值。

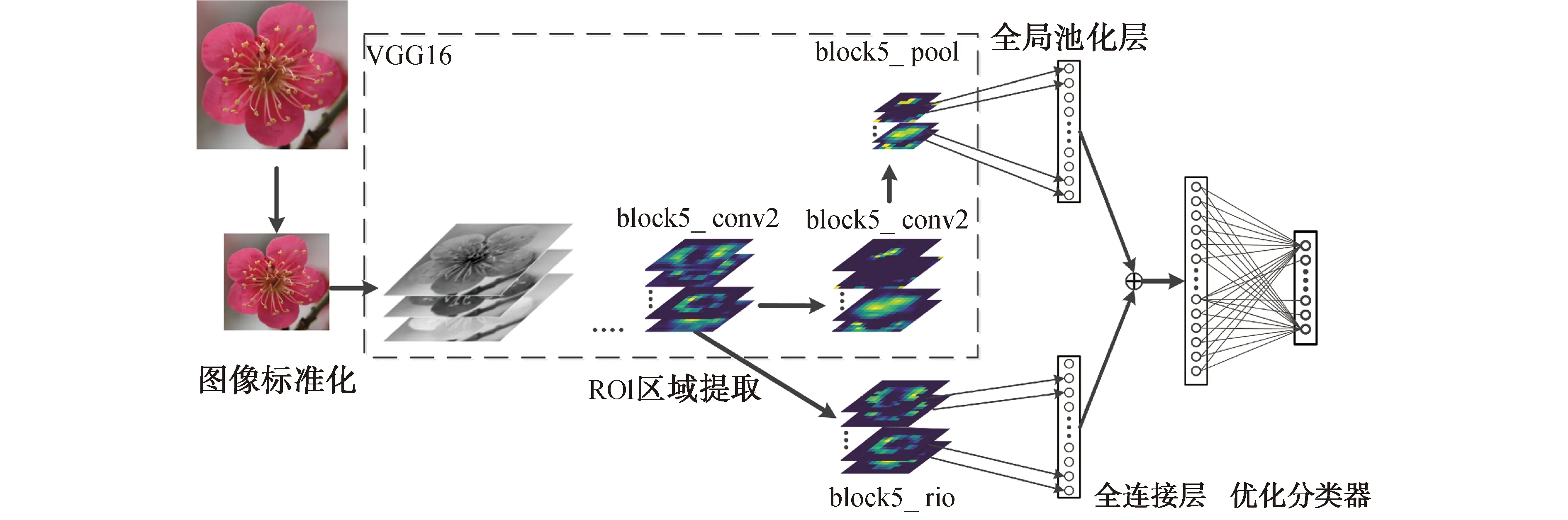

2 基于多特征融合的分類方法

基于多層特征融合的花卉細粒度圖像分類是基于VGG16的結構,增加了block5_rio和GAP層。block5_rio層是對block5_conv2特征圖的判別性區域的提取和強化。block5_rio與block5_conv2維度保持一致。通過全局平均池化的方法對block5_pool和block5_rio降維,并將二者融合拼接成新的張量,再使用1 024個節點的全連接層,通過opt_softmax損失函數分類。基于多層特征融合及興趣區域的花卉細粒度圖像分類系統結構如圖3所示。

圖3 多層特征融合網絡總結構Fig.3 General structure of multi-layer feature fusion network

2.1 特征圖分析

卷積神經網絡由多個卷積層和池化層構成。每個卷積層包含若干個卷積核,經由這些卷積核進行從左到右,上從往下進行卷積運算,得到的數據稱為特征圖。卷積神經網絡的特征提取過程保持著圖像的空間結構,即特征圖與原始圖像在空間上保持對應關系。

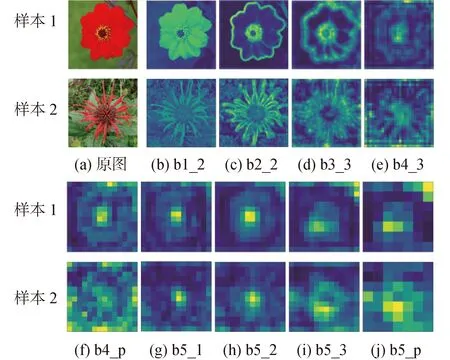

池化層是對卷積層的特征圖以某種方式進行壓縮,縮小特征圖的維度、降低網絡復雜度,使得神經網絡具有更高的魯棒性,防止過擬合現象。池化層是仿照人的視覺系統處理信息的抽象過程,降低特征維度,并夠保留顯著信息,從而增加了卷積核的感受野。池化層的特征圖與上一層的卷積層特征圖的抽象信息保持一致,如圖4所示,block5_pool與block5_conv3特征圖的信息保持一致。

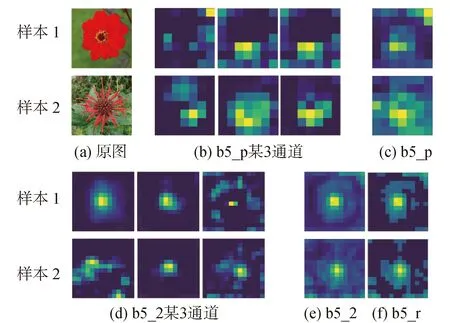

為了更好理解卷積神經網絡的特征提取的特點,本文通過可視化的方法對不同的卷積層和池化層的特征圖進行可視化。圖4是VGG16的部分卷積層和池化層的特征圖疊加可視化效果。

圖4分析可知,隨著網絡層數的增加,特征圖的分辨率越小,對圖像的抽象能力越高。淺層特征提取的是紋理、細節特征;而深層特征提取的是輪廓,形狀,更顯著的特征。相比較而言,淺層特征包含的細節信息更多,也具有一定類別區分的能力;深層特征具有判別性,具有明確的分類的能力。以深層特征的分類能力為基礎,輔以淺層網絡的細節特征,有利于提高分類任務的準確率。

注:b2_2表示block2_conv2卷積層,b5_p表示block5_pool池化層。圖4 VGG16網絡層特征圖可視化Fig.4 Visualization of feature maps in VGG16 network layers

2.2 興趣區域提取

訓練神經網絡的過程就是訓練卷積核參數的過程,是圖像特征不斷提取的過程。神經網絡越優秀,卷積核的特征提取能力越強。通過神經網絡提取出的特征越重要,其連接權重越大,表現為強激活區域。圖5是本文所設計的多層特征融合網絡特征圖的部分強激活區域可視化。

注:b5_2表示block2_conv2卷積層,b5_p表示block5_pool池化層,b5_r表示block5_roi自定義層,其他簡稱類似。圖5 block5_conv2和block5_pool部分通道、及高響應區域特征圖可視化Fig.5 Visualization of partial channel and feature maps of block5_conv2,block5_pool and high response area

相較于池化層block5_pool,其他層特征圖的抽象性較低,為了提升其他層信息表達能力,本文設計了興趣區域層,用于強化關鍵特征。block5_roi層是對block5_conv2特征的提取,并對特征圖的強化,抑制背景及噪聲干擾,具有提取關鍵特征的能力。此法可充分融合多層的不同特征,提升網絡性能。block5_roi的特征圖大小是14×14×512,與block5_conv2保持一致。

為了盡最大可能提取關鍵區域特征,強化block5_conv2和block5_pool層特征融合效果,將在block5_conv2的特征圖中提取興趣區域。block5_conv2的輸入為Iinput:

Iinput=Finput(x,y,z),1≤x,y≤W,1≤z≤c

(4)

式中:Finput為c表示特征圖的通道數。輸出定義為Ioutput:

Ioutput=Iinput·Imask

(5)

式中:·表示逐位相乘;特征圖的長、寬及通道數保持不變;Imask表示矩陣蒙版,用于截取興趣區域。

所有通道疊加的平均值稱為特征圖疊加平均圖,記作Istack。與特征圖相比,長寬保持不變,通道壓縮為1,可表示為:

(6)

Istack特征圖疊加平均圖的所有像素點的平均數為:

(7)

Imask矩陣蒙版的切片,即單層蒙版可記作Islice為:

Islice=Fslice(x,y) 1≤x,

(8)

Imask矩陣蒙版與蒙版切片Islice的關系為:

Imask=Fmask(x,y,z),1≤x,y≤W;

1≤z≤C=Islice(x,y,z),1≤z≤C

(9)

式中Imask是Islice堆疊C次張量,其張量的形狀為(W,W,C)。

2.3 全局平均池化及優化損失函數

用傳統全連接層連接特征圖層,會產生龐大的參數,不可避免導致過擬合現象。GAP層將特征圖的每一個通道與GAP層的點相對應,從而賦予通道的意義[14]。因此,在特征圖之后,使用GAP代替全連接層,可以將特征圖與分類的關系更加清晰,還能大幅降低參數,防止網絡過擬合。

softmax函數是logistic函數的擴展。logistic函數只能處理二分問題,softmax可以處理多分類任務,其輸出是每一個類的概率值。每一個樣本對應的k個概率估計值為式:

(10)

神經網絡的訓練過程是損失函數尋找最優解的過程,使得損失函數達到最小值。softmax損失函數為:

(11)

在神經網絡輸出層選用softmax分類函數,其采用交叉熵作為損失函數。由于其計算分類的結果非0即1,必然會引起過擬合,而實踐中又無法設置閾值。為了防止過擬合,本文提出了聯合樣本均勻分布的交叉熵損失方法。樣本均勻分布的交叉熵損失Lmean為:

(12)

式中:m表示訓練樣本的數量;xi∈Rd表示第i個訓練樣本;yi表示xi的標記。聯合樣本交叉熵損失與均勻分布交叉熵損失作為總損失:

L=(1-λ)S+λmean

(13)

式中:LS表示softmax 損失;Lmean表示均勻分布的交叉熵損失;λ表示用于平衡2個損失函數的系數,本文中λ取值為0.1。

3 花卉圖像分類實驗及分析

本研究采用Oxford Flowers 102數據集[6]和Plum Flowers 17。后者是為研究梅花細粒度分類所采集梅花圖像數據集,包含17個梅花品種。

本研究的實驗電腦配置為PC Intel(R) Core(TM) i7-6700 CPU@3.40 GHz的CPU、8 GB的Nvidia Geforce GTX 1070 GPU和16 GB的運行內存。所有的程序均是由Python語言編寫并調用CUDA、Cudnn、OPENCV庫并在Windows10系統下運行。

為了保持實驗評價標準的統一性,將數據集分為訓練集、驗證集和測試集按70∶15∶15隨機劃分。訓練時所有模型的優化器采用Adam,批樣本數量設置為64,并且都設定了學習率10-3,學習率衰減10-9,每次訓練50輪。防止過擬合,實驗采用EarlyStopping方法記錄到目前為止最好的驗證集精度,當連續10次Epoch沒達到最佳精度時,則可停止訓練。

3.1 數據增強效用評價

為了消除其他因素影響,本實驗使用block5_pool層提取的特征,采用VGG的標準降維方法Flatten,連接有1 024個點的全連接層,輸出層的激勵函數采用softmax。

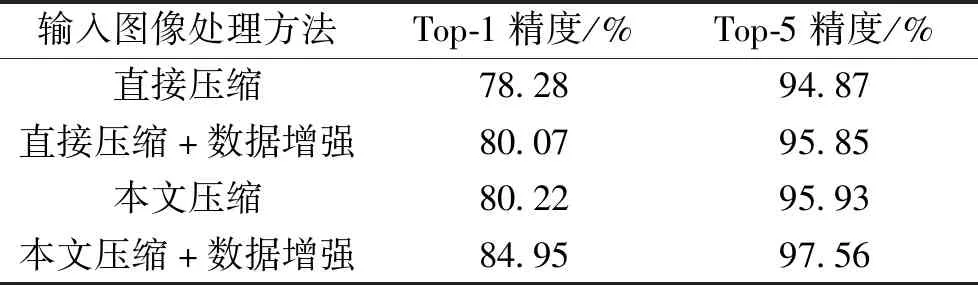

圖像輸入給神經網絡之前,需要對其進行尺寸歸一化操作。傳統方法是將圖像直接壓縮為輸入圖像尺寸,為了防止訓練的過擬合,會采用數據增強技術。實驗的數據增強方法采用水平翻轉圖像、圖像歸一化處理等操作。為了預防直接壓縮而引起的細粒度信息的丟失,本文提出了一種圖像預處理方法,防止破壞圖像的細粒度特征。為了比較直接壓縮、本文圖像處理及數據增強的影響,本階段設計4個子實驗,分別是直接壓縮、直接壓縮+數據增強、本文圖像處理、本文圖像處理+數據增強。在Oxford flowers 102上的數據增強效果評估實驗結果如表1所示。

表1 本文壓縮方法及數據增強對準確率的影響Table 1 Impact of compression method and data augmentation on accuracy

由表1可以看出,比較Top-1的結果,以直接壓縮的方法作為基準,本文圖像處理方法對于分類準確率提升明顯。本文圖像處理+數據增強的分類精度最好,Top-1是84.95%。

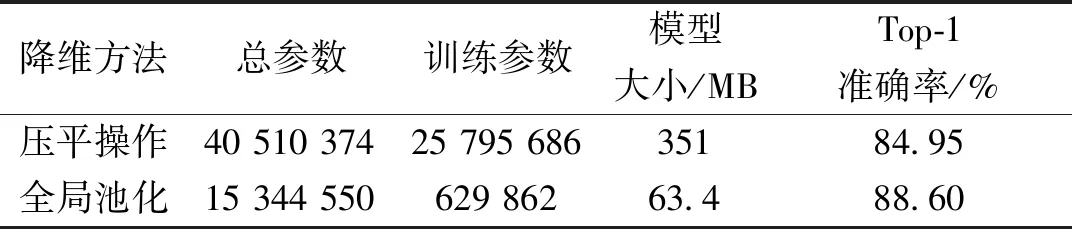

3.2 全局池化層效用評估

全連接層致命的弱點是參數量過大,尤其是與最后1個卷積層相連的全連接層。全連接層增加網絡訓練和測試的計算量,并且由于參數量大,容易引起過擬合。為了比較壓平操作和全局池化的差異,本階段設計2個子實驗,在Oxford flowers 102的實驗結果如表2所示。

表2 壓平操作與全局池化比較實驗Table 2 Comparison experiments of GAP and Fllaten

本實驗使用block5_pool層提取特征,降維方法分別使用壓平操作和全局池化,連接有1 024個點的全連接層,輸出層的激勵函數采用softmax。

如表2所示,采用壓平操作方法的訓練參數是25 795 686,全局池化的可以訓練參數只有629 862,不可訓練參數相同,都是14 714 688。由于壓平操作方法的訓練參數大,最終的模型文件大小為351 MB,遠遠超過全局池化方法的模型大小63.4 MB,并且在識別率上,全局池化的識別率明顯高于壓平操作。實驗表明,全局池化取代與最后一個卷積層相連接的全連接層,有效地解決參數過大引起的過擬合問題。

3.3 特征融合評估實驗

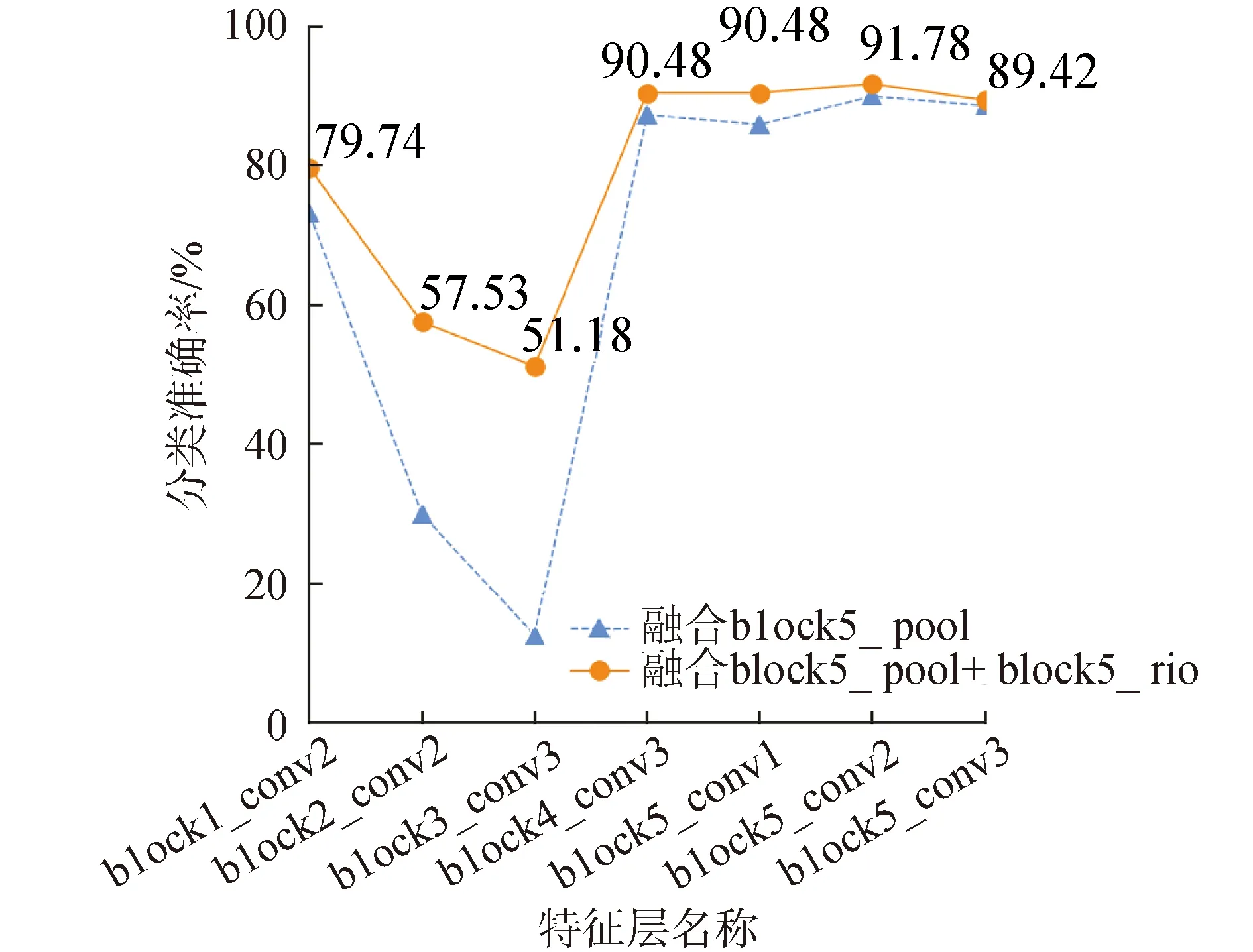

不計最后3層的全連接層,VGG16包含16層。整體結構上包含5組卷積層,卷積層之后連一個最大池化層,池化層的特征圖是對上一池化層的壓縮,特征信息保持一致。訓練神經網絡的過程就是訓練卷積核參數的過程,是圖像特征不斷抽象的過程。為了提升分類準確率,多層特征融合時,對特征圖的選擇尤為關鍵。隨著網絡層數的增加,特征圖的分辨率越小,對圖像的抽象能力越高,block5_pool必不可少。淺層特征提取的是紋理、細節特征,block5_pool特征的基礎上融合其他層的特征提升了效果,需要通過實驗驗證。本實驗分別采取5組卷積層的最后一層卷積層與block5_pool融合訓練。由于高層的抽象能力強,識別率高,還開展了block5_conv1、block5_conv2與block5_pool融合的實驗。圖6是VGG16多層特征融合在Oxford flowers 102上的實驗結果。

圖6 VGG16 block5_pool與其他層特征融合實驗Fig.6 Multi-layer feature fusion experiment of VGG16

本實驗使用block5_pool層融合其他層的特征圖,采用GAP降維,然后連接有1 024個點的全連接層,輸出層的激勵函數采用softmax。

圖6可見,添加了block5_rio層的融合效果較佳,并且block1_conv2、block2_conv2、block3_conv3與block5_pool的融合嚴重影響基準識別率,不及單獨使用block5_pool的識別率88.60%。block4_conv3、block5_conv1、block5_conv3與block5_pool的融合都能夠提升圖像的分類準確率。在此基礎上添加了block5_rio,block5_conv2+block5_pool的融合效果最理想,分類準確率達91.78%。

3.4 優化損失函數評估實驗

為了提升分類效果,提出聯合均勻分布的交叉熵損失函數。為了對比優化函數的有效性,開展了softmax損失函數與本文優化損失函數的比較實驗。

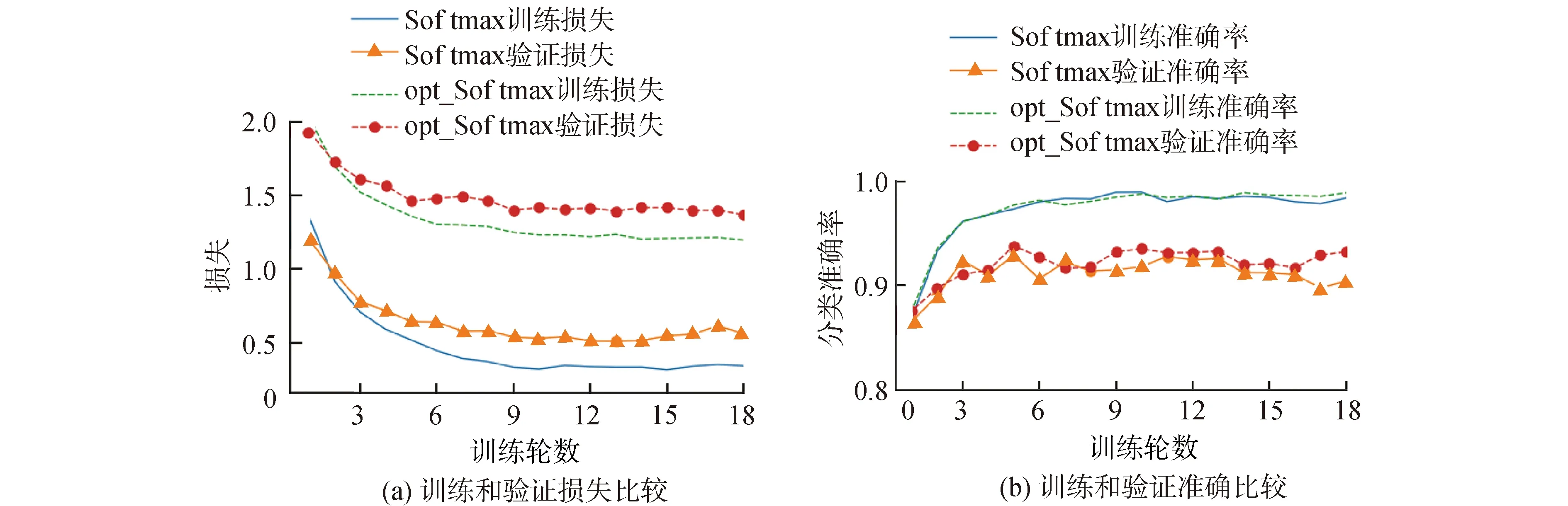

實驗使用block5_conv2、block5_pool特征圖,并分別使用GAP降維,將降維后的2個張量融合,然后連接有1 024個點的全連接層,輸出層的激勵函數分別采用softmax和opt_softmax方法。聯合交叉熵損失函數在Oxford flowers 102上的實驗結果如圖7所示。

圖7 優化損失函數比較實驗Fig.7 Comparative experiment of optimized Loss Function

本文提出聯合均勻分布的交叉熵損失函數opt_softmax可以緩解傳統采用交叉熵損失函數softmax過于自信而導致的過擬合問題,測試準確率從91.78%提升到93.57%,表現良好。

未經過融合的VGG16分類精度只有80.07%。其他研究的分類準確率分別為72.80%[6]、79.10%[15]和84.02%[16]。借助本文提出的圖像預處理方法、多層特征融合、及損失函數優化都提升了花卉圖像的細粒度分類精度,達到93.57%。

3.5 梅花品種分類實驗

上述實驗已證明本文提出的多層特征融合細粒度分類方法的有效性。最后將該方法應用于梅花品種數據集Plum Flowers 17進行實驗。VGG16的實驗采用數據增強,使用Fllaten連接block5_pool,和softmax分類器進行實驗。本文采用block5_pool和block5_conv2多層特征融合細粒度分類方法,結構如圖3所示。

VGG16和本文方法在梅花數據集上的分類準率分別為71.22%和85.47%。實驗結果表明,本文提出的基于多層特征融合的分類方法,不僅適用于標準花卉數據集,還適應于梅花數據集,對分類性能提升明顯,因此該方法針對小規模花卉分類具有參考價值。

4 結論

1)本文提出的圖像預處理方法,能夠防止直接壓縮圖像引起的破壞圖像細粒度特征,有利于神經網絡提高分類準確率。

2)多層特征融合方法充分融合淺層特征包含的細節信息,深層特征包含的抽象信息,對分類準確率提升有益。

3)全局池化層替代Flatten層方法降低特征圖的維度,使特征圖與分類的關系更加清晰,還大幅降低參數,防止網絡過擬合。

4)聯合均勻分布的交叉熵損失函數可以緩解傳統交叉熵損失函數過于自信而導致的過擬合問題。