基于深度神經網絡的行為識別算法

汪洋

摘要:在計算機視覺領域中,行為識別是重點研究問題。而隨著大規模行為數據的收集以及計算機水平的提升,深度神經網絡得到了長足發展,計算機視覺性能超越了以往,但是當前方法也存在一些局限。本文就深度神經網絡中的行為識別算法展開研究,首先闡述了行為識別現狀,其次分布分析了RGB視頻行為識別和人體骨架3D行為識別。

關鍵詞:深度神經網絡;行為識別算法;集成學習

中圖分類號:TP393? ? ? 文獻標識碼:A

文章編號:1009-3044(2021)03-0017-02

隨著科技的發展,日常生活中的行為會被攝像頭記錄下來,大量視頻網站紛紛涌現。近年來,隨著智能手機的普及,人們會將日常生活中所拍攝的視頻發送到網上,這些視頻為計算機技術帶來了新的發展機遇。而在密集場所中,攝像設備安裝數量也越來越多,其中記錄了大量視頻資料,包含各種人體行為。這些功能都需要行為識別算法才能夠實現,這對計算機視覺技術提出了更高的要求。

1 行為識別現狀

近年來,計算機視覺技術發展迅速,行為識別也得到了較大的發展,但是其中也存在一些問題亟待解決。當前,行為識別定義不夠確定,人體行為比較復雜,行為定義難度加大。同一行為在不同人的執行下,流程有所不同,導致時序提取特征呈現復雜性現象。而現有RGB視頻數據集都是人工截取形成的長視頻,不同人的截取不同,樣本市場也不同,且存在信息冗雜、執行主體不明等問題[1]。同時,不同角度攝像頭對同一行為的拍攝不同,會導致樣品出現較大差異,不同角度行為識別難度隨之增加。此外,針對復雜多人交互行為,樣本采集本身就比較困難,其還需要與人體分割結合起來,難度大大增加。

2 RGB視頻行為識別

人體行為分為時間和空間這兩個維度,基于此,本文基于深度神經網絡展開設計,以解決RGB視頻行為識別中的不足。以卷積神經網絡為空間特征提取器,設計的雙流長短時記憶模型,該模型如圖1所示。

2.1 特征提取

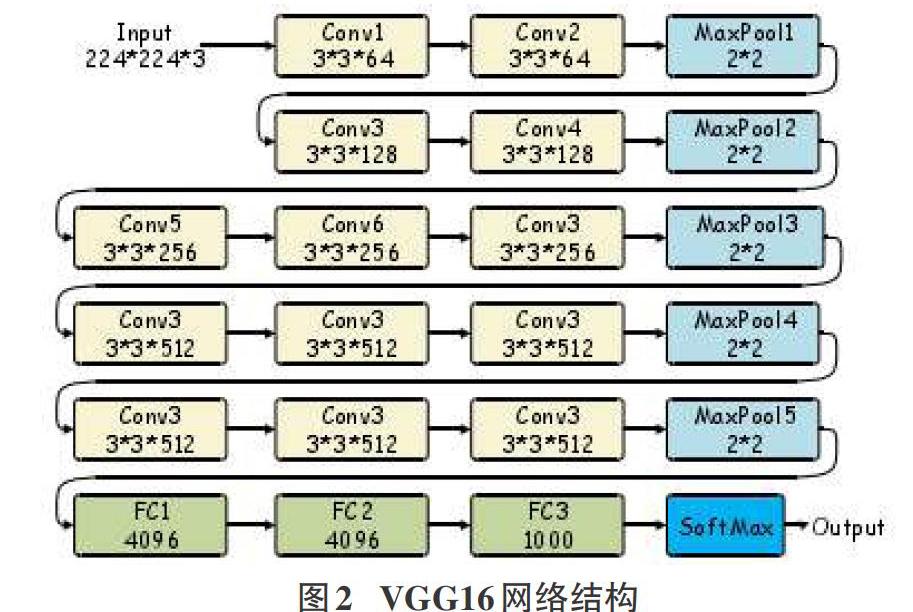

1) VGG16網絡。改為案例具有加強的空間特征提取力,其中蘊含13個卷積層以及3個全連接層,如圖2所示,其為網絡結構。從圖中可以發現,該網絡的卷積核為3*3系列,對比5*5系列,計算量明顯減少。而網絡層數增加也使得網絡特征空間持續擴大,但是通道數也在逐漸增加。卷積操作能夠提取空間臨近視頻信息,重復操作能夠得到高緯度空間特征[2]。

2) ResNet152網。ResNet實現殘差連接,解決反向傳播午安梯度回傳問題,且在3*3卷積堆疊、批次正則化等基礎上,網絡層超過100層,且訓練參數也有所減少。重復殘差連接能夠實現深度神經網絡[3]。

2.2 長短時記憶模型

1) 全連接長短時記憶模型。為解決循環神經網絡中時間間隔大、無法連接長時間間隔外信息問題。由此提出了長短時極易模型,其中包含了遺忘門、輸入門、輸出門這三個門。其中,遺忘門包括t時刻輸入以及t-1時刻隱含狀態,其決定了信息需要丟棄多少,影響更新[4]。

2) 卷積長短時記憶模型。該模型結構類似于上一模型,其是將部分全連接變為卷積操作,通過卷積完成學習權重,卷積操作能夠學習空間信息,長短時記憶模型能夠實現時序建模。在時序建模時就已經提取了空間特征。

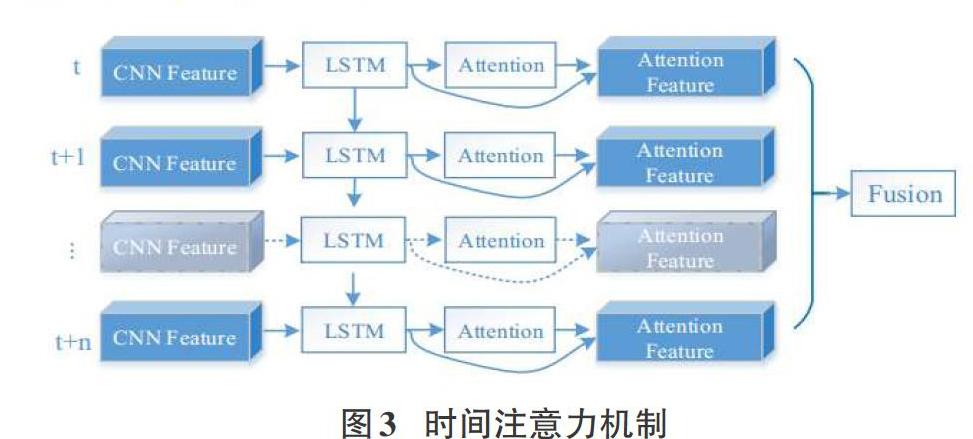

2.3 時間和時空注意力機制

1) 時間注意力機制。為識別行為,在全連接長短時記憶模型后設計時間注意力機制,其能夠針對模型不同時刻輸出評分,進而自動學習視頻幀。該機制中包括全連接層和SoftMax函數、∑函數[5]。訓練完成后,價值視頻幀可得高分,無價值視頻幀得分較低,最后,通過一系列計算后可得整個視頻輸出特征。該機制如圖3所示。

2) 時空注意力機制。卷積長短時記憶模型基礎上的注意力機制,其不僅能夠判斷幀,同時也能夠學習關鍵幀及其周邊區域。

2.4 聯合優化模型

注意力機制后可得兩種輸出特征,其代表了一個行為視頻樣本,內部特征較為相似。由此設計了聯合優化模塊,可以對特征向量進行訓練,并將視頻中的語義、時間和空間等特征充分挖掘出來。由LSTM網絡產生的特征向量的注意模型各不相同,具有明顯特征,且存在內在聯系。同時,利用同一分類器對兩個向量進行處理,進而得到其內在聯系。通過兩倍量特征數據所得的訓練更強,得到的識別效果也更好。

3人體骨架3D行為識別

3.1基網絡

基網絡包括Block1、Block2和Block3三個模塊,堆疊完成后,連接均值池化層和全連接層。一個基本一維卷積層內含一個一維卷積層以及批次歸一化層、修正線性激活單元激活函數、DropOut操作。如圖4。這種網絡無須大量數據就能夠實現較好的訓練質量,且結構擴展性也比較好,各層間也能夠實現任意添加,構成所需網絡模型。

3.2 雙流網絡

該網絡中包括基網絡和SoftMax層。SoftMax層會產生相應類別分數,彼此相互融合。基網絡用于特區時間和空間兩個維度上的特征。SoftMax層能夠產生相應類別概率矩陣,得分可以融合。矩陣中,元素表示網絡對表現置信水平,二者成正比。矩陣相應元素經過計算可得新矩陣,其中的元素差異比較大,也就是說,彼此置信水平會有較大差異,在于時間和空間判別信息結合后,可以提高網絡信息判定可靠性,且有著更好的識別效果[6]。

3.3 肢體分離網絡

日常生活的大部分行為都需要肢體運動才能完成,但是其中應用的肢體只是一部分,其他的肢體是處于靜止狀態的。這種行為就是微觀行為。基于此,本文設計了一種微觀特征提取網絡。人體包括五部分,在整個進入網絡前,可以分為五部分,之后分別將其數據融合到各自的基網絡中。根據數據微觀特征,神經網絡可以提取微觀運動特征。

3.4 注意力網絡

注意力機制包括全連接層和SoftMax層。全連接層需要激活函數,SoftMax層則需要針對每幀或每個特征通道評分,賦予關鍵幀或特征通道更高分,之后經過計算構成新特征。在基網絡卷積層和Block上附著注意力機制。

3.5 幀差網絡

本文設計了幀差網絡對行為相對運動特征進行提取。通過函數計算處理了原始樣本數據,可得新相對位置信息,其能夠將行為運動情況直接表達出來,幀差網絡包括基網絡和SoftMax層,在該網絡中,卷積核只能夠在時間維度進行滑動。

3.6 訓練測試

訓練時,本文的目標焊接就是交叉熵損失函數。在子網絡進行獨立訓練時,其中的SoftMax層可得相應的概率矩陣,測試時,本身針對四個概率矩陣設計兩種方法完成融合,這兩種方法分別為相乘和相加這兩種融合。

4 結束語

計算機視覺技術迅速發展使得人們對于視覺信息的理解更加深入,計算機就是通過收集人體行為數據,理解人體行為,擴大了應用范圍,提高了應用率。深度學習就是通過計算機強大的硬件條件及其所收集的大量樣本,使得計算機視覺和語言處理效果提高。

參考文獻:

[1] 齊琦,錢慧芳.基于融合3DCNN神經網絡的行為識別[J].電子測量技術,2019,42(22):140-144.

[2] 陳勝,朱國勝,祁小云,等.基于深度神經網絡的自定義用戶異常行為檢測[J].計算機科學,2019,46(S2):442-445,472.

[3] 張怡佳,茅耀斌.基于雙流卷積神經網絡的改進人體行為識別算法[J].計算機測量與控制,2018,26(8):266-269,274.

[4] 劉云,張堃,王傳旭.基于雙流卷積神經網絡的人體行為識別方法[J].計算機系統應用,2019,28(7):234-239.

[5] 關百勝,卞春江,馮水春,等.基于神經網絡的交互式異常行為識別研究[J].電子設計工程,2018,26(20):1-5.

[6] 石英,孫明軍,李之達,等.基于運動歷史圖像與卷積神經網絡的行為識別[J].湘潭大學學報(自然科學版),2019,41(2):109-117.

【通聯編輯:光文玲】