基于深度學習的DR胸片智能質控方法研究

王平,胡博奇,安東洪,劉蓄蕾,石張鎮,田中生,郝富德,劉景鑫

1. 吉林大學中日聯誼醫院 放射科,吉林 長春 130033;2. 遼寧萬象聯合醫療科技有限公司,遼寧 沈陽 110000

引言

影像學檢查是當今醫學檢查的重要組成部分,為臨床疾病診斷、癌癥的篩查、病灶的定位及定性、臨床治療方案的選擇、疾病的分期及預后等提供了重要依據。醫學影像診斷是指醫生通過非侵入性的方式取得內部組織影像數據,再以定量和定性的形式進行疾病診斷[1]。隨著X線攝影技術的發展與普及,越來越多的醫療機構引進了X線DR設備,且廣泛地應用于各個醫療機構的多種業務場景。X線胸片攝影是常規體檢的檢查項目之一。X線攝影的簡便、快捷、經濟、實用的優勢日漸突出,成為胸部疾病檢查的優先選擇。X線攝影利用人體各組織密度的不同,可觀察到密度和厚度差別較小的病變。X線胸片能清晰地記錄肺部的大體病變,如結核、腫塊、炎癥等。其中,正位胸片攝影和側位攝影最為常見,影像數量最多。因此,正側位胸片攝影的質量控制工作量極大。目前,正側位胸片攝影的質量控制主要以人工判定為主,容易受到多方面因素的干擾和限制,如主觀認知水平、疲勞程度、工作經驗以及環境亮度等,難以滿足當前的工作需求。

近年來計算機硬件性能顯著提升,尤其是GPU性能不斷突破,可以支撐大量數據的并行計算,提供更高的訪存速度和更高的浮點運算能力。因此,云計算、大數據、機器學習、深度學習、計算機視覺等領域發展迅速,為各領域提供了解決問題的新方案。在醫學影像領域中,近年來提出了很多基于深度學習的醫學影像語義分析應用[2-3],基于深度學習技術自動地提取醫療影像中的各種語義信息、綜合分析提取的語義信息,最終實現目標區域的自動分割[4-5]。本文將醫學業務知識與人工智能技術相結合,以醫療影像大數據為驅動,提出了一種基于深度學習的DR胸片常規攝片質量控制方法,解決了人工質控效率低、誤差大等問題。

1 研究方法

本文中質控方法的醫學業務規則借鑒了國內外放射科管理規范、質控標準。針對DR正、側位胸片常規攝影,提出了總體完整、臟器完整、成像細節、位置細節四大類質控規則,涵蓋了醫學影像質控的主要評估標準。

本文中質控方法以深度學習為技術核心,通過對語義分析技術進行改進,構建深度學習質控模型來對醫療影像進行總體完整、臟器完整、成像細節、位置細節四大類質控規則的評判。主要創新如下:① 綜合國內外質控標準,提出了人工智能可評估的DR正位胸片攝影和側位胸片攝影的質控規則;② 首次提出了一種基于深度學習的DR正位胸片和側位胸片攝片的質控方法。

1.1 醫學業務規則

關于X射線的質量控制,國家頒布了一系列規章制度[6-9],規定了醫用X射線的衛生防護、影像質量控制規范、放射防護要求、檢查操作規程等。在相關文獻中,給出了主要組織器官的X射線檢查操作規范、圖像質控標準、影像診斷規范與質控標準[10]。此外,有文獻介紹了對腹部、胸部、腰椎、顱骨、胸椎五個部位的照射方法與圖像質量的研究,為X射線設備的質量控制提供了參考[11]。Hobbs[12]對歐共體指南沒有進一步描述的扭曲和傾斜誤差進行了研究,通過檢查鎖骨頭與棘突的關系評估誤差的影響。Grewal等[13]通過對多種因素產生的不同影響進行研究,得出綜合性數字胸片圖像質量評估方案。

1.2 語義分析

全卷積網絡(Fully Convolutional Networks,FCN)是采用全卷積網絡進行語義分析的第一種方法,雖然其網絡結構較為簡單,但是為語義分析提供了一種新的思路,后續提出了許多基于FCN的圖像語義分析方法,這些方法在圖像語義分析方面都取得了很大的進展[14]。例如,實例敏感的FCN可以利用圖像的局部一致性來估計實例,通過在一組實例敏感的score map上添加一個簡單的集成模塊來獲取相對于實例位置的像素級分類器的結果[15]。

鑒于計算機計算能力的大幅提升,語義分析模型的網絡結構逐步向深度、寬度擴展。其目的是為了獲取更多的語義信息、更好地擬合目標函數,提升模型的性能。深度模型的代表網絡結構是VGG[16],由牛津大學Visual Geometry Group提出的卷積神經網絡模型,其變體之一的VGG-16在ILSVRC-2013競賽中取得了top-5上92.7%的準確率。VGG-16由16個權重層組成,第一層使用了大量的小尺寸卷積核,與使用少量的大尺寸卷積核相比,模型參數更少,非線性更強,決策函數更靈敏,更易于訓練。GoogLeNet的網絡結構在深度和寬度兩個維度上進行了擴展,在ILSVRC-2014競賽上取得了top-5上93.3%的準確率[17]。GoogLeNet的網絡結構極其復雜,共有22個權重層,并且引入了inception模塊。該模型的網絡結構證實了權重層可以有更多的堆疊方式,而不僅僅是標準的序列方式。繼此之后,深度學習模型能夠快速、準確地對圖像語義進行分析,進而使其在醫學影像中得到了更為廣泛的應用,尤其在智能輔助診斷等方面發揮了重要作用[18-21]。

2 技術方案

在本章節,將介紹基于深度學習的DR正位胸片常規攝片和側位胸片常規攝片質控方法的技術方案。首先,介紹如何提取醫療影像中不同維度的語義信息。其次,介紹基于深度學習的質控方法框架。

2.1 醫療影像語義信息提取

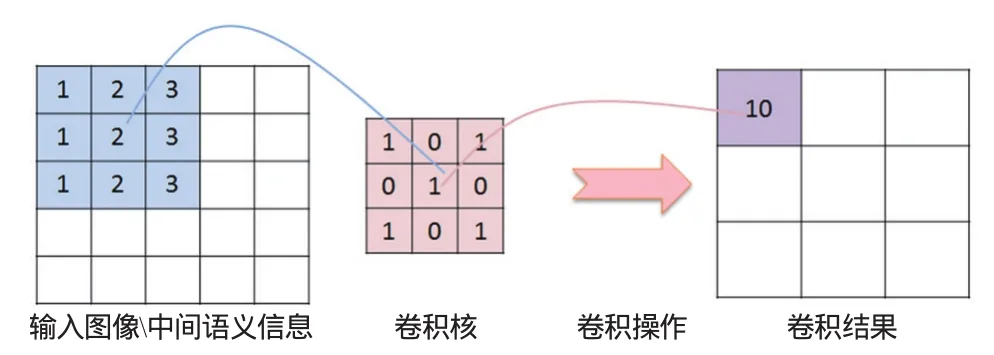

在深度學習中,使用卷積層來提取圖像的語義信息。卷積層之所以能夠提取語義信息,在于其包含的卷積核,卷積層的原理如圖1所示。

圖1 卷積層原理

圖1中的卷積核尺寸為3×3,并且隨機分配了一組權重。卷積核在輸入圖像/中間語義信息上分別沿著寬度、高度兩個方向平移,在平移時與對應位置上的輸入值做加權求和。平移結束時,得到的加權和組成了卷積結果,即語義信息。

為了獲取更多的語義信息,可以同時使用多個卷積核如圖2所示。

圖2 多卷積核卷積層

圖2中使用了4個3×3×3的卷積核,其中前兩個3表示卷積核的高度和寬度,最后一個3表示卷積核的通道數,應與輸入數據的通道數一致。按照圖1所示的卷積層工作原理,得到了7×7×4的輸出,其中輸出數據的通道數為4,與卷積核的個數一致。

為了獲取不同維度的語義信息,可以同時使用具有多個尺寸的卷積核,與圖2所示的原理一致,只是各個卷積核具有不同的高度和寬度。

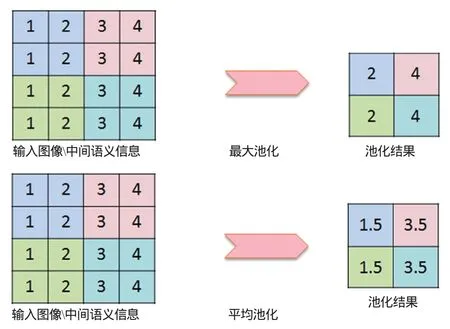

通過上述的卷積層,可以提取出大量的、多個維度的語義信息。雖然這些語義信息有助于模型的訓練,但是降低了計算速度、增加了過擬合的風險,因此引入了池化層。池化層通常分為最大池化層、平均池化層如圖3所示。

圖3 最大池化層、平均池化層原理

圖3中,輸入圖像/中間語義信息中每個底色對應一次池化操作,池化區域的寬度和高度均為2。最大池化是選擇池化區域內最大的值,平均池化是計算池化區域內的平均值。池化區域也可以是其他尺寸,如3×3,5×5等。

通過池化層的處理,縮減了模型大小、提高了計算速度,以及所提取語義信息的魯棒性。

2.2 基于深度學習的質控方法框架

基于深度學習的質控方法是以深度學習為核心,輔以特征工程和結果可視化的完整技術解決方案,其方法框架如圖4所示。方法主要由三部分組成:特征工程,構建、訓練深度學習質控模型,質控結果可視化。

圖4 基于深度學習的DR正位胸片常規攝片質控方法

特征工程:通過值域轉換將醫療影像的醫學值域轉換至統一的量綱;通過空間歸一化來規范醫療影像的各個空間特征;通過數據增強豐富了數據集,增加了數據的多樣性,提升了數據的魯棒性。

構建、訓練深度學習質控模型:基于卷積層、池化層、輔助層構建質控模型。在深度上通過多層卷積層逐層地提取語義信息,增加語義信息的數量。在寬度上采用多個不同尺寸的卷積核獨立地提取語義信息,增加語義信息的維度。將最終提取的語義信息送入池化層,實現語義信息的靜態分析。靜態分析后的結果通過輔助層(如softmax)變換為數字化質控結果。

訓練模型所使用的數據集包括以下內容:醫學影像,對應的臟器、組織結構掩碼。依據該數據集從語義提取、語義描述、語義匹配三個角度來訓練模型,使模型能夠在醫學影像中分割出質控所需的臟器、組織結構,并在3.1節和3.2節給出了模型分割臟器、組織結構的示例說明。分割所需的臟器、組織結構,是為了將其語義信息傳遞給總體完整、臟器完整、成像細節、位置細節模塊進行質控判定。

(1)語義提取。尋找易于追蹤和對比的語義;語義描述:對提取的語義用張量進行描述,使其能夠在其他圖像中尋找到相似的語義;語義匹配:根據語義描述,在其他圖像中尋找所有相同的語義區域,根據尋找結果給出最終判定。

(2)總體完整。基于各臟器、組織結構語義信息中的空間信息計算各臟器、組織結構相對于影像坐標系的位置。當各臟器、組織結構的位置在質控標準規定的合理范圍內時,則總體完整這一項合格;反之,不合格。

(3)臟器完整。模型分割出的臟器與質控標準中醫學影像應包含的臟器類別個數一致,并且各個臟器完整,則臟器完整這一項合格;反之,不合格。

(4)成像細節。基于各臟器、組織結構語義信息,計算各臟器、組織結構在醫學影像中的灰度值分布、對比度等信息。當其符合質控標準規定的合理范圍時,則成像細節這一項合格;反之,不合格。

(5)位置細節。基于各臟器、組織結構語義信息中的空間信息計算各臟器、組織結構之間的相對位置,并基于圖像坐標系進行表示。當各臟器、組織結構之間的相對位置符合質控標準規定的合理范圍時,則成像細節這一項合格;反之,不合格。

(6)質控結果可視化。根據質控模型返回的數字化質控結果進行可視化,提供圖示說明、文字說明、統計分析。供不同機構、業務領域的用戶使用。

3 深度學習質控模型結構與工作原理

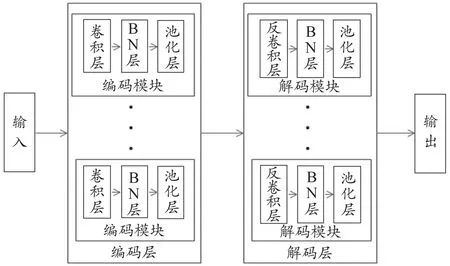

質控模型通過訓練,獲取了一組卷積層、池化層、輔助層的參數。模型中的參數能夠逐級地提取醫療影像的語義信息,并對語義信息進行靜態分析和動態整合,形成張量化的語義描述。基于張量化的語義描述在醫療影像中尋找相同的語義區域,實現語義匹配。模型通過卷積層提取語義的過程是對輸入影像進行編碼,模型通過卷積層將提取的語義還原為影像的過程是對輸入影像的語義進行解碼。當解碼過程的輸出的尺寸與模型的輸入影像的尺寸一致時,解碼過程結束,并將該輸出作為模型的輸出。該操作的目的是為了將模型輸出的語義結果與輸入至模型的影像對應,便于獲取模型輸出的語義在影像中所對應的區域、組織、器官。本文中的DR正位胸片常規攝片質控模型和DR側位胸片常規攝片質控模型均使用了編碼過程和解碼過程,其結構稱為編碼器—解碼器結構,并且可以具有不同的深度和寬度,結構示意圖如圖5所示。

圖5 采用編碼器-解碼器結構的質控模型結構

通過改變圖5中編碼模塊或解碼模塊的個數來改變模型的寬度,通過改變圖5中編碼層或解碼層的個數來改變模型的深度。在后文的質控模型統計表中,將卷積層和反卷積層統稱為2D卷積層。

3.1 DR正位胸片常規攝片質控模型

DR正位胸片常規攝片質控模型采用了編碼器-解碼器的結構,模型的基礎結構為2D卷積層、池化層、BN層、激活層等。該模型中,2D卷積層304個、池化層12個、BN層280個。

DR正位胸片常規攝片質控模型通過深度學習模型對影像中的語義進行提取、描述、匹配。基于語義的處理結果,匹配出判定各個質控指標所需的語義,通過對語義進行轉化得到質控指標在影像中對應的區域,并以此得到最終的質控判定結果。以DR正位胸片常規攝片肺部相關的質控指標為例,圖6給出了深度學習質控模型的輸入數據,肺部語義信息提取、描述、匹配的中間過程的可視化結果,顯式地說明了DR正位胸片常規攝片質控模型的工作原理。

3.2 DR側位胸片常規攝片質控模型

DR側位胸片常規攝片質控模型同樣采用了編碼器-解碼器的結構,模型的基礎結構為2D卷積層、池化層、BN層、激活層等。但是,由于側位胸片常規攝片的質控需求相對于正位胸片常規攝片的質控需求較少,所以模型中的基礎結構也較少。該模型中:2D卷積層231個、池化層8個、BN層數目176個。

DR側位胸片常規攝片質控模型的工作原理與DR正位胸片常規攝片質控模型的工作原理一致,同樣包含語義提取、語義描述、語義匹配。并且基于語義處理結果進行質控指標判定。以DR側位胸片常規攝片肺部相關的質控指標為例,圖7給出了深度學習質控模型的輸入數據,肺部語義信息提取、描述、匹配的中間過程的可視化結果,顯式地說明了DR側位胸片常規攝片質控模型的工作原理。

通過正位胸片和側位胸片的肺部語義信息提取、描述、匹配可視化結果可以看出在模型最后的若干卷積層中,利用語義提取、語義描述、語義匹配的結果,以及對應質控規則的標記,學習如何給出最終的質控評定結果。

4 實驗及結果

4.1 數據與模型

實驗使用了去隱私的真實醫療DR正位胸片DICOM數據和DR側位胸片DICOM數據,各7000例。分別將兩種數據中的5000例作為訓練數據使用,余下2000例作為測試數據使用。

圖6 肺部語義信息提取、描述、匹配可視化結果

圖7 側位胸片肺部語義信息提取、描述、匹配可視化結果

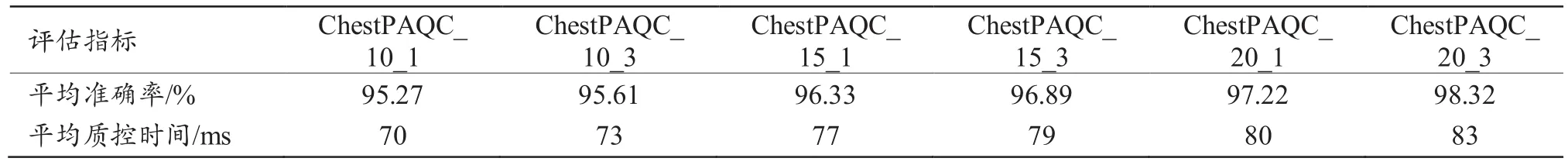

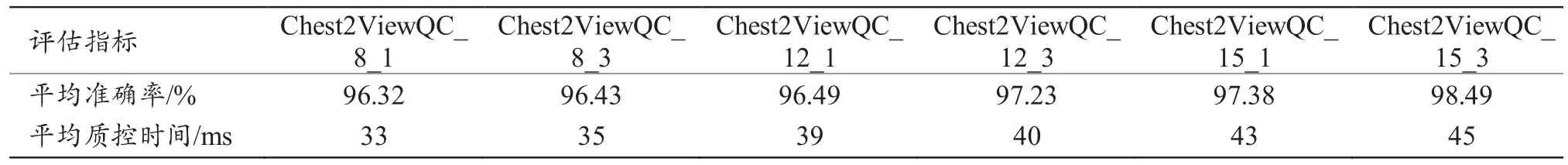

本文實驗中針對DR正位胸片和DR側位胸片分別設計了六種網絡結構,通過卷積層、池化層、輔助層的多樣化組合,構建了不同深度和寬度的網絡結構,分別為:ChestPAQC_10_1、ChestPAQC_10_3、ChestPAQC_15_1、ChestPAQC_15_3、ChestPAQC_20_1、ChestPAQC_20_3;C h e s t 2 Vi e w Q C_8_1、C h e s t 2 Vi e w Q C_8_3、Chest2ViewQC_12_1、Chest2ViewQC_12_3、Chest2ViewQC_15_1、Chest2ViewQC_15_3。 名 字 中ChestPAQC表示DR正位胸片質控模型,Chest2ViewQC表示DR側位胸片質控模型,第一個數字表示深度、第二個數字表示寬度。在各自的數據集上對上述兩組模型進行訓練、測試,根據準確率、計算耗時對各個模型進行性能評估。

4.2 結果統計與分析

表1和表2分別給出了上述兩組模型的消融實驗結果,列出了兩組模型內,每個模型的平均準確率和平均質控時間。

從表1和表2可以得出,模型深度一致時,增加模型的寬度可以提升模型的準確率;模型寬度一致時,增加模型的深度可以提升模型的準確率。隨著模型深度、寬度的增加,模型的計算時間也隨之增加。實際應用時,可以根據具體業務需求,權衡準確率和質控時間的重要性,構建符合業務需求的模型。

4.3 人工質控

人工質控完全基于醫師的業務知識和經驗進行質控,項目如下:

(1)總體完整。醫師觀察醫學影像中的各臟器、組織結構,根據業務知識和經驗判斷總體完整這一項是否合格。

(2)臟器完整。醫師觀察醫學影像中各臟器的類別和個數,根據業務知識和經驗判斷臟器完整這一項是否合格。

(3)成像細節。醫師觀察醫學影像中的各臟器、組織結構,根據業務知識和經驗判斷成像細節這一項是否合格。

(4)位置細節。醫師觀察醫學影像中的各臟器、組織結構,根據業務知識和經驗判斷位置細節這一項是否合格。

醫師將上述結果錄入質控系統,至此,完成1例醫學影像的質控工作,其平均質控時間為10 min,表1~2中所列出的模型的平均質控時間最長為83 ms,遠小于人工質控的平均質控時間。

通過對比本文提出的質控方法和人工質控方法,可以明顯地發現人工質控方法存在大量的人工操作,這大大降低了質控效率。并且,各醫師之間的業務知識和經驗具有差異性,導致了質控結果具有主觀偏差,降低了質控結果的可信度。

表1 DR正位胸片質控模型平均準確率、平均質控時間

表2 DR側位胸片質控模型平均準確率、平均質控時間

本文提出的質控方法無需人工參與,大大提高了質控效率。并且,通過算法量化各個質控標準,去除主觀偏差,提升了質控結果的可信度。

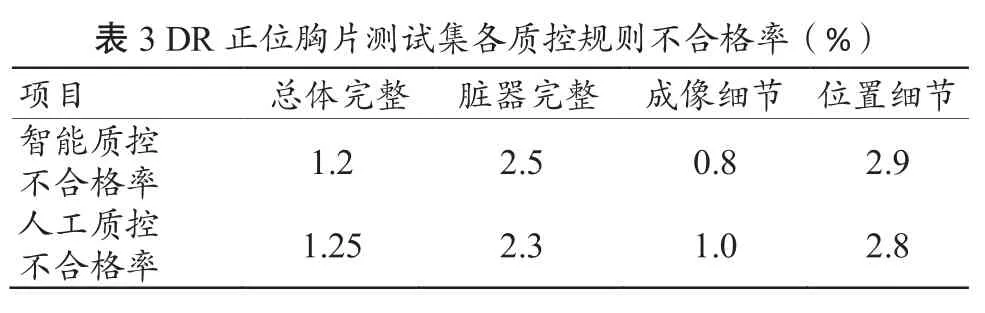

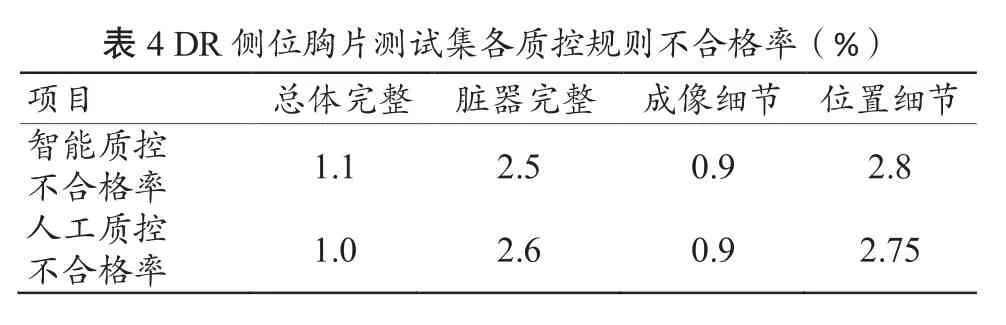

本文質控方法在DR正位胸片測試集和DR側位胸片測試集上的質控結果如表3~4所示。表中給出了智能質控模型在測試集上的總體完整、臟器完整、成像細節、位置細節質控規則的不合格率,其不合格率與人工質控結果的平均差異為1.25%,在合理范圍內,符合各醫療機構在日常診療工作中出現的影像不合格率。

?

?

5 結論

在本文中,提出了一種基于深度學習的DR正位胸片攝影和DR側位胸片攝影質控方法。該方法根據醫學影像質控規范,通過深度學習技術構建質控模型,利用大量醫學影像數據訓練得到了高性能的質控模型,輔以結果可視化技術提供了總體完整、臟器完整、成像細節、位置細節四大類可視化質控結果。該方法提升了質控工作的速率和準確率,釋放了質控工作占用的衛生資源,從而減輕影像診斷工作者的工作負擔,使衛生資源得到更合理地利用。