基于YOLOv2-Tiny的環視實時車位線識別算法

何俏君,郭繼舜,關倩儀,鐘 斌,付 穎,谷 俊

(廣州汽車集團股份有限公司 汽車工程研究院,廣東 廣州 511434)

隨著近年來人工智能技術的蓬勃發展,關于智能駕駛技術的研究在汽車行業快速興起。其中,自動泊車輔助系統(Automatic Parking Assist,APA)受到眾多新興人工智能領域企業以及傳統汽車制造企業的廣泛關注并展開了相關技術研究。車位識別作為自動泊車系統中的感知環節,其準確性和快速性對后續車輛泊車路徑規劃與控制至關重要。

目前已有的空閑車位識別技術可以分為基于超聲波雷達探測,基于視覺的空閑車位識別以及超聲波與視覺相融合3種基本模式。得益于360°環視成像技術的成熟發展,本文提出一種基于環視圖像的全視覺空閑車位線識別方法。在其他學者既已提出的眾多研究車位線自動識別方法中,可劃分為依據線檢測與依據角點檢測定位車位兩種基本思路。

文獻[1,2]中結合環視圖像邊緣提取與Hough變換檢測直線實現車位線定位,除了Hough變換外,文獻[3]使用Line Segment Detector(LSD)檢測識別車位線。基于直線檢測的車位定位對部分僅畫出角點附近車位線的車位適用性不高,且直線檢測對圖像噪聲點較為敏感,環境復雜的情況下對檢測準確度影響較大。基于角點檢測的思路,Suhr等人[4]提出分層樹模型以自下而上、自上而下兩種模式搜索定位車位角點完成車位線識別,但難以滿足實時性要求。Lin[5]等提出訓練分類器檢測角點并結合先驗邏輯約束重構車位,但僅能用于檢測角點為直角的車位線。而文獻[6]中提出基于深度學習的車位檢測方法,分別用目標檢測網絡檢測角點,并訓練另一個網絡匹配角點對模式,結合模板匹配確定車位擺向。該方法利用了深度學習強大的非線性擬合能力,但對運算所需硬件設備要求較高且角點中心定位準確程度對車位擺向影響較大。

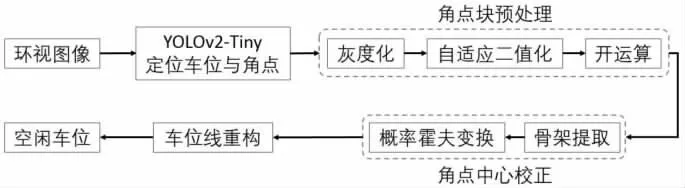

以自動泊車系統所要求的運算資源成本低且實時性要求高為出發點,本文提出一種基于輕量化深度學習目標檢測網絡YOLOv2-Tiny的角點檢測方法,結合車位線骨架信息提取,對網絡定位角點不精確的問題進行校正,并進一步將概率霍夫變換直線檢測應用于角點區域骨架上,減少全局噪聲對直線檢測精度的影響,最終確定重構的車位線,算法流程圖如圖1所示。

1 魚眼矯正拼接環視圖像

魚眼攝像頭成像角度廣,可收集近距離內較多視場信息,但魚眼相機拍攝圖像時存在嚴重畸變,故需預先對魚眼攝像頭進行標定校正。

圖1 本文車位線識別算法流程圖

1.1 魚眼攝像機模型中的坐標系統

世界坐標系 (world coordinate system):用戶定義的三維世界的坐標系,為了描述目標物體在真實世界里的位置而被引入。

相機坐標系 (camera coordinate system):在相機上建立的坐標系,為了從相機的角度描述物體位置而定義,作為溝通世界坐標系和圖像/像素坐標系的中間一環。

像素坐標系 (pixel coordinate system):描述物體成像后的像點在數字圖像上的坐標,是從相機內真正讀取到的信息所在的坐標系。

圖像坐標系 (image coordinate system):描述成像過程中物體從相機坐標系到圖像坐標系的投影透射關系,可進一步得到像素坐標系下的坐標。

標定過程分為兩部分。

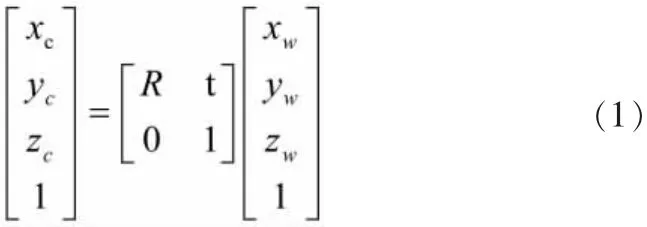

第1部分為世界坐標系轉換為相機坐標系,這一步是三維點到三維點的轉換,轉換關系為:

式中:R——3×3的旋轉矩陣;t——3×1的平移矢量;(xc,yc,zc,1)T——相機坐標系的齊次坐標; (xw,yw,zw,1)T——世界坐標系的齊次坐標。

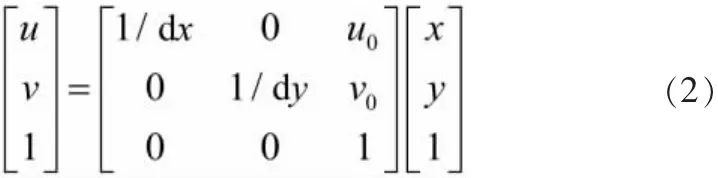

第2部分是相機坐標系轉換為像素坐標系,是三維點轉為二維點的過程。但因像素坐標系不利于坐標轉換,需先建立圖像坐標系,由像素坐標系轉換為圖像坐標系:

式中:1/dx,1/dy——分別為沿x軸與y軸方向單位物理尺寸上的像素個數;(u,v)——圖像中心點的像素坐標。

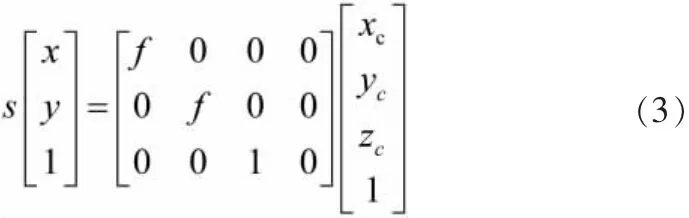

由相機針孔成像原理可知,相機坐標系轉換為圖像坐標系即為透視投影過程。轉換關系如下:

式中:s——比例因子 (s不為0);f——有效焦距 (光心到圖像平面的距離); (x,y,z,1)T——空間點P在相機坐標系OXYZ中的齊次坐標; (x,y,1)T——像素點p在圖像坐標系OXY中的齊次坐標。

通過將世界坐標系上的坐標值投影到對應的像素坐標系上的像素點,在此過程中可求解出相機的內外參數。轉換關系可表示為:

式中,R——3行3列矩陣,稱為旋轉矩陣;t——三維列向量,稱為平移向量;M1——相機內部參數矩陣;M2——相機外部參數矩陣。

1.2 魚眼攝像機標定技術

為了矯正魚眼相機產生的畸變,需先標定相機求出內外參數。相機標定技術主要分為兩種:相機的自標定法和攝影標定法。張正友棋盤格標定法是介于二者之間,接受度較高的方法,既克服了攝影標定法需要的高精度三維標定物的缺點,又解決了自標定法魯棒性差的難題。

張氏標定法[7]是一種基于平面棋盤格的標定法,通過圖像平面與標定物棋盤格平面的坐標系映射關系確定單應性矩陣,利用約束條件求解相機的內參數矩陣并由其估算出相應的外參數矩陣,從而達到標定相機并矯正的目的。具體流程如下。

1)打印一張棋盤格,貼在一個平面上以作為標定物。

2)通過調整標定物或攝像機的方向,為標定物拍攝一些不同方向的照片。

3)從照片中提取棋盤格角點。

4)估算理想無畸變的情況下,5個內參和6個外參。

5)應用最小二乘法估算實際存在徑向畸變下的畸變系數。

6)極大似然法對畸變系數進行優化估計,提升估計精度。

1.3 環視圖像拼接

多個魚眼攝像頭收集到圖像數據后需要將其拼接成一幅完整畫面。本文使用尺度不變特征轉換 (SIFT,Scale-invariant Feature Transform)方法匹配2幅圖像相同的特征點,通過隨機一致性采樣 (RANSAC,Random Sample Consensus)篩選正確的特征匹配并輸出透視矩陣,利用透視變換完成圖像的拼接,循環這個流程迭代所有圖像就可以完成多張圖像的全景圖拼接。

SIFT特征提取分為檢測特征點,確定特征點的尺度方向,生成特征向量,最后進行匹配。首先掃描圖片所有尺度下的所有位置,計算2個相鄰的高斯尺度空間差值得到高斯差分空間,高斯差分空間的眾多極值點即為特征點;利用直方圖統計方法,求出鄰域內所有像素點的梯度方向以及幅值,直方圖的峰值所代表的方向即為特征點的主方向;通過求得特征點的鄰域梯度信息來計算特征向量;采用最近鄰方法計算特征向量的歐氏距離從而匹配特征點。

隨機一致性采樣算法 (RANSAC)是隨機采用部分特征匹配坐標計算得到一個透視矩陣,利用此透視矩陣測試所有的匹配點,若匹配結果良好則輸出該透視矩陣,否則換用其他特征匹配坐標。該方法的作用是剔除掉不正確的特征匹配結果,獲得正確的透視矩陣。

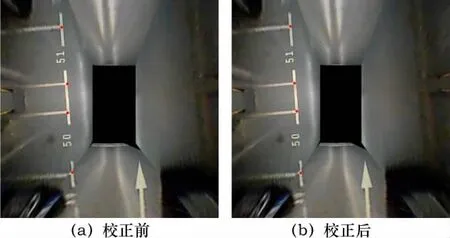

透視變換就是將圖像投影到一個新的視平面上。在全景圖拼接時,很多圖像會由于拍攝角度等問題出現一些方向上的不同步,需要旋轉圖像到相同視角再拼接。而控制旋轉變換的方式即是通過透視矩陣與原圖像的矩陣形式進行相乘得到新的圖像矩陣方可進行拼接。原視頻與拼接后的圖像對比如圖2所示。

圖2 原視頻與拼接后的圖像對比

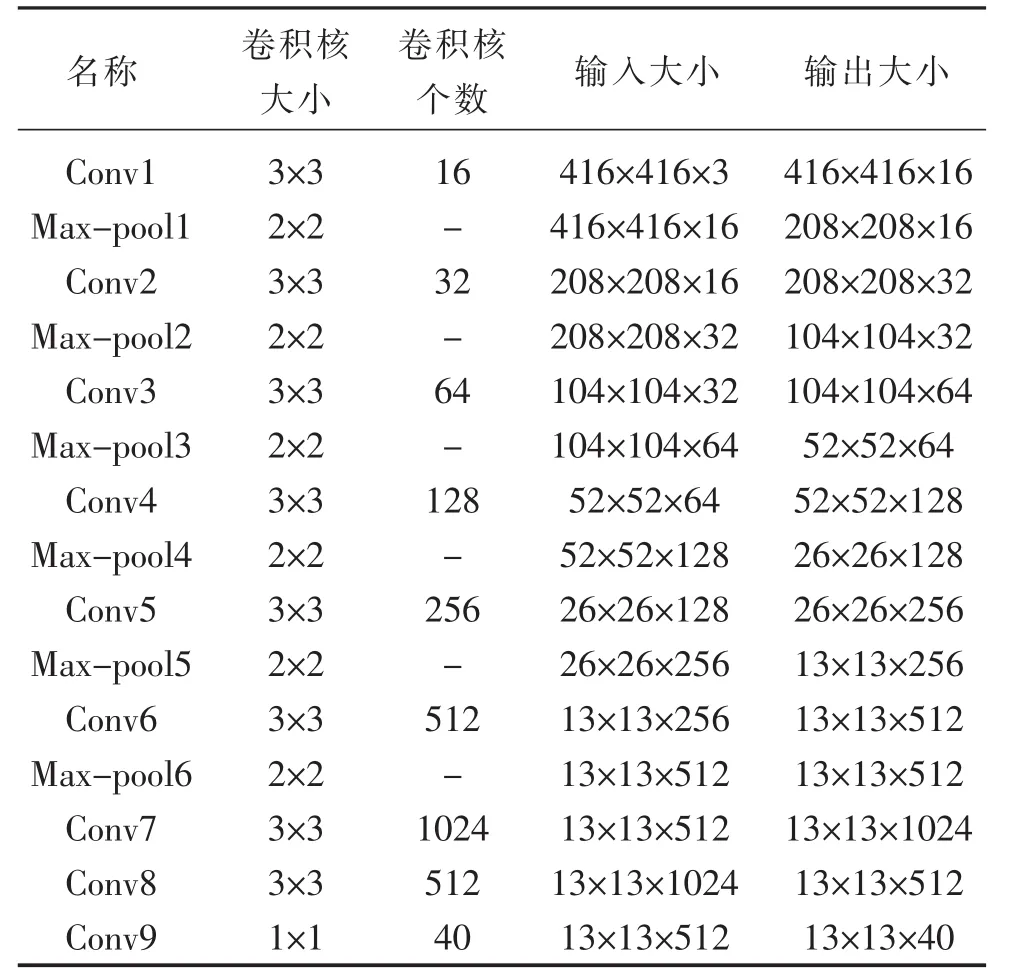

表1 YOLOv2-Tiny結構組成

2 基于YOLOv2-Tiny的空閑車位與角點檢測

2.1 YOLOv2-Tiny目標識別

基于darknet框架的YOLO目標檢測模型最早于2016年由Redmon等提出,YOLO通過網格化分割方式回歸目標邊界框同時預測類別,相較于當時表現出色的Faster-RCNN目標檢測模型,YOLO檢測效率大幅提升,對實時性要求高的目標檢測任務適用性更好。隨后YOLO模型進一步發展至YOLOv2,其特征提取基于darknet-19實現,通過在網絡中加入了批歸一化,多尺度特征提取,引入固定框 (anchor boxes)取代全連接層進行邊界框回歸等改進從而優化YOLO分類與定位效果,并進一步提升檢測效率。

然而,盡管基于深度網絡的YOLOv2模型對運算資源硬件要求較SSD、Faster-RCNN等目標檢測模型有所降低,仍難以滿足其在車載嵌入式ECU得以廣泛應用所期待的低成本與高效率二者相平衡的要求。因此,針對全自動泊車系統中基于視覺的空閑車位檢測任務的應用場景,使用輕量化的YOLOv2-Tiny模型適應車載嵌入式ECU算力低且檢測任務實時性要求高的特點。YOLOv2-Tiny的網絡結構共包含9個卷積層,6個池化層,具體每層卷積核大小和數量如表1所示。

2.2 空閑車位區域與車位線角點識別

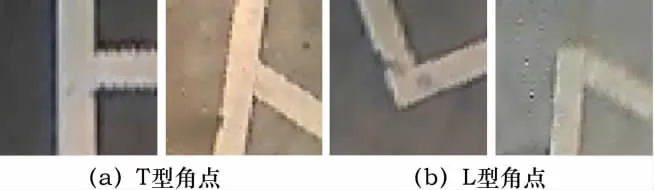

本文基于YOLOv2-Tiny模型對空閑車位區域以及角點進行識別,其中角點類型分為T型角點 (圖3a)與L型角點兩種(圖3b),共3種目標類型。

圖3 兩種角點類型

2.3 網絡訓練

實驗中網絡訓練部分基于Darknet框架在Ubuntu 16.04 LTS系統,中央處理器為主頻2.10GHz的Intel Xeon E5-2683 v4,GPU為TITAN X配置下實現。采用文獻[6]中提供的不同天氣狀況,不同室內外環境,不同光照方向與光照強度下采集的公開數據集進行訓練與測試。數據集包含共10000張環視車位圖像,其中8000張作為訓練樣本,其余作為測試樣本。YOLOv2-Tiny網絡訓練超參數設置如下:批次大小為16,迭代次數為10000,學習率為0.001。

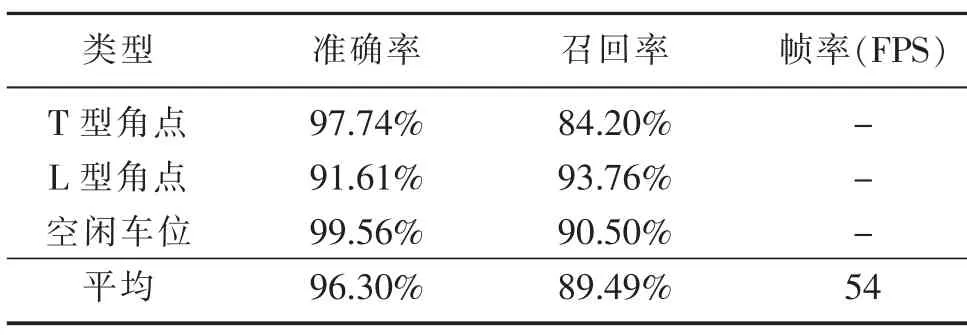

2.4 識別精度與效果

利用訓練好的網絡權重在Ubuntu 16.04 LTS系統,中央處理器為主頻2.80GHz的Intel Core i7-7700HQ,GPU為NVIDIA Quadro M1200配置下實現對2000張測試樣本圖進行測試,得到空閑車位區域與兩種角點識別準確率如表2所示。從表中可以看出,訓練后的YOLOv2網絡對空閑車位檢測效果十分理想,兩種類型角點的檢測精度較高,其輕量化結構使其檢測效率大大提高,能滿足自動泊車系統的實時性要求。

表2 YOLOv2-Tiny識別精度

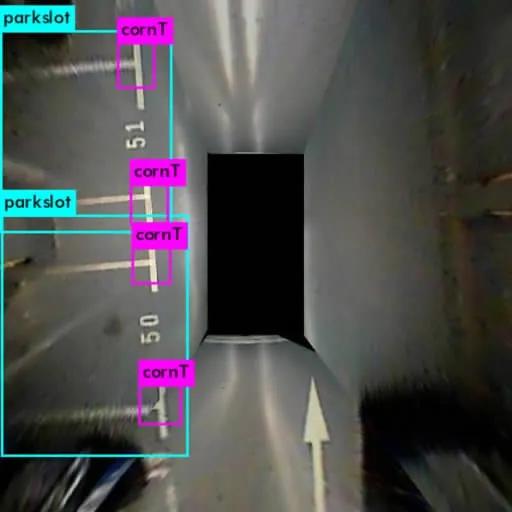

訓練好的網絡對測試圖片檢測結果如圖4所示,從圖4可看出網絡能正確定位空閑車位區域,并識別出角點類型與位置,根據角點塊中心與車位區域間的相對位置可篩選出每個車位區域內的角點,后續根據角點位置重構實際車位線。

圖4 空閑車位與角點識別效果

3 基于角點塊骨架提取的角點中心校正

第2章中訓練好的YOLOv2-Tiny網絡能基本定位角點塊區域,理想狀態下角點塊區域中心像素點坐標為實際角點坐標,但由于YOLOv2-Tiny較于其他深度網絡輕量化的特性,其對角點中心的定位精度有所降低。環視圖像中具有一定寬度的車位線在圖像上往往對應覆蓋多個像素點范圍,準確意義上的角點中心為2條線各自覆蓋的像素點區域中心軸相交的交點。圖像骨架提取指的正是相連通的像素點區域細化至單位像素寬度的過程,對于線狀輪廓而言,經過骨架提取后可得到單位寬度的中軸線,2條中軸線的交點即為實際角點中心。

3.1 角點校正預處理

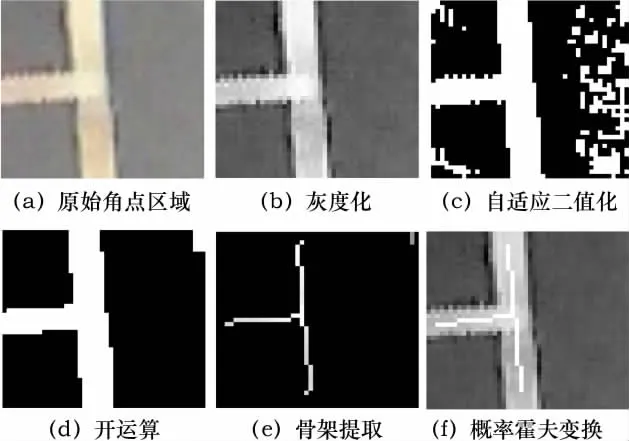

對圖像進行骨架提取前需要對原始角點區域圖像進行灰度化和自適應閾值二值化。各步驟處理角點圖像效果如圖5所示。

圖5 各步驟處理角點圖像效果

3.2 角點骨架提取

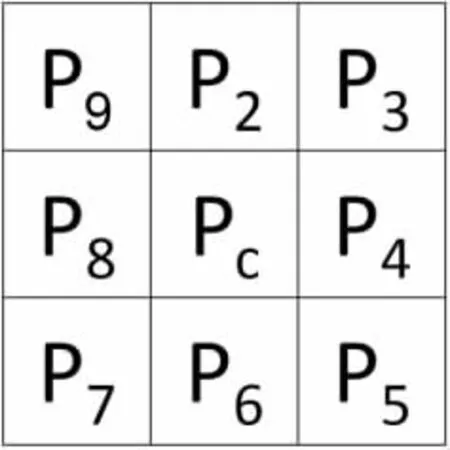

本文使用Zhang[8]提出的經典快速并行圖像細化算法對識別出的車位角點塊進行骨架提取,該算法迭代逐次消除角點框內直線的邊緣像素點,將每個像素點的相鄰像素點分布編號為如圖6所示順序,每輪消除滿足以下 1)~3)3個條件的像素點,直到沒有新的像素點被消除停止迭代。

快速并行細化算法刪除點條件如下所述。

1)與中心像素點相鄰的8個像素點之和滿足式 (5)。

圖6 相鄰像素點編號序列

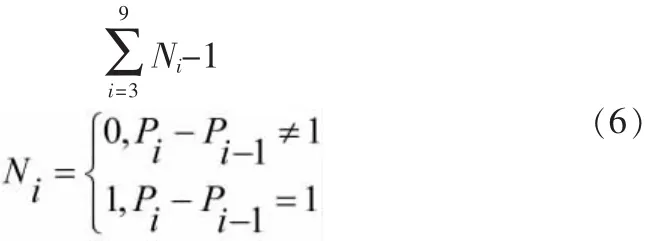

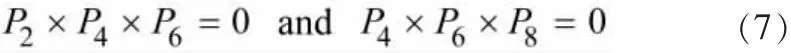

2)順時針遍歷P2~P9,像素點從0變成1的總次數等于1,即滿足式 (6)。

3)奇數輪迭代滿足:

偶數輪迭代滿足:

使用快速并行細化算法對角點提取骨架后的結果如圖5e所示。

3.3 概率霍夫變換檢測直線得到交點坐標

標準霍夫變換建立了二維空間(x,y)與參數空間(ρ,θ)間的投影變換,二維空間中的直線對應參數空間中的某個點(ρ0,θ0),因此二維空間直線上的所有點變換后都對應經過該點 (ρ0,θ0),由此可將直線檢測轉化為參數空間的高頻點檢測,霍夫變換中兩個空間的關系滿足式 (9):

標準霍夫變換可用于直線檢測,在此基礎上,概率霍夫變換把圖像邊緣點投影至參數空間并累積至滿足設定閾值后終止,較標準霍夫變換效率更高,可有效檢測線段,對本文識別任務更為適用。利用概率霍夫變換可以得到角點骨架線段,并進一步通過線段起始點和終點相對位置確定不完整顯示車位的擺向。

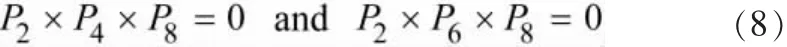

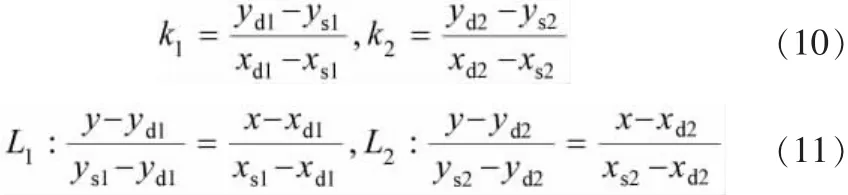

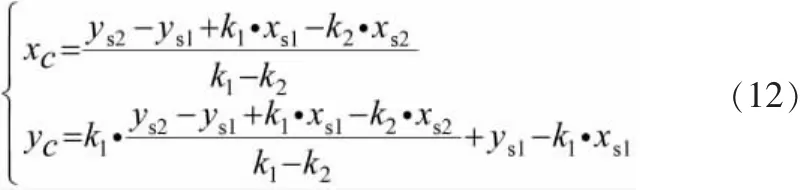

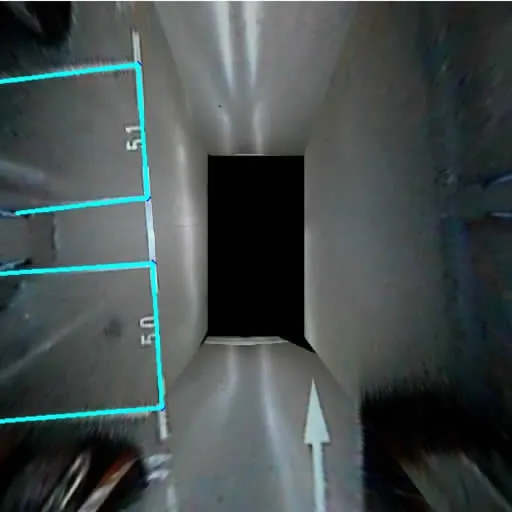

基于細化后的角點骨架,利用概率霍夫變換檢測線段的結果如圖5f所示。通過篩選可以得到通過2條有效線段的2個端點 (xs,ys), (xd,yd),根據2個端點相對位置可以確定2條車位線的斜率k1,k2(式 (10)) 以及式 (11) 所示直線表達式,進一步聯立兩個表達式可以求得式 (12)所示交點c=(xc,yc),即校正后的角點中心坐標。圖7為經過角點校正后識別出的環視圖像車位角點標記。

圖7 角點中心校正前后對比

4 車位線重構

由3.3節中計算的校正后角點位置和斜率可分不同情況對實際車位線進行重構,對于不完整顯示的車位需要識別出2個有效角點方可進行實際車位重構,具體可劃分為如下3種情況。

1)識別出的角點個數等于4。根據4個角點中心位置,兩兩計算其連線的斜率,與每個角點對應2條車位線的斜率k1,k2相比較,將在誤差允許范圍內連線斜率與k1,k2二者之一相等的2個角點相連,4點相連可得實際車位。

2)識別出的角點個數等于3。根據車位線對邊平行的特性可以計算出第4個車位角點坐標,得到4點坐標后對應情況1)實現車位線重構。

3)識別出的角點個數等于2。此時為車位不完整顯示于環視圖像中的情況,識別出的2個角點為同側角點,計算2個角點中心連線的斜率km與檢測得到的各自對應的車位線斜率k1,k2相比較,相差較大者分別為2個角點另一端不完整車位線的斜率ks。以單條車位線為例,沿其斜率方向延伸可以與環視圖像邊界交于兩點p1,p2,以角點中心c為起點,與圖像邊界角點為終點可以得到2個向量,。該角點骨架經過概率霍夫變換后可以得到的對應斜率kn的線段2個端點sn,dn,以離角點中心c較接近的端點為起始點s,較遠點為終點d,可得到車位擺向向量,分別對計算與的內積,滿足式 (13)的向量c為同向,對應點p*為有效交點。

車位線重構效果如圖8所示,藍色線段為重構的車位線。

5 結束語

圖8 車位線重構效果圖

針對自動泊車系統中實時檢測空閑車位這一實際任務,本文提出了一種使用輕量網絡YOLOv2-Tiny進行角點檢測的算法,并基于角點檢測結果結合骨架提取與概率霍夫變換進行角點中心校正。角點校正一方面可以彌補使用輕量化網絡帶來的角點定位偏差問題,另一方面基于角點塊區域檢測直線可以減輕全局環境噪聲對直線檢測精度的影響,且可檢測角度多變的不同類型車位。通過實驗結果證明本文所提出的車位線識別算法效果良好,且輕量化網絡檢測效率高,可滿足自動泊車系統實時性要求。