基于無人機多光譜遙感圖像的玉米田間雜草識別

趙靜,李志銘,魯力群,賈鵬,楊煥波,蘭玉彬

基于無人機多光譜遙感圖像的玉米田間雜草識別

趙靜1,2,李志銘1,2,魯力群2,3,賈鵬1,2,楊煥波1,2,蘭玉彬1,2

(1山東理工大學農業工程與食品科學學院,山東淄博 255000;2山東理工大學國際精準農業航空應用技術研究中心,山東淄博 255000;3山東理工大學交通與車輛工程學院,山東淄博 255000)

【目的】為了精確高效識別玉米田間雜草,減少除草劑施用,提高玉米種植管理精準性。【方法】通過六旋翼無人機搭載多光譜相機獲取玉米田塊多光譜圖像。為分離圖像中植被與非植被像元,計算了7種植被指數,采用最大類間方差法提取植被指數圖像中非植被區域,制作掩膜文件并對多光譜圖像掩膜。通過主成分分析對多光譜圖像進行變換,保留信息量最多的前3個主成分波段。將試驗區域分為訓練區域和驗證區域,在訓練區域中分別選取了675處玉米和525處雜草樣本對監督分類模型進行訓練,在驗證區域選取了240處玉米樣本及160處雜草樣本評價模型分類精度。將7種植被指數、3個主成分波段的24個紋理特征及經過濾波的10個反射率,共計41項特征作為樣本特征參數。利用支持向量機-特征遞歸消除算法(support vector machines-feature recursive elimination,SVM-RFE)和Relief算法從41項特征中各篩選14項特征構成特征子集,采用支持向量機、K-最近鄰、Cart決策樹、隨機森林和人工神經網絡對特征子集進行監督分類。【結果】支持向量機與隨機森林對全部特征及2個特征子集分類效果較好,支持向量機總體精度為89.13%—91.94%,Kappa>0.79,隨機森林總體精度為89.27%—90.95%,Kappa>0.79。【結論】SVM-RFE算法對數據降維效果優于Relief算法,支持向量機(SVM)模型對區域冠層尺度下玉米與雜草的分類效果最好。

雜草識別;無人機遙感;多光譜圖像;特征選擇;監督分類

0 引言

【研究意義】在農業生產過程中,田間雜草被視為嚴重影響作物生長的因素之一,中國因雜草導致的糧食作物產量損失達總產量的10%[1]。草害容易集中大規模爆發,且與作物幼苗爭奪生長所需的資源,致使作物幼苗生長發育緩慢,作物產量降低,因此必須對田間雜草及時控制。化學除草法由于其高效性,已成為國內外的主要除草手段,但地毯式地使用化學除草劑不僅對農田及周圍生態環境造成一定的破壞,其殘留在作物葉片上的藥劑也對食品安全造成危害[2]。2015年農業部明確了“雙減”的目標來治理農業面源污染,即通過技術手段和管理方式減少農業中化肥和農藥的使用,實現農業的可持續發展[3-5]。因此,研究精準的作物雜草識別方法,對于農藥精準變量噴施技術的發展具有重要意義[6-8]。【前人研究進展】當前雜草識別研究中,根據圖像信息獲取手段及圖像特征提取方式不同,可分為基于光譜特征、機器視覺以及光譜成像的雜草識別方法[9-10]。目前廣泛采用的是基于機器視覺的識別方法,針對獲取的作物及雜草圖像,利用計算機分析圖像中作物與雜草所表現出的形狀、紋理和顏色等特征,提取差異較大的特征參數對目標進行識別檢測。鄧向武等[11]通過數碼相機地面獲取稻田雜草圖像,提取其顏色、形狀和紋理特征,采用深度置信網絡對雜草進行識別,識別率為83.55%。孫俊等[12]提出一種空洞卷積與全局池化相結合的多尺度特征融合卷積神經網絡模型,對多種農作物幼苗及雜草進行訓練識別,平均測試識別準確率達到98.80%。何東健等[13]利用多光譜相機地面采集3類雜草圖像,提取葉片形狀、紋理及分形維數特征,將支持向量機分類結果引入DS融合算法,正確識別率達96.11%。基于光譜特征的雜草識別多為傳感器地面采集作物和雜草的光譜數據,篩選有效區分作物和雜草波段進行識別。潘冉冉等[14]利用高光譜成像系統室內采集油菜及多種雜草的高光譜圖像,通過對比多種光譜預處理方法及多種分類模型,發現通過主成分載荷、載荷系數法及連續投影法作為特征波長提取方法,極限學習機模型所得分類精度最高。王海華等[15]通過無人機獲取麥田可見光影像,利用剪切波變換獲取小麥與雜草的剪切波系數,根據小麥與雜草剪切波系數的特征差異,對雜草進行識別,準確率為69.2%。肖武等[16]通過無人機獲取采煤沉陷濕地多光譜影像,構建面向對象分類方法,對濕地植被進行分類,總體精度達84.2%。【本研究切入點】目前對作物與雜草的識別研究多在實驗室條件下或田間地面采集作物、雜草葉片進行分類,數據采集覆蓋范圍較小,工作強度大,且無法從整個大田區域及植物冠層尺度對作物和雜草進行分類。無人機遙感可快速高效獲取目標區域內植被冠層影像,監測范圍廣,能夠一次性采集大面積田塊及植被數據,節省時間。但無人機遙感獲取的影像相對于地面遙感獲取的圖像數據分辨率低,如何提高無人機遙感影像的識別分類精度是需要解決的一個問題。【擬解決的關鍵問題】本文以無人機獲取的玉米地塊尺度的多光譜影像中玉米和雜草為研究對象,采用最大類間方差法去除圖像非植被像元,提取玉米及雜草冠層的植被指數、紋理和反射率等多種特征,采用監督分類模型對試驗區域內玉米和雜草進行像元級語義識別,以期得到利用無人機遙感平臺獲取區域冠層尺度下玉米和雜草識別的最佳特征及模型,為快速獲取田間玉米和雜草分布,確定植保機械雜草施藥量提供參考。

1 材料與方法

1.1 研究區域概況

試驗地點為山東理工大學農業工程與食品科學學院試驗田,位于山東省淄博市南定鎮(36°44′36″N,118°3′23″E),該區域地處暖溫帶,屬溫帶季風氣候,多年平均降水量650 mm,年平均氣溫12.5℃—14.2℃,年平均日照時長達2 209.3—2 523.0 h,年平均無霜期190—210 d。試驗田總面積約為6 000 m2,研究區域總面積約為2 500m2。試驗田內主要種植作物為玉米,種植時間為2018年6月中旬,采用山東理工大學2BMFS3-240K振動深松分層施肥精播機進行播種,行距70 cm,株距20 cm。雜草種類主要為狗尾草、三葉草和稗草。

1.2 數據獲取

圖像數據采集時間為試驗田玉米播種后一個月,于2018年7月14日進行。無人機平臺采用南京禾譜航空科技有限公司HP6900六旋翼無人機,該機軸距900 mm,起落架尺寸460 mm(長)×450 mm(下底寬)×360 mm(高)、續航時間20 min,最大起飛質量8.2 kg,通訊距離5 km。利用Red Edge-M多光譜相機獲取圖像數據,該傳感器包含藍光、綠光、紅光、紅邊、近紅外5個通道,圖像分辨率1 280×960,拍攝圖像存儲于相機內部SD卡。圖像采集時段為正午11:00—13:00,天氣晴朗,地面無風,滿足無人機平臺飛行要求。試驗設計飛行高度為30 m,航線12條,飛行速度3 m·s-1,航線總長1.045 km,航向重疊度85%,旁向重疊度85%,采用垂直方式采集圖像,獲得5個單通道圖像共計2 630幅。

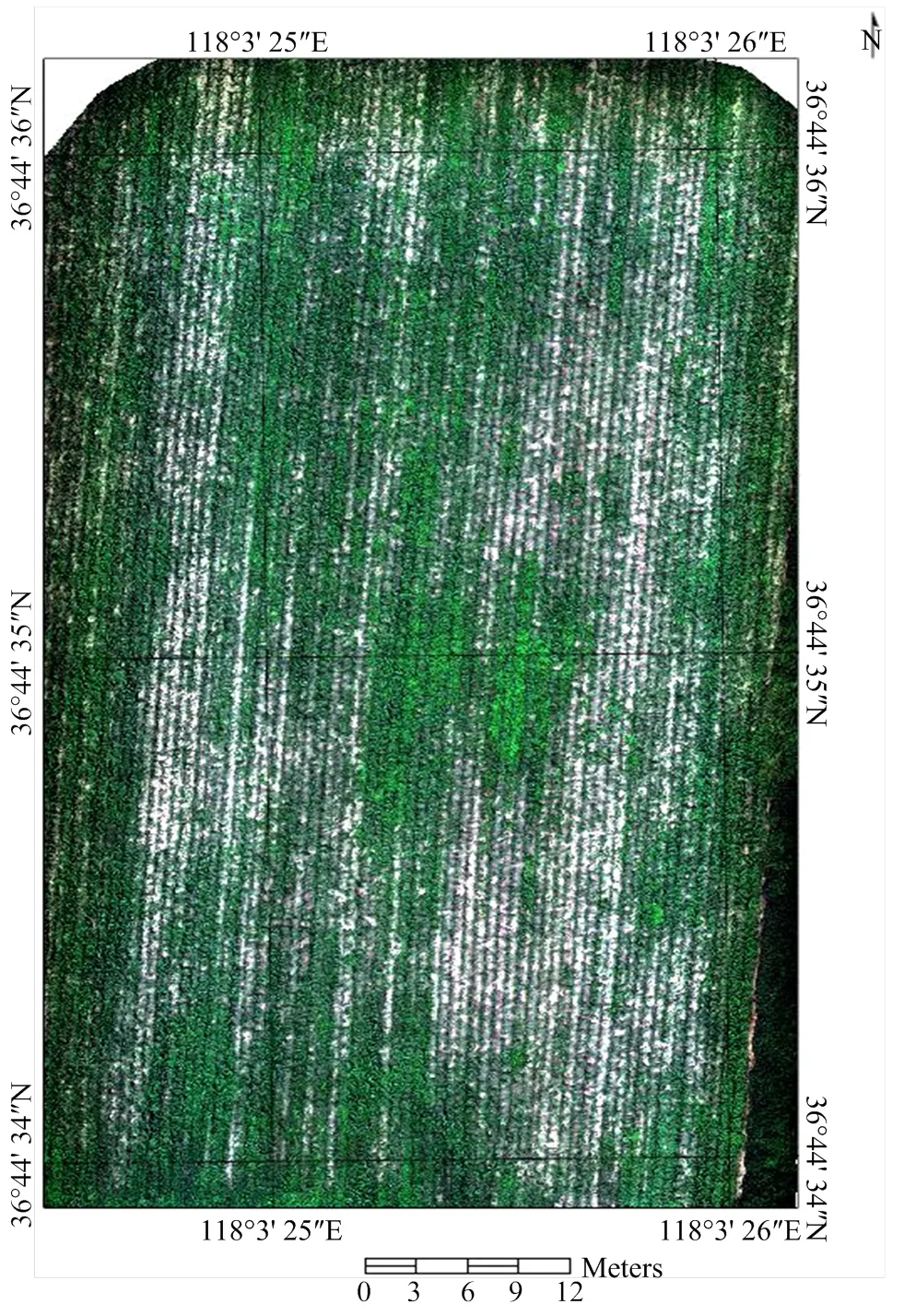

試驗區拍攝圖像通過Pix4Dmapper軟件進行校正和拼接等預處理操作,首先對單幅圖像進行輻射校正和幾何校正,然后根據飛行POS數據尋找同名點,通過空三測量計算原始影像生成點云模型,最后添加紋理得到藍、綠、紅、紅邊、近紅外5幅單波段圖像。使用ENVI軟件Layer Stacking功能將5幅單波段圖像融合為多光譜圖像,如圖1所示。

1.3 研究方案

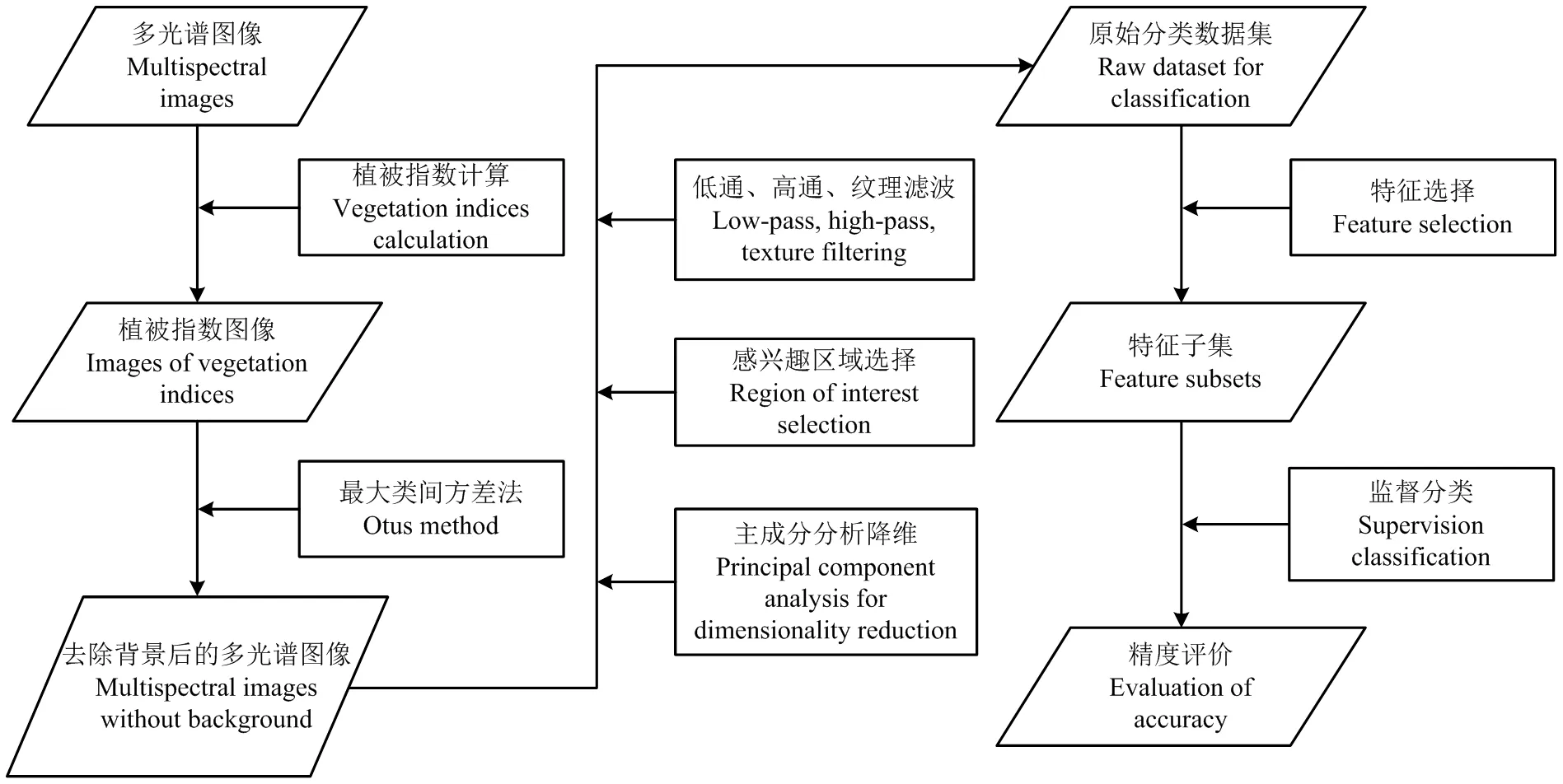

本試驗以大田玉米多光譜圖像為研究對象,首先計算多光譜圖像的植被指數,使用最大類間方差法獲得分離裸土與植被(玉米與雜草)像元的閾值,實現圖像背景像元去除;其次,應用主成分分析算法(PCA)對多波段圖像進行降維,提取感興趣區域內玉米及雜草的植被指數、紋理特征和反射率作為雜草識別特征,利用特征選擇方法創建數據集的子集;最后,將數據集分為訓練集和測試集,訓練并測試多種監督分類模型,選取分類精度最高的監督分類器及特征選擇方法,對驗證區域進行玉米雜草識別。技術路線如圖2所示。

圖1 試驗區域多光譜圖像

1.4 裸土陰影像元去除

通過對多光譜圖像中的藍、綠、紅波段組成的RGB圖像分析發現,圖像中的主要植被為玉米和雜草,非植被主要為裸土及玉米葉片遮擋所產生的的陰影。由于植被與非植被色彩差異明顯,因此可從多光譜圖像中去除非植被背景像元,從而提高雜草識別的效率并節省運行時間。

最大類間方差法(Otsu)是一種基于圖像灰度直方圖的閾值選擇方法[17],它將圖像像元分為2類,若圖像中背景和目標之間的差異增大,則2類圖像像元間的差異也會增大。因此,使圖像像元類間方差最大化的閾值即為分割圖像的最佳閾值。

植被指數是某些特定波長反射率的組合,是對植物葉片色素和營養狀況的響應[18]。由于不同植物反射率存在差異,其植被指數值也各異。本文選擇了NDVI、DVI、RVI、SAVI、OSAVI、GNDVI和EVI等7種常見的植被指數[19-26],通過ENVI軟件Band Math功能生成植被指數灰度圖像。采用Otsu算法對7種植被指數圖像進行非植被像元提取,發現差值植被指數(DVI)圖像的植被與非植被地物分離效果最好,因此提取DVI圖像的非植被區域制作掩膜文件,對多光譜圖像進行掩膜,實現植被與非植被像元的圖像分割。

圖2 技術路線

為了有效去除多光譜圖像各波段間冗余信息,降低波段間相關性,將有效信息集中到較少的轉換波段中,最大限度地表征原始數據信息[27-29],故本試驗采用主成分分析法(principal component analysis,PCA)對多光譜數據進行降維,消除多光譜數據中的冗余信息。

變換后的多波段圖像有5個主成分,其信息量分別為80.42%、13.93%、5.00%、0.48%和0.17%。因前3個主成分累加為99.35%,故僅保留信息量最多的前3個主成分,舍棄其余2個主成分。

1.5 玉米及雜草特征參數提取

玉米和雜草之間沒有明顯的顏色差異,僅使用植被指數很難對玉米與雜草分類識別,有必要使用多種特征對其分類。部分雜草未能在偽彩色圖像中與玉米葉片顯示出色彩差異,且雜草像元與玉米像元各主成分值相近,僅采用閾值法無法將玉米與雜草區分,因此選擇提取多光譜圖像中玉米和雜草的紋理特征和反射率進行分類。當前研究中常用的紋理分析方法為灰度共生矩陣法[30-34]。在實際應用中,多采用基于灰度共生矩陣計算出的統計量作為紋理識別的特征參數,本文選擇均值、方差、協同性、對比度、相異性、信息熵、二階矩、相關性等8項紋理特征參數進行分析。

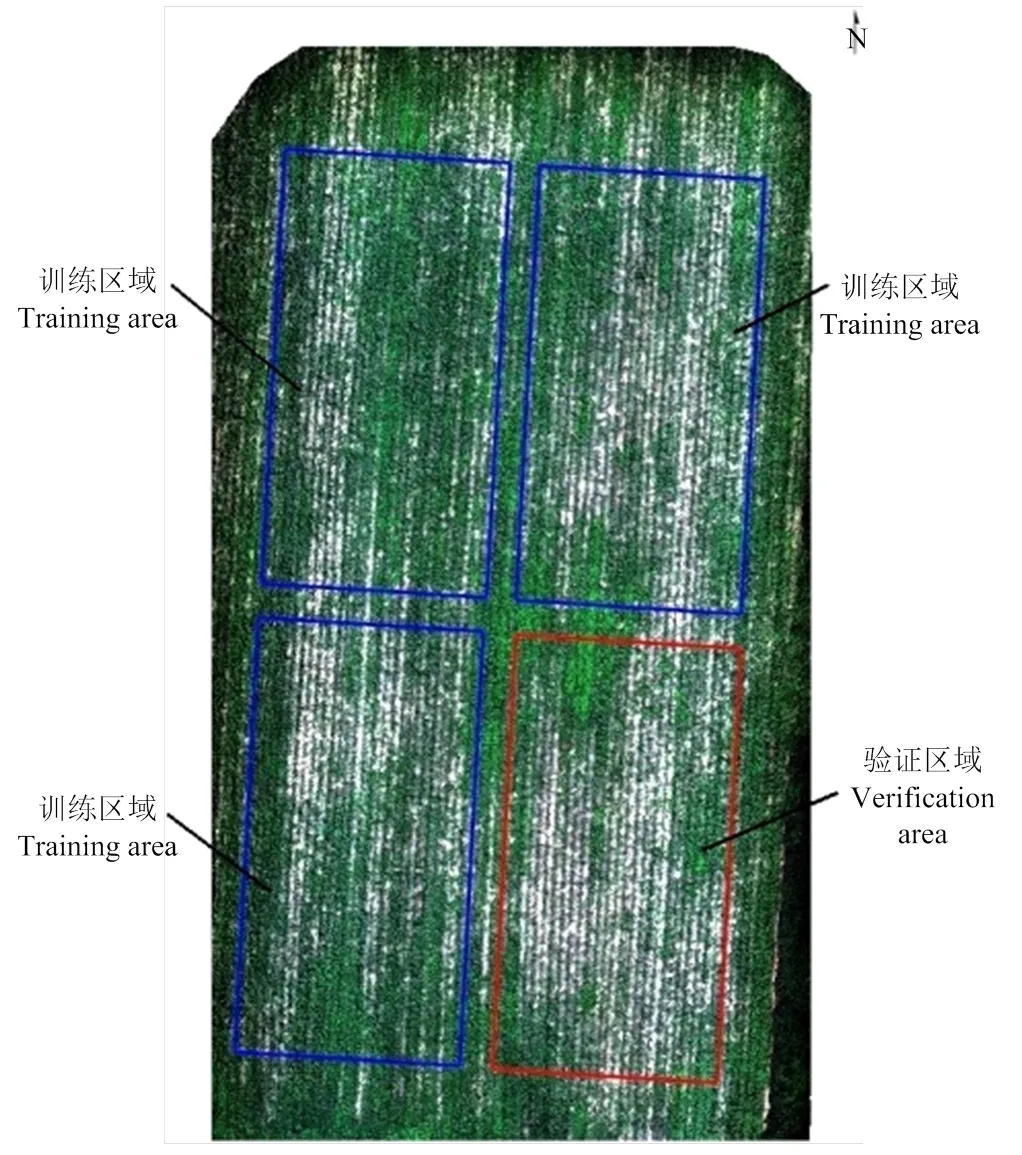

如圖3所示,試驗區被分為4個區域,驗證區域面積約為600 m2,3個監督分類訓練區域,每個區域面積為600 m2,總面積1 800 m2。由于圖像采集時的飛行高度為30 m,可人為在圖像中對玉米與雜草進行手動分類并選取感興趣區域(ROI)。通過人工選擇的方式,在每個訓練區域內選取225處玉米樣本感興趣區域,175處雜草樣本感興趣區域,考慮到特征統計的一般性,每個訓練區域內感興趣區域選擇盡可能均勻分布,為避免框選已掩膜區域,感興趣區域無特定形狀,僅確保每個感興趣區域包含100個像元。訓練區域共有675處玉米感興趣區域和525處雜草感興趣區域。

每處感興趣區域均被視為一個樣本。從玉米及雜草感興趣區域中提取的植被指數、紋理和反射率的統計量均值作為樣本特征。圖像經主成分分析變換后3個主成分波段的8種灰度共生矩陣統計量作為紋理特征,共計24個紋理特征。使用ENVI軟件的Convolutions功能對多光譜圖像各波段分別進行低通和高通濾波,獲得多光譜圖像5個波段的10個反射率。

將3個訓練區域共計1 200個樣本(包括675個玉米樣本和525個雜草樣本)作為原始數據集,每個樣本具有41項特征,包括植被指數(7)、紋理特征(24)和反射率(10)。將數據集以2﹕1的比例隨機分成訓練集和測試集。訓練集用于監督分類模型的訓練,包含450個玉米樣本和351個雜草樣本,由3個訓練區域各隨機提供的150個玉米樣本和117個雜草樣本組成。測試集由原始數據集剩余1/3樣本組成,即每個訓練區域余下的75個玉米樣本和58個雜草樣本,測試集用于分類器最優參數選擇。

圖3 訓練區域及驗證區域

1.6 特征選擇算法及監督分類模型選取

為了提高模型運算效率,減少數據集維度,本文選擇了2種特征選擇方法對原始數據集進行降維。

基于支持向量機的遞歸特征消除(SVM-RFE)是一種嵌入式特征選擇方法[27, 35-36]。其原理是在線性SVM分類器的訓練過程中對樣本特征進行選擇。在特征選擇之初,所有特征都參與線性SVM模型訓練,依據各特征對分類的貢獻度,舍棄貢獻最少的特征,剩余特征重新訓練線性SVM分類器。SVM分類器的訓練與特征移除不斷迭代,直至剩余特征數量達到用戶預設值。

為了與SVM-RFE算法進行比較,選擇了一種過濾式特征選擇方法Relief算法對原始數據集降維[27, 37]。Relief算法主要用于二類問題的特征選擇,使用與初始特征對應成分的相關統計量來衡量特征的重要性,對應成分較大者的特征將在分類中起重要作用。

通過交叉驗證獲得SVM-RFE算法訓練線性SVM模型的最佳特征數量為14,將具有該14項特征的數據集稱為SVM-RFE子集(第一主成分均值、方差、協同性、相異性、二階矩、相關性、第二主成分均值、信息熵、相關性、第三主成分均值、差值植被指數、比值植被指數、增強型植被指數、紅邊高通反射率)。使用Relief算法對所有特征按對應成分大小進行排序,選取前14項特征組成Relief特征子集(第一主成分協同性、信息熵、相關性、第二主成分均值、信息熵、相關性、第三主成分均值、方差、相關性、藍色低通反射率、綠色低通反射率、紅邊低通反射率、藍色高通反射率、紅邊高通反射率)。

使用5種監督分類模型對原始數據集及特征子集進行分類。監督分類模型分別為支持向量機(SVM),K-最近鄰(KNN),Cart決策樹(Cart),隨機森林(RF)及人工神經網絡(ANN)。在分類前對數據集進行歸一化處理,應用10折交叉驗證法對模型進行訓練。5種監督分類器的訓練及測試由python編程實現。

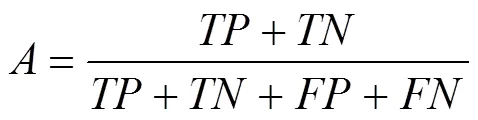

1.7 精度評價

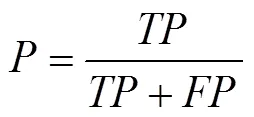

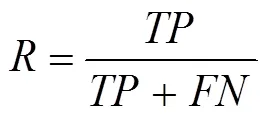

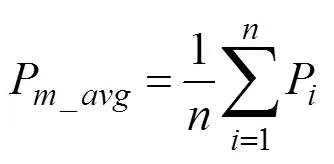

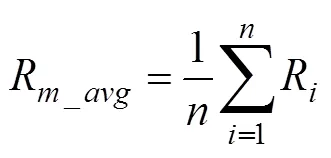

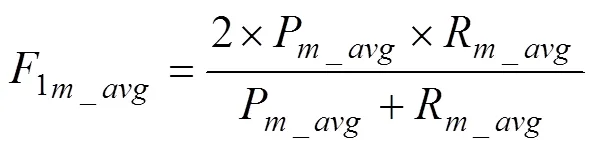

對5種監督分類模型進行精度評價,采用準確率()、精確率()、召回率()、1值4個指標作為精度評價指標[38],準確率為正確預測的數量占樣本總數的比值,精確率為真正例占所有預測正例樣本之比,召回率表示預測正例占所有正例樣本之比,1值為精確率與召回率的調和平均值。

式中,為真正例;為假反例;為假正例;為真反例。使用宏平均值綜合考察準確率與召回率。

式中,P為平均精確率;R為平均召回率;1m為平均1值;為交叉驗證次數;P為第次驗證精確率;R為第次驗證召回率。

2 結果

分別采用原始數據集、SVM-RFE特征子集、Relief特征子集對5種監督分類模型進行訓練與優化,并通過玉米雜草分類結果分析不同監督分類模型及特征選擇方法間的差異。

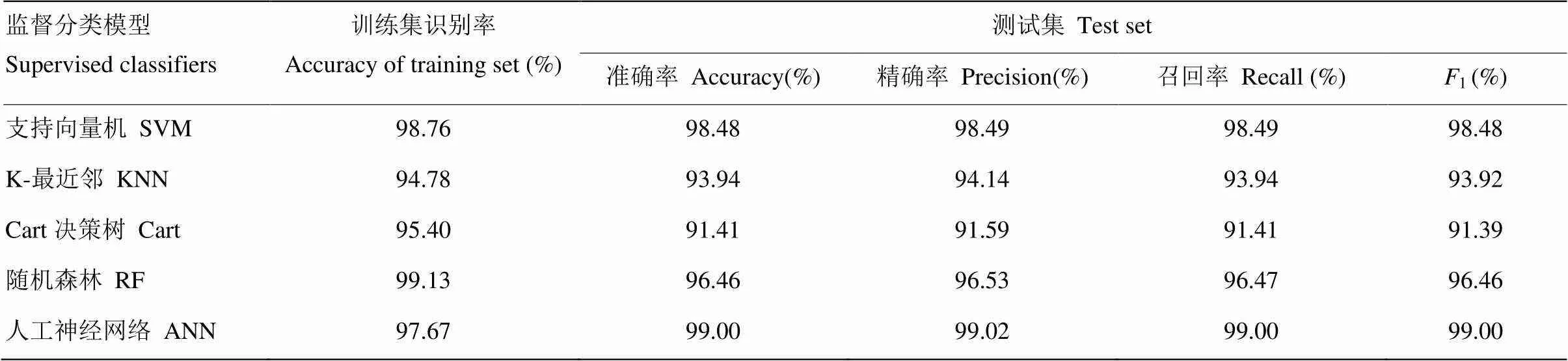

2.1 原始數據集分類結果分析

原始數據集分類結果如表2所示。在5種監督分類模型中,ANN模型測試集分類準確率最高,達99.0%;其次為SVM模型,準確率達98.48%,兩者準確率差異較小;Cart模型準確率最低,僅為91.41%。由多個Cart模型集合而成的RF模型分類準確率為96.46%,優于單個Cart模型表現。5種監督分類模型測試集準確度及精確度均高于90%,對紋理、植被指數和反射率特征構成的數據集分類效果良好。

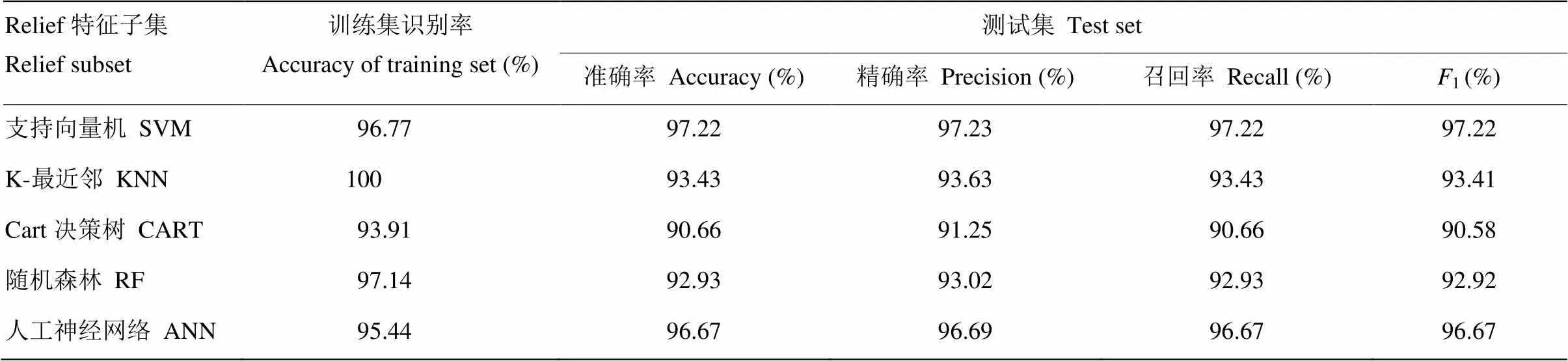

2.2 特征子集分類結果分析

分別采用Relief特征子集與SVM-RFE特征子集對5種監督分類模型進行訓練及測試,分類結果如表3和表4所示。與原始數據集分類結果相比較,監督分類模型對Relief特征子集的分類效果有所下降,測試集準確率平均下降1.68%。原始數據集中分類效果較好的3種模型準確率下降幅度均超過1.2%,而分類效果較差的KNN及Cart模型,準確率變化幅度在0.75%以內。在Relief特征子集對測試集的分類結果中,SVM模型的準確率最高,達97.22%;ANN模型精確度略低于SVM,為96.67%;RF模型準確率下降幅度最大,相對于原始數據集結果下降了3.53%,僅為92.93%。

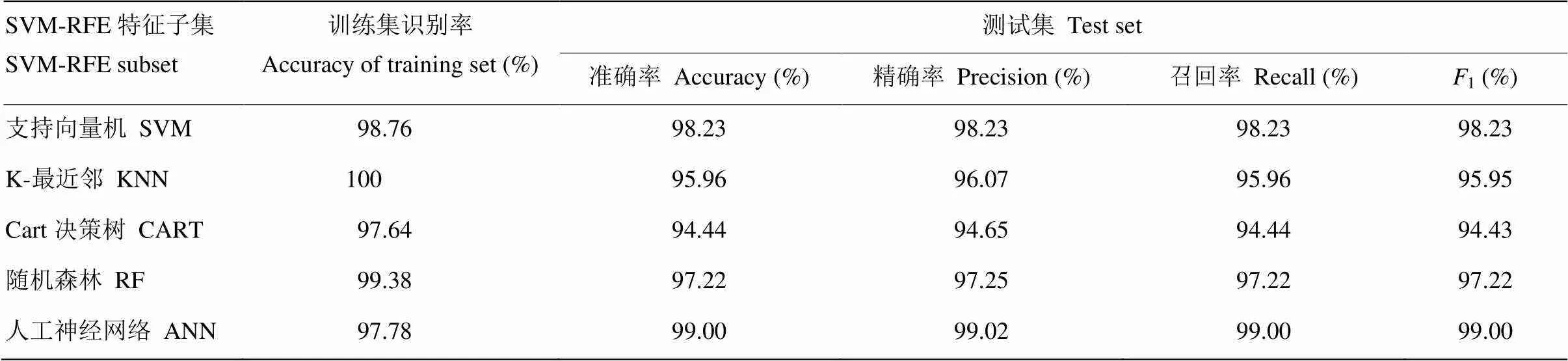

在SVM-RFE特征子集的分類結果中,ANN與SVM測試集分類精度相對于原始數據集結果變化極小,ANN具有最高的準確率,為99.0%;SVM準確率僅下降0.26%,為98.23%。相較原始數據集結果,RF、KNN與Cart模型準確率提升,其中KNN、Cart模型準確率分別提高2.02%、3.03%。KNN模型在Relief、SVM-RFE特征子集的分類結果中,訓練集準確率均為100%,而測試集準確率分別為93.43%和95.96%,存在過擬合現象。

表2 原始數據集分類結果

表3 Relief特征子集分類結果

表4 SVM-RFE特征子集分類結果

對比原始數據集、Relief特征子集與SVM-RFE特征子集的分類結果可以發現,各模型精確率、召回率及1值的高低分布與其準確率一致,且相同模型同一數據集的精確率與召回率差異較小,根據公式(2)、(3)可知,模型對玉米(真正例)識別效果較好,錯誤識別結果(假正例、假反例)較少。監督分類模型對SVM-RFE特征子集的分類效果優于Relief特征子集。SVM-RFE特征子集中,ANN與SVM模型的準確率與原始數據集相近,且RF、KNN與Cart模型準確率有所提升。

2.3 監督分類模型識別精度驗證

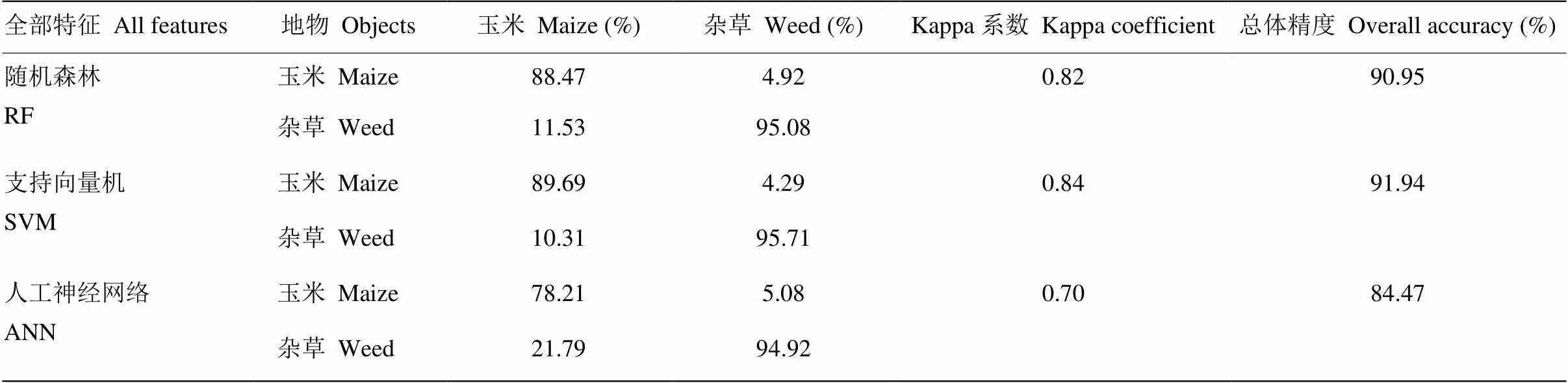

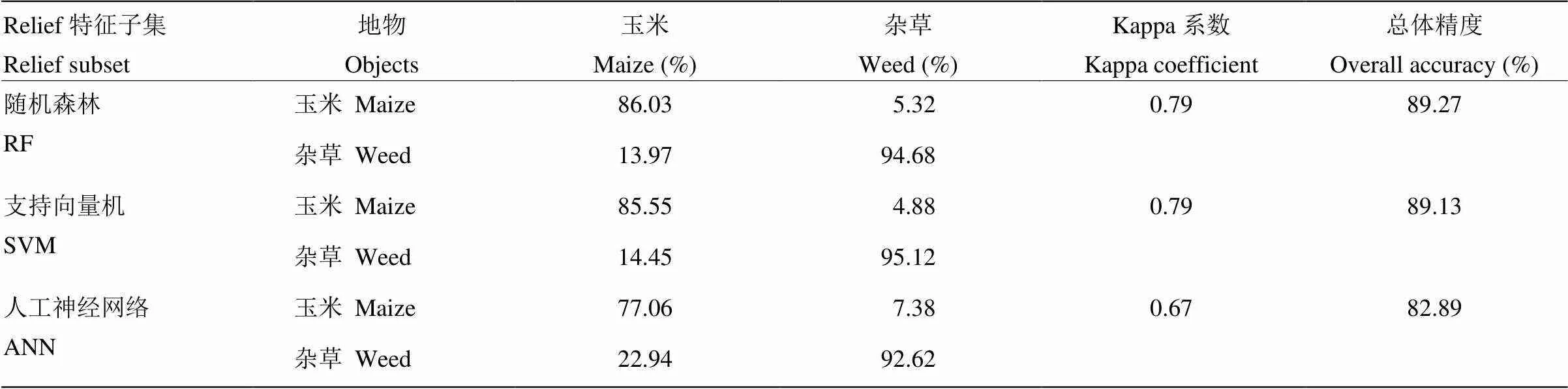

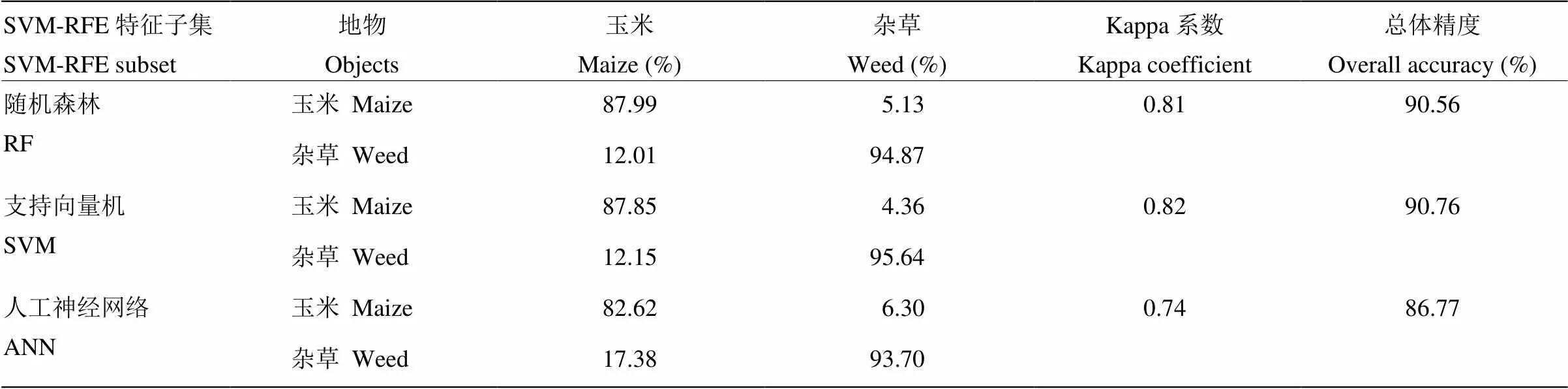

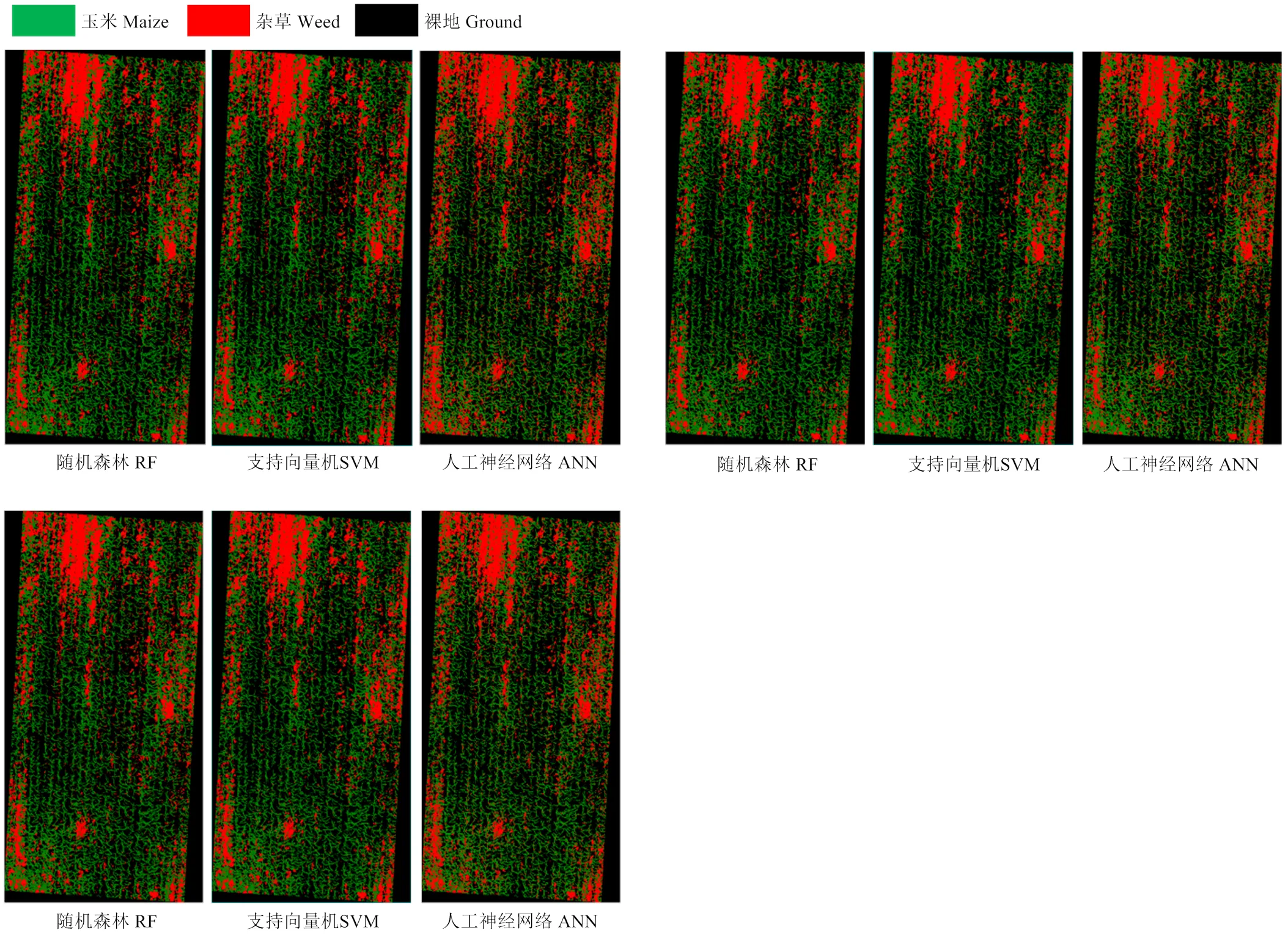

分別利用對測試集分類準確率較高的SVM、RF、ANN 3種模型,對圖3驗證區域采用全部特征、Relief特征子集、SVM-RFE特征子集進行雜草識別,驗證各模型分類精度,玉米雜草分類結果圖4所示。根據監督分類結果與驗證區域內人工標記的240處玉米樣本及160處雜草樣本計算混淆矩陣,結果如表5—7所示。

比較不同特征集分類結果總體精度可以看出,使用全部41項特征的監督分類總體精度最高,僅使用14項特征的Relief及SVM-RFE特征子集分類總體精度略有下降。在全部特征的分類結果中,SVM模型的總體精度最高,達91.94%,Kappa系數為0.84;Relief特征子集的分類結果中,RF模型的總體精度最高,達89.27%,Kappa系數為0.79;SVM-RFE特征子集的分類結果中,SVM模型的總體精度最高,達90.76%,Kappa系數為0.82;在3種不同特征集分類結果中,RF與SVM模型的總體精度相近,相差1%以內。ANN模型總體精度較差,與其他2種模型精度差異明顯。

表5 驗證區域使用全部特征混淆矩陣

表6 驗證區域使用Relief特征子集混淆矩陣

表7 驗證區域使用SVM-RFE特征子集混淆矩陣

a. 驗證區全部特征RF、SVM、ANN分類結果;b. 驗證區Relief特征子集RF、SVM、ANN分類結果;c. 驗證區SVM—RFE特征子集RF、SVM、ANN分類結果

在驗證區域的玉米雜草分類結果中,SVM、RF、ANN 3種模型對SVM-RFE特征子集的總體精度高于Relief特征子集總體精度,與測試集結論一致。2種特征子集的總體精度相較全部特征都有所下降,但精度降低幅度較小,且SVM-RFE特征子集比Relief特征子集總體精度降低變化更小。結果表明,SVM-RFE算法與Relief算法相比可以更有效地降低原始數據集維度及消除冗余特征。

3 討論

雜草識別研究多以地面傳感器采集的作物、雜草作為研究對象,近距離獲取高分辨率目標影像且背景干擾較小,故識別率整體較高。無人機獲取的遙感影像覆蓋范圍大,但單株作物冠層分辨率較低,受背景像元影響較大,故相較地面雜草研究識別率有所下降。本文基于無人機多光譜遙感,通過多種特征提取及數據降維,對比不同的分類模型及降維算法,得到了能夠快速準確識別田間雜草的分類模型及有效的降維算法。該研究對快速獲取作物田間雜草分布,指導植保機械施藥區域及施藥量的計算具有一定的參考價值,但由于農田環境的多樣與復雜,所選監督分類算法數量有限,還存在一些待改進之處。本試驗在評價監督分類模型對驗證區域的分類結果時,使用均勻分布于驗證區域各處人工標記的玉米、雜草感興趣區域,嘗試僅使用部分地面真值對模型分類效果進行可靠評價,針對樣本數量對分類效果評價的影響,將在下一步試驗中加以探究。

玉米與雜草在播種前期株高差異較小,但后期二者株高差異明顯,因此可以根據田間多時相的圖像結合植被三維空間信息,將不同時期相同位置植被高度差值作為特征用于雜草識別,并根據多時相圖像得到識別玉米田間雜草的最佳時期。本文僅對玉米、雜草進行識別區分,未對雜草進行具體種類區分,在下一步的研究中,可選擇非監督分類方法對雜草樣本進行聚類分析,結合實地調查獲取雜草品種,對聚類方法進行精度評價。

4 結論

(1)利用無人機遙感獲取的玉米田間多光譜圖像,其差值植被指數圖像可通過最大類間方差法提取非植被區域,從而實現圖像中植被與非植被像元的分割。

(2)SVM-RFE 特征選擇算法對原始特征降維效果優于Relief特征算法,所選擇的特征子集分類結果相對于原始特征分類結果總體精度下降幅度較小。

(3)隨機森林、支持向量機模型能夠有效地對玉米和雜草進行識別,總體精度最高可達90.95%和91.94%,Kappa系數可達0.8以上,支持向量機模型總體分類效果最好。

[1] 翁凌云. 我國玉米生產現狀及發展對策分析. 中國食物與營養, 2010(1): 22-25.

WENG L Y. Status of corn production in China and its countermeasures., 2010(1): 22-25. (in Chinese)

[2] Louargant M, Villette S, Jones G, Vigneau N, Paoli J, Gée C. Weed detection by UAV: simulation of the impact of spectral mixing in multispectral images., 2017, 18: 932-951.

[3] 山東省農業農村廳. 山東省到2020年農藥使用量零增長行動方案. 山東農藥信息, 2015(4): 13-14.

Shandong Provincial Department of Agricultural and Rural Affairs. Shandong province issued the action plan for zero increase of pesticide use in Shandong province by 2020., 2015(4): 13-14. (in Chinese)

[4] 周志艷, 明銳, 臧禹, 何新剛, 羅錫文, 蘭玉彬. 中國農業航空發展現狀及對策建議. 農業工程學報, 2017, 33(20): 1-13.

ZHOU Z Y, MING R, ZANG Y, He X G, LUO X W, LAN Y B. Development status and countermeasures of agricultural aviation in China., 2017, 33(20): 1-13. (in Chinese)

[5] 蘭玉彬. 精準農業航空技術現狀及未來展望. 農業工程技術, 2017, 37(30): 27-30.

LAN Y B. Current status and future prospects of precision agricultural aviation technology., 2017, 37(30): 27-30. (in Chinese)

[6] 何東健, 何勇, 李明贊, 洪添勝, 王成紅, 宋蘇, 劉允剛. 精準農業中信息相關科學問題研究進展. 中國科學基金, 2011, 25(1): 10-16.

HE D J, HE Y, LI M Z, HONG T S, WANG C H, SONG S, LIU Y G. Research progress of information science-related problems in precision agriculture., 2011, 25(1): 10-16. (in Chinese)

[7] 蘭玉彬, 王國賓. 中國植保無人機的行業發展概況和發展前景. 農業工程技術, 2018, 38(9): 17-27.

LAN Y B, WANG G B. China's plant protection drone industry development overview and development prospects., 2018, 38(9): 17-27. (in Chinese)

[8] 史舟, 梁宗正, 楊媛媛, 郭燕. 農業遙感研究現狀與展望. 農業機械學報, 2015, 46(2): 247-260.

SHI Z, LIANG Z Z, YANG Y Y, GUO Y. Status and prospect of agricultural remote sensing., 2015, 46(2): 247-260. (in Chinese)

[9] 金小俊, 陳勇, 孫艷霞. 農田雜草識別方法研究進展. 農機化研究, 2011, 33(7): 23-27.

JIN X J, CHEN Y, SUN Y X. Research advances of weed identification in agricultural fields., 2011, 33(7): 23-27. (in Chinese)

[10] 毛文華, 張銀橋, 王輝, 趙博, 張小超. 雜草信息實時獲取技術與設備研究進展. 農業機械學報, 2013, 44(1): 190-195.

MAO W H, ZHANG Y Q, Wang H, ZHAO B, ZHANG X C. Advance techniques and equipments for real-time weed detection., 2013, 44(1): 190-195. (in Chinese)

[11] 鄧向武, 齊龍, 馬旭, 蔣郁, 陳學深, 劉云海, 陳偉烽. 基于多特征融合和深度置信網絡的稻田苗期雜草識別. 農業工程學報, 2018, 34(14): 165-172.

DENG X W, QI L, MA X, JIANG Y, CHEN X S, LIU Y H,CHEN W F. Recognition of weeds at seedling stage in paddy fields using multi-feature fusion and deep belief networks., 2018, 34(14): 165-172. (in Chinese)

[12] 孫俊, 何小飛, 譚文軍, 武小紅, 沈繼峰, 路虎. 空洞卷積結合全局池化的卷積神經網絡識別作物幼苗與雜草. 農業工程學報, 2018, 34(11): 159-165.

SUN J, HE X F, TAN W J, WU X H, SHEN J F, LU H. Recognition of crop seedling and weed recognition based on dilated convolution and global pooling in CNN., 2018, 34(11): 159-165. (in Chinese)

[13] 何東健, 喬永亮, 李攀, 高瞻, 李海洋, 唐晶磊. 基于SVM-DS多特征融合的雜草識別. 農業機械學報, 2013, 44(2): 182-187.

HE D J, QIAO Y L, LI P, GAO Z, LI H Y, TANG J L. Weed recognition based on SVM-DS multi-feature fusion., 2013, 44(2): 182-187. (in Chinese)

[14] 潘冉冉, 駱一凡, 王昌, 張初, 何勇, 馮雷. 高光譜成像的油菜和雜草分類方法. 光譜學與光譜分析, 2017, 37(11): 3567-3572.

PAN R R, LUO Y F, WANG C, ZHANG C, HE Y, FENG L. Classifications of oilseed rape and weeds based on hyperspectral imaging., 2017, 37(11): 3567-3572. (in Chinese)

[15] 王海華, 朱夢婷, 李莉, 王麗燕, 趙海英, 梅樹立. 基于剪切波變換和無人機麥田圖像的區域雜草識別方法. 農業工程學報, 2017, 33(S1): 99-106.

WANG H H, ZHU M T, LI L, WANG L Y, ZHAO H Y, MEI S L. Regional weed identification method from wheat field based on unmanned aerial vehicle image and shearlets., 2017, 33(S1): 99-106. (in Chinese)

[16] 肖武, 任河, 呂雪嬌, 閆皓月, 孫詩睿. 基于無人機遙感的高潛水位采煤沉陷濕地植被分類. 農業機械學報, 2019, 50(2): 177-186.

XIAO W, REN H, Lü X J, YAN H Y, SUN S R. Vegetation classification by using UAV remote sensing in coal mining subsidence wetland with high ground-water level., 2019, 50(2): 177-186. (in Chinese)

[17] NOBUYUKI O. A threshold selection method from gray-level histograms., 1979, 1(1): 62-66.

[18] 孫濱峰, 趙紅, 陳立才, 舒時富, 葉春, 李艷大. 基于植被指數選擇算法和決策樹的生態系統識別. 農業機械學報, 2019, 50(6): 194-200.

SUN B F, ZHAO H, CHEN L C, SHU S F, YE C, LI Y D. Identification of ecosystems based on vegetation indices selection algorithm and decision tree., 2019, 50(6): 194-200. (in Chinese)

[19] 劉暢, 楊貴軍, 李振海, 湯伏全, 王健雯, 張春蘭, 張麗妍. 融合無人機光譜信息與紋理信息的冬小麥生物量估測. 中國農業科學, 2018, 51(16): 3060-3073.

LIU C, YANG G J, LI Z H, TANG F Q, WANG J W, ZHANG C L, ZHANG L Y. Biomass estimation in winter wheat by UAV spectral information and texture information fusion., 2018, 51(16): 3060-3073. (in Chinese)

[20] Rouse J W, Haas R W, Schell J A, Deering D W, Harlan J C. Monitoring the vernal advancement and retrogradation (Greenwave effect) of natural vegetation Final Rep. RSC 1978-4.Remote Sensing Center, Texas A&M UniversityCollege Station, 1974.

[21] Jordan C F. Derivation of leaf-area index from quality of light on the forest floor., 1969, 50: 663-666.

[22] Pearson R L, Miller L D. Remote mapping of standing crop biomass for estimation of the productivity of the short-grass prairie..Environmental Research Institute of MichiganAnn Arbor, MI, USA, 1972: 1357-1381.

[23] Huete A R. A soil-adjusted vegetation index (SAVI)., 1988, 25: 295-309.

[24] Rondeaux G, Steven M, Baret F. Optimization of soil- adjusted vegetation indices., 1996, 55: 95-107.

[25] Gitelson A A, Kaufman Y J, Merzlyak M N. Use of a green channel in remote sensing of global vegetation from EOS- MODIS., 1996, 58: 289-298.

[26] Huete A, Didan K, Miura T, Rodriguez E P, Gao X, Ferreira L G. Overview of the radiometric and biophysical performance of the MODIS vegetation indices., 2002, 83: 195-213.

[27] 周志華. 機器學習. 北京: 清華大學出版社, 2017.

ZHOU Z H.. Beijing: Tsinghua University Press, 2017. (in Chinese)

[28] 李慧, 祁力鈞, 張建華, 冀榮華. 基于PCA-SVM的棉花出苗期雜草類型識別. 農業機械學報, 2012, 43(9): 184-189, 196.

LI H, QI L J, ZHANG J H, JI R H. Recognition of weed during cotton emergence based on principal component analysis and support vector machine., 2012, 43(9): 184-189, 196. (in Chinese)

[29] 李俊秀, 姜三平. 基于主成分分析的圖像自適應閾值去噪算法. 紅外技術, 2014, 36(4): 311-314, 319.

LI J X, JIANG S P. Adaptive threshold image denoising algorithm based on principal component analysis., 2014, 36(4): 311-314, 319. (in Chinese)

[30] HARALICK R M, SHANMUGAM K. Textural features for image classification., 1973, 3(6): 610-621.

[31] 吳文涵, 陶華敏, 肖山竹,湯朋文. 灰度共生矩陣紋理特征提取算法的優化與實現. 數字技術與應用, 2015(6): 124-126.

WU W H, TAO H M, XIAO S Z, TANG P W. Optimization and implementation of texture feature extraction algorithm for gray level co-occurrence matrix., 2015(6): 124-126. (in Chinese)

[32] 韓文霆, 孫瑜, 徐騰飛, 陳香維, Su K O. 基于RGB圖像處理的玉米葉片含水率監測方法研究. 農業工程技術, 2016, 36(12): 75.

HAN W T, SUN Y, XU T F, CHEN X W, SU K O. Detecting maize leaf water status by using digital RGB images., 2016, 36(12): 75. (in Chinese)

[33] 侯群群, 王飛, 嚴麗. 基于灰度共生矩陣的彩色遙感圖像紋理特征提取. 國土資源遙感, 2013, 25(4): 26-32.

HOU Q Q, WANG F, YAN L. Extraction of color image texture feature based on gray-level co-occurrence matrix., 2013, 25(4): 26-32. (in Chinese)

[34] 韓文霆, 李廣, 苑夢嬋, 張立元, 師志強. 基于無人機遙感技術的玉米種植信息提取方法研究. 農業機械學報, 2017, 48(1): 139-147.

HAN W T, LI G, YUAN M C, ZHANG L Y, SHI Z Q. Extraction method of maize planting information based on UAV remote sensing technology., 2017, 48(1): 139-147. (in Chinese)

[35] 黃曉娟, 張莉. 改進的多類支持向量機遞歸特征消除在癌癥多分類中的應用. 計算機應用, 2015, 35(10): 2798-2802.

HUANG X J, ZHANG L. Modified multi-class support vector machine recursive feature elimination for cancer multi-classification., 2015, 35(10): 2798-2802. (in Chinese)

[36] 王君. 基于SVM-RFE的特征選擇方法研究[D]. 大連: 大連理工大學, 2015.

WANG J. The research of feature selection algorithm based on SVM- RFE[D]. Dalian: Dalian University of Technology, 2015. (in Chinese)

[37] 蔣玉嬌, 王曉丹, 王文軍, 畢凱. 一種基于PCA和ReliefF的特征選擇方法. 計算機工程與應用, 2010, 46(26): 170-172.

JIANG Y J, WANG X D, WANG W J, BI K. New feature selection approach by PCA and ReliefF., 2010, 46(26): 170-172. (in Chinese)

[38] 戴建國, 張國順, 郭鵬, 曾窕俊, 崔美娜, 薛金利. 基于無人機遙感可見光影像的北疆主要農作物分類方法. 農業工程學報, 2018, 34(18): 122-129.

DAI J G, ZHANG G S, GUO P, ZENG T J, CUI M N, XUE J L. Classification method of main crops in northern Xinjiang based on UAV visible waveband images., 2018, 34(18): 122-129. (in Chinese)

Weed Identification in Maize Field Based on Multi-Spectral emote Sensing of Unmanned Aerial Vehicle

ZHAO Jing1,2, LI ZhiMing1,2, LU LiQun2,3, JIA Peng1,2, YANG HuanBo1,2, LAN YuBin1,2

(1School of Agricultural Engineering and Food Science, Shandong University of Technology, Zibo 255000, Shandong;2International Research center of Precision Agriculture Aviation Application Technology, Shandong University of Technology, Zibo 255000, Shandong;3School of Transportation and Vehicle Engineering, Shandong University of Technology, Zibo 255000, Shandong)

【Objective】In order to reduce the application rate of herbicides and to make the maize planting management more effective, the accurate identification of weeds in maize fields was investigated based on multi-spectral remote sensing of unmanned aerial vehicles (UAV). 【Method】In this paper, a Red Edge-M multi-spectral camera was mounted in a six-rotor UAV to acquire five single-band images of blue, green, red, red edge, and near-infrared, and the application was taken in Zibo, Shandong province, China to acquire multi-spectral images of a maize field in July 14, 2018. In order to separate the vegetation and non-vegetation pixels in the image, 7 vegetation indices were calculated, the OTSU method was used to obtain the non-vegetation area, and the multi-spectral image was masked. Then multi-spectral image was transformed by principal component analysis, retaining the first three principal component bands with the most information. The experimental region was divided into 3 training areas and 1 verification area. 675 maize and 525 weed samples were selected in the training areas to train the supervised classification model, and 240 maize and 160 weed samples were selected in the verification area to evaluate model classification accuracy. The 7 vegetation indices, 24 texture features of the 3 principal component bands and 10 reflectivity of multi-spectral image bands which were filtered, and a total of 41 features were taken as features of maize and weed. Support vector machines-feature recursive elimination (SVM-RFE) algorithm and Relief algorithm were applied to selecting 14 features from 41 features to constitutes a feature subset separately, and supervised classification for weed detection was performed using support vector machine (SVM), K-nearest neighbor (KNN), Cart decision tree (Cart), random forest (RF) and artificial neural network (ANN) .【Result】SVM and RF performed a better classification with all features and SVM-RFE & Relief feature subsets. The overall accuracy of SVM was 89.13%-91.94%, Kappa>0.79, and overall accuracy of random forest was 89.27%-90.95%, Kappa>0.79.【Conclusion】SVM-RFE feature selection algorithm was better than the Relief feature algorithm for reducing the original features. SVM model had the highest classification accuracy for identification of weed and maize at regional canopy scales.

weed identification; UAV remote sensing; multi-spectral image; feature selection; supervised classification

2019-08-29;

2019-11-04

山東省引進頂尖人才“一事一議”專項經費資助項目、中央引導地方科技發展專項資金“精準農業航空技術與裝備研發”資助項目

趙靜,E-mail:zbceozj@163.com。通信作者蘭玉彬,E-mail:ylan@sdut.edu.cn

(責任編輯 楊鑫浩)