基于多特征圖像增強深度卷積神經(jīng)網(wǎng)絡的航天用電子元器件分類算法

蔡立明,李 威,高永發(fā),張文亮,張玉強

(1.北京航天控制儀器研究所, 北京 100039; 2.青島海洋科學與技術試點國家實驗室, 青島 266237; 3.航天物聯(lián)網(wǎng)技術有限公司, 北京 100094)

0 引言

航天用電子元器件在導彈、火箭等武器系統(tǒng)中具有極其重要的作用,電子元器件的自動分類關系到元器件生產過程中的應用與回收等環(huán)節(jié)[1]。因此,電子元器件自動分類系統(tǒng)在智能制造領域具有重要的地位。

目前,電子元器件自動分類系統(tǒng)中使用的算法主要包含兩種:1)基于圖像特征空間與變換域的元器件分類算法;2)基于機器學習的元器件分類算法。第一類算法將采集到的圖像進行簡單預處理,提取圖像的淺層特征,利用這些特征對圖像中的電子元器件進行分類。如杜思思等[2]提出利用Hough變換與最小二乘法相結合精確檢測電子元器件管腳直線段,鄭秀蓮等[3]提出利用顏色空間轉換、圖像分割和紋理特征對器件缺陷進行檢測。上述分類算法無法處理海量圖片,且檢測準確度依賴采集圖像的質量,無法實現(xiàn)對多種元器件的同時在位分類。第二類基于機器學習的元器件分類算法,如胡藝[4]提出的基于BP神經(jīng)網(wǎng)絡的電路板缺陷檢測算法,車尚岳[5]提出的基于SVM的電路板電阻元器件檢測算法。上述算法主要根據(jù)目標的淺層特征進行模型訓練,存在模型收斂速度慢、檢測結果易受圖像噪聲影響等缺點[4-6]。

目前,在圖像識別領域,機器學習算法-深度卷積神經(jīng)網(wǎng)絡得到了廣泛應用,并成為學術界與工業(yè)界的研究熱點[5-7]。深度卷積神經(jīng)網(wǎng)絡相對于傳統(tǒng)的分類方法具有識別準確率高、不受圖像畸變影響等優(yōu)點,深度卷積神經(jīng)網(wǎng)絡通過卷積層、池化層、全連接層等提取待測圖像的深度特征,并自動對海量圖像進行分類。但隨著神經(jīng)網(wǎng)絡層數(shù)的增加,神經(jīng)網(wǎng)絡的計算需要更多的資源,并且出現(xiàn)過擬合現(xiàn)象。因此,GoogleNet[8]提出利用模塊間級聯(lián)方式提取多尺度、多類型特征來提高算法的效率。這種系統(tǒng)類似于人類視覺系統(tǒng),能夠對形狀、方向和顏色特征進行深度挖掘,突出檢測物邊界信息,抑制背景雜波干擾,并通過結合局部、區(qū)域和總體三個層次特征提升物體檢測精度。基于上述研究,為了進一步提升檢測精度并減少網(wǎng)絡訓練存在的參數(shù),減少過擬合現(xiàn)象的出現(xiàn),本文提出了一種基于多特征圖像增強深度卷積神經(jīng)網(wǎng)絡(Multi-feature Image Enhanced Deep Convolution Neural Network,MFIE-DCNN)的航天用電子元器件分類算法。MFIE-DCNN算法創(chuàng)新點在于整合了多特征學習(Multi-feature Learning,MFL)和深度學習(Deep Learning,DL),用于提升算法的準確性與魯棒性。多特征學習的優(yōu)點在于剔除了光照不均造成的圖像干擾,突出原圖像中可分性較大的統(tǒng)計信息和待檢測元器件的邊緣紋理信息[9-11]。深度學習部分具備提取圖像表達特征子圖中的板載元器件建立監(jiān)督樣本庫的能力,用于訓練深度卷積神經(jīng)網(wǎng)絡,并創(chuàng)建分類模型。深度卷積神經(jīng)網(wǎng)絡的優(yōu)點在于防止淺層神經(jīng)網(wǎng)絡中過擬合現(xiàn)象的出現(xiàn),保證檢測結果的魯棒性[12]。將MFIE-DCNN、支持向量機(SVM)、基于稀疏自動編碼器的深度神經(jīng)網(wǎng)絡(SAE-DNN)及隨機森林算法(RF)的總體分類精度(OA)和Kappa系數(shù)進行比較,證明所提出算法的分類效果優(yōu)于上述對比算法。

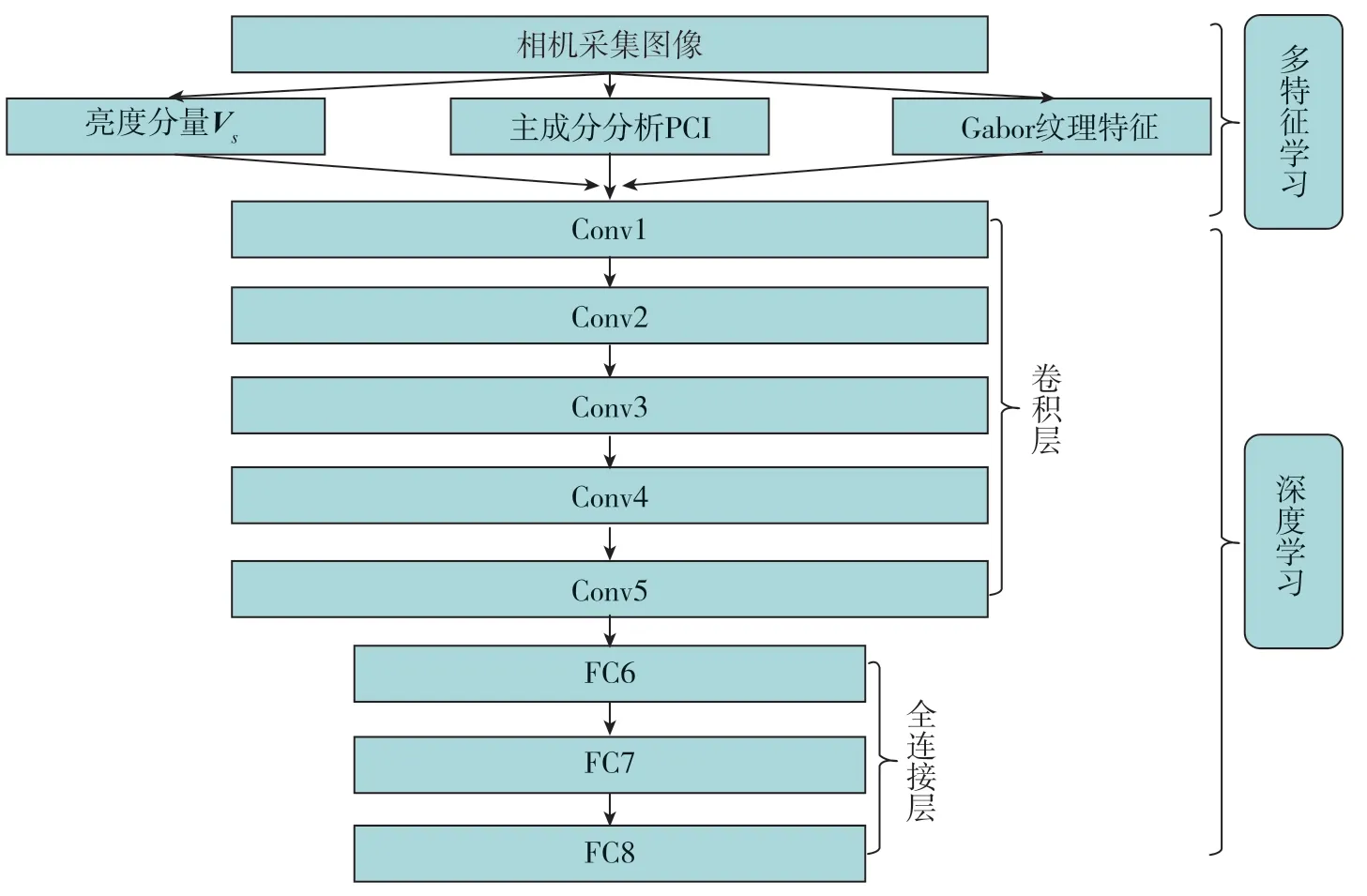

1 算法簡介

MFIE-DCNN算法包含兩個部分:多特征學習與深度學習,如圖1所示。多特征學習包含如下步驟:1)將電路板板載元器件的RGB圖像映射到HSV圖像空間,利用同態(tài)濾波得到增強亮度分量Vs,用于剔除光照不均造成的圖像干擾;2)利用主成分分析(Principal Component Analysis)提取RGB圖像的第一主成分信息(PC1),用于突出原圖像中可分性較大的統(tǒng)計信息;3)提取PC1的Gabor紋理特征(Gabor-texture,Gt),用于突出圖像中元器件的紋理信息。利用Vs、PC1和Gt構建圖像表達特征子圖。深度學習采用類VGG-16網(wǎng)絡,網(wǎng)絡包含八個層。其中,前五層為卷積層,卷積層結構為Convolution+Pool+ReLU;后三層為全連接層,利用Softmax輸出5類(電阻、兩類電容、兩類芯片)。

1.1 多特征學習

1)獲取亮度分量V:在RGB顏色空間中,圖像的亮度和飽和度無法有效分離,對圖像RGB三通道分別進行增強容易導致圖像色度失真。HSV空間能夠有效分離圖像的亮度、色度及飽和度,并將圖像的亮度、色度及飽和度映射到近似正交的空間中,通過調整HSV空間的亮度分量,對圖像進行增強[9]。

圖1 MFIE-DCNN結構圖Fig.1 Structure diagram of MFIE-DCNN

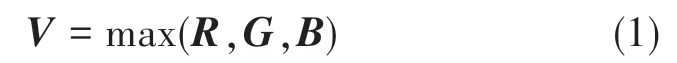

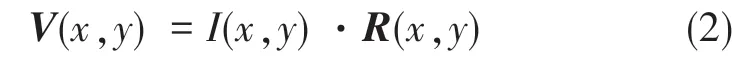

HSV空間中,亮度分量由V表示

式(1)中,RGB為圖像中每個像素的(R,G,B)通道的值。獲得亮度分量V后,利用同態(tài)濾波器處理V波段得到增強后的圖像Vs,同態(tài)濾波的作用為增強圖像暗區(qū)細節(jié)并保留亮區(qū)細節(jié)[9]。圖像V(x,y)可以被表示為

式(2)中,I(x,y)為照射強度,R(x,y)為反射強度。通常情況下,照射強度是均勻漸變的,故I為低頻分量;不同物體對光照的反射率是不同的,故R通常為高頻分量。將V(x,y)取對數(shù)進行同態(tài)變換,映射到空間域用于分離照射強度I(x,y)和反射強度R(x,y),具體步驟如式(3)和式(4)所示。

利用低通濾波器LPF濾除lnI(x,y)

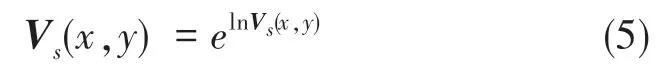

用lnV(x,y)減去低通濾波后的圖像lnIl(x,y),得到高頻增強圖像lnVs(x,y)。對lnVs(x,y)進行e指數(shù)運算

2)主成分分析主要用于凸顯圖像波段各成分之間的最大差異,利用正交變換將原圖像中的隨機分量映射到不相關的分量中[13]。

式(6)中,pi為第i個波段的主成分。

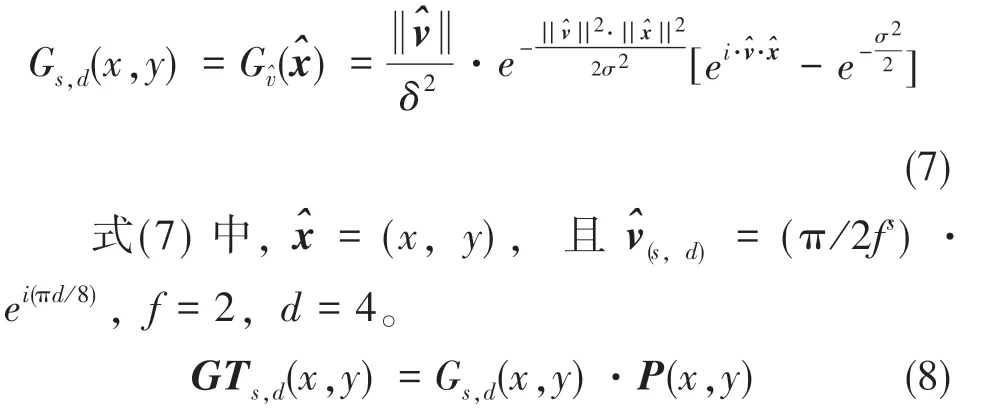

3)Gabor濾波器工作過程與人眼的視覺處理過程相近,具備提取圖像紋理特征的能力[14]。Gabor濾波函數(shù)如下

最終,利用Vs(x,y)、P(x,y)和GTs,d(x,y)構成圖像表達特征子圖。

1.2 深度卷積神經(jīng)網(wǎng)絡

卷積神經(jīng)網(wǎng)絡(CNN)作為一種具備多層結構的前饋神經(jīng)網(wǎng)絡,通常包含輸入層、卷積層、池化層、全連接層及輸出層。卷積層中的卷積核作為卷積神經(jīng)網(wǎng)絡的核心,用于提取圖像的平移不變特征。不同的卷積核提取不同的特征,所提取的特征通常包含邊緣、顏色和形狀[6,8,12]。

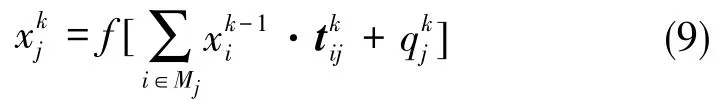

卷積神經(jīng)網(wǎng)絡處理過程如下:將輸入圖像數(shù)據(jù)與卷積核進行卷積,然后利用激活函數(shù)提取待測圖像的特征圖像,表達式如下

式(9)中,f[·]為ReLU激活函數(shù),為卷積核矩陣,為特征偏置,為k-1層輸入的特征或圖像數(shù)據(jù),為進行卷積運算和激活函數(shù)計算后的特征圖。

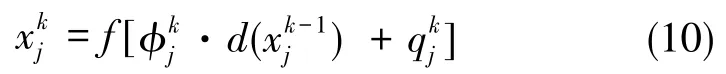

池化(Pooling)也叫下采樣運算,即對圖像局部位置進行聚合統(tǒng)計,稀疏化特征圖像,減少需要處理的數(shù)據(jù)量及防止過擬合,并減少網(wǎng)絡的訓練時間。輸入和輸出可表示為

式(10)中,d(·)為下采樣函數(shù),為加性偏置,為第k層第j個特征圖的乘性偏置。

在CNN中,經(jīng)過卷積層與全連接層得到具有類別區(qū)分性的深度局部信息。全連接層中,同層神經(jīng)元無連接,而上一層和下一層的神經(jīng)元是互聯(lián)的。將卷積層和下采樣運算提取到的深度特征信息寄存于全連接層用于分類。接著,根據(jù)損失函數(shù)反向優(yōu)化卷積神經(jīng)網(wǎng)絡中的權重向量,并利用柔性最大值歸一化函數(shù)(Softmax)進行分類運算

式(11)中,y為期望輸出,d為神經(jīng)網(wǎng)絡輸出。代表向量x的2-范數(shù)。

2 實驗結果與分析

2.1 數(shù)據(jù)集構建

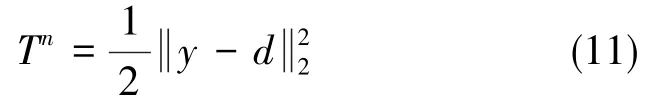

MFIE-DCNN算法使用Python語言,采用Keras作為人工神經(jīng)網(wǎng)絡庫,并采用tensorflow作為后端,實驗機配備了Inter-i5 CPU、8G內存、Win10操作系統(tǒng)。電路板板載元器件圖像由500萬像素工業(yè)相機采集,圖像的理論分辨率為2592×1944。從采集圖像中提取板載元器件建立監(jiān)督樣本庫,樣本庫中包含:電容(200張)、電阻(100張)、芯片(200張)等,元器件輪廓周邊白光由光源反光導致,如圖2所示。

圖2 電阻、兩類電容、兩類芯片示例Fig.2 Examples of resistances,capacitors and chips

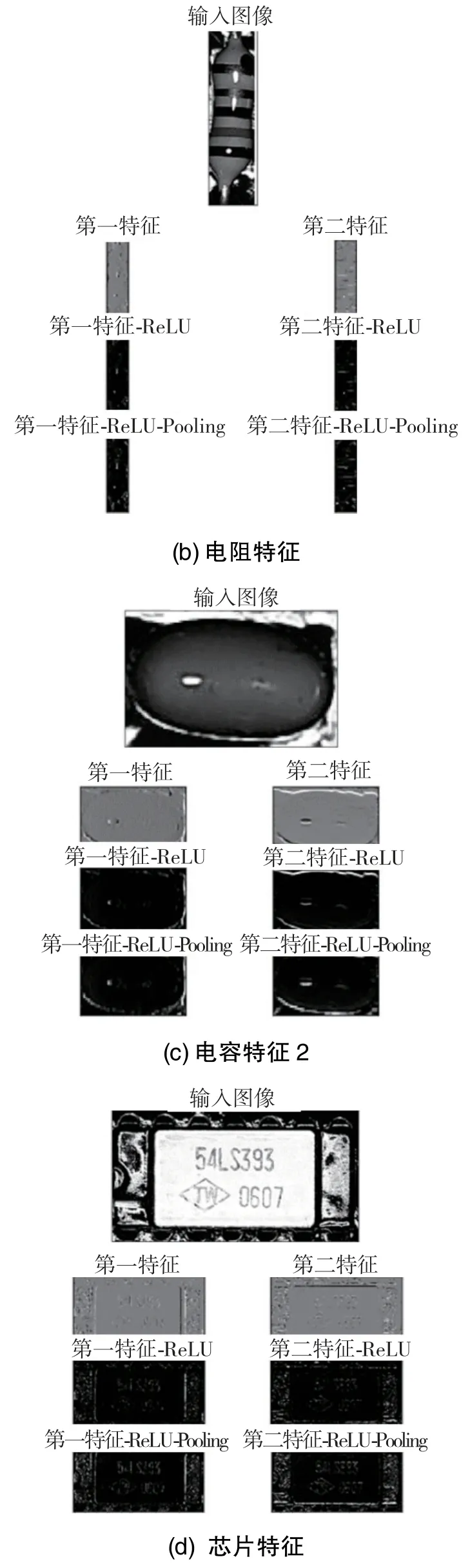

2.2 深度特征提取

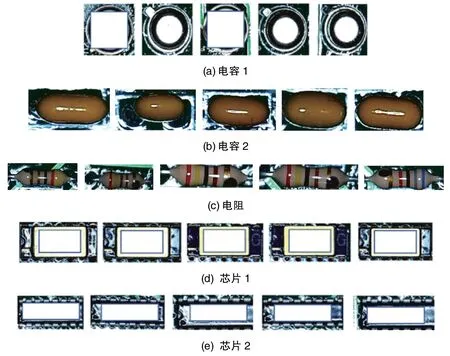

深度卷積神經(jīng)網(wǎng)絡能夠提取待測圖像的深度特征。通常,低層卷積層主要提取顏色和邊緣等特征,高層卷積層提取輪廓和形狀等特征。如表1所示,所用深度卷積神經(jīng)網(wǎng)絡類似于VGG-16,包含八個層,前五層為卷積層,卷積層結構為Convolution+Pool+ReLU;后三層為全連接層,全連接層作用為特征加權,并利用Softmax對圖像表達特征子圖中各元器件進行分類。

表1 MFIE-DCNN 網(wǎng)絡結構Table 1 Network structure of MFIE-DCNN

圖3 四種元器件的深度特征Fig.3 Deep features of four components

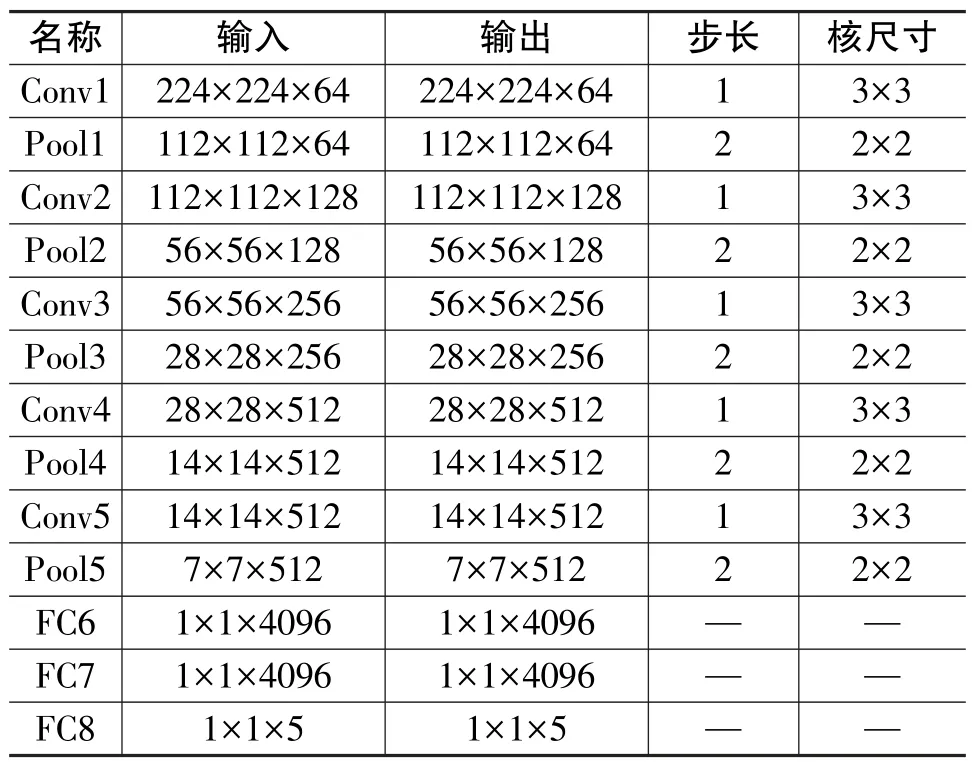

圖3展示了四種元器件的深度特征,首先為四種元器件的輸入圖像,第一特征和第二特征為輸入元器件的特征圖1和特征圖2,第一特征-ReLU和第二特征-ReLU為特征圖1和特征圖2經(jīng)過ReLU函數(shù)處理過的圖像,第一特征-ReLUPooling和第二特征-ReLU-Pooling為特征圖1和特征圖2經(jīng)過ReLU函數(shù)處理和池化運算后的特征圖像。由圖3可知,經(jīng)過處理后圖像的物體與背景具有較強的對比度,為后續(xù)分類提供型不變特征。

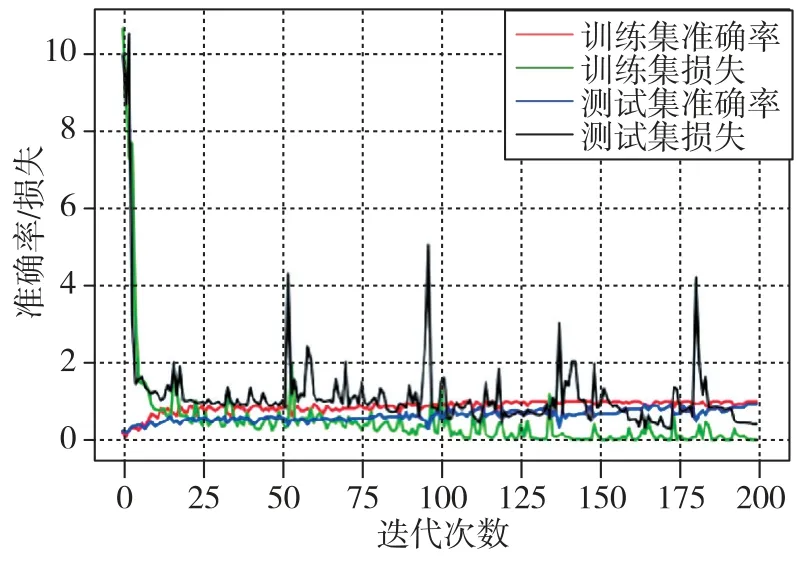

2.3 模型測試

利用訓練數(shù)據(jù)集和測試數(shù)據(jù)集對模型的收斂區(qū)間和穩(wěn)定性進行評估,將數(shù)據(jù)集分為兩個部分,即訓練數(shù)據(jù)(60%)和測試數(shù)據(jù)(40%)。將訓練數(shù)據(jù)輸入MFIE-DCNN中,得到如圖4所示的訓練數(shù)據(jù)集與測試數(shù)據(jù)集準確率的曲線圖。可以看出,經(jīng)過約20次迭代訓練,MFIE-DCNN開始收斂。

圖4 訓練數(shù)據(jù)集與測試數(shù)據(jù)集準確率曲線圖Fig.4 Accuracy curves of training dataset and testing dataset

2.4 驗證算法參數(shù)設置

首先將RGB圖像映射到HSV圖像空間,利用直方圖均衡化亮度分量V,通過主成分分析得到RGB圖像的第一主成分(PC1),并提取第一主成分(PC1)的Gabor紋理特征。利用Vs、PC1和Gt構建圖像表達特征子圖,增強圖像細節(jié)。MFIEDCNN包含八個層,前五層為卷積層,后三層為全連接層。Batch_size設為5,使用Dropout稀疏化全連接層中的節(jié)點,激活函數(shù)采用ReLU。Dropout的值設置為0.1,學習率采用系統(tǒng)默認的最優(yōu)值[15],對比算法包含SVM-linear、SVM-RBF、RF和SAEDNN。利用GridSearchCV法,可獲得SVM-RBF中gamma值和懲罰項的值。SAE-DNN包含3個稀疏自動編碼器,每個編碼器包含300個隱藏單元,每個編碼器的迭代次數(shù)為8000次。五種分類器分別運行10次,計算總體分類精度(OA)、Kappa系數(shù)和混淆矩陣[16-17]。

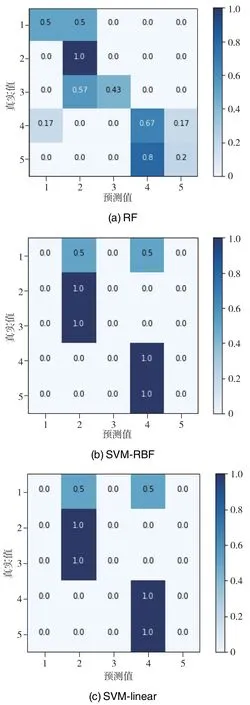

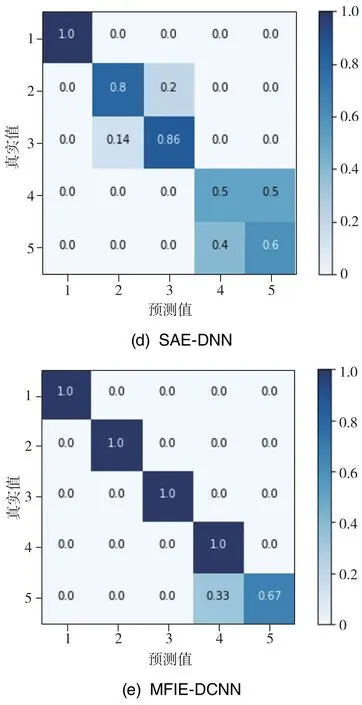

2.5 定量分析

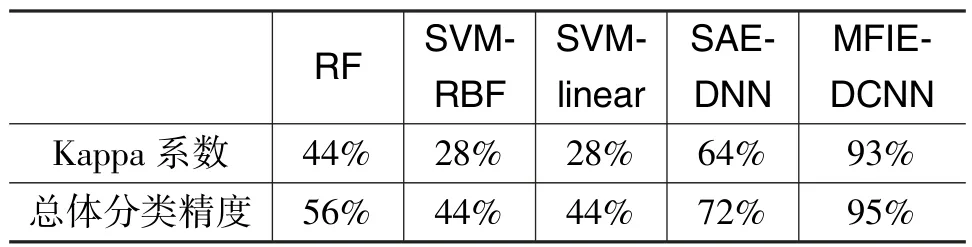

總體分類精度(OA)、Kappa系數(shù)和混淆矩陣被用于評估MFIE-DCNN算法的性能:總體分類精度(OA)為正確分類的類別圖像數(shù)與總的類別個數(shù)的比值[18],Kappa系數(shù)為分類與完全隨機的分類結果產生錯誤減少的比例[19],混淆矩陣用于計算分類器預測結果和輸入數(shù)據(jù)類別真值之間的差距[20]。圖5為五種算法的混淆矩陣,表2為五種算法的分類結果對比。

圖5 五種算法的混淆矩陣Fig.5 Confusion matrix of the five algorithms

表2 分類結果對比Table 2 Comparison of classification results

由表2可知,RF、SVM-RBF、SVM-linear、SAE-DNN和MFIE-DCNN的Kappa系數(shù)分別為44%、28%、28%、64%和93%,RF、SVM-RBF、SVM-linear、SAE-DNN和MFIE-DCNN的總體分類精度分別為56%、44%、44%、72%和95%。SVM-RBF、SVM-linear的總體分類精度較差,MFIE-DCNN的總體分類精度最高,較SAE-DNN提升了近20%。

3 結論

針對傳統(tǒng)的航天用電子元器件分類算法的不足,本文提出了一種基于多特征圖像增強深度卷積神經(jīng)網(wǎng)絡(MFIE-DCNN)的航天用電子元器件分類算法。MFIE-DCNN算法首先將工業(yè)相機采集到的電子元器件圖像由RGB空間映射到HSV空間,然后利用同態(tài)濾波增強亮度分量V,提取RGB圖像的第一主成分(PC1)和第一主成分的Gabor紋理特征,利用Vs、PC1和Gt構建圖像表達特征子圖。將圖像表達特征子圖輸入類VGG-16卷積神經(jīng)網(wǎng)絡用于訓練模型,利用訓練好的深度神經(jīng)網(wǎng)絡進行電子元器件分類。實驗表明,該算法的精度較SAE-DNN算法提升了近20%,能夠滿足實際應用。后續(xù)研究工作將繼續(xù)采集電子元器件圖像,擴充監(jiān)督樣本庫,訓練MFIE-DCNN,提高檢測效果。