深度學習技術在工件自動檢測中的應用

劉信君,林 滸,鄭飂默,王詩宇

1(中國科學院大學,北京 100049)2(中國科學院 沈陽計算技術研究所,沈陽 110168)3(沈陽高精數控智能技術股份有限公司,沈陽 110168)

1 引 言

工業機器人的使用不僅可以解決勞動力少、勞動力成本高等問題,又可以結合高新技術來建設智能化工廠[1].在自動化生產線上,很多情況下需要先將待操作物體的位置信息給到機器人,例如:機器人抓取工件、搬運、焊接等場景.然后,才能驅動機器人完成相應的工作.傳統的方式大多是基于離線編程或示教的方法,這種方式雖然可以滿足精度的要求,但是對于操作人員要求極為苛刻,而且方法的泛化性能極差.因此,利用工業相機捕捉場景圖像,對圖像中物體進行自動檢測與定位,實現機器人對物體的進一步操作,具有很好的實際應用價值.

目前,有很多不同的邊緣檢測算法,有根據亮度、顏色、像素梯度或者其他手工設計的特征,來對邊緣和非邊緣進行分類的傳統算法,還有現在比較流行的基于深度學習的端到端的神經網絡[2,3].本文基于深度學習技術搭建的機器人視覺系統,通過邊緣檢測以及后續的圖像算法對場景中工件進行識別與定位,實現六關節機器人對工件的抓取.本文第二部分對整個視覺系統的工作流程進行了簡單的概述.第三部分分析了當前邊緣檢測算法和相機標定算法存在的缺陷,并進行了相應的優化,提出了可行的解決方案.第四部分通過實驗驗證了優化算法的有效性和可行性.

2 視覺系統工作流程

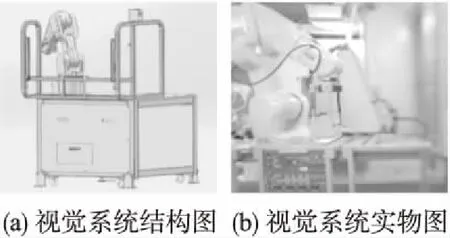

圖1 視覺系統結構圖Fig.1 Vision system structure

實驗過程中,首先由相機采集待抓取物的圖像信息并交由計算機,計算機通過圖像算法對圖像中待抓取物進行識別與定位.然后通過坐標轉換算法,將得到的待抓取物體二維坐標信息轉換成六關節機器人基坐標系下的三維坐標.機器人通過該坐標信息完成抓取.

3 視覺系統設計流程

3.1 工件邊緣檢測

邊緣檢測可以理解為從圖像中提取視覺上顯著的邊緣和對象邊界的方法.傳統的方法通常是根據亮度、顏色、像素梯度或者其他手工設計的特征,采用Sobel算子、Canny算子等來對邊緣和非邊緣進行分類,雖然傳統特征檢測的方法在某些場景下具有不錯的表現,但是局限性也很明顯,一方面對噪聲敏感、對人工設計的閾值等參數要求高,另一方面僅僅依靠強度、梯度、紋理這些低級特征會損失圖片的空間信息等高級信息.近幾年,在卷積神經網絡的幫助下,邊緣檢測的研究取得了重大進展,基于卷積神經網絡的邊緣檢測器已經在標準數據集的測試中超過了人工標注的度量結果.

3.1.1 RCF網絡

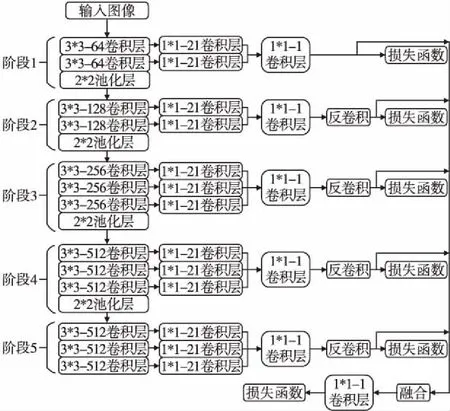

RCF(Richer Convolutional Features)網絡[2]是2017年由劉云等人在HED網絡[3]的基礎上改進的一個可以執行端到端的訓練和預測的邊緣檢測器.網絡結構如圖2所示.

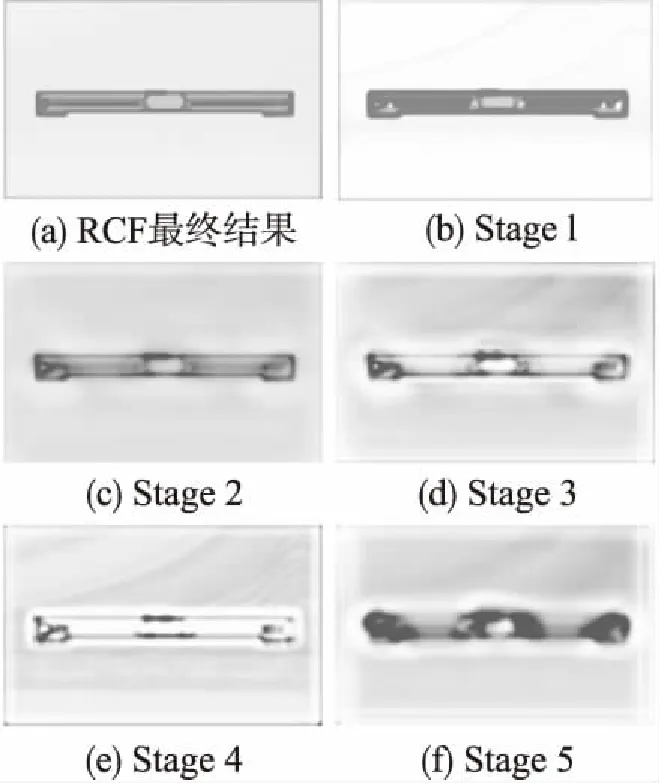

該網絡以VGG16作為主干網絡,保留了VGG16網絡前5個階段,省去了最后的全連接層以及第5個階段的池化層.在每個階段融合了每一個卷積層提取的特征,并采用反卷積,將每個階段得到的特征圖調整為原始圖像大小.最后,融合這些特征圖以獲得最終的預測圖.具體每一階段執行結果以及最后融合的預測圖,如圖3所示.

3.1.2 RCF優化

這種設計可以充分利用CNN豐富的特征層次結構,會保留原圖像中更多的細節信息.但是從圖3中也可以看出,得到的預測圖邊緣比較粗糙,為了提高邊緣檢測器的定位能力,必須尋求細化邊緣的方法.從網絡結構方面分析RCF網絡,邊緣過粗主要存在以下兩個原因.首先,由于連續的池化層,圖像不斷被下采樣,在更具邊緣判別能力的頂層中,特征的空間分辨率顯著降低,導致邊緣的模糊輸出.另一方面,在每一階段融合的時候采用反卷積的上采樣方法不足以恢復空間細節,因此進一步模糊了邊緣圖.由于在每一階段最后的池化層

馬約翰先生在1948年接待校刊記者時說:“我覺得體育的功效,最重要是培養人格,補充教育的不足,培養一種‘干、干、干!’的精神”他認為體育是教育的重要組成部分,培養全面發展人才的手段,運動場是培養學生品格極好的場所,培養青年們勇敢的精神,堅強的意志,自信心,進取心和爭取勝利的決心。

圖2 RCF網絡結構圖Fig.2 RCF network structure

可以有效提高計算效率,因此本文不做考慮,主要從使用亞像素卷積[4]替換反卷積以及數據增強兩個方面來對RCF網絡進行優化.

圖3 RCF結果圖Fig.3 Result graph of RCF

1)亞像素卷積

亞像素卷積是一種在低分辨率圖像上直接計算卷積得到高分辨率圖像的高效率方法.相對而言,反卷積是使用單個濾波器,先將圖像從低分辨率放大到高分辨率空間,然后在高分辨率空間進行操作,這就意味著增加了額外的計算復雜度.不同于反卷積,亞像素卷積是在低分辨率圖像上直接計算,然后通過一個升序濾波器陣列將最終的低分辨率特征圖提升到高分辨率空間.通過這種方式,可以有效地替換反卷積中的單濾波器,并且為每個特征圖提供了更加復雜的升頻濾波器,同時還降低了整體的計算復雜度.

在RCF中使用亞像素卷積代替反卷積可以消除反卷積引入的模糊,增加更精細的邊界細節.同時,為每一階段的輸出增加了額外的非線性,降低了相鄰像素之間的相關性.圖4是對兩種卷積方式同一階段邊緣特征圖、同一區域放大之后的結果,從圖4的對比中可以看出,使用亞像素卷積可以生成“正確”并且“清晰”的邊緣圖.

圖4 卷積結果對比圖Fig.4 Convolution result comparison

2)數據增強

本文使用BSDS500[5]和VOC Context[6]的增強數據集訓練.BSDS500數據集是邊緣檢測中被廣泛應用的數據集.它由訓練集、驗證集和測試集組成,其中,訓練集包括200張圖像、驗證集包括100張圖像、測試集包括200張圖像.增強數據集由BSDS500數據集中200張訓練圖像、100張驗證圖像和VOC Context數據集混合,經過旋轉、翻轉、裁剪等操作生成,總共約36800張圖像.

3.2 工件定位

定位工件抓取位置只需要定位到工件的中心即可.可是如果想要在圖像中定位出工件的邊緣與中心,僅僅依靠RCF網絡預測出的邊緣圖像還遠遠不夠,還需要對邊緣圖像提取最小外接輪廓,來得到工件的位置以及旋轉角度.在這里,我們使用OpenCV3[7]中的已經封裝好的方法來獲取邊緣圖像的最小外接矩形,該方法會根據檢測到的角點,返回矩形的中心、長寬以及旋轉角度,這里的矩形中心就是我們需要的工件中心.如圖5所示,得到的最小外接矩形可以很好地找到抓取所需的工件中心.

圖5 外接矩形定位圖Fig.5 External rectangle positioning

3.3 相機標定

得到了工件的二維圖像坐標之后,需要考慮如何將二維坐標轉換到機器人基坐標系下的三維坐標.相機標定的過程主要分為兩步:首先建立相機成像模型,然后設計標定算法來對相機內、外參數進行標定.相機模型主要分為線性模型和非線性模型,針對非線性模型,傳統的標定方法只考慮了徑向畸變,忽略了切向畸變等其他非線性畸變,因此,在很大程度上制約了標定的精度.本文根據相機模型,針對相機參數不精確的問題,借助神經網絡強大的非線性擬合能力,以相機成像模型為基本思想,提出了一個淺層的BP神經網絡模型來完成相機的標定,實現了二維像素坐標到三維世界坐標的非線性映射.

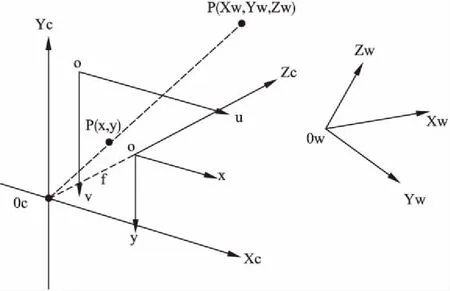

3.3.1 相機模型

相機成像模型建立了三維物體和二維圖像之間的對應關系,成像過程涉及了世界坐標系、相機坐標系、圖像坐標系、像素坐標系之間的轉換.下面首先以理想狀態下的針孔相機模型為例,對涉及的四個坐標系進行定義.如圖6所示,坐標系OwXwYwZw表示世界坐標系、坐標系OcXcYcZc表示相機坐標系、坐標系Oxy表示圖像坐標系、坐標系Ouv表示像素坐標系,p(Xw,Yw,Zw)為世界坐標系中的一點,p(x,y)是點p在圖像中對應的成像位置,在圖像坐標系中坐標為(x,y),在像素坐標系中坐標為(u0,v0).

圖6 坐標關系圖Fig.6 Coordinate relationship

在成像過程中,首先是世界坐標系到相機坐標系的轉化,因為兩者均是空間的絕對坐標,因此該變換屬于剛體變換,用[R|t]表示;然后是從相機坐標系到圖像坐標系的轉化,根據小孔成像原理可知,該變換屬于透視投影變換,轉化關系為公式(1),其中f為相機鏡頭的焦距.

進一步,從圖像坐標系轉化到像素坐標系,圖像坐標系和像素坐標系都在成像平面上,圖像坐標系的x軸和y軸分別于像素坐標系的u軸和v軸平行,兩者轉化關系為公式(2).綜上所述,從世界坐標系到像素坐標系轉化的數學模型如公式(3)所示.

(1)

(2)

(3)

上述的過程是在理想情況下的線性模型,實際環境中會因為透鏡的形狀和相機組裝過程中透鏡和成像平面不平行,帶來非線性誤差,一般分為徑向畸變和切向畸變,用數學模型表示為:

Xcorrect=x(1+k1r2+k2r4+k3r6)+2p1xy+p2(r2+2x2)

Ycorrect=y(1+k1r2+k2r4+k3r6)+2p1(r2+2y2)+2p2xy

(4)

其中,r2=x2+y2,(x,y)是成像裝置上畸變點的原始位置,(Xcorrect,Ycorrect)是畸變矯正之后的位置,k1、k2、k3是徑向畸變系數,p1、p2是切向畸變系數.

上述相機模型可以簡化為Q=H*P,但是在實際場景中需要的是機械臂基坐標下的三維信息,所以需要將二維坐標轉化成三維坐標,本文假設待抓取物的Z軸垂直于地面,機械臂末端在平行于待抓取物X軸和Y軸所在的平面內定位待抓取物,因此可以根據P=H-1*Q通過像素坐標來得到待抓取物的三維信息.

3.3.2 BP神經網絡

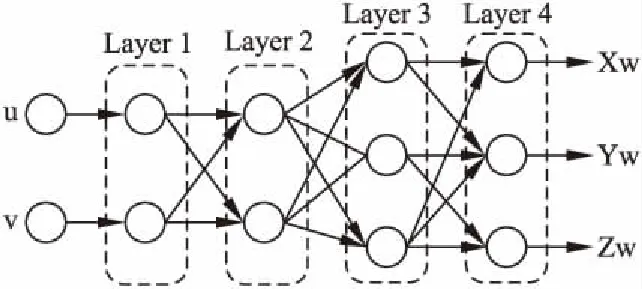

BP神經網絡的基本結構包括:輸出層,隱藏層和輸出層,理論上只要隱藏層神經元足夠多,就具有擬合任意復雜非線性映射的能力.對于相機標定,由于相機鏡頭存在多種非線性畸變,傳統的標定方法需要建立復雜的數學模型,而神經網絡在應對這些非線性畸變上具有極強的魯棒性,因此本文根據相機成像模型提出了一種基于BP神經網絡的相機標定方法,具體網絡結構如圖7所示.

圖7 相機標定網絡結構Fig.7 Camera calibration network structure

整個網絡使用Keras框架搭建,使用圖8所示的6*9標準棋盤格采集的500組圖像和機器人末端點對作為實驗數據.激活函數采用tanh函數,來對每個節點進行非線性激活;學習率使用Keras提供的指數衰減法,這個方法先使用較大的學習率來快速得到一個比較優的解,然后隨著迭代的進行逐步降低學習率,使得模型在訓練后期更加穩定;損失函數采用均方誤差(MSE),定義如公式(5)所示:

(5)

圖8 6*9棋盤格Fig.8 6*9 checkerboard

(6)

4 實驗結果與分析

為了驗證本文方法的可行性,本文進行兩部分的實驗,分別對優化的RCF網絡和用于相機標定的BP神經網絡進行評估.

4.1 RCF網絡評估實驗

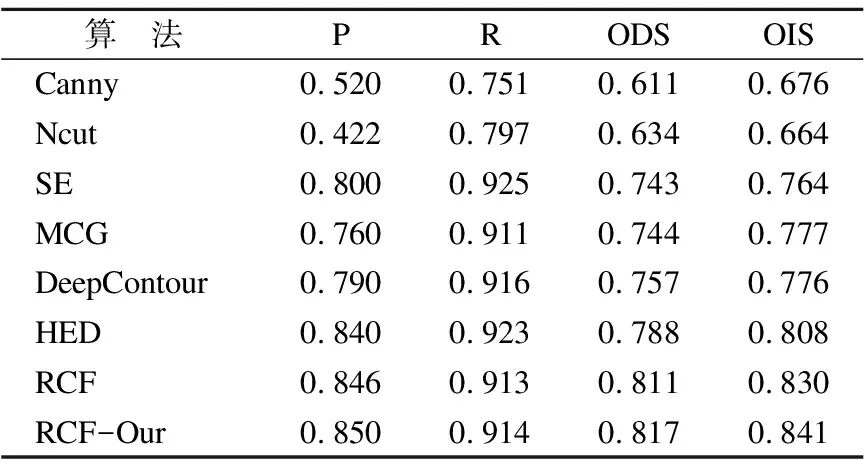

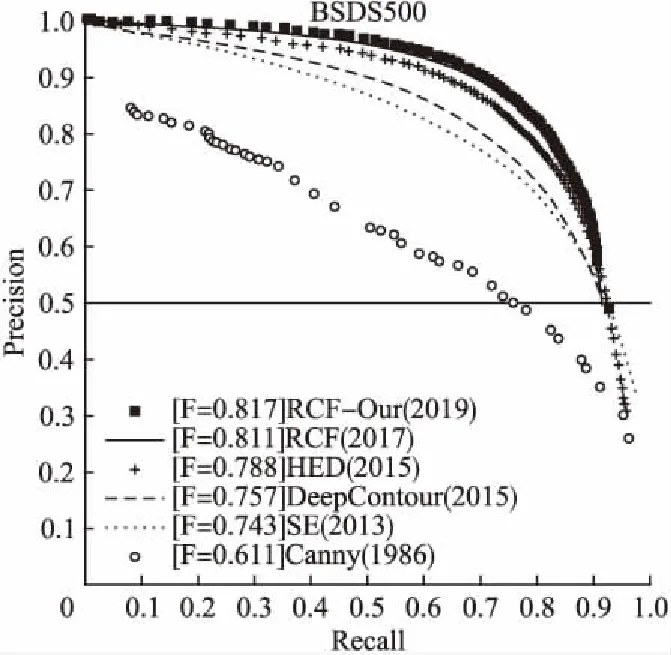

表1 各算法在BSDS500上的邊緣檢測評估結果

Table 1 Edge detection evaluation results on BSDS500

算 法PRODSOISCanny0.5200.7510.6110.676Ncut0.4220.7970.6340.664SE0.8000.9250.7430.764MCG0.7600.9110.7440.777DeepContour0.7900.9160.7570.776HED0.8400.9230.7880.808RCF0.8460.9130.8110.830RCF-Our0.8500.9140.8170.841

通過上述實驗結果可以看出,本文提出的對RCF網絡的優化策略在精確率和召回率方面均優于現在主流的邊緣檢測模型,ODS和OIS指標相較于經典的RCF網絡分別提升了0.6%和1.1%,這也證明了使用亞像素卷積替換反卷積可以得到更精細、質量更高的邊緣特征圖,邊緣特征圖融合之后可以得到“清晰”和“準確”的邊緣.

圖9 各算法P-R曲線對比圖Fig.9 P-R curve comparison chart

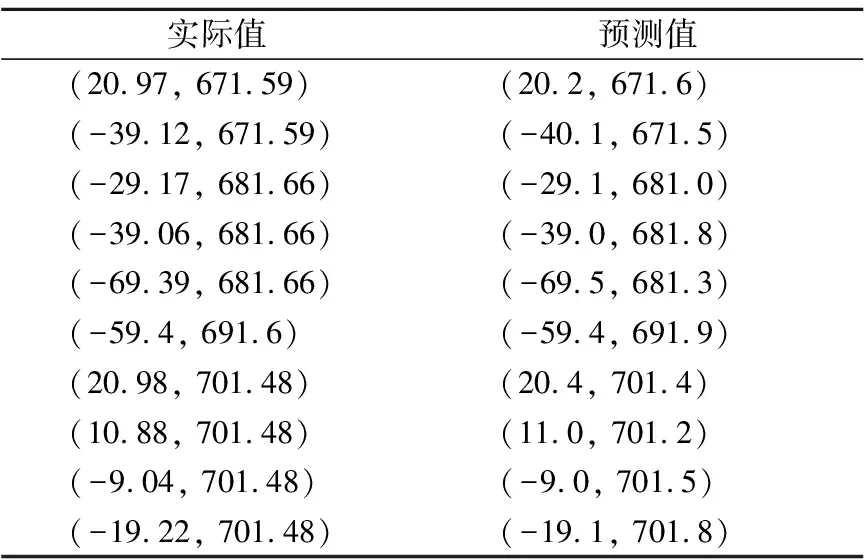

4.2 相機標定BP網絡評估實驗

本文在自己采集的數據集分割出來的測試集上進行網絡測試實驗,樣本實際值與網絡所得預測值樣例如表2所示.

測試實驗最終所得均方誤差為0.431,也就是說誤差在0.5mm之內,已經完全可以滿足本視覺系統的實際應用.

表2 BP神經網絡預測樣例表

Table 2 Prediction examples of BP neural network

實際值預測值(20.97, 671.59)(20.2, 671.6)(-39.12, 671.59)(-40.1, 671.5)(-29.17, 681.66)(-29.1, 681.0)(-39.06, 681.66)(-39.0, 681.8)(-69.39, 681.66)(-69.5, 681.3)(-59.4, 691.6)(-59.4, 691.9)(20.98, 701.48)(20.4, 701.4)(10.88, 701.48)(11.0, 701.2)(-9.04, 701.48)(-9.0, 701.5)(-19.22, 701.48)(-19.1, 701.8)

5 結束語

本文以ABB IRB1200 六關節機器人和映美精 DFK33GP-006工業相機為基礎搭建了機器人視覺系統.采用邊緣檢測和最小外接矩形的方式對工件進行定位,對執行端到端邊緣檢測的RCF網絡通過亞像素卷積核和數據增強的方式對網絡進行了優化,實驗驗證了在每一階段可以產生精細、準確的邊緣,并且在標準數據集上通過實驗驗證了算法的有效性.接下來分析了相機成像模型,并以此為基本思想,設計了基于BP神經網絡的坐標映射方法,并通過實驗驗證了算法的可行性.綜上所述,本視覺系統具有很好的實際應用價值.