基于特征的圖像顯著性檢測

艾顯麗 彭亞雄 陸安江

【摘 ?要】為了解決目前顯著性檢測中圖像的紋理特征對其他特征(顏色、方向等)的影響問題,通過對該領域已有的算法和文章進行實驗和比較,提出一個概念上明確和改進的基于對比度的顯著性檢測的直觀算法。研究了將輸入的圖像用已改進的總變差模型來獲取一個有效的主要結構,將提取到的主要結構圖像分解為緊湊、感知、同質的元素,抽象出不必要的細節;進一步,基于這種抽象元素計算了兩個對比度量,即顏色獨特性和空間分布,通過高斯濾波得到兩個對比度的顯著圖,將其進行融合。分析了融合后的顯著圖與目前比較經典的算法得到的顯著圖之間的改進之處。實驗證實了去除紋理特征后提取到的顯著圖,有效地抑制了圖像各特征之間的相互干擾,提高了顯著圖融合的精確度。

【關鍵詞】顯著性檢測;紋理特征;對比度

1 ? 引言

人類對自身以外的信息獲取是來自感知,其中有80%的信息是通過視覺來獲取的[1]。面對如此之多的復雜場景,人類如何快速、準確地識別出對自己有效的信息一直都是人們堅持不懈追求的目標。顯著性目標檢測技術可分為通過任務驅動的自頂向下的顯著性方法以及通過底層特征數據驅動的自底向上的顯著性方法[2-3]。近幾年隨著人工智能的興起,目標級顯著性檢測的研究也在越來越受到人們的密切關注,由于這種方法的實用性,顯著目標檢測的研究成果也已經廣泛應用于很多領域,比如可以應用在圖像分割、自適應壓縮、圖像檢索等計算機視覺技術中[4]。

然而,在以往的工作中,對比度的定義是基于各種不同類型的圖像特征,包括單個像素的顏色變化、邊緣和梯度、空間頻率、圖像塊的結構和分布、直方圖、多尺度描述符或其組合。每個單獨特征的重要性仍然不清楚,即使是非常相似的方法也可能表現出相當大的性能差異。

從目前的研究現狀來看,顯著性檢測方法很少考慮到圖像的紋理特征對其他特征(顏色、方向等)的影響,使得最后的顯著圖融合不精確。本文重新考慮了基本相關的對比措施及其定義的圖像內容。方法是基于一幅圖像含有規則或不規則的紋理特征,用改進的總變差模型提取圖像的主結構圖,將主結構圖分解為基本元素[9],基于這些元素定義了兩個對比度量用于計算每個像素的顯著性。

除此之外,不同的評價結果表明:現有方法中的個體特征和對比措施很難評估。將對比度度量集減少到只有兩個,這兩個度量集可以通過抽象的圖像元素直觀地定義,同時生成像素精確的顯著性圖。

2 ? 本文算法

2.1 ?算法步驟

本文的算法是將一幅輸入的圖像通過總變差模型去紋理特征之后,然后通過分割得到主結構圖,獲取到抽象的、小的和在感知上均勻的元素(如圖1中的分割圖),用于圖像抽象的顯著性計算方法,將主結構上具有代表性的元素和基于顏色和空間分布對比度的顯著性度量計算出來。這里采用基于濾波器的公式高效計算并生成每像素顯著性圖(如圖1中的顏色獨特性和空間分布)以及利用這些元素的兩兩對比度量來計算圖像的顯著性(如圖1中的最終顯著圖)。最后為了與手工分割的標注圖進行比較,在實驗中對閾值圖進行計算(如圖1中的閾值結果)。

2.2 ?總變差模型

本文通過提取圖像主結構的方法來分離紋理特征,在主結構圖上提取圖像的顏色特征,減少紋理信息對基于顏色特征進行顯著性檢測的干擾[10]。本文選取的是基于總變差模型的方法來去除圖像中的規則或不規則的紋理,該方法具有很高的魯棒性,適用于對多種不同類型的紋理這一特征進行處理。總變差模型通過下式表示:

其中,I是原始輸入的圖像,P是二維圖像的像素索引,S是去紋理后的輸出圖像,Sp是去紋理后的二維圖像像素索引,Ip是原始輸入圖像的二維圖像像素索引,λ是一個不可或缺的權重值,它用來控制圖像的光滑程度,在本文實驗中λ=0.01,(Sp-Ip)2保證了輸出的結構圖像和輸入的原始圖像保持盡可能的相似,其中各向異性

2.3 ?顏色特征值

3 ? 實驗和評價

3.1 ?Precision-Recall評估

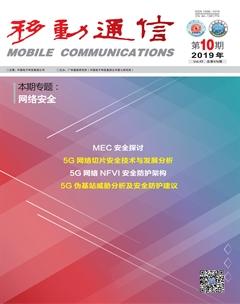

本文采用的是分割閾值的方法來進行評估[12,17-19]。首先,將通過融合得到的顯著圖進行二值化,將分割后的二值圖與MSRA-1000數據庫[20]中手工分割的標注圖(GT)進行比較。此外,為了凸顯算法(MYS)的改進性,在評估時還會選取傳統方法中一些經典的算法與之作比較,其中有基于視覺注意機制顯著性模型(IT)[5]、基于圖論的顯著性檢測(GB)[7]、基于局部對比的顯著性檢測(MZ)[13]、基于頻域分析的顯著性檢測(FT)[13]、基于全局對比度顯著性檢測(HC)[14]和基于低頻的顯著性檢測(AC)[21]。

精度(Precision)對應于正確分配的顯著像素百分比,召回率(Recall)對應于檢測到的顯著像素與顯著地面真值數(Ground-truth)的比值。在實驗中,實現高召回率是以降低精度為代價的,反之亦然。因此,同時評估這兩種方法是很重要的。

根據圖2中得到的曲線表明,算法(MYS)在每個閾值和任何給定的召回率下始終如一地產生更接近GT的結果。

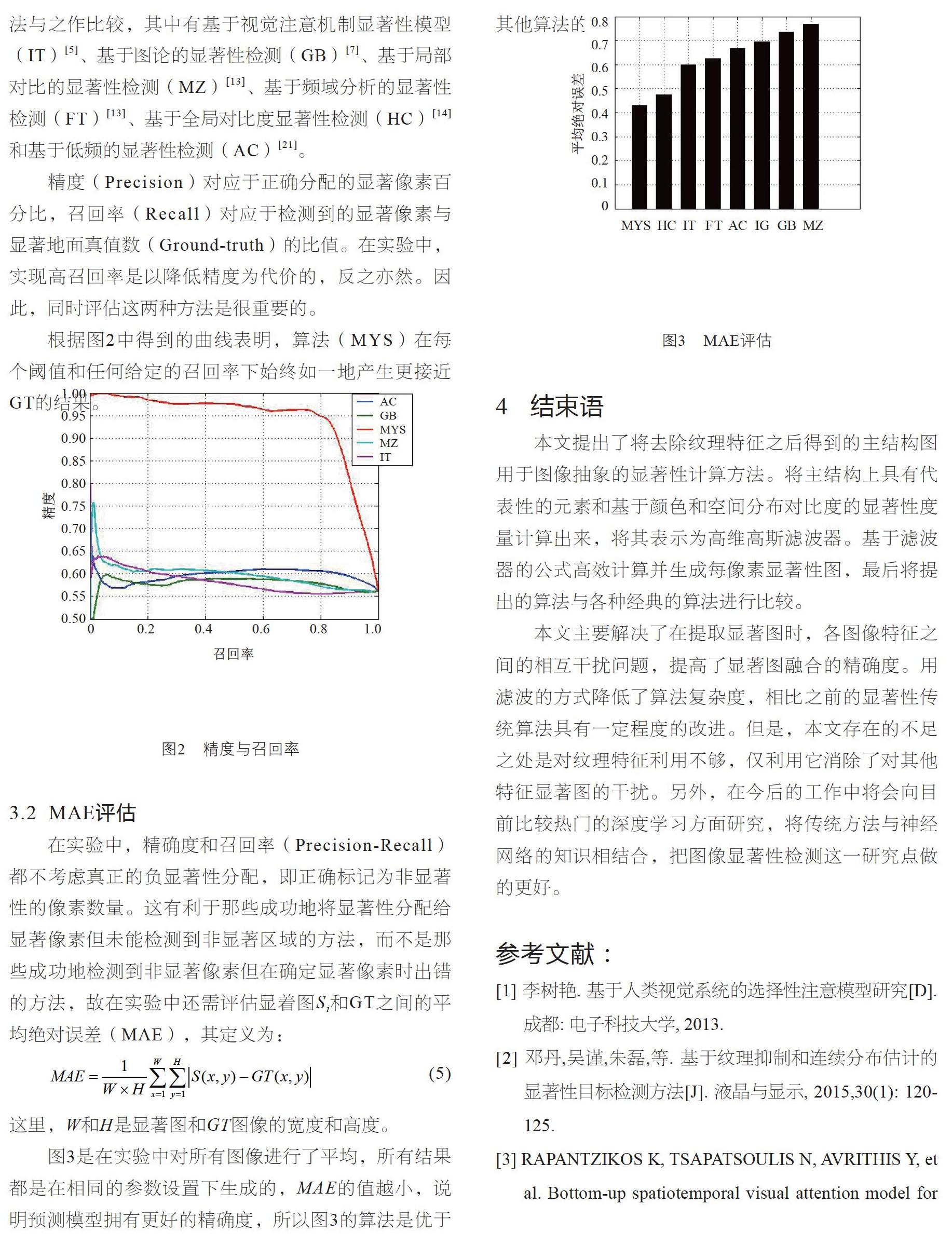

3.2 ?MAE評估

圖3是在實驗中對所有圖像進行了平均,所有結果都是在相同的參數設置下生成的,MAE的值越小,說明預測模型擁有更好的精確度,所以圖3的算法是優于其他算法的。

4 ? 結束語

本文提出了將去除紋理特征之后得到的主結構圖用于圖像抽象的顯著性計算方法。將主結構上具有代表性的元素和基于顏色和空間分布對比度的顯著性度量計算出來,將其表示為高維高斯濾波器。基于濾波器的公式高效計算并生成每像素顯著性圖,最后將提出的算法與各種經典的算法進行比較。

本文主要解決了在提取顯著圖時,各圖像特征之間的相互干擾問題,提高了顯著圖融合的精確度。用濾波的方式降低了算法復雜度,相比之前的顯著性傳統算法具有一定程度的改進。但是,本文存在的不足之處是對紋理特征利用不夠,僅利用它消除了對其他特征顯著圖的干擾。另外,在今后的工作中將會向目前比較熱門的深度學習方面研究,將傳統方法與神經網絡的知識相結合,把圖像顯著性檢測這一研究點做的更好。

參考文獻:

[1] 李樹艷. 基于人類視覺系統的選擇性注意模型研究[D]. 成都: 電子科技大學, 2013.

[2] 鄧丹,吳謹,朱磊,等. 基于紋理抑制和連續分布估計的顯著性目標檢測方法[J]. 液晶與顯示, 2015,30(1): 120-125.

[3] RAPANTZIKOS K, TSAPATSOULIS N, AVRITHIS Y, et al. Bottom-up spatiotemporal visual attention model for video analysis[J]. IEEE Conference on Image Processing, 2007(2): 237-248.

[4] 胡德鳳. 基于紋理特征圖像分割的研究[D]. 合肥: 合肥工業大學, 2013.

[5] ITTI KOCH C, NIEBUR E. A model of saliency-based visual attention for rapid scene analysis[J]. IEEE TPAMI, 1998(11): 1254-1259.

[6] 魏昱. 圖像顯著性區域檢測方法及應用研究[D]. 濟南: 山東大學, 2012.

[7] HAREL J, KOCH C, PERONA P. Graph-based visual saliency[J]. In NIPS, 2006: 545-552.

[8] HOU X, ZHANG L. Saliency detection: A spectral residual approach[J]. In CVPR, 2007(7): 1109.

[9] EFROS A A, FREEMAN W T. Image quilting for texture synthesis and transfer[J]. In SIGGRAPH, 2001: 341-346.

[10] AUJOL J F, GILBOA G, CHAN T F, et al. Structure-texture image decomposition-modeling, algorithms, and parameter selection[J]. International Journal of Computer, 2006: 111-136.

[11] REN Y, HU L T, CHIA, et al. Improved saliency detection based on super pixel clustering and saliency propagation[J]. ACM Multimedia, 2010: 1099-1102.

[12] ACHANTA R, SHAJI A, SMITH K, et al. SLIC super pixels Technical report[R]. 2010.

[13] MA Y F, ZHANG H. Contrast-based image attention analysis by using fuzzy growing[J]. ACM Multimedia, 2003: 374-381.

[14] CHENG M M, ZHANG G X, MITRA N J, et al. Global contrast based salient region detection[J]. IEEE Conference on Computer Vision & Pattern Recognition, 2015,37(3): 409-416.

[15] ACHANTA R, HEMAMI S, ESTRADA F, et al. Frequency-tuned salient region detection[C]//IEEE Conference on Computer Vision and Pattern Recognition. 2009: 1109.

[16] PEDRO F, FEIZENSZWALB, DANIEL, et al. Efficient Graph-Based Image Segmentation[J]. International Journal of Computer Vision, 2004(2): 167-181.

[17] DUAN L, WU C, MIAO J, et al. Visual saliency detection by spatially weighted dissimilarity[J]. In CVPR, 2011: 473-480.

[18] 劉文超. 基于光學遙感圖像的目標檢測算法的研究與實現[D]. 成都: 電子科技大學, 2010.

[19] WANG M, KONRAD J, ISHWAR P, et al. Image saliency: From intrinsic to extrinsic context[J]. In CVPR, 2011: 417-424.

[20] 劉松濤,姜康輝,劉振興,等. 局部和全局特征融合的紅外圖像顯著性檢測[J]. 光電子·激光, 2018(3): 235-242.

[21] LIN Weisi, FANG Yuming. A Saliency Detection Model Using Low-Level Features Based on Wavelet Transform[J]. IEEE Transactions on Multimedia, 2013: 135-140.