農(nóng)業(yè)物聯(lián)網(wǎng)中多傳感器數(shù)據(jù)智能融合方法研究

楊秋菊 韓樂

摘 ?要: 針對(duì)傳統(tǒng)多傳感器數(shù)據(jù)融合方法融合置信度較低的問題,提出一種農(nóng)業(yè)物聯(lián)網(wǎng)中多傳感器數(shù)據(jù)智能融合方法,利用證據(jù)理論對(duì)農(nóng)業(yè)物聯(lián)網(wǎng)中多傳感器數(shù)據(jù)的時(shí)空積累信息進(jìn)行獲取,利用獲取的時(shí)空積累信息建立多傳感器數(shù)據(jù)智能融合模型,通過該模型實(shí)現(xiàn)多傳感器數(shù)據(jù)的智能融合。為了驗(yàn)證該方法的融合置信度,將該方法與基于Rough集理論的多傳感器數(shù)據(jù)融合方法、基于數(shù)據(jù)信息轉(zhuǎn)換的多傳感器數(shù)據(jù)融合方法進(jìn)行比較,實(shí)驗(yàn)結(jié)果表明,這三種方法的融合置信度分別是0.965,0.812,0.68。通過對(duì)比實(shí)驗(yàn)?zāi)軌蜃C明農(nóng)業(yè)物聯(lián)網(wǎng)中多傳感器數(shù)據(jù)智能融合方法的融合置信度最高,充分說明了該方法相較于傳統(tǒng)多傳感器數(shù)據(jù)智能融合方法更加適用于農(nóng)業(yè)物聯(lián)網(wǎng)。

關(guān)鍵詞: 智能融合; 數(shù)據(jù)融合模型; 農(nóng)業(yè)物聯(lián)網(wǎng); 融合置信度; 時(shí)空積累信息; 對(duì)比驗(yàn)證

中圖分類號(hào): TN915?34 ? ? ? ? ? ? ? ? ? ? ? ? ? ? ?文獻(xiàn)標(biāo)識(shí)碼: A ? ? ? ? ? ? ? ? ? ? 文章編號(hào): 1004?373X(2019)20?0029?04

Research on intelligent fusion method of multi?sensor data in

agricultural Internet of Things

YANG Qiuju1, HAN Le2

(1. Southwest Petroleum University, Nanchong 637001, China; 2. Xinjiang Technician College of PetroChina, Kelamayi 834000, China)

Abstract: As the traditional multi?sensor data fusion method has the problem of lower fusion confidence coefficient, an intelligent fusion method of multi?sensor data in the agricultural Internet of Things (IOT) is proposed. The space?time accumulated information of multi?sensor data in the agricultural IOT is obtained by means of evidence theory to establish the intelligent fusion model of multi?sensor data, and then the multi?sensor data intelligent fusion can be realized by means of this model. To verify the fusion confidence coefficient of this method, the method is compared with the multi?sensor data fusion method based on Rough set theory and the multi?sensor data fusion method based on data information conversion. The experimental results show that the fusion confidence coefficients of the three methods is 0.965, 0.812, 0.68, respectively. The comparison experiment proves that the fusion confidence coefficient of the intelligent fusion method of multi?sensor data in the agricultural IOT is the highest, which fully demonstrates that the method is more suitable for the agricultural IOT than the traditional intelligent fusion method of multi?sensor data.

Keywords: intelligent fusion; data fusion model; agriculture IOT; fusion confidence coefficient; space?time accumulated information; comparison validation

0 ?引 ?言

在農(nóng)業(yè)物聯(lián)網(wǎng)中,相較于利用單一的傳感器設(shè)備,利用多個(gè)傳感器往往能夠獲得更多更為精準(zhǔn)的信息,并能夠?qū)π畔⑦M(jìn)行綜合判斷與分析[1]。

為了對(duì)農(nóng)業(yè)物聯(lián)網(wǎng)信息進(jìn)行準(zhǔn)確判斷,必須進(jìn)行信息融合。農(nóng)業(yè)物聯(lián)網(wǎng)數(shù)據(jù)融合是對(duì)智能計(jì)算技術(shù)與概率推理技術(shù)進(jìn)行綜合應(yīng)用,將農(nóng)業(yè)領(lǐng)域相關(guān)信息知識(shí)和農(nóng)業(yè)物聯(lián)網(wǎng)所獲取與采集的信息進(jìn)行有機(jī)融合,并對(duì)其進(jìn)行綜合分析,獲取農(nóng)業(yè)畜禽與農(nóng)作物的產(chǎn)量、長(zhǎng)勢(shì)、所處生長(zhǎng)環(huán)境信息,從而對(duì)農(nóng)產(chǎn)品質(zhì)量監(jiān)管領(lǐng)域進(jìn)行優(yōu)化協(xié)調(diào)與準(zhǔn)確預(yù)估[2?3]。

隨著其中數(shù)據(jù)抽象級(jí)別與數(shù)據(jù)抽象程序的逐漸升高,數(shù)據(jù)融合難度會(huì)越來越大,因此提出一種農(nóng)業(yè)物聯(lián)網(wǎng)中多傳感器數(shù)據(jù)智能融合方法,對(duì)多傳感器數(shù)據(jù)進(jìn)行智能融合,降低數(shù)據(jù)融合難度[4]。

1 ?農(nóng)業(yè)物聯(lián)網(wǎng)中多傳感器數(shù)據(jù)智能融合方法

1.1 ?時(shí)空積累信息獲取

利用證據(jù)理論對(duì)農(nóng)業(yè)物聯(lián)網(wǎng)中多傳感器數(shù)據(jù)的時(shí)空積累信息進(jìn)行獲取[5]。首先給定一個(gè)名為X的集合,利用Bel函數(shù)對(duì)集合X的定義進(jìn)行變換:[PX→0,1],也就是對(duì)集合X中的各個(gè)勻邊自子集進(jìn)行數(shù)字指配,數(shù)字范圍為[0,1],對(duì)于每一個(gè)勻邊自子集[PX]中的元素A,利用Bel函數(shù)對(duì)其進(jìn)行定義,可以得到Bel(A),即勻邊自子集[PX]中任一元素的可信度[6]。假設(shè)勻邊自子集[PX]為[A,B,C],那么其冪集[P′(X)]為:

式中,共有[2N]個(gè)元素,代表的是冪集[P′X]的元素個(gè)數(shù)[7]。接著利用基本概率指派函數(shù)m為冪集[P′X]中的元素進(jìn)行概率值的搭配,獲取單位區(qū)間到冪集[P′X]子集的映射集合:[m.P′X→0,1],則元素A的映射集合[8]為m(A)。其中,指派函數(shù)基本概率比0大的子集即為焦點(diǎn)元素,Bel(A)是分配給A的總信度,m(A)主要反映A自身的信度大小,利用基本概率指派函數(shù)m對(duì)這些與信度有關(guān)的函數(shù)進(jìn)行正交求和。設(shè)[m1],[m2]分別為冪集[P′X]上的2個(gè)基本概率指派函數(shù),它們的焦點(diǎn)元素集則分別為[{Ai,i=1,2,…,k}],[{Bj,j=1,2,…,l}],那么它們的正交和為:

它們的正交和是一種分離數(shù)據(jù)結(jié)構(gòu),因此利用Dempster規(guī)則對(duì)它們的正交和進(jìn)行時(shí)空數(shù)據(jù)有效融合:假設(shè)利用多傳感器對(duì)同一個(gè)主體(X)進(jìn)行探測(cè),利用冪集P(X)代表全部待測(cè)子集的集合,在冪集P(X)中,各個(gè)子集是相對(duì)獨(dú)立的,利用一個(gè)空集代表沖突信息,并將數(shù)值[m′j(k-1)m′jk]指配給這個(gè)空集,通過Dempster規(guī)則得到新的積累信息[10]。當(dāng)多傳感器全部完成積累信息計(jì)算后,將得到的積累信息組合起來,即可獲得多傳感器數(shù)據(jù)的時(shí)空積累信息,具體獲取方式如下:

式中:[min(k)]代表多傳感器數(shù)據(jù)的時(shí)空積累信息;[θ′k]代表積累信息組合系數(shù)。對(duì)農(nóng)業(yè)物聯(lián)網(wǎng)中的多個(gè)傳感器重復(fù)執(zhí)行該步驟,即可獲得農(nóng)業(yè)物聯(lián)網(wǎng)的所有多傳感器數(shù)據(jù)時(shí)空積累信息。

1.2 ?多傳感器數(shù)據(jù)智能融合模型建立

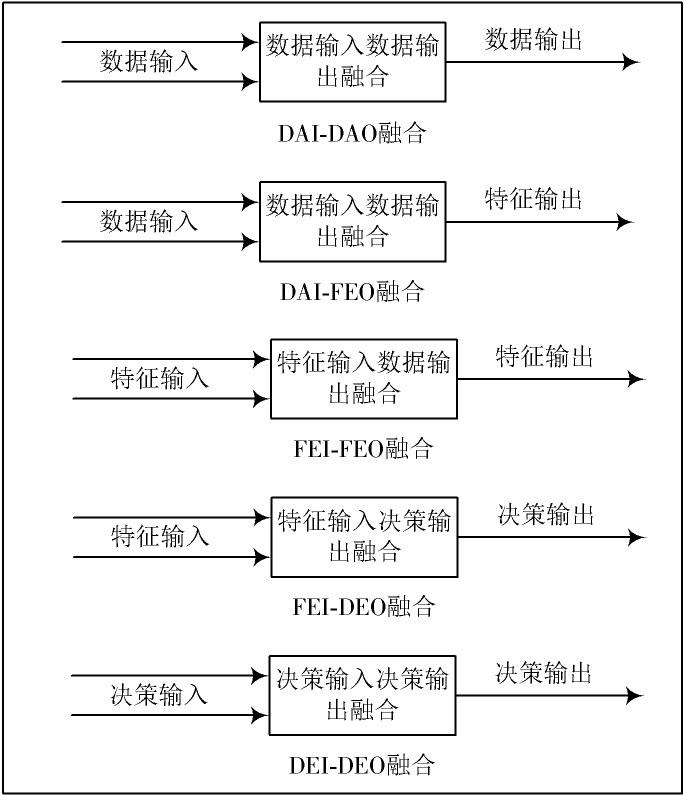

利用獲取的多傳感器數(shù)據(jù)時(shí)空積累信息建立多傳感器數(shù)據(jù)智能融合模型,所建立的多傳感器數(shù)據(jù)智能融合模型如圖1所示。

圖1 ?多傳感器數(shù)據(jù)智能融合模型

多傳感器數(shù)據(jù)智能融合模型由四級(jí)組成,包括對(duì)象融合、勢(shì)態(tài)融合、數(shù)據(jù)源融合與過程融合。其中,對(duì)象融合是將身份信息、參數(shù)信息與位置信息進(jìn)行結(jié)合,以對(duì)個(gè)體進(jìn)行詳細(xì)描述,目的是實(shí)現(xiàn)多傳感器數(shù)據(jù)坐標(biāo)與單位的一致轉(zhuǎn)換;勢(shì)態(tài)融合是對(duì)物體的關(guān)系信息進(jìn)行融合;數(shù)據(jù)源融合是對(duì)農(nóng)業(yè)物聯(lián)網(wǎng)中多傳感器的數(shù)據(jù)源進(jìn)行融合;過程融合則是一個(gè)中間過程,主要是對(duì)數(shù)據(jù)融合的性能進(jìn)行控制,并對(duì)改善融合效果的信息進(jìn)行鑒別。完成這四級(jí)后,即可實(shí)現(xiàn)對(duì)多源數(shù)據(jù)多層次、階梯狀的處理,完成多傳感器數(shù)據(jù)的智能融合。

1.3 ?實(shí)現(xiàn)多傳感器數(shù)據(jù)智能融合

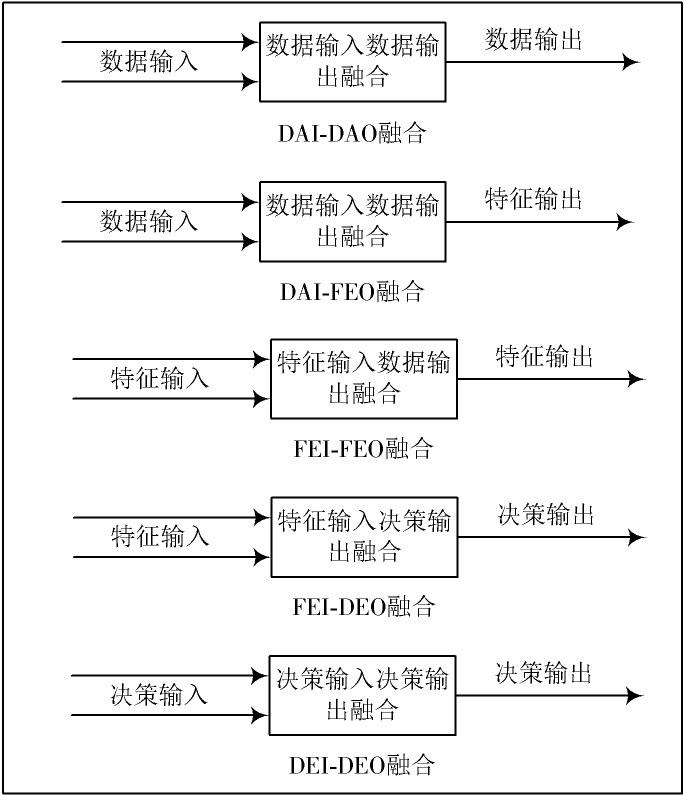

多傳感器數(shù)據(jù)智能融合模型主要基于I/O屬性進(jìn)行多源數(shù)據(jù)的融合,其融合模式如圖2所示。

圖2中:數(shù)據(jù)層智能融合包括多傳感器數(shù)據(jù)的多源圖像合成與融合、圖像數(shù)據(jù)傳輸與配準(zhǔn)等;特征層智能融合主要包括目標(biāo)狀態(tài)數(shù)據(jù)融合與目標(biāo)特征融合;而決策層智能融合是利用不同類別的傳感器對(duì)同一目標(biāo)進(jìn)行觀察,并利用傳感器進(jìn)行本地處理,首先通過特征判決、特征識(shí)別、特征抽取、特征處理等流程得出目標(biāo)的初步觀察結(jié)論,接著通過決策層融合判決與關(guān)聯(lián)處理,獲取最終的多傳感器數(shù)據(jù)智能融合結(jié)果。

2 ?實(shí)驗(yàn)研究

為了檢測(cè)本文提出的農(nóng)業(yè)物聯(lián)網(wǎng)中多傳感器數(shù)據(jù)智能融合方法,設(shè)計(jì)一個(gè)對(duì)比實(shí)驗(yàn)。

圖2 ?融合模式

2.1 ?實(shí)驗(yàn)參數(shù)

本次實(shí)驗(yàn)參數(shù)如表1所示。

表1 ?實(shí)驗(yàn)參數(shù)

2.2 ?實(shí)驗(yàn)過程

利用1臺(tái)PC 終端與1 個(gè)協(xié)調(diào)器節(jié)點(diǎn)、1 個(gè)路由節(jié)點(diǎn)、6個(gè)終端采集節(jié)點(diǎn)作為本次實(shí)驗(yàn)的多傳感器數(shù)據(jù)融合置信度的測(cè)試設(shè)備,以Matlab作為本次實(shí)驗(yàn)的平臺(tái),對(duì)農(nóng)業(yè)物聯(lián)網(wǎng)中多傳感器數(shù)據(jù)進(jìn)行融合。為了保證本次實(shí)驗(yàn)的有效性,使用基于Rough集理論的多傳感器數(shù)據(jù)融合方法、基于數(shù)據(jù)信息轉(zhuǎn)換的多傳感器數(shù)據(jù)融合方法與本文提出的農(nóng)業(yè)物聯(lián)網(wǎng)中多傳感器數(shù)據(jù)智能融合方法進(jìn)行融合置信度比較。

2.3 ?實(shí)驗(yàn)結(jié)果

融合置信度對(duì)比如圖3所示。

通過圖3可知,基于Rough集理論的多傳感器數(shù)據(jù)融合方法的融合置信度最高為0.812;基于數(shù)據(jù)信息轉(zhuǎn)換的多傳感器數(shù)據(jù)融合方法的融合置信度最高為0.68;農(nóng)業(yè)物聯(lián)網(wǎng)中多傳感器數(shù)據(jù)智能融合方法的融合置信度最高為0.965。通過比較可知,農(nóng)業(yè)物聯(lián)網(wǎng)中多傳感器數(shù)據(jù)智能融合方法的融合置信度最高,驗(yàn)證了所提方法的優(yōu)越性。

- 現(xiàn)代電子技術(shù)的其它文章

- 基于虛擬現(xiàn)實(shí)技術(shù)的園林景觀規(guī)劃效果模擬系統(tǒng)設(shè)計(jì)

- 基于不同能耗計(jì)算方法的綠色建筑節(jié)能評(píng)價(jià)系統(tǒng)

- 基于Hadoop平臺(tái)的崗位推薦系統(tǒng)設(shè)計(jì)

- 基于Matlab的飛機(jī)機(jī)翼結(jié)構(gòu)拓?fù)鋬?yōu)化設(shè)計(jì)

- 基于GIS的土地區(qū)域整理項(xiàng)目規(guī)劃輔助系統(tǒng)設(shè)計(jì)

- 突觸晶體管及其神經(jīng)形態(tài)系統(tǒng)應(yīng)用