基于卷積神經網絡的出血圖像檢測

葉林飛 徐建省 孔德昱

摘? 要: 為了實現消化道圖像中出血病灶的自動識別,本文提出了一種基于卷積神經網絡的圖像識別系統。該識別系統使用python以及TensorFlow進行卷積神經網絡的搭建,并通過對比不同網絡結構的識別準確度,選擇合適的網絡參數和訓練參數,最后利用網絡的識別結果,通過區域回歸方法標記圖像中的病灶區域。最終的實驗結果表明:該圖像識別系統的對于消化道出血圖像的識別準確度可達92.30%,并能夠在圖像中標記出血區域。

關鍵詞: 圖像;卷積神經網絡;出血;檢測

【Abstract】: In order to realize automatic recognition of hemorrhagic lesions in digestive tract images, an image recognition system based on convolution neural network is proposed in this paper. The recognition system used Python and TensorFlow to construct convolution neural network. By comparing the recognition accuracy of different network structures, the appropriate network parameters and training parameters were selected. Finally, the recognition results of the network were used to mark the lesion area in the image by regression method. The result shows that the recognition accuracy of the image recognition system for gastrointestinal bleeding image are measured as 92.30%, and the bleeding area can be marked in the image.

【Key words】: Images; Convolutional neural network; Bleeding; Detection

0? 引言

消化道出血是十分常見的一種消化道疾病,也是判別消化道是否存在病灶的主要依據之一。近年來發展迅速的膠囊內窺鏡由于其具有非侵入性而受到患者喜愛,并且由于其能夠觀察小腸而成為消化道疾病檢查的主要方法之一[1]。目前,對于膠囊內窺鏡圖像的出血檢測主要是通過醫生觀察全部的膠囊內窺鏡產生的圖像。膠囊內窺鏡依靠消化道蠕動而前進,在消化道內工作時間大約為7小時,單次檢測所產生的圖片往往多達55000張[2]。在如此巨大數量下進行出血檢測是十分耗時且枯燥的工作,因此,利用計算機技術進行出血病灶的智能檢測是一個必然的趨勢。

現有的出血病灶識別方法主要通過前期的特征提取以及特定分類器的訓練,利用分類器對于圖像的判別結果從而判別是否存在出血病灶。常使用的手工特征包括圖像的顏色特征[3-5]、結構特征[6-7]等。在獲得手工特征后,需要使用分類器對圖像進行判別,常使用的分類器包括多層感知機[5-7],支持向量機[4-8]等。

Sonu等[2]使用紅綠藍(RGB)空間的顏色特征如均值、標準差、能量等,用于識別無線膠囊胃鏡出血圖像,并對比了使用不同特征的結合組合的識別效果。Li等[5]利用色調、色飽和度、亮度(HSI)空間的顏色特征和多層感知機進行識別。Sindhu等[7]通過計算感興趣區域的區塊的SIFT特征和灰度共生矩陣等結構特征,并利用多層感知機用于識別圖像。Yi等[8]使用最小生成樹對圖像進行聚類,并使用支持向量機對圖像進行識別分類。Pan等[9]在HSI顏色空間對圖像進行分割后使用概率神經網絡(PNN)進行識別。

手工特征的選取需要根據出血病灶在圖像上的具體表現,專門針對某種表現而設計,因此對特定目標十分有效。但是,手工特征需要與分類器結合才可發揮作用,并且手工特征僅僅針對單一表現,無法根據圖像信息進行優化。因此,需要尋找一種更加優異的方法用于檢測出血病灶圖像。

隨著計算機技術和深度學習技術的發展,使用卷積神經網絡(CNN)用于識別膠囊內窺鏡圖像中的病灶成為一種新的圖像識別方法。CNN不僅能夠用于圖像分類任務[10-14],也可用于圖像中的病灶識別任務[14-15]。CNN相比于手工特征,其能夠尋找到手工特征無法描述的特征共性,從而能夠達到更優的識別效果。

本文提出了一種使用卷積神經網絡用于識別膠囊內窺鏡圖像中的出血病灶的方法,首先將出血區域的圖像作為網絡的輸入,之后通過卷積層獲取到卷積特征,并利用降采樣減少特征數量,之后使用全連接層獲得能夠進行分類的特征,最后將特征輸入到分類器中進行分類,獲得分類結果。訓練后的網絡可對圖像進行識別分類,并可通過處理分類結果獲得出血病灶區域。

1? 卷積神經網絡

神經網絡最初由Lecun等人提出[16],之后經過多次改進,最終形成了較為成熟的可完成現實任務的網絡[17-20]。本文提出了一個共9層的卷積神經網絡,網絡包括3層卷積層(C1-C3)、3層最大值池化層(MP1-MP3)、以及3層全連接層(FC1-FC3)。網絡的具體結構如圖1所示。本文使用線性整流函數(Relu)作為3層卷積層和前兩層全連接層的激活函數。使用最大值池化函數(Maxpool)選取池化層輸入的最大值,從而減少需要計算的數據量。最后,使用柔性最大值(Softmax)函數作為第三層全連接層的激活函數,其具有兩個神經元,能夠輸出是否為出血或正常的分類結果。

1.2? 訓練過程

本文使用的CNN網絡采用Python與TensorFlow進行編寫,選取的批尺寸(Batchsize)為30,學習率(Learning rate)為0.0001,迭代次數為5000。

2? 實驗結果與分析

2.1? 消化道圖像的選取

本文使用的圖像集來自于金山公司提供的膠囊內鏡臨床疾病圖譜[21],共有1700張圖像,圖像大小為120×120×3,其中1200張用于訓練,500張用于測試,訓練和測試所使用的正常和出血圖像數量的比例為3∶1。如圖2所示,使用的正常圖像共1200張,出血圖像共500張圖像。出血圖像類型主要有兩種,點狀出血的以及片狀出血。點狀出血表現為單個或多個深紅色點狀出血區域,塊狀出血多為塊狀淺紅色或鮮紅色區域。

2.2? 網絡結構的選擇

為了選取最適合圖像數據集的網絡結構,本文對比了使用不同大小卷積核的網絡的識別準確度,并對比了全連接層的神經元個數對網絡識別準確度的影響。在卷積層C1、C2和C3中,使用的卷積核個數分別為32、64和128。如表1所示,通過改變使用的卷積核大小,圖像的識別準確度也有所變化。針對使用的圖像數據集而言,若使用5×5的卷積核,識別結果并不可以達到文獻中所描述的較高的準確度00。若使用11×11的卷積核,識別準確度明顯下降。結果顯示,在使用全部大小為3×3的卷積核時,網絡的識別率達到最高,大約為92.3%。

通過設置全連接層FC1和FC2的神經元結點個數,對比不同情況下的識別準確度,最終確定全連接層FC1和FC2所使用的神經元結點數。如表2所示,由于第三層卷積層的卷積核個數為128,若第一層全連接層的神經元結點數在其1/2和兩倍之間,識別準確度變化不大,但是若超出一定范圍后,識別準確度有較大的下降。第二層全連接層的神經元結點個數在合適范圍內能夠保證識別準確度基本不變,但結點數不可超過256個。結果顯示,在使用全連接層神經元個數分別為128和32的網絡的識別準確度最高。

2.3? 訓練參數的選擇

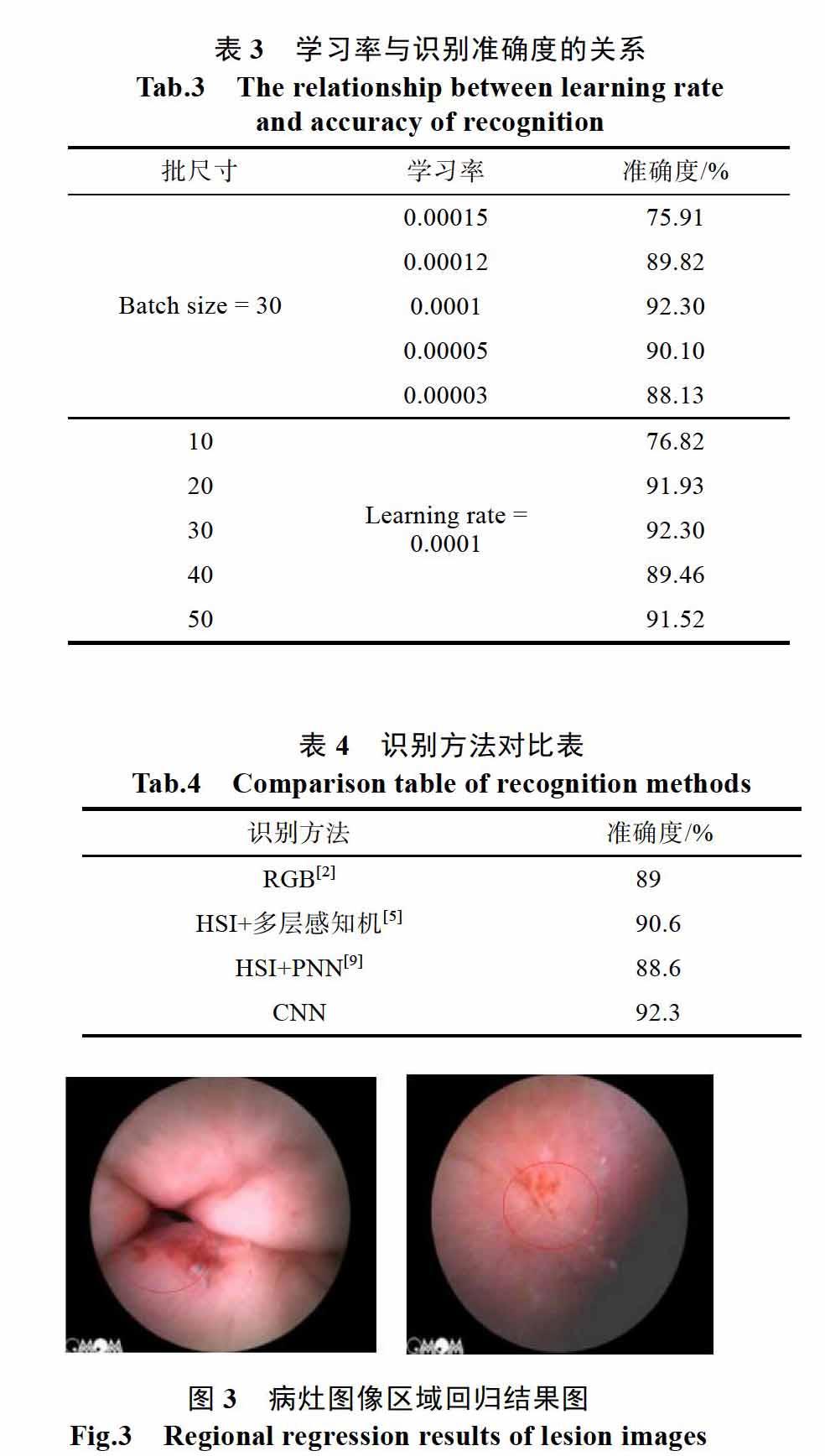

訓練參數尤其是批尺寸和學習率的選擇不僅影響訓練時的計算時間,而且對于最終的識別準確度也有一定的影響。針對訓練參數對準確度的影響,本文通過對比在不同參數值情況下的識別準確度,獲得最適合于數據集的參數。具體數值如表3所示。

如表3所示,學習率對于準確度的影響較大,并且學習率對于準確度的有效區間較小,往往需要對學習率進行微調,以達到最佳系數,因此在確認網絡結構時需要先確定學習率的大小。網絡使用的批尺寸大小與識別準確度的關系并不密切,但不可小于20。通過比較使用不同的批尺寸和學習率的網絡識別準確度,選擇批尺寸為30,學習率為0.0001時,能夠達到最佳的準確度。

最后,本文對比了不同識別方法對于出血圖像的識別準確度,如表4所示。所對比的方法包括Sonu等[2]使用的基于RGB空間的方法、Li等[5]使用的基于HSI和多層感知機的方法、Pan等[9]使用的基于HSI和PNN的方法以及本文使用的基于CNN的識別方法。使用的數據為同一數據集。結果顯示,對比與傳統識別方法,基于CNN的識別方法有其優? 越性。

2.4? 區域回歸

在獲得最終的分類網絡后,由于網絡訓練和測試時使用的圖像大小為120×120,而膠囊內窺鏡獲得的圖像大小為576×576,因此,需要對大圖像進行區域提取,獲得120×120的圖像,之后在輸入到網絡中進行分類,獲得分類結果。通過對分類結果進行處理,能夠獲得圖像的區域信息,判斷某個區域是否存在病灶,最后對該區域進行標記,標記結果如圖3所示。

如圖3所示,通過病灶區域回歸步驟,能夠獲得病灶區域的大致位置,雖然可能由于準確度不足而無法標記到準確位置,但對于較為明顯的病灶,標記結果尚可。

3? 結論

本文使用卷積神經網絡用于膠囊內窺鏡圖像中的出血病灶識別,通過對比不同網絡結構以及網絡參數和訓練參數下的準確度,獲得最佳的卷積核大小、數量、批尺寸大小以及學習率,最終網絡的分類準確度可達92.30%。最后,在獲得分類結果后,使用區域回歸方法獲得病灶的區域并標記。未來需要提高分類的準確度從而使區域標記更加準確,提高分類準確度可通過改進網絡結構、增加圖像特征等方法實現。

參考文獻

[1] 張偉, 謝德明. 膠囊內鏡的技術進展及臨床應用[J]. 生物醫學工程與臨床, 2012, 16(05): 499-503.

[2] Sainju Sonu, Bui Francis M, Wahid Khan, Bleeding detection in wireless capsule endoscopy based on color features from histogram probability[J]. doi: 10.1109/CCECE.2013.6567779. 2013 26th IEEE Canadian Conference on Electrical and Computer Engineering (CCECE), 2013: 1-4.

[3] 潘國兵. 無線膠囊內窺鏡系統及內窺圖像中出血智能識別研究[D]. 上海交通大學, 2010: 73-79.

[4] Ghosh T, Bashar S. K, Fattah S. A, Shahnaz C, Wahid K. A, A feature extraction scheme from region of interest of wireless capsule endoscopy images for automatic bleeding detection[J]. doi: 10.1109/ISSPIT.2014.7300597. 2014 IEEE International Symposium on Signal Processing and Information Technology (ISSPIT), 2014: 000256-000260.

[5] Li B, Meng M Q. Computer-aided detection of bleeding regions for capsule endoscopy images.[J]. IEEE transactions on bio-medical engineering, 2009, 56(4): 1032.

[6] Kumar R, Qian Zhao, Seshamani S, Mullin G, Hager G, Dassopoulos T, Assessment of Crohn's Disease Lesions in Wireless Capsule Endoscopy Images[J]. doi:10.1109/TBME. 2011.2172438. IEEE Transactions on Biomedical Engineering, 2012, 2: 355-362.

[7] Sindhu C. P, Valsan Vysak, A novel method for automatic detection of inflammatory bowel diseases in wireless capsule endoscopy images[J]. doi: 10.1109/ICSCN.2017.8085711. 2017 Fourth International Conference on Signal Processing, Communication and Networking (ICSCN), 2017: 1-6.

[8] Yi Xiong, Yiting Zhu, Zhiyong Pang, Yuzhe Ma, Dihu Chen, Xinying Wang, Bleeding detection in wireless capsule endoscopy based on MST clustering and SVM[J]. doi:10.1109/ SiPS.2015.7345001. 2015 IEEE Workshop on Signal.

[9] Guobing Pan, Guozheng Yan, Xiangling Qiu, and Jiehao Cui. Bleeding detection in wireless capsule endoscopy based on probabilistic neural network. Journal of medical systems, 35(6): 1477-1484, 2011.

[10] 張曉明, 尹鴻峰. 基于卷積神經網絡和語義信息的場景分類[J]. 軟件, 2018, 39(01): 29-34.

[11] 劉騰飛, 于雙元, 張洪濤, 等. 基于循環和卷積神經網絡的文本分類研究[J]. 軟件, 2018, 39(01): 64-69.

[12] 宋婷婷, 徐世許. 基于全采樣和L1范數降采樣的卷積神經網絡圖像分類方法[J]. 軟件, 2018, 39(2): 75-80.

[13] 吳亞熙, 岑峰. 基于卷積神經網絡的多層級目標檢測方法[J]. 軟件, 2018, 39(4): 164-169.

[14] Jia Xiao, Meng Max Q.-H, Gastrointestinal bleeding detection in wireless capsule endoscopy images using handcrafted and CNN features[J]. doi: 10.1109/EMBC.2017.8037526. 2017 39th Annual International Conference of the IEEE Engineering in Medicine and Biology Society (EMBC), 2017: 3154-3157.

[15] Jia X, Meng M Q, Xiao J, et al. A deep convolutional neural network for bleeding detection in Wireless Capsule Endoscopy images.[J]. IEEE Engineering in Medicine and Biology Society, 2016: 639-642.

[16] Lecun Y, Bottou L, Bengio Y, Haffner P, Gradient-based learning applied to document recognition[J]. doi: 10.1109/ 5.726791. Proceedings of the IEEE, 1998, 11: 2278-2324.

[17] Krizhevsky Alex, Sutskever Ilya, Hinton Geoffrey, ImageNet classification with deep convolutional neural networks[J]. doi: 10.1145/3065386. Communications of the ACM, 2017, 6: 84-90.

[18] Simonyan K, Zisserman A. Very Deep Convolutional Networks for Large-Scale Image Recognition[J]. Computer Science, 2014.

[19] 蒲杰方, 盧熒玲. 基于聚類算法和神經網絡的客戶分類模型構建[J]. 軟件, 2018, 39(4): 130-136.

[20] 趙文可, 孫玉國. 彈性RBF神經網絡在人臉識別中的應用研究[J]. 軟件, 2018, 39(5): 203-206.

[21] 重慶金山科技有限公司. 膠囊內鏡臨床疾病圖譜[OL]. (2018-12-19). http://www.jinshangroup.com/